1.本发明涉及图像处理领域,具体地,涉及一种眼底糖网图像病灶分割集成的方法及系统。

背景技术:

2.糖尿病性视网膜病变是指由视网膜毛细血管、小动脉、小静脉的病理性改变,以及这些微血管组织渗漏或阻塞而引起的一系列病变。糖尿病性视网膜病变会导致不同程度的视力减退,甚至失明。视网膜眼底图像是观察和诊断糖尿病性视网膜病变的一种重要影像手段。然而,在采集眼底图像数据的过程中不可避免地受到传统光学镜头视场角不足、瞳孔和屈光间质要求高、存在电子系统噪声、图像采集环境不理想等因素影响,导致采集的眼底图像数据对于发现、分析糖尿病性视网膜病变的病灶表现位置与形态等方面仍有不足。

3.现有技术中,存在针对眼底糖网图像病灶分割的精确度不高,进而导致眼底糖网图像病灶分割的效果不佳的技术问题。

技术实现要素:

4.本技术提供了一种眼底糖网图像病灶分割集成的方法及系统,解决了现有技术中针对眼底糖网图像病灶分割的精确度不高,进而导致眼底糖网图像病灶分割的效果不佳的技术问题。

5.鉴于上述问题,本技术提供了一种眼底糖网图像病灶分割集成的方法及系统。

6.第一方面,本技术提供了一种眼底糖网图像病灶分割集成的方法,其中,所述方法应用于一种眼底糖网图像病灶分割集成的系统,所述方法包括:通过超广角激光图像采集装置获得多角度眼底图像集合;基于所述训练数据增强模块对所述多角度眼底图像集合进行数据增强,获得扩充多角度眼底图像集合;

7.将所述扩充多角度眼底图像集合作为训练样本数据,通过所述基础网络训练模块使用深度学习网络结构对所述训练样本数据进行语义分割训练,获得基础分割模型;将所述基础分割模型作为输入信息,通过所述移动端网络集成模块对所述输入信息和所述训练样本数据进行集成训练,获得移动端集成分割模型;

8.基于所述移动端集成分割模型,获得模型输出结果,所述模型输出结果包括特征点分割结果图像集合;通过所述特征点识别校正模块对所述特征点分割结果图像集合进行识别网络训练,获得特征点识别网络模型;获取待处理目标糖网眼底图像;将所述待处理目标糖网眼底图像作为输入图像信息,输入至所述移动端集成分割模型和所述特征点识别网络模型中,获得眼底糖网分割图像。

9.第二方面,本技术还提供了一种眼底糖网图像病灶分割集成的系统,其中,所述系统包括:图像采集模块,所述图像采集模块用于通过超广角激光图像采集装置获得多角度眼底图像集合;训练数据增强模块,所述训练数据增强模块用于对所述多角度眼底图像集合进行数据增强,获得扩充多角度眼底图像集合;基础网络训练模块,所述基础网络训练模

块用于将所述扩充多角度眼底图像集合作为训练样本数据,通过所述基础网络训练模块使用深度学习网络结构对所述训练样本数据进行语义分割训练,获得基础分割模型;移动端网络集成模块,所述移动端网络集成模块用于将所述基础分割模型作为输入信息,通过所述移动端网络集成模块对所述输入信息和所述训练样本数据进行集成训练,获得移动端集成分割模型;中间输出模块,所述中间输出模块用于基于所述移动端集成分割模型,获得模型输出结果,所述模型输出结果包括特征点分割结果图像集合;特征点识别校正模块,所述特征点识别校正模块用于通过所述特征点识别校正模块对所述特征点分割结果图像集合进行识别网络训练,获得特征点识别网络模型;信息采集模块,所述信息采集模块用于获取待处理目标糖网眼底图像;处理模块,所述处理模块用于将所述待处理目标糖网眼底图像作为输入图像信息,输入至所述移动端集成分割模型和所述特征点识别网络模型中,获得眼底糖网分割图像。

10.本技术中提供的一个或多个技术方案,至少具有如下技术效果或优点:

11.通过超广角激光图像采集装置获得多角度眼底图像集合;利用训练数据增强模块对其进行数据增强,获得扩充多角度眼底图像集合;将扩充多角度眼底图像集合作为训练样本数据,通过所述基础网络训练模块使用深度学习网络结构对其进行语义分割训练,获得基础分割模型;将基础分割模型作为输入信息,通过所述移动端网络集成模块对所述输入信息和所述训练样本数据进行集成训练,获得移动端集成分割模型;基于此,获得模型输出结果,所述模型输出结果包括特征点分割结果图像集合;通过所述特征点识别校正模块对所述特征点分割结果图像集合进行识别网络训练,获得特征点识别网络模型;获取待处理目标糖网眼底图像;将所述待处理目标糖网眼底图像作为输入图像信息,输入至所述移动端集成分割模型和所述特征点识别网络模型中,获得眼底糖网分割图像。达到了提高眼底糖网图像病灶分割的精确度和准确性,提高眼底糖网图像病灶分割的效果和质量;同时,设计一种优化眼底糖网图像病灶分割的方法,实现基于移动端的糖网眼底图像的多类别病灶精细分割过程,在移动端高效分析糖网眼底图像的多类别病灶位置轮廓信息的技术效果。

附图说明

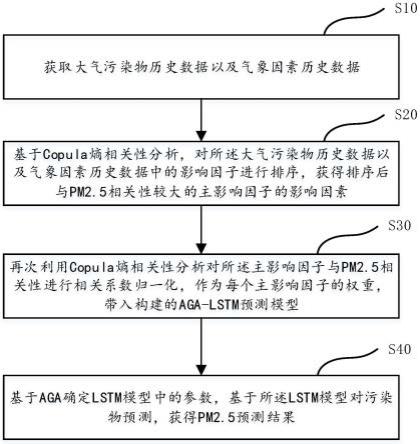

12.图1为本技术一种眼底糖网图像病灶分割集成的方法的流程示意图;

13.图2为本技术一种眼底糖网图像病灶分割集成的方法中对第一标准角度眼底图像集合和第二标准角度眼底图像集合进行图像拼接,获得多角度眼底图像集合的流程示意图;

14.图3为本技术一种眼底糖网图像病灶分割集成的方法中获得扩充多角度眼底图像集合的流程示意图;

15.图4为本技术一种眼底糖网图像病灶分割集成的方法中获得预测语义分割结果的流程示意图;

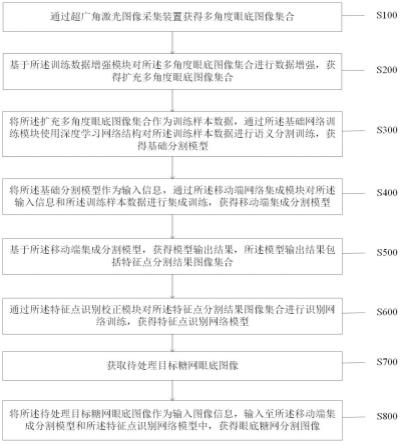

16.图5为本技术一种眼底糖网图像病灶分割集成的系统的结构示意图。

17.附图标记说明:图像采集模块11,训练数据增强模块12,基础网络训练模块13,移动端网络集成模块14,中间输出模块15,特征点识别校正模块16,信息采集模块17,处理模块18。

具体实施方式

18.本技术通过提供一种眼底糖网图像病灶分割集成的方法及系统,解决了现有技术中针对眼底糖网图像病灶分割的精确度不高,进而导致眼底糖网图像病灶分割的效果不佳的技术问题。达到了提高眼底糖网图像病灶分割的精确度和准确性,提高眼底糖网图像病灶分割的效果和质量;同时,设计一种优化眼底糖网图像病灶分割的方法,实现基于移动端的糖网眼底图像的多类别病灶精细分割过程,在移动端高效分析糖网眼底图像的多类别病灶位置轮廓信息的技术效果。

19.实施例一

20.请参阅附图1,本技术提供一种眼底糖网图像病灶分割集成的方法,其中,所述方法应用于一种眼底糖网图像病灶分割集成的系统,所述方法具体包括如下步骤:

21.步骤s100:通过超广角激光图像采集装置获得多角度眼底图像集合;

22.进一步的,本技术步骤s100还包括:

23.步骤s110:所述超广角激光图像采集装置包括第一波长激光器和第二波长激光器;

24.步骤s120:基于所述第一波长激光器和所述第二波长激光器获得第一角度眼底图像集合;

25.步骤s130:获取角度采集区域不同的第二角度眼底图像集合;

26.步骤s140:将所述第一角度眼底图像集合和所述第二角度眼底图像集合进行去噪处理,获得第一标准角度眼底图像集合和第二标准角度眼底图像集合;

27.步骤s150:对所述第一标准角度眼底图像集合和第二标准角度眼底图像集合进行图像拼接,获得所述多角度眼底图像集合。

28.具体而言,不同波长的激光器具有不同的组织穿透能力,多色照片在图像上能够展示不同层次的眼底病灶组织特征。本技术所采用的超广角激光图像采集装置具有第一波长激光器和第二波长激光器。通过所述第一波长激光器和所述第二波长激光器对获取角度采集区域进行图像采集,获得第一角度眼底图像集合;再利用所述第一波长激光器和所述第二波长激光器对获取角度采集区域进行不同角度的图像采集,获得第二角度眼底图像集合。进而,获得的第一角度眼底图像集合和第二角度眼底图像集合在图像采集、图像传输的过程中不可避免地受到超广角激光图像采集装置、外部环境噪声干扰等影响,具有较高的噪声,降低了图像的精确度。优选地,本技术采用去噪处理,降低第一角度眼底图像集合和第二角度眼底图像集合的噪声后,获得第一标准角度眼底图像集合和第二标准角度眼底图像集合,并对其进行图像拼接后,获得所述多角度眼底图像集合。

29.其中,所述角度采集区域是使用超广角激光图像采集装置对存在出血、微血管瘤、硬性渗出、软性渗出、新生血管纤维增殖膜、微血管异常等多种类型的糖网病灶的视网膜眼底进行图像采集的区域。所述多角度眼底图像集合是将第一标准角度眼底图像集合和第二标准角度眼底图像集合(即两个波长的激光图像)组合成的多色照片数据信息,具有穿透能力强、不易被屈光介质吸收/反射、便于疾病鉴别诊断等作用。

30.示例性地,所述超广角激光图像采集装置可以为超广角激光共焦眼底相机(微清cro),与传统的光学眼底相机相比,超广角激光共焦眼底相机具有适应更广泛的患者、无需散瞳、无需暗室、穿透力更强、检测速度更快等优点。所述第一波长激光器可以为532nm波长

激光器。所述第二波长激光器可以为785nm波长激光器。超广角激光共焦眼底相机还具有多角度广角镜头光学设计,当角度采集区域为黄斑区时,超广角激光共焦眼底相机采用15

°

的镜头对黄斑区进行图像采集,获得第一角度眼底图像集合;超广角激光共焦眼底相机再采用30

°

的镜头对黄斑区进行图像采集,获得第二角度眼底图像集合。

31.达到了利用超广角激光图像采集装置获得第一角度眼底图像集合、第二角度眼底图像集合,并对其进行去噪处理、图像拼接后,获得精确度较高的多角度眼底图像集合,进而提高病灶的检出率,避免病灶遗漏的技术效果。

32.进一步的,如附图2所示,本技术步骤s150还包括:

33.步骤s151:基于所述第一标准角度眼底图像集合和所述第二标准角度眼底图像集合进行基准图像选择,获得眼底基准图像;

34.步骤s152:根据所述眼底基准图像,构建基准图像坐标系;

35.步骤s153:基于所述眼底基准图像,获取待拼接眼底图像集合;

36.步骤s154:将所述待拼接眼底图像集合在所述基准图像坐标系中进行关系映射,确定图像转换矩阵;

37.步骤s155:基于所述图像转换矩阵将所述待拼接眼底图像集合转换拼接至所述眼底基准图像,获得所述多角度眼底图像集合。

38.具体而言,在对第一标准角度眼底图像集合和第二标准角度眼底图像集合进行图像拼接时,首先,在第一标准角度眼底图像集合和第二标准角度眼底图像集合中选择基准图像,确定眼底基准图像,并根据其获得基准图像坐标系和待拼接眼底图像集合;进而,将所述待拼接眼底图像集合映射至所述基准图像坐标系,确定图像转换矩阵,并利用其对所述待拼接眼底图像集合与所述眼底基准图像进行转换拼接,获得所述多角度眼底图像集合。

39.其中,所述眼底基准图像是所述第一标准角度眼底图像集合和所述第二标准角度眼底图像集合中的任一图像。所述基准图像坐标系是以眼底基准图像为原点的坐标系。所述待拼接眼底图像集合是在所述第一标准角度眼底图像集合和所述第二标准角度眼底图像集合中,进行眼底基准图像的去除后的图像数据信息。所述图像转换矩阵是用于表征所述待拼接眼底图像集合与所述基准图像坐标系之间的映射关系的数据信息。同时,所述图像转换矩阵也可表征待拼接眼底图像集合在基准图像坐标系中的具体位置坐标信息。所述多角度眼底图像集合是利用图像转换矩阵对待拼接眼底图像集合进行旋转、平移等转换拼接等操作,将待拼接眼底图像集合与眼底基准图像拼接后的广角度、全范围的眼底图像数据信息。达到了利用图像转换矩阵进行较为准确的图像拼接,获得准确性和可信度较高的多角度眼底图像集合,为后续获得扩充多角度眼底图像集合提供数据支持的技术效果。

40.步骤s200:基于所述训练数据增强模块对所述多角度眼底图像集合进行数据增强,获得扩充多角度眼底图像集合;

41.进一步的,如附图3所示,本技术步骤s200还包括:

42.步骤s210:获取图像增强类型信息,所述图像增强类型信息包括旋转、水平翻转、垂直翻转、缩放;

43.步骤s220:根据所述图像增强类型信息,确定眼底图像变化系数;

44.步骤s230:基于所述眼底图像变化系数对所述多角度眼底图像集合进行数据扩增

变化输出,获得所述扩充多角度眼底图像集合。

45.具体而言,由所述一种眼底糖网图像病灶分割集成的系统的训练数据增强模块对多角度眼底图像集合进行智能分析后,确定图像增强类型信息,并根据其获得眼底图像变化系数;进一步,训练数据增强模块通过眼底图像变化系数对多角度眼底图像集合进行数据扩增,获得所述扩充多角度眼底图像集合。其中,所述图像增强类型信息是用于表征多角度眼底图像集合需要的数据增强处理方式的数据信息。所述图像增强类型信息包括旋转、水平翻转、垂直翻转、缩放。所述眼底图像变化系数是用于表征多角度眼底图像集合中每个图像对应的图像增强类型、具体的图像增强步骤、图像增强程度等参数的数据信息。所述扩充多角度眼底图像集合是通过眼底图像变化系数对多角度眼底图像集合中每个图像进行扩增后的数据信息。达到了利用训练数据增强模块对所述多角度眼底图像集合进行数据增强,避免过度拟合,获得数据量较多的扩充多角度眼底图像集合,为后续的基础网络训练模块使用深度学习网络结构对其进行语义分割训练奠定基础的技术效果。

46.步骤s300:将所述扩充多角度眼底图像集合作为训练样本数据,通过所述基础网络训练模块使用深度学习网络结构对所述训练样本数据进行语义分割训练,获得基础分割模型;

47.进一步的,如附图4所示,本技术步骤s300还包括:

48.步骤s310:将所述扩充多角度眼底图像集合中的图像划分为预设尺寸的重叠图像块集合;

49.步骤s320:所述深度学习网络结构包括网络编码器和网络解码器;

50.步骤s330:将所述重叠图像块集合作为输入信息输入至所述网络编码器中,获得图像多尺度特征;

51.步骤s340:将所述图像多尺度特征输入所述网络解码器中,获得预测语义分割结果。

52.具体而言,由所述一种眼底糖网图像病灶分割集成的系统的基础网络训练模块自动对已获得的扩充多角度眼底图像集合中的图像进行预设尺寸的划分,获得重叠图像块集合。进而,将所述重叠图像块集合作为输入信息,输入网络编码器,获取图像多尺度特征,再将该图像多尺度特征作为输入信息,输入网络解码器,获得预测语义分割结果。其中,所述网络编码器和所述网络解码器均包含于所述深度学习网络结构。所述预设尺寸可由基础网络训练模块预先设置确定,也可以根据实际情况进行自适应设置。所述重叠图像块集合是对扩充多角度眼底图像集合中的图像进行预设尺寸的划分后的图像数据信息。示例性地,所述扩充多角度眼底图像集合是大小为h

×w×

3的图像。所述预设尺寸为7*7。由基础网络训练模块对扩充多角度眼底图像集合进行预设尺寸的划分后,获得的重叠图像块集合是尺寸大小为7*7的扩充多角度眼底图像集合,较小的图像块有利于对病变密集的眼底图像的预测需求。所述图像多尺度特征包括重叠图像块集合中的图像的宽度、高度,相邻图像之间的距离等参数信息。所述基础分割模型是通过基础网络训练模块使用深度学习网络结构对扩充多角度眼底图像集合进行语义分割训练后获得的模型。达到了获得准确性较高的基础分割模型,为后续确定移动端集成分割模型提供数据支持的技术效果。

53.进一步的,本技术步骤s340还包括:

54.步骤s341:所述网络解码器由一个mlp层组成;

55.步骤s342:通过所述mlp层统一所述图像多尺度特征的通道尺寸;

56.步骤s343:基于所述通道尺寸对所述图像多尺度特征进行特征采样和特征连接;

57.步骤s344:采用所述mlp层融合串联特征,并基于所述串联特征添加一层mlp层获得所述预测语义分割结果。

58.具体而言,为了减少计算量并提高效率,所述网络解码器仅由一个mlp层组成。利用所述mlp层可以对所述图像多尺度特征的通道尺寸进行统一,再利用通道尺寸对所述图像多尺度特征进行特征采样和特征连接,基于此,采用mlp层对串联特征进行融合,并根据其添加一层mlp层获得所述预测语义分割结果。其中,所述mlp层意为多层感知机(mlp,multi-layer perceptron),由感知机推广而来。它的特点是具有多个神经元层,因此又称深度神经网络。神经网络的预测能力来自网络的分层或多层结构。多层感知机是指至少具有三层节点,输入层、中间层和输出层的神经网络。所述串联特征包括图像多尺度特征进行特征采样和特征连接后的重合特征。所述特征采样可对图像多尺度特征中的任意特征进行采样。所述预测语义分割结果是用于表征图像多尺度特征对应的病灶特征分割结果的数据信息。达到了获得准确性较高的预测语义分割结果,为后续获得基础分割模型奠定基础的技术效果。

59.步骤s400:将所述基础分割模型作为输入信息,通过所述移动端网络集成模块对所述输入信息和所述训练样本数据进行集成训练,获得移动端集成分割模型;

60.步骤s500:基于所述移动端集成分割模型,获得模型输出结果,所述模型输出结果包括特征点分割结果图像集合;

61.具体而言,将获得的基础分割模型作为输入信息,输入所述移动端网络集成模块,并结合所述训练样本数据进行集成训练,获得移动端集成分割模型,并利用其获得特征点分割结果图像集合。其中,所述训练样本数据为扩充多角度眼底图像集合。与基础网络训练模块相比,移动端网络集成模块的参数更少,网络更加轻量。所述特征点分割结果图像集合包括病灶特征对应图像数据信息。达到了获得移动端集成分割模型,并根据其确定特征点分割结果图像集合,为后续获得特征点识别网络模型提供数据支持的技术效果。

62.步骤s600:通过所述特征点识别校正模块对所述特征点分割结果图像集合进行识别网络训练,获得特征点识别网络模型;

63.进一步的,本技术步骤s600还包括:

64.步骤s610:根据所述特征点识别校正模块,获得级联分类器;

65.步骤s620:所述级联分类器选择densenet作为分类图像网络;

66.步骤s630:根据所述分类图像网络对所述特征点分割结果图像集合进行分类校正,获得特征点分割图像类型;

67.步骤s640:基于所述特征点分割图像类型进行识别网络训练,获得所述特征点识别网络模型。

68.具体而言,由于糖网眼底图像上的小面积出血与微血管瘤外观相似,难以对二者进行区分。因此,为了确保准确性,对特征点识别校正模块连接级联分类器,专门用于对特征点分割结果图像集合进行分类校正。所述级联分类器选择densenet作为分类图像网络,在确保网络各层之间最大信息传输的前提下,直接连接所有层,使用快捷方式连接将输入从一个块传递到另一个块。所述特征点分割图像类型是对特征点分割结果图像集合进行病

灶类型的分类、校正后的数据信息。所述特征点识别网络模型是对特征点分割图像类型进行识别网络训练后的神经网络模型。达到了获得精确度和可靠性较高的特征点识别网络模型,进而提高后续获得的眼底糖网分割图像的精确度的技术效果。

69.步骤s700:获取待处理目标糖网眼底图像;

70.步骤s800:将所述待处理目标糖网眼底图像作为输入图像信息,输入至所述移动端集成分割模型和所述特征点识别网络模型中,获得眼底糖网分割图像。

71.具体而言,通过将所述待处理目标糖网眼底图像作为输入信息,输入至移动端集成分割模型和特征点识别网络模型,经过移动端集成分割模型和特征点识别网络模型复杂而高效的计算后,获得眼底糖网分割图像。其中,所述待处理目标糖网眼底图像是使用所述一种眼底糖网图像病灶分割集成的系统进行智能化图像分割、病灶分析的任意糖网眼底图像数据信息。所述眼底糖网分割图像包括待处理目标糖网眼底图像对应的病灶类型、病灶位置等数据信息。达到了利用移动端集成分割模型和特征点识别网络模型对待处理目标糖网眼底图像进行准确识别,获得较为精确的眼底糖网分割图像的技术效果。

72.综上所述,本技术所提供的一种眼底糖网图像病灶分割集成的方法具有如下技术效果:

73.通过超广角激光图像采集装置获得多角度眼底图像集合;利用训练数据增强模块对其进行数据增强,获得扩充多角度眼底图像集合;将扩充多角度眼底图像集合作为训练样本数据,通过所述基础网络训练模块使用深度学习网络结构对其进行语义分割训练,获得基础分割模型;将基础分割模型作为输入信息,通过所述移动端网络集成模块对所述输入信息和所述训练样本数据进行集成训练,获得移动端集成分割模型;基于此,获得模型输出结果,所述模型输出结果包括特征点分割结果图像集合;通过所述特征点识别校正模块对所述特征点分割结果图像集合进行识别网络训练,获得特征点识别网络模型;获取待处理目标糖网眼底图像;将所述待处理目标糖网眼底图像作为输入图像信息,输入至所述移动端集成分割模型和所述特征点识别网络模型中,获得眼底糖网分割图像。达到了提高眼底糖网图像病灶分割的精确度和准确性,提高眼底糖网图像病灶分割的效果和质量;同时,设计一种优化眼底糖网图像病灶分割的方法,实现基于移动端的糖网眼底图像的多类别病灶精细分割过程,在移动端高效分析糖网眼底图像的多类别病灶位置轮廓信息的技术效果。

74.实施例二

75.基于与前述实施例中一种眼底糖网图像病灶分割集成的方法,同样发明构思,本发明还提供了一种眼底糖网图像病灶分割集成的系统,请参阅附图5,所述系统包括:

76.图像采集模块11,所述图像采集模块11用于通过超广角激光图像采集装置获得多角度眼底图像集合,其中,所述超广角激光图像采集装置包括第一波长激光器和第二波长激光器;

77.训练数据增强模块12,所述训练数据增强模块12用于对所述多角度眼底图像集合进行数据增强,获得扩充多角度眼底图像集合;

78.基础网络训练模块13,所述基础网络训练模块13用于将所述扩充多角度眼底图像集合作为训练样本数据,通过所述基础网络训练模块使用深度学习网络结构对所述训练样本数据进行语义分割训练,获得基础分割模型,其中,所述深度学习网络结构包括网络编码

器和网络解码器;

79.移动端网络集成模块14,所述移动端网络集成模块14用于将所述基础分割模型作为输入信息,通过所述移动端网络集成模块对所述输入信息和所述训练样本数据进行集成训练,获得移动端集成分割模型;

80.中间输出模块15,所述中间输出模块用于15基于所述移动端集成分割模型,获得模型输出结果,所述模型输出结果包括特征点分割结果图像集合;

81.特征点识别校正模块16,所述特征点识别校正模块16用于通过所述特征点识别校正模块对所述特征点分割结果图像集合进行识别网络训练,获得特征点识别网络模型;

82.信息采集模块17,所述信息采集模块用于17获取待处理目标糖网眼底图像;

83.处理模块18,所述处理模块18用于将所述待处理目标糖网眼底图像作为输入图像信息,输入至所述移动端集成分割模型和所述特征点识别网络模型中,获得眼底糖网分割图像。

84.进一步的,所述图像采集模块还包括:

85.图像采集单元,所述图像采集单元用于基于所述第一波长激光器和所述第二波长激光器获得第一角度眼底图像集合;

86.图像获取单元,所述图像获取单元用于获取角度采集区域不同的第二角度眼底图像集合;

87.去噪处理单元,所述去噪处理单元用于将所述第一角度眼底图像集合和所述第二角度眼底图像集合进行去噪处理,获得第一标准角度眼底图像集合和第二标准角度眼底图像集合;

88.图像拼接单元,所述图像拼接单元用于对所述第一标准角度眼底图像集合和第二标准角度眼底图像集合进行图像拼接,获得所述多角度眼底图像集合。

89.进一步的,所述图像拼接单元还包括:

90.基准图像选择单元,所述基准图像选择单元用于基于所述第一标准角度眼底图像集合和所述第二标准角度眼底图像集合进行基准图像选择,获得眼底基准图像;

91.构建单元,所述构建单元用于根据所述眼底基准图像,构建基准图像坐标系;

92.待拼接处理单元,所述待拼接处理单元用于基于所述眼底基准图像,获取待拼接眼底图像集合;

93.映射单元,所述映射单元用于将所述待拼接眼底图像集合在所述基准图像坐标系中进行关系映射,确定图像转换矩阵;

94.转换拼接单元,所述转换拼接单元用于基于所述图像转换矩阵将所述待拼接眼底图像集合转换拼接至所述眼底基准图像,获得所述多角度眼底图像集合。

95.进一步的,所述训练数据增强模块还包括:

96.增强类型处理单元,所述增强类型处理单元用于获取图像增强类型信息,所述图像增强类型信息包括旋转、水平翻转、垂直翻转、缩放;

97.变化系数单元,所述变化系数单元用于根据所述图像增强类型信息,确定眼底图像变化系数;

98.数据扩增单元,所述数据扩增单元用于基于所述眼底图像变化系数对所述多角度眼底图像集合进行数据扩增变化输出,获得所述扩充多角度眼底图像集合。

99.进一步的,所述基础网络训练模块还包括:

100.图像划分单元,所述图像划分单元用于将所述扩充多角度眼底图像集合中的图像划分为预设尺寸的重叠图像块集合;

101.尺度特征单元,所述尺度特征单元用于将所述重叠图像块集合作为输入信息输入至所述网络编码器中,获得图像多尺度特征;

102.语义分割单元,所述语义分割单元用于将所述图像多尺度特征输入所述网络解码器中,获得预测语义分割结果,其中,所述网络解码器由一个mlp层组成。

103.进一步的,所述语义分割单元还包括:

104.通道尺寸单元,所述通道尺寸单元用于通过所述mlp层统一所述图像多尺度特征的通道尺寸;

105.特征处理单元,所述特征处理单元用于基于所述通道尺寸对所述图像多尺度特征进行特征采样和特征连接;

106.综合处理单元,所述综合处理单元用于采用所述mlp层融合串联特征,并基于所述串联特征添加一层mlp层获得所述预测语义分割结果。

107.进一步的,所述特征点识别校正模块还包括:

108.级联分类单元,所述级联分类单元用于根据所述特征点识别校正模块,获得级联分类器;

109.选择单元,所述选择单元用于所述级联分类器选择densenet作为分类图像网络;

110.分类校正单元,所述分类校正单元用于根据所述分类图像网络对所述特征点分割结果图像集合进行分类校正,获得特征点分割图像类型;

111.网络训练单元,所述网络训练单元用于基于所述特征点分割图像类型进行识别网络训练,获得所述特征点识别网络模型。

112.本说明书和附图仅仅是本技术的示例性说明,如果本发明的修改和变型属于本发明及其等同技术的范围之内,则本发明也意图包含这些改动和变型在内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。