1.本发明涉及安全驾驶技术领域,尤其涉及一种基于多模态融合的行为属性识别方法、装置及存储介质。

背景技术:

2.随着汽车保有量的增加和人工智能技术的成熟,车辆驾驶安全逐渐成为人们关注的焦点,安全驾驶辅助系统成为新发展方向。在行车过程中,绝大多数交通事故是因为驾驶员或车内乘客的不正当操作行为导致的。并且,随着网约车、顺风车等新型出行模式的兴起,识别驾驶员和车内乘客的危险动作对提高车内驾乘人员的安全尤为重要。

3.现有识别危险动作大多是基于单一视觉或听觉的判断分析,视觉判断分析包括机器学习算法和深度学习算法两种。机器学习算法利用自适应增强人脸检测算法检测人脸范围定位人体动作区域,并利用支撑向量机模型 (support vector machine,svn)训练构建的正负样本库。在预测阶段,通过加载训练后的svn输出危险动作的概率。这种机器学习算法运行速度快、需要的算力小,但是预测的准确度低,算法泛化能力不足,导致应用效果不佳。深度学习算法可以从多个层次提取并学习图像特征,被广泛应用于视频动作识别,其采用目标检测算法ssd或者yolo3,在卷积层对特征图进行特征提取并检测模板进行定位和分类。由于视频动作是图像基于时间的产物,为关注动作识别网络模型在时间维度上的建模能力,提出使用神经网络模型3d cnn对连续的多帧图像进行卷积,使得多特征图相连从而捕捉目标运动信息。此外,还提出时间转移模型tsm和时间激活和融合模型 tea来进行复杂动作的判断,但是这些模型的结构较大,,参数在实际部署应用时需要的算力大,导致实时性较差。目前基于计算机视觉识别危险动作的算法,只能适用于检测使用手机接打电话等简单场景,无法适用于复杂场景,容易将驾驶员或车内乘客的部分动作误识别为危险动作,导致车机系统作出误操作造成驾乘人员的困扰。此外,容易漏判车内人员的争斗以及车内乘客对驾驶员的干扰。

4.视觉判断分析主要应用于驾驶员和车内乘客与车机系统之间的语音交互,采用语音识别、语义理解、情绪侦测等技术将采集到的语音转化为文本或指令,通过计算机将其转化为机器可以理解的特征参数,输出识别结果。相关算法模型主要包括隐马尔科夫模型hmm、语言模型n-gram和深度学习网络模型。虽然可以提高判断准确性,但是模型之间只能串行,每个模型都需要前一个模型的输出作为输入,运行速度很慢。

技术实现要素:

5.本技术实施例提供了基于多模态融合的行为属性识别方法、装置及存储介质,可以降低误判率,提高对危险行为的识别准确性。

6.本技术实施例提供的一种基于多模态融合的行为属性识别方法,包括:

7.获取待处理视频数据和待处理音频数据;待处理视频数据包括至少一个对象;

8.根据待处理视频数据和待处理音频数据,确定对象的画像信息;

9.根据待处理视频数据,确定对象的动作信息;

10.根据待处理音频数据,确定对象的情绪信息和文本信息;

11.基于画像信息、动作信息、情绪信息和文本信息,确定对象的行为属性。

12.进一步地,根据待处理视频数据和待处理音频数据,确定对象的画像信息,包括:

13.从待处理视频数据中,确定对象的脸部数据;

14.从待处理音频数据中,确定对象的语音特征数据;

15.根据脸部数据和语音特征数据,确定对象的标签信息、年龄信息和性别信息;

16.根据标签信息、年龄信息和性别信息,确定对象的画像信息。

17.进一步地,根据待处理视频数据,确定对象的动作信息,包括:

18.从待处理视频数据的每帧视频数据中,确定对象对应的关节点集合;

19.确定关节点集合中每个关节点的位置数据和置信度数据;

20.根据每帧视频数据中每个关节点的位置数据和置信度数据,确定对象的动作信息。

21.进一步地,根据待处理音频数据,确定对象的情绪信息,包括:

22.对待处理音频数据进行特征提取处理,得到语音特征向量序列;语音特征向量序列中相邻两个语音特性向量部分重合;

23.确定语音特征向量序列中每个语音特征向量对应的注意力向量;

24.将每个语音特征向量对应的注意力向量与每个语音特征向量进行拼接处理,得到带有注意力特性信息的语音特征向量序列;

25.根据带有注意力特性信息的语音特征向量序列,确定对象的情绪信息。

26.进一步地,根据待处理音频数据,确定对象的情绪信息,包括:

27.对待处理音频数据进行特征提取处理,得到第一语音特征向量和第二语音特征向量;第一语音特征向量和第二语音特征向量相邻,且部分重合;

28.对第一语音特征向量进行特征提取处理,得到第一语音特征子向和第二语音特征子向量;

29.对第二语音特征向量和第二语音特征子向量进行堆叠处理,得到堆叠语音特征向量;

30.确定堆叠语音特征向量对应的注意力向量集合;

31.根据第一语音特征子向量、堆叠语音特征向量和堆叠语音特征向量对应的注意力向量集合,确定第一注意力语音特征子向量和第二注意力语音特征子向量;

32.根据第一注意力语音特征子向量和第二注意力语音特征子向量,确定对象的情绪信息。

33.进一步地,根据待处理音频数据,确定对象的文本信息,包括:

34.对待处理音频数据进行特征提取处理,得到语音特征向量序列;语音特征向量序列中相邻两个语音特性向量部分重合;

35.对语音特征向量序列进行语音识别处理,得到语句序列;

36.从语句序列的每个语句中确定目标词语;

37.根据语句序列的每个语句中的目标词语句,确定对象的文本信息。

38.进一步地,根据画像信息、动作信息、情绪信息和文本信息,确定对象的行为属性,

包括:

39.根据画像信息、动作信息、情绪信息、文本信息和第一属性信息,确定第一参数;

40.根据画像信息、动作信息、情绪信息、文本信息和第二属性信息,确定第二参数;

41.根据第一参数和第二参数,确定对象的行为属性。

42.相应地,本技术实施例提供了一种基于多模态融合的行为属性识别装置,包括:

43.获取模块,用于获取待处理视频数据和待处理音频数据;待处理视频数据包括至少一个对象;

44.第一确定模块,用于根据待处理视频数据和待处理音频数据,确定对象的画像信息;

45.第二确定模块,用于根据待处理视频数据,确定对象的动作信息;

46.第三确定模块,用于根据待处理音频数据,确定对象的情绪信息和文本信息;

47.第四确定模块,用于基于画像信息、动作信息、情绪信息和文本信息,确定对象的行为属性。

48.进一步地,第一确定模块,还用于从待处理视频数据中,确定对象的脸部数据;从待处理音频数据中,确定对象的语音特征数据;根据脸部数据和语音特征数据,确定对象的标签信息、年龄信息和性别信息;根据标签信息、年龄信息和性别信息,确定对象的画像信息。

49.进一步地,第二确定模块,还用于从待处理视频数据的每帧视频数据中,确定对象对应的关节点集合;确定关节点集合中每个关节点的位置数据和置信度数据;根据每帧视频数据中每个关节点的位置数据和置信度数据,确定对象的动作信息。

50.进一步地,第三确定模块,还用于对待处理音频数据进行特征提取处理,得到语音特征向量序列;语音特征向量序列中相邻两个语音特性向量部分重合;确定语音特征向量序列中每个语音特征向量对应的注意力向量;将每个语音特征向量对应的注意力向量与每个语音特征向量进行拼接处理,得到带有注意力特性信息的语音特征向量序列;根据带有注意力特性信息的语音特征向量序列,确定对象的情绪信息。

51.进一步地,第三确定模块,还用于对待处理音频数据进行特征提取处理,得到第一语音特征向量和第二语音特征向量;第一语音特征向量和第二语音特征向量相邻,且部分重合;对第一语音特征向量进行特征提取处理,得到第一语音特征子向和第二语音特征子向量;对第二语音特征向量和第二语音特征子向量进行堆叠处理,得到堆叠语音特征向量;确定堆叠语音特征向量对应的注意力向量集合;根据第一语音特征子向量、堆叠语音特征向量和堆叠语音特征向量对应的注意力向量集合,确定第一注意力语音特征子向量和第二注意力语音特征子向量;根据第一注意力语音特征子向量和第二注意力语音特征子向量,确定对象的情绪信息。

52.进一步地,第三确定模块,还用于对待处理音频数据进行特征提取处理,得到语音特征向量序列;语音特征向量序列中相邻两个语音特性向量部分重合;对语音特征向量序列进行语音识别处理,得到语句序列;从语句序列的每个语句中确定目标词语;根据语句序列的每个语句中的目标词语句,确定对象的文本信息。

53.进一步地,第四确定模块,用于根据画像信息、动作信息、情绪信息、文本信息和第一属性信息,确定第一参数;根据画像信息、动作信息、情绪信息、文本信息和第二属性信

息,确定第二参数;根据第一参数和第二参数,确定对象的行为属性。

54.相应地,本技术实施例还提供了一种电子设备,该电子设备包括处理器和存储器,存储器中存储有至少一条指令、至少一段程序、代码集或指令集,至少一条指令、至少一段程序、代码集或指令集由处理器加载并执行以实现上述基于多模态融合的行为属性识别方法。

55.相应地,本技术实施例还提供了一种计算机可读存储介质,该存储介质中存储有至少一条指令、至少一段程序、代码集或指令集,至少一条指令、至少一段程序、代码集或指令集由处理器加载并执行以实现上述基于多模态融合的行为属性识别方法。

56.本技术实施例具有如下有益效果:

57.本技术实施例所公开的基于多模态融合的行为属性识别方法、装置及存储介质,识别方法包括获取待处理视频数据和待处理音频数据;待处理视频数据包括至少一个对象;根据待处理视频数据和待处理音频数据,确定对象的画像信息;根据待处理视频数据,确定对象的动作信息;根据待处理音频数据,确定对象的情绪信息和文本信息;基于画像信息、动作信息、情绪信息和文本信息,确定对象的行为属性。基于本技术实施例,通过根据对象的标签、年龄和性别确定对象的画像信息,使得判断车内危险行为时不再仅依赖瞬时的视频数据和音频数据,而是综合考虑对象的过往行为和人物画像,可以减少对驾乘人员习惯性安全动作的误判,提高车内危险动作的识别准确性。通过设计一套可以直接获取人体骨架关节位置信息的开源系统,不需要复杂的图像处理进行预处理,并且使用时空图神经网络模型提取对象的姿态数据进行训练和预测,在时间维度上具有更强的表达能力和更高的性能,可以降低延迟,减少算力,增强实时性和鲁棒性。通过基于注意力机制的双向长短期记忆模型和支持向量机算法进行情绪识别和文本识别,在单一视觉判断分析的基础上增加听觉的判断分析,可以降低误判率,提高行为识别的可信度。通过利用朴素贝叶斯算法对画像信息、动作信息、情绪信息和文本信息进行融合,与不同维度的特征值无关,可以减少算力,增加对危险行为的识别准确性。

附图说明

58.为了更清楚地说明本技术实施例或现有技术中的技术方案和优点,下面将对实施例或现有技术描述中所需要使用的附图作简单的介绍,显而易见地,下面描述中的附图仅仅是本技术的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其它附图。

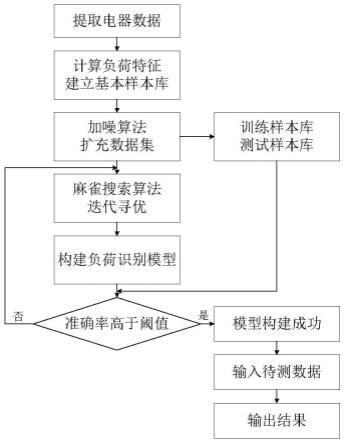

59.图1是本技术实施例所提供的一种应用环境的示意图;

60.图2是本技术实施例提供的一种基于多模态融合的行为属性识别方法的流程示意图;

61.图3是本技术实施例提供的另一种基于多模态融合的行为属性识别方法的流程示意图;

62.图4是本技术实施例提供的一种动作信息识别方法的示例图;

63.图5是本技术实施例提供的一种对待处理音频数据进行预处理的示意图;

64.图6是本技术实施例提供的一种情绪识别方法的示意图;

65.图7是本技术实施例提供的一种长短期记忆模型中单个神经元的结构示意图;

66.图8是本技术实施例提供的一种长短期记忆模型的示意图

67.图9是本技术实施例提供的一种基于多模态融合的行为属性识别装置的结构示意图。

具体实施方式

68.为使本技术的目的、技术方案和优点更加清楚,下面将结合附图对本技术实施例作进一步地详细描述。显然,所描述的实施例仅仅是本技术一个实施例,而不是全部的实施例。基于本技术中的实施例,本领域普通技术人员在没有作出创造性劳动的前提下所获得的所有其他实施例,都属于本技术保护的范围。

69.此处所称的“实施例”是指可包含于本技术至少一个实现方式中的特定特征、结构或特性。在本技术实施例的描述中,需要理解的是,术语“第一”、“第二”仅用于描述目的,而不能理解为指示或暗示相对重要性或者隐含指明所指示的技术特征的数量。由此,限定有“第一”、“第二”的特征可以明示或者隐含的包括一个或者更多个该特征。而且,术语“第一”、“第二”等是用于区别类似的对象,而不必用于描述特定的顺序或先后次序。应该理解这样使用的数据在适当情况下可以互换,以便这里描述的本技术实施例能够以除了在这里图示或描述以外的顺序实施。此外,术语“包括”、“具有”和“为”以及他们的任何变形,意图在于覆盖不排他的包含。

70.请参阅图1,图1是本技术实施例所提供的一种应用环境的示意图,包括服务器10、车内摄像设备20和车载录音设备30。其中,服务器10可以从车内摄像设备20获取待处理视频数据以及从车载录音设备30获取待处理音频数据,其中,待处理视频数据包括至少一个对象,然后可以根据待处理视频数据和待处理音频数据,确定对象的画像信息,可以根据待处理视频数据,确定对象的动作信息,并可以根据待处理音频数据,确定对象的情绪信息和文本信息。然后可以基于画像信息、动作信息、情绪信息和文本信息,确定对象的行为属性。

71.在一些可能的实施方式中,由于车载芯片的算力有限,可以将采集到的视频数据和音频数据分别进行本地实时前向推理和云端服务器的模型训练。再将每次训练后更新好的模型参数传回本地的前向推理,以提高判断结果的准确性和泛化性,也可以节约车载算力和实时性。因此,服务器10 可以是独立的物理服务器,也可以是多个物理服务器构成的服务集群或者分布式系统,还可以是提供云服务、云数据库、云计算、云函数、云存储、网络服务、云通信、中间件服务、域名服务、安全服务、内容分发网络(contentdelivery network,cdn)以及大数据和人工智能平台等基础云计算服务的云服务器。其中,服务器可以包括有网络通信单元、处理器和存储器等等。服务器10可以为提供行为属性的识别服务。

72.下面介绍本技术一种基于多模态融合的行为属性识别方法的具体实施例,图2是本技术实施例提供的一种基于多模态融合的行为属性识别方法的流程示意图,图3是本技术实施例提供的另一种基于多模态融合的行为属性识别方法的流程示意图。本说明书提供了如实施例或流程图所示的方法操作步骤,但基于常规或者无创造性的劳动可以包括更多或者更少的操作步骤。实施例中列举的步骤顺序仅仅为众多执行顺序中的一种方式,不代表唯一的执行顺序,在实际执行时,可以按照实施例或者附图所示的方法顺序执行或者并行执行(例如并行处理器或者多线程处理的环境)。

73.具体的如图2和图3所示,该识别方法可以包括:

74.s201:获取待处理视频数据和待处理音频数据;待处理视频数据包括至少一个对象。

75.本技术实施例中,服务器可以从车辆内部的摄像设备中获取待处理视频数据,并可以从车载录音设备中获取待处理音频数据。其中,车辆内部的摄像设备采集的视频数据中包括至少一个对象,即至少一个驾乘人员。为了便于理解,下文以视频数据包括两个对象为例进行说明。

76.s203:根据待处理视频数据和待处理音频数据,确定对象的画像信息。

77.本技术实施例中,服务器可以从待处理视频数据中,确定对象的脸部数据,从待处理音频数据中,确定对象的语音特征数据,并根据脸部数据和语音特征数据,确定对象的标签信息、年龄信息和性别信息,然后根据标签信息、年龄信息和性别信息,确定对象的画像信息。

78.在一些可能的实施方式中,可以将待处理视频数据和待处理音频数据输入画像识别模型,输出对象的画像信息。可选地,在对待处理视频数据进行提取时,可以根据人脸识别系统对每个对象进行标注和匹配,得到每个对象的历史行为数据,例如,车内乘客的历史行为数据中有频繁做出危险动作的倾向,则可以确定对象的标签为高风险。同时可以根据人脸识别系统分析出对象的年龄和性别。也可以根据语音识别系统,确定对象的年龄和性别。还可以综合人脸识别系统和语音识别吸引,确定对象的年龄和性别。然后可以综合对象的标签信息、年龄信息和性别信息,确定对象的画像信息。通过根据对象的标签、年龄和性别确定对象的画像信息,使得判断车内危险行为时不再仅依赖瞬时的视频数据和音频数据,而是综合考虑对象的过往行为和人物画像,可以减少对驾乘人员习惯性安全动作的误判,提高车内危险动作的识别准确性。

79.s205:根据待处理视频数据,确定对象的动作信息。

80.本技术实施例中,服务器可以从待处理视频数据的每帧数据中,确定对象对应的关节点集合,并确定关节点集合中每个关节点的位置数据和置信度数据,进而可以根据每帧视频数据中每个关节点的位置数据和置信度数据,确定对象的动作信息。

81.在一些可能的实施方式中,可以将待处理视频数据输入动作识别模型,输出对象的动作信息。可选地,动作识别模型可以是训练后的时空图神经网络模型。图4是本技术实施例提供的一种动作信息识别方法的示例图,在时空图神经网络模型的训练过程中,可以基于openpose标注训练集中人体的关节,例如颈部、肩膀、肘部等关节,使其连接成骨骼,从而可以估计人体姿态。对于输入时空图神经网络模型的一个批量batch的训练集,可以用一个5维矩阵(n,c,t,v,m)表示。其中,n可以表示视频的帧数,例如,可以设置一个batch具有128个视频。c可以表示提取的关节特征,包含位置维度x,y和置信度acc。t可以表示关键帧的数量,例如,一个视频可以包括150帧图像。v可以表示关节数量,例如,每个对象可以标注18个关节。m可以表示每一帧图像内驾乘人员的数量,可以基于车内场景选择平均置信度最高的两个驾乘人员。如此可以提取到视频特征维度信息(128,3,150,18,2)。然后可以根据标注好的关节,确定对象的动作信息。在实际应用过程中,动作信息可以包括手机打字、开门、打哈欠、与车内人员斗殴等类别,通过分类后输出概率值最大的动作为预测结果。其中,时空图神经网络模型包括9个卷积层,每3个卷积层为一组可以分为前中后三层卷积层,分别输出64、128、256通道数,每层卷积层之间使用残差链接,使用dropout方法将一半的中间

层神经元随机抹去,以防止过度拟合。并且,在第4个卷积层和第7个卷积层设置池化层,使用随机梯度下降进行优化,并采用反向传播进行训练,生成能表达特征的权重参数。通过设计一套可以直接获取人体骨架关节位置信息的开源系统,不需要复杂的图像处理进行预处理,并且使用时空图神经网络模型提取对象的姿态数据进行训练和预测,在时间维度上具有更强的表达能力和更高的性能,可以降低延迟,减少算力,增强实时性和鲁棒性。

82.s207:根据待处理音频数据,确定对象的情绪信息和文本信息。

83.本技术实施例中,服务器可以对待处理音频数据进行特征提取处理,得到语音特征向量序列,其中,语音特征向量序列中相邻两个语音特征向量部分重合。然后可以确定语音特征向量序列中每个语音特征向量对应的注意力向量,以及将每个语音特征向量对应的注意力向量与每个语音特征向量进行拼接处理,得到带有注意力特性信息的语音特征向量序列,并根据带有注意力特征信息的语音特征向量序列,确定对象的情绪信息。

84.本技术实施例中,服务器可以对待处理音频数据进行特征提取处理,得到第一语音特征向量和第二语音特征向量,其中,第一语音特征向量和第二语音特征向量相邻,且部分重合。然后可以对第一语音特征向量进行特征提取处理,得到第一语音特征子向量和第二语音特征子向量,以及对第二语音特征向量和第二语音特征子向量进行堆叠处理,得到堆叠语音特征向量。之后可以确定堆叠语音特征向量对应的注意力向量集合,并根据第一语音特征子向量、堆叠语音特征向量和堆叠语音特征向量对应的注意力向量集合,确定第一注意力语音特征子向量和第二注意力语音特征子向量,再根据第一注意力语音特征子向量和第二注意力语音特征子向量,确定对象的情绪信息。

85.在一些可能的实施方式中,在获取待处理音频数据之后,可以利用物理的方法对待处理音频数据进行预处理,以提升待处理音频数据的音量和质量。并可以利用梅尔频率倒谱系数的方法进行特征提取,将待处理音频数据转换为服务器能够处理的语音特征向量序列。图5是本技术实施例提供的一种对待处理音频数据进行预处理的示意图。可以先对待处理音频数据进行预加重处理,消除待处理音频数据中的低频干扰,提升高频部分的频谱,使得待处理信号变得平坦。然后可以对预加重处理后的待处理音频数据进行分帧处理,将预加重处理后的待处理音频数据分割成一个个小段,称之为“帧”,同时可以对其进行加窗处理,每帧待处理音频数据乘以汉明窗,以增加分帧后的待处理音频数据中前一帧待处理音频数据和后一帧待处理音频数据的连续性。之后可以对分帧加窗处理后的各帧待处理音频数据进行快速傅立叶变换,得到各帧待处理音频数据的频谱。然后可以利用梅尔滤波器组对各帧待处理音频数据的频谱进行平滑化处理,并消除谐波,突显原待处理音频数据的共振峰,进而对其对数运算和离散余弦变换,得到包括13个一阶差分和13个二阶差分,以进一步集中待处理音频数据的信号能量,提升特征提取的效果。图6是本技术实施例提供的一种情绪识别方法的示意图。在对待处理音频数据进行预处理之后,可以将预处理后的待处理音频数据输入深度神经网络模型进行变分自动编码以及根据音频的高低进行性别辨识,可以减少数据维度、减少训练参数以及确保隐藏层能够较好地抽取到输入的预处理后的待处理音频数据的特征。然后,可以基于注意力机制的双向长短期记忆模型(bi-directional longshort-term memory,bilstm)进行特征优化和预测,图7是本技术实施例提供的一种长短期记忆模型中单个神经元的结构示意图,图8是本技术实施例提供的一种长短期记忆模型的示意图。图中经过上一个神经元输入的信息包括c

t-1

和a

t-1

,a

t-1

与输入信息x

t

堆叠后

被复制为四份参数,每份参数乘以权重参数后用α进行激活。其中,第一份参数乘以遗忘门的权重系数wf后用α=1/(1 e

-t

)进行激活,这样可以将数值映射到(0,1)上,并且绝大部分值都非常接近0和1,从而上一个神经元携带的信息c

t-1

与之相乘后会进行选择性的遗忘(乘以接近0的数)和通过(乘以接近1的数)。输入门是对a

t-1

乘以权重wi经α=tanh激活后的信息前向运算的结果进行限制,处理后的信息与遗忘门处理的信息逐个相加得到c

t

,可以实现对上文旧信息和新信息的共同输入。输出门是对当前神经元要输出的内容进行限制,前面的信息经过α=tanh激活后与输出权重wo逐元素相乘,可以得到当前神经元的输出以及传递给下一个神经元的输入信息a

t

。如此,可以c

t

可以携带有更多的上文信息,具有长期记忆,a

t

可以包含更多的当前信息,具有短期记忆。为了同时提取待处理音频数据中前后段共同信息,可以在lstm的基础上添加反向的运算,将输入信息反转,重新计算一遍输出,最终的结果可以为正向与反向的堆叠,从而可以实现lstm对前后时间段的共同分析。可选地,可以将lstm堆叠四层,再将得到的数据使用支撑向量机算法进行分类,得出每种情绪的概率值,并输出预测结果。在实际应用过程中,情绪类别可以分为高兴、生气、中性和难过等类别。

86.由于在车内危险行为发生的同时,往往伴随手机或者对象的声音,通过基于注意力机制的双向长短期记忆模型和支持向量机算法进行情绪识别,在单一视觉判断分析的基础上增加听觉的判断分析,可以降低误判率,提高行为识别的可信度。

87.本技术实施例中,服务器可以对待处理音频数据进行特征提取处理,得到语音特征向量序列,其中,语音特征向量序列中相邻两个语音特性向量部分重合。然后可以对语音特征向量序列进行语音识别处理,得到语句序列,并可以从语句序列的每个语句中确定目标词语,根据语句序列的每个语句中的目标词语句,确定对象的文本信息。

88.在一些可能的实施方式中,在获取待处理音频数据之后,可以利用物理的方法对待处理音频数据进行预处理,以提升待处理音频数据的音量和质量。并可以利用梅尔频率倒谱系数的方法进行特征提取,将待处理音频数据转换为服务器能够处理的语音特征向量序列。具体预处理方法与上文描述的确定对象的情绪信息中对待处理音频数据进行预处理方法相同,此处不再赘述。在得到语音特征向量序列之后,可以将语音特征向量序列转换为文本信息。其中,经梅尔频率倒谱系数提取的特征可以输入到3层的一维或二维卷积后通过循环神经网络vanilla rnn或者门空神经网络gru 或者双向循环神经网络bi directional rnn后再经过前向卷积 lookahead-convolution,最后通过全连接输出文本信息。然后,通过连接时序分类(connectionist temporal classification,ctc)来解决输入序列和输出序列难以一一对应的问题,省去了需要反复多次迭代的语音对齐过程。然后可以使用回归函数对文本进行分类,得到对象的文本信息。在实际应用过程中,可以预先定义“报警”、“打”、“杀”等危险词汇,通过正则表达式匹配的方法与得到的本文信息进行比较,输出每个包含危险词汇语句的权重比例并取概率值最大的为预测结果。

89.由于在车内危险行为发生的同时,往往伴随手机或者对象的声音,通过基于注意力机制的双向长短期记忆模型和支持向量机算法进行文本识别,在单一视觉判断分析的基础上增加听觉的判断分析,可以降低误判率,提高行为识别的可信度。

90.s209:基于画像信息、动作信息、情绪信息和文本信息,确定对象的行为属性。

91.本技术实施例中,服务器可以根据画像信息、动作信息、情绪信息、文本信息和第

一属性信息,确定第一参数,以及可以根据画像信息、动作信息、情绪信息、文本信息和第二属性信息,确定第二参数。然后可以根据第一参数和第二参数,确定对象的行为属性。

92.在一些可能的实施方式中,可以使用朴素贝叶斯算法进行后端评价,这是一种基于不同模态预测结果的后端决策方法,可以对之前得到的不同模式分类进行综合打分,形成决策识别矩阵并判定对象的行为是否为危险行为。在实际应用中,对象的行为属性可以包括危险行为和非危险行为,分别可以用ωk(k=1,2)表示。样本空间包括对象的动作信息、情绪信息、文本信息和画像信息,总维度可以为多种信息的总和,具体可以表示为: x=[x1,...,xn],其中,n可以为信息总和,然后可以得到公式 f(ω)=maxp(ωk│

x1,...,xn)求出在不同模态下的行为信息是否为危险行为,取概率最大的值进行判断。根据朴素贝叶斯理论,f(ω)=maxp(ωk│

x1,...,xn)可以表示为max(x1,...,xn│

ωk)p(ωk)/p(x1,...,xn),在实际应用中,可以简化为 p(x1│

ωk)

×

...

×

p(xn│

ωk)

×

p(ωk)。基于该公式可以确定标签信息、动作信息、情绪信息和文本信息是危险动作的概率和非危险动作的概率,进而可以确定两个概率值最大值对应的行为属性为对象的行为属性,并做出相应反馈,例如报警。通过利用朴素贝叶斯算法对画像信息、动作信息、情绪信息和文本信息进行融合,与不同维度的特征值无关,可以减少算力,增加对危险行为的识别准确性。

[0093]

采用本技术实施例所提供的基于多模态融合的行为属性识别方法,通过根据对象的标签、年龄和性别确定对象的画像信息,使得判断车内危险行为时不再仅依赖瞬时的视频数据和音频数据,而是综合考虑对象的过往行为和人物画像,可以减少对驾乘人员习惯性安全动作的误判,提高车内危险动作的识别准确性。通过设计一套可以直接获取人体骨架关节位置信息的开源系统,不需要复杂的图像处理进行预处理,并且使用时空图神经网络模型提取对象的姿态数据进行训练和预测,在时间维度上具有更强的表达能力和更高的性能,可以降低延迟,减少算力,增强实时性和鲁棒性。通过基于注意力机制的双向长短期记忆模型和支持向量机算法进行情绪识别和文本识别,在单一视觉判断分析的基础上增加听觉的判断分析,可以降低误判率,提高行为识别的可信度。通过利用朴素贝叶斯算法对画像信息、动作信息、情绪信息和文本信息进行融合,与不同维度的特征值无关,可以减少算力,增加对危险行为的识别准确性。

[0094]

本技术实施例还提供的一种基于多模态融合的行为属性识别装置,图9 是本技术实施例提供的一种基于多模态融合的行为属性识别装置的结构示意图,如图9所示,该识别装置可以包括:

[0095]

获取模块901,用于获取待处理视频数据和待处理音频数据;待处理视频数据包括至少一个对象;

[0096]

第一确定模块903,用于根据待处理视频数据和待处理音频数据,确定对象的画像信息;

[0097]

第二确定模块905,用于根据待处理视频数据,确定对象的动作信息;

[0098]

第三确定模块907,用于根据待处理音频数据,确定对象的情绪信息和文本信息;

[0099]

第四确定模块909,用于基于画像信息、动作信息、情绪信息和文本信息,确定对象的行为属性。

[0100]

本技术实施例中,第一确定模块903,还用于从待处理视频数据中,确定对象的脸部数据;从待处理音频数据中,确定对象的语音特征数据;根据脸部数据和语音特征数据,

确定对象的标签信息、年龄信息和性别信息;根据标签信息、年龄信息和性别信息,确定对象的画像信息。

[0101]

本技术实施例中,第二确定模块905,还用于从待处理视频数据的每帧视频数据中,确定对象对应的关节点集合;确定关节点集合中每个关节点的位置数据和置信度数据;根据每帧视频数据中每个关节点的位置数据和置信度数据,确定对象的动作信息。

[0102]

本技术实施例中,第三确定模块907,还用于对待处理音频数据进行特征提取处理,得到语音特征向量序列;语音特征向量序列中相邻两个语音特性向量部分重合;确定语音特征向量序列中每个语音特征向量对应的注意力向量;将每个语音特征向量对应的注意力向量与每个语音特征向量进行拼接处理,得到带有注意力特性信息的语音特征向量序列;根据带有注意力特性信息的语音特征向量序列,确定对象的情绪信息。

[0103]

本技术实施例中,第三确定模块907,还用于对待处理音频数据进行特征提取处理,得到第一语音特征向量和第二语音特征向量;第一语音特征向量和第二语音特征向量相邻,且部分重合;对第一语音特征向量进行特征提取处理,得到第一语音特征子向和第二语音特征子向量;对第二语音特征向量和第二语音特征子向量进行堆叠处理,得到堆叠语音特征向量;确定堆叠语音特征向量对应的注意力向量集合;根据第一语音特征子向量、堆叠语音特征向量和堆叠语音特征向量对应的注意力向量集合,确定第一注意力语音特征子向量和第二注意力语音特征子向量;根据第一注意力语音特征子向量和第二注意力语音特征子向量,确定对象的情绪信息。

[0104]

本技术实施例中,第三确定模块907,还用于对待处理音频数据进行特征提取处理,得到语音特征向量序列;语音特征向量序列中相邻两个语音特性向量部分重合;对语音特征向量序列进行语音识别处理,得到语句序列;从语句序列的每个语句中确定目标词语;根据语句序列的每个语句中的目标词语句,确定对象的文本信息。

[0105]

本技术实施例中,第四确定模块909,用于根据画像信息、动作信息、情绪信息、文本信息和第一属性信息,确定第一参数;根据画像信息、动作信息、情绪信息、文本信息和第二属性信息,确定第二参数;根据第一参数和第二参数,确定对象的行为属性。

[0106]

本技术实施例中的装置与方法实施例基于同样的申请构思。

[0107]

采用本技术实施例所提供的基于多模态融合的行为属性识别装置,通过根据对象的标签、年龄和性别确定对象的画像信息,使得判断车内危险行为时不再仅依赖瞬时的视频数据和音频数据,而是综合考虑对象的过往行为和人物画像,可以减少对驾乘人员习惯性安全动作的误判,提高车内危险动作的识别准确性。通过设计一套可以直接获取人体骨架关节位置信息的开源系统,不需要复杂的图像处理进行预处理,并且使用时空图神经网络模型提取对象的姿态数据进行训练和预测,在时间维度上具有更强的表达能力和更高的性能,可以降低延迟,减少算力,增强实时性和鲁棒性。通过基于注意力机制的双向长短期记忆模型和支持向量机算法进行情绪识别和文本识别,在单一视觉判断分析的基础上增加听觉的判断分析,可以降低误判率,提高行为识别的可信度。通过利用朴素贝叶斯算法对画像信息、动作信息、情绪信息和文本信息进行融合,与不同维度的特征值无关,可以减少算力,增加对危险行为的识别准确性。

[0108]

本技术实施例还提供的一种电子设备,电子设备可设置于服务器之中以保存用于实现方法实施例中的一种基于多模态融合的行为属性识别方法相关的至少一条指令、至少

一段程序、代码集或指令集,该至少一条指令、该至少一段程序、该代码集或指令集由该存储器加载并执行以实现上述的基于多模态融合的行为属性识别方法。

[0109]

本技术实施例还提供的一种存储介质,存储介质可设置于服务器之中以保存用于实现方法实施例中一种基于多模态融合的行为属性识别方法相关的至少一条指令、至少一段程序、代码集或指令集,该至少一条指令、该至少一段程序、该代码集或指令集由该处理器加载并执行以实现上述基于多模态融合的行为属性识别方法。

[0110]

可选的,在本实施例中,上述存储介质可以位于计算机网络的多个网络服务器中的至少一个网络服务器。可选地,在本实施例中,上述存储介质可以包括但不限于包括:u盘、只读存储器(read-only memory,rom)、移动硬盘、磁碟或者光盘等各种可以存储程序代码的介质。

[0111]

由上述本技术提供的基于多模态融合的行为属性识别方法、装置、电子设备或存储介质的实施例可见,本技术中识别方法包括获取待处理视频数据和待处理音频数据;待处理视频数据包括至少一个对象;根据待处理视频数据和待处理音频数据,确定对象的画像信息;根据待处理视频数据,确定对象的动作信息;根据待处理音频数据,确定对象的情绪信息和文本信息;基于画像信息、动作信息、情绪信息和文本信息,确定对象的行为属性。基于本技术实施例,通过根据对象的标签、年龄和性别确定对象的画像信息,使得判断车内危险行为时不再仅依赖瞬时的视频数据和音频数据,而是综合考虑对象的过往行为和人物画像,可以减少对驾乘人员习惯性安全动作的误判,提高车内危险动作的识别准确性。通过设计一套可以直接获取人体骨架关节位置信息的开源系统,不需要复杂的图像处理进行预处理,并且使用时空图神经网络模型提取对象的姿态数据进行训练和预测,在时间维度上具有更强的表达能力和更高的性能,可以降低延迟,减少算力,增强实时性和鲁棒性。通过基于注意力机制的双向长短期记忆模型和支持向量机算法进行情绪识别和文本识别,在单一视觉判断分析的基础上增加听觉的判断分析,可以降低误判率,提高行为识别的可信度。通过利用朴素贝叶斯算法对画像信息、动作信息、情绪信息和文本信息进行融合,与不同维度的特征值无关,可以减少算力,增加对危险行为的识别准确性。

[0112]

在本发明中,除非另有明确的规定和限定,术语“相连”、“连接”等术语应做广义理解,例如,可以是固定连接,也可以是可拆卸连接,或成一体;可以是机械连接,也可以是电连接;可以是直接相连,也可以通过中间媒介间接相连,可以是两个元件内部的相连或两个元件的相互作用关系。对于本领域的普通技术人员而言,可以根据具体情况理解上述术语在本发明中的具体含义。

[0113]

需要说明的是:上述本技术实施例的先后顺序仅仅为了描述,不代表实施例的优劣,且上述本说明书对特定的实施例进行了描述,其他实施例也在所附权利要求书的范围内。在一些情况下,在权利要求书中记载的动作或者步骤可以按照不同的实施例中的顺序来执行并且能够实现预期的结果。另外,在附图中描绘的过程不一定要求示出特定顺序或者而连接顺序才能够实现期望的结果,在某些实施方式中,多任务并行处理也是可以的或者可能是有利的。

[0114]

本说明书中的各个实施例均采用递进的方式描述,各个实施例之间相同相似的部分互相参见即可,每个实施例重点说明的均为与其他实施例的不同之处。尤其,对于装置的实施例而言,由于其基于相似于方法实施例,所以描述的比较简单,相关之处参见方法实施

例的部分说明即可。

[0115]

以上所述是本发明的优选实施方式,应当指出,对于本技术领域的普通技术人员来说,在不脱离本发明原理的前提下,还可以做出若干改进和润饰,这些改进和润饰也视为本发明的保护范围。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。