1.本发明属于听障人士语言学习技术领域,具体涉及一种基于深度学习的语言训练方法及系统。

背景技术:

2.听障人士因生理特点存在听力反馈途径存在障碍,使得他们无法像正常人一样及时得到语音信号的反馈,从而致使听障人士的发音存在不同程度的失真。

3.相关技术中,通常通过语言康复训练系统来辅助听障人士进行语音康复训练,解决发音失真问题。现有技术中的语音康复训练系统仅仅单纯通过标准通用模型来对所有使用学习者发音进行对比,对每个使用学习者均给出相对于标准通用模型的通用评价和反馈。但是,听障人士具有自己的生理特点和听力短板,通过通用模型给出的通用评价和反馈在个体准确度上存在一定偏差,使得语言康复训练效果不显著。

4.因此,如何提升使用学习者的语言康复训练效果,成为现有技术中亟待解决的技术问题。

技术实现要素:

5.本发明提供了一种基于深度学习的语言训练方法及系统,以解决现有技术中学习者的语言康复训练效果较差的技术问题。

6.本发明提供的技术方案如下:

7.一方面,一种基于深度学习的语言训练方法,包括:

8.获取目标学习者读预设语言文字信息时的表述信息,所述表述信息包括语音;

9.基于智能语音分析技术,在预设发音层次上对所述语音进行特征分析和统计,获取分析结果;所述预设发音层次,包括:音素、单字发音、词组发音和语句发音的至少一种;

10.以预设形象化方式显示所述分析结果,以使所述目标学习者实时查看所述分析结果,从而对发音进行纠正或改进。

11.可选的,所述以预设形象化方式显示所述分析结果,包括:以不同标志显示不同准确度的预设文字信息发音结果;所述发音结果,包括:准确、完整和待提升;所述不同标志包括不同颜色。

12.可选的,还包括:

13.接收查看指令,根据所述查看指令,查看对应的提升策略;

14.若所述查看指令为查看待提升发音结果,则所述提升策略为:显示对应文字标准发音的基准唇形。

15.可选的,所述表述信息,还包括:嘴型空间形状数据;所述方法,还包括;

16.将与所述预设语言文字信息相对应的教学嘴型空间形状数据,和,所述目标学习者的嘴型空间形状数据进行对比评价,生成评价结果;

17.所述以预设形象化方式显示所述分析结果,还包括:以预设形象话方式显示所述

评价结果。

18.可选的,所述嘴型空间形状数据,包括:唇形;所述获取目标学习者读预设语言文字信息时的表述信息,包括;

19.基于人脸3d模型提取目标学习者根据预设语言文字信息进行发音时的唇形。

20.可选的,所述将与所述预设语言文字信息相对应的教学嘴型空间形状数据,和,所述目标学习者的嘴型空间形状数据进行对比评价,生成评价结果,包括;

21.逐帧确定所述与所述预设语言文字信息相对应的教学嘴型空间形状数据中的基准唇形数据;

22.基于图像转换过程中的不变量,确定所述所述目标学习者的唇形数据;

23.以所述基准唇形数据为基准,逐帧匹配所述基准唇形数据和所述目标学习者的唇形数据,生成评价结果。

24.可选的,所述获取目标学习者读预设语言文字信息时的表述信息,包括:

25.基于摄像装置,获取目标学习者根据预设语言文字信息进行发音时的嘴型图像,并在显示界面进行显示;

26.根据所述嘴型图像,获取目标学习者根据预设语言文字信息进行发音时的嘴型空间形状数据。

27.可选的,所述预设形象化方式,包括;数字评分,和/或,视觉评分;

28.所述视觉评分的评价规则,包括:显示不同个数或大小的设定形状来代表评价结果。

29.可选的,所述基于智能语音分析技术,在预设发音层次上对所述语音进行特征分析和统计,获取分析结果,包括:

30.基于智能语音分析技术,对比所述语音与预设听障声学语言模型,获取分析结果。

31.又一方面,一种基于深度学习的语言训练系统,包括:获取模块、分析模块和显示模块;

32.所述获取模块,用于获取目标学习者读预设语言文字信息时的语音;

33.所述分析模块,用于基于智能语音分析技术,在预设发音层次上对所述语音进行特征分析和统计,获取分析结果;所述预设发音层次,包括:音素、单字发音、词组发音和语句发音的至少一种;

34.所述显示模块,用于以预设形象化方式显示所述分析结果,以使所述目标学习者实时查看所述分析结果,从而对发音进行纠正或改进。

35.本发明的有益效果为:

36.本发明实施例提供的基于深度学习的语言训练方法及系统,通过获取目标学习者读预设语言文字信息时的表述信息,基于智能语音分析技术,在预设发音层次上对所述语音进行特征分析和统计,获取分析结果;以预设形象化方式显示所述分析结果,以使所述目标学习者实时查看所述分析结果,从而对发音进行纠正或改进。本发明利用智能语音分析技术在音素、字、词、句各层次上对学习者语音特征进行分析和统计,对各种发音错误以形象化方式实时反馈进而帮助练习者纠正和改进发音,提升了语言康复训练效果。

附图说明

37.为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

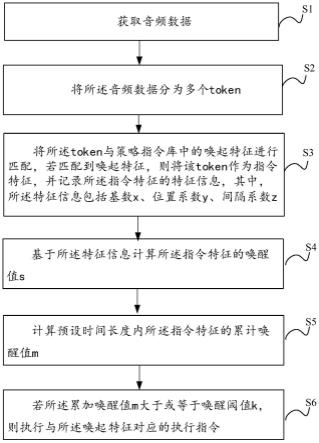

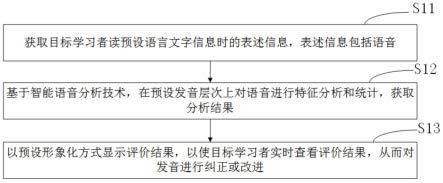

38.图1为本发明实施例提供的一种基于深度学习的语言训练方法的流程示意图;

39.图2为本发明实施例提供的一种口型模板示意图;

40.图3为本发明实施例提供的一种唇形匹配示意图;

41.图4为本发明实施例提供的一种以预设形象化方式显示分析结果的示意图;

42.图5为本发明实施例提供的一种基于深度学习的语言训练系统的结构示意图;

43.图6为本发明实施例提供的一种基于深度学习的语言训练设备结构示意图。

具体实施方式

44.为使本发明的目的、技术方案和优点更加清楚,下面将对本发明的技术方案进行详细的描述。显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动的前提下所得到的所有其它实施方式,都属于本发明所保护的范围。

45.根据世界卫生组织的报告,全球有15亿人患有某种程度的听力损失,其中约4.3亿人需要针对听力损失的康复服务。我国有听力残疾患者2780万人,每年新增听力残疾人逾30万,患听力障碍人士共达3480万人。听力损失会影响到个人生活的许多方面尤其是语言交流能力,事实证明患者越早进行必要的语言学习和训练对他们部分重拾语言能力的帮助越大。

46.相关技术中,通常通过语言康复训练系统来辅助听障人士进行语音康复训练,解决发音失真问题。现有技术中的语音康复训练系统仅仅单纯通过标准通用模型来对所有使用学习者发音进行对比,对每个使用学习者均给出相对于标准通用模型的通用评价和反馈。但是,每个使用学习者均具备个人特点,通过通用模型给出的通用评价和反馈在个体准确度上存在一定偏差,使得语言康复训练效果不显著。

47.基于此,本发明实施例提供一种基于深度学习的语言训练方法。

48.图1为本发明实施例提供的一种基于深度学习的语言训练方法的流程示意图,如图1所示,本发明实施例提供的方法,可以包括以下步骤:

49.s11、获取目标学习者读预设语言文字信息时的表述信息,表述信息包括语音。

50.在一个具体的实现过程中,可以定义任一个需要进行基于深度学习的语言训练的听障人士为目标学习者,使目标学习者使用本技术提供的基于深度学习的语言训练方法进行发音训练。

51.例如,在学习训练开始后,目标学习者可以根据预设语言文字信息进行发音,如,预设语言文字信息为一首诗歌,目标学习者可以读这首诗歌,进行发音。在目标学习者开始发音后,获取目标学习者读诗歌的表述信息,其中,表述信息可以为语音。

52.s12、基于智能语音分析技术,在预设发音层次上对语音进行特征分析和统计,获取分析结果。

53.其中,预设发音层次,包括:音素、单字发音、词组发音和语句发音的至少一种。

54.例如,在获取到表述信息,如语音后,可以基于语音分析技术,在音素、单字发音、词组发音和语句发音的至少一种的预设发音层次上对语音进行特征分析和统计,获取分析结果。

55.在一些实施例中,可选的,基于智能语音分析技术,在预设发音层次上对语音进行特征分析和统计,获取分析结果,包括:

56.基于智能语音分析技术,对比语音与预设听障声学语言模型,获取分析结果。

57.其中,分析结果可以为评分结果,此处不做具体限定。

58.例如,智能语音分析技术可以为基于深度学习模型和算法架构rnn和lstm 智能语音分析引擎的基础架构。

59.其中,预设听障声学语音模型可以为与聋哑学校合作采用手机app方式完成前期训练数据采集后训练而成的预设听障声学语音模型。其训练过程可参阅现有模型训练过程,此处不做赘述。在数据采集过程中,无需要求听障人士发音标准,使得样本数据能被人识别、理解,即可作为采集标准。在获取到语言后,可以对比预设听障声学语言模型,得到分析结果。也可以根据再次采集到的语音,对预设听障声学语言模型进行学习更新。也可以将利用采集的特定语音数据生成包含完整听障用户语音特点的预设听障声学语言模型与正常用户语音训练而成的声学模型和语言模型进行特征参数评估可以产生有参考意义在 (音素|字|词|句)层次上的比较分析结果从而给训练者及时有效的改正指导意和提示。

60.s13、以预设形象化方式显示评价结果,以使目标学习者实时查看评价结果,从而对发音进行纠正或改进。

61.在一些实施例中,可选的,以预设形象化方式显示分析结果,包括:以不同标志显示不同准确度的预设文字信息发音结果;发音结果,包括:准确、完整和待提升;不同标志包括不同颜色。

62.例如,可以实时显示每个字发音的准确性,以不同颜色来区分发音准确性的判断结果。如,红色表示发音待提升(即待纠正)、浅绿表示发音完整(可被人理解,无需纠正)、绿色表示准确(清晰)等,此处仅仅是对颜色的列举,并不是限定。

63.在一些实施例中,可选的,还可以包括:接收查看指令,根据查看指令,查看对应的提升策略;若查看指令为查看待提升发音结果,则提升策略为:显示对应文字标准发音的基准唇形。

64.例如,用户可以根据显示的颜色,发出查看指令,如,查看指令可以为点击,通过点击,查看点击单字、词组等发音的提升策略。如,可以“啊”发音不准确,显示为红色,点击“啊”的发音,显示“啊”的基准唇形。

65.在一些实施例中,可选的,获取目标学习者读预设语言文字信息时的表述信息,包括:基于摄像装置,获取目标学习者根据预设语言文字信息进行发音时的嘴型图像,并在显示界面进行显示;根据嘴型图像,获取目标学习者根据预设语言文字信息进行发音时的嘴型空间形状数据。

66.在一些实施例中,可选的,嘴型空间形状数据,包括:唇形;获取目标学习者根据预设语言文字信息进行发音时的嘴型空间形状数据,包括;

67.基于人脸3d模型提取目标学习者根据预设语言文字信息进行发音时的唇形。

68.例如,可以根据人脸3d模型,获取目标学习者发音时候的唇形。

69.其中,人脸3d模型可以为facemesh模型。本实施例中,可以根据google 研究团队在mediapipe facemesh上的研究成果唇形对比及分析模块,来使用 rgb摄像机跟踪嘴唇的形状。其中,facemesh是一个轻量级包,仅3mb,响应速度非常快,非常适合在移动设备上进行实时推断,适于虚拟现实(ar)场景中的应用。facemesh可以计算出每个人脸内468个特征点的位置,利用如此密集的面部网格拓扑图,提供一个人脸的3d模型,进一步利用相关细分曲面算法还可以得到光滑的面部轮廓图。

70.在本实施例中,可以根据facemesh来获取目标学习者发音时的唇形:通过 facemesh模型对面部表情关键点实时进行高密度评估,这意味着数据可在本地实现推理,利用嘴部和唇部周围的关键点,可以分离出原始图像中的唇部区域。

71.在一些实施例中,可选的,表述信息,还包括:嘴型空间形状数据;方法,还包括:将与预设语言文字信息相对应的教学嘴型空间形状数据,和,目标学习者的嘴型空间形状数据进行对比评价,生成评价结果;以预设形象化方式显示分析结果,还包括:以预设形象话方式显示评价结果。

72.例如,可以预设语言文字信息,并录入标准发音对预设语言文字信息的读取,根据预设语言文字信息进行基准口型相对应的基准唇形的数据对比,根据匹配程度,获取评价结果。其中,可以采用唇形对比及评分模块对唇形进行对比,唇形对比及评分模块是基于google研究团队在mediapipe facemesh上的研究成果,能够使用单个rgb摄像机跟踪嘴唇的形状,通过实时的唇形对比,改善发音时嘴部的轮廓和形状,适于在移动设备(手机,树莓派等),台式电脑,笔记本电脑甚至网络上运行。

73.在一些实施例中,可选的,将与预设语言文字信息相对应的教学嘴型空间形状数据,和,目标学习者的嘴型空间形状数据进行对比评价,生成评价结果,包括:逐帧确定与预设语言文字信息相对应的教学嘴型空间形状数据中的基准唇形数据;基于图像转换过程中的不变量,确定目标学习者的唇形数据;以基准唇形数据为基准,逐帧匹配基准唇形数据和目标学习者的唇形数据,生成评价结果。

74.例如,可以逐帧捕捉确认预设语言文字信息(如,一段诗歌)读取时对应的基准唇形数据;确定目标学习者读该预设语言文字信息时的唇形数据;将两种唇形数据相匹配,生成评价结果。其中,在获取目标学习者的唇形数据时,可以采用各种方法测量口型,本实施例中可以采用做“hu矩”(hu moments) 的方法,即使用户晃动头部的同时,对嘴巴形状、大小和与摄像头的距离限制相对鲁棒。利用图像转换过程中的不变量(中心矩,central moments)进行计算,得到一组数字。之后,可形状进行比对。这种测量方案可以兼容目标平移、缩放和旋转操作。因此,用户可以自由转动头部,而不会影响对口型本身的检测。

75.在对唇形进行匹配时,可以用户实时从摄像头输入的视频流为目标学习者的唇形数据,运用测量口型的技术,可以确定嘴部轮廓形状的匹配程度(例如 1000分为满分,完全匹配)。

76.在一些实施例中,可以预先对口型进行编码,通过口型编码来实现对唇形形状的匹配。图2为本发明实施例提供的一种口型模板示意图,图3为本发明实施例提供的一种唇形匹配示意图。

77.参阅图2,可以预先设置口型模板,并对口型模板进行编码。可以设定16 个口型模

板,对应模板代号msec-01至msec-16,设定模板代号分别对应口型编码b0000、b0001、b0010、b0011、b0100、b0101、b0110、b0111、b1000、 b1001、b1010、b1011、b1100、b1101、b1110、b1111,二进制编码以便于识别。口型模板中prediction)对应预测测量得到的口型。

78.参阅图3,可以将预测测量得到的口型(prediction)与基准唇形 (baseline)进行匹配,可以设定匹配程度满分为1000分,在完全不匹配时,匹配得分为0,还可以如图设定得分为7分、995分以及1000分等,此处不做具体限定。

79.在一些实施例中,可选的,预设形象化方式,包括;数字评分,和/或,视觉评分;

80.视觉评分的评价规则,包括:显示不同个数或大小的设定形状来代表评价结果。

81.例如,在一个具体的实现过程中,目标学习者可以通过手机、电脑或其他移动设备的摄像头,输入和观察自己的唇部形状,可以在念出预设语言文字信息的同时,观察自己的唇部形状,以及根据唇形匹配程度得到的实时计分,并在预设语言文字信息结束后给出一个累计得分。

82.图4为本发明实施例提供的一种以预设形象化方式显示分析结果的示意图,参阅图4,也可以重点关注用户对口型时唇形的视觉效果,实时给出一个视觉评分,例如用星星数量来表示用户的表现,此处不做具体赘述。

83.本发明实施例提供的基于深度学习的语言训练方法,通过获取目标学习者读预设语言文字信息时的表述信息,基于智能语音分析技术,在预设发音层次上对语音进行特征分析和统计,获取分析结果;以预设形象化方式显示分析结果,以使目标学习者实时查看分析结果,从而对发音进行纠正或改进。本发明利用智能语音分析技术在音素、字、词、句各层次上对学习者语音特征进行分析和统计,对各种发音错误以形象化方式实时反馈进而帮助练习者纠正和改进发音,提升了语言康复训练效果。

84.基于一个总的发明构思,本发明实施例还提供一种基于深度学习的语言训练系统。

85.图5为本发明实施例提供的一种基于深度学习的语言训练系统的结构示意图,参阅图3,本发明实施例提供的系统,可以包括以下结构:获取模块31、分析模块32和显示模块33。

86.其中,获取模块31,用于获取目标学习者读预设语言文字信息时的语音;

87.分析模块32,用于基于智能语音分析技术,在预设发音层次上对语音进行特征分析和统计,获取分析结果;预设发音层次,包括:音素、单字发音、词组发音和语句发音的至少一种;

88.显示模块33,用于以预设形象化方式显示分析结果,以使目标学习者实时查看分析结果,从而对发音进行纠正或改进。

89.可选的,显示模块33,用于以不同标志显示不同准确度的预设文字信息发音结果;发音结果,包括:准确、完整和待提升;不同标志包括不同颜色。

90.可选的,获取模块31,还用于接收查看指令,根据查看指令,查看对应的提升策略;

91.若查看指令为查看待提升发音结果,则提升策略为:显示对应文字标准发音的基准唇形。

92.可选的,分析模块32,还用于将与预设语言文字信息相对应的教学嘴型空间形状数据,和,目标学习者的嘴型空间形状数据进行对比评价,生成评价结果;显示模块33,还用

于以预设形象话方式显示评价结果。

93.可选的,分析模块,用于逐帧确定与预设语言文字信息相对应的教学嘴型空间形状数据中的基准唇形数据;

94.基于图像转换过程中的不变量,确定目标学习者的唇形数据;

95.以基准唇形数据为基准,逐帧匹配基准唇形数据和目标学习者的唇形数据,生成评价结果。

96.关于上述实施例中的系统,其中各个模块执行操作的具体方式已经在有关该方法的实施例中进行了详细描述,此处将不做详细阐述说明。

97.本发明实施例提供的基于深度学习的语言训练系统,通过获取目标学习者读预设语言文字信息时的表述信息,基于智能语音分析技术,在预设发音层次上对语音进行特征分析和统计,获取分析结果;以预设形象化方式显示分析结果,以使目标学习者实时查看分析结果,从而对发音进行纠正或改进。本发明利用智能语音分析技术在音素、字、词、句各层次上对学习者语音特征进行分析和统计,对各种发音错误以形象化方式实时反馈进而帮助练习者纠正和改进发音,提升了语言康复训练效果。

98.基于一个总的发明构思,本发明实施例还提供一种基于深度学习的语言训练设备。

99.图6为本发明实施例提供的一种基于深度学习的语言训练设备结构示意图,请参阅图4,本发明实施例提供的一种基于深度学习的语言训练设备,包括:处理器41,以及与处理器相连接的存储器42。

100.存储器42用于存储计算机程序,计算机程序至少用于上述任一实施例记载的基于深度学习的语言训练方法;

101.处理器41用于调用并执行存储器中的计算机程序。

102.基于一个总的发明构思,本发明实施例还提供一种存储介质。

103.一种存储介质,该存储介质存储有计算机程序,当计算机程序被处理器执行时,实现上述的基于深度学习的语言训练方法中各个步骤。

104.以上所述,仅为本发明的具体实施方式,但本发明的保护范围并不局限于此,任何熟悉本技术领域的技术人员在本发明揭露的技术范围内,可轻易想到变化或替换,都应涵盖在本发明的保护范围之内。因此,本发明的保护范围应以所述权利要求的保护范围为准。

105.可以理解的是,上述各实施例中相同或相似部分可以相互参考,在一些实施例中未详细说明的内容可以参见其他实施例中相同或相似的内容。

106.需要说明的是,在本发明的描述中,术语“第一”、“第二”等仅用于描述目的,而不能理解为指示或暗示相对重要性。此外,在本发明的描述中,除非另有说明,“多个”的含义是指至少两个。

107.流程图中或在此以其他方式描述的任何过程或方法描述可以被理解为,表示包括一个或更多个用于实现特定逻辑功能或过程的步骤的可执行指令的代码的模块、片段或部分,并且本发明的优选实施方式的范围包括另外的实现,其中可以不按所示出或讨论的顺序,包括根据所涉及的功能按基本同时的方式或按相反的顺序,来执行功能,这应被本发明的实施例所属技术领域的技术人员所理解。

108.应当理解,本发明的各部分可以用硬件、软件、固件或它们的组合来实现。在上述

实施方式中,多个步骤或方法可以用存储在存储器中且由合适的指令执行系统执行的软件或固件来实现。例如,如果用硬件来实现,和在另一实施方式中一样,可用本领域公知的下列技术中的任一项或他们的组合来实现:具有用于对数据信号实现逻辑功能的逻辑门电路的离散逻辑电路,具有合适的组合逻辑门电路的专用集成电路,可编程门阵列(pga),现场可编程门阵列(fpga) 等。

109.本技术领域的普通技术人员可以理解实现上述实施例方法携带的全部或部分步骤是可以通过程序来指令相关的硬件完成,所述的程序可以存储于一种计算机可读存储介质中,该程序在执行时,包括方法实施例的步骤之一或其组合。

110.此外,在本发明各个实施例中的各功能单元可以集成在一个处理模块中,也可以是各个单元单独物理存在,也可以两个或两个以上单元集成在一个模块中。上述集成的模块既可以采用硬件的形式实现,也可以采用软件功能模块的形式实现。所述集成的模块如果以软件功能模块的形式实现并作为独立的产品销售或使用时,也可以存储在一个计算机可读取存储介质中。

111.上述提到的存储介质可以是只读存储器,磁盘或光盘等。

112.在本说明书的描述中,参考术语“一个实施例”、“一些实施例”、“示例”、“具体示例”、或“一些示例”等的描述意指结合该实施例或示例描述的具体特征、结构、材料或者特点包含于本发明的至少一个实施例或示例中。在本说明书中,对上述术语的示意性表述不一定指的是相同的实施例或示例。而且,描述的具体特征、结构、材料或者特点可以在任何的一个或多个实施例或示例中以合适的方式结合。

113.尽管上面已经示出和描述了本发明的实施例,可以理解的是,上述实施例是示例性的,不能理解为对本发明的限制,本领域的普通技术人员在本发明的范围内可以对上述实施例进行变化、修改、替换和变型。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。