1.本发明的实施方式涉及进展判定系统、进展判定方法及存储介质。

背景技术:

2.为了自动地判定作业的进展,开发了各种技术。关于进展的判定,期望精度的提高。

3.现有技术文献

4.专利文献

5.专利文献1:日本特开2020-71566号公报

技术实现要素:

6.本发明要解决的技术问题在于,提供能够提高进展的判定精度的进展判定系统、进展判定方法及存储介质。

7.实施方式的进展判定系统具备第一取得部及第二取得部。所述第一取得部从拍摄有与作业有关的物品的图像中取得与多个颜色各自的面积值有关的面积数据。所述第二取得部将所述面积数据输入至分类器,从所述分类器取得表示进度的分类结果。

附图说明

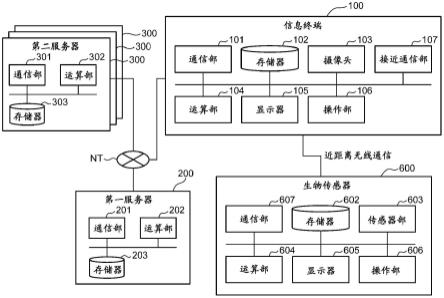

8.图1是表示实施方式的进展判定系统的示意图。

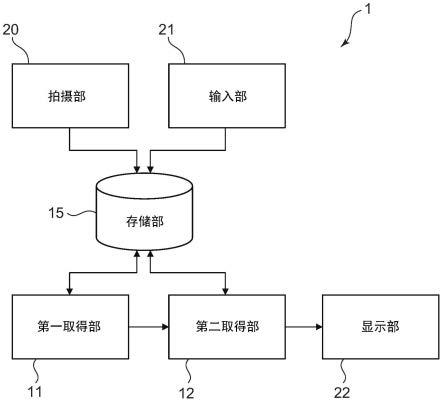

9.图2是用于说明实施方式的进展判定系统的处理的示意图。

10.图3是用于说明实施方式的进展判定系统的处理的示意图。

11.图4是用于说明实施方式的进展判定系统的处理的示意图。

12.图5是用于说明实施方式的进展判定系统的处理的示意图。

13.图6是表示实施方式的进展判定系统的输出例的示意图。

14.图7是表示实施方式的进展判定系统的其他输出例的示意图。

15.图8是用于说明工时的计算方法的示意图。

16.图9是表示实施方式中的分类器的学习时的处理的流程图。

17.图10是表示实施方式的进展判定系统的处理的流程图。

18.图11是表示实施方式的第一变形例中的分类器的学习时的处理的流程图。

19.图12是表示实施方式的第一变形例的进展判定系统的处理的流程图。

20.图13是表示实施方式的第二变形例的进展判定系统的示意图。

21.图14是表示应用了实施方式的第二变形例的进展判定系统的作业现场的示意图。

22.图15是表示面积数据的一例的曲线图。

23.图16是表示实施方式的第二变形例的进展判定系统的处理的流程图。

24.图17是表示硬件结构的示意图。

25.附图标记说明

26.1,2:进展判定系统、11:第一取得部、12:第二取得部、13:合并部、15:存储部、20,20a,20b:拍摄部、21:输入部、22:显示部、50:搁架、51~53:部件、60:配件盒、61:标签、62:电缆、70:手推车、71、72:部件、90:处理装置、91:cpu、92:rom、93:ram、94:存储装置、95:输入接口、95a:输入装置、96:输出接口、96a:显示装置、97:通信接口、97a:服务器、98:系统总线、99:相机、100:判定结果、110:目标时刻、120:进度、130:目标进度、140:实绩进度、141:差量、150~153:实绩时刻、160:到达时刻、170:指示器、a:作业、o:作业者

具体实施方式

27.以下,参照附图对本发明的各实施方式进行说明。在本技术说明书和各图中,对与已说明过的要素相同的要素标注相同的附图标记并适当省略详细的说明。

28.图1是表示实施方式的进展判定系统的示意图。

29.实施方式的进展判定系统用于根据拍摄有与作业有关的物品的图像来判定该作业的进度。作业是制造、物流、施工、检查等中的规定的工作。物品是成为作业对象的产品或设备、作业中使用的设备、部件或工具等。

30.如图1所示,进展判定系统1包含第一取得部11、第二取得部12、存储部15、拍摄部20、输入部21及显示部22。拍摄部20拍摄与作业有关的物品,生成图像。拍摄部20反复拍摄物品。拍摄部20也可以通过拍摄来生成动态图像。拍摄部20将图像或动态图像保存于存储部15中。

31.图像中关联有表示拍摄到的物品的物品识别数据、表示该物品所关联的作业的作业识别数据、及拍摄时刻。物品识别数据及作业识别数据在拍摄开始前由用户预先设定。用户是作业者、作业的监督者、或者对进展判定系统1进行管理的管理者等。

32.第一取得部11取得保存于存储部15中的图像。在存储部15中保存有动态图像的情况下,第一取得部11从动态图像中切出静态图像。第一取得部11计算图像中的多个颜色各自的面积值。具体而言,从图像中提取的颜色预先由用户设定,并保存于存储部15中。用户预先设定与各个颜色对应的像素值的范围。

33.例如,在图像中的各像素的像素值基于rgb颜色空间的情况下,像素值包含r、g及b各自的亮度。相对于r、g、及b各自的亮度的上限及下限被设定为范围。在图像中的各像素的像素值基于lab颜色空间的情况下,相对于l、a、及b各自的值的上限及下限被设定为范围。范围针对各个颜色而设定。例如,在进度的判定中使用4个颜色的情况下,针对4个颜色分别设定范围。

34.第一取得部11将各像素的像素值与多个范围进行比较。在像素值包含在某一范围内时,第一取得部11判定为具有该像素值的像素的颜色为与该范围对应的颜色。通过各像素值与多个范围的比较,判定各像素的颜色是否为预先设定的某一颜色。第一取得部11基于比较结果,计算各个颜色的像素数。第一取得部11使用各个颜色的像素数作为各个颜色的面积值。第一取得部11将与各色的面积值有关的面积数据发送至第二取得部12。面积数据例如包含各色的面积值。面积数据也可以包含各色的面积值的比率或分布。第一取得部11将面积数据与物品识别数据、作业识别数据及拍摄时刻建立关联并保存于存储部15。

35.第二取得部12在取得包含从各色的面积值、比率及分布中选择的一个以上在内的面积数据时,将该面积数据输入至分类器。分类器如果被输入面积数据,则输出对作业的进

度进行表示的分类结果。分类器预先由用户学习并保存于存储部15中。例如,通过随机森林学习的分类器或贝叶斯分类器等被用作分类器。

36.或者,作为面积数据,也可以使用对所述面积值、所述比率或者所述分布进行表示的直方图。即,面积数据也可以是对与各色的面积值有关的信息进行表示的图像数据。在该情况下,用于对图像数据进行分类的神经网络被用作分类器。优选神经网络包括卷积神经网络(cnn:convolutional neural network)。

37.分类器如果被输入面积数据,则将进度的分类结果输出。例如,分类器输出面积数据的对各进度的适合率。第二取得部12根据分类结果,选择适合率最高的进度。第二取得部12取得所选择的进度作为与所输入的面积数据对应的进度。第二取得部12将所取得的进度作为与面积数据建立了关联的拍摄时刻的作业的进度而保存于存储部15。

38.输入部21在用户向进展判定系统1输入上述的各种数据时使用。显示部22将从第二取得部12输出的数据以用户能够视觉确认的方式显示。

39.图2~图5是用于说明实施方式的进展判定系统的处理的示意图。

40.参照具体例,对进展判定系统1的处理进行说明。在此,对使用图像中的各色的面积值作为面积数据的例子进行说明。

41.(学习)

42.用户使分类器预先学习。用户准备学习数据。例如,学习数据包含多个学习图像和与多个学习图像分别建立关联的多个进度。例如,用户通过拍摄部20拍摄与各个进度对应的状态的物品,生成学习图像。学习图像的拍摄条件与进度的判定时的拍摄条件同样地设定。例如,在准备学习图像时和判定进度时,拍摄部20相对于物品的位置及角度被设定为相同。作为学习图像,也可以使用cad图、3d模型图像或者人描绘的插图等来代替拍摄到的图像。

43.在该例子中,第一取得部11作为使分类器学习的学习部发挥功能。第一取得部11从各个学习图像中取得面积数据。第一取得部11将面积数据作为输入数据,将与该学习图像建立关联的进度作为标签,使分类器学习。

44.图2的(a)是由用户准备的学习图像的一例。在学习图像ti1中拍摄有搁架50。在搁架50上收纳有在作业中使用的部件51~53。搁架50的颜色为白色(wh)。部件51的颜色为黄色(yl)。部件52的颜色为黑色(bk)。部件53的颜色为绿色(gr)。学习图像ti1与进度“0%”建立关联。进度既可以如该例那样以百分率表示,也可以用其他数值表示。

45.在该情况下,在进度的判定中,能够使用白、黄、绿及黑这4色。用户设定白、黄、绿及黑各自的亮度的范围。例如,在各像素值基于rbg颜色空间且以256灰度表示的情况下,(r:g:b)=(245~255:245~255:245~255)的范围被设定为白色的范围。(r:g:b)=(245~255:245~255:0~10)的范围被设定为黄色的范围。(r:g:b)=(0~10:245~255:0~10)的范围被设定为绿色的范围。(r:g:b)=(0~10:0~10:0~10)的范围被设定为黑色的范围。

46.第一取得部11将图2的(a)的学习图像ti1的各像素的像素值与由用户设定的各个颜色的范围进行比较。图2的(b)是根据比较结果获得的图2的(a)的学习图像ti1的面积数据的一例。第一取得部11将图2的(b)的面积数据作为输入数据,将0%作为标签,对分类器执行有监督学习。

47.图3的(a)~图3的(d)表示其他学习图像ti2~ti5和与各个学习图像建立关联的

进度。在该例子中,在作业中,首先,部件51被取出。接着,部件52被取出。最后,部件53被取出。部件越被取出,则该部件的颜色的面积越小。搁架50的颜色的面积变大。第一取得部11与学习图像ti1同样地,从学习图像ti2~ti5分别取得面积数据。第一取得部11使用多个面积数据及多个标签(进度),使分类器依次学习。由此,分类器被学习成能够根据面积数据的输入来输出进度。

48.分类器也可以代替进度而输出作业所包含的工序的分类结果。例如,在1个作业包含多个工序的情况下,工序对应于进度。在该情况下,准备学习图像和与该学习图像对应的工序名作为学习数据。第一取得部11使用面积数据作为输入数据,并使用工序名作为标签,使分类器学习。第二取得部12在取得作为分类结果的工序名时,取得与该工序名建立关联的进度作为与所输入的面积数据对应的进度。

49.或者,也可以对分类器执行无监督学习。第一取得部11从所准备的多个学习图像中取得多个面积数据。第一取得部11将多个面积数据依次输入至分类器,执行无监督学习。由此,分类器被学习成能够对多个面积数据进行分类。第一取得部11将学习完毕的分类器保存于存储部15中。

50.在执行无监督学习的情况下,若向分类器输入面积数据,则分类器输出该面积数据的分类结果。第二取得部12参照属于所输出的分类的学习图像,取得与该学习图像建立关联的进度作为与输入至分类器的面积数据对应的进度。

51.如上所述,分类器也可以通过有监督学习来输出直接表示进度的分类结果。分类器也可以通过无监督学习来输出间接地表示进度的分类结果。在任何情况下,第二取得部12都能够基于表示进度的分类结果,得到拍摄时的作业的进度。

52.图4的(a)~图4的(d)是其他学习图像的一例。在学习图像ti6~ti9中拍摄有配件盒60。在配件盒60中收纳有带有标签61的电缆62。配件盒60的上表面的颜色为蓝色(bl)。配件盒60的内侧及标签61的颜色为白色(wh)。电缆62的颜色为黑色(bk)。学习图像ti6~ti9分别关联有进度“0%”、“25%”、“50%”、“100%”。

53.第一取得部11根据学习图像ti6~ti9的每一个,计算包含蓝色、白色、黑色的面积值在内的面积数据。第一取得部11使用多个面积数据及多个进度,使分类器依次学习。

54.(判定)

55.图5的(a)是为了判定进度而由拍摄部20拍摄到的图像im1的一例。在图像im1中,拍摄了全部的部件51已被取出且部件52的一部分已被取出的情况。第一取得部11根据图像im1计算各色的面积值。图5的(b)表示根据图5的(a)的图像im1计算出的各色的面积值。

56.第二取得部12将图5的(b)的面积数据输入至分类器。例如,分类器输出对与所输入的面积数据对应的进度为50%这一情况进行表示的分类结果。第二取得部12取得进度“50%”作为拍摄到图像im1时的作业的进度。或者,分类器输出对所输入的面积数据属于与图3的(b)的学习图像ti3的面积数据相同的分类这一情况进行表示的分类结果。第二取得部12取得与学习图像ti3建立关联的进度“50%”作为拍摄图像im1时的作业的进度。

57.第二取得部12还可以计算实绩工时。例如,第二取得部12计算出从由拍摄部20开始拍摄的时间到得到图像的时间为止而作为实绩工时。第二取得部12将实绩工时和进度建立关联并保存于存储部15中。

58.(前处理)

59.第一取得部11也可以从由拍摄部20生成的图像中切出一部分。用户在图像中预先指定拍摄有物品的区域。例如,指定4角的坐标,切出拍摄有物品的四边形的图像。对学习图像及进展判定用的图像这两者执行切出。通过切出图像,能够抑制物品周围的设备、地板、墙壁、人等的颜色对学习及判定造成影响。

60.进而,第一取得部11也可以从切出的图像中去除拍摄有人的区域。例如,预先准备用于识别图像中的人的识别器。识别器包含神经网络。优选使用卷积神经网络(cnn)。在识别器中,预先执行有监督学习,以便能够从图像中识别人。第一取得部11在由识别器在图像中识别出人时,将识别出的区域去除。由此,能够抑制人的衣服的颜色、人携带的物品的颜色等对判定造成影响。

61.第一取得部11可以对图像的亮度及对比度中的至少一个进行归一化。例如,第一取得部11对亮度及亮度对比度进行归一化。对学习图像及进展判定用的图像这两者执行归一化。通过归一化,能够降低作业现场的明亮度的变化、相机的设定的变化等对各像素值造成的影响。

62.(显示)

63.显示部22显示从第二取得部12输出的数据。例如,第二取得部12将进度及作业实绩输出至显示部22。也可以在存储部15中保存作业计划。第二取得部12还取得作业计划,并将进度、作业实绩及作业计划输出至显示部22。

64.图6是表示实施方式的进展判定系统的输出例的示意图。

65.第二取得部12使显示部22显示图6所示的判定结果画面100。在判定结果画面100中,显示有目标时刻110、进度120、目标工时130、实绩工时140及实绩时刻150。

66.作业计划包含目标时刻110及目标工时130。目标时刻110是达到各个进度120的时刻的目标。目标工时130是针对该作业的目标的工时。在该例中,目标工时130通过目标时刻110与条(bar)的长度的对比来表现。具体而言,条从目标时刻13时延伸至17时,表示目标工时为4小时。

67.作业实绩包含实绩工时140及实绩时刻150。实绩时刻150是实际达到各个进度120的时刻。是达到各个进度所需的实绩的工时。在该例中,实绩工时140通过实绩时刻150与条的长度的对比来表现。具体而言,条从目标时刻13时延伸至17时,表示实绩工时为4小时。

68.实绩工时140及实绩时刻150基于拍摄到图像的时刻和由第二取得部12取得的进度来决定。例如,拍摄部20开始拍摄的时刻被视为作业的开始时刻。达到各个进度为止的时间被作为实绩工时来计算。

69.在图6的例子中,在17时得到最新的进度的判定结果。在作业计划中,在13时开始作业a,在14时、15时30分及17时进度分别达到10%、20%及30%作为目标而设定。在实绩中,在13时开始作业a,在15时及17时,进度分别达到10%及20%。进度未达到30%。达到进度10%的实绩时刻及达到进度20%的实绩时刻比目标时刻延迟。

70.例如,关于某个进度,在实绩时刻相对于目标时刻延迟的情况下,第二取得部12将该实绩时刻以能够与其他实绩时刻相区别的方式进行显示。在图6的例子中,“15时”的实绩时刻152及“17时”的实绩时刻153已以与“13时”的实绩时刻151相区别的方式进行显示。由此,用户能够容易地确认在哪个进度中比目标发生了延迟。在实绩工时140中,也可以示出目标工时130与实绩工时140的差量145。由此,用户容易直观地理解目标工时130与实绩工

时140之差。

71.第二取得部12也可以预测达到某一进度的到达时刻。到达时刻使用最新的进度的目标时刻与实际时刻之差来计算。第二取得部12将最新的进度的目标时刻与下一进度的目标时刻之差与最新的进度中的实际时刻相加。由此,计算出达到下一进度的到达时刻。

72.在图6的例子中,进度20%的目标时刻与30%的目标时刻之差为1.5小时。第二取得部12对进度20%的实绩时刻加上1.5小时,作为到达时刻160,计算出18时30分。

73.或者,关于到达时刻,也可以考虑直至达到最新的进度为止的作业的提前度。第二取得部12将最后判定了进度的时刻的目标的进度与实际的进度进行比较。第二取得部12计算实绩的进度相对于目标的进度之比。第二取得部12对最新的进度的目标时刻与计算到达时刻的进度的目标时刻之差乘以所述比。第二取得部12将最后判定了进度的实绩时刻与将乘以所述比之后的差相加。

74.例如,在图6的例子中,第二取得部12将最后判定了进度的17时的目标的进度30%与实际的进度20%进行比较。第二取得部12计算实绩的进度20%相对于目标的进度30%的比0.67。第二取得部12将最新的进度20%时的目标时刻15时30分与计算到达时刻的进度30%时的目标时刻17时之差1.5小时乘以上述比0.67。第二取得部12对最后判定了进度的实绩时刻17时加上1.5小时与0.67之积。由此,作为到达时刻,计算出19时15分。

75.通过上述的方法,第二取得部12也可以预测达到进度100%的到达时刻。达到进度100%的到达时刻换言之是作业结束的预计时刻。

76.通过基于最新的进度的判定结果来预测到达时刻,从而能够提高用户的便利性。

77.图7的(a)及图7的(b)是表示实施方式的进展判定系统的其他输出例的示意图。

78.在1个作业包含多个工序的情况下,在作业计划中,也可以关联有进度和工序。例如,第二取得部12取得进度,并且取得与该进度建立关联的工序名。

79.在图7的(a)所示的例子中,作业a包含工序a及b。例如,作业a的进度0%~10%与工序a建立关联。作业a的进度10%~30%与工序b建立关联。在目标工时130中,显示有工序a的目标工时131及工序b的目标工时132。在实绩工时140中,显示有工序a的目标工时141及工序b的目标工时142。

80.也可以显示各个工序中的进度的目标与实绩的比较。例如,用户通过操作输入部21,从而能够使显示于显示部22的指示器170移动。若用户使指示器170与目标实绩130中的任一个工序匹配并进行点击,则显示如图7的(b)所示那样的该工序的详细。在图7的(b)所示的详细画面200中,显示了进度220、目标进度230及实绩进度240。目标进度230表示在拍摄到最新的图像的时刻之前应该达成的进度。实际进度240表示在拍摄到最新的图像的时刻之前能够实现的进度。通过详细画面200的显示,即使在工序数多的情况下,用户也能够容易地掌握各个工序中的详细。

81.也可以基于进度的判定结果、与进度建立关联的工序及拍摄时刻,来计算各工序的工时。在图7的(a)所示的例子中,从13时至15时为止的2小时能够作为工序a的实绩工时而计算出。从15时到17时为止的2小时能够作为工序b的实绩工时而计算出。

82.图8是用于说明工时的计算方法的示意图。

83.参照图8,对工时的更详细的计算方法进行说明。对1个进度关联有1个工序。在图7的(a)的例子中,对进度0%以上且小于10%,关联有工序a。对进度10%以上且小于30%,关

联有工序b。

84.图8的横轴表示时间。图8中的虚线表示拍摄部20的拍摄定时。拍摄部20在定时t1开始拍摄。拍摄的开始时刻作为工序a的开始时刻来处理。在定时t2之前,进度被判定为小于10%。因此,从定时t1至t2,判定为执行了工序a。从定时t3至t4,判定为进度为10%以上且小于30%。因此,从定时t3至t4,判定为执行了工序b。在定时t5,判定为进度为30%以上。因此,在定时t5,判定为执行其他工序。

85.在图8的例子中,作为实绩工时的计算方法,能够应用以下的2种方法。

86.在第一个方法中,从定时t1至t2作为工序a的实绩工时来计算,从定时t3至t4作为工序b的实绩工时来计算。

87.在第二个方法中,从定时t1至t3作为工序a的实绩工时来计算,从定时t3至t4作为工序b的实绩工时来计算。或者,从定时t1至t2作为工序a的实绩工时来计算,从定时t2至t4作为工序b的实绩工时来计算。

88.根据第一个方法,在工序a的结束时刻与工序b的开始时刻之间产生差。因此,计算出的实绩工时比实际的工时短。如第二个方法那样,对于连续的2个工序,通过使前一工序的开始时刻和后一工序的结束时刻一致,从而能够减小计算出的实绩工时与实际的工时之差。

89.图9是表示实施方式中的分类器的学习时的处理的流程图。

90.首先,用户使用输入部21设定进展的判定所需的数据(步骤s1),并保存于存储部15。例如,设定各个颜色的范围、拍摄到的图像中的物品的位置等。此外,用户在存储部15中适当地保存作业计划、使其进行学习的分类器、识别器等。用户准备学习数据(步骤s2),并保存于存储部15。学习数据包含多个学习图像与进度的组。第一取得部11从各个学习图像中取得面积数据(步骤s3)。第一取得部11使用多个面积数据来使分类器学习(步骤s4)。如上所述,学习可以执行有监督学习或无监督学习中的任一个。第一取得部11将所学习的分类器保存于存储部15中。

91.图10是表示实施方式的进展判定系统的处理的流程图。

92.拍摄部20拍摄与作业有关的物品,并生成图像(步骤s11)。第一取得部11对图像进行前处理(步骤s12)。第一取得部11从图像中取得面积数据(步骤s13)。第二取得部12将面积数据输入至分类器(步骤s14),得到分类结果。第二取得部12取得与分类结果对应的进度(步骤s15)。第二取得部12输出进度的判定结果(步骤s16)。

93.对实施方式的优点进行说明。

94.在实施方式的进展判定系统1中,在进展的判定中使用面积数据。图像中的颜色的面积不易受到物品的状态(朝向、位置、细节部分的构造等)的影响。例如,即使在作业时的物品的状态从预先设想的物品的状态发生变化的情况下,颜色的面积值的变化也不易受到影响。通过使用面积数据,能够降低物品的状态对进度的判定结果造成的影响,提高进度的判定精度。

95.如果作业的进展与图像中的颜色的面积值之间存在相关性,则进展判定系统1能够应用于制造、物流、施工、检查等广泛的作业中。

96.(第一变形例)

97.为了进行进度的判定,除了面积数据之外,也可以使用边缘数据。第一取得部11从

物品的图像中取得面积数据,并且对图像执行边缘检测。边缘检测可以使用canny edge法或sobel法。边缘检测时的针对亮度变化的阈值由用户预先设定,并保存于存储部15中。通过边缘检测,从图像中提取多个边缘,取得边缘数据。第一取得部11将边缘数据输出至第二取得部12,并且保存于存储部15。

98.在分类器的学习时,第一取得部11还从学习图像中取得面积数据及边缘数据。第一取得部11从多个学习图像中分别取得面积数据及边缘数据的组,使分类器学习。在有监督学习中,分类器以根据面积数据及边缘数据的组的输入而输出表示进度的分类结果的方式进行学习。

99.图11是表示实施方式的第一变形例中的分类器的学习时的处理的流程图。

100.用户与图9所示的流程图同样地设定进度的判定所需的数据(步骤s1)。此时,用户除了设定各个颜色的范围之外,还设定用于边缘检测的阈值。用户准备学习数据(步骤s2)。第一取得部11从各个学习图像中取得面积数据及边缘数据(步骤s3a)。第一取得部11使用面积数据及边缘数据,使分类器学习(步骤s4a)。

101.图12是表示实施方式的第一变形例的进展判定系统的处理的流程图。

102.与图10所示的流程图同样地,执行步骤s11及s12。第一取得部11从图像中取得面积数据及边缘数据(步骤s13a)。第二取得部12将面积数据及边缘数据输入至分类器(步骤s14a),得到分类结果。第二取得部12取得与分类结果对应的进度(步骤s15)。第二取得部12输出进度的判定结果(步骤s16)。

103.通过在面积数据的基础上使用边缘数据,在作业的进度与物品的形状存在相关的情况下,能够进一步提高进度的判定精度。

104.(第二变形例)

105.图13是表示实施方式的第二变形例的进展判定系统的示意图。

106.第二变形例的进展判定系统2还包含合并部13。进展判定系统2包含多个拍摄部20。

107.各个拍摄部20在相同的定时从相互不同的位置及角度对相同的物品进行拍摄,生成多个图像。各个拍摄部20反复拍摄物品,将图像保存于存储部15。各个图像关联有表示拍摄到的物品的物品识别数据、表示该物品所关联的作业的作业识别数据、及拍摄时刻。

108.各个拍摄部20的拍摄定时也可以在进度不产生实质的差的范围内存在偏差。例如,在需要1天的作业的进度的判定中,各个拍摄部20的拍摄定时可以存在小于1分钟的偏差。在这样的情况下,各个拍摄部20也能够视为在实质上相同的定时拍摄物品。

109.第一取得部11从各个图像中取得面积数据,将基础的图像的物品识别数据、作业识别数据及拍摄时刻与面积数据建立关联并保存于存储部15。第一取得部11将面积数据、物品识别数据、作业识别数据及拍摄时刻发送至合并部13。

110.合并部13选择基于在相同的定时拍摄到的多个图像的多个面积数据。合并部13将所选择的多个面积数据合并为1个面积数据。例如,合并部13将多个面积数据的各色的面积值平均化。或者,合并部13也可以基于针对各个面积数据的准确度来将多个面积数据合并。

111.作为准确度,能够使用从以下的第一准确度~第四准确度中选择的1个以上。

112.第一准确度对应于各个面积数据的可靠性,由用户预先设定。根据拍摄到的图像计算出的面积数据越准确,面积数据的可靠性越高,第一准确度被设定得越大。

113.第二准确度是图像中的物品的大小。在通过前处理切出了所拍摄到的图像的一部分的情况下,所切出的图像的尺寸对应于物品的大小。合并部13基于所切出的图像的尺寸来设定第二准确度。或者,图像中的物品的大小依赖于物品与拍摄部20之间的距离。与物品和拍摄部20之间的距离相对应的值也可以作为第二准确度而由用户预先设定。

114.第三准确度是拍摄部20相对于物品的角度。例如,在物品的颜色根据作业的进展而变化的区域朝向上方的情况下,在从上方拍摄物品而得到的图像中,颜色的变化更准确地出现的可能性较高。与拍摄部20相对于物品的角度相对应的值作为第三准确度而由用户预先设定。

115.第四准确度基于在图像中拍摄到的人的区域的大小。在图像中,若物品的一部分被人遮挡,则无法准确地计算面积值。例如,第一取得部11切出所拍摄到的图像的一部分。第一取得部11识别所切出的图像中的人,去除拍摄有人的区域。被去除的区域的尺寸越大,则合并部13使第四准确度越小。或者,也可以是,被去除的区域的尺寸相对于所切出的图像的尺寸的比例越大,则合并部13使第四准确度越小。

116.合并部13针对各个面积数据计算准确度。在使用4个准确度中的2个以上的情况下,将这些准确度相加,而计算出1个准确度。也可以对2个以上的准确度分别设定权重,通过加权和来计算出1个准确度。

117.合并部13使用多个准确度将多个面积数据合并为1个面积数据。例如,合并部13将多个准确度归一化,以使多个准确度的和成为“1”。合并部13对多个面积数据和归一化后的多个准确度分别进行累计,并将这些累计值相加。由此,得到合并后的1个面积数据。

118.第二取得部12将合并后的面积数据输入至分类器,取得分类结果。

119.参照具体例,对进展判定系统2的处理进行说明。

120.图14是表示应用了实施方式的第二变形例的进展判定系统的作业现场的示意图。

121.在图14所示的作业现场,设置有拍摄部20a及20b。拍摄部20a及20b从相互不同的位置及角度来拍摄手推车70。在手推车70的顶面放置有部件71及72。作业者o从手推车70依次取出部件71及72,并组装到放置于其他场所的设备中。例如,手推车70的顶面的颜色为白色(wh)。部件71的颜色为黄色(yl)。部件72的颜色为绿色(gr)。

122.图15的(a)~图15的(c)是表示面积数据的一例的曲线图。

123.拍摄部20a及20b在相同的时机拍摄手推车70的顶面、部件71及部件72。通过拍摄部20a及20b分别生成第一图像及第二图像。第一取得部11从第一图像中取得第一面积数据,从第二图像中取得第二面积数据。图15的(a)及图15的(b)分别例示第一面积数据及第二面积数据。合并部13将第一面积数据及第二面积数据合并。合并部13参照第一准确度~第四准确度。

124.例如,关于第一准确度,第一面积数据的可靠性和第二面积数据的可靠性是同等的。用户将针对第一面积数据的第一准确度和针对第二面积数据的第一准确度设定为相同的值。

125.关于第二准确度,手推车70与拍摄部20a的距离比手推车70与拍摄部20b的距离短。用户将针对第一面积数据的第二准确度设定得比针对第二面积数据的第二准确度大。

126.关于第三准确度,拍摄部20a设置于手推车70的正上方,与手推车70的顶面正对。拍摄部20b从斜上方拍摄手推车70。拍摄部20a与拍摄部20b相比,容易拍摄手推车70、部件

71及部件72的整体。用户将针对第一面积数据的第三准确度设定得比针对第二面积数据的第三准确度大。

127.关于第四准确度,例如,在第一图像中未拍摄到作业者o。在第二图像中拍摄有作业者o。在该情况下,在前处理中,第一取得部11从第二图像中去除拍摄有作业者o的区域。合并部13根据被去除的区域的尺寸相对于第二图像的尺寸的比例,减小针对第二面积数据的第四准确度。

128.合并部13针对第一面积数据,将第一准确度~第四准确度相加,计算1个准确度。合并部13针对第二面积数据,将第一准确度~第四准确度相加,计算1个准确度。合并部13对各个准确度进行归一化,以使针对第一面积数据的准确度与针对第二面积数据的准确度之和成为“1”的方式。合并部13对第一面积数据的各面积值乘以归一化后的准确度。合并部13对第二面积数据的各面积值乘以归一化后的准确度。合并部13针对各个颜色,将第一面积数据与准确度的累计值和第二面积数据与准确度的累计值相加。由此,多个面积数据被合并为1个。

129.图15的(c)是图15的(a)及图15的(b)所示的第一面积数据及第二面积数据被合并后的结果的一例。在该例子中,针对第一面积数据的准确度比针对第二面积数据的准确度大。因此,合并后的面积数据与第一面积数据之差小于合并后的面积数据与第二面积数据之差。第二取得部12将图15的(c)所示的面积数据输入至分类器,取得分类结果。

130.图16是表示实施方式的第二变形例的进展判定系统的处理的流程图。

131.多个拍摄部20在相同的定时拍摄物品,生成多个图像(步骤s11b)。第一取得部11对各个图像执行前处理(步骤s12b)。第一取得部11从各个图像中取得面积数据(步骤s13b)。第二取得部12将多个面积数据合并为1个(步骤s20)。以后,与图10所示的流程图同样地执行步骤s14~s16。

132.在第二变形例中,也可以与第一变形例同样地使用边缘数据。第一取得部11从在相同的定时拍摄到的图像的每一个中取得面积数据及边缘数据。合并部13将多个面积数据合并为1个面积数据。合并部13将多个边缘数据合并为1个边缘数据。例如,第一取得部11通过使多个边缘数据重叠,来生成合并后的1个边缘数据。或者,第一取得部11也可以通过poisson image editing对多个边缘数据进行合成,生成合并后的1个边缘数据。第二取得部12将面积数据及边缘数据输入至分类器,取得分类结果。

133.图17是表示硬件结构的示意图。

134.实施方式的进展判定系统1能够通过图17所示的硬件结构来实现。图17所示的处理装置90包含cpu91、rom92、ram93、存储装置94、输入接口95、输出接口96及通信接口97。

135.rom92存储用于对计算机的操作进行控制的程序。rom92中存储有使计算机实现上述各处理所需的程序。ram93作为供rom92中存储的程序展开的存储区域发挥功能。

136.cpu91包含处理电路。cpu91将ram93作为工作存储器,执行在rom92或存储装置94中的至少任意一个中存储的程序。在程序的执行中,cpu91经由系统总线98对各结构进行控制,并执行各种处理。

137.存储装置94存储程序的执行所需的数据、通过程序的执行而得到的数据。

138.输入接口(i/f)95将处理装置90与输入装置95a连接。输入i/f95例如是usb等串行总线接口。cpu91能够经由输入i/f95从输入装置95a读入各种数据。

139.输出接口(i/f)96将处理装置90与显示装置96a连接。输出i/f96例如是数字digital visual interface(dvi)或high-definition multimedia interface(hdmi:注册商标)等影像输出接口。cpu91能够经由输出i/f96向显示装置96a发送数据,使显示装置96a显示图像。

140.通信接口(i/f)97将处理装置90外部的服务器97a与处理装置90连接。通信i/f97例如是lan卡等网卡。cpu91能够经由通信i/f97从服务器97a读入各种数据。相机99拍摄物品,并将图像保存于服务器97a。

141.存储装置94包含从硬盘驱动器(hdd:hard disk drive)及静态驱动器(ssd:solid state drive)中选择的1个以上。输入装置95a包含鼠标、键盘、麦克风(声音输入)及从触摸板中选择的1个以上。显示装置96a包含从监视器及投影仪中选择的1个以上。也可以如触摸面板那样使用具备输入装置95a和显示装置96a这两者的功能的设备。

142.处理装置90作为第一取得部11、第二取得部12及合并部13发挥功能。存储装置94及服务器97a作为存储部15发挥功能。输入装置95a作为输入部21发挥功能。显示装置96a作为显示部22发挥功能。相机99作为拍摄部20发挥功能。

143.通过使用以上说明的进展判定系统或者进展判定方法,能够提高进度的判定精度。通过使用用于使计算机作为进展判定系统进行动作的程序,能够得到同样的效果。

144.上述的各种数据的处理也可以作为能够使计算机执行的程序,记录在磁盘(软盘及硬盘等)、光盘(cd-rom、cd-r、cd-rw、dvd-rom、dvd

±

r、dvd

±

rw等)、半导体存储器、或者其他非暂时性的计算机可读取的记录介质(non-transitory computer-readable storage medium)中。

145.例如,记录在记录介质中的信息可以由计算机(或嵌入式系统)读取。在记录介质中,记录形式(存储形式)是任意的。例如,计算机从记录介质读出程序,并基于该程序使cpu执行在程序中记述的指示。在计算机中,程序的取得(或读出)也可以通过网络来进行。

146.实施方式也可以包含以下的技术方案。

147.(技术方案1)

148.一种进展判定系统,具备:

149.第一取得部,从拍摄有与作业有关的物品的图像中取得与多个颜色各自的面积值有关的面积数据;以及

150.第二取得部,将所述面积数据输入至分类器,从所述分类器取得表示进度的分类结果。

151.(技术方案2)

152.根据技术方案1所述的进展判定系统,其中,所述面积数据包含所述多个颜色各自的面积值、所述多个颜色各自的面积值的比率或所述多个颜色各自的面积值的分布。

153.(技术方案3)

154.根据技术方案2所述的进展判定系统,其中,所述第一取得部基于与所述多个颜色分别对应的多个像素值的范围,判定所述图像中包含的各像素的颜色,将各个所述颜色的像素数作为所述面积值来计算。

155.(技术方案4)

156.根据技术方案1至3中任一项所述的进展判定系统,其中,所述第一取得部从所述

图像中进一步取得表示所述物品的边缘的边缘数据,

157.所述第二取得部将所述面积数据及所述边缘数据输入至所述分类器,取得所述分类结果。

158.(技术方案5)

159.根据技术方案1至4中任一项所述的进展判定系统,其中,还具备合并部,

160.所述第一取得部从在相同的定时从相互不同的角度拍摄所述物品而得到的多个所述图像中,分别取得多个所述面积数据,

161.所述合并部基于针对所述多个面积数据的各个准确度将所述多个面积数据合并为1个,

162.所述第二取得部将合并后的所述面积数据输入至所述分类器,取得所述分类结果。

163.(技术方案6)

164.根据技术方案5所述的进展判定系统,其中,针对所述多个面积数据的每一个的准确度基于从第一准确度、第二准确度、第三准确度及第四准确度中选择的1个以上,

165.所述第一准确度与针对各个所述面积数据的可靠性对应而设定,

166.所述第二准确度与各个所述图像中的所述物品的大小对应而设定,

167.所述第三准确度与拍摄各个所述图像的拍摄部相对于所述物品的角度对应而设定,

168.所述第四准确度与各个所述图像中的人的大小对应而设定。

169.(技术方案7)

170.根据技术方案1至6中任一项所述的进展判定系统,其中,还具备拍摄所述物品的拍摄部,

171.所述第一取得部从由所述拍摄部拍摄到的图像中切出拍摄有所述物品的区域,从所切出的所述图像中取得所述面积数据。

172.(技术方案8)

173.根据技术方案1至7中任一项所述的进展判定系统,其中,所述第一取得部在从所述图像中去除拍摄有人的区域之后,取得所述面积数据。

174.(技术方案9)

175.根据技术方案1至8中任一项所述的进展判定系统,其中,所述进展判定系统还具备显示部,所述显示部显示所述进度、基于所述图像被拍摄到的时刻而计算出的所述作业的实绩和预先设定的所述作业的计划。

176.(技术方案10)

177.根据技术方案1至9中任一项所述的进展判定系统,其中,所述分类器将从拍摄有所述物品的学习图像中取得的面积数据作为输入数据,使用与所述学习图像对应的进度作为标签来进行学习,

178.对学习完毕的所述分类器输入从所述图像中取得的所述面积数据。

179.以上,例示了本发明的几个实施方式,但这些实施方式是作为例子而提示的,并不意图限定发明的范围。这些新的实施方式能够以其他各种方式实施,在不脱离发明的主旨的范围内,能够进行各种省略、置换、变更等。这些实施方式及其变形例包含在发明的范围

或主旨内,并且包含在权利要求书所记载的发明及其等同的范围内。前述的各实施方式能够相互组合来实施。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。