1.本发明涉及计算机视觉领域。具体而言,涉及一种基于宠物姿态的心情识别方法。

背景技术:

2.因为宠物的陪伴,可以给人带来温暖、喜悦以及身心的改变,所以,养宠物的人数不断增加,并且人们将他们当做家人对待,但是由于语言不通,与宠物沟通存在障碍,所以,我们只能从宠物表现行为中判断他们的心情。

3.现有技术中,基于深度学习和svm进行动物心情识别,对大量动物图片的十三个身体关键点进行标记,构建深度学习的动物姿态估计模型,使该模型可估计出动物的中心点位置和十三个身体关键点的位置,基于动物的中心点位置变化、包含有尾巴关键点的十三个身体关键点的位置关系和相对位置变化关系构建多个svm分类器,用于判断动物的行为与心情;由于现有技术中十三个身体关键点的来源通过模型训练得到,可能准确性不够,并且对图片中十三身体关键点进行标记会花费大量的人力,以及需要很长地时间才能训练得到比较精确地识别十三身体关键点模型,所以为了使关键点的来源更加准确,减少人力成本和计算时间,提高计算机工作效率,本发明提出一种基于宠物姿态的心情识别方法。

4.随着计算机视觉领域的发展以及图像获取设备性能的提高,人们对于图像清晰度的需求逐渐提高,并且对于图像分类与检测任务在精度和速度两个方面对计算机视觉技术提出了更高的挑战。图像分类任务是指对完整图像所属类别进行分类,其典型方法可分为数字图像处理技术与深度学习技术两种。

5.在数字图像处理技术中由于其只根据图像的像素特征进行分类导致分类鲁棒性低,但是数字图像处理方法对于像素的敏感度十分显著;在深度学习技术中由于基于各种结构的特征提取网络能够自动进行特征提取,避免了人工参与过程,提高了分类准确率,降低了人工成本,但特征提取过程“黑盒”化,严重依赖训练数据集也成为了深度学习技术的弊端。现有的图像分类任务面对的图像大多为场景复杂,背景混乱图像,如何从中提取出典型特征是以上两种方法需要共同面对的难题。

技术实现要素:

6.本发明正是基于现有技术的上述需求而提出的,本发明要解决的技术问题是为了使关键点的来源更加准确,减少人力成本和计算时间,提高计算机工作效率,动物心情识别更加精确,提供一种基于宠物姿态的心情识别方法。

7.为了解决上述问题,本发明是采用如下技术方案实现的:一种基于宠物姿态的心情识别方法,其特征在于,包括:对原始图像进行灰度化处理,得到灰度化图像;基于sobel算子对所述灰度化图像进行边缘处理,获得宠物前景目标的边缘轮廓图像,对所述边缘轮廓图像处理得到最大外接矩形,基于所述最大外接矩形,将所述前景目标从所述原始图像中抠出,得到预处理图像;

对所述预处理图像和原始图像分别使用不同特征提取网络处理并融合,预测得到宠物类别;对所述预处理图像进行轮廓图像填充,得到掩码图像,依次对所述掩码图像轮廓点的8像素邻域进行腐蚀,具体包括:判断像素领域中是否含有3连通像素,如果存在则将该点从轮廓点中删除,再依次判断是否含有3或者4连通像素、3或者4或者5连通像素、3或者4或者5或者6连通像素、3或者4或者5或者6或者7连通像素,若存在则将该点从轮廓点中删除,若不存在则保留该点,当所有轮廓点判断完成后得到前景目标的伪骨架,最后检测所述伪骨架中的像素点是否含有2或者3或者4或者5或者6或者7连通像素,若存在则将该点从轮廓点中删除,若不存在则保留该点,当伪骨架中的所有像素点判断完成后得到所述前景目标的骨架特征;利用所述骨架特征计算尾部节点与身体节点的夹角,基于所述夹角和所述宠物类别确定宠物心情。

8.可选地,利用所述骨架特征计算尾部骨架与身体骨架的夹角,包括:基于特征提取网络对所述预处理图像处理识别得到的宠物身体区域和尾部区域,确定所述骨架特征包含的各个像素点相对于所述预处理图像的位置,将位于所述尾部区域的像素点作为尾部节点,以及将位于所述身体区域的像素点作为身体节点;根据夹角公式计算得到尾部节点与身体节点的夹角,所述夹角公式为:tanα=|(k2-k1)/(1 k1k2)|其中α为两个骨架的夹角,k1为尾部骨架的斜率,k2为身体骨架的斜率。

9.可选地,当位于尾部区域的像素点为两个时,将与所述身体节点邻近的像素点作为尾部头节点,另一个像素点作为尾部尾节点,根据所述夹角公式分别计算尾部头节点与身体节点的夹角,与尾部头节点和尾部尾结点的夹角,将得到的两个夹角与所述宠物类别结合,确定宠物心情。

10.可选地,对所述预处理图像和原始图像分别使用不同特征提取网络处理并融合,预测得到宠物类别,包括:对所述预处理图像进行第一特征提取网络处理得到局部特征图像,对所述原始图像进行第二特征提取网络处理得到全局特征图像,将所述全局特征图像和所述局部特征图像分别进行全连接层处理,得到对应的一维向量,对所述一维向量进行分类器计算,分别得到与预先设置的类别标签对应的类别概率;将相同类别标签对应的全局特征图像的类别概率和局部特征图像的类别概率进行加权求和,得到融合后类别概率;选择融合后类别概率最大值对应的类别作为宠物识别结果。

11.可选地,对所述原始图像进行灰度化处理,得到灰度化图像,包括:基于rgb三通道对原始图像进行特征降维,对每个通道的像素值赋予不同的权重系数,实现图像的灰度化处理,得到灰度化图像,灰度化公式为:yi=0.3ri 0.59gi 0.11bi其中,i表示当前图像像素值,y表示灰度值,r表示r通道像素值,g表示g通道像素值,b表示b通道像素值。

12.可选地,基于sobel算子对所述灰度化图像进行边缘处理,获得宠物前景目标的边

缘轮廓图像,包括:对所述灰度化图像分别进行横向滤波器和纵向滤波器处理,分别得到每个目标像素块包含的各个像素点对应的横向处理值和纵向处理值,将每个像素点对应的横向处理值与纵向处理值的平方和进行开方运算,得到所述各个像素点对应的卷积值;判断各个像素点对应的卷积值是否超过预先设置的阈值,如果超过所述阈值,则将所述像素点作为所述前景目标的边缘像素点;将灰度化图像的所有边缘像素点组合,构成所述前景目标的边缘轮廓图像。

13.可选地,对所述边缘轮廓图像处理得到最大外接矩形,包括:根据所述前景目标的边缘轮廓图像的各个像素点相对于所述原始图像的位置坐标,得到横坐标的最大值和最小值,以及纵坐标的最大值和最小值;根据所述横坐标的最大值和最小值,以及纵坐标的最大值和最小值,确定最大外接矩形的范围,其计算公式为:x

min

=min(xi)x

max

=max(xi)y

min

=min(yi)y

max

=max(yi)其中xi表示边缘像素点的横坐标,yi表示边缘像素点的纵坐标,min(

•

)表示最小值函数,max(

•

)表示最大值函数,x

min

和x

max

分别表示在横轴上的最小边缘像素点横坐标值和最大边缘像素点横坐标值,y

min

和y

max

分别表示在纵轴上的最小边缘像素点纵坐标值和最大边缘像素点纵坐标值。

14.可选地,将所述前景目标从所述原始图像中抠出,得到预处理图像,其处理公式为:i=a[x

min

:x

max

:y

min

:y

max

]其中,a表示原始图像,x

min

和x

max

分别表示在横轴上的最小边缘像素点横坐标值和最大边缘像素点横坐标值,y

min

和y

max

分别表示在纵轴上的最小边缘像素点纵坐标值和最大边缘像素点纵坐标值,i表示预处理图像。

[0015]

可选地,所述分类器为softmax分类器,计算公式为其中,公式中yi表示第i个类别的第一特征提取网络或第二特征提取网络的全连接层输出的一维向量,ps表示softmax分类器的输出概率,c为类别数量,e为自然常数。

[0016]

可选地,对所述灰度化图像分别进行横向滤波器和纵向滤波器处理,分别得到每个目标像素块包含的各个像素点对应的横向处理值和纵向处理值,具体计算公式为:

其中a表示灰度化图像,g

x

和gy分别表示sobel卷积因子在不同方向上的卷积结果。

[0017]

与现有技术相比,本发明提出的一种基于宠物姿态的心情识别方法,通过本方法不用担心是尾巴与身体分不开的情况,容易计算尾部与身体的夹角,又因为尾巴不可能是一直挺直状态,还有可能弯曲,在这种情况下,在尾部区域中会有两个节点,根据计算得到的尾部头节点和尾部尾结点的夹角,与身体与尾部头节点的夹角,以及识别得到的宠物类别,共同结合得到进行判断宠物情绪,使判断结果更加准确。确定宠物身体区域和尾部区域只需要在模型训练时,标记采集得到的宠物图片的尾巴和身体区域,与标记十三身体关键点相比,会减少人力成本和计算时间,提高计算机工作效率。

附图说明

[0018]

为了更清楚地说明本说明书实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本说明书实施例中记载的一些实施例,对于本领域普通技术人员来讲,还可以根据这些附图获得其他的附图。

[0019]

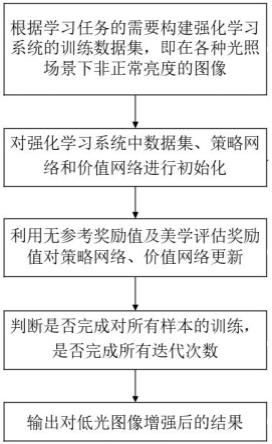

图1是本发明具体实施方式提供的一种基于宠物姿态的心情识别方法的流程示意图;图2是本发明具体实施方式提供的一种基于宠物姿态的心情识别方法的宠物分类识别流程图;图3是本发明具体实施方式提供的一种基于宠物姿态的心情识别方法的模型框架示意图。

具体实施方式

[0020]

为使本发明实施例的目的、技术方案和优点更加清楚,下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

[0021]

为便于对本发明实施例的理解,下面将结合附图以具体实施例做进一步的解释说明,实施例并不构成对本发明实施例的限定。

[0022]

本实施例提供了一种基于宠物姿态的心情识别方法,其流程如图1和图2所示,包括:s1:对原始图像进行灰度化处理,得到灰度化图像;基于sobel算子对所述灰度化图像进行边缘处理,获得宠物前景目标的边缘轮廓图像,对所述边缘轮廓图像处理得到最大外接矩形,基于所述最大外接矩形,将所述前景目标从所述原始图像中抠出,得到预处理图像。

[0023]

获取原始图像,所述原始图像只有一个目标,其目标区域占所述原始图像至少

50%,在本发明实施例,所述目标区域为宠物图像中关于宠物的相关区域。

[0024]

在本步骤中,对所述原始图像进行灰度化处理,得到灰度化图像,包括:基于rgb三通道对原始图像进行特征降维,对每个通道的像素值赋予不同的权重系数,实现图像的灰度化处理,得到灰度化图像,灰度化公式为:yi=0.3ri 0.59gi 0.11bi其中,i表示当前图像像素值,y表示灰度值,r表示r通道像素值,g表示g通道像素值,b表示b通道像素值。

[0025]

基于sobel算子对所述灰度化图像进行边缘处理,获得宠物前景目标的边缘轮廓图像,包括:s10:对所述灰度化图像分别进行横向滤波器和纵向滤波器处理,分别得到每个目标像素块包含的各个像素点对应的横向处理值和纵向处理值,将每个像素点对应的横向处理值与纵向处理值的平方和进行开方运算,得到所述各个像素点对应的卷积值;首先,依次对灰度化图像中各个像素上覆盖横向滤波器和纵向滤波器。

[0026]

其次,将横向滤波器和纵向滤波器中的值分别与灰度化图像中的对应灰度值进行相乘。

[0027]

然后,把横向滤波器结果与纵向滤波器结果相加,得到的和是目标像素的卷积结果。

[0028]

最后,对所述卷积结果进行开方运算,得到各个像素点对应的卷积值。

[0029]

在本发明实施例中,将横向滤波器和纵向滤波器中的值分别与灰度化图像中的对应灰度值进行相乘的计算公式为:应灰度值进行相乘的计算公式为:其中a表示灰度化图像,g

x

和gy分别表示sobel卷积因子在不同方向上的卷积结果。

[0030]

将卷积结果带入到开方运算公式为:其中,g表示经过开方运算后图像的卷积值,g

x

和gy分别表示sobel卷积因子在不同方向上的卷积结果。

[0031]

s11:判断各个像素点对应的卷积值是否超过预先设置的阈值,如果超过所述阈值,则将所述像素点作为所述前景目标的边缘像素点;将灰度化图像的所有边缘像素点组合,构成所述前景目标的边缘轮廓图像。

[0032]

当横向滤波器和纵向滤波器对同一像素块处理完成后,根据预先设置阈值判断所述像素块包含的各个像素点是否超过所述阈值,若是,则将所述像素点作为所述前景目标的边缘像素点,否则,不做任何操作;然后再利用横向滤波器和纵向滤波器基于步长对所述

灰度化图像中邻近像素块进行处理,得到所述邻近像素块包含的各个像素点对应的卷积值,根据所述阈值再次对所述邻近像素块包含的各个像素点进行判断;当所述灰度化图像中所有的像素点都判断完成后,获取所有的边缘像素点。

[0033]

在得到边缘轮廓图像后,要确定所述边缘轮廓图像的最大外接矩形,从而将前景目标从原始图像中抠出,得到预处理图像。

[0034]

在获得边缘轮廓图像后,利用边缘轮廓图像的各个像素点相对于原始图像的位置坐标,获取最大外界矩形;基于所述最大外界矩形进行显著目标提取,得到预处理图像,对所述预处理图像进行第一特征提取网络处理,得到局部特征图像的分类结果,对原始图像进行第二特征提取网络的处理,得到全局特征图像的分类结果,对两种分类结果进行融合,得到最终的图像分类结果,具体如图3所示的模型框架示意图。

[0035]

其中,根据所述前景目标的边缘轮廓图像的各个像素点相对于所述原始图像的位置坐标,确定最大外接矩形,包括:根据所述前景目标的边缘轮廓图像的各个像素点相对于所述原始图像的位置坐标,得到横坐标的最大值和最小值,以及纵坐标的最大值和最小值;根据所述横坐标的最大值和最小值,以及纵坐标的最大值和最小值,确定最大外接矩形的范围,其计算公式为:x

min

=min(xi)x

max

=max(xi)y

min

=min(yi)y

max

=max(yi)其中xi表示边缘像素点的横坐标,yi表示边缘像素点的纵坐标,min(

•

)表示最小值函数,max(

•

)表示最大值函数,x

min

和x

max

分别表示在横轴上的最小边缘像素点横坐标值和最大边缘像素点横坐标值,y

min

和y

max

分别表示在纵轴上的最小边缘像素点纵坐标值和最大边缘像素点纵坐标值。

[0036]

在本发明实施例中,针对原始图像,获取全部前景目标边缘像素点相对于原始图像的二维坐标(x,y),并根据所述确定最大值和最小值的计算公式计算坐标中相对于图像横轴的最大和最小坐标值,纵轴的最大和最小坐标值。

[0037]

根据所述横坐标的最大值和最小值,以及纵坐标的最大值和最小值,确定最大外接矩形的范围;根据前景目标的最大外接矩形范围,将前景图像从原始图像中抠出,得到最终的预处理图像,其处理公式为:i=a[x

min

:x

max

:y

min

:y

max

]其中,a表示原始图像,x

min

和x

max

分别表示在横轴上的最小边缘像素点横坐标值和最大边缘像素点横坐标值,y

min

和y

max

分别表示在纵轴上的最小边缘像素点纵坐标值和最大边缘像素点纵坐标值,i表示预处理图像。

[0038]

通过sobel算子对原始图像进行边缘提取,提取出前景显著目标,为第一特征提取网络提取局部特征滤除背景信息的干扰,提高分类地准确性。

[0039]

在将前景目标从原始图像中抠出,得到预处理图像后,还包括:使用双线性插值法对所述预处理图像的大小进行统一调整,使提取出的前景目标的显著区域为所述第一特征提取网络要求输入的大小。

[0040]

s2:对所述预处理图像和原始图像分别使用不同特征提取网络处理并融合,预测

得到宠物类别。

[0041]

在本步骤中,包括:s20:对所述预处理图像进行第一特征提取网络处理得到局部特征图像,对所述原始图像进行第二特征提取网络处理得到全局特征图像,将所述全局特征图像和所述局部特征图像分别进行全连接层处理,得到对应的一维向量,对所述一维向量进行分类器计算,分别得到与预先设置的类别标签对应的类别概率。

[0042]

s21:将相同类别标签对应的全局特征图像的类别概率和局部特征图像的类别概率进行加权求和,得到融合后类别概率;选择融合后类别概率最大值对应的类别作为宠物识别结果。

[0043]

其中,在s20中包括以下步骤:步骤一:对所述预处理图像进行第一特征提取网络处理得到局部特征图像,再对所述局部特征图像利用与所述局部特征图像大小相同的卷积核进行卷积计算,获得所述局部特征图像的一维向量。

[0044]

在本发明实施例中,使用resnet18特征提取网络作为第一特征提取网络,利用resnet18对所述预处理图像进行特征提取,得到局部特征图像。所述resnet18特征提取网络的结构主要设计了残差连接结构,使其能够最大限度的避免因为网络层数过深带来的梯度消失或者梯度爆炸问题。

[0045]

resnet18共有18层,其网络结构的输入图像大小为224

×

224像素,通道数为3,经过第一层卷积后图像大小降维到112

×

112,通道数增加到64,再经过最大池化层后图像进一步降维到56

×

56,通道数不增加,经过前两步操作后进入残差部分,每经历一部分残差图像大小降维其原来的一半,通道数增加到原来的2倍,图像降维通过步长为2的卷积层实现,经过4次残差操作后最终图像大小降维到7

×

7,通道数增加至512,最后连接平均池化层和全连接层。

[0046]

在resnet18网络结构中,主要涉及了卷积层、最大池化层和平均池化层。卷积层的作用是通过设置不同大小的卷积核和不同的步长使每一个卷积层的感受野不同,从而提取不同范围图像特征,最大池化层的作用是提取出图像中最具特点的特征,相当于“锐化”操作,而平均池化层的作用是提取中图像中的普遍特征,相当于“平滑”操作。在resnet18网络中最具有代表性的结构为残差结构,通过将上一层网络结构的输出与本层网络结构的输出相加融合,可以减轻网络训练过程中梯度的剧烈变化,从而避免了梯度消失或者梯度爆炸现象,尤其是对于深层次的网络结构更有效。

[0047]

步骤二:对所述原始图像进行第二特征提取网络处理得到全局特征图像,再对所述全局特征图像利用与所述全局特征图像大小相同的卷积核进行卷积计算,获得所述全局特征图像的一维向量。

[0048]

在本发明实施例中,使用vgg19特征提取网络作为第二特征提取网络,利用vgg19对所述原始图像进行特征提取,得到全局特征图像。对所述原始图像进行vgg19网络处理,共进行了5次特征降维,从输入的224

×

224像素依次降维至112

×

112、56

×

56、28

×

28、14

×

14和7

×

7,其中降维操作通过最大池化层实现,特征通道数从3依次增加至64、128、256和512。

[0049]

vgg19网络结构大量使用3

×

3卷积核,通过增加小卷积核的个数以及网络的深度

进而提高模型分类结果的准确率。

[0050]

vgg19共有19层,共由16层卷积层和3层全连接层组成,其网络结构的输入图像大小为224

×

224像素,通道数为3,vgg19网络结构的特点在于通过小卷积叠加的形式实现了和大卷积核相同的感受野的效果;所有的卷积层不进行降维操作,使用最大池化层实现特征图降维。vgg19的网络结构比较简洁,只涉及了卷积层、最大池化层和全连接层。卷积层的作用是通过设置不同大小的卷积核和不同的步长使每一个卷积层的感受野不同,从而提取不同范围图像特征,最大池化层的作用是提取出图像中最具特点的特征,相当于“锐化”操作。

[0051]

步骤三:对所述一维向量进行分类器计算,分别得到与预先设置的类别标签对应的类别概率。

[0052]

其中,所述分类器为softmax分类器,计算公式为公式中yi表示第i个类别的第一特征提取网络或第二特征提取网络的全连接层输出的一维向量,ps表示softmax分类器的输出概率,c为类别数量,e为自然常数。

[0053]

在s21中包括:将相同类别标签对应的全局特征图像的类别概率和局部特征图像的类别概率进行加权求和,所述加权求和的处理公式为:,其中,p1为局部特征图像的概率,p2为与局部特征图像的标签对应的全局特征图像的概率,λ和β为超参,最开始都设置为0.5,在模型训练过程中,基于预测图像类别结果,进行调整。

[0054]

考虑到局部特征图像可能忽视了一些特征,对分类结果造成影响,所以对原始图像也进行了特征提取网络的处理,得到全局特征图像,综合考虑局部特征图像和全局特征图像的分类结果,提高分类结果的准确性。

[0055]

为了分类的准确性,将所述融合后类别概率和对应的类别标签构成训练数据集,利用所述训练数据集对图像分类模型进行有监督训练,获得训练后的图像分类模型;使用训练后的图像分类模型对图像中的目标进行分类。

[0056]

针对两种图像粒度的特征提取结果,获取其对应的类别概率,并映射到同一概率空间;基于概率空间与图像标签,进行有监督的训练,得到图像分类模型,其中第一特征提取网络输出的特征向量和第二特征提取网络输出的特征向量分别作为两种全连接层的输入,并对两种全连接层的输出采用softmax分类器进行图像分类获取对应的类别概率,对两种类别概率对应加权求和,得到最终的图像分类结果。

[0057]

考虑到不同种宠物,角度相同,但是情绪可能不同,所以为了使心情识别结果更加准确,根据宠物的类别和尾部与身体的角度进行综合评价宠物心情。

[0058]

s3:对所述预处理图像进行轮廓图像填充,得到掩码图像,依次对所述掩码图像轮廓点的8像素邻域进行腐蚀,得到所述前景目标的骨架特征。

[0059]

具体包括,判断像素领域中是否含有3连通像素,如果存在则将该点从轮廓点中删除,再依次判断是否含有3或者4连通像素、3或者4或者5连通像素、3或者4或者5或者6连通

像素、3或者4或者5或者6或者7连通像素,若存在则将该点从轮廓点中删除,若不存在则保留该点,当所有轮廓点判断完成后得到前景目标的伪骨架,最后检测所述伪骨架中的像素点是否含有2或者3或者4或者5或者6或者7连通像素,若存在则将该点从轮廓点中删除,若不存在则保留该点,当伪骨架中的所有像素点判断完成后得到所述前景目标的骨架特征。

[0060]

s4:利用所述骨架特征计算尾部骨架与身体骨架的夹角,基于所述夹角和所述宠物类别确定宠物心情。

[0061]

在本步骤中,利用所述骨架特征计算尾部骨架与身体骨架的夹角,包括:基于特征提取网络对所述预处理图像处理识别得到的宠物身体区域和尾部区域,确定所述骨架特征包含的各个像素点相对于所述预处理图像的位置,将位于所述尾部区域的像素点作为尾部节点,以及将位于所述身体区域的像素点作为身体节点。

[0062]

根据夹角公式计算得到尾部节点与身体节点的夹角,所述夹角公式为:tanα=|(k2-k1)/(1 k1k2)|其中α为两个骨架的夹角,k1为尾部骨架的斜率,k2为身体骨架的斜率。

[0063]

当位于尾部区域的像素点为两个时,将与所述身体节点邻近的像素点作为尾部头节点,另一个像素点作为尾部尾节点,根据所述夹角公式分别计算尾部头节点与身体节点的夹角,与尾部头节点和尾部尾结点的夹角,将得到的两个夹角与所述宠物类别结合,确定宠物心情。

[0064]

识别得到的宠物身体区域和尾部区域是根据已经训练好的模型得到的,所述模型是通过采集大量宠物图片,进行灰度化、sobel算子和获取最大外接矩形处理得到预处理图像,并对所述预处理图像进行目标检测框的标记与尾巴和身体区域的标记,利用第一特征提取网络进行特征提取,再使用目标检测算法预测宠物图片中各个标记框范围,不断进行学习得到。

[0065]

本方法确定宠物身体区域和尾部区域只需要在模型训练时,标记采集得到的宠物图片的尾巴和身体区域,与现有技术中标记十三身体关键点相比,会减少人力时间和计算时间,提高计算机工作效率。

[0066]

本方法通过对宠物前景目标的边缘轮廓图像进行轮廓图像填充得到掩码二值图像的轮廓,再对其不断腐蚀得到骨架特征,通过尾部骨架与身体骨架的夹角和所述宠物类别,判断当时宠物的心情;考虑到在宠物将尾巴与身体紧贴在一起的时候,通过神经网络处理图像不容易区分尾巴和身体部分,所以对轮廓中的每个点的8像素邻域进行判断是否符合要求,不断腐蚀,得到宠物目标的骨架特征,由此得到的骨架特征,关键点来源也更加准确,不用担心是尾巴与身体分不开的情况,容易计算尾部与身体的夹角,又因为尾巴不可能是一直挺直状态,还有可能弯曲,在这种情况下,在尾部区域中会有两个节点,根据计算得到的尾部头节点和尾部尾结点的夹角,与身体与尾部头节点的夹角,以及识别得到的宠物类别,共同结合得到进行判断宠物情绪,使判断结果更加准确。

[0067]

综上所述,本发明实施例公开了一种基于宠物姿态的心情识别方法,包括:根据原始处理得到灰度化图像进行边缘处理,得到宠物前景目标的边缘轮廓图像;再进行轮廓图像填充,得到前景目标的掩码图像,对所述掩码图像进行不断腐蚀,提取得到前景目标的骨架特征,利用所述骨架特征计算尾部骨架与身体骨架的夹角,基于所述夹角和所述宠物类别确定宠物心情。通过本方法不用担心是尾巴与身体分不开的情况,容易计算尾部与身体

的夹角,并且为了识别的准确性,添加了宠物分类识别。以及确定宠物身体区域和尾部区域只需要在模型训练时,标记采集得到的宠物图片的尾巴和身体区域,与标记十三身体关键点相比,会减少人力时间和计算时间,提高计算机工作效率。

[0068]

通过以上的实施方式的描述,本领域的技术人员可以清楚地了解到各实施方式可借助软件加必需的通用硬件平台的方式来实现,当然也可以通过硬件。基于这样的理解,上述技术方案本质上或者说对现有技术做出贡献的部分可以以软件产品的形式体现出来,该计算机软件产品可以存储在计算机可读存储介质中,如rom/ram、磁碟、光盘等,包括若干指令用以使得一台计算机设备(可以是个人计算机,服务器,或者网络设备等)执行每个实施例或者实施例的某些部分所述的方法。

[0069]

以上所述的具体实施方式,对本发明的目的、技术方案和有益效果进行了进一步详细说明,所应理解的是,以上所述仅为本发明的具体实施方式而已,并不用于限定本发明的保护范围,凡在本发明的精神和原则之内,所做的任何修改、等同替换、改进等,均应包含在本发明的保护范围之内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。