1.本公开总体上涉及机器学习系统,并且更具体地,涉及对对抗式攻击鲁棒的深度生成模型。

背景技术:

2.一般来说,机器学习系统(诸如,深度神经网络)容易受到对抗式攻击。例如,机器学习系统可能会经由其输入而被攻击。这种对抗式攻击包括对输入的扰动,这种扰动引起机器学习系统的输出中的改变。例如,当对抗式攻击涉及传感器数据时,对该传感器数据的扰动可能例如通过提供不正确的输出数据而引起机器学习系统以非期望的方式做出行为,从而导致负面后果和影响。虽然在分类设置中、并且在较小程度上在诸如对象检测或图像分割之类的其他监督设置中有一些与对抗式攻击相关的工作,但是在向生成模型提供对对抗式攻击的防御解决方案方面,似乎没有太多的工作。

技术实现要素:

3.以下内容是下面详细描述的某些实施例的概述。呈现所描述的方面仅仅是为了向读者提供这某些实施例的简要概述,并且对这些方面的描述并不意图限制本公开的范围。实际上,本公开可以涵盖下面可能没有明确阐述的各种方面。

4.根据至少一个方面,一种计算机实现方法包括:获得输入数据。输入数据包括传感器数据和可容许扰动的

ℓ

p

范数球的半径。该方法包括:基于输入数据来生成输入边界数据(bounding data)。该方法包括:通过在编码器网络的第一和第二输出上传播输入边界数据来生成第一边界数据和第二边界数据。该方法包括:生成第三边界数据,第三边界数据与隐变量相关联并且基于编码器网络的输出。该方法包括:通过在解码器网络的输出上传播第三边界数据来生成第四边界数据。该方法包括:通过基于第一边界数据、第二边界数据、第三边界数据和第四边界数据来生成证据下边界(elbo)的下边界从而关于输入数据来建立鲁棒性凭证。该方法包括:基于鲁棒性凭证来更新编码器网络和解码器网络,使得包括编码器网络和解码器网络的机器学习系统在针对可容许扰动进行防御方面是鲁棒的。

5.根据至少一个方面,一种系统包括:致动器、传感器系统、非暂时性计算机可读介质和控制系统。传感器系统包括至少一个传感器。非暂时性计算机可读介质存储机器学习系统,该机器学习系统具有编码器网络和解码器网络,该编码器网络和解码器网络是基于形成该机器学习系统的损失函数的下边界的鲁棒性凭证来训练的。控制系统可操作以基于与传感器系统和机器学习系统的通信来控制致动器。控制系统包括至少一个电子处理器,该电子处理器可操作以获得输入数据,输入数据包括来自传感器系统的传感器数据和来自干扰的扰动数据,其中传感器数据被扰动数据所扰动。经由该机器学习系统来处理输入数据。经由该机器学习系统来生成输出数据。输出数据是传感器数据的重建。输出数据与未被扰动数据所扰动的似然性相关联。似然性对应于elbo。传感器数据和输出数据是分布内数据,该分布内数据对应于与该机器学习系统相关联的模型分布。即使扰动数据被构造成使

该机器学习系统将输入数据标识和处理为在模型分布之外的分布外数据,该机器学习系统也将输入数据标识和处理为在分布内数据的范围内。

6.根据至少一个方面,一种非暂时性计算机可读介质包括至少计算机可读数据,当由电子处理器执行时,该计算机可读数据可操作以实现用于将机器学习系统训练成对扰动鲁棒的方法。该方法包括:获得输入数据,输入数据包括传感器数据和可容许扰动的

ℓ

p

范数球的半径。该方法包括:基于输入数据来生成输入边界数据。该方法包括:通过在编码器网络的第一和第二输出上传播输入边界数据来生成第一边界数据和第二边界数据。该方法包括:生成第三边界数据,第三边界数据与隐变量相关联并且基于编码器网络的输出。该方法包括:通过在解码器网络的输出上传播第三边界数据来生成第四边界数据。该方法包括:通过基于第一边界数据、第二边界数据、第三边界数据和第四边界数据来生成证据下边界(elbo)的下边界从而关于输入数据来建立鲁棒性凭证。该方法包括:基于鲁棒性凭证来更新编码器网络和解码器网络,使得包括编码器网络和解码器网络的机器学习系统在针对可容许扰动进行防御方面是鲁棒的。

7.本发明的这些和其他特征、方面和优点在根据附图的以下详细描述中讨论,遍及这些附图,相同的字符表示类似或相似的部分。

附图说明

8.图1a是包括根据本公开的示例实施例的机器学习系统的系统的示图。

9.图1b是根据本公开的示例实施例的关于移动机器技术的图1a的系统的示例的示图。

10.图1c是根据本公开的示例实施例的关于制造技术的图1a的系统的示例的示图。

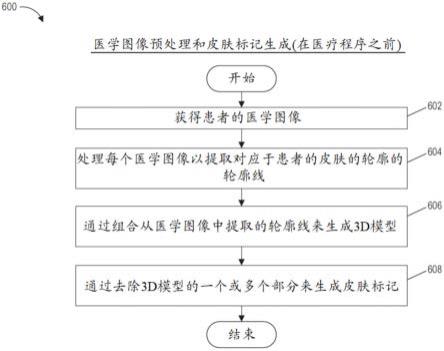

11.图2a是根据本公开的示例实施例的与训练可证明鲁棒的深度生成模型相关联的流程图。

12.图2b是根据本公开的示例实施例的与操作图2a的经训练的可证明鲁棒的深度生成模型相关联的流程图。

13.图3a是根据本公开的示例实施例的与训练可证明鲁棒的深度生成模型相关联的框图图3b是根据本公开的示例实施例的训练包括变分自编码器的可证明鲁棒的深度生成模型的概念图。

14.图4是根据本公开的示例实施例的训练可证明鲁棒的深度生成模型的方法的流程图。

15.图5a、5b、5c和5d图示了根据本公开的示例实施例的输入数据的非限制性示例。

16.图6a图示了根据示例实施例的具有与不同生成模型相关联的对第一数据集的对抗式攻击的效果的表示的图解。

17.图6b图示了根据示例实施例的具有与不同生成模型相关联的对第二数据集的对抗式攻击的效果的表示的图解。

具体实施方式

18.已经通过示例的方式示出和描述的本文中描述的实施例以及它们的许多优点将

通过前述描述而被理解,并且将明显的是,在不脱离所公开的主题的情况下或者在不牺牲其一个或多个优点的情况下,可以在组件的形式、构造和布置中进行各种改变。实际上,这些实施例的所描述形式仅仅是解释性的。这些实施例容许各种修改和替代形式,并且以下权利要求意图涵盖和包括这种改变,并且不限于所公开的特定形式,而是覆盖落入本公开的精神和范围内的所有修改、等同物和替代方案。

19.如本文中所描述,实施例涉及在生成模型的情境中可证明鲁棒的训练的应用。更具体地,这些实施例在无监督生成模型而不是监督分类任务的情境中构造与损失函数相关的可证明边界。例如,在示例实施例中,可证明鲁棒的训练涉及至少一个生成模型,诸如变分自编码器(vae)。在这点上,可证实地,在似然性的变分下边界上定义了鲁棒下边界,并且然后在训练期间优化该下边界以生成可证明鲁棒的vae(“provae”)。而且,与生成模型的控制组相比,这些可证明鲁棒的生成模型被评估为显著地对对抗式攻击(例如,敌对方尝试扰动输入,以便大幅度降低它们在生成模型下的可能性)更鲁棒。

20.图1a图示了根据示例实施例的系统100的框图。系统100包括具有一个或多个传感器的传感器系统110。例如,传感器系统110包括图像传感器、相机、雷达传感器、光检测和测距(lidar)传感器、热传感器、超声传感器、红外传感器、运动传感器、基于卫星的导航传感器(例如,全球定位系统(gps)传感器)、任何合适的传感器或其任何组合。传感器系统110可操作以与控制系统120进行通信。

21.控制系统120被配置成直接地或间接地从传感器系统110的一个或多个传感器获得传感器数据。在接收到输入数据(例如,传感器数据和/或基于传感器数据的图像数据)后,控制系统120被配置成与机器学习系统200相结合地经由处理系统140来处理该输入数据。在这点上,处理系统140包括至少一个处理器。例如,处理系统140包括电子处理器、中央处理单元(cpu)、图形处理单元(gpu)、微处理器、现场可编程门阵列(fpga)、专用集成电路(asic)、任何合适的处理技术或其任何组合。在处理该输入数据后,处理系统140可操作以经由机器学习系统200来生成输出数据。附加地或替代地,处理系统140可操作以生成分类数据,所述分类数据对机器学习系统200的输出数据进行分类。此外,处理系统140可操作以基于机器学习系统200的分类数据和/或输出数据向致动器系统170提供控制数据。

22.在示例实施例中,机器学习系统200被存储在存储器系统160中。在示例实施例中,存储器系统160是计算机或电子存储系统,其被配置成存储各种数据并提供对各种数据的访问,以至少实现如本文中公开的操作和功能。在示例实施例中,存储器系统160包括单个设备或多个设备。在示例实施例中,存储器系统160可以包括电气、电子、磁性、光学、半导体、电磁或任何合适的技术。例如,在示例实施例中,存储器系统160可以包括随机存取存储器(ram)、只读存储器(rom)、闪速存储器、盘驱动器、存储卡、光学存储设备、磁性存储设备、存储器模块、任何合适类型的存储器设备或其任何组合。在示例实施例中,关于控制系统120和/或处理系统140,存储器系统160是本地的、远程的或者其组合(例如,部分本地和部分远程)。例如,存储器系统160可以至少包括基于云的存储系统(例如,基于云的数据库系统),所述基于云的存储系统远离处理系统140和/或控制系统120的其他组件。

23.在示例实施例中,机器学习系统200包括至少一个深度神经网络。更具体地,该深度神经网络包括至少一个经训练的、可证明鲁棒的生成模型(“provae”)。响应于输入数据,处理系统140(与机器学习系统200结合)可操作以生成输出数据,该输出数据是输入数据的

重建。例如,当输入数据是传感器数据(和/或基于传感器数据的图像数据)时,处理系统140可操作以经由机器学习系统200来生成输出数据,其中输出数据是该传感器数据的重建。作为另一示例,当输入数据包括被扰动数据所扰动的传感器数据(和/或基于传感器数据的图像数据)时,处理系统140可操作以经由机器学习系统200来生成输出数据,其中输出数据是该传感器数据的重建,由此似然性效应(likelihood effect)不会被扰动数据所破坏。机器学习系统200的该特征在提供对对抗式攻击的防御解决方案方面是有利的,因为这种扰动数据不会引起机器学习系统200的似然性效应和/或输出数据中的剧烈改变。

24.此外,系统100包括有助于控制系统120与传感器系统110和致动器系统170相关的操作的其他组件。例如,如图1中所示,存储器系统160还被配置成存储其他相关数据,这些其他相关数据涉及系统100与其一个或多个组件(例如,传感器系统110、机器学习系统200、致动器系统170等)相关的操作。此外,控制系统120包括输入/输出(i/o)系统130,输入/输出(i/o)系统130包括去往涉及系统100的一个或多个i/o设备的一个或多个接口。而且,控制系统120被配置成提供辅助或有助于系统100的运作的其他功能模块150,诸如任何适当的硬件、软件或其组合。例如,其他功能模块150包括操作系统和通信技术,该操作系统和通信技术使得系统100的组件能够如本文中所描述的那样彼此通信。在至少图1a的示例中讨论的配置的情况下,系统100适用于各种技术中。

25.图1b图示了关于移动机器技术(例如,机器人等)的系统100的第一应用的示例。在图1b中,系统100由车辆10采用,其中控制系统120根据来自传感器系统110的传感器数据来控制车辆10的至少一个致动器系统170。更具体地,作为非限制性示例,控制系统120被配置成使用来自传感器系统110的传感器数据来标识实体(例如,对象)。例如,系统100被配置成:在从图像传感器获得图像数据后标识标志(例如,停止标志)。作为另一示例,系统100被配置成:从图像数据——该数据是基于从图像传感器和lidar传感器获得的传感器数据而生成的——来检测行人。在这点上,传感器数据是从传感器系统110的一个或多个传感器生成和/或获得的。在该示例中,在至少接收到传感器数据和/或图像数据后,处理系统140经由机器学习系统200被配置成:在以高似然性值估计出传感器数据(和/或图像数据)是基于与实体相关联的分布而生成的和/或处于分布内后,从该传感器数据(和/或图像数据)来标识实体。有利地,provae 200a被配置成:即使当输入数据(例如,传感器数据和/或图像数据)被扰动(例如,噪声)所扰动时也以高似然性值估计,从而关于分布外攻击是鲁棒的。例如,作为非限制性示例,如果处理系统140经由机器学习系统200在从传感器系统110接收到包括传感器数据的未被扰动/被扰动的输入数据后将另一个车辆标识为实体(在其模型分布内),则控制系统120被配置成控制致动器系统170(例如,转向系统、制动系统或任何合适的致动器系统)以避免与该标识的车辆碰撞。在该示例中,致动器系统170被配置成控制或辅助车辆的驾驶功能,车辆的驾驶功能是自主的、高度自主的、部分自主的、条件自主的或驾驶员辅助的。

26.图1c图示了关于制造技术的系统100的第二应用的示例。在图1c中,系统100由制造系统20采用,其中控制系统120根据来自传感器系统110的传感器数据来控制制造机器22的至少一个致动器系统170。更具体地,作为非限制性示例,控制系统120被配置成通过对产品24的有缺陷组件的图像分布进行建模来标识产品24中的故障。在这种情况下,provae 200a被配置成:即使在其中传感器数据被相对小的(和/或不可察觉的)扰动所扰动的情况

下也标识产品24的组件中的缺陷或故障。例如,如果被扰动的输入数据包括产品24的有缺陷组件的图像,则处理系统140经由机器学习系统200被配置成将产品24标识为有缺陷的,并且不会将产品24标识为如该扰动数据所预期的那样无缺陷的。在这种情况下,响应于对该被扰动的输入数据的处理,控制系统120被配置成将有缺陷产品分类为属于有缺陷产品的分布,并且被配置成基于机器学习系统200的输出和/或将产品24分类为在有缺陷的产品24的分布内来控制致动器系统170。在该非限制性示例中,例如,致动器系统170被配置成基于产品24被标识为有缺陷来控制机器人或制造机器的动作。

27.附加于或替代于第一应用(图1b)和第二应用(图1c),系统100(和/或控制系统120)也可在其他应用中操作。例如,控制系统120被配置成生成用于训练这些类型的机器学习系统200的训练数据。此外,系统100(和/或控制系统120)也适用于各种领域中,诸如计算机控制的机器、机器人、家用电器、电动工具、电子个人助理、医疗/医学系统、移动机器、安全性系统、仿真系统等。此外,系统100(和/或控制系统120和/或机器学习系统200)不限于上面提到的应用,而是可以被应用于受益于具有至少一个经训练的生成模型的机器学习系统200的任何合适的应用,该生成模型对扰动是可证明鲁棒的。

28.图2a图示了根据示例实施例的与用于机器学习系统200生成至少一个可证明鲁棒的生成模型(例如,provae 200a)的训练过程204相关的流程图。如图2a中所示,经由训练过程204(图4)利用分布内数据202来训练生成模型(例如,vae)。作为示例,分布内数据202指代从与生成模型相关联的x∈d的分布中选择或取得的输入数据。该特征是有利的,这是因为在训练过程204期间,可证明鲁棒的生成模型不需要其他类型的训练数据(例如,分布外数据、扰动数据、对抗式示例等)。在利用分布内数据202完成训练过程204后,经训练的可证明鲁棒的生成模型(例如,provae 200a)被生成并且准备好操作。

29.图2b图示了根据示例实施例的与机器学习系统200的操作相关联的流程图,该机器学习系统200包括至少一个经训练的可证明鲁棒的生成模型(例如,provae 200a)。该流程图突出显示了可证明鲁棒的生成模型的优点。例如,作为优点,在接收到包括被扰动数据208所扰动的分布内数据202的输入数据后,则provae 200a可操作以将该输入数据标识为分布内数据,并且还生成作为分布内数据202的输出数据。替代地,尽管未示出,但是在接收到包括未被扰动数据所扰动的分布内数据202的输入数据后,则provae 200a被配置成生成作为分布内数据202的输出数据。

30.图3a是根据示例实施例的与训练可证明鲁棒的深度生成模型相关联的框图。如图3a中所示,训练过程204至少涉及存储器系统300和处理系统310。在示例实施例中,存储器系统300是计算机或电子存储系统,其被配置成存储各种数据并提供对各种数据的访问,以至少实现如本文中公开的操作和功能。在示例实施例中,存储器系统300包括单个设备或多个设备。在示例实施例中,存储器系统300包括电气、电子、磁性、光学、半导体、电磁或任何合适的技术。例如,存储器系统300包括ram、rom、闪速存储器、盘驱动器、存储卡、光学存储设备、磁性存储设备、存储器模块、任何合适类型的存储器设备或其任何组合。在示例实施例中,关于处理系统310,存储器系统300是本地的、远程的或其组合(例如,部分本地和部分远程)。例如,存储器系统300被配置成至少包括远离处理系统310的基于云的存储系统(例如,基于云的数据库系统)。

31.在示例实施例中,如图3a中所示,存储器系统300至少包括训练数据302、机器学习

数据304和可证明鲁棒的生成模型(“provae”)200a。训练数据302至少包括传感器数据(和/或基于传感器数据的图像数据)。有利地,训练过程204可操作以针对可容许扰动进行训练,而不需要扰动作为输入数据。而且,机器学习数据304包括与用于训练和生成provae 200a的方法400(图4)相关联的机器学习算法、以及其他相关数据304a(图3b),诸如各种边界数据(例如,向量数据)、鲁棒性凭证等。provae 200a包括与其训练和/或操作相关联的神经网络数据(例如,各层、参数数据、

ϵ

train

数据等)。在完成训练过程204后,provae 200a可由图1a的系统100或任何合适的应用来部署和/或采用。

32.在接收到训练数据302(例如,传感器数据和/或基于传感器数据的图像数据)后,处理系统310被配置成与机器学习数据304结合来训练生成模型。在这点上,处理系统310包括至少一个处理器。例如,处理系统310包括电子处理器、cpu、gpu、微处理器、fpga、asic、任何合适的处理技术或其任何组合。在示例实施例中,处理系统310与存储器系统300进行通信,以基于训练数据302和机器学习数据304来生成经训练的可证明鲁棒的生成模型(“provae”)200a。

33.图3b图示了根据示例实施例的训练生成模型(例如,vae)以生成可证明鲁棒的生成模型(例如,provae 200a)的概念图。一般来说,vae至少包括具有编码器网络的编码器和具有解码器网络的解码器。在这点上,分别地,编码器包括识别模型,而解码器包括生成模型。在示例实施例中,至少如图3b中所示,编码器和解码器使用区间边界传播(ibp)技术来传播对输入的扰动的影响。扰动的影响遍及vae而传播。而且,为了方便,图3b图示了vae的一些组件(例如,μ(x)、σ(x)、g(z)等)的映射、以及与vae相关的其他相关数据304a的一些表示,以帮助与图4一起说明可证明鲁棒的训练过程。而且,图3b图示了传感器数据x的示例(例如,具有手写数字

‘4’

的输入图像304b)和输出数据的示例,输出数据是该传感器数据的重建(例如,具有重建的手写数字

‘4’

的输出图像304c)。输入图像304b和输出图像304c两者被标识为分布内数据(或在“手写数字”的分布内)。

34.一般来说,基于对数似然性上的边界来训练vae,处理系统310被配置成在对抗式设置中进一步形成该对数似然性的边界。vae是基于所谓的证据下边界(elbo)l(x)来训练的,l(x)依据隐变量z∈rk来表达概率p(x),并且然后形成该似然性的边界如下:其中q(z|x)是所谓的变分分布,其试图近似后验p(z|x)(针对这种情况,该边界是紧的),但其是经由更易处理的分布类来这么做的。在vae设置中,处理系统310选择:其中和是预测来自输入x的正态分布q的均值和方差的编码器网络,并且g

θ

(z)是在给定隐向量z的情况下在输入空间中生成样本的解码器网络。

35.在这些假设下,elbo具有以下显式形式:

其中c是常数。一般来说,编码器和解码器网络使用例如随机梯度下降而被联合地训练以最大化该下边界,如以下等式所表示的那样:其中处理系统310用等效过程其中处理系统310用等效过程来代替采样过程以抽取样本,并且确保均值和方差项可以经由所谓的重新参数化技术被反向传播通过。

36.图4图示了根据示例实施例的用于生成可证明鲁棒的生成模型(例如,provae 200a)的训练过程204的方法400的流程图。该方法400提供了对如下技术问题的解决方案:即,制订针对对于深度生成模型的分布外攻击的鲁棒防御。方法400通过获得可证明鲁棒的深度生成模型(例如,provae 200a)来实现这种防御,该模型针对可容许扰动形成elbo的下边界。更具体地,方法400将标识为可容许扰动的集合,并且将标识为以x为中心的半径为

ϵ

train

的球。在本公开中,为了符号的简洁,这些项和δ(x)可互换地使用。

37.处理系统310被配置成:针对所有可能的扰动来获得elbo的下边界,作为。该下边界提供了elbo的鲁棒性的凭证。δ(x)中的任何可能的扰动对elbo的影响将是以l的下边界。下边界l的优化有效地将该网络训练成对δ(x)(围绕x的半径为

ϵ

train

的球)内最强的可能分布外攻击是鲁棒的。

38.为了形成elbo的下边界,处理系统310遍及μ

θ

、σ

θ

和g

θ

的层执行ibp,使得处理系统310获得关于elbo对输入空间的可容许扰动的传播的边界。处理系统310因此被配置成形成被扰动的输入的kulback-leibler(kl)散度和被扰动的条件对数似然性的期望值两者的边界。为此,处理系统310在编码器网络μ

θ

和σ

θ

上执行ibp,并且在解码器网络g

θ

上执行ibp。

39.作为对方法400的预备措施,处理系统310在编码器和解码器网络的构建块上传播下边界和上边界。一般来说,构建块至少包括线性和卷积层、以及单调逐元素激活函数。这些特征使得处理系统310能够从深度神经网络(例如,vae)的输入到输出顺序地连接不同的区间边界。在本公开中,为了符号的方便和简洁,μ的上边界被标示为,并且下边界被标示为,这在寻址多维实体时被认为是逐元素的。

40.关于线性算子,处理系统310认为wv是应用于v的线性算子w,并且是v的逐元素上边界和下边界。处理系统310将线性算子w分解成正算子和负算子w = w

w

−

,使得w

=max(w,0)和w

−

=min(w,0),其中max和min对应于逐元素的最大值和最小值。处理系统310然后将线性算子的上边界和下边界应用于v。更具体地,处理系统310应用上边界(等式7)和下边界(等式8),由于它们的线性性质,它们对卷积层和线性层成立。

41.关于单调函数,处理系统310被配置成将v

t = h(v

t

−1)标示为在v

t

−1上逐元素应用

的单调(非递减或非递增)函数。处理系统310表达关于h的v

t

的上边界和下边界以及v

t

−1的上边界和下边界如下,这些边界对于单调激活函数、诸如relu和sigmoid成立。

42.关于

ℓ2范数平方,处理系统310被配置成通过认识到存在对v的下边界和上边界的逐元素依赖性来获得v的

ℓ2范数平方的下边界和上边界。由于,其中vi标示v的第i个组件,处理系统310获得作为和的函数的相应上边界和下边界如下,在执行预备措施之后,处理系统310实现方法400以例如依据至少一个对数似然函数来优化从最坏情况扰动获得的鲁棒性凭证。方法400包括一个或多个迭代(或时期)。在这种情况下,每个迭代(或时期)包括通过边界传播来计算鲁棒性凭证(例如,步骤402-412)以及优化鲁棒性凭证(例如,步骤414),从而提供鲁棒地训练的编码器和解码器网络(例如,步骤416)。参考图4,方法400至少包括以下实现方式,如下所描述。

43.在步骤402处,处理系统310被配置成获得输入x,并且生成输入x上的至少一个边界。例如,输入x包括训练数据,诸如x = {x1…

xn},并且其中。对于x∈x,处理系统310被配置成生成输入xi上的输入边界数据。输入边界数据包括输入xi上的上边界数据和输入xi上的下边界数据。

44.此外,在给定第一编码组件μ

θ

(x)和第二编码组件σ

θ

(x)的情况下,处理系统310将编码器网络构造为具有relu激活的卷积层的接续,其中至少一个最后层是至少一个全连接线性层。此外,在不需要扰动作为输入x的情况下,处理系统310可操作,以通过将扰动数据定义为并且通过如下那样表示可容许的被扰动输入的下边界和上边界来考虑任何可容许的被扰动输入xi δ:在步骤404处,处理系统310被配置成生成针对编码器网络的输出的边界。这些边界包括vae的第一边界数据和第二边界数据。第一和第二边界数据涉及编码器的第一和第二编码组件的相应输出。更具体地,处理系统310被配置成生成针对第一编码组件μ

θ

(x)的输出的第一上边界数据和第一下边界数据。此外,处理系统310被配置成生成第二编码组件σ

θ

(x)的输出的第二上边界数据和第二下边界数据。处理系统310被配置成独立于第二编码组件σ

θ

(x)的第二边界数据来生成第一编码组件μ

θ

(x)的第一边界数据。在这点上,处理系统310被配置成在同一时间或在不同时间处生成第一边界数据和第二边界数据。

45.在等式7-8中针对线性层和卷积层以及等式9-10中针对激活函数的区间边界的传播的情况下,处理系统310被配置成基于和的ibp遍及编码器网络的组件经由下式来

形成编码器网络的输出的边界:其中和是编码器的输出,和以及和分别对应于编码器网络的下边界和上边界的传播。这得到了编码组件μi和σi的输出的边界、以及logσi(因为对数和指数是单调非递减的)作为扰动δ(xi)的量值

ϵ

train

的函数。

46.在给定编码器网络的输出上的边界的情况下,处理系统310被配置成经由下式来形成和之间的kl散度的边界:其中和标示如由编码器输出的第i个样本的均方(squared mean)和协方差的第j个组件。此外,处理系统310被配置成从编码器网络的末端部分处的μi和σi上的边界继续,以使得能够经由解码器网络来执行ibp。

47.在步骤406处,处理系统310被配置成抽取被标示为“ε”的至少一个样本,并且计算被标示为“z”的隐变量上的边界。例如,处理系统310被配置成经由重新参数化技术来获得隐变量上的边界(或vae的第三边界数据)。更具体地,在重新参数化技术的情况下,由于重新参数化是线性算子,因此隐变量上的边界遵循等式7-8中针对线性算子的边界。

48.例如,处理系统310被配置成处理样本,如由、和所标示,使得,其中0表示均值,并且i表示协方差的标识向量。这种重新参数化技术通过将隐变量表达为从而将随机性与编码器解耦。在使用重新参数化技术之后,处理系统310被配置成形成隐变量zi的边界(例如,生成第三边界数据),这被表达为:在步骤408处,处理系统310被配置成生成针对解码器网络g

θ

(x)的输出的边界。在这点上,处理系统310被配置成生成vae的第四边界数据,其包括解码器网络g

θ

(x)的第四上边界数据和第四下边界数据。例如,在步骤408之后,隐变量(即,z)上的边界然后通过解码器网络g

θ

而传播,该解码器网络g

θ

包括线性和卷积层(例如,线性算子,其中边界可以利用等式7-8来传播),其具有relu和sigmoid激活(例如,单调激活函数,其中边界可以利用等式9-10来传播)。因此,与编码器网络一样,处理系统310提供了作为隐向量zi上的边界的函数的

解码器网络的输出上的边界。

49.此外,处理系统310解决了形成条件对数似然性log p(xi|zi)的边界的问题。为此,处理系统310将对角协方差固定在中。处理系统310因此将形成条件对数似然性的边界的问题简化为形成的边界的问题。在求解等式11-12后,处理系统310被配置成经由下式来形成该函数的边界:其中处理系统310被配置成采用跨x的元素的逐元素max和min以及j中的总和。

50.在步骤410处,处理系统310被配置成通过生成用作损失函数的elbo l的至少一个边界来生成鲁棒性凭证。更具体地,处理系统310被配置成生成elbo上的下边界数据。例如,处理系统310将针对编码器网络和解码器网络的上边界和下边界、以及条件对数似然性上的相关联下边界和kl散度上的上边界(由于elbo考虑了kl散度的负值)进行组合,从而从以下下边界来获得下边界数据:其中针对编码器网络的上边界和下边界被传播,并且重新参数化技术为:elbo上的所得到的下边界形成被扰动样本的对数似然性log p(xi δ)的下边界,其作为针对扰动的鲁棒性凭证而工作。这意味着,如果在馈送到编码器中的输入区间边界是xi−

ϵ

train

1和xi

ϵ

train

1(半径为

ϵ

train

的以xi为中心的

ℓ

∞

球)的情况下l≥α,则这保证了对于所有所有而言,。

51.方法400包括通过优化下边界来训练vae。例如,处理系统310通过优化elbo l的下边界来训练可证明鲁棒的深度生成模型,这对应于优化鲁棒性凭证,而不是直接优化elbo l。

52.在步骤414处,处理系统310被配置成更新编码器网络和解码器网络以优化elbo的下边界。例如,处理系统310可操作以更新vae的参数并且直接最大化elbo l的下边界。在这

0.01的provae 200a时,则损失被表示为l =

ꢀ−

59.08,由此provae 200a正确地将该对抗式示例504标识并处理为分布内数据(例如,在手写数字的范围内),从而与vae相比展现出鲁棒性。作为另一个比较,当对抗式示例506作为输入数据被呈现给具有

ϵ

train = 0.1的provae时,则损失被表示为l =

ꢀ−

50.06,由此provae 200a正确地将该对抗式示例504标识并处理为分布内数据(例如,在手写数字的范围内),从而与vae相比展现出鲁棒性。此外,图6a和图6b中也图示了provae 200a的益处,其包括vae与provae 200a的比较。

58.图6a和6b图示了具有对抗式攻击(例如,对于,半径为

ϵ

attack

的

ℓ

∞

球中的pgd攻击)对损失的影响的图形表示的图解,如针对利用

ϵ

train

的不同值训练的分类器、由elbo l所表示的那样。图6a图示了基于第一数据集(例如,来自mnist数据库的样本图像)的图解600,而图6b图示了基于第二数据集(例如,来自加拿大高级研究所(cifar10)数据库的样本图像)的图解610。在图6a中,vae表示602对应于基于第一数据集的

ϵ

train = 0。在图6b中,vae表示612对应于基于第二数据集的

ϵ

train = 0。vae表示602和612中的每一个清楚地图示了针对非鲁棒分类器的损失l的快速衰减、以及训练可证明鲁棒的分类器如何以在未被干扰的数据(其中

ϵ

attack = 0)上的l的较低值为代价来减轻这种衰减。此外,为了比较,图6a和6b分别图示了基于第一数据集和第二数据集的provae(

ϵ

train = 0.01)表示604和614。而且,为了比较,图6a和6b分别图示了基于第一数据集和第二数据集的provae(

ϵ

train = 0.10)表示606和616。因此,如图6a和6b中所示,与vae表示602和612相比,provae表示604、606、614和616中的每一个对于增加的

ϵ

attack

而言表现得更好。

59.如本文中所描述,实施例包括许多有利的特征和益处。例如,这些实施例涉及训练和生成可证明鲁棒的生成模型,该模型基于定义对似然性的变分下边界(即,elbo)的鲁棒下边界,并且优化这些下边界来训练可证明鲁棒的生成模型。这些实施例在生成模型的域中引入了针对对抗式攻击(即,分布外攻击)的可证明的防御,其中,该模型的分布内的样本被扰动以降低其似然性。

60.此外,图6a-6b证实了这种可证明的防御的有效性,并且引入了与模型鲁棒性相关联的其他权衡。例如,图6a-6b示出了:与尚未经由图4的训练过程被鲁棒地训练的vae相比,provae 200a提供了针对对抗式攻击的更好的防御(例如,通过随着

ϵ

train

增加在更高的

ϵ

attack

值下展现出更高的对数似然性)。此外,本公开中的教导可扩展到涉及创建针对进入分布攻击(into-distribution attack)的防御的改进方向,其中对抗式攻击可以扰动分布外的样本(),以使其看起来好像它来自于分布(x∈d)。

61.而且,实施例在提供对与机器学习系统(例如,深度生成模型)对对抗式攻击的易受性相关联的技术问题的技术解决方案方面是有利的。已经已知这些对抗式攻击会引起对输入数据的难以察觉的改变,这可能会导致似然函数中的剧烈改变,从而提供不正确的输出数据。在解决该技术问题时,如本文中所公开的实施例提供了可证明鲁棒的生成模型,其中对机器学习系统的输入的这些小改变(例如,扰动)不会引起机器学习系统的似然函数中的剧烈改变。因此,如上所讨论,本文中描述的实施例在向生成模型提供对对抗式攻击的防御解决方案方面是有利的。

62.也就是说,以上描述意图是说明性的,而不是限制性的,并且是在特定应用及其要求的情境中提供的。本领域技术人员可以从前述描述中领会到,本发明可以以各种形式来实现,并且各种实施例可以单独或组合地实现。因此,虽然已经结合本发明的特定示例描述

了本发明的实施例,但是在不脱离所描述的实施例的精神和范围的情况下,本文中定义的一般原理可以应用于其他实施例和应用,并且本发明的实施例和/或方法的真实范围不限于所示出和描述的实施例,这是因为在研究附图、说明书和以下权利要求之后,各种修改对于本领域技术人员将变得明显。例如,组件和功能可以以与各种所描述的实施例的方式不同的方式被分离或组合,并且可以使用不同的术语来描述。这些和其他变型、修改、添加和改进可以落在如以下权利要求中限定的本公开的范围内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。