1.本发明涉及交通管理和视频监控技术领域,具体涉及一种基于道路交通场景下的全景视频拼接方法及系统。

背景技术:

2.随着经济的逐步繁荣,科学技术的不断发展,对城市道路交通的全面实时监测变得越发重要,通过科学技术手段建立全面的道路交通图像管理平台成为各地交通管理部门的目标。目前,道路交通监测系统已经基本实现覆盖城市和乡镇主干道,辅道和路口的数字网络系统,并配备了相应的图像监视设备和操作软件,可实时将道路交通的运行状况传送至相应的调度中心,对道路交通运行状况进行监控。一旦出现问题,第一时间做出反馈。但是因为目前现有的监控设备,主要是现有的安防摄像头,存在摄像头之间没有直观的位置关系,一旦查找跨摄像头的情况,需要相关人员人工调出相应多个摄像头的图像,一一进行比对拼合,才能获取到有用信息,费事费力。

3.cn113055613a公开“一种基于矿山场景下的全景视频拼接的方法及装置”,其采用传统surf算法提取特征点,并生成特征描述子,surf算法在实际应用中不能实现视频帧的实时处理,基本可以排除工程应用;并且,特征匹配算法采用k最近邻分类算法,匹配误差较大。又如,cn103516995a公开“一种基于orb特征的实时全景视频拼接方法和装置”采用的方法是:开启采集多路同步视频数据;采用orb特征提取算法对同一时刻的各路图像进行特征点提取并计算各特征点的orb特征向量;采用最邻近匹配法和ransac(随机抽样一致性)匹配算法求出同步视频对应帧间的单应性矩阵;根据单应性矩阵进行视频帧场景的拼接;最后输出拼接后的视频。但是,所述对比文件都是通过传统的图像特征点提取和匹配方法,比如sift或者surf,其存在特征点提取精度不高,提取时间太长,不能实现实时拼接。

技术实现要素:

4.针对现有技术存在的上述不足,本发明的目的在于提供一种基于道路交通场景下的全景视频拼接方法及系统,解决现有技术提取精度不高、查找费时费力和不能实现实时拼接的问题。

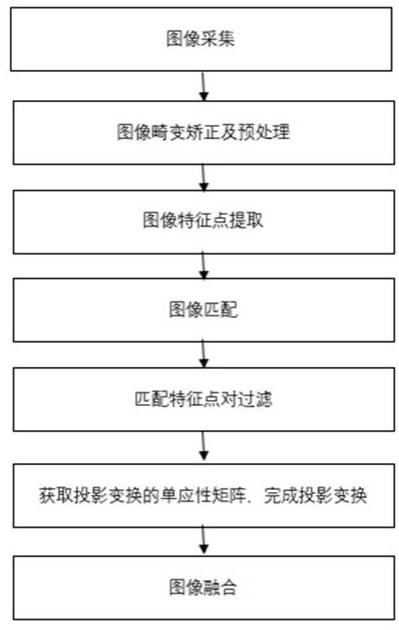

5.为实现上述目的,本发明采用如下技术方案:一种基于道路交通场景下的全景视频拼接方法,包含以下步骤:s1、图像采集:由多个摄像头同步采集测试路段中每路摄像头的图像,要求每个摄像头的时间戳严格一致;s2、图像畸变矫正及预处理:采用何凯明暗通道去雾算法对采集的多个图像进行矫正及预处理;s3、图像特征点提取:采用深度学习网络superpoint对图像进行特征点的提取;提取摄像头之间重叠区域的特征点,包含角点和梯度变化明显的点,并生成特征描述子;s4、图像匹配:采用基于图卷积神经网络的特征匹配算法superglue对图像进行特

征匹配, 其中输入是两张图像中superpoint网络提取的特征点以及描述子,输出是图像特征之间的匹配关系;s5、匹配特征点对过滤:利用k近邻算法对匹配上的特征点对进行过滤;s6、获取投影变换的单应性矩阵,完成投影变换:过滤后剩余的匹配点对利用ransac算法循环遍历,直到计算得到图像间投影所需的最佳单应性矩阵,完成图像间的拼接;s7、图像融合:采用动态规划寻找最佳拼接线进行图像融合。

6.进一步,所述s3中重叠区域分为静态的背景和动态的前景,分别提取背景和前景特征点。

7.所述s4中,图像特征匹配包括静态匹配和动态匹配;静态匹配包括道路场景下的道路、交通标识、树木等静态物体的匹配;动态匹配包括指行人、车辆等的匹配。所述静态匹配对于图像而言基本相当于背景,可以单独对背景的特征点进行匹配;动态匹配对于图像而言相当于前景,可以单独对前景的特征点进行匹配。

8.进一步,所述图像融合使用快速颜色插值模型结合邻近最短距离法寻找最佳拼接线进行图像融合。

9.本发明还提供一种基于道路交通场景下的全景视频拼接系统,包括摄像头和处理器,所述处理器执行上述全景视频拼接方法。

10.相比现有技术,本发明具有如下有益效果:1、本发明通过深度学习网络来实现特征点的提取和特征点匹配,图像特征点提取的时候,分别对动态前景和静态背景进行特征点提取,通过提取不同摄像头之间重叠区域背景和前景的特征点,并对特征点进行匹配,动态获取不同摄像头之间的相对位置关系,也就是单应性矩阵,实现了对片区道路交通系统中摄像头间图像的实时融合拼接。

11.2、本发明解决了传统的单摄像头监控体系,需要相关人员人工调出相应多个摄像头图像,一一进行比对拼合,才能获取到有用信息,费事费力的问题,同时完美解决了目标跨摄像头追踪问题。

12.3、本发明将同一片区存在重叠区域的摄像头图像按照相对位置关系,进行全景拼接和融合,然后直接投影到相应的监控大屏,可以更直观更清晰的监测整个片区的交通状况。

附图说明

13.图1为本发明基于道路交通场景下的全景视频拼接方法的流程图;图2为采用广角摄像头获取的原图像示例;图3为图像经矫正后效果图示例;图4为图像拼接效果图示例;图5为图像融合效果图示。

具体实施方式

14.为了使本领域技术人员更好地理解本发明的技术方案,下面结合附图对本发明作进一步详细说明,但本发明的实施方式不仅限于此。

15.参见图1,为本发明基于道路交通场景下的全景视频拼接方法流程图。

16.第一步,图像采集:同步多个摄像头同时采集测试路段中每路摄像头的图像,要求每个摄像头的时间戳严格一致,实际测试过程中对每路摄像头采用单独的进程进行图像采集,基本最快和最慢进程的时间差在0.5ms,是可以满足每秒25帧同步采集的。参见图2,为采用海康广角摄像头获取跨摄像头图像示例。

17.第二步,图像畸变矫正及预处理:(2a)由于道路摄像头多采用广角摄像头,图像存在严重径向畸变,表现为桶状畸变(如图2),选取了三路摄像头的原始图像,造成图像特征失真,所以需要校正摄像头参数消除畸变影响,由处理器采用何凯明暗通道去雾算法对采集的多个图像进行矫正及预处理。矫正后图像的效果示例如图3。

18.(2b)采用何凯明暗通道去雾算法对图像进行预处理。摄像头长期处于露天环境,镜头会有灰尘,雨天和雾天等都会造成图像不清晰,需要进行相应的预处理,提升图像质量。

19.第三步,图像特征点提取:本发明采用深度学习网络superpoint对图像进行特征点的提取。superpoint的输出不仅仅是特征点还有特征点的描述子。提取摄像头之间重叠区域的特征点,包含角点和梯度变化明显的点,并生成特征描述子。由于重叠区域之外的图像信息容易造成特征点的误匹配,所以可以只在重叠区域提取特征点,既能提升特征点提取的速度,又能提升匹配的准确度。重叠区域又可以分为静态的背景和动态的前景,可以分别对背景和前景提取特征点。

20.第四步,图像匹配:图像匹配分静态和动态匹配,静态匹配主要指道路场景下的道路、交通标识、树木等静态物体的匹配,动态匹配是指行人、车辆等的匹配。根据提取的特征描述子,分别对图像的静态和动态物体进行特征匹配。本发明采用一种基于图卷积神经网络的特征匹配算法superglue对图像进行特征匹配, 其中输入是两张图像中superpoint网络提取的特征点以及描述子,输出是图像特征之间的匹配关系。

21.(4a)静态匹配对于图像而言基本相当于背景,可以单独对背景的特征点进行匹配;(4b)动态匹配对于图像而言相当于前景,可以单独对前景的特征点进行匹配。

22.第五步,匹配特征点对过滤:在特征模糊区域提取的特征点可能成为正确匹配的干扰点,导致失配,所以需要对匹配上的特征点对按照一定的规则进行过滤。利用k近邻算法对匹配上的特征点对进行过滤。

23.第六步,获取投影变换的单应性矩阵,完成投影变换:过滤后剩余的匹配点对利用ransac算法循环遍历,直到计算得到图像间投影所需的最佳单应性矩阵,完成图像间的拼接。图4为图像拼接效果图示例。

24.第七步,图像融合:不同摄像头之间因为安装角度等原因,使得图像呈现出的颜色和亮度不统一,造

成拼接处很生硬,效果不好,这种情况下还需对待拼接的图像进行图像融合操作。本发明采用动态规划即使用快速颜色插值模型结合邻近最短距离法寻找最佳拼接线进行图像融合。图5为图像融合效果图示。其中,快速颜色插值模型主要是利用相邻两个摄像头中的图像的颜色梯度差来平滑掉两幅图像拼接处的颜色差异值。平滑的规则是利用邻近最短距离法,即每个像素的颜色值都根据其八邻域的颜色值进行高斯滤波,实现平滑颜色差的目的。

25.由此可见,本发明提取精度高,实现实时全景拼接和融合,然后直接投影到相应的监控大屏,可以更直观更清晰的监测整个片区的状况。本发明的创新在于特征点提取的方法采用superpoint和特征匹配方法采用superglue;并且,superpoint在进行特征提取的时候,是分别对动态前景和静态背景进行特征点提取,使提取的特征点精度更高,不会将背景信息错误的跟前景信息中的相似点进行错误匹配;而且,克服了传统sift或surf提取特征点时间太长,导致不能实时拼接的问题。因为每帧图像中静态背景占比很高,但是前后帧变化率很低,sift方法是每帧都会提取整张图像的信息,很浪费计算时间,而superpoint则是把前一帧图像的背景信息保存,后续每一帧只需跟前一帧做差分,然后只在变化的差分图像上做特征提取即可,只对动态前景做特征提取,大大减少了特征提取所需的时间成本。

26.最后需要说明的是,以上实施例仅用以说明本发明的技术方案而非限制技术方案,本领域的普通技术人员应当理解,那些对本发明的技术方案进行修改或者等同替换,而不脱离本技术方案的宗旨和范围,均应涵盖在本发明的权利要求范围当中。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。