1.本公开属于情绪识别技术领域,具体涉及一种基于多模态时空特征融合的情绪识别方法及系统。

背景技术:

2.本部分的陈述仅仅是提供了与本公开相关的背景技术信息,不必然构成在先技术。

3.情绪的变化通常是在外界环境的刺激之下产生的,会伴有个体表征和心理反映的变化,因此可以通过科学的方法进行测量和模拟。随着便携式和可穿戴式传感器的研发和推广,生理信号的获取难度降低,基于生理信号的情感识别方法受到越来越多研究者的关注。基于生理信号的情感识别方法是指通过对生理信号的处理,分析出人类内心的情感变化。它已被广泛应用于许多领域,如疲劳驾驶检测和医疗保健等。然而,众多研究表明脑电图(electroencephalogram,简称eeg)、心电图(electrocardiogram,简称ecg)、皮肤电(galvanic skin response,简称gsr)、呼吸(respiration,简称rsp)和眼电信号(electrooculogram,简称eog)等生理信号与特定的情绪具有一定的相关性,但每种生理信号具有不同的特点,在情绪识别任务中的表现也不同,每种生理信号都需要单独研究。

4.当前基于生理信号的情绪识别方法可以大致分为两类:单模态情绪识别方法和多模态情绪识别方法。在单模态情绪识别方法中,使用最多的就是基于脑电信号的情感识别方法,除此之外,心电图、皮肤电和呼吸等生理信号在情绪识别领域也具有较好的效果。多模态情绪识别方法是指将多个模态的数据和特征等相结合,共同得到最终分类结果的方法,主要包括数据级融合、特征级融合和决策级融合三个层级。无论是单模态还是多模态情绪识别方法,其主要包括数据预处理、特征提取、特征优化、特征融合和情感分类等几个步骤,重点在于特征工程部分。所以,如何提取具有较强情感表征能力的特征并将他们运用到情感识别任务中,已经成为一个关键的挑战。

5.据发明人了解,现有的情绪识别方法存在以下技术问题:

6.(1)传统基于生理信号的情绪识别方法,主要是根据专业知识和经验,从数据中提取统计特征和频域特征等人工特征,可解释性强,但对专业知识要求较高,可能造成信息丢失等问题,从而影响识别准确率。有些研究者提出,使用神经网络提取数据的高级特征是另一种可行的方法,然而不同网络结构在特征提取上表现出的效果差异较大。如何使用神经网络提取具有较高情感表征能力的高级特征成为了一大技术难点。

7.(2)多模态技术主要包括数据级融合、特征级融合和决策级融合三个方面,在情感识别领域,研究主要集中在决策级融合和特征级融合。决策级融合是在每个模态训练一个分类器的基础上,对结果进行集成,可以充分利用每一种模态所具有的有益信息,实现简单、可解释强,但也会导致模态间的互补信息损失。特征级融合是从原始数据中提取特征后,将各模态之间的特征进行融合得到融合特征用作识别任务,可以充分利用各个模态之间的情绪互补性。

技术实现要素:

8.为了解决上述问题,本公开提出了一种基于多模态时空特征融合的情绪识别方法及系统,以ecg、rsp和眼动信号为输入,对原始生理数据进行线性填充和降噪处理,消除异常值和噪声对识别准确率的影响;使用卷积神经网络(convolutional neural network,简称cnn)和长短时记忆神经网络(long short term memory networks,简称lstm)提取生理数据的时间特征和空间特征,用以表征情绪;使用多模紧凑双线性池化层融合生理数据的时间特征和空间特征,在保留有效信息和降低维度的基础上,充分利用不同生理数据间的互补信息,解决了不同模态之间的互补信息融合的相关技术问题,提高模型的识别准确率。

9.根据一些实施例,本公开的第一方案提供了基于多模态时空特征融合的情绪识别方法,采用如下技术方案:

10.一种基于多模态时空特征融合的情绪识别方法,包括以下步骤:

11.获取原始生理数据;

12.对所获取的原始生理数据进行预处理,得到多模态生理数据;

13.基于所得到的多模态生理数据分别提取多模态数据的空间特性和时间特性;

14.对所提取到的多模态数据的空间特性和时间特性进行特征级融合,得到融合特征;

15.根据所得到的融合特征进行分类,得到情绪识别的结果。

16.在这里,所获取的原始生理数据至少包括获取心电、呼吸和眼动信号。

17.作为进一步的技术限定,原始的情绪数据集中包含情感刺激阶段和自我评估阶段,对原始的情绪数据集中的生理信号进行裁剪,截取情感刺激阶段数据;对截断后的数据进行线性插值,消除数据采集和处理过程中缺失值的影响;使用小波降噪法对数据进行降噪处理,消除噪声对识别效果的影响。

18.作为进一步的技术限定,所述预处理包括:

19.原始的情绪数据集中包含情感刺激阶段和自我评估截断,对原始的情绪数据集中的生理信号进行裁剪,截取情感刺激阶段数据;

20.对截断后的数据进行线性插值,消除数据采集和处理过程中的缺失值影响;

21.使用小波降噪法对数据进行降噪处理,消除噪声对识别效果的影。

22.进一步的,将预处理后的多模态生理数据转换成灰度图像输入到神经网络中,从灰度图像中提取多模态数据的空间特征。

23.进一步的,将预处理后的多模态生理数据分别输入到神经网络中,提取多模态生理数据的时间特征。

24.作为进一步的技术限定,对神经网络中提取的多模态生理数据的时间特征和空间特征进行特征级融合,得到融合特征,用于情感识别任务,具体过程为:使用countsktech算法统计各个元素出现的频率,实现从高维到低维的映射;通过双线性池化方法对降维后的特征进行融合,得到融合特征。

25.作为进一步的技术限定,根据得到的融合特征,进行分类任务,得到最终情绪识别结果,具体过程为:训练svm分类器;将融合特征输入到分类器中,得到最终识别结果。

26.根据一些实施例,本公开的第二方案提供了一种基于多模态时空特征融合的情绪识别系统,采用如下技术方案:

27.一种基于多模态时空特征融合的情绪识别系统,包括:

28.获取模块,被配置为获取原始生理数据,对所获取的原始生理数据进行预处理,得到多模态生理数据;

29.融合模块,被配置为基于所得到的多模态生理数据分别提取多模态数据的空间特性和时间特性,对所提取到的多模态数据的空间特性和时间特性进行特征级融合,得到融合特征;

30.识别模块,被配置为根据所得到的融合特征进行分类,得到情绪识别的结果。

31.根据一些实施例,本公开的第三方案提供了一种计算机可读存储介质,采用如下技术方案:

32.一种计算机可读存储介质,其上存储有程序,该程序被处理器执行时实现如本公开第一方面所述的基于多模态时空特征融合的情绪识别方法中的步骤。

33.根据一些实施例,本公开的第四方案提供了一种电子设备,采用如下技术方案:

34.一种电子设备,包括存储器、处理器及存储在存储器上并可在处理器上运行的程序,所述处理器执行所述程序时实现如本公开第一方面所述的基于多模态时空特征融合的情绪识别方法中的步骤。

35.与现有技术相比,本公开的有益效果为:

36.1、本公开首先对原始生理信号进行预处理,预处理步骤包括数据截断、线性插值和降噪处理;第二,提出了一种基于二维卷积神经网络(two dimensional convolutional neural network,简称2d-cnn)的空间特征提取模块,将预处理后的多模态生理数据转换成1

×

120

×

120的图像(1表示层数,120

×

120表示图像的像素大小),再将图像输入到2d-cnn中,提取多模态生理数据的空间特征;第三,提出了一种基于长短时记忆神经网络(lstm)的时间特征提取模块,将预处理后的多模态生理数据分别输入到lstm中,提取多模态生理数据的时间特征;第四,采用了一种多模紧凑双线性池化(multimodal compact bilinear pooling)的方法对时间特征和空间特征进行特征级融合,得到融合特征;第五,将融合特征输入到训练好的分类器中,得到最后情绪识别结果。

37.2、本公开中所述的系统由五部分组成:数据预处理模块、空间特征提取模块、时间特征提取模块、特征融合模块和情感分类模块。通过分析发现,人类在情绪发生变化或出现较大波动时,eeg和rsp等也会发生变化,如幅度增大、频率增大等,通过对这些波形规律的分析,准确识别出当前情绪;本公开所提出的空间特征提取模块,预处理后的多模态生理数据转换成1

×

120

×

120的图像(1表示层数,120

×

120表示图像的像素大小),使用2d-cnn网络提取生理信号的空间特征,最大限度地利用生理信号的波形规律等。

38.3、为有针对性地提取生理信号中的时间信息,本公开提出一种时间特征提取模块,将预处理地生理信号分别输入到lstm中提取时间特征,最大限度地利用生理信号中的时间信息。

39.4、为了充分整合时间特征和空间特征,以及利用不同模态之间的互补信息,本公开提出一种特征融合模块,采用多模紧凑双线性池化方法融合时间特征和空间特征,得到融合特征,用于情感识别任务。

附图说明

40.构成本公开的一部分的说明书附图用来提供对本公开的进一步理解,本公开的示意性实施例及其说明用于解释本公开,并不构成对本公开的不当限定。

41.图1是本公开实施例一中的基于多模态时空特征融合的情绪识别方法的流程图;

42.图2是本公开实施例一中的基于多模态时空特征融合的情绪识别方法的具体工作原理图;

43.图3是本公开实施例一中的基于多模态时空特征融合的情绪识别方法的流程实例图;

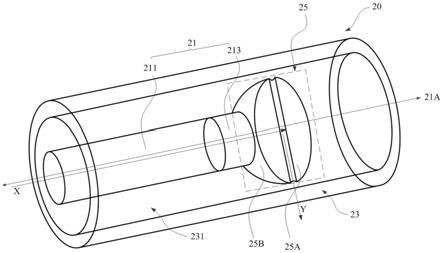

44.图4是本公开实施例一中的空间特征提取的结构示意图;

45.图5是本公开实施例一中的时间特征提取的结构示意图;

46.图6是本公开实施例一中的特征融合的结构示意图;

47.图7是本公开实施例二中的基于多模态时空特征融合的情绪识别系统的结构框图。

具体实施方式

48.下面结合附图与实施例对本公开作进一步说明。

49.应该指出,以下详细说明都是例示性的,旨在对本公开提供进一步的说明。除非另有指明,本文使用的所有技术和科学术语具有与本公开所属技术领域的普通技术人员通常理解的相同含义。

50.需要注意的是,这里所使用的术语仅是为了描述具体实施方式,而非意图限制根据本公开的示例性实施方式。如在这里所使用的,除非上下文另外明确指出,否则单数形式也意图包括复数形式,此外,还应当理解的是,当在本说明书中使用术语“包含”和/或“包括”时,其指明存在特征、步骤、操作、器件、组件和/或它们的组合。

51.在不冲突的情况下,本公开中的实施例及实施例中的特征可以相互组合。

52.实施例一

53.本公开实施例一介绍了一种基于多模态时空特征融合的情绪识别方法。

54.如图1所示的一种基于多模态时空特征融合的情绪识别方法,其特征在于,包括以下步骤:

55.获取原始生理数据;

56.对所获取的原始生理数据进行预处理,得到多模态生理数据;

57.基于所得到的多模态生理数据分别提取多模态数据的空间特性和时间特性;

58.对所提取到的多模态数据的空间特性和时间特性进行特征级融合,得到融合特征;

59.根据所得到的融合特征进行分类,得到情绪识别的结果。

60.如图2和图3所示,本实施例提供了一种基于多模态时空特征融合的情绪识别方法,本实施例以该方法应用于服务器进行举例说明,可以理解的是,该方法也可以应用于终端,还可以应用于包括终端和服务器和系统,并通过终端和服务器的交互实现。服务器可以是独立的物理服务器,也可以是多个物理服务器构成的服务器集群或者分布式系统,还可以是提供云服务、云数据库、云计算、云函数、云存储、网络服务器、云通信、中间件服务、域

名服务、安全服务cdn、以及大数据和人工智能平台等基础云计算服务的云服务器。终端可以是智能手机、平板电脑、笔记本电脑、台式计算机、智能音箱、智能手表等,但并不局限于此。终端以及服务器可以通过有线或无线通信方式进行直接或间接地连接,本技术在此不做限制。本实施例中,该方法包括以下步骤:

61.步骤s01:针对原始情绪数据集d,对于数据集d中的生理信号进行数据裁剪、线性插值和降噪处理后得到数据集d

*

;

62.步骤s02:针对数据集d

*

中的生理信号s,将生理信号转化成灰度图像i_s,并将灰度图像i_s输入到2d-cnn中,得到空间特征f

spatio

;

63.步骤s03:针对数据级d

*

的生理信号s,将生理信号输入到lstm中,得到时间特征f

temporal

;

64.步骤s04:将空间特征f

spatio

和时间特征f

temporal

输入到多模紧凑双线性池化层中进行特征融合,得到融合特征f

fusion

;

65.步骤s05:将融合后的特征f

fusion

输入到分类器中得到最终识别结果。

66.在实施例的步骤s01中,原始的情绪数据集中包含情感刺激阶段和自我评估阶段,对原始的情绪数据集中的生理信号进行裁剪,截取情感刺激阶段数据;对截断后的数据进行线性插值,消除数据采集和处理过程中缺失值的影响;使用小波降噪法对数据进行降噪处理,消除噪声对识别效果的影响。

67.初始化输入原始情绪数据集d=[s1,s1,

…

,sn],其中sn为第n次情感刺激实验中采集的生理信号序列,其中n∈n,n表示实验数量。每次实验中采集的生理信号序列sn=[ecg

1,n

,ecg

2,n

,ecg

3,n

,rspn,eye_datan],其中ecg

i,n

表示第n次情感刺激实验中采集的第i个通道的心电信号,i=1,2,3,rspn表示第n次情感刺激实验中采集的呼吸数据,eye_datan表示第n次情感刺激实验中采集的眼动数据。对数据集d中的每次实验的生理信号序列sn进行数据截断,截取其中情感刺激部分的生理信号,然后进行线性插值和降噪处理,得到预处理后数据集d

*

。

[0068]

在本实施例的步骤s02中,如图4所示,本公开使用matplotlib工具包将数据集d

*

中的各个生理信号序列转化成灰度图像(1

×

120

×

120,1表示层数,120

×

120表示图像的像素大小)。然后使用pytorch工具包搭建2d-cnn网络,将灰度图片输入到的网络中,提取空间特征f

spatio

。

[0069]

对于空间特征提取模块的设计,首先,将维度为120

×

120

×

1的灰度图像i_s输入到2d-cnn中,2d-cnn包括2个5

×5×

32和2个5

×5×

64的卷积运算,得到30

×

30

×

64的特征图,随后通过两个全连接层得到维度为1

×

50的空间特征f

spatio

。卷积运算可以表示为:

[0070]

s(t)=(x

×

ω)(t)

ꢀꢀꢀ

(1)

[0071]

其中,第一个参数x成为“输入数据”,第二个参数ω称为“核函数”,s(t)是输出,即特征映射。

[0072]

以某一次实验的灰度图像i_s为例,使用2d-cnn提取空间特征的计算过程如下:

[0073]

(1)第一个卷积层:输入为120

×

120

×

1的灰度图像i_s(高度

×

宽度

×

颜色通道数),本层共有32个卷积核,每个卷积核的尺寸为7

×7×

1,输出矩阵的尺寸为60

×

60

×

32;

[0074]

(2)第二个卷积层:输入为60

×

60

×

32的矩阵,本层共有32个卷积核,每个卷积核的尺寸为7

×7×

32,输出矩阵的尺寸为60

×

60

×

32;

[0075]

(3)第三个卷积层:输入为60

×

60

×

32的矩阵,本层共有64个卷积核,每个卷积核的尺寸为7

×7×

32,输出矩阵的尺寸为30

×

30

×

64;

[0076]

(4)第四个卷积层:输入为30

×

30

×

64的矩阵,本层共有64个卷积核,每个卷积核的尺寸为7

×7×

64,输出矩阵的尺寸为30

×

30

×

64;

[0077]

(5)第一个全连接层:输入为30

×

30

×

64的矩阵,输出为1

×

512的矩阵;

[0078]

(6)第二个全连接层:输入为1

×

512的矩阵,输出为1

×

50的特征矩阵。

[0079]

在本实施例的步骤s03中,如图5所示,本公开使用pytorch工具包搭建lstm网络,从数据集d

*

中的各个生理信号序列中提取时间特征f

temporal

。lstm网络中需要用到门的概念,其本质是一个全连接层,可以表示为:

[0080]

g(x)=σ(wx b)

ꢀꢀ

(2)

[0081]

其中,x是输入向量,w是门的权重向量,b是偏置项,g(x)是输出向量。

[0082]

lstm使用两个门来控制单元状态c的内容,一个是遗忘门(forget gate),它决定了上一时刻的单元状态c

t-1

有多少保留到当前时刻c

t

,遗忘门可以表示为:

[0083]

f1=σ(wf·

[h

t-1

·

x

t

] bf)

ꢀꢀꢀ

(3)

[0084]

其中,wf是遗忘门的权重矩阵,[h

t-1

·

x

t

]表示把两个向量连接成一个更长的向量,bf是遗忘门的偏置项,σ是sigmoid函数。

[0085]

另一个是输入门(input gate),它决定了当前时刻网络的输入x

t

有多少保存到单元状态c

t

。输入门可以表示为:

[0086]it

=σ(wi·

[h

t-1

·

x

t

] bi)

ꢀꢀꢀ

(4)

[0087]

其中,wi是遗忘门的权重矩阵,bi是遗忘门的偏置项,σ是sigmoid函数。

[0088]

当前输入的单元状态它是根据上一次的输出和本次输入来计算的,计算公式如下所示:

[0089][0090]

接下来计算当前时刻的单元状态c

t

,它是由上一次的单元状态c

t-1

按元素乘以遗忘门f

t

,再用当前输入的单元状态元素乘以输入门i

t

,再将两个积加和产生,计算公式如下:

[0091][0092]

其中,“。”表示按元素乘。

[0093]

lstm用输出门(output gate)来控制单元状态c有多少输出到lstm的当前输出值h

t

,计算公示如下所示:

[0094]ot

=σ(wo·

[h

t-1

·

x

t

] bo)

ꢀꢀꢀꢀ

(7)

[0095]

lstm的最终输出由输出门和单元状态共同决定,计算公示如下所示:

[0096]ht

=o

t

·

tanh(c

t

)

ꢀꢀꢀꢀꢀ

(8)

[0097]

在实施例的步骤s04中,如图6所示,本公开使用countsktech算法统计各个元素出现的频率,实现数据f

spatio

和f

temporal

从高维到低维的映射,得到降维后的特征和减少了后续特征融合的运算量。然后通过快速傅里叶变换(fast fourier transform,fft)、点乘和逆快速傅里叶变换(inverse fast fourier transform,ifft)得

到融合特征f

fusion

。

[0098]

在本实施例的步骤s05中,根据得到的融合特征,进行分类任务,得到最终情绪识别结果,具体为:

[0099]

训练svm分类器;

[0100]

将融合特征输入到分类器中,得到最终识别结果。

[0101]

实施例二

[0102]

本公开实施例二介绍了一种基于多模态时空特征融合的情绪识别系统。

[0103]

如图7所示的一种基于多模态时空特征融合的情绪识别系统,包括:

[0104]

获取模块,被配置为获取原始生理数据,对所获取的原始生理数据进行预处理,得到多模态生理数据;

[0105]

融合模块,被配置为基于所得到的多模态生理数据分别提取多模态数据的空间特性和时间特性,对所提取到的多模态数据的空间特性和时间特性进行特征级融合,得到融合特征;

[0106]

识别模块,被配置为根据所得到的融合特征进行分类,得到情绪识别的结果。

[0107]

详细步骤与实施例一提供的基于多模态时空特征融合的情绪识别方法相同,在此不再赘述。

[0108]

实施例三

[0109]

本公开实施例三提供了一种计算机可读存储介质。

[0110]

一种计算机可读存储介质,其上存储有程序,该程序被处理器执行时实现如本公开实施例一所述的基于多模态时空特征融合的情绪识别方法中的步骤。

[0111]

详细步骤与实施例一提供的基于多模态时空特征融合的情绪识别方法相同,在此不再赘述。

[0112]

实施例四

[0113]

本公开实施例四提供了一种电子设备。

[0114]

一种电子设备,包括存储器、处理器及存储在存储器上并可在处理器上运行的程序,所述处理器执行所述程序时实现如本公开实施例一所述的基于多模态时空特征融合的情绪识别方法中的步骤。

[0115]

详细步骤与实施例一提供的基于多模态时空特征融合的情绪识别方法相同,在此不再赘述。

[0116]

上述虽然结合附图对本公开的具体实施方式进行了描述,但并非对本公开保护范围的限制,所属领域技术人员应该明白,在本公开的技术方案的基础上,本领域技术人员不需要付出创造性劳动即可做出的各种修改或变形仍在本公开的保护范围以内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。