1.本发明涉及计算机视觉的数据预处理方法,特别是一种应用于三维目标检测的数据增强方法。

背景技术:

2.三维目标检测是指从场景中确定目标的位置并识别目标的类别,包括对目标的精确定位和分类两个过程。目前的三维目标检测包括基于相机的三维目标检测和基于激光雷达的三维目标检测。相机具有低成本和信息丰富等优点,但是其无法提供精确的深度信息,当前基于视觉的三维目标检测方法很难取得和基于激光雷达的方法相近的性能;而基于激光雷达的目标检测方法是:激光雷达传感器通过对地物表面进行三维扫描采样,快速获取大规模、无结构、无序的三维点云数据,其中每个点均包含空间坐标(x,y,z)和某些属性信息(如反射强度intensity),是现实世界简单而真实的表征。基于激光雷达的目标检测方法能够提供精准的目标位置、尺寸以及行驶方向等信息,对自动驾驶的安全性起到了至关重要的作用。

3.深度神经网络的迅速成功极快的推动了自动驾驶的发展,其中基于深度学习的激光点云检测算法在检测精度上很快超越了传统的点云聚类算法。通过引入深度神经网络让模型从数据中自主学习点云特征的效果远好于传统的手工设计特征提取模块。但是目前用于三维目标检测的深度神经网络有数以百万计的参数,需要大量的训练数据才能获得较好的效果,否则就会出现严重的过拟合问题。对于目标检测任务而言,数据采集和标注需要对每一帧点云的全部目标周围绘制边界框,这个过程需要手工劳动,会产生高昂的时间成本和价格成本。

4.为了解决上述问题,许多学者和研究人员提出了很多方法,其中数据增强是一种十分有效地防止过拟合的方法,通过从现有的训练样例中创建新的训练样例来扩充训练集的规模,可以较为简单的训练更加精确和稳定的深度神经网络,目前几乎所有目标检测算法都使用了基本的数据增强技术。现有的计算机视觉增强方法大致可分为三类:空间变换、颜色失真以及信息丢弃三种。空间变换包括随机缩放、裁减、翻转以及旋转等;颜色失真包括改变图像的亮度、色调等。这两种方法通过对信息进行一些转换来模拟真实场景来扩充数据集规模,而信息丢失则通过随机擦除、剪切等方式删除掉数据中的部分信息,让深度神经网络学习到原本不太敏感或重要的信息,增加感知的范围从而提高模型的鲁棒性。

5.目前已有较多关于二维图像增强的论文,但目前对三维目标检测的研究仍然较少,三维目标点云之间复杂的相互作用、相互遮挡以及视角和比例的变化,使得获得准确的三维世界理解仍然是一个挑战问题。虽然二维与三维目标检测任务较为相似,但是由于激光点云相较二维图像数据量较大,并具有稀疏性、无序性等特点,并不能直接使用比较成熟的二维图像增强方法,因此目前通过数据增强扩充激光点云数据集规模以防止过拟合的方法还需要进一步研究。

6.由于信息丢失具有较小的计算成本和较好的增强效果,近年来受到了很多研究者

的关注,如何避免对目标点云进行过度删除或保留是信息丢失增强方法的核心要求,一个成功的信息丢失方法应当在数据区域信息的删除和保留之间得到合理的平衡。一方面,过度的删除点云信息会使完全无法分辨出背景点云和目标点云之间的界限,使深度神经网络将该信息不足的目标点云当作是图像噪声;另一方面,过度的保留点云信息会使一些目标完全不被触及,从而导致深度神经网络的鲁棒性较差。

技术实现要素:

7.为解决现有技术存在的上述问题,本发明要设计一种既能分辨出背景点云和目标点云之间的界限,又能提高深度神经网络的鲁棒性的应用于三维目标检测的数据增强方法。

8.为了实现上述目的,本发明的技术方案如下:一种应用于三维目标检测的数据增强方法,包含以下步骤:

9.a、读入一帧激光扫描图中的无序点云p,将无序点云p及与之对应的真实边界框b作为输入,并根据无序点云p与边界框b之间的几何位置关系,将无序点云p划分为背景点云p

back

和目标点云p

fore

,具体表示如下:

10.p

fore

=p∈b

11.p

back

=p-p

fore

12.所述边界框的参数化表示为x,y,z,h,w,l,θ,其中x,y,z分别表示边界框中心的三个方向的坐标,h、w、l分别为边界框的长度、宽度以及高度,而θ为边界框的偏航角;

13.b、将目标点云p

fore

划分为[p1、p2、...、pn],将边界框b划分为[b1、b2、...、bn],并通过平移和旋转将目标点云与边界框对齐生成与边界框相匹配的点云坐标p

coord

,具体操作为将各个边界框中的点云以边界框中心b

center

为原点,并绕原点向边界框偏航角θ反方向旋转,具体表示如下:

[0014][0015]

随后根据预先确定的网格比例范围随机选取网格蒙版单元比例n将边界框分割成包含n3个小立方体的三维网格状蒙版m,并通过对网格蒙版m与目标点云p

fore

的随机相对位移σ产生不同的信息丢失效果如下:

[0016]

m=m σ

ꢀꢀ

0<σ<n

[0017]

通过将网格蒙版m与点云坐标p

coord

进行匹配得到进行保留的点云索引值p

index

如下:

[0018]

p

index

=p

coord

∈m

[0019]

根据该索引值进行目标点云删除,得到处理后的点云p

mask

,具体表示如下:

[0020]

p

mask

=p

fore

∈p

index

[0021]

c、将所有边界框中处理后的点云拼接在一起,并与背景点云合并后得到数据增强后的点云p

new

,将所有的点云与真实标签和边界框输出,公式如下:

[0022]

p

new

=p

back

p

mask

[0023]

与现有技术相比,本发明具有以下有益效果:

[0024]

1、由于本发明采用了离散的网格蒙版以移除点云,可以鲁棒地实现信息丢失。通

过随机改变生成网格状蒙版尺寸比例来对网络进行不同的信息丢失,当比例较小时,生成更加密集的信息丢失网格蒙版,当网格比例较大时,生成比较稀疏的信息丢失网络蒙版。通过合理调节网格比例可以在增加数据集规模的同时保留目标点云关键信息,防止深度神经网络无法收敛。相较于传统的将边界框划分为数块小边界框,离散的网格蒙版能更好的保留目标点云的关键信息,而本发明的离散网格蒙版即使在网格比例较大时也能保留目标点云的关键信息。

[0025]

2、由于本发明对随机生成的网格蒙版进行了随机移位,可以在每次进行信息丢失操作过程中针对相同的目标框产生不同的数据增强效果,显著的提高了数据集的规模,使得训练得到的深度学习模型具有更好的鲁棒性。

[0026]

3、由于本发明根据目标点云与边界框中心的相对位置对点云进行索引,通过生成索引列表与网格蒙版进行匹配来对目标点云进行增强,大大减少了将目标点云与网格蒙版相对位置匹配所产生的时间复杂度和空间复杂度,这使得该预处理方法不会增加显著的时间成本。

附图说明

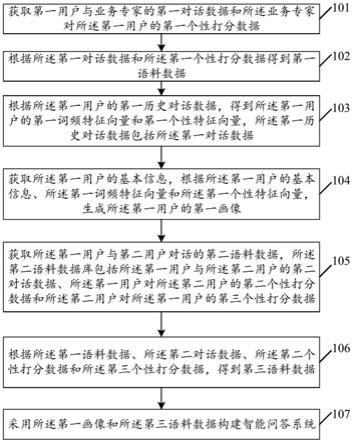

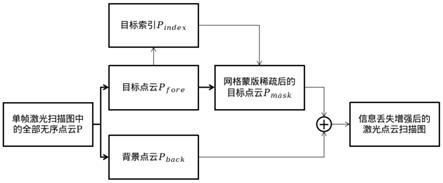

[0027]

图1是本发明的网格蒙版结构示意图。

[0028]

图2是本发明的方法流程图。

具体实施方式

[0029]

下面结合附图对本发明进行进一步地描述。

[0030]

为了正确理解当前深度学习理论解决三维目标检测的问题,首先提供关于目标检测的基本概念。传统的二维目标检测将图像作为输入,并在检测到的物体周围画出一个边界框,然后,将二维目标检测提升到三维,需要对物体在三维空间中的大小、方向以及位置进行额外的估计。具体来说,三维目标检测的目的在于在三维空间中的物体周围放置一个定向的三维边界框,与二维边界框类似,三维边界框将目标参数化表示为[x,y,z,h,w,l,θ],其中[x,y,z]表示三维目标边界框的中心坐标,h、w、l分别为边界框的长度、宽度以及高度,而θ为边界框框的偏航角。该边界框应该紧密的贴合所有感兴趣的检测目标。

[0031]

为解决现有三维目标检测信息丢失策略失败案例较多的问题,本发明设计了一种使用网格蒙版对目标点云进行信息丢失的方法gridmask3d,这种方法通过合理的信息丢失方法在扩充训练数据集规模减少了失败案例的概率。将gridmask3d数据增强方法按公式形式表征为:

[0032][0033]

其中,x代表原始的边界框中的离散点云,m代表根据该三维边界框生成的网格蒙版,代表经过网格蒙版信息丢失后的离散点云,通过将点云与网格蒙版进行匹配的方法,对目标点云进行信息丢失。

[0034]

如图1所示,网格蒙版m为立体网格结构,本发明以三维边界框的中心为原点生成相同间距和大小的网格蒙版,通过对网格蒙版随机移位在每次增强操作中得到不同的增强效果,最后通过删除网格蒙版中的点云进行信息丢失,立方体的间距和尺寸需要通过实验

验证确定,从而获得较好的增强效果,具体流程见图2。

[0035]

与现有的点云增强算法不同,本发明设计的信息丢失增强算法既不将目标点云按相对边界框的位置分为数个连续区域,并随机移除部分连续区域的全部点云,也不直接对全部目标点云进行稀疏化处理。本发明通过删除不连续的网格蒙版中的点云,可以在保留必要目标信息的同时,强迫深度神经网络学习到原本不太敏感或重要的信息。

[0036]

本发明不局限于本实施例,任何在本发明披露的技术范围内的等同构思或者改变,均列为本发明的保护范围。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。