技术特征:

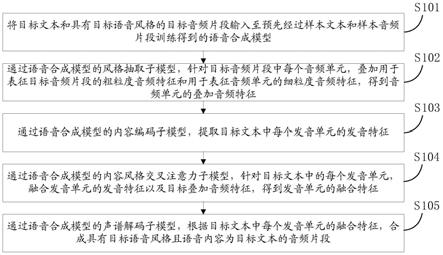

1.一种风格迁移合成方法,包括:将目标文本和具有目标语音风格的目标音频片段输入至预先经过样本文本和样本音频片段训练得到的语音合成模型;通过所述语音合成模型的风格抽取子模型,针对所述目标音频片段中每个音频单元,叠加用于表征所述目标音频片段的粗粒度音频特征和用于表征所述音频单元的细粒度音频特征,得到所述音频单元的叠加音频特征;通过所述语音合成模型的内容编码子模型,提取所述目标文本中每个发音单元的发音特征;通过所述语音合成模型的内容风格交叉注意力子模型,针对所述目标文本中的每个发音单元,融合所述发音单元的发音特征以及目标叠加音频特征,得到所述发音单元的融合特征,其中,所述目标叠加音频特征为与所述发音特征匹配的叠加音频特征;通过所述语音合成模型的声谱解码子模型,根据所述目标文本中每个发音单元的所述融合特征,合成具有所述目标语音风格且语音内容为所述目标文本的音频片段。2.根据权利要求1所述的方法,其中,所述通过所述语音合成模型的风格抽取子模型,针对所述目标音频片段中每个音频单元,叠加用于表征所述目标音频片段的粗粒度音频特征和用于表征所述音频单元的细粒度音频特征,得到所述音频单元的叠加音频特征,包括:通过所述语音合成模型的风格抽取模块,提取所述目标音频片段中所有音频帧的平均音频特征,作为粗粒度音频特征;通过所述风格抽取模块,针对所述目标音频片段中的每个音频单元,提取所述音频单元中所有音频帧的平均音频特征,作为所述音频单元的细粒度音频特征;通过所述风格抽取模块,针对所述目标音频片段中的每个音频单元,将所述音频单元的所述细粒度音频特征与所述粗粒度音频特征相加,得到所述音频单元的叠加音频特征。3.根据权利要求1所述的放法,其中,所述通过所述语音合成模型的内容风格交叉注意力子模型,针对目标文本中的每个发音单元,融合所述发音单元的发音特征以及目标叠加音频特征,得到所述发音单元的融合特征,包括:将目标文本中每个发音单元的发音特征输入至所述语音合成模型中内容风格交叉注意力子模型的自注意力子网络,得到所述子注意力子网络输出的经过调整的发音特征;通过所述内容交叉子模型的交叉注意力子网络,针对所述目标文本中的每个发音单元,融合所述发音单元的经过调整的发音特征以及目标叠加音频特征,得到所述发音单元的融合特征,其中,所述所述目标叠加音频特征为与经过调整的发音特征匹配的叠加音频特征。4.根据权利要求1所述的方法,其中,所述通过所述语音合成模型的声谱解码子模型,根据所述目标文本中每个发音单元的所述融合特征,合成具有所述目标语音风格且语音内容为所述目标文本的音频片段,包括:将所述目标文本中每个发音单元的所述融合特征、所述粗粒度音频特征输入至所述语音合成模型的声谱解码子模型,得到所述声谱解码子网络输出的声谱特征;将所述声谱特征转换为具有所述目标语音风格且语音内容为所述目标文本的音频片段。5.一种语音合成模型的训练方法,包括:

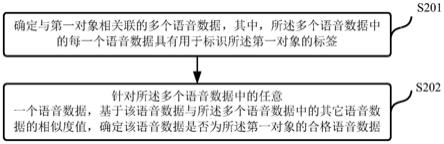

将样本音频片段、样本文本输入至原始模型,其中,所述样本文本为所述样本音频片段的语音内容;通过所述原始模型,针对所述样本音频片段中每个音频单元,叠加用于表征所述样本音频片段的粗粒度音频特征和用于表征所述音频单元的细粒度音频特征,得到所述音频单元的叠加音频特征;通过所述原始模型,提取所述样本文本中每个发音单元的发音特征;通过所述原始模型,针对所述样本文本中的每个发音单元,融合所述发音单元的发音特征以及目标叠加音频特征,得到所述发音单元的融合特征,其中,所述目标叠加音频特征为与所述发音特征匹配的叠加音频特征;通过所述原始模型,根据所述样本文本中每个发音单元的所述融合特征转换为预测声谱特征;根据所述预测声谱特征与所述样本音频片段的真实声谱特征之间的差异,调整所述原始模型的模型参数;获取新的样本音频片段和新的样本文本,返回执行所述将样本音频片段、样本文本输入至原始模型的步骤,直至达到第一收敛条件,将经过调整的原始模型作为语音合成模型。6.根据权利要求5所述的方法,还包括:从所有叠加音频特征中抽取部分叠加音频特征,作为筛选后音频特征;所述目标叠加音频特征为与所述发音特征匹配的筛选后音频特征。7.根据权利要求6所述的方法,其中,所述样本音频片段初始为第一样本人员的音频片段;所述获取新的样本音频片段,包括:若未达到第二收敛条件,从第一样本数据集中获取新的样本音频片段,所述第一样本数据集中包括所述第一样本人员的音频片段;若达到所述第二收敛条件,从第二样本数据集中获取新的样本音频片段和新的样本文本,所述第二样本数据集中包括多个样本人员的音频片段。8.一种风格迁移合成装置,包括:第一输入模块,用于将目标文本和具有目标语音风格的目标音频片段输入至预先经过样本文本和样本音频片段训练得到的语音合成模型;风格抽取模块,用于通过所述语音合成模型的风格抽取子模型,针对所述目标音频片段中每个音频单元,叠加用于表征所述目标音频片段的粗粒度音频特征和用于表征所述音频单元的细粒度音频特征,得到所述音频单元的叠加音频特征;内容编码模块,用于通过所述语音合成模型的内容编码子模型,提取所述目标文本中每个发音单元的发音特征;内容风格交叉注意力模块,用于通过所述语音合成模型的内容风格交叉注意力子模型,针对所述目标文本中的每个发音单元,融合所述发音单元的发音特征以及目标叠加音频特征,得到所述发音单元的融合特征,其中,所述目标叠加音频特征为与所述发音特征匹配的叠加音频特征;声谱解码模块,用于通过所述语音合成模型的声谱解码子模型,根据所述目标文本中每个发音单元的所述融合特征,合成具有所述目标语音风格且语音内容为所述目标文本的

音频片段。9.根据权利要求8所述的装置,其中,所述风格抽取模块通过所述语音合成模型的风格抽取子模型,针对所述目标音频片段中每个音频单元,叠加用于表征所述目标音频片段的粗粒度音频特征和用于表征所述音频单元的细粒度音频特征,得到所述音频单元的叠加音频特征,包括:通过所述语音合成模型的风格抽取模块,提取所述目标音频片段中所有音频帧的平均音频特征,作为粗粒度音频特征;通过所述风格抽取模块,针对所述目标音频片段中的每个音频单元,提取所述音频单元中所有音频帧的平均音频特征,作为所述音频单元的细粒度音频特征;通过所述风格抽取模块,针对所述目标音频片段中的每个音频单元,将所述音频单元的所述细粒度音频特征与所述粗粒度音频特征相加,得到所述音频单元的叠加音频特征。10.根据权利要求8所述的装置,其中,所述内容风格交叉注意力模块通过所述语音合成模型的内容风格交叉注意力子模型,针对目标文本中的每个发音单元,融合所述发音单元的发音特征以及目标叠加音频特征,得到所述发音单元的融合特征,包括:将目标文本中每个发音单元的发音特征输入至所述语音合成模型中内容风格交叉注意力子模型的自注意力子网络,得到所述子注意力子网络输出的经过调整的发音特征;通过所述内容交叉子模型的交叉注意力子网络,针对所述目标文本中的每个发音单元,融合所述发音单元的经过调整的发音特征以及目标叠加音频特征,得到所述发音单元的融合特征,其中,所述所述目标叠加音频特征为与经过调整的发音特征匹配的叠加音频特征。11.根据权利要求8所述的装置,其中,所述声谱解码模块通过所述语音合成模型的声谱解码子模型,根据所述目标文本中每个发音单元的所述融合特征,合成具有所述目标语音风格且语音内容为所述目标文本的音频片段,包括:将所述目标文本中每个发音单元的所述融合特征、所述粗粒度音频特征输入至所述语音合成模型的声谱解码子模型,得到所述声谱解码子网络输出的声谱特征;将所述声谱特征转换为具有所述目标语音风格且语音内容为所述目标文本的音频片段。12.一种语音合成模型的训练装置,包括:第二输入模块,用于将样本音频片段、样本文本输入至原始模型,其中,所述样本文本为所述样本音频片段的语音内容;第一原始模块,用于通过所述原始模型,针对所述样本音频片段中每个音频单元,叠加用于表征所述样本音频片段的粗粒度音频特征和用于表征所述音频单元的细粒度音频特征,得到所述音频单元的叠加音频特征;第二原始模块,用于通过所述原始模型,提取所述样本文本中每个发音单元的发音特征;第三原始模块,用于通过所述原始模型,针对所述样本文本中的每个发音单元,融合所述发音单元的发音特征以及目标叠加音频特征,得到所述发音单元的融合特征,其中,所述目标叠加音频特征为与所述发音特征匹配的叠加音频特征;第四原始模块,用于通过所述原始模型,根据所述样本文本中每个发音单元的所述融

合特征转换为预测声谱特征;参数调整模块,用于根据所述预测声谱特征与所述样本音频片段的真实声谱特征之间的差异,调整所述原始模型的模型参数;获取模块,用于获取新的样本音频片段和新的样本文本,返回执行所述将样本音频片段、样本文本输入至原始模型的步骤,直至达到第一收敛条件,将经过调整的原始模型作为语音合成模型。13.根据权利要求12所述的装置,还包括:叠加特征抽取模块,用于从所有叠加音频特征中抽取部分叠加音频特征,作为筛选后音频特征;所述目标叠加音频特征为与所述发音特征匹配的筛选后音频特征。14.根据权利要求12所述的装置,其中,所述样本音频片段初始为第一样本人员的音频片段;所述获取模块获取新的样本音频片段,包括:若未达到第二收敛条件,从第一样本数据集中获取新的样本音频片段,所述第一样本数据集中包括所述第一样本人员的音频片段;若达到所述第二收敛条件,从第二样本数据集中获取新的样本音频片段和新的样本文本,所述第二样本数据集中包括多个样本人员的音频片段。15.一种电子设备,包括:至少一个处理器;以及与所述至少一个处理器通信连接的存储器;其中,所述存储器存储有可被所述至少一个处理器执行的指令,所述指令被所述至少一个处理器执行,以使所述至少一个处理器能够执行权利要求1-4或5-7中任一项所述的方法。16.一种存储有计算机指令的非瞬时计算机可读存储介质,其中,所述计算机指令用于使所述计算机执行根据权利要求1-4或5-7中任一项所述的方法。17.一种计算机程序产品,包括计算机程序,所述计算机程序在被处理器执行时实现根据权利要求1-4或5-7中任一项所述的方法。

技术总结

本公开提供了一种风格迁移合成方法、装置及电子设备。涉及人工智能技术领域,尤其涉及深度学习、语音合成、风格迁移技术领域,具体涉及一种语音风格迁移合成方法、装置及电子设备。具体实现方案为:将目标文本和目标音频片段输入至预先经过样本文本和样本音频片段训练得到的语音合成模型;针对目标音频片段中每个音频单元,叠加粗粒度音频特征和细粒度音频特征,得到音频单元的叠加音频特征;提取目标文本中每个发音单元的发音特征;针对目标文本中的每个发音单元,融合发音单元的发音特征以及目标叠加音频特征,得到发音单元的融合特征;根据融合特征,合成音频片段。能够合成在整体和细节上具有目标风格的音频片段。体和细节上具有目标风格的音频片段。体和细节上具有目标风格的音频片段。

技术研发人员:赵情恩

受保护的技术使用者:北京百度网讯科技有限公司

技术研发日:2021.12.08

技术公布日:2022/3/15

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。