1.本发明涉及自动驾驶技术领域,尤其是涉及一种基于单目图像的语义拓扑联合建图方法。

背景技术:

2.在车辆实现自动驾驶的过程中,除了需要给车辆配备各种实时传感器,如相机、激光雷达、毫米波雷达之外,基本都离不开另外一个可以提供大量周围环境信息的“传感器”——高精度地图。高精度地图不同于面向人类的传统电子地图,它是专为自动驾驶汽车打造的,能够支持其完成自动驾驶任务,是一种能够提供信息更多、精度也更高的地图。

3.目前,高精度地图建图的技术路线主要分为两种:一种是使用激光雷达与视觉感知融合的多模态数据路线(对应waymo,here的测绘车采集策略);另一种则是以视觉感知信息为主的路线(对应mobileye的众包采集策略)。其中,使用激光雷达进行建图的方式,其成本高昂,在面对巨大待建图道路总量以及道路情况随时可能更新的情况下,应尽可能发展使用低成本传感器如相机和gnss定位系统进行建图的技术。

4.但不管是采用激光雷达和视觉融合感知的建图方案、还是依靠视觉感知的建图方案,构建高精度地图的流程都包括数据采集、数据清洗和匹配拼接、人工或半自动化的地图语义元素标注、人工或半自动化的拓扑关系标注等步骤,部分难以通过计算机视觉识别的语义特征以及语义元素之间的拓扑逻辑关系标注仍旧离不开人工的编辑加工(平均工作量约为30km路段/人/天),而拓扑信息由于抽象程度更高,需要更大的工作量,因此,降低建图工作的成本和提高其自动化程度是当前亟需解决的问题。

5.此外,在高精度地图建图涉及到的多个领域中,也存在着很多有待改善的问题,例如基于视觉的道路语义特征提取方法仍面临着距离自车较远位置的检测精度明显下降的问题;语义建图方法中一部分工作使用了激光雷达或者人工的标注,另一部分使用了传统的自然特征点作为建图特征,而使用车道线等路面语义信息作为建图特征的相关工作采用了视觉或激光里程计的定位方式,不满足高精度地图对精度的要求;拓扑建图方法中大部分工作仍停留在道路级别拓扑路网的构建,不满足高精度地图车道级别的要求,少量构建车道级别拓扑地图的工作仍是采用激光雷达作为主要传感器,面临硬件成本较高的问题。

技术实现要素:

6.本发明的目的就是为了克服上述现有技术存在的缺陷而提供一种基于单目图像的语义拓扑联合建图方法,以实现低成本、高自动化程度的语义建图和拓扑建图。

7.本发明的目的可以通过以下技术方案来实现:一种基于单目图像的语义拓扑联合建图方法,包括以下步骤:

8.s1、车辆沿路径行驶,同步采集车辆前方rgb图像数据、车辆位姿信息、车辆定位数据以及定位数据对应的时间戳信息;

9.s2、将车辆前方rgb图像数据输入语义分割网络,输出得到包含图像路面类别标识

的语义分割图;

10.s3、构建全局语义地图:将语义分割图中各路面类别标识像素点投影至车体坐标系;

11.再将车体坐标系中各路面类别标识像素点投影至地图全局坐标系,并将地图全局坐标系中各路面类别标识像素点融入地图数据管理系统;

12.直至每张rgb图像数据对应语义分割图中各路面类别标识像素点均已融入地图数据管理系统;

13.由地图数据管理系统生成全局语义地图;

14.s4、构建拓扑地图:将全局语义地图分解成多个roi(region of interest,感兴趣区域),并对全局语义地图进行车道拓扑状态的最优解搜索,最后将所有建立拓扑状态的roi结合构成完整的拓扑地图。

15.进一步地,所述步骤s1中车辆前方rgb图像数据和车辆位姿信息具体是由安装在车辆上的单目相机视觉传感器采集得到,所述车辆定位数据以及定位数据对应的时间戳信息具体是由安装在车辆上的gps和imu(inertial measurement unit,惯性测量单元)采集得到。

16.进一步地,所述步骤s2中语义分割网络具体是一种采取以编-解码器结构的全卷积神经网络为基础骨干、并结合空间变换网络构建的语义分割网络,所述语义分割网络的具体工作过程为:在编码的过程中将前视图视角的特征图逐步转换到鸟瞰图视角;

17.在解码的过程中再通过反向的变换,将鸟瞰图视角下多维特征图转换回前视图视角,最终仍使用前视图视角的真值进行有监督训练;

18.整个编码-解码过程可导,根据语义分割网络的输出,以得到路面标记的语义信息提取图。

19.进一步地,所述步骤s3具体包括以下步骤:

20.s31、图像坐标系到车体坐标系的投影:根据单目相机内参以及相机坐标系相对于车体坐标系的外参,将语义分割图中各路面类别标识像素点投影至车体坐标系;

21.s32、车体坐标系到地图全局坐标系的投影:结合车辆位姿和定位数据,通过记录的时间戳,将rgb图像和定位信息进行同步,进行位姿的四元数插值计算,得到每一张rgb图像所对应的同一时刻的车辆位姿,根据每张rgb图像所对应的位姿,将车体坐标系下的语义特征点投影至地图全局坐标系下;

22.s33、建立地图数据管理单元nest和bin,以构成地图数据管理系统,所述nest是以10m*10m*10m为大小的物理世界中的立方体,所述bin是以5cm*5cm*5cm为大小的物理世界中立方体,具体的:

23.nest={(id

x

,idy,idz),{bins}}

24.bin={(id

x

,idy,idz),labelb,votebox}

25.其中,id为其立方体中心点在世界坐标系中的坐标除以相应的分辨率,bin中类别标签labelb表示这个单元属于哪一种语义类别,投票箱votebox记录了这个bin被分类为每一种类别的频数,将投票箱内的各个类别被观测到的频次用直方图的形式表示,频次记录最高的类别即作为这个bin的类别标签;

26.结合数据管理融合算法和动态投票箱内融合算法,将地图全局坐标系中的坐标点

融入地图数据管理系统。

27.进一步地,所述步骤s33中数据管理融合算法的具体过程为:

28.输入:rgb图像经过语义分割和坐标变换后,投影到地图全局坐标系中,得到点集{realpointi},每个realpoint∈{realpointi}都可以根据其坐标以及nest和bin的分辨率,以分别计算各realpoint所属的nest以及bin,其中,realpoint={(x,y,z),label},realpoint={(x,y,z),label},realpoint为地图全局坐标系中的一个路面语义特征点,(x,y,z)为路面语义特征点在地图全局坐标系中的坐标数据,label为路面语义特征点对应的语义类别标签;

29.如果所归属的nest当前不存在,则新建一个nest以及相应的bin;

30.否则将当前realpoint投放到所属的nest中进行融合,如果当前realpoint所属的bin不存在,则新建相应的bin,并初始化bin的labelb为realpoint的label,votebox中对应label的频次为1,其它为0;

31.否则将当前realpoint投放进所属的bin中进行融合投票,更新数据;

32.输出:处理完点集{realpoint_i}后保存地图数据。

33.进一步地,所述步骤s33中动态投票箱内融合算法的具体过程为:

34.前提:当前bin已存在,类别标签labelb=i,投票箱votebox={cj},j为类别编号,类别总数为num_class,即0≤j<num_class,且当前类别的被观测频次ci=max({cj});

35.输入:一个新的realpoint(语义分割类别为t),坐标属于当前bin,需要融合:

36.在当前bin的投票箱中更新类别t被观测到频次c

t

=c

t

1;

37.如果c

t

>250,则对投票箱内的所有频次数据进行同程度的削减:

38.cj=max(0,c

j-50)

39.保证频次不会出现负数,0≤j<num_class;

40.如果在当前bin的投票箱中,类别t被观测频次大于当前bin的标签类i被观测到的频次c

t

>ci,则更新当前bin的类别标签为t;

41.否则无需更新类别,仅需更新投票箱数据,融合结束;

42.输出:融合更新后的bin。

43.进一步地,所述步骤s4中对全局语义地图进行车道拓扑状态的最优解搜索具体包括以下步骤:

44.s41、将拓扑图层的构建建模为一个提取有向无环图的最大似然问题,其中,有向无环图中的节点编码了车道线的位置和方向属性,连接节点的边则表示拓扑连接关系;

45.s42、构建贪心算法提取拓扑关系;

46.s43、考虑到车道线具有狭长、连续性强的特性,采用卷积神经网络进行全局多尺度特征的提取、采用循环神经网络进行拓扑节点的提取生成,以构建得到拓扑图层。

47.进一步地,所述步骤s41中构建的最大似然问题具体为:

48.输入的语义图层定义为期望的网络输出是将车道线结构化表示的有向无环图g,其中g=(v,e),v表示图中节点的集合,e表示图中边的集合,每个节点vi=(xi,θi,si)编码了节点所处局部的几何和拓扑属性,xi表示了该节点所处的位置,θi表示了节点所指方向,si表示了节点的拓扑状态,并定义四种拓扑状态:

49.(1)正常状态:该节点只有一个父节点和一个子节点;

50.(2)分叉状态:该点有一个父节点和两个子节点,车道线在这个节点处分叉出两根独立的车道线;

51.(3)合并状态:该节点有两个父节点和一个子节点,两根车道线在这个节点处合并为一根车道线;

52.(4)结束状态:该节点为当前车道线的终点,对应了路口遇到停止线的状态;

53.此外,定义v

c(i)

为节点vi的子节点,v

p(i)

为节点vi的父节点,当vi节点为分叉点的时候,子节点v

c(i)

的数量有2个,当vi节点为合并点的时候,父节点v

p(i)

的数量有2个,当vi节点为结束点的时候,子节点v

c(i)

的数量有0个;

54.给定输入语义地图后,目标是在所有可能的有向无环图g的解空间中找到概率最大的一个,也就构建成了最大似然问题:

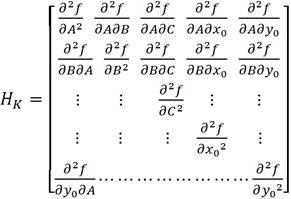

[0055][0056]

由于g是由若干节点和边组成的有向无环图,因此可以联合概率分布的方式表示如下:

[0057][0058]

其中,每一项条件概率又可以被拆解成节点的三个组成元素,即位置、方向、拓扑状态的条件概率连乘:

[0059][0060]

上述最大似然问题被建模成深度神经网络的形式进行最优解的搜索。

[0061]

进一步地,所述步骤s42中构建的贪心算法的具体工作过程为:

[0062]

输入:给定父节点v

p(i)

=(x

p(i)

,θ

p(i)

,s

p(i)

)以及当前输入的语义地图子图

[0063]

之后以父节点p(i)的位置x

p(i)

和方向θ

p(i)

为基准锁定子图中局部感兴趣区域roi

θ

;

[0064]

在感兴趣区域roi

θ

中预测得到节点vi的方向θi;

[0065]

再以父节点p(i)的位置x

p(i)

和节点vi方向θi为基准锁定子图中局部感兴趣区域roi

x

;

[0066]

之后在感兴趣区域roi

x

中预测得到节点vi所在的位置xi;

[0067]

然后以节点vi的位置xi和节点vi的方向θi为基准锁定子图中局部感兴趣区域rois;

[0068]

最后在感兴趣区域rois中预测得到节点vi所处的拓扑状态si;

[0069]

输出:节点vi的所有几何和拓扑状态(xi,θi,si),并构建合适的约束函数,使得每次预测产生的节点vi逐渐逼近真值。

[0070]

进一步地,所述步骤s43中构建拓扑图层的具体过程为:

[0071]

输入:一张语义地图(子图)

[0072]

经过全局多尺度特征提取模块,输出多尺度的特征图;

[0073]

多尺度的特征经过车道线注意力模块输出车道线的注意力特征图;

[0074]

将全局多尺度特征和车道线注意力特征合并后的融合特征图作为后续检测头截取感兴趣区域roi的来源;

[0075]

首先将根据父节点的位置和方向从车道线注意力特征图中截取相应roi传递给方向预测分支,输出下一个节点的方向;

[0076]

根据方向预测分支输出的方向在车道线注意力特征图上调整roi的截取范围,再传递给位置预测分支,输出下一个节点的位置;

[0077]

根据上面的两个分支输出方向和位置从融合特征图中截取相应roi,传递给状态预测分支,输出下一个节点的拓扑状态。至此在给定父节点的情况下,新节点的全部状态量都已获得;

[0078]

将生成的节点作为父节点继续进行子节点的搜索;

[0079]

输出:构建好的拓扑图层。

[0080]

与现有技术相比,本发明以高精度地图中最常见的两个重要图层:语义(几何)图层和拓扑图层为切入点,提出以车载视觉和定位系统为传感器配置方案,开拓性地搭建了完整的语义和拓扑联合建图算法框架,并针对语义建图和拓扑建图方法分别进行了改进,主要涉及基于视觉的语义分割路面标记提取、基于视觉和定位信息的自动化语义建图以及基于语义地图的自动化拓扑建图,不仅能够保证低成本,同时本发明提出的方法可以构建出相对精度达99%的语义地图,并设计了支持低成本传感器的众包融合策略,拓扑地图位置精度和拓扑关系正确率也高达90%以上,大大提高了建图的自动化程度。

附图说明

[0081]

图1为本发明的方法流程示意图;

[0082]

图2为实施例的应用过程示意图;

[0083]

图3为实施例的联合建图方法原理示意图;

[0084]

图4为实施例中采集数据车辆传感器配置图;

[0085]

图5为本发明的图像路面语义分割神经网络架构图;

[0086]

图6为本发明的拓扑建图网络整体架构图。

具体实施方式

[0087]

下面结合附图和具体实施例对本发明进行详细说明。

[0088]

实施例

[0089]

如图1所示,一种基于单目图像的语义拓扑联合建图方法,包括以下步骤:

[0090]

s1、车辆沿路径行驶,同步采集车辆前方rgb图像数据、车辆位姿信息、车辆定位数据以及定位数据对应的时间戳信息;

[0091]

s2、将车辆前方rgb图像数据输入语义分割网络,输出得到包含图像路面类别标识的语义分割图;

[0092]

s3、构建全局语义地图:将语义分割图中各路面类别标识像素点投影至车体坐标系;

[0093]

再将车体坐标系中各路面类别标识像素点投影至地图全局坐标系,并将地图全局坐标系中各路面类别标识像素点融入地图数据管理系统;

[0094]

直至每张rgb图像数据对应语义分割图中各路面类别标识像素点均已融入地图数据管理系统;

[0095]

由地图数据管理系统生成全局语义地图;

[0096]

s4、构建拓扑地图:将全局语义地图分解成多个roi(region of interest,感兴趣区域),并对全局语义地图进行车道拓扑状态的最优解搜索,最后将所有建立拓扑状态的roi结合构成完整的拓扑地图。

[0097]

本实施例应用上述方法,其具体应用过程和方法原理分别如图2和图3所示,主要包括:

[0098]

1)首先按照图4所示的车辆传感器配置进行数据同步采集,包括前视相机的rgb图像数据、车辆位姿信息、gps和imu获取的定位数据以及数据对应的时间戳,其中,车辆(相机内参和相机相对于车体坐标系的外参已精确标定)沿着设定的路径行驶。

[0099]

2)将采集的rgb图像输入本发明提出的语义分割网络,以输出得到包含路面类别标识的语义分割图,如图5所示,本发明采取以编-解码器(encoder-decoder)结构的全卷积神经网络(fcn)为基础骨干,结合空间变换网络(stn)的思想搭建了一种新颖的语义(或实例)分割网络。这种语义分割网络可以将传统的逆透视投影算法拆解成多个可导的单应性变换层,在编码的过程中将前视图视角的特征图逐步转换到鸟瞰图视角,而在解码的过程中再通过反向的变换将鸟瞰图视角下多维特征图转换回前视图视角,最终仍使用前视图视角的真值进行有监督训练。整个过程可导,该网络可以使用端到端的训练方式。根据语义分割网络的输出可以得到路面标记的语义信息提取图。

[0100]

需要说明的是,其中的连续透视变换原理具体为:假设鸟瞰图是由一个垂直向下拍摄的虚拟相机生成,完整的逆透视变换过程是将前视相机的图像转换到所述虚拟相机视角的图像。一次性进行这样的变换即为传统的逆透视变换算法,只需要计算一个单应性变换矩阵h即可。本发明则是将完整的逆透视变换h分解为一系列连续的透视变换{h

i,i 1

}(以下用hi简称),hi可以将图像从视角i投影到视角i 1(假设存在n个虚拟相机)。结合相机的成像模型,假设已知相机的内参和外参,则这个投影过程即可表示为:

[0101][0102]

其中,r

i,i 1

(简称为ri)是虚拟相机i 1相对于虚拟相机i的旋转矩阵,而ti是对应的平移向量,是地面的法向量,表示了地面的垂直方向,di是虚拟相机i到地面的距离,ki是虚拟相机i的内参矩阵。

[0103]

3)结合相机内参和相机相对于车体坐标系的外参,将图像中被提取的语义特征点投影到车体坐标系下,再结合车辆位姿和定位数据将车体坐标系下的语义特征点投影至地图全局坐标下,同时进行全局坐标系下的语义特征点融入地图数据管理系统的新建和更新。这里的相机内参和相机相对于车体坐标系的外参是已知的并经过精确标定,投影至车辆坐标系下的变换是在假设车辆局部地面平坦的情况下,即车标坐标系下的坐标z值为0,

根据上述关系可以推导出的关系式,其中p

′v为车体坐标系下的点,为图像坐标系下的点。这里的结合车辆位姿和定位数据是通过记录的时间戳将图像和定位信息进行同步,进行位姿的四元数插值计算,得到每一张图像所对应的同一时刻的车辆位姿。根据每张图像所对应的位姿,将车体坐标系下的语义特征点投影到地图全局坐标系下,车体坐标系到全局坐标系的转换关系为同时本发明还采用了一种全新的地图数据管理系统,该系统建立地图数据管理单元nest和bin。nest是以10m*10m*10m为大小的物理世界中的立方体,bin是以5cm*5cm*5cm为大小的物理世界中立方体,最终的地图数据将以这两个单元为基础进行层级管理:

[0104]

nest={(id

x

,idy,idz),{bins}}

[0105]

bin={(id

x

,idy,idz),labelb,votebox}

[0106]

其中id为其立方体中心点在世界坐标系中的坐标除以相应的分辨率,bin中类别标签labelb表示这个单元属于哪一种语义类别,投票箱votebox记录了这个bin被分类为每一种类别的频数,将投票箱内的各个类别被观测到的频次用直方图的形式表示,频次记录最高的类别作为这个bin的类别标签。

[0107]

该地图数据管理系统的优势在于以nest和bin这两种地图数据管理单元,结合数据管理融合算法和动态投票箱内融合算法,可以准确地将地图数据包括各个路面语义标记等表示出来,同时新建与更新机制准确,有利于众包模式在该地图数据管理系统的应用。

[0108]

具体过程包括:

[0109]

3.1)图像坐标系到车体坐标系的投影

[0110]

已知相机内参k和相机坐标系相对于车体坐标系的外参假设图像中某一点坐标为pi=(u,v)

t

,在车体坐标系中的坐标为pv=(xv,yv,zv)

t

,再结合“车辆所处路面局部平坦”这一假设,得到pv=(xv,yv,0)

t

,车体坐标系下路面上的点pv经过归一化后得到左乘得到相机坐标系下该点的归一化坐标即即即可表述为旋转矩阵和平移向量的组合,转矩阵和平移向量的组合,由于矩阵的第三列将与0相乘,因此可化简为可化简为

[0111]

而图像坐标系中的点可以根据相机内参k从相机坐标系下转换得到可以根据相机内参k从相机坐标系下转换得到zi为归一化系数,由于左右两边pi与p

′v均是归一化形式的坐标,故可以统一为归一化参数z。设可以得到

[0112]

3.2)车体坐标系到全局坐标系的投影

[0113]

结合车辆位姿和定位数据,通过记录的时间戳将图像和定位信息进行同步,进行

位姿的四元数插值计算,得到每一张图像所对应的同一时刻的车辆位姿。根据每张图像所对应的位姿,将车体坐标系下的语义特征点投影到地图全局坐标系下,车体坐标系到全局坐标系的转换关系为

[0114]

3.3)融入地图数据管理系统的多次观测数据融合

[0115]

图像中经过语义分割提取出的路面类别标识像素点经过上述图像坐标系到车体坐标系、车体坐标系到世界坐标系(即地图全局坐标系)的两步投影后得到了一个物理世界中的路面语义特征点,其在全局坐标系中的坐标为pg=(xg,y

g,

zg)

t

,以及这个点所属的语义类别(例如属于白色车道线)为labeli。每个点的这些信息抽象为一个数据结构realpoint,成员有世界坐标系下的坐标以及语义类别标签:realpoint={(x,y,z),label},此外建立地图数据管理单元nest和bin。nest是以10m*10m*10m为大小的物理世界中的立方体,bin是以5cm*5cm*5cm为大小的物理世界中立方体,最终的地图数据将以这两个单元为基础进行层级管理。nest={(id

x

,idy,idz),{bins}},bin={(id

x

,idy,idz),labelb,votebox},其中id为其立方体中心点在世界坐标系中的坐标除以相应的分辨率,bin中类别标签labelb表示这个单元属于哪一种语义类别,投票箱votebox记录了这个bin被分类为每一种类别的频数,将投票箱内的各个类别被观测到的频次用直方图的形式表示,频次记录最高的类别作为这个bin的类别标签。

[0116]

语义建图过程中数据管理融合算法流程和动态投票箱对多次观测的融合算法流程如下:

[0117]

[0118][0119]

4)结合上述步骤3)中的地图数据管理系统生成的最终全局语义地图,将其分解成许多个roi输入到本发明提出的拓扑建图神经网络,如图6所示,在语义地图上进行车道拓扑状态的最优解搜索,最后将所有建立拓扑状态的roi结合成完整的拓扑地图。本发明将拓扑图层的构建建模为一个提取有向无环图的最大似然问题,利用神经网络强大的拟合能力去近似有向无环图的概率分布。考虑到网络的输入是图像,且要提取的目标是车道线,它具有形状狭长、连续性强的特性,因此采用卷积神经网络进行全局多尺度特征的提取,采用循环神经网络进行拓扑节点的提取生成。

[0120]

即将拓扑状态的最优解搜索分解为三部分:拓扑建图问题的建模、拓扑节点提取

算法流程、拓扑建图网络整体架构。

[0121]

4.1)拓扑建图问题的建模

[0122]

本发明将车道线级别的所述拓扑地图的建图(简称拓扑建图)抽象为一个有向无环图的搜索和构建,有向无环图中的节点编码了车道线的位置和方向属性,连接节点的边表示了拓扑连接关系,但由于在整个所述全局语义地图上以有向无环图的形式进行精确的拓扑地图搜索的计算量和成本是相当巨大的,进而将其转化为可以用深度神经网络进行优化的最大似然问题,问题描述如下:

[0123]

输入的语义图层定义为期望的网络输出是将车道线结构化表示的有向无环图g。其中g=(v,e),v表示图中节点的集合,e表示图中边的集合。每个节点vi=(xi,θi,si)编码了节点所处局部的几何和拓扑属性。xi表示了该节点所处的位置,θi表示了节点所指方向,si表示了节点的拓扑状态。在这里定义四种拓扑状态:

[0124]

(a)正常状态:该节点只有一个父节点和一个子节点;

[0125]

(b)分叉状态:该点有一个父节点和两个子节点,车道线在这个节点处分叉出两根独立的车道线;

[0126]

(c)合并状态:该节点有两个父节点和一个子节点,两根车道线在这个节点处合并为一根车道线;

[0127]

(d)结束状态:该节点为当前车道线的终点,对应了路口遇到停止线的状态。

[0128]

此外定义v

c(i)

为节点vi的子节点,v

p(i)

为节点vi的父节点。当vi节点为分叉点的时候,子节点v

c(i)

的数量有2个,当vi节点为合并点的时候,父节点v

p(i)

的数量有2个,当vi节点为结束点的时候,子节点v

c(i)

的数量有0个。

[0129]

给定输入语义地图后,目标是在所有可能的有向无环图g的解空间中找到概率最大的一个,也就构建成了最大似然问题:

[0130][0131]

由于g是由若干节点和边组成的有向无环图,因此可以联合概率分布的方式表示如下:

[0132][0133]

其中每一项条件概率又可以被拆解成节点的三个组成元素,即位置、方向、拓扑状态的条件概率连乘:

[0134][0135]

上述最大似然问题被建模成深度神经网络的形式进行最优解的搜索,由于车道线具有狭长,连续性强的特性,因此搭建了以卷积神经网络(convolution neural network,cnn)和循环神经网络(recursive neural network,rnn)相结合的网络结构求解这一问题。

[0136]

4.2)拓扑节点提取算法流程

[0137]

按照上述拓扑建图的建模方式,要在几乎无穷多可能的解空间中找到最合适的有向无环图,直接暴力搜索低效且无法实现,为此构建了一种贪心算法用于提取拓扑关系。

[0138][0139]

4.3)拓扑建图网络整体架构

[0140]

在将拓扑图层的构建建模为一个提取有向无环图的最大似然问题后,本发明利用神经网络强大的拟合能力去近似有向无环图的概率分布。考虑到网络的输入是图像,且要提取的目标是车道线,它具有形状狭长、连续性强的特性,因此采用卷积神经网络进行全局多尺度特征的提取,采用循环神经网络进行拓扑节点的提取生成。

[0141][0142]

在完成上述四个步骤后,高精度地图的语义拓扑层构建完毕。综上可知,本发明以搭建高精度地图的建图框架为基础,提出以车载视觉和定位系统作为感知信息来源的自动化高精度地图算法。目的是使用尽可能低的硬件成本,尽可能低的人力成本,尽可能高的自动化程度进行高精度地图中两个最重要的图层的构建——语义图层和拓扑图层。使用到的方法涉及基于视觉的语义分割路面标记提取、基于视觉和定位信息的自动化语义建图以及基于语义地图的自动化拓扑建图。采用本发明提出的方法,能够构建出相对精度达99%的语义地图,并且设计了支持低成本传感器的众包融合策略,拓扑地图的位置精度和拓扑关系正确率也高达90%以上。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。