技术特征:

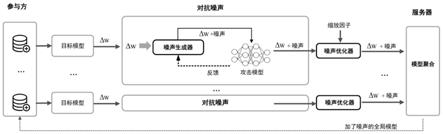

1.一种基于对抗性干扰的联邦学习成员推理攻击防御方法,其特征在于,包括以下步骤:步骤1:根据参与者数量将训练数据集和测试数据集平均划分成份,得到和将划分后的数据分配给各个参与者每个参与者使用自己拥有的数据训练本地模型并得到模型参数;步骤2:参与者训练攻击模型,让噪声生成器和攻击模型不断进行交互,得到使攻击模型对加噪声的本地模型攻击准确率趋近于50%的最小噪声,使攻击模型无法区别某一条数据是否是训练本地模型时使用的训练数据;步骤3:服务器利用噪声优化器根据式4和式5得到噪声的缩放因子,并随机发送给各个参与者;参与者利用缩放因子缩放噪声,将噪声加入本地模型参数并发送给服务器:参与者;参与者利用缩放因子缩放噪声,将噪声加入本地模型参数并发送给服务器:其中,m为参与者数量,γ1,γ2,

…

,γ

m

分别是m个参与者产生的噪声的缩放因子;x为一个变量,根据参与者数量m计算得到;步骤4:服务器接收所有参与者发送的模型参数,并对这些模型参数求平均值,将平均后的模型参数作为新的全局模型参数;步骤5:服务器将全局模型参数发送给所有参与者,使参与者更新本地模型,至此,完成了联邦学习模型训练的一个轮次;重复步骤1至步骤5,直到达到设置的指定训练轮次,从而完成可防御成员推理攻击的联邦学习模型训练,利用该模型实现防御成员推理攻击。2.如权利要求1所述的一种基于对抗性干扰的联邦学习成员推理攻击防御方法,其特征在于,方法基于联邦学习成员推理攻击防御模型如下:包括联邦学习训练模型成员推理攻击防御模型和模型数据其中,联邦学习训练模型是参与联邦学习本地模型训练的参与者的集合和参与联邦学习模型聚合与分发的服务器的并集,即,的并集,即,的并集,即,为中参与者个数;联邦学习训练模型中的参与者与服务器,基于平均聚合的算法,共同合作训练机器学习模型,其中,平均聚合是指服务器对接收的全部模型参数求平均值,并将该平均值作为新的全局模型的模型参数;成员推理攻击防御模型是攻击模型噪声生成器和噪声优化器的并,即,其中,攻击模型是为了进行成员推理攻击而训练的模型,它通过对参与者训练的本地模型进行成员推理攻击来推断该模型被成员推理攻击成功的概率,即,受到成员推理攻击的风险;噪声生成器负责与攻击模型进行交互,首

先根据本地模型参数值初始化噪声,并将其加入参与者训练好的本地模型中,然后使用攻击模型攻击该加噪声模型,当攻击模型对加噪声模型进行攻击得到的攻击准确率较高时,噪声生成器增大生成的噪声,当攻击模型对加噪声模型进行攻击得到的攻击准确率较低时,噪声生成器减小生成的噪声,噪声生成器根据攻击模型的反馈修改生成的噪声,从而得到精心设计的对抗噪声,最终实现训练的目标模型在最大化降低成员推理攻击准确率的同时尽量降低模型准确率的损失;使用噪声优化器对噪声进行优化,即,确定每个参与者在本地模型参数上所加噪声的缩放因子,使聚合的全局模型中的噪声与参与者数量无关,进而保证目标模型的模型准确率;攻击模型噪声生成器和噪声优化器的关系为:参与者训练使和不断进行交互,最终使生成抵御成员推理攻击的最小噪声,之后利用确定噪声的缩放因子,最后将缩放后的噪声加入本地模型参数并将加噪声参数发送给服务器;联邦学习训练模型和成员推理攻击防御模型的关系为:参与者和服务器根据进行联邦学习模型训练,每个参与者利用本地数据训练好本地模型后使用构造精心设计的噪声并对噪声进行优化,服务器使用根据参与者数量计算缩放因子并随机发送给各个参与者,参与者根据缩放因子缩放噪声并添加到本地模型参数中,然后按照继续执行联邦学习模型训练,此为联邦学习的一个轮次,之后,重复以上流程,直至模型训练终止;其中,模型数据的数据集合为其中,模型数据的数据集合为集合中的元素代表着每条数据的序号;数据集中共有条数据,包括用于参与者本地训练模型的训练数据集和用于测试模型的测试数据集即即即是训练数据集中的数据数量,是测试数据集中的数据数量;模型数据与联邦学习训练模型的关系具体为:参与者集合中第i个参与者拥有的训练数据集合表示为测试集合表示为集合是的子集,集合是的子集,即模型数据中的训练数据集被平均分成份并分别被个参与者所拥有,模型数据中的测试数据集被平均分成份并分别被个参与者所拥有,即且且且i大于等于1且小于等于3.如权利要求1所述的一种基于对抗性干扰的联邦学习成员推理攻击防御方法,其特征在于,步骤2包括以下步骤:步骤2.1:利用信噪比snr,根据式1、式2和式3生成符合高斯分布的噪声向量:首先,设置最小信噪比snr

min

和最大信噪比snr

max

,其中,snr

min

使生成的噪声为0,snr

max

使生成的噪声接近本地模型的参数;然后,取并使用此信噪比根据式1、式2和式3生成一个初始化噪声;噪声;噪声;其中,n为本地模型参数,snr是控制生成的噪声大小的信噪比,ps代表原始信号强度,pn代表噪声信号强度,指根据信噪比生成的噪声noise符合均值为0,标准差为的高斯分布的噪声,n表示高斯分布;步骤2.2:将初始化噪声加入本地模型参数中,使用ml_privacy_meter工具训练攻击模型;每个参与者从本地拥有的条训练数据中选择条数据,从条测试数据中选择条数据,将包括数据集和加噪声模型、攻击模型训练数据和测试数据的划分比例、成员推理攻击使用加噪声模型选定层的选定信息在内的配置信息,输入到ml_privacy_meter工具;该工具把条数据输入加噪声模型,从模型指定层得到的信息作为特征,标签为1,从而得到成员数据集;把条数据输入加噪声模型,将从模型指定层得到的信息作为特征,标签为0,从而得到非成员数据集;然后,按照训练数据和测试数据的划分比例,从成员数据集和非成员数据集中分别选择设定比例的数据汇总到一起,作为攻击模型的训练数据集,将剩余数据汇总到一起,作为攻击模型的测试数据集,从而对加噪声模型训练攻击模型并进行成员推理攻击,得到攻击准确率;步骤2.3:使用攻击模型攻击该加噪声模型后,根据攻击模型反馈不断修改snr,使最终攻击模型的攻击准确率尽可能趋近50%。4.如权利要求3所述的一种基于对抗性干扰的联邦学习成员推理攻击防御方法,其特征在于,步骤2.3包括以下步骤:步骤2.3.1:当使用攻击模型攻击该加噪声的本地模型,得到该模型受到成员推理攻击的风险之后,对该风险值进行判断:如果该风险大于0.5 ε,则说明生成的噪声太小,此时噪声生成器增大最小信噪比snr

min

,snr的值越小,生成的噪声的范数越大;如果该风险小于0.5

‑

ε,则生成的噪声太大,此时噪声生成器减小最大信噪比snr

max

;其中,ε是设置的攻击模型准确率偏离0.5的阈值,该阈值的设置使攻击模型对添加了

最终噪声的本地模型的攻击准确率能够尽可能接近50%;步骤2.3.2:取使用此更新后的信噪比,根据式1、式2和式3生成新的噪声;步骤2.3.3:重复步骤2.3.1至步骤2.3.2,不断根据攻击模型的反馈修改最小信噪比snr

min

和最大信噪比snr

max

,使逼近想要的取值,直至达到设置的轮次。

技术总结

本发明涉及一种基于对抗性干扰的联邦学习成员推理攻击防御方法,属于机器学习中的联邦学习隐私保护技术领域。本方法建立了一种联邦学习成员推理攻击防御机制,在每次参与者上传利用本地数据训练好的模型参数之前,向模型参数中添加精心设计的对抗性干扰,使攻击者针对使用此种防御机制训练出来的模型进行成员推理攻击后得到的攻击准确率尽可能趋近50%,尽可能降低对目标模型性能的影响,从而同时满足联邦学习场景中用户数据隐私保护和协同训练高性能模型的需求。练高性能模型的需求。练高性能模型的需求。

技术研发人员:沈蒙 魏雅倩 王焕 祝烈煌

受保护的技术使用者:北京理工大学

技术研发日:2021.08.30

技术公布日:2021/12/14

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。