image dehazing.proceedings of the aaai conference on artificial intelligence,34(07),11908

‑

11915.(icip).ieee,2020:923

‑

927]更是在reside数据集上达到了36.39dbpsnr,但这些方法都仅仅考虑了解空间的上界而忽略了下界,因此,还原的图片中往往还存在部分雾残留,颜色失真等问题。

技术实现要素:

5.本发明的目的在于针对现有去雾方法没有充分考虑解空间的下界,以及模型参数量大的问题,提出一种基于对比学习的紧凑深度学习去雾方法。该方法有效提升了去雾性能以及图片复原质量,同时大大降低了模型参数量。

6.实现本发明目的的具体技术方案是:

7.一种基于对比学习的紧凑深度学习去雾方法,该方法包括:

8.步骤1:数据集准备与预处理

9.1.1)收集成对的雾图和清晰图作为图像对,雾图和清晰图的内容一致,不同在于雾图的部分区域被雾遮挡导致纹理颜色模糊和损坏;图像对的文件格式为png,分辨率均相同;收集好图像对后,以8:2的比例划分为训练集和测试集;

10.1.2)将所述训练集图片进行数据增广,增广方式为随机翻转和随机裁剪;

11.步骤2:深度去雾模型特征提取与复原

12.2.1)深度去雾模型由下采样模块、特征提取模块和上采样模块组成,其中下采样模块由3层卷积组成,通过设置卷积的参数即卷积核、步长,实现把原始输入图片缩小4倍,对应的,下采样模块由3层卷积构成,用来把特征进行上采样,达到放大4倍的效果;最终,特征经过所述的下采样和上采样4倍,输出的图片大小恢复成与原始输入图片的大小一致;

13.2.2)特征提取模块用于深度特征提取,特征特征模块设于下采样模块后,使得网络的大量操作集中在小分辨率的特征空间内;其包含2个子模块,分别为注意力模块和可变形卷积模块;

14.2.3)将步骤1处理好的训练集数据作为深度去雾模型的输入,分别经过下采样模块,特征提取模块和上采样模块,最后得到3通道的复原图片;

15.步骤3:计算图片重建损失函数值

16.3.1)计算步骤2获得的预测复原图片与清晰图的重建损失函数值,公式(1)定义了深度去雾模型的重建损失函数,目的用于衡量深度去雾模型输出的结果与原始标签值的误差;

17.l1(φ(i,w),j)=min|j

‑

φ(i,w)|1ꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(1)

18.其中i表示输入雾图,j表示与输入雾图对应的清晰图,φ(

·

)表示深度去雾模型,w表示深度去雾模型参数,φ(i,w)表示深度去雾模型的输出;

19.步骤4:计算对比正则函数值

20.4.1)将输入的雾图、用于监督的清晰图以及步骤2得到的预测复原图片分别输入到预训练的vggnet19模型中,提取其中第1层,第3层,第5层,第9层和第13层的高维特征;

21.4.2)计算对比正则函数值;采用公式(2)定义对比正则,使深度去雾模型复原的结果靠近清晰图而远离雾图;

[0022][0023]

其中g

i

(

·

)表示预训练的vggnet19模型和深度去雾模型,g

i

(φ(i,w)),g

i

(j)和g

i

(i)分别表示去雾模型的输出即锚点、清晰图即正样本和雾图即负样本分别经过预训练的vggnet19模型后获得的高维表示;ω

i

表示vggnet19模型选定层特征的权重;

[0024]

步骤5:训练模型

[0025]

5.1)根据所述重建损失函数、对比正则函数的函数值和训练参数在所述训练集上训练深度去雾模型;其中,所述训练参数:学习速率为0.0002;

[0026]

5.2)当所述深度去雾模型迭代次数小于所设置的阈值时,停止训练;

[0027]

5.3)通过预留的测试集对所述的深度去雾模型进行测试,并根据测试结果确定测试精度,所述测试精度包括峰值信噪比(psnr)和结构相似度(ssim)两个指标,其中结构相似度(ssim)的数值范围为[

‑

1,1],峰值信噪比和结构相似度的数值越大表明复原效果越好。

[0028]

步骤2中所述的注意力模块是基于两种注意力层的组合:通道级注意力和像素级注意力;其中,通道级注意力计算特征的每个通道的权重,而像素级注意力则计算特征的每个像素的权重,二者都将计算得到的权重乘以原始特征,得到新的特征;二者的组合方式为级联。

[0029]

所述步骤3和步骤4是同时进行,并以加权求和的方式进行计算,其中重建损失函数的权重为1,对比正则函数的权重为0.1。

[0030]

本发明具有以下突出优点:

[0031]

本发明提出了一种新的针对去雾问题的损失函数,该损失函数基于对比学习,不仅考虑了解空间的上界,还约束了解空间的下届。实验表明,该函数可以有效地避免伪影和颜色失真,使复原的清晰图更加真实和自然。此外,本发明提出了一种兼顾参数量和性能的深度去雾模型,通过设计和使用一种自适应的特征混合操作和动态卷积模块,在取得优越的性能的同时仅使用了同比其他方法更少的参数量。

[0032]

本发明带来的有益效果:

[0033]

本发明提出一种新的基于对比学习的对比正则,使用该正则可以将去雾问题的解空间的下界进行约束,使得复原的图片更加靠近对应的清晰图。此外,实验表明,对比现有的其他方法,本发明在处理伪影和颜色失真上具有优越性。

[0034]

本发明充分兼顾性能和模型参数量,通过提出自适应混合特征和动态融合模块以更少的参数量来提取更多的信息。在获得高性能的同时,精简模型参数量,使得在实际运用中更加简单高效。

附图说明

[0035]

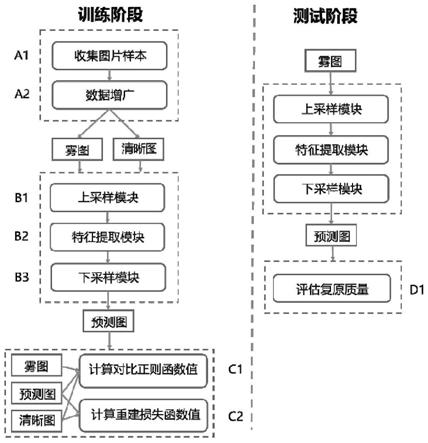

图1为本发明流程图;

[0036]

图2为本发明含深度去雾模型结构的流程图;

[0037]

图3为本发明可变形卷积模块图;

[0038]

图4为本发明部分复原效果图;

[0039]

图5为本发明提出的对比正则效果图。

具体实施方式

[0040]

为了便于理解,以下结合附图对本发明进行详细说明。

[0041]

本发明的具体流程如图1所示,在训练阶段中,主要分为数据集预处理、模型去雾和损失函数计算三部分。

[0042]

a1:本发明使用的数据集为公开数据集reside、dense

‑

haze和nh

‑

haze,包括了合成数据集(reside)和真实数据集(dense

‑

haze和nh

‑

haze[),室内场景和室外场景。reside数据集包含5个子集(its、ots、sots、rtts和hsts),在本发明中使用its子集,包含室内场景的13990成对图(雾图和清晰图)作为训练集,使用sots子集的500张室内成对图作为测试集。dense

‑

haze数据集包括50张真实雾场景下拍摄的图片对,其特点是雾分布密集,是极端的雾场景,图片纹理严重损坏。在本发明中,使用45张为训练集,5张为测试集。nh

‑

haze数据集包括50张真实雾场景下的雾图对(其中5张未公开清晰图),其特点是雾分布不均匀。在本发明中,使用40张为训练集,5张为测试集;

[0043]

a2:在训练过程中,对所有的训练集图片进行预处理以增加模型的泛化能力,主要包括缩放图片到256x256的分辨率,水平垂直翻转等。

[0044]

b1:下采样模块由3层卷积组成,通过设置卷积的参数(卷积核、步长等)实现下采样4倍的目的;

[0045]

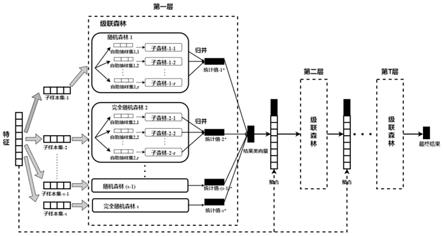

b2:特征提取模块由6个注意力层和2个可变形卷积组成。其中注意力模块是将通道级注意力模块和像素级注意力模块以级联的方式组合而成,将计算出的权重乘以原始的特征而得到新的特征。而可变形卷积则如图3所示,具有学习更灵活的卷积核的能力。本发明将2个可变形卷积以串联的方式组合成动态融合模块(参阅图2);

[0046]

b3:与b1具有对称的结构,输出是上采样4倍的特征,最后输出的通道数为3。

[0047]

c1:为了保证去雾模型的输出尽可能地接近对应的清晰图,本发明采用重建损失函数(公式(1))来对模型进行约束;

[0048]

其中φ(i,w)表示去雾网络的输出,j表示与输入雾图对应的清晰图;

[0049]

c2:仅用重建损失来约束去雾模型往往会出现伪影和颜色失真,针对这一问题,本发明提出了一种新颖的基于对比学习的对比正则。对比学习指的是给定一个样本(假设为锚点),使其靠近正样本,远离负样本。在本发明中,去雾模型的复原结果为锚点,输入的雾图为负样本,对应的清晰图为正样本,组成一个三元组,输入到预训练的vggnet19模型使得锚点、正样本和负样本都在同一个高维空间。最后本发明提出了一个新颖的对比正则,使得复原的结果靠近正样本,而远离负样本。具体地,公式(2)定义了本发明提出的对比正则,目的是使模型复原的结果靠近清晰图而远离雾图。

[0050]

深度去雾模型的具体结构如图2所示。

[0051]

训练期间,本发明使用一个总损失函数进行训练。公式(3)定义了本发明训练模型的总损失函数,目的是用于训练模型。

[0052]

loss=α1*l1(φ(i,w),j) α2*cr(g

i

(φ(i,w)),g

i

(j),g

i

(i))

ꢀꢀꢀ

(3)

[0053]

其中α1,α2分为为损失权重,在本发明中分别设置为1和0.1,cr为公式(2)。使用1张nvidia titan rtx gpu,使用adam作为优化器(β1=0.9,β2=0.999),学习率初始化为0.0002,采用cosine退火策略进行学习率调整。

[0054]

d1:计算去雾模型的输出的复原图的psnr和ssim值。

[0055]

具体实验结果

[0056]

目前,图像复原质量的评价指标通常使用峰值信噪比(psnr)和结构相似度(ssim)来衡量。二者的数值越高,表示两张图片越接近。在本发明中,通过计算本发明提出的方法复原的图片与对应清晰图的psnr和ssim来衡量本发明的性能。本发明在3个公开数据集上进行测试,分别为sots、dense

‑

haze和nh

‑

haze,同时对6种现有去雾方法进行对比。测试结果如表1。

[0057]

表1本发明与现有方法在3个数据集上的性能对比

[0058][0059]

本发明在sots和nh

‑

haze上都获得了最好的性能,在dense

‑

haze上获得了最好的psnr,ssim虽然比msbdn稍差,但msbdn的模型参数量是本发明的12倍。

[0060]

在视觉效果上,本发明提出的方法也具有优越性。如图4所示,图中(a)为雾图,(b)复原图,(c)为清晰图,本发明在室内场景,室外场景均可获得不错的结果。不仅如此,本发明提出的对比正则可以显著地避免伪影和颜色失真。如图5所示,图5(a)为雾图,图5(b)为仅用重建损失图,图中可以看出仅仅使用重建损失时,可能会带来黑色的伪影和颜色失真,图5(c)为本发明提出的对比正则可以显著地避免图5(b)的情况,更加接近清晰图,图5(d)为清晰图。

[0061]

此外,本发明提出的对比正则也具有泛化性。如表2所示,把本发明提出的对比正则增加到现有深度学习方法中,均可带来性能提升。

[0062]

表2对比正则的泛化性

[0063]

方法psnrssimgriddehazenet32.99(

↑

0.83)0.9863(

↑

0.0027)ffa

‑

net36.74(

↑

0.35)0.9906(

↑

0.0020)kddn35.18(

↑

0.46)0.9854(

↑

0.0009)msbdn34.45(

↑

0.66)0.9861(

↑

0.0021)

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。