1.本发明属于语言事件检测技术领域,特别是涉及一种基于可迁移异构图的多语言事件检测方法。

背景技术:

2.随着世界互联进程的推进,使用不同语言的人们逐渐在社交媒体上融为了一体,大家围绕同一个事件发表各自看法的现象已经尤为普遍。这就迫切需要建立一个服务于多语言场景的模型来克服已有的各种事件检测模型仅面向单一语言的禁锢。

3.大多数现有的学习clwe(cross

‑

lingual word embeddings)的方法,包括带有上下文嵌入的方法,都是感觉不可知的。以往的工作大多都基于静态嵌入对齐,但那种粗粒度的对齐方式显然是亟待改进和提升的。

4.在多语言社交事件数据中提取的实体是基于各种不同语言的,这意味着同一个实体可能有不同语言的不同表示,这给用多语言捕捉消息之间的关系带来了很大的挑战性。而当前的技术方案中,更多的是基于两种语言之间或仅限于有限的几种高资源语言的跨语言事件检测方法。

5.传统机器学习的方法需要目标语言的语料支持,而低资源语言的带标注数据不足,不适用于跨语言事件检测。对于基于迁移学习思想的跨语言事件检测方法,一些低资源语言的领域间的概率分布差异较大,会导致严重的负迁移问题;微调的幅度不容易把握,可能出现过度调整或调整程度不足,使模型损失值较大。对于元学习方式,当任务变得更大时,逐对比较导致计算上成本昂贵;无法应用到监督学习之外的场景。目前低资源语言的社交事件检测任务存在着很大的空缺,多数低资源语言无法实现向高资源语言的高效转换。

技术实现要素:

6.为了解决上述问题,本发明提出了一种基于可迁移异构图的多语言事件检测方法,能够实现面向包括大量低资源语言在内的多语言的社交事件检测,提高检测精准度。

7.为达到上述目的,本发明采用的技术方案是:一种基于可迁移异构图的多语言事件检测方法,包括步骤:

8.s10,在多语言社交信息流中,读取社交信息的节点,构建多个单语言异构信息图;

9.s20,对所有单语言异构信息图进行节点级对齐和语义级对齐,获得多语言异构信息图;

10.s30,聚焦于学习消息之间的相关性,通过消息的公共邻居将多语言异构信息图转换为多语言同构信息图;

11.s40,对最终的多语言同构消息图进行聚类,产生消息簇并将其输出,即为检测得到的社交事件。

12.进一步的是,在多语言社交信息流中,读取社交信息的关联用户、命名实体、标签、消息四种类型的节点,构建多个单语言异构信息图,并根据其所用语言将其分为英语异构

信息图及非英语异构信息图。

13.进一步的是,根据英语异构信息图及非英语异构信息图,进行节点级对齐和语义级对齐,将同一实体的不同表示合并在一起,构成多语言异构信息图。

14.进一步的是,基于跨语言命名实体词典挖掘不同的跨语言实体对,将非英语实体转换为英语,从而将同一实体的不同表示合并在一起;对于不同的语言,消息的初始表示在不同的嵌入空间;利用跨语言模型来获得英语语义空间中的非英语消息表示;

15.采用一个两层多头gat网络作为gnn编码器,并使用对比损失三元组进行反向传播,对得到的非英语异构信息图进行跨语言的转换,获得英语语义空间中的其他语言消息表示。

16.进一步的是,利用clwe跨语言单词嵌入方法,通过非线性或线性映射的方式进行跨语言的转换,在知识蒸馏的指导下完成跨语言模型的训练学习过程。

17.进一步的是,对于线性映射,假设源和目标嵌入空间近似同构,采用基于线性投影的clwe方法学习源空间和目标空间之间的矩阵,目的是学习源空间和目标空间之间的矩阵w,使得w=||wx

‑

y||,其中x和y分别表示源词嵌入和目标词嵌入;具体包括步骤:

18.步骤一:对于已知的n个单词对{x

i

,y

i

}

i∈{1,n}

组成的字典,利用单词嵌入空间之间的相似性来学习这种线性映射w;

19.步骤二:对于每一个没有翻译的单词s,通过找最近邻的方式找到对应的映射单词;利用muse词汇归纳方法在不使用任何并行语料库的情况下,通过无监督方式对齐单语单词嵌入空间,在两种语言之间构建双语词典;

20.步骤三:对于源语言单词嵌入{x1,x2,...,x

n

}和目标语言嵌入{y1,y2,...,y

m

},引入生成对抗网络学习w,训练模型从wx={wx1,wx2,...,wx

n

}和y中采样的元素;并通过最小化目标函数进行优化;

21.对于非线性映射,具体步骤如下:

22.步骤一:为每种语言分配一个自动编码器,每个自动编码器都包含一个编码器和解码器;自动编码器是非线性的,其中每个编码器和解码器都是具有两个非线性隐藏层的三层前馈神经网络;

23.步骤二:自动编码器以自我监督的方式独立训练,归纳相应语言的潜在空间;

24.步骤三:使用具有反向翻译和源嵌入重构约束的有监督非线性变换学习;使用种子字典来学习以前馈神经网络的方式实现的非线性映射。

25.进一步的是,所述知识蒸馏包括离线策略,非英语事件检测网络构成的从属图神经网络和大规模英语数据集上预先训练网络构成的主图神经网络共享同一个网络结构;在从属图神经网络训练阶段从具有真实标签的数据中学习知识,并从主图神经网络中获取探索知识;包括步骤:

26.步骤一:用英语社交事件数据训练主网络;

27.步骤二:对于处理后的非英语语言消息图g(x

s

,a

s

),利用跨语言模块学习从非英语语言到英语语言的映射过程,获得英语语义空间x

s

→

t

下的转换后的初始消息属性特征,来消除当非英语数据输入到为英语数据指定的预训练网络型时的语言障碍;

28.步骤三:将总损失设置为知识蒸馏损失与基于真实标签的损失这两部分加权之和,用于从属网络训练的反向传播。

29.进一步的是,所述知识蒸馏包括在线策略,采用相互连通的第一对等体图神经网络训练和第二对等体图神经网络,两个网络互相利用知识,两个网络都通过其对等网络的辅助训练得到了增强,具体包括步骤:

30.步骤一:分别为第一对等体图神经网络和第二对等体图神经网络的训练指定已处理的单语社交事件检测数据g(x

p1

,a

p1

)和g(x

p2

,a

p2

);

31.步骤二:通过跨语言模型得到对第二对等体图神经网络语言语义空间g(x

p1

→

p2

,a

p1

)中的对第一对等体图神经网络转换后数据以及对第一对等体图神经网络语言语义空间g(x

p2

→

p1

,a

p1

)中的对第二对等体图神经网络转换后数据,消除不同语种之间的语言障碍;

32.步骤三:对于对第一对等体图神经网络的训练,同时将g(x

p1

,a

p1

)和g(x

p1

→

p2

,a

p1

)分别输入第一对等体图神经网络和第二对等体图神经网络,相应的输出为h

p1

和h

p1

→

p2

;使用h

p1

→

p2

作为第一对等体图神经网络的额外监控信号,通过来自同伴的隐性知识来进一步训练第一对等体图神经网络;将第一对等体图神经网络的总损失设置为基于数据中的真实标签的相应三元组损失和通过两个学生网络输出的最终表征的差异计算的相应知识提取损失的加权之和用于第一对等体图神经网络训练网络的反向传播;

33.步骤四:对于对第二对等体图神经网络的训练,同时将g(x

p2

,a

p2

)和g(x

p2

→

p1

,a

p1

)分别输入第二对等体图神经网络和第一对等体图神经网络,相应的输出为h

p2

和h

p2

→

p1

;使用h

p2

→

p1

作为第二对等体图神经网络的额外监控信号,通过来自同伴的隐性知识来进一步训练对第二对等体图神经网络;将对第二对等体图神经网络的总损失设置为基于数据中的真实标签的相应三元组损失和通过两个学生网络输出的最终表征的差异计算的相应知识提取损失的加权之和,用于对第二对等体图神经网络训练网络的反向传播。

34.进一步的是,在多语言社交信息流中不断读取新的社交信息,重复s10到s30,使事件检测模型不断地适应输入数据以检测新事件并更新模型的知识。

35.进一步的是,采用k

‑

means或者dbscan聚类算法对最终的多语言同构消息图进行聚类,产生消息簇并将其输出,即为检测得到的社交事件。

36.采用本技术方案的有益效果:

37.本发明通过在多语言社交信息流中,读取社交信息的节点,构建多个单语言异构信息图;对所有单语言异构信息图进行节点级对齐和语义级对齐,获得多语言异构信息图;聚焦于学习消息之间的相关性,通过消息的公共邻居将多语言异构信息图转换为多语言同构信息图;对最终的多语言同构消息图进行聚类,产生消息簇并将其输出,即为检测得到的社交事件;能够实现面向包括大量低资源语言在内的多语言的社交事件检测,提高检测精准度。

38.本发明应用节点级对齐和语义级对齐两种对齐技术,减弱多语言社交事件之间的语言障碍,更好地建立统一的多语言社交图。提出在线策略的相互学习过程,将两个学生网络中的知识结合在一起,克服了教师网络信息不足的困难;在教师网络信息充足时,也能够做出更全面和信息更丰富的决定。

39.本发明利用跨语言单词嵌入方法,通过非线性或线性映射的方式进行跨语言的转换,在知识蒸馏的指导下完成跨语言模型的训练学习过程,从而实现面向包括大量低资源语言在内的多语言的社交事件检测,特别解决低资源语言无法实现向高资源语言的高效转换的问题。

40.现实中的社交流具有以下特点:按顺序生成、数量巨大、包含各种类型元素(文本、时间、标签和隐含的社交网络结构)、元素语义变化快速。现有大部分的检测算法大多无法同时满足这些条件,具体来说,如果使用词频和共现等统计特征来识别事件,在某种程度上容易忽略社交流中包含的丰富语义和结构信息;而模型中参数较少则会导致不能记住之前学过的信息,随着时间流逝忘记部分消息。本发明生命周期方法既能从数据中获取知识,又能保存以前学习的知识,还能不断适应输入的数据,更加符合检测现实中的社交流中不断更新的社交事件的需求。

附图说明

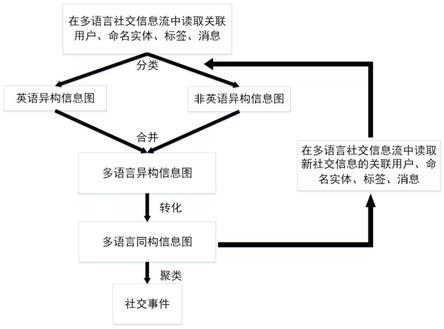

41.图1为本发明的一种基于可迁移异构图的多语言事件检测方法的流程示意图;

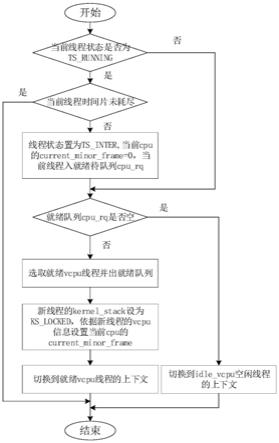

42.图2为本发明实施例中异构图分析过程的原理示意图;

43.图3为本发明实施例中跨语言线性和非线性映射方式的原理示意图;

44.图4为本发明实施例中跨语言知识蒸馏框架中离线策略的原理示意图

45.图5为本发明实施例中跨语言知识蒸馏框架中在线策略的原理示意图。

具体实施方式

46.为了使本发明的目的、技术方案和优点更加清楚,下面结合附图对本发明作进一步阐述。

47.在本实施例中,参见图1和图2所示,本发明提出了一种基于可迁移异构图的多语言事件检测方法,包括步骤:

48.s10,在多语言社交信息流中,读取社交信息的节点,构建多个单语言异构信息图;

49.s20,对所有单语言异构信息图进行节点级对齐和语义级对齐,获得多语言异构信息图;

50.s30,聚焦于学习消息之间的相关性,通过消息的公共邻居将多语言异构信息图转换为多语言同构信息图;

51.s40,对最终的多语言同构消息图进行聚类,产生消息簇并将其输出,即为检测得到的社交事件。

52.作为上述实施例的优化方案,在多语言社交信息流中,读取社交信息的关联用户、命名实体、标签、消息四种类型的节点,构建多个单语言异构信息图,并根据其所用语言将其分为英语异构信息图及非英语异构信息图。根据英语异构信息图及非英语异构信息图,进行节点级对齐和语义级对齐,将同一实体的不同表示合并在一起,构成多语言异构信息图。

53.作为上述实施例的优化方案,基于跨语言命名实体词典挖掘不同的跨语言实体对,将非英语实体转换为英语,从而将同一实体的不同表示合并在一起;对于不同的语言,消息的初始表示在不同的嵌入空间;利用跨语言模型来获得英语语义空间中的非英语消息表示;

54.采用一个两层多头gat网络作为gnn编码器,并使用对比损失三元组进行反向传播,对得到的非英语异构信息图进行跨语言的转换,获得英语语义空间中的其他语言消息表示。

55.利用clwe跨语言单词嵌入方法,通过非线性或线性映射的方式进行跨语言的转换,在知识蒸馏的指导下完成跨语言模型的训练学习过程。

56.在节点层面,考虑到在多语言社交事件数据中提取的实体是基于各种不同语言的,这意味着同一个实体可能有不同语言的不同表示,这给用多语言捕捉消息之间的关系带来了很大的挑战性。本发明基于跨语言命名实体词典挖掘超过164个不同的跨语言实体对,跨越120个语言对,根据这些词汇将非英语实体转换为英语,从而将同一实体的不同表示合并在一起。在语义层面,对于不同的语言,消息的初始表示在不同的嵌入空间。为了打破这种语言障碍,比如对于法语和阿拉伯语消息的属性特征,利用跨语言模型来获得英语语义空间中的法语和阿拉伯语消息表示。采用一个两层多头gat网络作为gnn编码器,并使用对比损失三元组进行反向传播,对第一步中得到的非英语的单语言异构信息图进行跨语言的转换,获得英语语义空间中的其他语言消息表示。针对某个社交事件,当教师语言信息很少甚至缺失时,便可以考虑使用在线策略的相互学习过程。例如,对于事件a,其节点几乎全部分布在法语语义空间与阿拉伯语语义空间中便可以对法语语义空间与阿拉伯语语义空间进行相互学习,从而能够做出更全面和信息更丰富的决定。

57.如图3所示,其中,对于线性映射,假设源和目标嵌入空间近似同构,采用基于线性投影的clwe方法学习源空间和目标空间之间的矩阵,目的是学习源空间和目标空间之间的矩阵w,使得w=||wx

‑

y||,其中x和y分别表示源词嵌入和目标词嵌入;具体包括步骤:

58.步骤一:对于已知的n个单词对{x

i

,y

i

}

i∈{1,n}

组成的字典,利用单词嵌入空间之间的相似性来学习这种线性映射w:其中d是嵌入维数,是d

×

d维的实数矩阵空间;x和y分别表示源词嵌入和目标词嵌入,是两个尺寸为d

×

n的对齐矩阵,包含单词在并行词汇表中的嵌入;f范数定义;

59.步骤二:对于每一个没有翻译的单词s,通过找最近邻的方式找到对应的映射单词:t=argmin

t

cos(wx

s

,y

t

);利用muse词汇归纳方法在不使用任何并行语料库的情况下,通过无监督方式对齐单语单词嵌入空间,在两种语言之间构建双语词典;

60.步骤三:对于源语言单词嵌入{x1,x2,...,x

n

}和目标语言嵌入{y1,y2,...,y

m

},引入生成对抗网络学习w,训练模型从wx={wx1,wx2,...,wx

n

}和y中采样的元素;

61.一方面,最小化目标函数:

62.最大化鉴别器识别出嵌入源的能力;

63.另一方面,最小化目标函数:

[0064][0065]

,使w近似wx和y,鉴别器正确识别出嵌入源。

[0066]

对于非线性映射,具体步骤如下:

[0067]

步骤一:为每种语言分配一个自动编码器,每个自动编码器都包含一个编码器和解码器;自动编码器是非线性的,其中每个编码器和解码器都是具有两个非线性隐藏层的

三层前馈神经网络;

[0068]

步骤二:自动编码器以自我监督的方式独立训练,归纳相应语言的潜在空间;

[0069]

步骤三:使用具有反向翻译和源嵌入重构约束的有监督非线性变换学习;使用种子字典来学习以前馈神经网络的方式实现的非线性映射。

[0070]

作为上述实施例的优化方案,如图4所示,所述知识蒸馏包括离线策略,非英语事件检测网络构成的从属图神经网络和大规模英语数据集上预先训练网络构成的主图神经网络共享同一个网络结构;在从属图神经网络训练阶段从具有真实标签的数据中学习知识,并从主图神经网络中获取探索知识;包括步骤:

[0071]

步骤一:用英语社交事件数据训练主网络;

[0072]

步骤二:对于处理后的非英语语言消息图g(x

s

,a

s

),利用跨语言模块学习从非英语语言到英语语言的映射过程,获得英语语义空间x

s

→

t

下的转换后的初始消息属性特征,来消除当非英语数据输入到为英语数据指定的预训练网络型时的语言障碍;

[0073]

步骤三:将总损失设置为知识蒸馏损失与基于真实标签的损失这两部分加权之和用于从属网络训练的反向传播;

[0074]

其中,λ是一个超参数,l

t

()表示由一组真实标签三元组形式由<锚,正,负>计算得来的损失,正与负分别表示锚和真实标签一致和不一致的情况。

[0075]

作为上述实施例的优化方案,如图5所示,所述知识蒸馏包括在线策略,采用相互连通的第一对等体图神经网络训练和第二对等体图神经网络,两个网络互相利用知识,两个网络都通过其对等网络的辅助训练得到了增强,具体包括步骤:

[0076]

步骤一:分别为第一对等体图神经网络和第二对等体图神经网络的训练指定已处理的单语社交事件检测数据g(x

p1

,a

p1

)和g(x

p2

,a

p2

);

[0077]

步骤二:通过跨语言模型得到对第二对等体图神经网络语言语义空间g(x

p1

→

p2

,a

p1

)中的对第一对等体图神经网络转换后数据以及对第一对等体图神经网络语言语义空间g(x

p2

→

p1

,a

p1

)中的对第二对等体图神经网络转换后数据,消除不同语种之间的语言障碍;

[0078]

步骤三:对于对第一对等体图神经网络的训练,同时将g(x

p1

,a

p1

)和g(x

p1

→

p2

,a

p1

)分别输入第一对等体图神经网络和第二对等体图神经网络,相应的输出为h

p1

和h

p1

→

p2

;使用h

p1

→

p2

作为第一对等体图神经网络的额外监控信号,通过来自同伴的隐性知识来进一步训练第一对等体图神经网络;将第一对等体图神经网络的总损失设置为基于数据中的真实标签的相应三元组损失和通过两个学生网络输出的最终表征的差异计算的相应知识提取损失的加权之和用于第一对等体图神经网络训练网络的反向传播;

[0079]

步骤四:对于对第二对等体图神经网络的训练,同时将g(x

p2

,a

p2

)和g(x

p2

→

p1

,a

p1

)分别输入第二对等体图神经网络和第一对等体图神经网络,相应的输出为h

p2

和h

p2

→

p1

;使用h

p2

→

p1

作为第二对等体图神经网络的额外监控信号,通过来自同伴的隐性知识来进一步训练对第二对等体图神经网络;将对第二对等体图神经网络的总损失设置为基于数据中的真实标签的相应三元组损失和通过两个学生网络输出的最终表征的差异计算的相应知识提取损失的加权之和,用于对第二对等体图神经网络训练网络的反向传播。

[0080]

计算的相应知识提取损失的加权之和:其中,λ是一个超参数,l

t

()表示由一组真实标签三元组形式<锚,正,负>计算得来的损失,正与负分别表示锚和真实标签一致和不一致的情况。

[0081]

本发明在建立增强对低资源语言数据检测的跨语言知识蒸馏框架时,提出以在线方式训练整个框架,通过组合损失来更新第一对等体和第二对等体的权重。假设第一对等体具有更丰富的语言数据资源,目标是使非英语社交事件检测获得更好的第二对等体网络性能。从第一对等体的角度来看,知识蒸馏损失提供从第二对等体那里学到的东西,这引导第一对等体隐式地向更可靠的方向学习推广,以帮助检测第二对等体的数据。换句话来说,利用第二对等体蒸馏的知识,第一对等体在检测第二对等体数据方面具有更强大的能力。从第二对等体的角度来看,知识蒸馏损失为第一对等体带来额外知识,而第一对等体具有扩充功能,直接提高了第二对等体的泛化能力。此外,在最终的检测中,我们利用这种集成策略的思想来探索更多信息和更为全面的跨语言知识。在测试中,将g(x

p2

,a

p2

)和g(x

p2

→

p1

,a

p2

)分别馈入第二对等体和第一对等体,并采用总表示作为第二对等体数据的最终表示,更具体地来说,我们将第二对等体数据的两个网络表示连接起来,进行最终的消息聚类。可以把这个过程理解为两个一起学习的学生,一个说英语,一个说另一种语言,对于说非英语语言的学生来说,当他学习用自己的语言表达的信息时,他也利用了他的说英语的同学从这些信息中学习到的知识,从而获得了额外的指导辅助。将两个学生学到的知识结合在一起,能够做出更全面和信息更丰富的决定。

[0082]

作为上述实施例的优化方案,在多语言社交信息流中不断读取新的社交信息,重复s10到s30,使事件检测模型不断地适应输入数据以检测新事件并更新模型的知识。

[0083]

为了使框架适应不断增长的社交信息流,本发明遵循一个包含三个阶段的生命周期,即预培训、检测和维护阶段。在预训练阶段,从最初的几个消息块构建初始消息图,并训练初始模型。预处理阶段只运行一次。在检测阶段,对于每个新到来的消息块,我们用输入消息块重建一个新的图,并用已经训练好的模型直接检测事件。在维护阶段,我们继续用最新的消息块训练模型,这允许模型学习新知识。这检测阶段与维护阶段交替运行。以这种方式,模型不断地适应输入数据以检测新事件并更新模型的知识,并且在删除过去消息块中的过时节点时也保持轻训练方式。

[0084]

作为上述实施例的优化方案,采用k

‑

means或者dbscan聚类算法对最终的多语言同构消息图进行聚类,产生消息簇并将其输出,即为检测得到的社交事件。

[0085]

以上显示和描述了本发明的基本原理和主要特征和本发明的优点。本行业的技术人员应该了解,本发明不受上述实施例的限制,上述实施例和说明书中描述的只是说明本发明的原理,在不脱离本发明精神和范围的前提下,本发明还会有各种变化和改进,这些变化和改进都落入要求保护的本发明范围内。本发明要求保护范围由所附的权利要求书及其等效物界定。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。