技术特征:

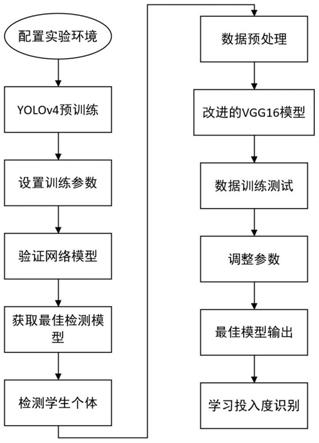

1.一种基于深度学习的在线学习投入度识别方法,其特征在于,包括如下步骤:步骤1,基于学习视频构建学习投入数据库;步骤2,利用yolov4目标检测模型在学习投入数据库上进行迁移学习,用来进行学生人脸检测任务,并在公开人脸检测数据集上训练得到yolov4预训练模型;步骤3,在学习投入数据库上,通过训练集不断训练网络模型,验证集测试网络模型性能,最终通过多次迭代和调整网络参数获取到最优的yolov4检测模型,并检测获得学习投入数据库上的人脸;步骤4,修改vgg16网络结构模型,并利用改进的vgg16模型进行训练,调参获取最佳模型;步骤5,利用训练好的改进的vgg16模型从检测到的人脸中识别学习投入度。2.如权利要求1所述的一种基于深度学习的在线学习投入度识别方法,其特征在于:步骤1的具体实现过程如下;1a)在真实的学习环境中采集学生在线学习的视频,从收集的m个学生学习视频抽取图像帧并进行投入度标注,对每个视频片段按照每间隔a帧抽取一帧的规则进行抽取,从视频序列中抽取m张图片;1b)进行数据标记,将m张图片中的学生个体进行标记,目的在于将学生与环境分离,并赋予图片标签值,为m张图片中的学生个体分配投入度标签值b,其中b有c类。3.如权利要求1所述的一种基于深度学习的在线学习投入度识别方法,其特征在于:改进的vgg16模型的网络结构如下;(1)将vgg16网路结构模型的第18层max pool替换为global pool,减少参数量;(2)将vgg16网路结构模型的第20

‑

21层full connet剔除,并将全连接层的节点数对应投入类别数目a;(3)在vgg16最后一层全连接层之前引入dropout策略,以增强模型的鲁棒性。4.如权利要求1所述的一种基于深度学习的在线学习投入度识别方法,其特征在于:训练改进的vgg16模型时,采用数据增广方式,将训练数据集按照某种特定的变换规则,产生新的图像,具体包括;a)图像向左旋转20度;b)图像向右旋转20度;c)图像水平翻转;d)图像向左平移20个像素点;e)随机设置部分像素值为零;f)添加高斯噪声;g)添加高斯模糊;h)将每张图像每隔两行的像素点变成黑色的条带。5.如权利要求1所述的一种基于深度学习的在线学习投入度识别方法,其特征在于:所述改进的vgg16模型包括14个隐藏层,即13个卷积层和1个全连接层,所有隐藏层的激活单元都采用relu函数,relu的表达式f(x)以及其导数f’(x)的计算公式如下所示:f(x)=max(0,x)

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(1)

relu函数是分段线性函数,把所有的负值都变为0,而正值不变,这种操作被成为单侧抑制。6.如权利要求1所述的一种基于深度学习的在线学习投入度识别方法,其特征在于:采用深度确定性信息瓶颈dib作为vgg16模型的损失函数,弥补传统损失函数的不足,以获取较为紧致的特征表达,减少泛化误差,改善模型的通用性和稳定性,dib定义了一个最优的特征表示,即网络所学习到的输入数据的特征表示t应该与输入x之间的互信息mi最小,同时与理想输出y的互信息最大,互信息利用熵来描述变量之间的非线性相关性,mi的值反映变量之间的相关性强弱,mi值越大,说明相关性越强;两个变量之间的mi值定义为:i(y;t)=h(y)

‑

h(y|t)

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(3)其中,h(y)表示y的熵;h(y|t)表示给网络所学习到的输入数据的特征表示t的条件下,y和t的条件信息熵,t∈t,t为网络所学习到的输入数据的特征表示,y∈y;由于h(y)是一个与神经网络无关的参数,因此由公式(3)可以得到:进一步的,给定一个训练数据集d=(x

i

,y

i

)

i=1,...,n

及其先验分布p(x

i

,y

i

),其中n为训练数据集中样本个数,x

i

为输入的图像集合,y

i

为在输入x

i

图像情况下的理想输出的分类结果集合,从该分布中可以对训练集进行采样,条件概率pθ(t|x

i

)和pθ(y

i

|t)由θ进行参数化,其θ表示网络参数,e表示期望;然后,可以得到给网络所学习到的输入数据的特征表示t的条件下,y和t的条件信息熵:进一步的,根据经验可以近似的得到平均交叉熵损失,即dib,其计算公式如下:综上,dib可以解释为通过了加权可微互信息项i(y;t)而得的经典交叉损失熵。7.一种基于深度学习的在线学习投入度识别系统,其特征在于,包括如下模块:学习投入数据库构建模块,用于基于学习视频构建学习投入数据库;人脸检测模型构建模块,用于利用yolov4目标检测模型在学习投入数据库上进行迁移学习,用来进行学生人脸检测任务,并在公开人脸检测数据集上训练得到yolov4预训练模型;人脸检测模块,用于在学习投入数据库上,通过训练集不断训练网络模型,验证集测试网络模型性能,最终通过多次迭代和调整网络参数获取到最优的yolov4检测模型,并检测获得学习投入数据库上的人脸;学习投入度识别模型构建模块,用于修改vgg16网络结构模型,并利用改进的vgg16模型进行训练,调参获取最佳模型;最终识别模块,用于利用训练好的改进的vgg16模型从检测到的人脸中识别学习投入度。

8.如权利要求7所述的一种基于深度学习的在线学习投入度识别系统,其特征在于:所述改进的vgg16模型的网络结构如下;(1)将vgg16网路结构模型的第18层max pool替换为global pool,减少参数量;(2)将vgg16网路结构模型的第20

‑

21层full connet剔除,并将全连接层的节点数对应投入类别数目a;(3)在vgg16最后一层全连接层之前引入dropout策略,以增强模型的鲁棒性。9.如权利要求7所述的一种基于深度学习的在线学习投入度识别系统,其特征在于:所述改进的vgg16模型包括14个隐藏层,即13个卷积层和1个全连接层,所有隐藏层的激活单元都采用relu函数,relu的表达式f(x)以及其导数f’(x)的计算公式如下所示:f(x)=max(0,x)

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(1)relu函数是分段线性函数,把所有的负值都变为0,而正值不变,这种操作被成为单侧抑制。10.如权利要求7所述的一种基于深度学习的在线学习投入度识别系统,其特征在于:采用深度确定性信息瓶颈dib作为vgg16模型的损失函数,弥补传统损失函数的不足,以获取较为紧致的特征表达,减少泛化误差,改善模型的通用性和稳定性,dib定义了一个最优的特征表示,即网络所学习到的输入数据的特征表示t应该与输入x之间的互信息mi最小,同时与理想输出y的互信息最大,互信息利用熵来描述变量之间的非线性相关性,mi的值反映变量之间的相关性强弱,mi值越大,说明相关性越强;两个变量之间的mi值定义为:i(y;t)=h(y)

‑

h(y|t)

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(3)其中,h(y)表示y的熵;h(y|t)表示给网络所学习到的输入数据的特征表示t的条件下,y和t的条件信息熵,t∈t,t为网络所学习到的输入数据的特征表示,y∈y;由于h(y)是一个与神经网络无关的参数,因此由公式(1)可以得到:进一步的,给定一个训练数据集d=(x

i

,y

i

)

i=1,...,n

及其先验分布p(x

i

,y

i

),其中n为训练数据集中样本个数,x

i

为输入的图像集合,y

i

为在输入x

i

图像情况下的理想输出的分类结果集合,从该分布中可以对训练集进行采样,条件概率pθ(t|x

i

)和pθ(y

i

|t)由θ进行参数化,其θ表示网络参数,,e表示期望;然后,可以得到给网络所学习到的输入数据的特征表示t的条件下,y和t的条件信息熵:进一步的,根据经验可以近似的得到平均交叉熵损失,即dib,其计算公式如下:综上,dib可以解释为通过了加权可微互信息项i(y;t)而得的经典交叉损失熵。

技术总结

本发明设计了一种基于深度学习的在线学习投入度识别方法及系统,首先为了保证图像不受无关背景的影响,本发明通过YOLOv4进行学生人脸检测;其次针对VGG16网络参数量庞大、训练耗时等问题,提出了一种改进的VGG16模型,同时,在模型训练过程中,采用深度确定性信息瓶颈方法DIB弥补传统损失函数的不足,以获取较为紧致的特征表达,减少泛化误差,改善模型的通用性和稳定性,实现复杂在线学习场景下的学习投入度精准识别;最后通过与传统机器学习和其它深度学习等多种方法比较和分析,验证了本发明方法的有效性。发明方法的有效性。发明方法的有效性。

技术研发人员:魏艳涛 胡美佳 雷芬 姚璜 邓伟 徐家臻

受保护的技术使用者:华中师范大学

技术研发日:2021.09.17

技术公布日:2021/11/23

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。