1.本发明涉及目标识别技术领域,尤其是一种对患者健康状况进行分析监测的方法。

背景技术:

2.当今社会老龄化现象日益加剧,住院就医的包括老年人在内需要特殊看护的患者数量不断上升,但是我国目前从事护理行业的人数较为短缺,医护人员缺口超过1000万人,这已经成为了目前病人看护亟待解决的问题。

3.随着人工智能技术的不断发展,将人工智能技术应用于病房内病人看护,可在一定程度上解决病房内护理人员短缺问题;目前采用的方法主要是通过智能穿戴与智能护理机器人组合实现对病人的无人化护理,以此来解决护理人员不足的问题;但是智能穿戴与智能机器人存在着造价高、功能单一的局限性,很难达到实用的预期效果。

4.有鉴于此,需要研发一种利用病房内安装的摄像头对患者进行健康状况分析监测的方法。

技术实现要素:

5.本发明需要解决的技术问题是提供一种对患者健康状况进行分析监测的方法,利用病房内安装的摄像头进行患者健康状况检测的系统,将面部表情识别、人体姿态估计和手部姿势估计结合起来,将摄像头采集到的患者的表情、姿态和手势等数据进行融合,利用融合后的信息综合分析患者的健康状况,有效的解决了医院护理人员短缺的问题。

6.为解决上述技术问题,本发明所采用的技术方案是:

7.一种对患者健康状况进行分析监测的方法,其特征在于:构建利用病房内安装的监控摄像头和放在护理人员值班室的监控终端对患者进行健康状况检测的系统,该系统将面部表情识别、人体姿态估计和手部姿势估计结合起来,将摄像头采集到的患者的表情、姿态和手势数据进行融合,利用融合后的信息综合分析患者的健康状况;患者在病房内出现四种情况时系统需要发出警报,通知护理人员留意观察患者健康的情况,以减轻医院护理人员工作压力。

8.本发明技术方案的进一步改进在于:所述面部表情识别的识别过程包括两部分:人脸预处理和面部表情分类;面部表情分为危险表情、待观察表情和安全表情,当系统识别到患者的表情为危险表情时,系统将会发出警告,立即通知护理人员前往病房查看患者的状况;当系统识别到患者的表情为待观察表情时,系统只需发出预警,提醒医护人员留意观察患者在病房内的情况;当系统识别到患者的表情为安全表情时,系统不用发出任何预警,护理人员无需将全部精力放在观察病房内的患者身上。

9.本发明技术方案的进一步改进在于:患者面部表情识别过程具体包括以下步骤:

10.s1,首先从输入的图片中利用基于cascadecnn的人脸检测算法识别找出目标区域,根据intraface检测到的关键点来裁剪人脸区域,这些关键点用来提取眉毛、眼睛、鼻子

和嘴巴的轮廓,并将图片进行归一化处理;

11.s2,然后从归一化处理后的图片中提取能够最大程度上表达整个人脸面部的特征信息;

12.s3,最后将s2得到的特征信息送到softmax分类器中进行表情分类。

13.本发明技术方案的进一步改进在于:所述危险表情至少包括发怒、厌恶、恐惧和伤心;所述待观察表情至少包括惊讶;所述安全表情至少包括中性和开心。

14.本发明技术方案的进一步改进在于:所述人体姿态估计是利用目标检测算法生成人体建议框,再在框内利用基于热图回归的关键点回归算法进行人体关键点回归;将人体姿势分为站立、坐下、平躺和摔倒;提取出患者身体的18个关键点,通过计算关键点之间的欧氏距离来估计患者的姿势;利用膝盖与臀部两处关键点之间的欧氏距离判断患者的身体姿势是站立还是坐下;结合患者与病床之间的位置关系,若患者在病床上,且臀部和颈部两处关键点在竖直方向上的欧氏距离较为接近,则患者是在平躺,系统还需进一步通过面部表情或者手部姿势分析患者的健康状况;若患者没有在病床上且臀部和颈部两处关键点之间在竖直方向上的欧氏距离较为接近,则判断患者摔倒了,需要立即发出警报并通知护理人员前往病房查看患者健康情况。

15.本发明技术方案的进一步改进在于:所述人体姿态估计过程如下:首先通过改进版mobilenet对人体进行检测得到包含一个人的bounding box;然后利用目标检测算法生成人体建议框,再在框内利用基于热图回归的关键点回归算法进行人体关键点回归;用heatmap来表示关键点的粗略位置,而heatmap最大值对应关键点的实际位置。

16.本发明技术方案的进一步改进在于:所述手部姿势估计是提取手部21个关键点,对21个关键点进行排序,手掌根部为起始关键点,每根手指上有四个关键点,通过计算手部关键点之间的欧氏距离和关键点与手掌根部关键点的角度关系来识别患者手部的姿势;将手部姿势分为握紧和张开;根据手掌掌心与手指指心的欧氏距离和角度关系判断手部姿势是握紧还是张开。

17.本发明技术方案的进一步改进在于:对患者的手部姿势进行估计,采用的是用于手部关键点检测的resnet

‑

50网络模型,通过计算提取的手部21个关键点之间的欧氏距离和关键点与手掌根部关键点的角度关系来识别患者手部的姿势;患者一般在危险的情况下会握紧双手,根据这个特性,利用得到的手部姿势辅助患者的面部表情和身体姿势来对患者的健康情况进行分析。

18.本发明技术方案的进一步改进在于:所述四种情况具体包括:

19.(1)如果系统能够检测到患者的面部表情,通过分析患者的面部表情得到患者的心理活动,从而在患者出现危险表情时,系统发出警报,护理人员能够及时做出反应;

20.(2)如果系统能够检测到患者的面部表情和手部姿势,利用面部表情和手部姿势相结合判断患者的心理活动,当患者出现危险表情时,会出现握紧拳头的姿势,此时系统会发出警报,及时通知护理人员查看患者健康状况;

21.(3)如果系统无法检测到患者的面部表情,通过患者的身体姿态分析患者的健康状况:在得到患者的颈部和臀部两处关键点在竖直方向上坐标相近后,结合患者与病床之间的位置关系判断患者是摔倒还是平躺:患者在病床上是平躺,没有在病床上是摔倒,患者摔倒时要及时通知护理人员;没有发生摔倒时还可以进一步通过患者的手势判断患者的心

理情绪,当患者握紧双手时,护理人员要提高警惕,时刻注意患者的健康情况;

22.(4)如果系统无法检测到患者的面部表情和身体姿态,在只能凭借患者的手部姿势判断患者的健康情况下,通过手部关键点距离的变化判断患者双手是否握紧;当无法检测到患者的面部表情和身体姿态,且双手处于握紧状态时,护理人员及时收到系统发出的警报关注患者的健康状况,并且能够迅速做出反应。

23.本发明技术方案的进一步改进在于:所述系统以pytorch1.9.0深度学习框架为基础,至少包括mobilenet网络模型和resnet

‑

50网络模型;至少包括基于cascadecnn的人脸检测算法、目标检测算法和关键点回归算法。

24.由于采用了上述技术方案,本发明取得的技术进步是:

25.1、本发明将面部表情识别、人体姿态估计和手势估计进行快速集成,提出了病房内患者健康状况检测系统;该系统不再是仅仅依靠于某一项数据来分析患者的健康状况,实现了对面部表情、人体姿态和手部姿势进行快速集成,从而达到更快更好地分析患者的健康状况;通过分析患者在病房内的表情和动作,得到患者的实时健康数据,护理人员依靠获得的这些健康数据来对患者进行护理,大大提高了工作效率,一定程度上缓解了护理人员不足的问题。

26.2、本发明将检测患者的面部表情作为判断患者健康状况的关键,同时联合检测身体姿态与手部姿势更加具体准确的判断患者的健康状况。

27.3、本发明将得到的面部表情、人体姿态和手部姿势等数据进行融合,综合分析这些数据得到患者在病房的健康状况,将患者多方面的数据融合在一起,可以更准确更全面的分析患者的健康状况。

28.4、本发明相对于智能穿戴与智能机器人的护理方案,本发明成本少,不用患者穿戴设备,易于实现,具有推广和使用价值。

29.5、本发明的优势在于当某一方面数据无法检测到时,仍有其他数据可以采集用来检测患者的健康状况,较全面的实现了对病房内患者健康情况的分析,从而在患者出现危险情况时,护理人员能够及时做出反应,保障了患者的生命健康,减轻了护理人员的工作压力。

30.6、本发明实现了对病房内患者健康状况的检测与分析,避免了病房内行动不便的患者发生危险的可能,缓解了医院护理人员不足的压力。

附图说明

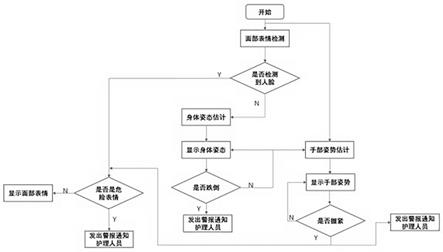

31.图1是本发明的患者面部表情识别流程图;

32.图2是本发明的患者身体姿态估计流程图;

33.图3是本发明的患者手部姿势估计流程图;

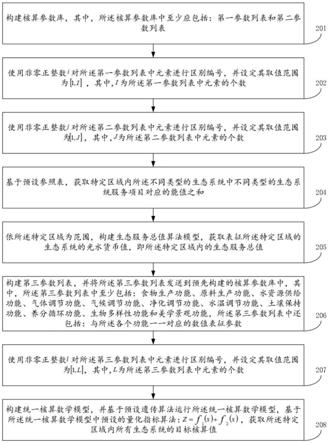

34.图4是本发明的患者健康情况分析流程图;

35.图5是本发明提出的识别面部表情、人体姿势和手部动作的截图;

36.图6是本发明检测到患者坐下时的截图;

37.图7是本发明检测到患者躺下时的截图;

38.图8是本发明提出的患者跌倒预警截图;

39.图9是本发明提出的二动作手部姿势截图。

具体实施方式

40.本发明提出了一种融合面部表情数据、人体姿态数据和手部姿势数据综合分析患者健康状况的方法,可以识别患者的表情、身体姿势以及手部做出的相应动作,并通过得到的这些数据来分析患者的面部表情、心理活动和身体姿势动作,以此得到患者的健康状况。

41.下面结合实施例对本发明做进一步详细说明:

42.一种对患者健康状况进行分析监测的方法,构建利用病房内安装的监控摄像头和放在护理人员值班室的监控终端对患者进行健康状况检测的系统,所述系统以pytorch1.9.0深度学习框架为基础,至少包括mobilenet网络模型和resnet

‑

50网络模型;至少包括基于cascadecnn的人脸检测算法、目标检测算法和关键点回归算法。

43.该系统将面部表情识别、人体姿态估计和手部姿势估计结合起来,将摄像头采集到的患者的表情、姿态和手势数据进行融合,利用融合后的信息综合分析患者的健康状况;患者在病房内出现四种情况时系统需要发出警报,通知护理人员留意观察患者健康的情况,以减轻医院护理人员工作压力。

44.如图1所示,患者表情识别流程图,对患者的面部表情进行识别,识别过程由两部分组成:人脸预处理和面部表情分类;首先从输入的图片中利用基于cascadecnn的人脸检测算法识别找出目标区域,根据intraface检测到的关键点来裁剪人脸区域,这些关键点可以用来提取眉毛、眼睛、鼻子和嘴巴的轮廓,并将图片进行归一化处理;然后从处理后的图片中提取能够最大程度上表达整个人脸面部的特征信息;最后将上一步得到的特征送到softmax分类器中进行表情分类。面部表情一共分为7类:发怒、厌恶、恐惧、伤心、惊讶、中性和开心。将发怒、厌恶、恐惧和伤心归为危险表情,惊讶为待观察表情,中性和开心归为安全表情,医护人员根据患者表情的危险程度做出相应反应。

45.当识别到患者的表情为发怒、伤心、厌恶和恐惧等消极危险情绪时,系统将会发出警告,立即通知护理人员前往病房查看患者的状况。当识别到患者的表情为惊讶等待观察表情时,系统只需发出预警,提醒医护人员留意观察患者在病房内的情况。当识别到患者的表情为中性和开心等安全表情时,系统不用发出任何预警,护理人员无需将全部精力放在观察病房内的患者身上,这样大大提高了护理人员的工作效率。利用患者面部表情对患者的健康状况进行分析,是本发明中的关键内容,患者面部表情和对应的护理人员应对措施如表1所示。

46.表1患者面部表情和对应的护理人员应对措施

47.表情种类护理人员应对措施发怒危险表情,及时通知护理人员伤心危险表情,及时通知护理人员恐惧危险表情,及时通知护理人员厌恶危险表情,及时通知护理人员惊讶待观察表情,发出预警留意观察中性安全表情,不用发出任何预警开心安全表情,不用发出任何预警

48.如图2所示,人体姿态估计流程图,对患者的人体姿态进行估计,采用的是用于人体关键点检测的改进版mobilenet网络模型,基于通过人体检测得到包含一个人的

bounding box,然后利用目标检测算法生成人体建议框(human proposals),再在框内利用基于热图(heatmap)回归的关键点回归算法进行人体关键点回归。用heatmap来表示关键点的粗略位置,训练网络得到的是特征图各个像素的概率检测值,heatmap最大值对应关键点的位置,heatmap的ground truth是以关键点为中心的二维高斯分布。

49.将人体姿势分为4类:站立、坐下、平躺和摔倒。提取出患者身体的18个关键点,通过计算关键点之间的欧氏距离来估计患者的姿势。利用膝盖与臀部两处关键点之间的欧氏距离判断患者的身体姿势是站立还是坐下。另外,由于患者平躺和摔倒时身体关键点之间的欧氏距离很接近,因此需要额外的判定条件区分患者的平躺和摔倒动作。本发明引入患者和病床之间的位置关系,若患者在病床上,且臀部和颈部两处关键点在竖直方向上的欧氏距离较为接近,则患者是在平躺,系统还需进一步通过面部表情或者手部姿势分析患者的健康状况。若患者没有在病床上且臀部和颈部两处关键点之间在竖直方向上的欧氏距离较为接近,则判断患者摔倒了,需要立即发出警报并通知护理人员前往病房查看患者健康情况。

50.欧式距离计算公式如式1

‑

1所示,ρ为点(x1,y1)与点(x2,y2)之间的欧氏距离。

[0051][0052]

如图3所示,手部姿势估计流程图,对患者的手部姿势进行估计,采用的是用于手部关键点检测的resnet

‑

50网络模型,,首先通过手部检测找到双手,再提取出手部21个关键点,对21个关键点进行排序,手掌根部为起始关键点,每根手指上有四个关键点,通过计算手部关键点之间的欧氏距离和关键点与手掌根部关键点的角度关系来识别患者手部的姿势。手部关键点之间的欧氏距离计算如式1

‑

1所示,关键点与手掌根部关键点的角度关系利用反余弦函数计算。反余弦函数计算公式如式1

‑

2所示,θ为点(x1,y1)与手掌根部关键点(x0,y0)之间的角度关系。

[0053][0054]

将手部姿势分为2类:握紧和张开。通过计算各手指根部关键点坐标的平均值计算出手掌掌心的坐标,当食指、中指、无名指、小拇指的指尖关键点和手掌掌心坐标之间的欧式距离小于规定阈值时,判断手势为握紧,大于规定阈值手势为张开。当采集到患者的面部表情时,利用手部信息结合患者的面部表情共同分析患者的心理活动;当无法采集到患者的面部表情时,利用得到的手部姿势辅助患者的身体姿势来对患者的健康情况进行分析。

[0055]

如图4所示,患者健康情况分析流程图,本发明将上述提到的表情识别、人体姿态估计和手势估计进行快速集成,提出了病房内患者健康状况检测系统。该系统不再是仅仅依靠于某一项数据来分析患者的健康状况,实现了对面部表情、人体姿态和手部姿势进行快速集成,从而达到更快更好地分析患者的健康状况。本发明将检测患者的面部表情作为判断患者健康状况的关键,同时联合检测身体姿势与手部姿势更加具体准确的判断患者的健康状况。本发明将得到的面部表情、身体姿势和手部姿势等数据进行融合,综合分析这些数据得到患者在病房的健康状况。患者在病房内出现以下四种情况时会发出警报通知护理人员留意观察患者健康情况:

[0056]

(1)如果可以检测到患者的面部表情,那么通过分析患者的面部表情得到患者的

心理活动,从而在患者出现危险表情时,护理人员能够及时做出反应。

[0057]

(2)如果可以检测到患者的面部表情和手部姿势,利用面部表情和手部姿势相结合判断患者的心理活动,当患者出现发怒、伤心、厌恶和恐惧等危险情绪时,会出现握紧拳头的姿势,此时应该及时通知护理人员查看患者健康状况。

[0058]

(3)如果无法检测到患者的面部表情,可以通过患者的身体姿态分析患者的健康状况。例如,在得到患者的颈部和臀部两处关键点在竖直方向上坐标相近后,结合患者与病床之间的位置关系判断患者是摔倒还是平躺:患者在病床上是平躺,没有在病床上是摔倒,患者摔倒时要及时通知护理人员。没有发生摔倒时还可以进一步通过患者的手势判断患者的心理情绪,当患者握紧双手时,护理人员要提高警惕,时刻注意患者的健康情况。

[0059]

(4)如果无法检测到患者的面部表情和身体姿态,在只能凭借患者的手部姿势判断患者的健康情况下,通过手部关键点距离的变化判断患者双手是否握紧。当无法检测到患者的面部表情和身体姿态,且双手处于握紧状态时,护理人员及时收到警报关注患者的健康状况,能够迅速做出反应。

[0060]

实施例

[0061]

一种对患者健康状况进行分析监测的方法,构建利用病房内安装的监控摄像头和放在护理人员值班室的监控终端对患者进行健康状况检测的系统,本实施例的患者健康情况监控系统用到的硬件设备是一套监控设备,监控摄像头放置于病房内视野宽阔的地方,可以最大程度的拍摄到患者的活动;监控摄像头采用海康威视的室内全景摄像头,水平旋转0

°‑

350

°

,垂直旋转

‑

10

°‑

110

°

,支持夜视和大容量存储;监控终端放在护理人员值班室,护理人员可以同时观察到多个病房不同患者的健康情况,大大缓解了护理人员短缺的压力。

[0062]

在监控界面的左上角依次显示手部动作、面部表情和人体姿势,当检测到患者的面部表情为危险消极情绪、人体姿态为摔倒、手部姿势为握紧的情况下时,满足以上任意条件,字体都会变得更加醒目并且会及时向护理人员发出警告,以便护理人员可以得知病房内的实时情况。

[0063]

本实施例在pc端上的实验以pytorch1.9.0深度学习框架为基础,opencv使用的版本是4.5.2,编程语言使用的是python3.8,在windows10 64位操作系统上进行实验,硬件平台为:intel i7

‑

10750h 3.2ghz cpu,nvidia rtx 3060gpu,6g内存。

[0064]

本实施例在fer2013数据集上对人脸面部表情进行7分类实验,fer2013数据集总共有35886张人脸表情图片,其中,训练集28708张,验证集和测试集都是3589张。每张图片都是48*48的灰度图,总共包含有7类表情,分别为愤怒、厌恶、恐惧、悲伤、惊讶、中性、快乐。本发明在coco2017数据集上对人体关键点进行检测,包含超过200,000张图像和250,000个标有关键点的人体实例,训练集和验证集上的超过150,000人和170万个标记的关键点是公开可用的。本发明在多视图手势数据集上对手部关键点进行检测,该数据集包含49062个样本,每个样本都有相应的json文件标记手部关键点位置。

[0065]

如图5所示,本实施例识别到的面部表情、人体姿势和手部动作的截图,截图中将面部表情识别为伤心,人物的动作识别为站立,另外将手部的姿势识别为握紧;本实施例在上述识别到的面部表情、人体姿势和手部动作的基础上,对患者的健康状况进行分析,以此来决定患者是否需要护理人员的帮助。

[0066]

患者的面部表情在判断患者的健康状态时极为重要,有的时候护理人员可以在检测到人脸面部表情的情况下,只依靠患者的面部表情就能判断出患者的健康状况。当识别到患者表情为发怒、伤心、厌恶和恐惧等危险消极情绪时,系统发出警告通知护理人员及时前往病房查看患者的健康状况。当识别到患者表情为惊讶等待观察表情时,系统发出预警护理人员只需留意患者的健康情况即可。当识别到患者表情为中性和开心等安全表情时,患者健康情况稳定,系统不会发出任何预警。如若遇到无法采集到患者面部表情数据的情况,系统将会检测人体姿态和手部姿势,利用采集到的人体姿态和手部姿势信息共同判断患者的健康情况,具体如下:

[0067]

通过分析患者的身体姿态来确定患者当前的健康状况。如图6所示,当患者左右膝盖关键点与臀部关键点在竖直方向上的坐标小于规定阈值y1时,可以判断患者在坐着。此时为了区别于平躺时患者左右膝盖关键点与臀部关键点在竖直方向上的坐标相近的情况,需要补充判定条件,即:患者坐着时颈部关键点与臀部关键点之间的欧式距离大于规定阈值y2。这样就可以区分患者的坐和躺两个姿态了。规定阈值的计算需要通过大量的实验,根据患者具体的动作以及相应关键点之间的欧式距离来确定阈值的大小。本发明中膝盖和臀部两处关键点之间的规定阈值y1为150,颈部与臀部两处关键点之间的规定阈值y2为300.检测患者平躺时的姿态如图7所示。

[0068]

患者的平躺和摔倒姿态特征较为相似,此时单单依靠人体关键点之间的相对位置已经无法区别患者平躺和摔倒姿势。需要明确的是患者大部分时间是平躺在病床上的,出现摔倒的情况较为少见。要想检测患者是否摔倒,还要分析患者的身体姿态以及患者与病床之间的位置关系。通过标记病床位置,计算患者与病床之间的距离,判断患者是否在病床上,结合身体颈部和臀部两处关键点在竖直方向上坐标是否相近来判断患者是平躺还是摔倒。如图8所示,在测试视频中,由于条件有限,用一把椅子代替病床,并用蓝框标记出来。当患者距离病床有一段距离时,判断患者没有在“病床”上,此时患者身体姿态与平躺相似,那么可以确定患者出现了摔倒的情况。系统需要及时发出警告通知护理人员前往病房施救,再结合面部表情是否是危险表情加以辅助确定。

[0069]

在无法检测到患者面部表情,单纯的依靠识别患者在病房内的身体姿势存在一定的不足,并不能达到最终想要的效果,为此利用患者的手部姿势用来辅助判断患者的健康状况。如图9所示,通过计算手掌中心坐标与各手指之间坐标的欧氏距离,当他们之间的距离小于规定阈值dst_thr=10时,判断手部姿势为握紧双手;当他们之间的距离大于规定阈值dst_thr=10时,判断手部姿势为张开双手。本发明将患者握紧双手作为关注焦点,握紧双手可以作为患者健康状况的一个重要依据。当可以检测到人脸面部表情时,手部姿势可以结合面部表情来判断患者是否处于紧张压力之下。如果患者握紧双手且出现危险表情时,系统会发出警报,护理人员会及时做出反应。当无法检测到人脸面部表情时,如果出现患者握紧双手的情况,系统需要发出预警,提醒护理人员留意观察患者健康状况。另外,在无法检测到面部表情时,也可以通过手部姿势或者身体姿态判断患者的姿势和动作。例如,当患者的手腕关键点和肩膀关键点之间的欧氏距离在不断变化,并且手部姿势为握紧状态时,可以判断患者在拿某样东西,系统将患者的这一行为及时提醒护理人员,护理人员有针对性的做出反应,避免危险的发生。

[0070]

综上所述,本发明将面部表情识别、人体姿态估计和手势估计进行快速集成,提出

了病房内患者健康状况检测系统;该系统不再是仅仅依靠于某一项数据来分析患者的健康状况,实现了对面部表情、人体姿态和手部姿势进行快速集成,从而达到更快更好地分析患者的健康状况;通过分析患者在病房内的表情和动作,得到患者的实时健康数据,护理人员依靠获得的这些健康数据来对患者进行护理,大大提高了工作效率,一定程度上缓解了护理人员不足的问题。

[0071]

以上所述的实例仅仅是对本发明的优选实施方式进行描述,并非对本发明的范围进行限定,在不脱离本发明设计精神的前提下,本领域普通技术人员对本发明技术方案做出的各种变形和改进,均应落入权利要求书确定的保护范围内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。