一种基于坐标注意力机制的ip

‑

fsrgan

‑

ca人脸图像超分辨率重建算法

技术领域

1.本发明属于超分辨率重建技术领域,具体涉及到一种用于人脸图片的超分辨率重建的方法。

背景技术:

2.近年来,生成对抗性网络在计算机视觉方面应用广泛,尤其在数据集扩展、图像转换、文字

‑

图片转换、语义图像

‑

图片转换、图片编辑、图片混合、图片修复、视频预测、3d打印等方面取得了巨大的成功。

3.单图像超分辨率重建是计算机视觉领域一个重要的研究方向,对于人脸图像细节的捕捉及恢复,在医学影像、交通监视、刑侦追踪、边防警戒、应急救援等领域有着非常重要的研究意义。在现实监控场景下,因为视频收集设备、自然天气条件、非限制人为活动、项目实际需求等因素的存在,使得获取的图像出现分辨率过低、模糊甚至失真的情况,可能会诱发工作人员对图像信息的误判造成不可估量的损失,因此人脸sr图片重建任务势在必行,任重道远。

4.近几年来,由于社会对个人信息安全的高度重视,基于gan网络的人脸sr重建任务迅速得到了社会各界的广泛关注。gan网络生成器与判别器的对弈策略以其无监督学习方式广受喜爱,为人脸sr重建提供无限的可能性。图片的分辨率在实现由低到高的转变的时候,往往会添加无用的信息,丢失有效的信息,而人脸识别过程中存在大量的先验信息可以协助人脸图像实现sr重建,基于人脸身份信息的人脸图片sr重构网络利用不同身份的人脸信息实现人脸图片超分辨率重建。

技术实现要素:

5.本文提出了一种融合改进的坐标注意力机制与ip

‑

fsrgan相结合的ip

‑

fsrgan

‑

ca 模型。在rdb模块中嵌入ca注意力机制,将通道注意力分解为两个沿着不同方向聚合特征的1d特征图,在表达目标信息的时候两个方向的特征相互弥补进而达到特征增强的目的。该模型由两部分组成:超分辨率模块和人脸身份信息保存模块。超分辨率模块是一个条件生成的对抗网络,用以重建sr人脸图像;人脸身份信息模块协助生成器生成身份信息相同的 sr人脸。

6.用于训练的单图像低分辨率(low resolution,lr)图片表示为i

lr

∈r

w*h*c

,重建的高分辨率(super resolution,sr)图片表示为原始高分辨率(high resolution, hr)图片表示为与生成器生成人脸具有相同身份的人脸图片表示为示为与生成器生成的人脸具有不同身份的图片表示为其中w和h表示图像的宽度和高度,r表示放大系数,c表示色彩空间的通道数。本文模型的输出原理表示为:

7.i

sr

=g(i

sr

)

8.b

res

=d(i

sr

,i

hr

)

[0009][0010]

其中,g(

·

)表示sr重建模块的映射函数,d(

·

)表示相对性判别网络模块的映射函数,f表示人脸特征提取函数,b

res

表示不同像素间的相似性度量,b

id

表示不同身份间的像素性度量。

[0011]

生成网络模型结构包括一个前残差块,一个residual in residual dense block based on coordinate attention(rrdbca)模块集,一个后残差快,一个上采样层和两层卷积。其中的rrdbca模块集包括23个rrdbca模块,每个rrdbca模块包括3个residual dense block(rdbca)子模块,每个rdb子模块中均加入了一个ca模块。23层的残差模块使得该超分辨率模块训练的更深,此处的rdbca子模块中的ca模块能够更好地捕捉高频图像信息。判别网络模型采用vgg

‑

128,该判别网络使用相对性判别器,其结果并非预测生成的sr图片是真是假,而是试图找出该sr图片是否真实,相对性判别器表示如下:

[0012][0013]

训练时采用的数据集来源于lfw数据集中的随机抽取的1000个人物的2736张人脸图片,实验中我们先用矩形框检测数据集中的人脸,将其裁剪为大小为128

×

128的人脸图像,作为实验的人脸hr图片。我们采用双三次差值法,对得到的人脸hr图像进行下采样,得到大小为32

×

32的人脸lr图像。实验中使用rrdbca网络作为生成器g,使用vgg网络作为鉴别器d,使用预训练的lightcnn作为人脸身份保存模块,实验时不使用已经预训练好的gans。实验参数方面,初始学习率为2

×

10

‑4,每经历2

×

105次迭代学习率衰退为 70%,初始的λ,γ,η,ξ分别为0.005,10,0.01,1,使用用自适应矩估计优化器训练模型,参数为β1=0.9,β2=0.999。

附图说明

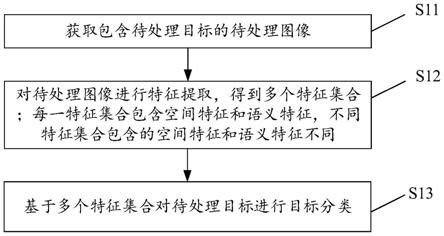

[0014]

如附图所示,图1为基于坐标注意力机制的ip

‑

fsrgan

‑

ca人脸图像超分辨率重建算法流程图。

[0015]

如附图所示,图2为生成器网络模型。

[0016]

如附图所示,图3为rrdbca模块示意图。

[0017]

如附图所示,图4为坐标注意力机制示意图。

[0018]

如附图所示,图5为人脸身份保存模块示意图。

[0019]

如附图所示,图6为损失函数对比图。

[0020]

如附图所示,图7为ip

‑

fsrgan

‑

ca重建效果图。

具体实施方式

[0021]

步骤一:采用的数据集来源于lfw数据集中的随机抽取的1000个人物的2736张人脸图片,实验中我们先用矩形框检测数据集中的人脸,将其裁剪为大小为128

×

128的人脸图像,作为实验的人脸hr图片。

[0022]

步骤二:采用双三次差值法,对得到的人脸hr图像进行下采样,得到大小为32

×

32 的人脸lr图像。

[0023]

步骤三:将得到的人脸lr图像作为输入送入超分辨率重建模块,得到人脸sr图像以及该sr图像与人脸hr图像的相似性度量,图像数据在超分辨率模块的具体运行步骤如下:

[0024]

超分辨率模块是一个生成对抗性网络,它包括一个生成器g和一个判别器d,g实现将输入的lr图片进行一个g映射得到人脸sr重建图片,表示为g:x

→

y;d将g生成的sr图片与hr图片做相似性度量,得到一个当前得到的sr图片是否比较真实的结果。

[0025]

用于训练的单图像低分辨率(low resolution,lr)图片表示为i

lr

∈r

w*h*c

,重建的高分辨率(super resolution,sr)图片表示为原始高分辨率(high resolution, hr)图片表示为其中w和h表示图像的宽度和高度,r表示放大系数,c 表示色彩空间的通道数。本文模型的输出原理表示为:

[0026]

i

sr

=g(i

sr

)

[0027]

b

res

=d(i

sr

,i

hr

)

[0028]

其中,g(

·

)表示sr重建模块的映射函数,d(

·

)表示相对性判别网络模块的映射函数,f表示人脸特征提取函数,b

res

表示不同像素间的相似性度量。

[0029]

生成网络模型其结构包括一个前残差块,一个residual in residual dense block based on coordinate attention(rrdbca)模块集,一个后残差快,一个上采样层和两层卷积。其中的rrdbca模块集包括23个rrdbca模块,每个rrdbca模块包括3个residual dense block(rdbca)子模块,每个rdb子模块中均加入了一个ca模块。23层的残差模块使得该超分辨率模块训练的更深,此处的rdbca子模块中的ca模块能够更好地捕捉高频图像信息。判别网络模型采用vgg

‑

128,该判别网络使用相对性判别器,其结果并非预测生成的sr图片是真是假,而是试图找出该sr图片是否真实,相对性判别器表示如下:

[0030][0031]

在构建生成器的网络模型的时候,引入坐标注意力ca,在ca中,将通道注意力分解为两个并行的一维特征编码,利用这两个一维全局池化分别将垂直和水平方向的输入特征融合为两个独立的方向感知特征图。两个嵌入特定方向信息的特征图分别被编码为两个注意力图,每个注意力图都捕获了输入特征图沿着一个空间方向的长程依赖。位置信息就被保存在生成的注意力图里,两个注意力图接着被乘到输入特征图上来增强特征图的表示能力。ca 模块分两个步骤:坐标信息嵌入和坐标注意力生成。

[0032]

坐标信息嵌入模块先将全局池化分解为两个一维特征编码,对于输入x,先使用核大小为(h,1)和(1,w)的池化层沿着水平坐标方向和竖直坐标方向对每个通道进行编码,高度为h的第c个通道及宽度为w的第c个通道的输出用公式表示如下:

[0033][0034][0035]

这两个变换沿着两个空间方向进行特征聚合,返回一对方向感知注意力图,这样的操作不仅能捕捉到沿着一个空间方向的长程依赖,而且能保存沿着另一个空间方向的精确位置信息,从而使得网络更准确地定位感兴趣的目标,这一过程如i操作。

[0036]

坐标注意力生成模块首先级联坐标嵌入模块生成的两个特征图,再使用一个共享

的1*1 卷积进行变换f1,公式表示如下:

[0037]

f=δ(f1([z

h

,z

w

]))

[0038]

变换得到的f∈r

c/r*(h w)

是对空间信息在水平方向和竖直方向的中间特征图,r表示下采样比例,用以控制模块的大小。

[0039]

沿着空间维度将f分割为两个单独的张量f

h

∈r

c/r

×

h

和f

w

∈r

c/r

×

w

,利用两个1

×

1卷积f

h

和f

w

将特征图f

h

和f

w

变换到与输入x同样的通道数,得到如下的结果。然后对g

h

和g

w

进行拓展,作为注意力权重,ca模块的最终输出表示如下:

[0040]

g

h

=σ(f

h

(f

h

))

[0041]

g

w

=σ(f

w

(f

w

))

[0042][0043]

步骤四:取lfw数据集与步骤三中的人脸具有相同身份和不同身份的人脸图像各一张,送入人脸身份保存模块,得到不同身份的相似性度量。

[0044]

用于训练的单图像低分辨率(lowresolution,lr)图片表示为i

lr

∈r

w*h*c

,重建的高分辨率(super resolution,sr)图片表示为原始高分辨率(high resolution, hr)图片表示为与生成器生成人脸具有相同身份的人脸图片表示为示为与生成器生成的人脸具有不同身份的图片表示为其中w和h表示图像的宽度和高度,r表示放大系数,c表示色彩空间的通道数。身份保存模型的输出原理表示为:

[0045][0046]

其中,b

id

表示不同身份间的像素性度量。

[0047]

使用身份保存模块目的是为了缩小类内间距,扩大类间间距,即正样本(拥有相同的id) 之间的距离尽可能拉近,负样本(拥有不同的id)之间的距离尽可能拉远,此判定的前提是人脸图片sr重建前后的图片具有身份一致性。

[0048]

步骤五:将步骤三和步骤四中产生的损失联合,使用本方法的损失函数修正ip

‑ꢀ

fsrgan

‑

ca模型,并重新进行步骤三和步骤四,实验参数方面,初始学习率为2

×

10

‑4,每经历2

×

105次迭代学习率衰退为70%,初始的λ,γ,η,ξ分别为0.005,10,0.01,1,使用自适应矩估计(adaptive moment estimation,adam)优化器训练模型,参数为β1=0.9,β2=0.999。

[0049]

本文网络中,使用x表示从底层空间x提取的人脸lr图像,使用y表示从底层空间y提取的人脸hr图像,训练集d={(x1,y1),

…

,(x

m

,y

m

)}来自于联合空间x

×

y。人脸sr图像重建的目的是找到一个函数h(x)满足所有的x到y上的映射,找到一个l函数使得映射函数 h(x)和目标图像y的距离最小化,映射函数h(x)能够通过最小化期望损失找到,公式如下:

[0050][0051]

本文的损失函数包括四个部分,包括对抗损失函数l

adv

,身份保存损失函数l

id

,感知损失函数l

p

以及像素损失函数l1。该网络目的就是找到最优参数满足生成器g以及判别器 d。

[0052][0053][0054]

λ,γ,η,ξ分别控制每个损失对最终的损失函数的贡献程度,在实验中我们经验地

确定最优的λ,γ,η,ξ。

[0055]

(1)对抗性损失函数

[0056]

通过相对性判别器的表达式可知,d<x1,x2>≠d<x2,x1>生成器g负责重建尽可能真实逼真的人脸sr图像,目的是使判别器d很难甚至不能分辨出重建的人脸sr图像与人脸hr 图像。生成器g的损失函数的公式表达如下:

[0057][0058]

判别器d负责区分人脸sr重建图像和人脸hr图像,目的是尽可能的将人脸sr重建图像和人脸hr图像之间的距离拉到最大。判别器d的损失函数的公式表示如下:

[0059][0060]

(2)身份保存损失函数

[0061]

在身份保存网络中,通过计算人脸sr重建图像与不同身份人脸图像的余弦相似度,进一步测量距离。假设g(x)是由生成器生成的人脸sr重建图像,y表示参考人脸图像,则它们的id特征之间的余弦相似性是cos(f(g(x)),f(y))。身份损失函数的目的是最大化正样本的相似度,最小化负样本的相似度。

[0062]

在实验中,使用预先训练的人脸识别网络lightcnn作为保存身份的网络。i

i,j

表示身份函数,如果人脸y

i

和y

j

属于同一个身份,i

i,j

=1;否则,i

i,j

=0。身份保存损失函数公式表示如下:

[0063][0064]

通过最小化身份保存损失,g将被优化以保持重建前的身份。这样g就可以从lr人脸图像中推断出与身份密切相关的细节,如眼睛和嘴巴的形状,生成器就可以合成更真实的sr 人脸图像。

[0065]

(3)感知损失函数及像素级损失函数

[0066]

感知损失函数的目的是稳定gan训练,提高重建sr人脸图像质量。感知损失用预先训练的卷积神经网络计算,通常是vgg网络.我们用φ

j

表示在j到第四层卷积层。在伪sr人脸g(x)和hr人脸y间的感知损失表示为:

[0067][0068]

在这里c

j

,h

j

,w

j

表示在vgg网络的第j层卷积层的人脸图像的特征图的形状。重建损失也被用来迫使生成的sr图像接近真实的hr图像,像素级损失函数l1的公式表示如下:

[0069][0070]

步骤六:训练过程结束,将lfw数据集中的部分数据作为测试集进行测试,并与srgan、 esrgan、ip

‑

fsrgan等方法进行对比。

[0071]

在放大倍数为4时,本文的方法可以使loss更好的收敛,且运行稳定,可以更好地优化模型参数,使重建性能更佳。为了验证本文方法在重加性能上的优越性,将本文的结果

首先与srgan、esrgan、ip

‑

fsrgan的方法进行对比,本发明对ca机制模块的配置进行了如下的调整:a.在每个rb子模块之后加入n个ca模块,此处的n的初始化为5。b.在每个 rb子模块之后加入n个ca模块,此处的n的初始化为5,输出的结果为第一个ca模块之前的输入与最后一个ca模块的输出实现短连接,作为该rb子模块的最终输出。实验将以上所有的方法进行比较,得到sr图片的psnr值和ssim值,实验得到的psnr值和 ssim值如表1和表2。

[0072]

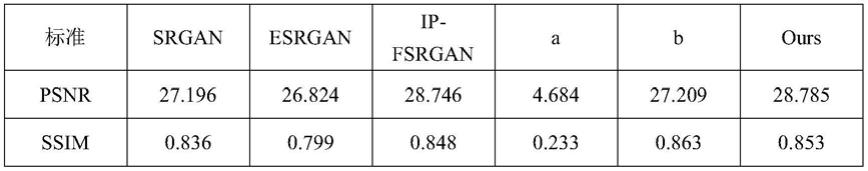

表1各模型评估对照表

[0073][0074]

表2各模型y通道评估对照表

[0075]

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。