1.本发明属于迁移学习领域,涉及一种基于动态领域自适应学习的医学图像识别方法。

背景技术:

2.随着医学成像技术和计算机技术的不断发展和进步,医学图像分析已成为医学研究、临床疾病诊断和治疗中一个不可或缺的工具和技术手段。近几年来,深度学习(deep learning, dl),特别是深度卷积神经网络(convolutional neural networks,cnn)已经迅速发展成为医学图像分析的研究热点,它能够从医学图像大数据中自动特区隐含的疾病诊断特征。在医学图像领域,医生或者研究人员在对某种特定的内部组织器官进行定量分析、实时监控和治疗规划时,为了做出正确的治疗决策,通常需要了解这种组织器官的一些详细信息。所以生物医学影像已成为疾病诊断和治疗中不可或缺的组成部分,且日益重要。但是由于医学图像数据的特殊性,想要获取大量带有标签的医学数据是极为困难的,往往只有通过及其少量的有标签数据来训练神经网络。因此研究如何使用少量带有标签的医学数据来进行医学图像分析具有重要意义。

3.迁移学习(transfer learning),是指利用数据、任务、模型之间的相似性,将在旧领域学习过的模型,应用于新领域的一种学习过程。在传统分类学习中,为了保证训练得到的分类模型具有准确性和高可靠性,都有两个基本的假设:(1)用于学习的训练样本与新的测试样本满足独立同分布;(2)必须有足够可用的训练样本才能学习得到一个好的分类模型。但是,在实际应用中我们发现这两个条件往往无法满足。如何利用少量的有标签训练样本或者源领域数据,建立一个可靠的模型对具有不同数据分布的目标领域进行预测。这就是迁移学习所要解决的问题。

4.领域自适应(domain adaptation),是指迁移学习中的一种代表性方法,指的是利用信息丰富的源域样本来提升目标域模型的性能。领域自适应问题中两个至关重要的概念:源域 (source domain)表示与测试样本不同的领域,但是有丰富的监督信息;目标域(target domain)表示测试样本所在的领域,无标签或者只有少量标签。源域和目标域往往属于同一类任务,但是分布不同。根据目标域和源域的不同类型,领域自适应问题有四类不同的场景:无监督的,有监督的,异构分布和多个源域问题。通过在不同阶段进行领域自适应,研究者提出了四种不同的领域自适应方法:

5.1)样本自适应,对源域样本进行加权重采样,从而逼近目标域的分布。

6.2)特征自适应,将源域和目标域投影到公共特征子空间。

7.3)模型自适应,对源域误差函数进行修改,考虑目标域的误差。

8.4)关系自适应,挖掘和利用源域和目标域的关系进行类比迁移。

9.最大均值差异mmd(maximum mean di screpancy),最大均值差异是迁移学习中使用频率最高的度量,它度量在再生希尔伯特空间中两个分布的距离,是一种核学习方法。许多领域自适应方法都使用最大均值差异来衡量源域和目标域之间的分布差异,并通过减小

分布差异来进行知识迁移。其数学公式如下:

[0010][0011]

领域自适应(domain adaptation)是迁移学习中的一种代表性方法,指的是利用信息丰富的源域样本来提升目标域模型的性能。领域自适应问题中两个至关重要的概念:源域 (source domain)表示与测试样本不同的领域,但是有丰富的监督信息;目标域(targetdomain)表示测试样本所在的领域,无标签或者只有少量标签。源域和目标域往往属于同一类任务,但是分布不同。

[0012]

深度网络自适应,许多深度学习方法开发出自适应层(adaptation layer)来完成源域和目标域数据的自适应。自适应能够使得源域和目标域的数据分布更加接近,从而使得网络的效果更好。深度网络中最重要的是对网络损失的定义,绝大多数深度迁移学习方法都采用了以下的损失定义方式:

[0013]

l=l

class

λl

a

[0014]

其中,l表示网络的最终损失,l

class

表示网络在源域上的常规分类损失,l

a

表示网络的自适应损失,通常使用最大均值差异mmd表示。而λ是权衡两部分的权重参数。

[0015]

功能性近红外光谱成像(fnirs)作为一种近年发展起来的新兴功能性脑成像设备,与现有脑成像和检测设备相比,仪器操作时无噪声且同时满足用户对常规成像空间和时间分辨率的要求,抗干扰性能好、造价低、可便携、可穿戴以及无创检测的特点,适合在社区、家庭、学校等场所推广应用。fnirs可用于脑健康检测的设备类型包括功能性核磁成像,具体来说,fnirs使用两种不同波长的近红外光来测量大脑活动时相应脑区中的氧合血红蛋白 (hbo或o2hb)、脱氧血红蛋白(hbr或hhb)、总血红蛋白(thbo)的浓度变化,以此监测脑内神经活动的代谢变化。fnirs是通过吸收穿透组织的漫反射回来的近红外光来测量hbo、 hbr的浓度变化。之所以选择近红外光是因为水、血红蛋白、蛋白质、胶原蛋白和脂肪等物质对其的吸收都相对较低。

技术实现要素:

[0016]

本发明的目的在于:提供了一种基于动态领域自适应学习的医学图像识别方法,解决了本发明采用的技术方案如下:

[0017]

1.一种基于动态领域自适应学习的医学图像识别方法,其特征在于:包括以下步骤:

[0018]

s101:基于图像数据集进行预处理,得到源域数据集,同时使用近红外脑成像仪采集少量的脑部医学图像数据,得到目标域数据集;

[0019]

s102:基于源域数据集定义用于图像识别的卷积神经网络模型,初始化各层级参数以及训练轮数epoch

max

,并在卷积神经网络中的全连接层的输出层之前加入域自适应层;

[0020]

s103:计算卷积神经网络的域自适应损失l

mmd

以及分类损失l

classification

;

[0021]

s104:定义初始种群λ1到λ

i

,并基于差分进化算法查找自适应参数λ的最优位置,基于最优自适应权重参数λ、域自适应损失l

mmd

以及分类损失l

classification

,利用反向传播算法对卷积神经网络进行训练,更新参数,直至网络收敛,完成训练;

[0022]

s105:将目标域数据集代入训练好的卷积神经网络中,获取脑部医学图像数据的识别输出结果,进行测试。

[0023]

进一步地,所述s102中基于源域数据集定义用于图像识别的卷积神经网络模型,具体包括:定义神经网络总层数,包括卷积层与全连接层,定义卷积层每一层的参数、以及全连接层的参数,在倒数第二层全连接层后加入自适应层,通过其输出计算源域与目标域间的最大均值差mmd。

[0024]

进一步地,所述s104中,基于自适应权重参数λ构建自适应损失l

mmd

,来调节卷积神经网络的各层级参数,具体包括:基于预设种群和种群进化阶段的轮数epoch

s

,利用差分进化算法获取最优的自适应权重参数λ;

[0025]

定义损失函数为:l=l

classification

λl

mmd

,其中,l表示网络的最终损失l

classification

表示网络在源域上的常规分类损失,l

mmd

表示网络的自适应损失,此处使用最大均值差异 mmd表示;

[0026]

基于预设神经网络的训练阶段的轮数epoch

t

,利用反向传播算法对卷积神经网络进行迭代训练,直至最终损失l收敛,停止训练。

[0027]

进一步地,所述进化阶段自适应权重参数λ的获取方法,具体包括:初始化原始种群的个数和位置[λ1,λ2,λ3,

…

,λ

i

],并将其中每个个体复制一次组成个体对 [λ1,λ1,λ2,λ2,λ3,λ3,

…

,λ

i

,λ

i

];

[0028]

依次使用每个个体对进行网络迭代训练,以相同个体λ

i

相邻两次迭代损失函数的减速速度作为个体的适应值,来评价当前个体λ

i

的性能;

[0029]

通过差分进化算法实现个体变异,利用从种群中随机选取的两个个体的差向量作为第三个个体的随机变化源,将差向量加权后按照与第三个个体进行向量合成而产生变异个体;

[0030]

通过交叉来随机选择个体,将变异个体与某个预先决定的目标个体进行参数混合,生成试验个体;如果试验个体的适应值优于目标个体的适应值,则在下一代中使用试验个体取代目标个体,否则目标个体仍保存下来;

[0031]

迭代训练,每代都保留优良个体,淘汰劣质个体,引导搜索过程向全局最优解逼近,得到最优自适应权重参数λ。

[0032]

进一步地,所述s104中,差分进化算法的变异函数定义为:

[0033][0034]

其中,r1,r1和r1是三个随机数,区间为[1,i],f为缩放因子,为一个确定的常数;g表示第g。

[0035]

进一步地,所述s104中,通过域自适应损失l

mmd

以及分类损失l

classification

的取值完成训练,其方法包括如下步骤:

[0036]

计算当前的损失l,即分类损失l

classification

和最优自适应权重参数λ的最大均值差mmd域自适应损失l

mmd

之和;

[0037]

当损失大于期望值时,使用反向传播算法进行迭代,对神经网络参数进行调整,直到loss 值稳定,网络模型收敛。

[0038]

进一步地,所述s105中,目标域数据集为脑部医学图像数据集,具体包括:将训练完成的网络模型参数保存下来;利用脑部医学图像数据集到网络模型上进行精度测试,并

输出测试结果。

[0039]

综上所述,由于采用了上述技术方案,本发明的有益效果是:

[0040]

1.本发明提出了一种有效的医学图像动态领域适应方法来解决“何时转移”的问题。它在训练过程中自动寻找合适的迁移学习机会,而不是传统的固定域适应参数λ方法。

[0041]

2.本发明使用自适应权重参数λ优化损失函数,与传统迁移学习方法的准确率相比,该方法不仅提高了算法的收敛速度,而且提高了测试精度。

[0042]

3.本发明提出了一种能应用于医学图像识别的动态领域自适应方法,能借助已训练好的域来辅助训练只有少量带标记的医学图像域,具有重大的应用价值。

附图说明

[0043]

为了更清楚地说明本发明实施例的技术方案,下面将对实施例中所需要使用的附图作简单地介绍,应当理解,以下附图仅示出了本发明的某些实施例,因此不应被看作是对范围的限定,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他相关的附图,其中:

[0044]

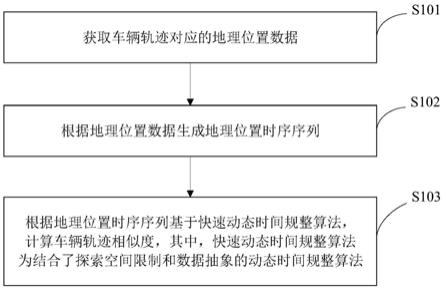

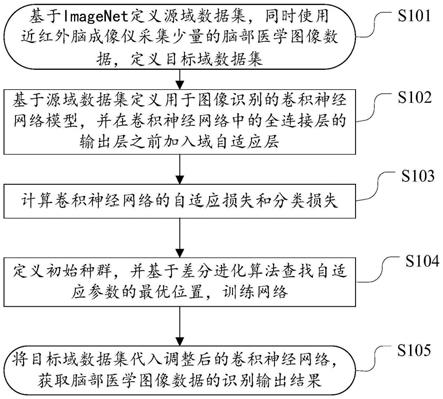

图1是本发明提出的动态领域自适应方法的流程图;

[0045]

图2是imagenet图像数据集示意图;

[0046]

图3是fni rs采集到的脑部医学图像数据集示意图;

[0047]

图4是使用反向传播算法训练神经网络的流程图。

具体实施方式

[0048]

为了使本发明的目的、技术方案及优点更加清楚明白,以下结合附图及实施例,对本发明进行进一步详细说明。应当理解,此处所描述的具体实施例仅用以解释本发明,并不用于限定本发明,即所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。通常在此处附图中描述和示出的本发明实施例的组件可以以各种不同的配置来布置和设计。

[0049]

因此,以下对在附图中提供的本发明的实施例的详细描述并非旨在限制要求保护的本发明的范围,而是仅仅表示本发明的选定实施例。基于本发明的实施例,本领域技术人员在没有做出创造性劳动的前提下所获得的所有其他实施例,都属于本发明保护的范围。

[0050]

需要说明的是,术语“第一”和“第二”等之类的关系术语仅仅用来将一个实体或者操作与另一个实体或操作区分开来,而不一定要求或者暗示这些实体或操作之间存在任何这种实际的关系或者顺序。而且,术语“包括”、“包含”或者其任何其他变体意在涵盖非排他性的包含,从而使得包括一系列要素的过程、方法、物品或者设备不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种过程、方法、物品或者设备所固有的要素。在没有更多限制的情况下,由语句“包括一个

……”

限定的要素,并不排除在包括所述要素的过程、方法、物品或者设备中还存在另外的相同要素。

[0051]

下面结合实施例对本发明的特征和性能作进一步的详细描述。

[0052]

实施例1

[0053]

参考图1所示,本实施例提供了一种基于动态领域自适应学习的医学图像识别方法,包括以下步骤:

[0054]

s101:基于imagnet数据集对数据进行预处理,数据集中的图像示例如图2所示,定

义为源域数据集。使用近红外脑成像仪采集人脑医学图像数据,如图3所示,并人工标记少量数据,定义为目标域数据集;

[0055]

s102:定义卷积神经网络的结构,定义如何从神经网络的输入得到输出,可以使用经典卷积神经网络模型如alexnet或vggnet,并在卷积神经网络中的全连接层的输出层之前加入域自适应层;

[0056]

s103:定义卷积神经网络的域自适应损失l

mmd

以及分类损失l

classification

;

[0057]

其中域自适应损失l

mmd

定义为:

[0058][0059]

其中x

s

和x

t

分别表示源域数据集和目标域数据集,φ(*)是核函数,可以将原始分布映射到可再生希尔伯特空间。

[0060]

分类损失l

classification

使用交叉熵表示,定义为:

[0061][0062]

其中和为源域的标签值和预测值。

[0063]

s104:定义初始种群λ1到λ1,并将种群中每个个体复制一次组成个体对 [λ1,λ1,λ2,λ2,λ3,λ3,

…

,λ

i

,λ

i

],依次使用每个个体对进行网络迭代训练,以相同个体λ

i

相邻两次迭代损失函数的减速速度作为个体的适应度值,来评价当前个体λ

i

的性能;基于差分进化算法查找自适应参数λ的最优位置,基于最优自适应权重参数λ、域自适应损失l

mmd

以及分类损失l

classification

,定义损失函数为:

[0064]

l=l

classification

λl

mmd

[0065]

利用反向传播算法对卷积神经网络进行训练,更新参数,直至网络收敛,完成训练;

[0066]

s105:保存训练好的网络,将人脑医学图像目标域数据集加载到网络模型上进行测试。

[0067]

根据上面的流程,算法结束后,得到高于使用静态权重参数的方法的分类准确率,对脑部医学图像分类识别准确率提高约5%,在迁移学习领域,这是一个较大的提升。

[0068]

如上所述s104中,反向传播算法训练神经网络也是一个重要的过程,下面对反向传播算法训练神经网络作详细描述。

[0069]

实施例2

[0070]

在实施例1基础上,本发明实施例2提供一种反向传播算法训练神经网络的方法流程。参考图4所示,其方法流程包含以下步骤:

[0071]

s201:将训练次数变量初始化为0;

[0072]

s202:在源域数据集中选取一部分训练数据,即一个批处理(batch);

[0073]

s203:通过前向传播获得输出的预测值;

[0074]

s204:计算损失,通过反向传播算法更新神经网络的各项参数;

[0075]

s205:判断是否达到训练期望,如果达到则跳到s208,如果未达到则跳转到s201;

[0076]

s206:判断是否达到设定的训练次数,若达到训练次数则跳转至s208,如果未达到

则跳转到s207;

[0077]

s207:对训练次数进行加1操作,并跳转至s202;

[0078]

s208:结束训练,完成迭代。

[0079]

以上所述仅为本发明的较佳实施例而已,并不用以限制本发明的保护范围,任何熟悉本领域的技术人员在本发明的精神和原则之内所作的任何修改、等同替换和改进等,均应包含在本发明的保护范围之内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。