技术特征:

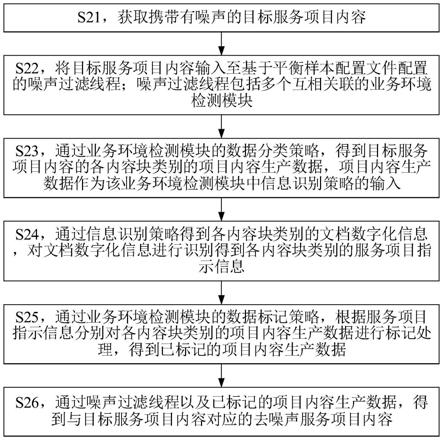

1.一种高效的深度卷积神经网络剪枝方法,其特征在于,包括:(1)利用基于admm的稀疏学习方法训练深度卷积神经网络:(1a)对深度卷积神经网络各通道引入缩放因子γ

l,i

;(1b)对深度卷积神经网络的损失函数loss,添加各通道中缩放因子的0范正则项,得到新的损失函数loss

new

;(1c)从公开数据网站下载训练数据集,利用该训练数据集和随机梯度下降算法训练神经网络中缩放因子以外的参数,并利用admm算法对缩放因子γ

l,i

进行优化,直到(1b)中新的损失函数收敛,得到训练好的深度卷积神经网络模型;(2)利用遗传算法搜索深度卷积神经网络模型的最佳子裁剪率:(2a)设置遗传算法的最大迭代次数,计算训练后卷积神经网络模型的总参数量b0和计算量d0;(2b)初始化m组裁剪率,每组包括n个不同的裁剪率,n等于网络层数;(2c)将各组裁剪率分别编码为二进制编码,并对二进制编码进行交叉和变异操作产生若干新二进制编码,得到新产生的二进制编码数量和原有的二进制编码数量之和为p;(2d)对(2c)中p个二进制编码进行解码,并将每条二进制编码解码为一组裁剪率p

i,j

;(2e)根据(2d)中生成的裁剪率,调整网络模型,选择卷积神经网络各层中缩放因子数值较小的通道,使卷积神经网络各层被选择的通道数与该层总通道数之比等于裁剪率;(2f)将(2e)中被选择通道从卷积神经网络中删除,获得p个子网络,每个子网络对应一组裁剪率;(2g)计算(2f)中的每个子网络的准确率a0,参数量b0和计算量d0,并利用a0,b0和d0计算出每个子网络的适应度f

i

;(2h)通过每个子网络的适应度f

i

计算出每个网络被选择的概率q

i

,通过轮盘选择法,从(2f)所获得的p个子网络中筛选出r个子网络,得到每个子网络在(2d)中所对应的当前裁剪率p

i,j

,1≤r≤p;(2i)重复(2b)到(2h)过程,当迭代次数达到(2a)中所设置的最大迭代次数,完成搜索,得到最佳适应度所对应的卷积神经网络模型的最佳子裁剪率p

best

;(3)选择卷积神经网络各层中缩放因子数值较小的ω个通道,使卷积神经网络各层被选择的通道数ω与该层总通道数β之比等于最佳子裁剪率,以完成对卷积神经网络模型的裁剪,得到卷积神经网络的最佳子网络。2.根据权利要求1所述的方法,其特征在于:(1b)中新的损失函数loss

new

的构造,其实现如下:向神经网络原来的损失函数e(

·

)添加深度卷积神经网络各通道的缩放因子γ

l,i

的l0范数正则项,将约束优化问题转换为如下缩放因子γ

l,i

的非约束优化问题:并根据该非约束优化式得到一个新的损失函数loss

new

:

其中,λ为超参数,λ>0,e(

·

)表示原网络的损失函数loss,γ表示缩放因子γ

l,i

集合的向量,w

l

和b

l

分别是网络第l层的权重和偏置集合,|γ|0为l0范数,表示非零因子的数量。3.根据权利要求1所述的方法,其特征在于:(1c)中利用admm算法优化缩放因子的方法,其实现如下:(1c1)为了求解(1b)式<1>中的非约束优化问题,向其加入辅助变量,并利用增广拉格朗日乘子法进行变换并进行配方,将公式<1>转换为如下公式:其中,γ表示缩放因子γ

l,i

集合的向量,ρ为常数,u为用于配方的对偶变量,z为辅助变量。|z|0为l0范数,表示辅助变量的数量;(1c2)将(1c1)中公式<3>分解为三个子问题,并通过迭代的方式求解。(1c3)将第一个子问题表示为:其中,k为迭代次数索引,z

k

‑1和u

k

‑1分别是第k

‑

1次迭代中辅助变量和对偶变量的集合,可以视为常数;(1c4)求解式<4>表示的第一个子问题,得到第k次迭代中缩放因子γ

l,i

的集合γ

k

:从公开数据网站下载对应任务的训练数据集,利用该训练数据集和随机梯度下降算法训练该问题,直到其收敛,得到第k次迭代中缩放因子γ

l,i

的集合γ

k

;(1c5)将第二个子问题表示为:其中,γ

k

是第一个子问题在k次迭代的结果,u

k

‑1是第k

‑

1次迭代的对偶变量。z,γ

k

和u

k

‑1均为向量的表示,可将该公式<5>转换为如下公式:其中,z

j

,和分别是向量z,γ

k

和u

k

‑1的元素,c表示神经网络总的通道数量,其值等于向量z,γ

k

和u

k

‑1的长度;(1c6)根据式<6>中辅助变量z

j

的取值,得到第k次迭代中辅助变量的集合z

k

:若辅助变量z

j

不为零,则将公式<6>重写为:对公式<7>的完全平方项取零,即得到公式<10>的最小值为λ,为z

j

在第k次迭代时的值;

若辅助变量z

j

为0,即为0,则公式<6>中的|z

j

|0项为0,只剩完全平方项,得到其最小值为综合以上两种取值情况,得到的值如下:将式<5>第二个子问题的结果表示为z

k

为第k次迭代中辅助变量集合;(1c7)将第三个子问题表示为:其中,z

k

为第二个子问题在k次迭代的结果。此子问题为凸二次优化问题,其结果为其极值,表示如下:u

k

=γ

k

‑

z

k

u

k

‑1,

ꢀꢀꢀꢀ

<10>其中,u

k

‑1为第k

‑

1次迭代中对偶变量的集合,γ

k

和z

k

分别为第一个和第二个子问题在k次迭代时的结果;(1c8)在第k 1次迭代时,将(1c7)中第三个子问题在第k次迭代中的结果u

k

输入到(1c3)中的第一个子问题中;(1c9)重复(1c3)到(1c8)的过程,直到(1b)中新的损失函数loss

new

收敛,完成使用基于admm的稀疏学习方法对缩放因子的优化,得到优化之后的缩放因子集合γ。4.根据权利要求1所述的方法,其特征在于:(2b)裁剪率的初始化方式如下:初始化m个个体作为遗传算法的种群,每一个个体表示一组通道裁剪率,每组包含n个不同的裁剪率:s

i

={p

i,j

|0≤p

i,j

<1,j=1,2,...,n},i=1,2,...,m,

ꢀꢀꢀꢀ

<11>其中,s

i

是第i个个体,p

i,j

代表第s

i

中第j层的通道裁剪率。m表示个体的总数,n表示网络的层数。5.根据权利要求1所述的方法,其特征在于:(2g)中计算子网络的适应度f

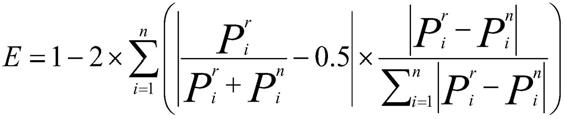

i

,公式如下:其中,a

i

,b

i

和d

i

分别表示每个子网络的准确率,参数量和计算量。a0和b0和d0是原网络的这些参数。θ是平衡公式各部分的超参数,1≤θ≤1,ε表示精度的允许偏差。

技术总结

本发明公开了一种高效的深度卷积神经网络剪枝方法,主要解决现有深度卷积神经网络对存储资源和计算资源消耗大的问题,其实现方案是:通过基于ADMM算法的稀疏学习方法优化缩放因子,对深度卷积神经网络进行训练,使网络结构稀疏化;利用遗传算法对训练好的深度卷积神经网络各层所适宜的裁剪率进行搜索,并在适应度函数的引导下自动搜索出符合需求的最佳裁剪率;使用最佳裁剪率对稀疏学习训练后的网络各层进行裁剪,得到效率最佳的卷积神经网络。本发明可大大降低剪枝后卷积神经网络的精度损失,通过减少网络的参数量大大减少了卷积神经网络对存储资源和计算资源消耗,可用于深度卷积神经网络的压缩。卷积神经网络的压缩。卷积神经网络的压缩。

技术研发人员:谢雪梅 石光明 杨建朋 汪振宇

受保护的技术使用者:西安电子科技大学广州研究院

技术研发日:2021.07.23

技术公布日:2021/11/4

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。