1.本技术涉及人工智能技术领域,尤其涉及一种语音唤醒方法、装置、电子设备及可读存储介质。

背景技术:

2.语音唤醒主要应用在语音交互场景,解决不方便触摸但是又需要交互的情况。工作状态的设备会一直处理收到的音频信息,将所有声音都当作有效信息处理,就会导致乱搭话的情况。而语音唤醒就成功的避开了这个问题,在只有用户叫名字的时候工作,其他时间休眠。因此语音唤醒需要在连续语流中实时检测出说话人特定片段,现有方案使用带有注意力模块的声学模型进行声学建模,但是注意力模块的计算量大,时间延迟高,导致语音唤醒的实时性较差。

技术实现要素:

3.本技术提供一种语音唤醒方法、装置、电子设备及可读存储介质,以解决语音唤醒的实时性较差的问题。

4.第一方面,本技术实施例提供了一种语音唤醒方法,包括:

5.获取音频数据以及所述音频数据中的目标音频帧,所述目标音频帧包括所述音频数据中包含人声的音频帧;

6.提取所述目标音频帧的声学特征;

7.使用预先训练的神经网络模型对所述声学特征进行识别,以获取所述音频数据的识别结果;

8.基于所述识别结果获取所述音频数据的置信度;

9.在所述置信度大于预设阈值的情况下,唤醒目标设备。

10.第二方面,本技术实施例还提供一种语音唤醒装置,包括:

11.第一获取模块,用于获取音频数据以及所述音频数据中的目标音频帧,所述目标音频帧包括所述音频数据中包含人声的音频帧;

12.提取模块,用于提取所述目标音频帧的声学特征;

13.识别模块,用于使用预先训练的神经网络模型对所述声学特征进行识别,以获取所述音频数据的识别结果;

14.第二获取模块,用于基于所述识别结果获取所述音频数据的置信度;

15.第一唤醒模块,用于在所述置信度大于或等于预设阈值的情况下,唤醒目标设备。

16.第三方面,本技术实施例还提供一种电子设备,包括处理器、存储器及存储在所述存储器上并在所述处理器上运行的程序或指令,所述程序或指令被所述处理器执行时实现如前述第一方面所述方法中的步骤。

17.第四方面,本技术实施例还提供一种计算机可读存储介质,用于存储程序,所述计算机可读存储介质上存储有计算机程序,所述计算机程序被处理器执行时实现如前述第一

方面所述方法中的步骤。

18.本技术实施例中,使用预先训练的神经网络模型对所述声学特征进行识别,以获取所述音频数据的识别结果,并基于所述识别结果获取所述音频数据的置信度,在所述置信度大于预设阈值的情况下,唤醒目标设备,通过判断所述音频数据的置信度,确保唤醒性能,从而可以避免使用注意力模块进行声学建模,提高语音唤醒的实时性。

附图说明

19.为了更清楚地说明本技术的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本技术的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动性的前提下,还可以根据这些附图获得其他的附图。

20.图1是本技术实施例提供的语音唤醒方法的流程示意图;

21.图2是本技术实施例提供的语音唤醒系统的唤醒流程示意图;

22.图3是本技术实施例提供的声学模型的结构示意图;

23.图4是本技术实施例提供的循环神经网络变换器模型的结构示意图;

24.图5是本技术实施例提供的语音唤醒装置的结构示意图之一;

25.图6是本技术实施例提供的语音唤醒装置的结构示意图之二;

26.图7是本技术实施例提供的语音唤醒装置的结构示意图之三;

27.图8是本技术实施例提供的语音唤醒装置的结构示意图之四;

28.图9是本技术实施例提供的语音唤醒装置的结构示意图之五;

29.图10是本技术实施例提供的语音唤醒装置的结构示意图之六;

30.图11是本技术实施例提供的语音唤醒装置的结构示意图之七;

31.图12是本技术实施例提供的电子设备的结构示意图;

具体实施方式

32.下面将结合本技术实施例中的附图,对本技术实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例是本技术一部分实施例,而不是全部的实施例。基于本技术中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本技术保护的范围。

33.本技术实施例中的术语“第一”、“第二”等是用于区别类似的对象,而不必用于描述特定的顺序或先后次序。此外,术语“包括”和“具有”以及他们的任何变形,意图在于覆盖不排他的包含,例如,包含了一系列步骤或单元的过程、方法、系统、产品或设备不必限于清楚地列出的那些步骤或单元,而是可包括没有清楚地列出的或对于这些过程、方法、产品或设备固有的其它步骤或单元。此外,本技术中使用“和/或”表示所连接对象的至少其中之一,例如a和/或b和/或c,表示包含单独a,单独b,单独c,以及a和b都存在,b和c都存在,a和c都存在,以及a、b和c都存在的7种情况。

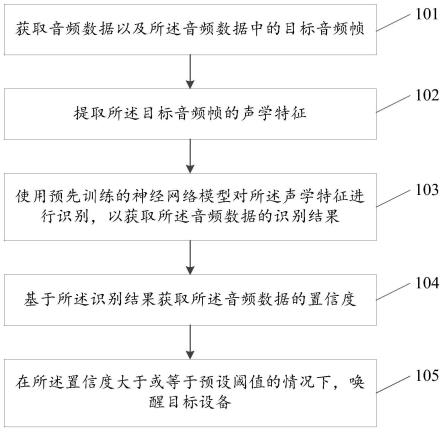

34.请参阅图1,图1是本技术实施例提供的语音唤醒的流程示意图之一,如图1所示,包括以下步骤:

35.步骤101、获取音频数据以及所述音频数据中的目标音频帧,所述目标音频帧包括

所述音频数据中包含人声的音频帧。

36.可以理解,将获取的上述音频数据进行分帧加窗后可以得到多个音频帧,对上述多个音频帧进行vad(voice activity detection,语音端点检测)判断,可以消除其中的非语音帧,并获取其中包含人声的目标音频帧。具体的,分帧加窗包括分帧和加窗两个过程,分帧包括将获取的音频数据切分为固定长度的音频帧,加窗包括使用窗函数对每个音频帧进行处理,防止频谱泄露。这样,使用声学模型对上述音频数据进行识别判断时,可以过滤掉无用音频。

37.步骤102、提取所述目标音频帧的声学特征。

38.具体的,上述声学特征可以使用上述目标音频帧中提取的80维fbank(filter bank,滤波器组)特征,相比mfcc(mel-frequency cepstral coefficients,梅尔倒谱系数)特征可以保留更多不同频率之间的相关性信息。

39.步骤103、使用预先训练的神经网络模型对所述声学特征进行识别,以获取所述音频数据的识别结果。

40.可以理解,上述神经网络模型训练使用的音频数据,也可以进行上述分帧加窗处理后再输入到上述神经网络模型中,提高对上述神经网络模型的训练效果。

41.其中,上述神经网络模型可以基于rnn-t(recurrent neural network-transducer,循环神经网络变换器)结构得到,rnn-t结构的参数量小,延迟低,功耗小,可以适用于语音唤醒任务。

42.步骤104、基于所述识别结果获取所述音频数据的置信度。

43.其中,上述置信度可以表示上述识别结果的唤醒词的唤醒效果,在使用自定义唤醒词进行设备唤醒时,可以根据上述置信度判断该唤醒词的唤醒效果,若上述识别结果的唤醒词的唤醒效果较好,可以直接使用该唤醒词进行唤醒。

44.步骤105、在所述置信度大于预设阈值的情况下,唤醒目标设备。

45.可以理解,在上述置信度大于上述预设阈值的情况下,可以认为上述识别结果对应的唤醒词唤醒效果较好,即可以直接使用上述识别结果对应的唤醒词对上述目标设备进行唤醒。

46.其中,上述目标设备可以是获取上述音频数据并执行上述步骤的设备,也可以是其他设备,例如:上述音频数据中的唤醒词对应的设备,本技术对此不作限制。

47.本技术实施例中,使用预先训练的神经网络模型对所述声学特征进行识别,以获取所述音频数据的识别结果,并基于所述识别结果获取所述音频数据的置信度,在所述置信度大于预设阈值的情况下,唤醒目标设备,通过判断所述音频数据的置信度,确保唤醒性能,从而可以避免使用注意力模块进行声学建模,提高语音唤醒的实时性。

48.可选的,所述神经网络模型包括第一循环神经网络变换器模型;

49.步骤103中所述使用预先训练的神经网络模型对所述声学特征进行识别,以获取所述音频数据的识别结果,具体可以包括:

50.使用预先训练的所述第一循环神经网络变换器模型对所述声学特征进行识别,以获取所述音频数据的拼音序列。

51.其中,语音唤醒的过程中,更关注音频数据的发音,若发音正确就可以视为对上述目标设备的语音唤醒。

52.该实施方式中,使用预先训练的所述第一循环神经网络变换器模型对所述声学特征进行识别,以获取所述音频数据的拼音序列,即可通过上述拼音序列对音频数据的发音准确度进行判断。

53.可选的,所述神经网络模型还包括第二循环神经网络变换器模型;

54.步骤103中所述使用预先训练的神经网络模型对所述声学特征进行识别,以获取所述音频数据的识别结果,具体还可以包括:

55.使用预先训练的所述第二循环神经网络变换器模型对所述拼音序列进行识别,以获取所述音频数据的文字序列;

56.步骤103中所述使用预先训练的神经网络模型对所述声学特征进行识别,以获取所述音频数据的识别结果之后,所述方法还可以包括以下步骤:

57.输出所述文字序列。

58.其中,上述第二循环神经网络变换器模型与上述第一循环神经网络变换器模型可以独立训练,例如:训练过程中,上述第二循环神经网络变换器模型的输入是拼音序列,但输入的拼音序列可以是上述第一循环神经网络变换器模型输出的拼音序列,也可以是其他可以用于训练的拼音序列。

59.其中,上述输出可以是将上述文字序列展示出来,这样,可以实现将上述音频数据转换成文字形式展示在显示器,即可以应用在会议转写服务等语音识别场景。

60.该实施方式中,使用预先训练的所述第二循环神经网络变换器模型对所述拼音序列进行识别,并将获取的文字序列输出,可以根据声学特征识别到音频数据的文字序列作为识别结果。

61.可选的,所述识别结果包括第一唤醒词;

62.步骤103中所述使用预先训练的神经网络模型对所述声学特征进行识别,以获取所述音频数据的识别结果之后,所述方法还可以包括以下步骤:

63.获取唤醒词集合;

64.若所述第一唤醒词包括第二唤醒词,唤醒所述目标设备,其中,所述第二唤醒词属于所述唤醒词集合。

65.其中,上述唤醒词集合中可以包括多个训练上述神经网络模型使用的唤醒词,并且上述唤醒词集合中的唤醒词的置信度均大于上述预设阈值,上述第一唤醒词可以理解为用户自定义的唤醒词。

66.可以理解,上述第一唤醒词包括上述第二唤醒词可以包括以下情况:上述第一唤醒词与上述第二唤醒词一致,上述第一唤醒词的一部分为上述第二唤醒词,例如:上述唤醒词集合中包括第二唤醒词“小天小天”,当上述第一唤醒词为“小天小天”、“小天小天小天”“啊小天小天”等时,均可以理解为上述第一唤醒词包括上述第二唤醒词。

67.其中,上述识别结果中的第一唤醒词可以是上述拼音序列或上述文字序列形式,通过上述第一唤醒词与上述唤醒词集合中唤醒词的拼音序列或文字序列进行对比,即可确定上述第一唤醒词是否包括上述唤醒词集合中的唤醒词。

68.该实施方式中,若所述第一唤醒词包括所述第二唤醒词,可以理解为获取的所述音频数据中包括所述唤醒词集合中的唤醒词,可以直接根据所述第一唤醒词唤醒所述目标设备。

69.可选的,步骤104中所述基于所述识别结果获取所述音频数据的置信度,具体可以包括:

70.若所述第一唤醒词不包括所述第二唤醒词,基于所述识别结果获取所述音频数据的置信度;

71.步骤104中所述基于所述识别结果获取所述音频数据的置信度之后,所述方法还可以包括以下步骤:

72.在所述置信度小于或等于所述预设阈值的情况下,获取所述唤醒词集合中与所述第一唤醒词相似度最高的第三唤醒词;

73.输出第一消息,所述第一消息包括将所述第三唤醒词替换为所述第一唤醒词,以唤醒所述目标设备;

74.在接收到第二消息的情况下,唤醒所述设备,所述第二消息包括同意将所述第三唤醒词替换为所述第一唤醒词,以唤醒所述目标设备。

75.其中,上述第三唤醒词可以是与上述第一唤醒词的发音相似度最高的唤醒词,上述第一唤醒词可以理解为用户自定义的唤醒词,通过上述神经网络模型对包含自定义唤醒词的音频数据的识别,若判断上述第一唤醒词的置信度小于或等于预设阈值,可以推荐与上述第三唤醒词替换上述第一唤醒词,提高唤醒设备的成功率。

76.具体的,在上述音频数据的置信度小于或等于上述预设阈值的情况下,可以输出语音询问用户是否同意将上述第三唤醒词替换上述第一唤醒词,若用户同意,则将用户自定义唤醒词替换为上述第三唤醒词,并唤醒上述目标设备。在上述唤醒过程中,上述输出的语音即为上述第一消息,上述用户同意即为上述第二消息,并且,上述第二消息可以预先设置为多种形式,例如:包含同意、可以或通过等词的语音,触摸或按压,10秒无反应即默认同意替换等,本技术对此不作限制。

77.该实施方式中,在所述置信度小于或等于所述预设阈值的情况下,获取所述唤醒词集合中与所述第一唤醒词相似度最高的第三唤醒词,并推荐所述第三唤醒词作为所述第一唤醒词的替换唤醒词,从而提高所述音频数据的唤醒效果。

78.可选的,所述在所述置信度小于或等于所述预设阈值的情况下,获取所述唤醒词集合中与所述第一唤醒词相似度最高的第三唤醒词,具体可以包括:

79.在所述置信度小于或等于所述预设阈值的情况下,获取所述第一唤醒词对应的第一向量,以及所述唤醒词集合中每个唤醒词对应的第二向量集;

80.确定所述第二向量集中与所述第一向量的距离最近的第三向量;

81.获取所述第三向量对应的第三唤醒词。

82.具体的,可以通过预先训练的bert(bidirectional encoder representations from transformers,基于转换器的双向编码表征)模型实现上述唤醒词与向量之间的转换,与上述第一向量的距离最近的向量可以理解为与上述第一唤醒词发音最相似的唤醒词。

83.该实施方式中,通过确定所述第二向量集中与所述第一向量的距离最近的第三向量,并获取所述第三向量对应的第三唤醒词,即可以快速获取与所述第一唤醒词发音最相似的所述第三唤醒词。

84.可选的,所述识别结果包括后验概率;

85.步骤104中所述基于所述识别结果获取所述音频数据的置信度,具体可以包括:

86.基于所述后验概率获取所述音频数据的置信度。

87.其中,上述后验概率可以是上述识别结果中每个字对应的后验概率,上述置信度可以根据每个字对应的后验概率得到。

88.该实施方式中,基于所述后验概率获取所述音频数据的置信度,可以通过上述神经网络模型的识别结果获取置信度,从而确定所述识别结果的唤醒效果。

89.本技术实施例中介绍的多种可选的实施方式,在彼此不冲突的情况下可以相互结合实现,也可以单独实现,对此本技术实施例不作限定。

90.为方便理解,具体示例如下:

91.本技术实施例提供一种能够推荐自定义唤醒词的端到端语音唤醒系统,该语音唤醒系统的语音唤醒包括唤醒词自定义阶段和推理阶段(即唤醒阶段)。如图2所示,上述端到端语音唤醒系统的语音唤醒可以具体包括以下过程:

92.将输入的多麦语音切分为固定长度的音频帧,并使用hamming窗(海明窗)防止频谱泄露,同时还可以方便网络的训练;

93.经过分帧加窗后的语音送入vad,判断每一帧是否是人声,并抛弃不是人声的音频帧;

94.将上述经过vad判断为人声的语音帧提取80维fbank作为特征输入,输入数据用input

(i,80)

表示,其中,fbank相比mfcc保留了更多不同频率之间的相关性信息,这些相关性信息可以用于神经网络的建模;

95.将上述80维fbank特征input

(i,80)

作为声学模型的输入,使用预先训练的声学模型识别语音结果,语音结果包括识别序列及其后验概率;

96.根据语音结果得到置信度score,并与预设的阈值t比较;

97.如果score小于或等于t,表明用户自定义的唤醒词不能很好适配该语音唤醒系统,因此利用推理算法根据用户自定义的唤醒词发音推荐相似发音的内置唤醒词,若用户同意使用内置唤醒词则激活设备;

98.如果score大于t,表明用户自定义的唤醒词可以适配该语音唤醒系统,根据识别的语音结果激活设备即可。

99.其中,如图3所示,语音唤醒系统选择cascade rnn-t作为声学模型,cascade rnn-t中的“syllable based rnn-t”(拼音识别网络)和“syllable-to-character converter”(拼音-文字转换器)都是由rnn-t结构构成的,rnn-t结构如图4所示,m1、m2、m和n是表示层数的参数,本技术提供的语音唤醒系统中m1为2,m2为3,m为2,n为2。上述input

(i,80)

输入声学模型后,可以得到cascade rnn-t识别的拼音序列和文字序列。

100.其中,cascade rnn-t中的“syllable based rnn-t”(拼音识别网络)和“syllable-to-character converter”(拼音-文字转换器)是独立训练的,即“syllable-to-character converter”的训练是一个独立的过程,可以不和“syllable based rnn-t”一起进行。“syllable based rnn-t”将input

(i,80)

作为输入,输出的是syllable序列(拼音序列)。而“syllable-to-character converter”输入的是syllable序列,输出的是char序列(文字序列)。具体的,以音频内容为“你好,小迪”为例,上述声学模型输出的拼音序列为syllable={ni3,hao3,xiao3,di2},文字序列为char={你,好,小,迪}。

101.其中,上述内置唤醒词的推荐过程可以具体包括:使用预先训练的中文bert模型识别上述语音结果的拼音序列对应的向量vectoru,并将语音唤醒系统中所有内置唤醒词的拼音序列输入bert模型得到对应的向量vectorl,分别计算每个内置唤醒词对应的向量vectorl与向量vectoru之间的距离distance:获取所有向量vectorl中与向量vectoru的距离distance最小的向量vectorl对应的内置唤醒词作为推荐唤醒词,并将推荐唤醒词返回给用户。

102.另外,在上述语音唤醒过程中,设备唤醒及唤醒词推荐均可以不需要上述文字序列的结果,只要发音正确即可进行语音唤醒,因此上述“syllable-to-character converter”部分可以根据应用场景需要剥离出来,即在上述语音唤醒系统中声学模型的输出为上述“syllable based rnn-t”部分输出的拼音序列。上述输出的识别结果序列是2*m的序列,其中的m是训练时包含的拼音数量,2是每行包含(token_id,score)两个元素,token_id表示上述拼音序列,score表示该拼音序列中每个元素的分数。

103.本技术实施例中,语音唤醒系统使用cascade rnn-t作为声学模型识别音频,并得到音频的置信度,在使用用户自定义唤醒词的情况下,若自定义唤醒词的置信度小于或等于预设阈值,可以根据自定义唤醒词的发音推荐发音相似度最高的内置唤醒词给用户,从而提高语音唤醒系统的唤醒率。并且,cascade rnn-t参数量少,即音频识别时的计算量小,对硬件的功耗低。

104.另外,声学模型中的拼音序列识别和文字序列识别部分可以分离,以适应不同的应用场景,例如:上述语音唤醒系统可以应用于会议室中的会议转写服务、智能服务机器人系统或嵌入设备的语音唤醒激活功能等,从而提高语音唤醒系统的资源复用水平。

105.语音唤醒系统的语音唤醒包括唤醒词自定义阶段和推理阶段(即唤醒阶段),以系统内置唤醒词“小天小天”和“张三张三”两个唤醒词,而用户希望自定义使用的唤醒词是“你好,小天”为例,唤醒词自定义阶段包括如下过程:

106.语音唤醒系统采集到用户音频x,音频x内容为“你好,小天”。则拼音序列syllable={ni3,hao3,xiao3,tian1},文字序列char={你,好,小,天}。设置信度t=0.6。

107.接着对音频x进行vad判断以去除非人声的干扰。

108.将上述处理过的音频x提取80维的fbank特征,这里使用input_i表示fbank特征,其中的i表示第i帧。

109.将input_i输入cascade rnn-t中的“syllable based rnn-t”作为声学特征,cascade rnn-t会返回syllable序列作为结果和得分score(假设score=0.4)。因为这个唤醒词是用户自定义的,可以判断score《t。因此系统认为用户自定义的唤醒词性能不佳,不适合于语音唤醒,下面进入唤醒词推荐过程。

110.将“你好小天”、“小天小天”和“张三张三”三个唤醒词的拼音序列为{ni3,hao3,xiao3,tian1}、{xiao3,tian1,xiao3,tian1}和{zhang1,san1,zhang1,san1}分别放入bert计算每个syllable序列的词向量。

111.使用上述向量距离计算公式计算距离之后,语音唤醒系统发现内置唤醒词“小天小天”与用户自定义唤醒词“你好小天”在发音上最为接近,因此语音唤醒系统返回“小天小

天”作为唤醒词。

112.用户决定语音唤醒系统返回的“小天小天”是否可以作为替代唤醒词完成以后的唤醒工作,如果用户接受,那么直接激活语音系统完成唤醒流程,否则返回音频接受阶段进行下一轮的唤醒词自定义接收工作。

113.推理阶段包括如下过程:

114.因为用户已经完成了唤醒词的自定义工作并选择了最终的唤醒词,这里假设唤醒词是“小天小天”。

115.语音唤醒系统采集到用户音频x,音频内容为“小天小天”。则拼音序列syllable={xiao3,tian1,xiao3,tian1},char={小,天,小,天}。设置信度t=0.6。

116.接着对音频x进行vad判断去除非人声的干扰。

117.将上步处理过的x提取80维的fbank特征,这里使用input_i表示,其中的i表示第i帧。

118.将input_i输入cascade rnn-t中的“syllable based rnn-t”作为acoustic feature(声学特征),其会返回syllable序列作为结果和得分score(假设score=0.8)。因为score》t,激活设备,语音唤醒任务结束。

119.请参阅图5,图5是本技术实施例提供的语音唤醒装置的结构示意图之一,如图5所示,语音唤醒装置500包括:

120.第一获取模块501,用于获取音频数据以及所述音频数据中的目标音频帧,所述目标音频帧包括所述音频数据中包含人声的音频帧;

121.提取模块502,用于提取所述目标音频帧的声学特征;

122.识别模块503,用于使用预先训练的神经网络模型对所述声学特征进行识别,以获取所述音频数据的识别结果;

123.第二获取模块504,用于基于所述识别结果获取所述音频数据的置信度;

124.第一唤醒模块505,用于在所述置信度大于预设阈值的情况下,唤醒目标设备。

125.可选的,如图6所示,所述神经网络模型包括第一循环神经网络变换器模型;

126.所述识别模块503具体可以包括:

127.第一识别单元5031,用于使用预先训练的所述第一循环神经网络变换器模型对所述声学特征进行识别,以获取所述音频数据的拼音序列。

128.可选的,如图7所示,所述神经网络模型还包括第二循环神经网络变换器模型;

129.所述识别模块503具体可以还包括:

130.第二识别单元5032,用于使用预先训练的所述第二循环神经网络变换器模型对所述拼音序列进行识别,以获取所述音频数据的文字序列;

131.所述语音唤醒装置500还可以包括:

132.第一输出模块506,用于输出所述文字序列。

133.可选的,如图8所示,所述识别结果包括第一唤醒词;

134.所述语音唤醒装置500还可以包括:

135.第三获取模块507,用于获取唤醒词集合;

136.第二唤醒模块508,用于若所述第一唤醒词包括第二唤醒词,唤醒所述目标设备,其中,所述第二唤醒词属于所述唤醒词集合。

137.可选的,如图9所示,所述第二获取模块504具体可以包括:

138.第一获取单元5041,用于若所述第一唤醒词不包括所述第二唤醒词,基于所述识别结果获取所述音频数据的置信度;

139.所述语音唤醒装置500还可以包括:

140.第四获取模块509,用于在所述置信度小于或等于所述预设阈值的情况下,获取所述唤醒词集合中与所述第一唤醒词相似度最高的第三唤醒词;

141.第二输出模块510,用于输出第一消息,所述第一消息包括将所述第三唤醒词替换为所述第一唤醒词,以唤醒所述设备;

142.第三唤醒模块511,用于在接收到第二消息的情况下,唤醒所述设备,所述第二消息包括同意将所述第三唤醒词替换为所述第一唤醒词,以唤醒所述设备。

143.可选的,如图10所示,所述第四获取模块509具体可以包括:

144.第二获取单元5091,用于在所述置信度小于或等于所述预设阈值的情况下,获取所述第一唤醒词对应的第一向量,以及所述唤醒词集合中每个唤醒词对应的第二向量集;

145.确定单元5092,用于确定所述第二向量集中与所述第一向量的距离最近的第三向量;

146.第三获取单元5093,用于获取所述第三向量对应的第三唤醒词。

147.可选的,如图11所示,所述识别结果包括后验概率;

148.所述第二获取模块504具体可以包括:

149.第四获取单元5042,用于基于所述后验概率获取所述音频数据的置信度。

150.语音唤醒装置500能够实现本技术实施例中图1方法实施例的各个过程,以及达到相同的有益效果,为避免重复,这里不再赘述。

151.本技术实施例还提供一种电子设备。请参见图12,该电子设备1200包括处理器1201,存储器1202,存储在存储器1202上并可在处理器1201上运行的程序或指令,该程序或指令被处理器1201执行时实现上述图像识别方法实施例的各个过程,且能达到相同的技术效果,为避免重复,这里不再赘述。

152.本领域普通技术人员可以理解实现上述实施例方法的全部或者部分步骤是可以通过程序指令相关的硬件来完成,所述的程序可以存储于一可读取介质中。

153.本技术实施例还提供一种计算机可读存储介质,用于存储程序,所述计算机可读存储介质上存储有计算机程序,所述计算机程序被处理器执行时可实现上述图1对应的方法实施例中的任意步骤,且能达到相同的技术效果,为避免重复,这里不再赘述。

154.所述的存储介质,如只读存储器(read-only memory,rom)、随机存取存储器(random access memory,ram)、磁碟或者光盘等。

155.以上所述是本技术实施例的优选实施方式,应当指出,对于本技术领域的普通技术人员来说,在不脱离本技术所述原理的前提下,还可以作出若干改进和润饰,这些改进和润饰也应视为本技术的保护范围。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。