1.本发明涉及判定用户的正常、愤怒、悲伤、喜悦这样的情绪的技术。

背景技术:

2.为了适当的控制等,而提出判定用户抱有的情绪的技术。如果能够正确地判定情绪,则例如能够控制交流机器人的动作(发言等),以与用户进行合适的交流。

3.判定情绪的以往技术例如在专利文献1~3中被公开。在专利文献1~3中公开了基于由可穿戴的设备测定出的脑波、心律等各种生物体信息来判定情绪的技术。

4.现有技术文献

5.专利文献

6.专利文献1:日本特开2014-178970号公报

7.专利文献2:日本特开2017-144222号公报

8.专利文献3:日本特开2012-059107号公报

技术实现要素:

9.发明要解决的课题

10.然而,在专利文献1~3所公开的以往技术中,用户必须佩戴可穿戴的设备,可用性较差。另外,由于使用许多的生物体信息,所以情绪判定的处理负荷较大,情绪判定需要时间。

11.本发明是鉴于上述实际情况而完成的,其目的在于提供能够以可用性较高的简单的结构高精度地判定情绪的技术。

12.用于解决课题的手段

13.为了实现上述目的,本发明采用以下的结构。

14.本发明的第一侧面提供了情绪判定装置,其特征在于,具有:第1推断单元,基于从用户的面部图像检测出的该用户的表情的变化来推断该用户的情绪;第2推断单元,基于以非接触的方式从所述用户检测到的该用户的温度的变化来推断该用户的情绪;以及判定单元,基于所述第1推断单元的推断结果和所述第2推断单元的推断结果来判定所述用户的情绪。此处,面部图像是图像传感器(相机)拍摄面部而得到的图像、图像传感器拍摄而得到的图像中的检测出面部的部分等。温度由热传感器等以非接触的方式检测。

15.根据上述的结构,不使用许多的生物体信息,而能够通过基于使用面部图像的情绪推断的结果和使用温度的情绪推断的结果这种简单的结构高精度地判定情绪。并且,面部图像和温度(检测值)都是以非接触的方式得到,所以不会产生用户佩戴可穿戴的设备的麻烦,能够实现较高的可用性。此外,由于表情的变化量、情绪与表情的对应关系等有个人差,所以仅通过面部图像难以高精度地判定情绪,用户的温度根据环境(季节、场所(屋内/屋外))、服装而大不同,仅通过温度也难以高精度地判定情绪。根据上述的结构,通过组合使用面部图像的情绪判定(情绪推断)的结果和使用温度的情绪判定的结果,与一方的情绪

判定相比,能够高精度地推断情绪。

16.所述第1推断单元和所述第2推断单元也可以分别针对多个情绪的每个情绪,计算所述用户抱有该情绪的可能性即分数,所述判定单元基于由所述第1推断单元计算出的各情绪的分数和由所述第2推断单元计算出的各情绪的分数来判定所述用户的情绪。此处,在使用面部图像的情绪推断和使用温度的情绪推断中,以相同的基准对分数进行归一化,分数的范围共用。例如,在使用面部图像的情绪推断和使用温度的情绪推断中,分数的最大值共用100等规定值。多个情绪是正常、愤怒、悲伤、喜悦等。

17.例如,也可以在由所述第1推断单元计算出最大分数的情绪与由所述第2推断单元计算出最大分数的情绪一致的情况下,所述判定单元将该情绪判定为所述用户的情绪,在由所述第1推断单元计算出最大分数的情绪与由所述第2推断单元计算出最大分数的情绪不一致的情况下,所述判定单元基于由所述第1推断单元计算出的各情绪的分数和由所述第2推断单元计算出的各情绪的分数来判定所述用户的情绪。

18.具体而言,也可以在由所述第1推断单元计算出最大分数的情绪与由所述第2推断单元计算出最大分数的情绪不一致的情况下,所述判定单元将这些情绪中的计算出的分数较高的情绪判定为所述用户的情绪。这样,能够获得信赖度更高的情绪作为判定结果。

19.也可以在由所述第1推断单元计算出最大分数的情绪与由所述第2推断单元计算出最大分数的情绪不一致的情况下,所述判定单元将这些情绪中的由所述第1推断单元计算出的分数和由所述第2推断单元计算出的分数相加得到的值较大的情绪判定为所述用户的情绪。这样,能够获得信赖度更高的情绪作为判定结果。

20.也可以在由所述第1推断单元计算出最大分数的情绪与由所述第2推断单元计算出最大分数的情绪不一致的情况下,所述判定单元将这些情绪中的与前次的分数的变化量较大的情绪判定为所述用户的情绪。这样,能够更早地捕捉情绪的变化。

21.也可以在由所述第1推断单元计算出最大分数的情绪与由所述第2推断单元计算出最大分数的情绪不一致的情况下,所述判定单元将这些情绪中的所述多个情绪之间的分数的方差值较大的情绪判定为所述用户的情绪。这样,能够获得信赖度更高的情绪作为判定结果。此处,方差值可以说是分数突出的程度。

22.还可以还具有变更单元,该变更单元检测所述用户抱有推断出的情绪的可能性即分数的到规定时间前为止的期间中的方差值小于规定的阈值的定时,并变更所述第1推断单元的推断结果和所述第2推断单元的推断结果,以使得从所述方差值小于所述规定的阈值的第1定时追溯,将到所述方差值小于所述规定的阈值的第2定时的紧后的定时为止的推断结果置换为所述第1定时的推断结果,所述判定单元基于所述变更单元变更后的推断结果来判定所述用户的情绪。这样,能够平滑地捕捉情绪的变迁,能够高精度地捕捉情绪的变迁的趋势。其结果,可以适当地进行预测出情绪的变迁的控制等。例如,在用户的情绪处于从愤怒向为悲伤变化的趋势的情况下,能够控制交流机器人的动作(发言等),以与抱有愤怒的情绪的用户进行假定变化成悲伤的交流。

23.所述第1推断单元和所述第2推断单元分别以第1周期推断所述用户的情绪,所述判定单元以比所述第1周期长的第2周期更新并使用所述第1推断单元的推断结果和所述第2推断单元的推断结果。这样,能够减少情绪判定的处理负荷。

24.本发明的第二侧面提供了情绪判定方法,其特征在于,包括:第1推断步骤,基于从

用户的面部图像检测出的该用户的表情的变化来推断该用户的情绪;第2推断步骤,基于以非接触的方式从所述用户检测到的该用户的温度的变化来推断该用户的情绪;以及判定步骤,基于所述第1推断步骤中的推断结果和所述第2推断步骤中的推断结果来判定所述用户的情绪。

25.此外,本发明能够作为具有上述结构或功能的至少一部分的情绪判定系统捕捉。另外,本发明也能够作为包括上述处理的至少一部分的情绪判定方法或者情绪判定系统的控制方法、用于使计算机执行这些方法的程序或者非暂时地记录有那样的程序的计算机可读取的记录介质实现。上述结构以及处理分别只要不产生技术矛盾则能够相互组合来构成本发明。

26.根据本发明,能够以可用性较高的简单的结构高精度地判定情绪。

附图说明

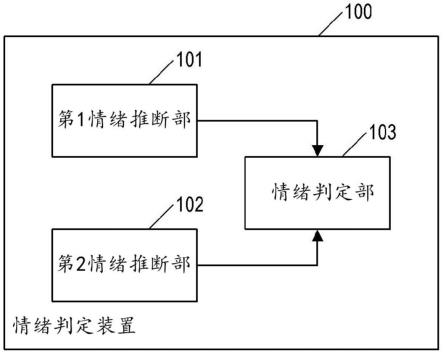

27.图1是表示应用本发明的情绪判定装置的构成例的框图。

28.图2(a)是表示第1实施方式的交流系统(情绪判定系统)的大致构成例的示意图,图2(b)是表示第1实施方式的pc(情绪判定装置)的构成例的框图。

29.图3是表示第1实施方式的处理流程例的流程图。

30.图4(a)~4(c)是表示第1实施方式的动作例的图。

31.图5是表示第2实施方式的处理流程例的流程图。

32.图6(a)~6(c)是表示第2实施方式的动作例的图。

33.图7是表示第3实施方式的处理流程例的流程图。

34.图8(a)~8(c)是表示第3实施方式的动作例的图。

35.图9是表示第4实施方式的处理流程例的流程图。

36.图10(a)~10(c)是表示第4实施方式的动作例的图。

37.图11是表示第5实施方式的pc(情绪判定装置)的构成例的框图。

38.图12(a)~12(c)是表示第5实施方式的动作例的图。

39.图13(a)、13(b)是表示第6的实施方式的动作例的图。

具体实施方式

40.<应用例>

41.对本发明的应用例进行说明。在判定用户的正常、愤怒、悲伤、喜悦这样的情绪的以往技术中,用户必须佩戴可穿戴的设备,可用性较差。另外,由于使用许多的生物体信息,所以情绪判定的处理负荷较大,情绪判定需要时间。

42.图1是表示应用本发明的情绪判定装置100的构成例的框图。情绪判定装置100具有:第1情绪推断部101、第2情绪推断部102以及情绪判定部103。第1情绪推断部101基于从用户的面部图像检测出的该用户的表情的变化来推断该用户的情绪。第2情绪推断部102基于以非接触的方式从用户检测到的该用户的温度的变化来推断该用户的情绪。情绪判定部103基于第1情绪推断部101的推断结果和第2情绪推断部102的推断结果来判定用户的情绪。第1情绪推断部101是本发明的第1推断单元的一个例子,第2情绪推断部102是本发明的第2推断单元的一个例子,情绪判定部103是本发明的判定单元的一个例子。此处,面部图像

是图像传感器(相机)拍摄面部而得到的图像、图像传感器拍摄而得到的图像中的检测到面部的部分等。温度是由热传感器等以非接触的方式检测出的。

43.根据情绪判定装置100的上述结构,不使用许多的生物体信息,而能够通过基于使用面部图像的情绪推断的结果和使用温度的情绪推断的结果这种简单的结构高精度地判定情绪。如果能够正确地判定情绪,则能够控制交流机器人的动作(发言等),例如与用户进行适当的交流。并且,由于面部图像和温度(检测值)都是以非接触的方式获得的,所以不会产生用户佩戴可穿戴的设备这种麻烦,能够实现较高的可用性。此外,由于表情的变化量、情绪与表情的对应关系等有个人差,所以仅通过面部图像难以高精度地判定情绪,用户的温度根据环境(季节、场所(屋内/屋外))、服装而大不同,仅通过温度也难以高精度地判定情绪。根据上述的结构,通过组合使用面部图像的情绪判定(情绪推断)的结果和使用温度的情绪判定的结果,与一方的情绪判定相比,能够高精度地推断情绪。

44.<第1实施方式>

45.对本发明的第1实施方式进行说明。

46.(结构)

47.图2(a)是表示第1实施方式的交流系统(情绪判定系统)的大致构成例的示意图。第1实施方式的交流系统具有:相机10、温度测定装置20、pc200(个人计算机、情绪判定装置)以及交流机器人30。相机10和pc200通过有线或者无线相互连接。同样地,温度测定装置20和pc200通过有线或者无线相互连接,pc200和交流机器人30通过有线或者无线相互连接。

48.相机10使用设置于相机10的图像传感器进行拍摄,并将通过拍摄而得到的图像向pc200输出。在第1实施方式中,相机10将拍摄用户的面部而得到的面部图像向pc200输出。温度测定装置20使用设置于温度测定装置20的热传感器来测定温度,并将测定结果(温度信息)向pc200输出。在第1实施方式中,温度测定装置20检测用户的温度(面部的温度等),并将表示检测到的温度的温度信息(温度的检测值)向pc200输出。pc200基于用户的面部图像和该用户的温度来判定该用户的情绪,并将情绪的判定结果向交流机器人30输出。交流机器人30基于用户的情绪的判定结果进行与该用户的交流。

49.此外,相机10也可以拍摄比面部宽的范围。在该情况下,例如,通过相机10或者pc200进行从由相机10拍摄到的图像获得面部图像的处理(从拍摄到的图像检测面部的处理)即可。另外,温度测定装置20也可以检测比用户(面部)宽的范围的温度分布。在该情况下,例如,通过温度测定装置20或者pc200进行从检测到的温度分布获得用户的温度的处理即可。另外,用户的情绪的判定结果的用途没有特别限定,可以不是交流机器人30的控制。

50.另外,在第1实施方式中,相机10、温度测定装置20、pc200以及交流机器人30是独立的装置,但也可以不是。例如,相机10、温度测定装置20、pc200以及交流机器人30的至少两个以上也可以包含在一个装置中。具体而言,相机10、温度测定装置20以及pc200也可以内置在交流机器人30。另外,没有特别限定pc200的设置场所。例如,pc200也可以设置在与相机10、温度测定装置20以及交流机器人30相同的房间中,也可以不是。pc200可以是云上的计算机,也可以不是。

51.图2(b)是表示pc200的构成例的框图。pc200具有:图像获取部210、温度获取部220、控制部230、存储部240以及输出部250。

52.图像获取部210从相机10获取面部图像,并向控制部230(第1情绪推断部231)输出。在第1实施方式中,相机10拍摄动态图像,图像获取部210依次进行从相机10获取动态图像的1帧并向控制部230输出的处理。图像获取部210的面部图像获取的周期没有特别限定,在第1实施方式中,图像获取部210与相机10的拍摄同步地获取面部图像(动态图像的1帧)。也就是说,图像获取部210以相机10的拍摄的帧率(例如30fps)进行从相机10获取面部图像并向控制部230输出的处理。此外,相机10可以依次进行静止图像的拍摄,在该情况下,图像获取部210依次进行从相机10获取静止图像并向控制部230输出的处理。

53.温度获取部220从温度测定装置20获取用户的温度信息,并向控制部230(第2情绪推断部232)输出。温度测定装置20的温度测定的周期、温度获取部220的温度信息获取的周期等没有特别限定。在第1实施方式中,温度测定装置20与相机10的拍摄同步地测定温度,温度获取部220与相机10的拍摄(图像获取部210对面部图像的获取)同步地获取温度信息。也就是说,温度获取部220以相机10的拍摄的帧率进行从温度测定装置20获取温度信息并向控制部230输出的处理。

54.控制部230包括cpu(central processing unit:中央处理器)、ram(random access memory:随机存取存储器)、rom(read only memory:只读存储器)等,进行各构成要素的控制、各种信息处理等。详细后述,但在第1实施方式中,控制部230基于由图像获取部210获取到的面部图像和温度获取部220获取到的温度信息来判定用户的情绪,并将情绪的判定结果向输出部250输出。

55.存储部240存储由控制部230执行的程序、由控制部230使用的各种数据等。例如,存储部240是硬盘驱动器、固态硬盘等辅助存储装置。

56.输出部250将由控制部230输出的判定结果(情绪的判定结果)向交流机器人30输出。

57.更详细地对存储部240进行说明。存储部240具有第1情绪推断辞典241和第2情绪推断辞典242。第1情绪推断辞典241是预先登记有表情变化与情绪的对应关系的辞典。第2情绪推断辞典242是预先登记有温度变化与情绪的对应关系的辞典。

58.更详细地对控制部230进行说明。控制部230具有:第1情绪推断部231、第2情绪推断部232以及情绪判定部233。

59.第1情绪推断部231依次进行从由图像获取部210输出的面部图像检测用户的表情的处理(表情检测)。第1情绪推断部231参照第1情绪推断辞典241,根据检测到的表情的变化推断用户的情绪。而且,第1情绪推断部231将情绪的推断结果向情绪判定部233输出。第1情绪推断部231是本发明的第1推断单元的一个例子。

60.此外,由第1情绪推断部231进行的表情检测、情绪推断(均基于面部图像的处理)可以使用任何的算法。例如,可以通过现有的表情检测检测用户的表情,具体而言,可以使用组合hog、haar-like等图像特征和提升的检测器(识别器)来检测表情。也可以使用通过现有的机器学习生成的学习完毕模型来检测表情,具体而言,可以使用通过深度学习(例如,r-cnn、fast r-cnn、yolo、ssd等)生成的学习完毕模型来检测表情。同样地,可以通过现有的情绪推断来推断用户的情绪,也可以使用通过现有的机器学习生成的学习完毕模型来推断用户的情绪。具体而言,也可以使用通过深度学习(例如,r-cnn、fast r-cnn、yolo、ssd等)生成的学习完毕模型来推断用户的情绪。

61.第2情绪推断部232依次获取由温度获取部220输出的温度信息,参照第2情绪推断辞典242,根据获取到的温度信息的变化(用户的温度的变化)来推断用户的情绪。而且,第2情绪推断部232将情绪的推断结果向情绪判定部233输出。第2情绪推断部232是本发明的第2推断单元的一个例子。

62.此外,由第2情绪推断部232进行的情绪推断(基于温度的情绪推断)可以使用任何的算法。例如,可以通过现有的情绪推断来推断用户的情绪,也可以使用通过现有的机器学习生成的学习完毕模型来推断用户的情绪。具体而言,也可以使用通过深度学习(例如,r-cnn、fast r-cnn、yolo、ssd等)生成的学习完毕模型来推断用户的情绪。

63.情绪判定部233基于第1情绪推断部231的推断结果和第2情绪推断部232的推断结果来判定用户的情绪,并将情绪的判定结果向输出部250输出。情绪判定部233是本发明的判定单元的一个例子。

64.在第1实施方式中,第1情绪推断部231和第2情绪推断部232分别针对多个情绪的每个情绪,计算用户抱有该情绪的可能性即分数,并将各情绪的分数作为推断结果输出。而且,情绪判定部233基于由第1情绪推断部231计算出的各情绪的分数和由第2情绪推断部232计算出的各情绪的分数来判定用户的情绪。

65.此处,在使用面部图像的情绪推断(第1情绪推断部231的情绪推断)和使用温度的情绪推断(第2情绪推断部232的情绪推断)中,以相同的基准对分数进行归一化,分数的范围共用。例如,在使用面部图像的情绪推断和使用温度的情绪推断中,分数的最大值以100等规定值共用。在第1实施方式中,在使用面部图像的情绪推断和使用温度的情绪推断的每个情绪推断中,以与多个情绪分别对应的多个分数的合计为100的方式计算各情绪的分数。多个情绪的数量、种类没有特别限定,但在第1实施方式中,使用正常、愤怒、悲伤、喜悦这四个情绪。

66.在由第1情绪推断部231计算出最大分数的情绪与由第2情绪推断部232计算出最大分数的情绪一致的情况下,认为用户抱有该情绪的可能性极高。因此,在这样的情况下,情绪判定部233将在第1情绪推断部231和第2情绪推断部232中计算出最大分数的情绪判定为用户的情绪。

67.在由第1情绪推断部231计算出最大分数的情绪与由第2情绪推断部232计算出最大分数的情绪也有时不一致。在这样的情况下,情绪判定部233基于由第1情绪推断部231计算出的各情绪的分数和由第2情绪推断部232计算出的各情绪的分数来判定用户的情绪。具体而言,情绪判定部233将由第1情绪推断部231计算出最大分数的情绪和由第2情绪推断部232计算出最大分数的情绪中的计算出的分数较高的情绪判定为用户的情绪。由于认为分数越高则信赖度(用户抱有对应的情绪的可能性)越高,所以这样,能够获得信赖度更高的情绪作为判定结果。

68.(动作)

69.图3是表示第1实施方式的处理流程例的流程图。pc200反复执行图3的处理流程。图3的处理流程的反复周期没有特别限定,但以相机10拍摄的帧率(例如30fps)反复图3的处理流程。

70.首先,图像获取部210从相机10获取用户的面部图像(步骤s301)。而且,第1情绪推断部231从在步骤s301获取到的面部图像检测用户的表情,并基于检测到的表情的变化(从

过去到现在的表情变化)来计算正常、愤怒、悲伤以及喜悦各自的分数(步骤s302)。

71.接下来,温度获取部220从温度测定装置20获取用户的温度信息(用户的温度)(步骤s303)。而且,第2情绪推断部232基于用户的温度的变化(从过去到现在的温度变化)来计算正常、愤怒、悲伤以及喜悦各自的分数(步骤s304)。

72.接下来,情绪判定部233判定由第1情绪推断部231计算出最大分数的情绪e1与由第2情绪推断部232计算出最大分数的情绪e2是否一致(步骤s305)。情绪e1是在步骤s302中基于表情变化计算出的4个分数(与正常、愤怒、悲伤以及喜悦分别对应)中的计算出最大分数的情绪。情绪e2是在步骤s304中基于温度变化计算出的四个分数(与正常、愤怒、悲伤以及喜悦分别对应)中的计算出最大分数的情绪。在情绪e1与情绪e2一致的情况下(步骤s305:是),使处理进入步骤s306,在情绪e1与情绪e2不一致的情况下(步骤s305:否),使处理进入步骤s307。

73.在步骤s306中,情绪判定部233将情绪e1=e2决定为用户的情绪eresult(最终的判定结果)。而且,pc200结束图3的处理流程。

74.在步骤s307中,情绪判定部233判定情绪e1的分数(基于表情变化的分数)与情绪e2的分数(基于温度变化的分数)是否一致。在情绪e1的分数与情绪e2的分数不一致的情况下(步骤s307:否),使处理进入步骤s308。在情绪e1的分数与情绪e2的分数一致的情况下(步骤s307:是),pc200结束图3的处理流程。此时,作为用户的情绪eresult,采用与前次相同的情绪。

75.在步骤s308中,情绪判定部233判定情绪e1的分数是否高于情绪e2的分数。在情绪e1的分数高于情绪e2的分数的情况下(步骤s308:是)使处理进入步骤s309,在情绪e1的分数低于情绪e2的分数的情况下(步骤s308:否),使处理进入步骤s310。

76.在步骤s309中,情绪判定部233将情绪e1(基于表情变化推断出的情绪)决定为用户的情绪eresult。而且,pc200结束图3的处理流程。

77.在步骤s310中,情绪判定部233将情绪e2(基于温度变化推断出的情绪)决定为用户的情绪eresult。而且,pc200结束图3的处理流程。

78.(动作的具体例)

79.图4(a)~4(c)示出第1实施方式的动作例。图4(a)示出由第1情绪推断部231计算出的各情绪的分数(基于表情变化的分数)的时间变化的一个例子。在图4(a)中,用粗框示出情绪e1(基于表情变化推断出的情绪)。图4(b)示出由第2情绪推断部232计算出的各情绪的分数(基于温度变化的分数)的时间变化的一个例子。在图4(b)中,用粗框示出情绪e2(基于温度变化推断出的情绪)。图4(c)示出由情绪判定部233判定出的情绪(情绪eresult)的时间变化的一个例子。

80.在图4(a)~4(c)的例子中,在帧0~帧2的期间中,情绪e1和情绪e2都是正常,正常也被决定为情绪eresult。在帧3中,情绪e1是愤怒,情绪e2是正常,情绪e1与情绪e2不同。此处,情绪e1(愤怒)的分数是55,情绪e2(正常)的分数是52。由于情绪e1(愤怒)的分数(55)高于情绪e2(正常)的分数(52),愤怒被决定为情绪eresult。其它帧也是同样的,基于情绪e1的分数与情绪e2的分数的一致/不一致、大小关系等来决定情绪eresult。

81.(总结)

82.如以上所述那样,根据第1实施方式,不使用许多的生物体信息,而能够通过基于

使用面部图像的情绪推断的结果和使用温度的情绪推断的结果这种简单的结构高精度地判定情绪。并且,面部图像和温度(检测值)都是以非接触的方式获得,所以不会产生用户佩戴可穿戴的设备这种麻烦,能够实现较高的可用性。另外,通过将基于面部图像推断出的情绪和基于温度推断出的情绪中的计算出的分数较高的情绪判定为用户的情绪,从而能够获得信赖度更高的情绪作为判定结果。

83.<第2实施方式>

84.对本发明的第2实施方式进行说明。

85.(结构)

86.第2实施方式的交流系统的结构、第2实施方式的pc200的结构等与第1实施方式几乎相同的。在第2实施方式中,由第1情绪推断部231计算出最大分数的情绪与由第2情绪推断部232计算出最大分数的情绪不一致的情况下的情绪判定部233的处理与第1实施方式不同。在第2实施方式中,在这样的情况下,情绪判定部233将这些情绪中的由第1情绪推断部231计算出的分数和由第2情绪推断部232计算出的分数相加得到的值较大的情绪判定为用户的情绪。这样,能够获得信赖度更高的情绪作为判定结果。

87.(动作)

88.图5是表示第2实施方式的处理流程例的流程图。pc200反复执行图5的处理流程。图5的处理流程的反复周期没有特别限定,但以相机10拍摄的帧率(例如30fps)反复图5的处理流程。

89.步骤s501~s507的处理与第1实施方式的步骤s301~s307的处理相同。在情绪e1的分数(基于表情变化的分数)与情绪e2的分数(基于温度变化的分数)不一致的情况下(步骤s507:否),使处理进入步骤s508。

90.在步骤s508中,情绪判定部233计算与情绪e1对应的合计分数s1。通过情绪e1的分数(由第1情绪推断部231计算出的分数、基于表情变化的分数)和由第2情绪推断部232针对与情绪e1相同的情绪计算出的分数(基于温度变化的分数)的相加来计算合计分数s1。

91.在步骤s509中,情绪判定部233计算与情绪e2对应的合计分数s2。通过情绪e2的分数(由第2情绪推断部232计算出的分数、基于温度变化的分数)和由第1情绪推断部231针对与情绪e2相同的情绪计算出的分数(基于表情变化的分数)的相加来计算合计分数s2。

92.在步骤s510中,情绪判定部233判定在步骤s508中计算出的合计分数s1与在步骤s509中计算出的合计分数s2是否一致。在合计分数s1与合计分数s2不一致的情况下(步骤s510:否),使处理进入步骤s511。在合计分数s1与合计分数s2一致的情况下(步骤s510:是),pc200结束图5的处理流程。此时,采用与前次相同的情绪作为用户的情绪eresult。

93.在步骤s511中,情绪判定部233判定在步骤s508中计算出的合计分数s1是否高于在步骤s509中计算出的合计分数s2。在合计分数s1高于合计分数s2的情况下(步骤s511:是),使处理进入步骤s512,在合计分数s1低于合计分数s2的情况下(步骤s511:否),使处理进入步骤s513。

94.在步骤s512中,情绪判定部233将与合计分数s1对应的情绪e1决定为用户的情绪eresult。而且,pc200结束图5的处理流程。

95.在步骤s513中,情绪判定部233将与合计分数s2对应的情绪e2决定为用户的情绪eresult。而且,pc200结束图5的处理流程。

96.(动作的具体例)

97.图6(a)~6(c)示出第2实施方式的动作例。图6(a)示出由第1情绪推断部231计算出的各情绪的分数(基于表情变化的分数)的时间变化的一个例子。在图6(a)中,用粗框示出情绪e1(基于表情变化推断出的情绪)。图6(b)示出由第2情绪推断部232计算出的各情绪的分数(基于温度变化的分数)的时间变化的一个例子。在图6(b)中,用粗框示出情绪e2(基于温度变化推断出的情绪)。图6(c)示出由情绪判定部233判定出的情绪(情绪eresult)的时间变化的一个例子。

98.在图6(a)~6(c)的例中,在帧0~帧2的期间中,情绪e1和情绪e2都是正常,所以正常也被决定为情绪eresult。在帧3中,情绪e1是愤怒,情绪e2是正常,情绪e1与情绪e2不同。此处,对于情绪e1(愤怒),第1情绪推断部231计算出的分数(55)与第2情绪推断部232计算出的分数(20)的合计(合计分数s1)是75。对于情绪e2(正常),第1情绪推断部231计算出的分数(22)与第2情绪推断部232计算出的分数(72)的合计(合计分数s2)是74。由于与情绪e1(愤怒)对应的合计分数s1(75)高于与情绪e2(正常)对应的合计分数s2(74),所以愤怒被决定为情绪eresult。其它帧也是同样的,基于情绪e1的分数与情绪e2的分数的一致/不一致、合计分数s1与合计分数s2的大小关系等来决定情绪eresult。

99.(总结)

100.如以上所述那样,即使是第2实施方式,也与第1实施方式同样地,能够获得可以通过可用性较高的简单的结构高精度地判定情绪这种效果。另外,通过将基于面部图像推断出的情绪和基于温度推断出的情绪中的基于面部图像的分数和基于温度的分数的合计较高的情绪判定为用户的情绪,从而能够获得信赖度更高的情绪作为判定结果。

101.<第3实施方式>

102.对本发明的第3实施方式进行说明。

103.(结构)

104.第3实施方式的交流系统的结构、第3实施方式的pc200的结构等与第1实施方式几乎相同。在第3实施方式中,由第1情绪推断部231计算出最大分数的情绪与由第2情绪推断部232计算出最大分数的情绪不一致的情况下的情绪判定部233的处理与第1实施方式不同。在第3实施方式中,在这样的情况下,情绪判定部233将这些情绪中的从前次的分数的变化量较大的情绪判定为用户的情绪。这样,能够更早地捕捉情绪的变化。

105.(动作)

106.图7是表示第3实施方式的处理流程例的流程图。pc200反复执行图7的处理流程。图7的处理流程的反复周期没有特别限定,但以相机10拍摄的帧率(例如30fps)反复图7的处理流程。

107.步骤s701~s707的处理与第1实施方式的步骤s301~s307的处理相同。在情绪e1的分数(基于表情变化的分数)与情绪e2的分数(基于温度变化的分数)不一致的情况下(步骤s707:否),使处理进入步骤s708。

108.在步骤s708中,情绪判定部233计算从情绪e1的前次的分数(基于表情变化的分数)到情绪e1的本次的分数(基于表情变化的分数)的变化量d1。变化量d1是从情绪e1的本次的分数减去情绪e1的前次的分数而获得的差值。

109.在步骤s709中,情绪判定部233计算从情绪e2的前次的分数(基于温度变化的分

数)到情绪e2的本次的分数(基于温度变化的分数)的变化量d2。变化量d2是从情绪e2的本次的分数减去情绪e2的前次的分数而获得的差值。

110.在步骤s710中,情绪判定部233判定在步骤s708中计算出的变化量d1与在步骤s709中计算出的变化量d2是否一致。在变化量d1与变化量d2不一致的情况下(步骤s710:否),使处理进入步骤s711。在变化量d1与变化量d2一致的情况下(步骤s710:是),pc200结束图7的处理流程。此时,采用与前次相同的情绪作为用户的情绪eresult。

111.在步骤s711中,情绪判定部233判定在步骤s708中计算出的变化量d1是否大于在步骤s709中计算出的变化量d2。在变化量d1大于变化量d2的情况下(步骤s711:是),使处理进入步骤s712,在变化量d1小于变化量d2的情况下(步骤s711:否),使处理进入步骤s713。

112.在步骤s712中,情绪判定部233将与变化量d1对应的情绪e1,决定为用户的情绪eresult。而且,pc200结束图7的处理流程。

113.在步骤s713中,情绪判定部233将与变化量d2对应的情绪e2决定为用户的情绪eresult。而且,pc200结束图7的处理流程。

114.(动作的具体例)

115.图8(a)~8(c)示出第3实施方式的动作例。图8(a)示出由第1情绪推断部231计算出的各情绪的分数(基于表情变化的分数)的时间变化的一个例子。在图8(a)中,用粗框示出情绪e1(基于表情变化推断出的情绪)。图8(b)示出由第2情绪推断部232计算出的各情绪的分数(基于温度变化的分数)的时间变化的一个例子。在图8(b)中,用粗框示出情绪e2(基于温度变化推断出的情绪)。图8(c)示出由情绪判定部233判定出的情绪(情绪eresult)的时间变化的一个例子。

116.在图8(a)~8(c)的例子中,在帧0~帧2的期间中,情绪e1和情绪e2都是正常的,正常也被决定为情绪eresult。在帧3中,情绪e1是愤怒,情绪e2是正常,情绪e1与情绪e2不同。此处,对于情绪e1(愤怒),从第1情绪推断部231前次计算出的分数(23;帧2的分数)到第1情绪推断部231本次计算出的分数(55;帧3的分数)的变化量d1为32(=55-23)。对于情绪e2(正常),从第2情绪推断部232前次计算出的分数(52;帧2的分数)到第2情绪推断部232本次计算出的分数(50;帧3的分数)的变化量d2是-2(=50-52)。由于与情绪e1(愤怒)对应的变化量d1(32)大于与情绪e2(正常)对应的变化量d2(-2),所以愤怒被决定为情绪eresult。其它帧也是同样的,基于情绪e1的分数与情绪e2的分数的一致/不一致、变化量d1与变化量d2的大小关系等来决定情绪eresult。

117.(总结)

118.如以上所述那样,即使是第3实施方式,也与第1实施方式同样地,能够获得可以通过可用性较高的简单的结构高精度地判定情绪这种效果。另外,通过将基于面部图像推断出的情绪和基于温度推断出的情绪中的从前次的分数的变化量较大的情绪判定为用户的情绪,从而能够更早地捕捉情绪的变化。

119.<第4实施方式>

120.对本发明的第4实施方式进行说明。

121.(结构)

122.第4实施方式的交流系统的结构、第4实施方式的pc200的结构等与第1实施方式几乎相同。在第4实施方式中,由第1情绪推断部231计算出最大分数的情绪与由第2情绪推断

部232计算出最大分数的情绪不一致的情况下的情绪判定部233的处理与第1实施方式不同。在第4实施方式中,在这样的情况下,将情绪判定部233将这些情绪中的多个情绪之间的分数的方差值较大的情绪判定为用户的情绪。此处,方差值也可以说是分数突出的程度。由于认为多个情绪之间的分数的方差值越大,换句话说,最大分数越突出,信赖度(用户抱有对应的情绪的可能性)越高,所以这样能够获得信赖度更高的情绪作为判定结果。n个分数xi(i为1以上且n以下的整数)的方差值v例如能够通过以下的式1计算。在式1中,xave是n个分数xi的平均值。

123.[数1]

[0124][0125]

(动作)

[0126]

图9是表示第4实施方式的处理流程例的流程图。pc200反复执行图9的处理流程。图9的处理流程的反复周期没有特别限定,但以相机10拍摄的帧率(例如30fps)反复图9的处理流程。

[0127]

步骤s901~s907的处理与第1实施方式的步骤s301~s307的处理相同。在情绪e1的分数(基于表情变化的分数)与情绪e2的分数(基于温度变化的分数)不一致的情况下(步骤s907:否),使处理进入步骤s908。

[0128]

在步骤s908中,情绪判定部233计算第1情绪推断部231针对多个情绪(正常、愤怒、悲伤以及喜悦)分别计算出的多个分数(基于表情变化的多个分数)的方差值,作为与情绪e1对应的方差值v1。

[0129]

在步骤s909中,情绪判定部233计算第2情绪推断部232针对多个情绪(正常、愤怒、悲伤以及喜悦)分别计算出的多个分数(基于温度变化的多个分数)的方差值,作为与情绪e2对应的方差值v2。

[0130]

在步骤s910中,情绪判定部233判定在步骤s908中计算出的方差值v1与在步骤s909中计算出的方差值v2是否一致。在方差值v1与方差值v2不一致的情况下(步骤s910:否),使处理进入步骤s911。在方差值v1与方差值v2一致的情况下(步骤s910:是),pc200结束图9的处理流程。此时,采用与前次相同的情绪,作为用户的情绪eresult。

[0131]

在步骤s911中,情绪判定部233判定在步骤s908中计算出的方差值v1是否大于在步骤s909中计算出的方差值v2。在方差值v1大于方差值v2的情况下(步骤s911:是),使处理进入步骤s912,在方差值v1小于方差值v2的情况下(步骤s911:否),使处理进入步骤s913。

[0132]

在步骤s912中,情绪判定部233将与方差值v1对应的情绪e1决定为用户的情绪eresult。而且,pc200结束图9的处理流程。

[0133]

在步骤s913中,情绪判定部233将与方差值v2对应的情绪e2决定为用户的情绪eresult。而且,pc200结束图9的处理流程。

[0134]

(动作的具体例)

[0135]

图10(a)~10(c)示出第4实施方式的动作例。图10(a)示出由第1情绪推断部231计算出的各情绪的分数(基于表情变化的分数)的时间变化的一个例子。在图10(a)中,用粗框示出情绪e1(基于表情变化推断出的情绪)。图10(b)示出由第2情绪推断部232计算出的各

情绪的分数(基于温度变化的分数)的时间变化的一个例子。在图10(b)中,用粗框示出情绪e2(基于温度变化推断出的情绪)。图10(c)示出由情绪判定部233判定出的情绪(情绪eresult)的时间变化的一个例子。

[0136]

在图10(a)~10(c)的例子中,在帧0~帧2的期间中,情绪e1和情绪e2都是正常,所以正常也被决定为情绪eresult。在帧3中,情绪e1是愤怒,情绪e2是正常,情绪e1与情绪e2不同。此处,对于情绪e1(愤怒),根据第1情绪推断部231计算出的四个分数(22、55、12、11)计算的方差值v1是319。对于情绪e2(正常),根据第2情绪推断部232计算出的四个分数(52、20、8、20)计算的方差值v2是267。由于与情绪e1(愤怒)对应的方差值v1(319)大于与情绪e2(正常)对应的方差值v2(267),所以愤怒被决定为情绪eresult。其它帧也是同样的,基于情绪e1的分数与情绪e2的分数的一致/不一致、方差值v1与方差值v2的大小关系等来决定情绪eresult。

[0137]

(总结)

[0138]

如以上所述那样,即使是第4实施方式,也与第1实施方式同样地,能够获得可以通过可用性较高的简单的结构高精度地判定情绪这种效果。另外,通过将基于面部图像推断出的情绪和基于温度推断出的情绪中的多个情绪之间的分数的方差值较大的情绪判定为用户的情绪,从而能够获得信赖度更高的情绪作为判定结果。

[0139]

<第5实施方式>

[0140]

对本发明的第5实施方式进行说明。

[0141]

(结构)

[0142]

第5实施方式的交流系统的结构与第1实施方式几乎相同。图11是表示第5实施方式的pc200的构成例的框图。第5实施方式的pc200也与第1实施方式同样地具有:图像获取部210、温度获取部220、控制部230、存储部240以及输出部250。其中,第5实施方式的控制部230还具有推断结果变更部234。在第5实施方式中,后述的处理以外的处理与第1实施方式相同。

[0143]

在第5实施方式中,第1情绪推断部231和第2情绪推断部232分别将用户的情绪的推断结果储存(记录、积蓄)于存储部240。

[0144]

推断结果变更部234变更储存于存储部240的第1情绪推断部231的推断结果和第2情绪推断部232的推断结果。从容易明白的观点来看,在图11中,代替对存储部240写入/读出推断结果的箭头,而示出从第1情绪推断部231和第2情绪推断部232朝向推断结果变更部234的箭头。具体而言,推断结果变更部234检测在规定时间前为止的期间中的分数(推断出的情绪的分数)的方差值小于规定的阈值的定时。这样的定时能够视为用户的情绪的推断结果稳定的定时。而且,推断结果变更部234从方差值小于规定的阈值的第1定时追溯,将到方差值小于规定的阈值的第2定时的紧后的定时为止的推断结果,置换为第1定时的推断结果。推断结果变更部234变更第1情绪推断部231的推断结果和第2情绪推断部232的推断结果,以便进行这样的定时的检测和推断结果的置换。推断结果变更部234是本发明的变更单元的一个例子。

[0145]

情绪判定部233基于推断结果变更部234变更后的推断结果来判定用户的情绪。例如,通过第1~第4实施方式中的任意一种方法判定用户的情绪。

[0146]

这样,能够平滑地捕捉情绪的变迁,能够高精度地捕捉情绪的变迁的趋势。其结

果,可以适当地进行预测出情绪的变迁的控制等。例如,在用户的情绪处于从愤怒向悲伤变化的趋势的情况下,能够控制交流机器人30的动作(发言等),以与抱有愤怒的情绪的用户进行假定变化成悲伤的交流。

[0147]

(动作的具体例)

[0148]

图12(a)~12(c)示出第5实施方式的动作例。以下中,对变更第1情绪推断部231的推断结果的例子进行说明。也通过与以下的方法同样的方法变更第2情绪推断部232的推断结果。

[0149]

图12(a)示出推断结果变更部234变更前的分数的时间变化的一个例子,示出由第1情绪推断部231计算出的各情绪的分数(基于表情变化的分数)的时间变化的一个例子。在图12(a)中,用粗框示出情绪e1(基于表情变化推断出的情绪)。

[0150]

首先,推断结果变更部234基于图12(a)的时间变化来计算由推断结果变更部234推断出的情绪e1的、到规定时间前为止的期间中的方差值。规定时间没有特别限定,但此处为3帧的时间。例如,在帧2中,情绪e1(分数最大的情绪)是正常,所以推断结果变更部234根据帧2的正常的分数(56)、帧1的正常的分数(50)以及帧0的正常的分数(60)计算方差值(16.9)。在帧3中,情绪e1(分数最大的情绪)是愤怒,推断结果变更部234根据帧3的愤怒的分数(55)、帧2的愤怒的分数(23)以及帧1的愤怒的分数(20)计算方差值(251)。对于其它帧,推断结果变更部234也通过同样的方法计算方差值。图12(b)示出计算出的方差值的时间变化的一个例子。

[0151]

接下来,推断结果变更部234检测方差值小于规定的阈值的定时(帧)。规定的阈值没有特别限定,但此处是50。在图12(b)中,用粗框示出小于规定的阈值(50)的方差值。具体而言,检测到帧2、7、13、14。

[0152]

最后,推断结果变更部234从方差值小于规定的阈值(50)的第1定时追溯,将到方差值小于规定的阈值(50)的第2定时的紧后的定时为止的推断结果置换为第1定时的推断结果。如上述那样,在图12(b)中,作为方差值小于规定的阈值(50)的定时,检测到帧2、7、13、14。因此,推断结果变更部234进行分数的置换,以使得帧0~2的分数成为帧2的分数,帧3~7的分数成为帧7的分数,帧8~13的分数成为帧13的分数。图12(c)示出推断结果变更部234变更后的分数的时间变化的一个例子。

[0153]

此外,在图12(c)仅示出情绪e1(推断为用户抱有的情绪)的分数,但也可以对情绪e1以外的分数进行上述置换。并且,情绪e1相同的多个帧连续的情况下,可以进行分数的置换,以在该多个帧之间统一分数。例如,图12(a)~12(c)的情况下,帧13的情绪e1和帧14的情绪e1都是悲伤。因此,推断结果变更部234也可以进行分数的置换,以使得帧8~14的分数成为帧13或者帧14的分数。

[0154]

(总结)

[0155]

如以上所述那样,即使是第5实施方式,也与第1实施方式同样地,能够获得可以通过可用性较高的简单的结构高精度地判定情绪这种效果。另外,通过变更情绪推断的结果以平滑化地捕捉情绪的变迁,能够高精度地捕捉情绪的变迁的趋势。

[0156]

<第6实施方式>

[0157]

对本发明的第6的实施方式进行说明。

[0158]

(结构)

[0159]

第6的实施方式的交流系统的结构、第6的实施方式的pc200的结构等与第1实施方式几乎相同。在第6的实施方式中,第1情绪推断部231和第2情绪推断部232分别以第1周期推断用户的情绪。情绪判定部233以比第1周期长的第2周期更新并使用第1情绪推断部231的推断结果和第2情绪推断部232的推断结果。例如,第2周期是第1周期的3倍的周期。如果相机10拍摄的帧率是30fps,第1周期与该帧率对应,则第2周期与其1/3的帧率(10fps)对应。这些以外的结构(处理)与第1~第4实施方式中的任意一个相同。

[0160]

这样,由于能够减少第1情绪推断部231推断结果和第2情绪推断部232的推断结果的更新这种情绪判定部233的处理的频率,所以能够减少情绪判定的处理负荷。此外,情绪判定部233可以以第1周期进行情绪判定、其结果的输出等,也可以以第2周期进行。如果它们也以第2周期进行,则能够进一步减少情绪判定部233的处理负荷。

[0161]

(动作的具体例)

[0162]

图13(a)、13(b)示出第6的实施方式的动作例。以下,对情绪判定部233更新第1情绪推断部231的推断结果的例子进行说明。情绪判定部233也以与以下的方法同样的方法更新第2情绪推断部232的推断结果。

[0163]

图13(a)示出由第1情绪推断部231计算出的各情绪的分数(基于表情变化的分数)的时间变化的一个例子。在图13(a)中,用粗框示出情绪e1(基于表情变化推断出的情绪)。

[0164]

图13(b)示出情绪判定部233所使用的各情绪的分数(基于表情变化的分数)的时间变化的一个例子。图13(b)也用粗框示出情绪e1(基于表情变化推断出的情绪)。

[0165]

如图13(a)所示,第1情绪推断部231按每1帧计算、更新分数。另一方面,如图13(b)所示,情绪判定部233按每3帧计算、更新分数。具体而言,情绪判定部233将帧0的分数也用作帧1、2的分数。因此,情绪判定部233能够在比帧1、2靠前的定时进行与帧1、2有关的处理。换句话说,能够更早地获得情绪的判定结果。在帧3更新分数,帧3的分数也被用作帧4、5的分数。之后,同样地进行分数的更新。

[0166]

(总结)

[0167]

如以上所述那样,即使是第6的实施方式,也与第1实施方式同样地,能够获得可以通过可用性较高的简单的结构高精度地判定情绪这种效果。另外,通过减少使用于情绪判定的情绪推断结果的更新频率,能够减少情绪判定的处理负荷,或提高情绪判定的处理速度(缩短直至获得情绪判定结果为止的时间)。

[0168]

<其它>

[0169]

上述实施方式只是例示性地说明本发明的构成例。本发明并不限于上述的具体的方式,能够在其技术的思想的范围内进行各种变形。也能够适当地组合第1~第6的实施方式的处理。

[0170]

<附记1>

[0171]

一种情绪判定装置(100、200),其特征在于,具有:

[0172]

第1推断单元(101、231),基于从用户的面部图像检测出的该用户的表情的变化来推断该用户的情绪;

[0173]

第2推断单元(102、232),基于以非接触的方式从上述用户检测到的该用户的温度的变化来推断该用户的情绪;以及

[0174]

判定单元(103、233),基于上述第1推断单元的推断结果和上述第2推断单元的推

断结果来判定上述用户的情绪。

[0175]

<附记2>

[0176]

一种情绪判定方法,其特征在于,具有:

[0177]

第1推断步骤(s302、s502、s702、s902),基于从用户的面部图像检测出的该用户的表情的变化来推断该用户的情绪;

[0178]

第2推断步骤(s304、s504、s704、s904),基于以非接触的方式从上述用户检测到的该用户的温度的变化来推断该用户的情绪;以及

[0179]

判定步骤(s305~s310、s505~s513、s705~s713、s905~s913),基于上述第1推断步骤中的推断结果和上述第2推断步骤中的推断结果来判定上述用户的情绪。

[0180]

附图标记的说明

[0181]

100:情绪判定装置

[0182]

101:第1情绪推断部 102:第2情绪推断部 103:情绪判定部

[0183]

10:相机 20:温度测定装置 30:交流机器人

[0184]

200:pc(情绪判定装置)

[0185]

210:图像获取部 220:温度获取部 230:控制部

[0186]

240:存储部 250:输出部

[0187]

231:第1情绪推断部 232:第2情绪推断部

[0188]

233:情绪判定部 234:推断结果变更部

[0189]

241:第1情绪推断辞典 242:第2情绪推断辞典。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。