1.本发明涉及图像处理领域,尤其涉及一种基于多特征注意力神经网络的图像去雾建模方法。

背景技术:

2.近年来,国内外的科研人员对单幅雾霾图像进行深入分析和探索,现阶段基于数字图像处理技术的方法可以分为两大类:基于传统的图像处理的方法和基于深度学习的算法。目前,人工智能正在日益渗透到各种各样技术领域中。在计算机视觉领域中,研究人员使用深度学习的方法,在目标识别、图像去噪、图像风格转化、超分辨率重建等方向取得了巨大的成绩,因此基于深度学习算法实现去雾效果的研究也逐渐增多。

3.he等人提出了暗通道先验算法,从统计数据分析出暗通道与图像传输率的关系,从有雾图中估算出传输图,并提出用导向滤波对传输图进行精化处理,从而得到无雾图像。但是暗通道算法的一个不足之处在于,对于一些颜色与天空相似的物体,会出现失真的问题。

4.boyi li等人提出具有密集连接的卷积神经网络,通过网路去预测传输图,再进行物理模型去雾,且该网络为轻量型网络,可以嵌入搞基视觉任务中使用,从而引起了深度学习运用于图像去雾的潮流。runde li等人提出了使用编码器和解码器结构,同时使用对称层的跳跃连接等优势的端到端的神经网络,直接让网络从成对数据中学习到去雾过程。

5.deniz engin提出以cyclegan为基础的cycle-dehaze的端到端网络,用于单个图像去雾问题,它不需要成对的模糊和相应的地面真实图像进行训练。所提出的方法不依赖于大气散射模型参数的估计,通过结合循环一致性和感知损失来增强cyclegan,以便改善纹理信息恢复的质量并产生视觉上更好的无雾图像。zhao j等人在cycle-dehaze的基础上发现鉴别器有训练不稳定和崩溃等原因,通过增加鉴别器的数量,同时使用了权重裁剪代替交叉熵,来解决训练不稳定和模式崩溃的问题,并提高了训练速度。当其中一个鉴别器达到生成器的最佳收敛时,另外一个鉴别器依然可以提供梯度来更新生成器。从而提高了性能。liu c等人也是基于cycle-dehaze的基础上使用octave卷积替代了传统的卷积操作,同时发现景深会影响神经网络去雾,通过使用xian提出的景深网络增加了感知损失,克服了景深变化较大去雾不好的缺点。dudhane等人提出了将inception(ri)modules和gan网络进行结合,通过监督学习让网络可以学到更准确的知识,inception(ri)modules增大了计算量的同时也让模型的感受野变的更为准确。

6.shao y等人提出了域领域适应去雾,使用基于学习的图像去雾方法已取得了stoa的性能。然而,现有的大部分方法都是在合成雾图上训练去雾模型,由于域偏移,它们对真实雾图的泛化能力较差。作者采用双向变换网络,通过将图像从一个域变换到另一个域,以弥补合成域和真实域之间的差距,进一步提升域适应性,可以看出结果对现实去雾效果有显著提高。li l等人提出提出了一种有效的半监督学习算法用于单幅图像去雾。该算法采用一个包含监督学习分支和一个无监督学习分支的深度卷积神经网络。在监督分支中,深

层神经网络受监督损失函数(均方损失、感知损失和对抗损失)的约束。在无监督分支中,利用干净图像的稀疏性和梯度先验来约束网络。实验结果表明,半监督学习算法不仅适用于合成训练数据集,而且可以很好地推广到实际图像中。pang y等人提出了双目图像去雾,使用了立体变换模块(stm)编码了双目图像之间的关系和相关性,对双目图像中的左右图像同时进行除雾是互利的,这比仅对左图像除雾要好。dong h等人提出基于u-net架构的具有密集特征融合的多尺度增强去雾网络。该方法是基于boosting和误差反馈这两个原理设计的,表明它们适用于去雾问题。通过在所提出模型的解码器中加入增强策略,通过开发了一种简单而有效的增强解码器,以逐步恢复无雾图像。2为了解决在u-net架构中保留空间信息的问题,使用反投影反馈方案设计了一个密集特征融合模块。密集特征融合模块可以同时纠正高分辨率特征中缺失的空间信息,并利用非邻近特征。

7.ming hong提出一种基于知识蒸馏的图像去雾网络。该方法先使用干净图像训练一个自编码网络作为teacher网络;然后将去雾网络作为student网络,并使用teacher网络挖掘的干净图像的隐含特征和重建信息来指导有雾图像到干净图像的映射。

8.对于现有去雾方法,基本能够达到一个不错的视觉效果。但是主流的方法都有一个问题,如蒸馏学习只学中间的某一层特征,编码器解码器网络结构的中间特征也是逐层传递,缺少对不同层特征之间的学习。

技术实现要素:

9.本发明目的在于提供一种基于多特征注意力神经网络的图像去雾建模方法,通过机械深度学习使神经网络在训练过程中可以学习到精细的特征。

10.为达上述目的,本发明采用以下技术方案:

11.一种基于多特征注意力神经网络的图像去雾建模方法,包括以下步骤:

12.s1:获取原始图像、预处理图像并裁剪成预定大小;

13.s2:利用多特征注意力块对原始图像、预处理图像进行编码得到特征图;利用特征注意力块将输出的特征图恢复到原始尺寸;

14.s3:将原始图像、预处理图像中的有雾输入图像输入到构建的图像去雾网络模型中,经过图像去雾网络,得到去雾生成图;

15.将去雾生成图和原始图像、预处理图像中的真实无雾图像通过l1损失函数,得到损失值lm;

16.真实无雾图与经过去雾网络得到的去雾生成图经过预训练的vgg19网络模型计算得到感知损失lp;

17.感知损失lp和损失值lm按预定比例计算得到l

total

;

18.采用反向传播算法计算隐含层的误差,采用梯度下降算法更新图像去雾网络模型的参数;

19.s4:有雾图像输入到图像去雾网络模型得到去雾图像。

20.多特征注意力块是指采用多层特征的注意力模块,特征注意力块是指单层特征的注意力模块。

21.进一步地,s2中所述多特征注意力块是先通过卷积层对输入图像进行下采样,然后通过不同层的特征,将多层的特征通过注意力模块进行精细特征的学习。

22.进一步地,s2中所述特征注意力块分为残差模块和注意力模块。

23.残差块通过跳跃连接将数据处理后传给后续的模块,可以使低层的特征保存到后续的模块,能使整体的特征保存下来,同时残差块也能有效抑制梯度消失和梯度爆炸等情况。

24.注意力块主要关注不同的通道特征和像素具有完全不同的加权信息。注意力块不平等地处理不同的特征和像素区域,这可以在处理不同类型的信息时提供额外的灵活性,并且可以扩展cnns的表示能力。

25.所述的图像去雾重建网络模型训练模块主要在损失函数和超参数选择,本发明网络采用反向传播算法计算每一隐含层的误差,采用梯度下降算法更新神经网络参数。使用l1损失函数计算去雾图像和真实无雾图像的内容损失值。同时利用通过预训练vgg19模型去计算感知损失,vgg19网络模型是一个特征提取效果很好的模型,真实无雾图像和去雾图像经过vgg19模型,提取高层信息的特征图,并且进行均方差计算损失。

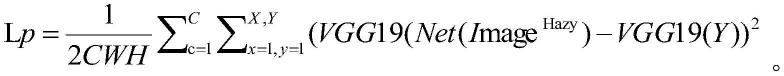

26.进一步地,s3步骤中的感知损失lp的函数为:

[0027][0028]

s3步骤中的损失值lm的函数为:

[0029][0030]

进一步地,s3步骤中的l

total

的函数为:

[0031]

l

total

=lp λlm。

[0032]

本发明与现有技术相比,具有如下优点和有益效果:

[0033]

(1)本发明所应用的多特征注意力块,是通过对不同层的特征进行结合,不局限于单层的特征计算像素的加权信息,从而得到多特征注意力信息,减少网络在编码和下采样过程中信息的损失。真实无雾图像结合有雾图像经过去雾网络得到的去雾图像,通过vgg19网络计算感知损失,并以一定比例结合感知损失和内容损失,二者一起作用于神经网络,指明了网络优化的方向,保留了特征提取的优势,有效的提高了图像去雾的真实性。

[0034]

(2)本发明所应用的注意力块主要关注不同的通道特征和像素具有完全不同的加权信息。注意力块不平等地处理不同的特征和像素区域,这可以在处理不同类型的信息时提供额外的灵活性,并且可以扩展cnns的表示能力。

附图说明

[0035]

下面根据附图和实施例对本发明作进一步详细说明。

[0036]

图1为本发明实施例图像去雾神经网络结构示意图。

[0037]

图2为本发明实施例多特征注意力层一示意图。

[0038]

图3为本发明实施例多特征注意力层二示意图。

[0039]

图4为本发明实施例多特征注意力层三示意图。

[0040]

图5为本发明实施例特征注意力层示意图。

[0041]

图6为本发明实施例残差块示意图。

[0042]

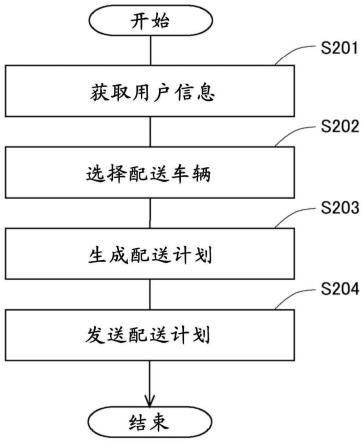

图7为本发明实施例的基于多特征注意力神经网络的图像去雾建模方法的训练流程示意图。

[0043]

图8为本发明实施例的基于多特征注意力神经网络的图像去雾建模方法效果示意图。

具体实施方式

[0044]

为使本发明解决的技术问题、采用的技术方案和达到的技术效果更加清楚,下面对本发明实施例的技术方案作进一步的详细描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域技术人员在没有作出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

[0045]

本实施例的运行条件为:nvidia1080ti gpu上训练,基于pytorch框架。操作系统为ubuntu18.04,python3.6,torch==1.3.0,torchvision==0.4.1。

[0046]

本实施例的步骤为:

[0047]

s1:获取原始图像、预处理图像,具体为:

[0048]

训练的准备工作主要是进行数据集的预处理,选用2020年计算机视觉和模式识别国际会议(cvpr2020)的比赛图集作为训练的数据集。对于训练集,首先将训练集的图像裁剪为512

×

512px的相同大小的图像。

[0049]

s2:构建图像去雾网络模型,具体为:

[0050]

s21:利用多特征注意力块对图像进行编码得到特征图;

[0051]

多特征注意力块是先通过卷积层对输入图像进行下采样,然后通过不同层的特征,将多层的特征通过注意力模块进行精细特征的学习,主要关注不同像素具有完全不同的加权信息。

[0052]

s22:利用特征注意力块将输出的特征图恢复到原始尺寸。

[0053]

特征注意力块分为两个模块,一个残差模块,一个注意力模块;

[0054]

残差块通过跳跃连接将数据处理后传给后续的模块,可以使低层的特征保存到后续的模块,能使整体的特征保存下来,同时残差块也能有效抑制梯度消失和梯度爆炸等情况;

[0055]

注意力块主要关注不同的通道特征和像素具有完全不同的加权信息。注意力块不平等地处理不同的特征和像素区域,这可以在处理不同类型的信息时提供额外的灵活性,并且可以扩展cnns的表示能力。

[0056]

其中,多特征注意力块是指采用多层特征的注意力模块;特征注意力块是指单层特征的注意力模块;

[0057]

本发明设计的单网络结构如图1所示(跳跃连接未画出,分别为第一层下采样和第三次特征注意力层,第二层下采样和第二层特征注意力层,第三层下采样和第一层特征注意力层),多特征注意力层一如图2所示,多特征注意力层二如图3所示、多特征注意力层三如图4所示、特征注意力层如图5所示,残差块如图6所示。

[0058]

s3:训练图像去雾重建网络模型进行训练,批大小(batch_size)设为1,初始学习率设为1

×

10-4

,训练的迭代次数设为30万次;具体为:

[0059]

s31:将有雾输入图像数据输入到构建的图像去雾网络模型中,经过图像去雾网

络,得到去雾的图像;

[0060]

s32:将去雾生成图和真实无雾图像通过l1损失函数,得到损失值lm;

[0061]

内容损失函数lm为:

[0062][0063]

其中:image

hazy

为有雾输入图像,image

gt

与image

hazy

对应的真实无雾图像,net为图像去雾网络模型,w、h分别为真实无雾图像的宽、高。本实施例中,w取值为512、h取值为512。

[0064]

s33:真实无雾图与经过去雾网络得到的去雾图像经过预训练的vgg19网络模型计算得到感知损失lp;

[0065]

感知损失lp的计算通过vgg19模型,真实无雾图像和去雾图像经过vgg19模型,提取高层信息的特征图,并且进行均方差计算损失。

[0066]

vgg19模型是一个具有很强的特征提取能力的模型。有雾输入图像经过网络的到的去雾图像和真实无雾图像共同经过vgg19得到第5个池化层之前的第4个卷积层的特征图,他们的特征细节得到的损失能够使本模型更具有对高层特征信息的生成能力。其中,损失函数lp为:

[0067][0068]

其中:image

hazy

为有雾输入图像,y为与image

hazy

对应的真实无雾图像,net为需要训练的图像去雾网络模型,vgg19为vgg19神经网络模型,x,y和c分别为真实无雾图像y的宽、高和通道数。本实施例中,x取值512,y取值512、c取值3。

[0069]

s34:lp和lm按一个比例进行结合得到l

total

;

[0070]

ltotal=lp λlm

[0071]

其中:λ为比例系数。本实施例中取值0.04。

[0072]

s35:采用反向传播算法计算隐含层的误差,采用梯度下降算法更新图像去雾网络模型的参数;

[0073]

对于卷积层的参数wi和偏差bi每次迭代的更新公式如下:

[0074][0075][0076]

其中:α为学习率。本实施例中取值0.0001。为偏微分符号。

[0077]

s4:有雾图像输入到图像去雾网络模型得到去雾图像。

[0078]

训练网络时,我们使用的批大小(batch_size)为1,网络进行迭代的次数设置为30万次,网络的初始学习率设为1

×

10-4,在3000次迭代后学习率减半,用到adam优化函数,并且β1=0.9,β2=0.999。每经过30000次迭代,进行一次校验并保存一次模型,可以通过查看损失函数提前终止实验,选择效果最好的模型。

[0079]

使用不同的去雾模型和去雾方法的结果如下表1。

[0080]

表1

[0081][0082][0083]

其中psnr是指peak signal to noise ratio,即峰值信噪比;ssim是指structural similarity,即结构相似性。

[0084]

此时的训练迭代次数为30万次,可见采用本发明的去雾方法的结果优于现有的去雾方法。

[0085]

于本文的描述中,需要理解的是,术语“上”、“下”、“左”、“右”、等方位或位置关系,仅是为了便于描述和简化操作,而不是指示或暗示所指的装置或元件必须具有特定的方位、以特定的方位构造和操作,因此不能理解为对本发明的限制。此外,术语“第一”、“第二”,仅仅用于在描述上加以区分,并没有特殊的含义。

[0086]

在本说明书的描述中,参考术语“一实施例”、“示例”等的描述意指结合该实施例或示例描述的具体特征、结构、材料或者特点包含于本发明的至少一个实施例或示例中。在本说明书中,对上述术语的示意性表述不一定指的是相同的实施例或示例。

[0087]

此外,应当理解,虽然本说明书按照实施方式加以描述,但并非每个实施方式仅包含一个独立的技术方案,说明书的这种叙述方式仅仅是为清楚起见,本领域技术人员应当将说明书作为一个整体,各实施例中的技术方案也可以适当组合,形成本领域技术人员可以理解的其他实施方式。

[0088]

以上结合具体实施例描述了本发明的技术原理。这些描述只是为了解释本发明的原理,而不能以任何方式解释为对本发明保护范围的限制。基于此处的解释,本领域的技术人员不需要付出创造性的劳动即可联想到本发明的其它具体实施方式,这些方式都将落入本发明的保护范围之内。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。