基于改进resnet的夜间热红外图像语义分割增强方法

技术领域

1.本发明涉及计算视觉实例分割领域和无人驾驶技术领域。更具体地说,本发明涉及一种基于改进resnet的夜间热红外图像语义分割增强方法。

背景技术:

2.夜间城市道路交通场景作为一种较为特别的道路交通场景,相比于白天视野良好下的城市交通场景而言,具有视野模糊,可见度极低,低照度下无法识别路上行人,车辆等特点。如今无人驾驶技术已经逐步渗透到人们的生活当中,用于夜间城市道路场景下的无人接驳车自动驾驶技术也成为了当下高校的研究热点。

3.基于深度卷积神经网络的夜间场景多目标分割方法,主要包括以下步骤:1)特征提取步骤:大部分算法采用单一的编码器深度网络将原始输入图像通过多个卷积层加上下采样池化层,经过多次的卷积的组合损失大量的语义信息得到两模态的特征信息;2)特征融合步骤:把特征提取步骤里面的可见光与热红外图像模态的特征信息做融合操作;元素按照简单对应位置的进行直接求和的方式得到融合特征谱,没有其他区任何计算方法来增强两模态相加时候的权重;3)上采样步骤:上采样网络由两个卷积层和数据变换层组成,确定要恢复的原始图像的高宽与两个卷积层后输出特征谱高宽相差n倍,则把输出谱按照每n2个通道中同一位置的像素点重新在一个图像中排列成n*n的区域,两个卷积层后输出特征谱经数据变换层得到恢复到原图像尺寸的特征谱。

4.由上可知,现有技术中的主流方法采用的是单一可见光,故现有夜间语义分割方法存在以下缺点:

5.1、现有方法未考虑在夜间行车场景中远距离行人,停车标识小目标重要物体分割不出的问题。

6.2、现有技术中,由于上采样和下采样过程中使用的1*1卷积变换通道的方式过于直接和粗暴,容易导致深层次的语义信息丢失。当面临图像中存在物体数量较多,出现大量遮挡时,就会出现难以有效进行融合的问题。

7.3、就算现有技术中采用了红外技术,但可见光与红外并用一个编码器,并且两模态经过编码器的提取简单相加的方式没有发挥热红外图像的信息,对夜间低照度下的热红外图像(人,车)边缘轮廓没有较好的利用,易造成融合时出现较大语义鸿沟,难以保证分割精度,以及有效的检测效果。

8.另外,以申请号为202210632703.0,专利名称为《基于改进的rtfnet纯视觉自动驾驶控制系统、方法、介质》为例,改进的rtfnet在每个红外图像的编码器中增加一个多头注意力,虽然在一定程度上提高了热红外编码器提取热红外图像的分割率,但是夜间rgb图像仍然具有丰富的纹理信息,改进的rtfnet在应用中丢弃rgb图像中的彩色信息的行为,不利于编码器中两模态的融合,更增加了解码器中上采样恢复原始图像像素的难度,使得后续的强化模型需要先验经验,在增加图像分割准确率的基础上,也大量的提高了算法的复杂度。

9.另外,以申请号为202111245617.6,专利名称为《一种基于深度卷积神经网络的语义分割方法系统》为例,此发明适用于白天视野良好的可见光图像,而对于夜间模糊的可见光图像来说,其难以进行有效的图像分割,不能满足实际应用场景的需要。

技术实现要素:

10.本发明的一个目的是解决至少上述问题和/或缺陷,并提供至少后面将说明的优点。

11.为了实现本发明的这些目的和其它优点,提供了一种基于改进resnet的夜间热红外图像语义分割增强方法,包括:

12.步骤一,将夜间的可见光图像、热红外图像分别输入至两支并行编码器中进行多次特征提取,以提取相应的热红外和可见光语义信息;

13.步骤二,通过与各编码器相配合的解码器,将步骤一中得到的热红外和可见光语义信息进行多次图像上采样操作,并经过softmax层输出带有彩色mask信息以及类别信息的图像;

14.其中,在步骤一中,各编码器均配置有将多层特征进行细化融合的深度残差网络resnet;

15.在resnet的残差结构中,将3

×

3重分组块的512通道数修改为2048通道数,并对每组通道进行独立的1

×

1卷积操作,以得到改进resnet。

16.优选的是,于,在步骤一中,两支并行编码器的始端被配置为分别输入1通道的热红外图像和3通道的可见光图像,所述可见光语义信息的提取流程被配置为包括:

17.s110,在可见光支路中,可见光图像编码器首端通过卷积层,批量归一化,relu激活函数对输入的图像像素进行筛选,以初步提取有效的语义信息;

18.s111,在可见光图像编码器进行第2次下采样时,将热红外图像以逐像素相加的方式融合进可见光图像的编码器中,得到热红外图像与可见光图像的融合层,并通过最大池化层筛选出全局权重较大的语义信息;

19.s112,采用可见光图像编码器进行第3、4、5次下采样以得到对应的可见光语义信息;

20.其中,所述可见光图像编码器的第3、4、5次下采样配置为与第2次下采样的方式一致。

21.优选的是,在步骤一中,各编码器在改进resnet后还设置有权重筛选用的通道空间注意力分配权重模块cbam。

22.优选的是,所述cbam对图像通道维度进行分组,在每组通道中进行空间维度的注意力操作,学习多种语义信息,以通过局部与全局卷积的方式获取空间注意力信息,基于全局与局部像素相似性的策略指导空间维度的语义特征分布。

23.优选的是,在cbam中,对于高、宽、通道为h

×w×

c的特征图,采用全局与局部像素相似性策略指导空间维度的语义特征分布的方法被配置为包括:

24.s120,将输入图像沿通道维度分为l组,将l组通道维度包含的所有特征空间信息用向量表示为xi={x1,x2…

xd},其中,d=h

×

w;

25.s121,在l组通道的空间维度特征中,对于各组特征空间信息,利用空间平均函数fgap

(

·

)来近似各组学习到的全局特征;

26.s122,将s121得到的全局特征与每组空间特征做点积,以生成每个特征对应的权重系数,以表示全局特征与局部特征之间的相似性。

27.优选的是,在步骤二中,所述解码器架构是在rtfnet解码器基础上的进行优化以得到,以将特征图恢复到原始图像,所述优化包括:

28.删除rtfnet解码器中的两个连续的1

×

1卷积,且在转置模块中增加了一个额外的转置卷积分支transconv 2。

29.优选的是,每个基于残差的转置模块包含一个3

×

3卷积和一个基于残差的转置卷积。

30.优选的是,转置模块被配置为还包括与转置卷积分支transconv 2相配合的转置卷积transconv 1,以及设置在transconv 1上端的卷积层conv 1;

31.其中,图像通过conv 1后的分辨率大小和原图一样,但特征通道数会减少2倍,而transconv 1卷积层保持通道数不变,分辨率增加了2倍;

32.transconv 2则增加分辨率并减少特征通道的数量,以通过渐进上采样的方式生成预测图。

33.本发明至少包括以下有益效果:其一,本发明首次将语义分割算法应用在了夜间校园道路场景下进行分割,同时本发明在将红外摄像头应用于语义分割时,采用编码器-解码器的结构,由两支并行的编码器及一个共用的解码器构成,使得其在后期融合时,可以有效应用红外图像,其有效的语义信息提取效果更好,更能将道路环境中的柱状护栏、路障、车辆停止标识等小目标提取出来。

34.其二,本发明采用注意力机制的手段和改进的残差提取网络进一步关注细节信息,将神经网络进一步细化提取到的目标特征,保留小目标信息。并将各层的特征信息消除语义差距之后进行有效融合,获取到目标的深层次语义信息,使防止关键的网络的权重信息被丢弃,使权重更为平滑,进一步的确定分割目标的类型。在面对夜间目标遮挡,和物体残缺的情况下,该算法的性能会大于其他算法,具体来说,本发明提升了语义分割算法在夜间情况下对人的分割精度( 1.9%)和召回率( 1.4%),柱状护栏、路障、车辆停止标识小目标的像素分割准确率分别提升了(4.8%,2.4%,1.0%)。

35.本发明的其它优点、目标和特征将部分通过下面的说明体现,部分还将通过对本发明的研究和实践而为本领域的技术人员所理解。

附图说明

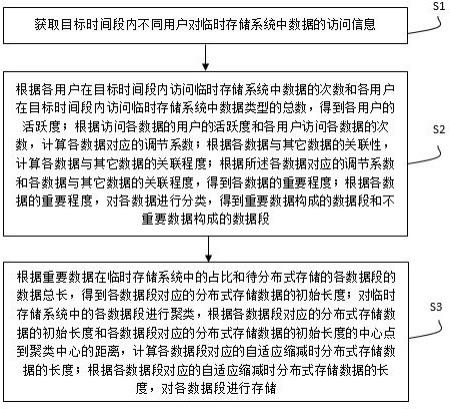

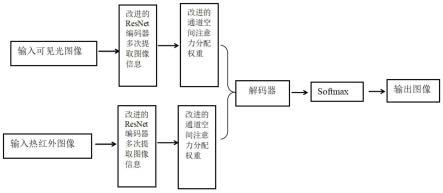

36.图1为本发明的网络结构示意图;

37.图2为现有技术中的残差结构示意图;

38.图3为本发明改进后的残差结构示意图;

39.图4为本发明通道空间注意力分配权重模块的结构示意图;

40.图5为本发明解码器优化的解码结构示意图;

41.图6为本发明实施例中夜间可见光摄像头采集的图像;

42.图7为本发明实施例中夜间红外摄像头采集的图像;

43.图8为采用现有技术对夜间道路进行语义分割后的效果图;

44.图9为采用本发明的方法对夜间道路进行语义分割后的效果图。

具体实施方式

45.下面结合附图对本发明做进一步的详细说明,以令本领域技术人员参照说明书文字能够据以实施。

46.本发明对现有夜间道路低照度环境下存在目标过小、目标残缺,难以准确分割目标等问题进行针对性的改进并实现语义分割,即提供了一种基于深度神经网络的用于夜间道路交通场景使用的语义分割方法,目的在于夜间道路场景下无人车在低速环境下对周围环境进行实时视觉感知,包含以下步骤:

47.步骤1:将待检测的两模态可见光与热红外图像信息传入到本发明的网络框架中,在编码器中进行多次特征提取。

48.步骤2:将多层特征信息送入到编码器中改进后的resnet中进行细化并融合。

49.步骤3:将融合后的信息送入通过resnet提取的信息再次经过改进的注意力机制进行筛选权重,增强语义分割的效果。

50.步骤4:将编码区所得到大量测信息进行经简化的解码器,减少计算量的同时,不失编码器中提取的细节信息进行相应的上采样恢复到原始像素大小。

51.步骤5:将所得的原始像素大小的图像经过softmax进行分类预测分割出各自属于的类别。本发明被用作无人接驳车环境感知部分,不同于单一可见光摄像头对道路环境信息进行采集,结合flira650热红外相机采集的环境信息一并传入到本发明所涉及到的深度卷积神经网络之中,能够对夜间低照度图像中的所需特征物体,例如行人、车辆、自行车等进行像素级的分割,并按照每个独立的物体打上彩色掩码,本发明能准确的获得各个目标物体的掩码信息,其相对于现有的改进resnet技术来说,本发明的编码器改进能提高对两模态图像的信息利用率,解码器的改进也对编码器中提取到的图像信息进行上采样恢复到原始图像大小也起着十分重要的作用,故其效果相对于现有的改进resnet技术来说,其分割效果更为优异。

52.进一步,针对现有方法未考虑在编码器网络处理可见光与热红外图像信息权重分配问题,导致提取出来的特征信息丢失。基于此,本发明在这两点上进行了针对性处理,通过对传统的resnet轻量级改进,并融合改进的通道空间注意力机制。最终通过如图1的网络结构,作出了改善并完成了更优的语义分割结果。故对本发明的方案进一步拓展来说,本发明的处理流程可以包括:

53.步骤1.采用编码器-解码器的结构,由两支并行的编码器及一个共用的解码器构成。两支并行编码器始端分别输入1通道的热红外图像和3通道的可见光图像。在可见光支路中,编码器首端由卷积层,批量归一化,relu激活函数对输入的图像像素进行筛选,初步提取有效的语义信息。在热红外支路中进行与可见光支路同样的操作,确保并行的两支编码器呈现对称模块,方便在编码器中的两模态像素相加融合。

54.步骤2:在可见光图像编码器第2次下采样时,通过热红外图像与可见光图像的融合层,将热红外图像以逐像素相加的方式融合进可见光图像的模块,经过最大池化层筛选出全局权重较大的语义信息,缩小特征像素尺寸。

55.步骤3:在每个改进resnet后加入通道空间注意力机制模块,以加强对不同模态空

间显著性细节信息的提取。编码器的第3、4、5次下采样与第2次下采样类似。

56.步骤4:与目前语义分割中编码-解码网络类似,解码器部分将双路编码器中5次下采样操作提取的热红外和可见光语义信息,进行5次图像上采样操作,最终在编码器末端恢复到原始输入图像的像素大小,经过softmax层进行融合像素的分类。

57.步骤5:最终输出对应物体的在原图像上的mask信息以及所对应的物体类别信息。在本方案中,本发明设计了一种新颖的端到端并行的夜间图像增强算法,其推理速度与准确率均优于原算法,能够适用于多种道路交通场景,具有较强的鲁棒性。

58.实施例:

59.步骤1:首先在编码器中当resnet网络层数大于34层后残差结构如图2所示。图2中,残差结构首先用1

×

1的卷积通道个数来降维,中间用3

×

3的卷积瓶颈单元接收输入的通道,最后同样用1

×

1卷积进行通道升维,恢复到起始的维数。在该结构中,1

×

1的卷积层主要用来维持通道维数一致,不具有较强的特征提取能力也将限制了网络的特征学习能力。极易丢失为数不多的可利用图像信息,同时还易引入噪声,对后续的目标分割造成不利影响。针对此在改进的分组残差结构中,把输入的通道数分为多组,对每组进行独立的卷积操作,使不同特征图之间的耦合性降低,关注的特征不同,得到互相补充的特征图,如图3,将3

×

3重分组块的512通道数变为1

×

1的卷积模块较多的2048通道数,使原残差结构扩大了4倍的空间信息通道。将输入通道分成多组,对每组分别进行卷积运算,加强特征提取能力,同时提升对两模态图像信息的利用率。

60.步骤2:通过编码器中的resnet后,如图4,卷积、池化运算会存在图像局部感受野失真的情况,易使小目标特征像素丢失,进而导致小目标物体无法被完整正确分割。视觉注意力机制通过观察全局图像,关注重点的目标区域,这些区域往往就包含了场景中显著的小目标。现有的通道空间注意力分配权重模块cbam使用全连接计算权值并进行跨通道的降维与交互。同空间注意模块降维相似,通道降维会损失大量的语义信息,且使用所有通道信息是低效的。而cbam可通过局部与全局卷积的方式获取空间注意力信息,因此利用全局与局部像素相似性的策略指导空间维度的语义特征分布。将图像通道维度分组,在每组通道中进行空间维度的注意力操作,学习多种语义信息,撅弃cbam中传统的全连接层,减少大量无意义的计算量。结构如图4所示,在图4中一个高、宽、通道为h

×w×

c的特征图。首先将输入图像沿通道维度分为l组,将l组通道维度包含的所有特征空间信息用向量表示为xi={x1,x2…

xd},其中,d=h

×

w。其次,在l组通道的空间维度特征中,每组空间具有物体的某一特征信息,因此在此区域拥有更大的向量长度。为加强对重要区域特征信息的学习,使用整组特征空间的信息,利用空间平均函数f

gap

(

·

)来近似该组学习到的全局特征,计算公式为(1)。将全局特征与每组空间特征做点积生成每个特征对应的系数,表示了全局特征l与局部特征之间的相似性,采用这种方式对各种目标的权重进行分类,以进一步便于将小目标提取出来。

[0061][0062]ci

=l

·

xiꢀꢀꢀ

(2)

[0063]

式中:l表示全局特征平均像素,ci表示全局与局部特征的相似性系数。如xi为某一

小物体显著的向量特征,具有较大值,则与全局特征平均像素l相乘,具有较大的像素ci表示此位置小物体向量特征像素是重点需要关注的。

[0064]

步骤3:如图5,解码器的主要设计目的是有效地利用多级信息来对细节像素细化。解码器架构是从rtfnet解码器改进而来,将特征图恢复到原始图像。与rtfnet不同的是,避免解码器中复杂的上采样过程,删除了原始模块的两个连续的1

×

1卷积。转置块b包含一个额外的分支来扩大感受野和一个残差连接来保存信息。在转置模块b中,它由conv 1和两个transconv层组成。每个基于残差的转置模块包含一个3

×

3卷积和一个基于残差的转置卷积。图像通过conv 1卷积层的分辨率大小和原图一样,但特征通道数会减少2倍,而transconv 1卷积层保持通道数不变,分辨率增加了2倍。与transconv 1不同的是,transconv 2需要增加分辨率并减少特征通道的数量。最后,解码器为获得更多细节信息,以渐进上采样的方式生成最终的预测图。

[0065]

步骤4:通过以上几步经解码器最后的softmax层,输出带有彩色mask信息以及类别信息的图像。在本实施例中,本发明采用注意力机制的手段和改进的残差提取网络进一步关注细节信息,将神经网络进一步细化提取到的目标特征,保留小目标信息。并将各层的特征信经过一次改进的resnet粗采样与注意力细采样之后进行有效融合,获取到目标的深层次语义信息,使防止关键的网络的权重信息被丢弃,使权重更为平滑,进一步的确定分割目标的类型。如图6-9,是对于相同的夜间道路场景下,本发明与现有技术的方法分别进行处理时的效果对比图,可知本发明相对于现有技术的方法来说,其对于小目标分割的精确度明显提高。

[0066]

以上方案只是一种较佳实例的说明,但并不局限于此。在实施本发明时,可以根据使用者需求进行适当的替换和/或修改。

[0067]

这里说明的设备数量和处理规模是用来简化本发明的说明的。对本发明的应用、修改和变化对本领域的技术人员来说是显而易见的。

[0068]

尽管本发明的实施方案已公开如上,但其并不仅仅限于说明书和实施方式中所列运用。它完全可以被适用于各种适合本发明的领域。对于熟悉本领域的人员而言,可容易地实现另外的修改。因此在不背离权利要求及等同范围所限定的一般概念下,本发明并不限于特定的细节和这里示出与描述的图例。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。