1.本发明涉及自动化领域,具体涉及一种基于目标识别和机器人的自动拆装电缆方法。

背景技术:

2.智能化自动化是工业发展的趋势,通过智能设备的集成从而达到的自动化作业,可以最大程度的减少人为作业从而可能产生的错误及危险等。视觉识别系统的空间定位功能、自动化设备作业功能与检测设备及系统的对接方面,国内外均未达到成熟的地步。

3.目前变压器检测采用传统人工接线的拆装方式存在不可控的因素,有一定的安全风险,检测的配电变压器的种类比较多,试验项目也比较多,有绕组电阻测量,绝缘电阻测试,工频耐压试验,感应耐压试验和负载损耗测量,空载损耗和空载电流测量等。面对复杂的试验,现在国内外接线方式普遍都是采用人工手动接线的拆装方式,人工手动接线的缺点在于,耗费时间长,接线的好差影响数据的准确性;劳动强度大,且存在一定的安全风险。而且接线工作也只是相对并不复杂的重复劳动,如何提供一种全流程自动化智能试验装置,可实现试验的自动接线,一次性完成变压器的检测试验成为需要迫切解决的技术问题。

4.现有技术中,如专利“印刷电路板与fpc柔性电缆线的装配方法及相关设备”(cn114347013a),仅提供了一种印刷电路板和电缆的装配方法,并未解决电缆拆装的自动装拆的问题。

技术实现要素:

5.针对上述背景技术提出的问题,提出一种基于目标识别和机器人的自动拆装电缆方法。

6.基于目标识别和机器人的自动拆装电缆方法,包括如下步骤:步骤1,从彩色ccd相机中获取电缆的rgb图像;步骤2,将rgb像素转换成为另一种颜色空间cielab;步骤3,对图像中相同像素的连通域blob进行分析;步骤4,把分析返回的结果保存,完成目标识别;步骤5,根据目标识别,控制基于机器人的机械部分做相应的运动,移动至目标识别得到的位置,进行电缆的拆装。

7.进一步地,步骤1中,彩色ccd相机采用基于双目结构光技术和ai智能算法开发的3d相机,对测量深度范围内散乱的电缆进行全自由的识别、定位,再控制机器人进行抓取。

8.进一步地,彩色ccd相机安装于微调平台上,通过微调平台调节彩色ccd相机高度和水平度,进而调节相机的成像效果;微调平台同支架安装于伺服模组上,通过伺服电机实现电缆的平移或者以电缆中心为原点进行旋转运动。

9.进一步地,步骤3中,经二值化处理后的图像中色斑视为blob目标,通过分析工具从图像背景中分离出blob目标,并计算出blob目标的数量、位置、形状、方向和大小,并提供

相关blob目标之间的拓扑结构;在处理过程中对图形的行进行操作,图像的每一行都用游程长度编码rle来表示相邻的目标范围。

10.进一步地,步骤4中,根据分析的结果,存入数据库进行信息管理,提供检索查询。

11.进一步地,步骤5中,基于机器人的机械部分中,机器人采用具备夹持装置的六轴机器人,相对于相机的位置固定。

12.进一步地,通过相机与机器人进行坐标系标定,计算出像素分辨率;记录下机器人在相机采集图像时的坐标和ccd检测到的blob目标的坐标;检测时,在ccd中计算新的连通域坐标与模板标定时的ccd坐标的偏差,转换成以mm为单位的值,最后把偏差值加上机器人坐标,即为新的机器人需要操作的坐标。

13.进一步地,对于网络资源足够的设备,采用云计算卸载的形式,将图像数据在云端进行处理。

14.进一步地,对于资源有限的设备,对采集到的高分辨率图像,使用嵌入式gpu设备在边缘计算处理图像。

15.进一步地,对于资源有限的设备,将一部分计算任务转移到云上,另一部分通过边缘计算处理。

16.本发明达到的有益效果为:1)采用的双目3d相机,稳定性高,固定安装在可调的机械组件上,以确保重复性。

17.2)利用3d机器视觉提供的深度测量信息,消除由于物体位置(距传感器的距离)而导致的误差,物体可以在传感器的测量体积内的任何位置移动,并仍能得到准确的结果,简化了物体固定要求,并降低了系统设计和维护成本。

18.3)实现了流水线的自动化改造,得到快速、实时、准确、高效的流水线。

19.4)采用机器视觉的自动识别技术,结合机器人,完成以前由人工来完成的工作,避免用人工检查产品而易发生的质量效率低且精度不高的问题,用目标识别结合机器人的方法可以大大提高生产效率和生产的自动化程度。

附图说明

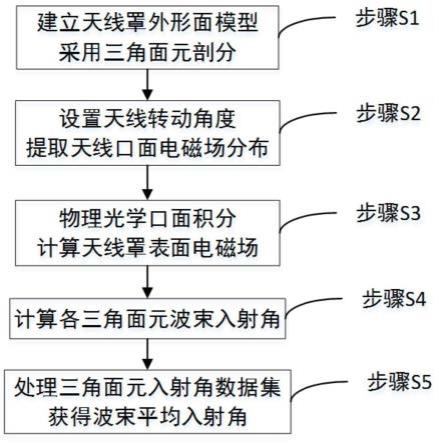

20.图1为本发明实施例中的目标识别的流程示意图。

21.图2为本发明实施例中的六轴机器人的原理图。

22.图3为本发明实施例中的每个消息类型的云执行时间示意图。

23.图4为本发明实施例中的各消息类型的端到端网络延迟示意图。

24.图5为本发明实施例中的用户应用程序每秒接收的帧数示意图。

具体实施方式

25.下面结合说明书附图对本发明的技术方案做进一步的详细说明。

26.参照图1,在机器视觉检测系统工作流程中,主要分为图像信息获取、图像信息处理和机电系统执行检测结果3个部分,另外根据系统需要还可以实时地通过人机界面进行参数设置和调整。

27.当被检测的对象运动到某一设定位置时会被位置传感器发现,位置传感器会向plc控制器发送“探测到被检测物体”的电脉冲信号,plc控制器经过计算得出何时物体将移

动到ccd相机的采集位置,然后准确地向图像采集卡发送触发信号,采集开检测的此信号后会立即要求ccd相机采集图像。被采集到的物体图像会以bmp文件的格式送到工控机,然后调用专用的分析工具软件对图像进行分析处理,得出被检测对象是否符合预设要求的结论,根据“合格”或“不合格”信号,执行机会对被检测物体作出相应的处理。系统如此循环工作,完成对被检测物体队列连续处理。

28.一个完整的机器视觉检测系统的主要工作过程如下:

①

电缆定位传感器探测到被检测物体已经运动到接近机器视觉摄像系统的视野中心,向机器视觉检测系统的图像采集单元发送触发脉冲。

29.②

机器视觉检测系统的图像采集单元按照事先设定的程序和延时,分别向摄像机和照明系统发出触发脉冲。

30.③

机器视觉摄像机停止目前的扫描,重新开始新的一帧扫描,或者机器视觉摄像机在触发脉冲来到之前处于等待状态,触发脉冲到来后启动一帧扫描。

31.④

机器视觉摄像机开始新的一帧扫描之前打开电子快门,曝光时间可以事先设定。

32.⑤

另一个触发脉冲打开灯光照明,灯光的开启时间应该与机器视觉摄像机的曝光时间相匹配。

33.⑥

机器视觉摄像机曝光后,正式开始新一帧图像的扫描和输出。

34.⑦

机器视觉检测系统的图像采集单元接收模拟视频信号通过a/d转换器将其数字化,或者是直接接收机器视觉摄像机数字化后的数字视频信号。

35.⑧

处理结果控制生产流水线的动作、进行定位、纠正运动的误差等。

36.从上述的工作流程可以看出,机器视觉检测系统是一种相对复杂的系统。大多监控和检测对象都是运动的物体,系统与运动物体的匹配和协调动作尤为重要,所以给系统各部分的动作时间和处理速度带来了严格的要求。在某些应用领域,例如机器人、飞行物体制导等,对整个系统或者系统的一部分的重量、体积和功耗等都会有严格的要求。

37.总结归纳,机器视觉检测主要包含以下几个过程:

①

图像采集:光学系统采集图像,将图像转换成数字格式并传入计算机存储器。

38.②

图像处理:处理器运用不同的算法来提高对检测有影响的图像因素。

39.③

特征提取:处理器识别并量化图像的关键特征,例如位置、数量、面积等,然后将这些数据传送到控制程序。

40.④

判别和控制:处理器的控制程序根据接收到的数据做出结论。例如:位置是否合乎规格,或者执行机构如何移动去拾取某个部件。

41.机器视觉系统包括以下三大块:视觉检测照明:照明是影响机器视觉系统输入的重要因素,它直接影响输入数据的质量和应用效果。由于没有通用的机器视觉照明设备,所以针对每个特定的应用实例,要选择相应的照明装置,以达到最佳效果。光源可分为可见光和不可见光。常用的几种可见光源是白炽灯、日光灯、水银灯和钠光灯。可见光的缺点是光能不能保持稳定。如何使光能在一定的程度上保持稳定,是实用化过程中急需要解决的问题。另一方面,环境光有可能影响图像的质量,所以可采用加防护屏的方法来减少环境光的影响。照明系统按其照射方法可分为:背向照明、前向照明、结构光和频闪光照明等。其中,背向照明是被测物放在光源和摄

像机之间,它的优点是能获得高对比度的图像。前向照明是光源和摄像机位于被测物的同侧,这种方式便于安装。结构光照明是将光栅或线光源等投射到被测物上,根据它们产生的畸变,解调出被测物的三维信息。频闪光照明是将高频率的光脉冲照射到物体上,摄像机拍摄要求与光源同步。

42.视觉检测镜头:fov(fieldofvision)=所需分辨率*亚象素*相机尺寸/prtm(零件测量公差比)。

43.镜头选择应注意:

①

焦距、

②

目标高度、

③

影像高度、

④

放大倍数、

⑤

影像至目标的距离、

⑥

中心点/节点、

⑦

畸变。

44.视觉检测中如何确定镜头的焦距,为特定的应用场合选择合适的工业镜头时必须考虑以下因素:视野(被成像区域的大小)、工作距离wd(摄像机镜头与被观察物体或区域之间的距离)、ccd(摄像机成像传感器装置的尺寸)。

45.这些因素必须采取一致的方式对待。如果在测量物体的宽度,则需要使用水平方向的ccd规格,等等。如果以英寸为单位进行测量,则以英尺进行计算,最后再转换为毫米。

46.参考如下例子:有一台1/3”c型安装的cdd摄像机(水平方向为4.8毫米)。物体到镜头前部的距离为12”(305毫米)。视野或物体的尺寸为2.5”(64毫米)。换算系数为1”=25.4毫米(经过圆整)。

47.fl=4.8毫米x305毫米/64毫米,fl=1464毫米/64毫米,fl=按23毫米镜头的要求,fl=0.19”x12”/2.5”,fl=2.28”/2.5”,fl=0.912”x25.4毫米/inch,fl=按23毫米镜头的要求。

48.需注意的是,勿将工作距离与物体到像的距离混淆。工作距离是从工业镜头前部到被观察物体之间的距离。而物体到像的距离是ccd传感器到物体之间的距离。计算要求的工业镜头焦距时,必须使用工作距离。

49.视觉检测相机:按照不同标准可分为:标准分辨率数字相机和模拟相机等。要根据不同的实际应用场合选不同分辨率相机:线扫描ccd和面阵ccd;单色相机和彩色相机。

50.视觉检测图像采集:图像采集卡只是完整的机器视觉系统的一个部件,但是它扮演一个非常重要的角色。图像采集卡直接决定了摄像头的接口:黑白、彩色、模拟、数字等等。

51.比较典型的是pci或agp兼容的捕获卡,可以将图像迅速地传送到计算机存储器进行处理。有些采集卡有内置的多路开关。例如,可以连接8个不同的摄像机,然后告诉采集卡采用那一个相机抓拍到的信息。有些采集卡有内置的数字输入以触发采集卡进行捕捉,当采集卡抓拍图像时数字输出口就触发闸门。

52.视觉处理器:视觉处理器集采集卡与处理器于一体。以往计算机速度较慢时,采用视觉处理器加快视觉处理任务。由于采集卡可以快速传输图像到存储器,而且计算机也快多了,所以视觉处理器用的较少了。

53.在机器视觉系统中,获得一张高质量的可处理的图像是至关重要。系统之所以成功,首先要保证图像质量好,特征明显。一个机器视觉项目之所以失败,大部分情况是由于图像质量不好,特征不明显引起的。要保证好的图像,必须要选择一个合适的光源。

54.光源选型基本要素:对比度:对比度对机器视觉来说非常重要。机器视觉应用的照明的最重要的任务就是使需要被观察的特征与需要被忽略的图像特征之间产生最大的对比度,从而易于特征

的区分。对比度定义为在特征与其周围的区域之间有足够的灰度量区别。好的照明应该能够保证需要检测的特征突出于其他背景。

55.亮度:当选择两种光源的时候,最佳的选择是选择更亮的那个。当光源不够亮时,可能有三种不好的情况会出现。第一,相机的信噪比不够;由于光源的亮度不够,图像的对比度必然不够,在图像上出现噪声的可能性也随即增大。其次,光源的亮度不够,必然要加大光圈,从而减小了景深。另外,当光源的亮度不够的时候,自然光等随机光对系统的影响会最大。

56.鲁棒性:另一个测试好光源的方法是看光源是否对部件的位置敏感度最小。当光源放置在摄像头视野的不同区域或不同角度时,结果图像应该不会随之变化。方向性很强的光源,增大了对高亮区域的镜面反射发生的可能性,这不利于后面的特征提取。

57.好的光源需要能够使你需要寻找的特征非常明显,除了是摄像头能够拍摄到部件外,好的光源应该能够产生最大的对比度、亮度足够且对部件的位置变化不敏感。光源选择好了,剩下来的工作就容易多了。具体的光源选取方法还在于试验的实践经验。

58.一般而言,从彩色ccd相机中获取的图像都是rgb图像。也就是说每一个像素都由红(r)绿(g)蓝(b)三个成分组成,来表示rgb色彩空间中的一个点。问题在于这些色差不同于人眼的感觉。即使很小的噪声也会改变颜色空间中的位置。所以无论人眼感觉有多么的近似,在颜色空间中也不尽相同。基于上述原因,需要将rgb像素转换成为另一种颜色空间cielab。目的就是使人眼的感觉尽可能的与颜色空间中的色差相近。

59.blob检测:根据上面得到的处理图像,根据需求,在纯色背景下检测杂质色斑,并且要计算出色斑的面积,以确定是否在检测范围之内。因此图像处理软件要具有分离目标,检测目标,并且计算出其面积的功能。

60.blob分析(blobanalysis)是对图像中相同像素的连通域进行分析,该连通域称为blob。经二值化(binarythresholding)处理后的图像中色斑可认为是blob。blob分析工具可以从背景中分离出目标,并可计算出目标的数量、位置、形状、方向和大小,还可以提供相关斑点间的拓扑结构。在处理过程中不是采用单个的像素逐一分析,而是对图形的行进行操作。图像的每一行都用游程长度编码(rle)来表示相邻的目标范围。这种算法与基于象素的算法相比,大大提高处理速度。

61.结果处理和控制:应用程序把返回的结果存入数据库或用户指定的位置,并根据结果控制机械部分做相应的运动。

62.根据识别的结果,存入数据库进行信息管理。以后可以随时对信息进行检索查询,管理者可以获知某段时间内流水线的忙闲,为下一步的工作作出安排;可以获知电缆的质量情况等等。

63.3d相机安装于微调平台上,通过微调平台可以调节3d相机高度和水平度,进而调节相机的效果;微调平台同支架安装于伺服模组上,通过伺服电机可以实现电缆的平移或者以电缆中心为原点进行旋转运动;(电缆做旋转运动仅仅安装1个3d相机,如果仅仅做平移运动需要2个相机平排安装)相机与六轴机器人之间通过偏差移动相机拍照位固定,机器人安装固定。

64.①

通过相机与机器人进行坐标系标定计算出像素分辨率。

65.②

通过模板标定记录下机器人在拍照位的坐标和ccd检测特征点的坐标。

66.③

检测时候只需要计算在ccd中,新的特征点坐标与模板标定时候的ccd坐标的偏差offsetx,offset,转换成以mm为单位的值。(主要是包含角度的计算)。最后把偏差值加上机器人坐标,即为新的机器人要走的坐标。此时可以保证机器人上有一个激光打出来,不管物件特征点怎么偏置,都能找准。

67.六轴机器人的运用:1.相机非线性校正:使用标定板做非线性校正。

68.2.相机与机器人做9点标定:可以使用机器人扎9个点,或者机器人抓住电缆摆放9个位置,得到9个机械坐标,相机也得到9个像素坐标,然后标定。

69.3.计算机器人的旋转中心:机器人抓取电缆分别旋转三个角度摆放到相机视野内,相机可以得到三个坐标值,通过三个坐标值拟合圆获得圆心坐标即为旋转中心。

70.4.相机通过公式计算得出最终的输出结果,(rx0,ry0)为旋转中心,(x,y)为被旋转的点,(x0,y0)旋转后的点:x0=cos(a)*(x-rx0)

–

sin(a)*(y-ry0) rx0;y0=cos(a)*(y-ry0) sin(a)*(x-rx0) ry0。

71.5.通过计算得到的输出结果,操作电缆进行旋转和移动,完成拆装。

72.本实验构建具有深度学习应用程序的深脑系统,通过评估计算对3d相机结合机器人可行性和有效性。

73.云服务器和gpu服务器:dreammapplanner作为3d相机和gpu服务器之间的中继,硬件包括gp1.hyperspeedflavor、16gbram、8个虚拟cpu、80gb硬盘、ubuntu16.04操作系统。gpu服务器负责执行深度学习的计算机视觉算法,用于目标检测和被检测对象的地理定位。gpu硬件包括nvidiageforcegtx1080显卡,8gb内存,频率为3.7ghz的intelcorei7-8700k处理器。

74.通过能耗、云服务器利用率和实时性三个指标来评估deepbrain性能。能耗是将深度学习算法在和云端上运行的能耗进行比较;云服务器利用率是通过计算有无负载两种情况的带宽使用率评估;实时性是评估有无计算卸载时的deepbrain架构的响应时间。

75.当存在计算3d相机使用roslink协议将数据从raspberrypi传输到云端,在gpu服务器上进行远程处理;在无需计算卸载的情况下实时处理采集的图像数据。实验中使用不同的3s和4s锂聚合物电池为raspberrypi和nvidiajetsontx2板供电。

76.图3是每个消息类型的云执行时间,图4是各种消息类型的端到端网络延迟。

77.图5描述了两种情况下用户应用程序每秒接收的帧数(fps)。在第一种情况下,图像数据从raspberrypi单板计算机传输,该计算机使用navio2,称为rpi。在第二种情况下,图像数据从i5处理器和8gb的ram的计算机上传输,称为ria,它是gaitechriae100机器人的机载计算机。测试两台不同计算能力计算机的目的是评估其对数据传输质量的影响。

78.压缩可以显著增加每秒从终端用户接收的帧数。在raspberrypi拖缆的情况下,每秒的帧数从1fps增加到4fps(四倍以上),而在ria中,它从22fps略微减少到20fps。总之,图像压缩有助于提高流媒体服务质量,特别是在低容量设备中。

79.先进的计算机可以提高速率传输帧,终端用户处接收到的帧的数量也显著变化。发送更多的帧会在网络中引起额外的延迟和抖动,从而影响最终用户接收图像帧的规律性。然而,50%的图像以16fps到22fps的速率接收,这相对于接收器处的帧速率提供了较好

的服务质量。

80.以上所述仅为本发明的较佳实施方式,本发明的保护范围并不以上述实施方式为限,但凡本领域普通技术人员根据本发明所揭示内容所作的等效修饰或变化,皆应纳入权利要求书中记载的保护范围内。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。