1.本发明涉及计算机技术领域,尤其涉及一种基于移动端的眼底图像分类方法及系统。

背景技术:

2.视网膜眼底图像是观察和诊断眼科疾病的重要手段,随着计算机技术的发展,计算机和软件为医疗行业赋能,而在视网膜眼底图像分析领域也贡献了一定的作用,作为辅助手段提升图像分析的效率和效果。

3.目前一般通过深度学习,构建较为复杂的网络模型,进行视网膜眼底图像的分析处理,且一般针对单个病种的分析处理。

4.现有技术中的视网膜眼底图像分析处理需要基于复杂的网络模型,运算效率较低,响应时间较长,无法在移动端进行轻量化的快捷的图像分析处理,且一般仅根据眼底图像针对单一病种进行分析处理,存在着计算资源占用大、时效便捷性差以及功能较为单一的技术问题。

技术实现要素:

5.本技术的目的是提供一种基于移动端的眼底图像分类方法及系统,用以针对解决现有技术中现有技术中视网膜眼底图像分析处理存在的计算资源占用大、时效便捷性差以及功能较为单一的技术问题。

6.鉴于上述问题,本技术提供了一种基于移动端的眼底图像分类方法及系统。

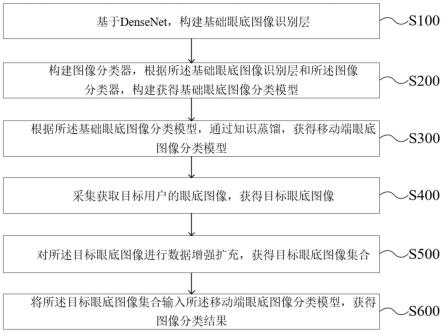

7.第一方面,本技术提供了一种基于移动端的眼底图像分类方法,所述方法包括:基于densenet,构建基础眼底图像识别层;构建图像分类器,根据所述基础眼底图像识别层和所述图像分类器,构建获得基础眼底图像分类模型;根据所述基础眼底图像分类模型,通过知识蒸馏,获得移动端眼底图像分类模型;采集获取目标用户的眼底图像,获得目标眼底图像;对所述目标眼底图像进行数据增强扩充,获得目标眼底图像集合;将所述目标眼底图像集合输入所述移动端眼底图像分类模型,获得图像分类结果。

8.另一方面,本技术还提供了一种基于移动端的眼底图像分类系统,用于执行如第一方面所述的一种基于移动端的眼底图像分类方法,其中,所述系统包括:基础识别层构建模块,用于基于densenet,构建基础眼底图像识别层;基础识别模型构建模块,用于构建图像分类器,根据所述基础眼底图像识别层和所述图像分类器,构建获得基础眼底图像分类模型;移动端识别模型构建模块,用于根据所述基础眼底图像分类模型,通过知识蒸馏,获得移动端眼底图像分类模型;眼底图像采集模块,用于采集获取目标用户的眼底图像,获得目标眼底图像;图像增强扩充模块,用于对所述目标眼底图像进行数据增强扩充,获得目标眼底图像集合;图像识别分类模块,用于将所述目标眼底图像集合输入所述移动端眼底图像分类模型,获得图像分类结果。

9.本技术中提供的一个或多个技术方案,至少具有如下技术效果或优点:

10.本技术提供的技术方案通过基于densenet,在本地构建计算资源占用较大的基础眼底图像识别层,且能够保证在网络中各层之间最大信息传输的前提下,通过密集连接所有网络层的特征图,实现特征重用,提升图像分析处理的效率和准确性,并构建图像分类器,实现多病种的分类识别预测,提升视网膜眼底图像与深度学习结合的功能维度,继而通过知识蒸馏,采用teacher-student模式,获得轻量化但性能较好的移动端眼底图像分类模型,实现在移动端进行快捷、智能、准确的眼底图像识别分析处理,降低模型在移动端的计算资源占用,提升响应效率,然后采集获取当前用户的视网膜眼底图像,进行数据增强扩充,提升图像数据维度,进而提升图像数据分析处理的准确性,输入移动端眼底图像分类模型,获得当前用户的视网膜眼底图像的图像分类结果,本技术实现了在移动端基于深度学习进行较为复杂的眼底图像分析处理,更为轻量化和便捷,且能够进行多病种的图像识别分类,功能更为丰富,达到了降低眼底图像识别处理的计算资源占用,提升移动端使用的时效性和便捷性,以及丰富眼底图像识别处理功能的技术效果。

11.上述说明仅是本技术技术方案的概述,为了能够更清楚了解本技术的技术手段,而可依照说明书的内容予以实施,并且为了让本技术的上述和其它目的、特征和优点能够更明显易懂,以下特举本技术的具体实施方式。

附图说明

12.为了更清楚地说明本技术或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是示例性的,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据提供的附图获得其他的附图。

13.图1为本技术实施例提供的一种基于移动端的眼底图像分类方法的流程示意图;

14.图2为本技术实施例提供的一种基于移动端的眼底图像分类方法中基础眼底图像识别层的基础网络结构的示意图;

15.图3为本技术实施例提供的一种基于移动端的眼底图像分类方法中获得基础眼底图像分类模型的流程示意图;

16.图4为本技术实施例提供的一种基于移动端的眼底图像分类方法中获得移动端眼底图像分类模型的流程示意图;

17.图5为本技术实施例提供的一种基于移动端的眼底图像分类系统的结构示意图。

18.附图标记说明:基础识别层构建模块11,基础识别模型构建模块12,移动端识别模型构建模块13,眼底图像采集模块14,图像增强扩充模块15,图像识别分类模块16。

具体实施方式

19.本技术通过提供一种基于移动端的眼底图像分类方法及系统,用以针对解决现有技术中现有技术中视网膜眼底图像分析处理存在的计算资源占用大、时效便捷性差以及功能较为单一的技术问题。

20.本技术技术方案中对数据的获取、存储、使用、处理等均符合国家法律法规的相关规定。

21.下面,将参考附图对本技术中的技术方案进行清楚、完整地描述,显然,所描述的

实施例仅是本技术的一部分实施例,而不是本技术的全部实施例,应理解,本技术不受这里描述的示例实施例的限制。基于本技术的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本技术保护的范围。另外还需要说明的是,为了便于描述,附图中仅示出了与本技术相关的部分而非全部。

22.实施例一

23.如图1所示,本技术提供了一种基于移动端的眼底图像分类方法,所述方法包括:

24.s100:基于densenet,构建基础眼底图像识别层;

25.本技术实施例中,基于深度学习中的densenet,创建从网络浅层到深层的映射路径,在保证网络中各层之间最大信息传输的前提下,通过密集连接所有网络层的特征图,可实现特征重用,提升图像处理效率和质量。

26.本技术实施例提供的方法中的步骤s100包括:

27.s110:分别采集获取多类病种的多个眼底图像,获得多个样本眼底图像;

28.s120:对所述多个样本眼底图像进行数据增强扩充,获得多个样本眼底图像集合;

29.s130:分别对所述多个样本眼底图像集合进行特征数据标识,获得多个样本特征数据集合;

30.s140:基于densenet,构建所述基础眼底图像识别层的基础网络结构,其中,所述基础网络结构包括:

31.xi=hi([x0,x1,

…

,x

i-1

])

[0032]

其中,xi为第i层输出,[x0,x1,

…

,x

i-1

]为x0到x

i-1

层的所有输出特征向量的拼接组合,hi为第i层进行的非线性变换,非线性变换h为bn relu conv(3

×

3)的组合;

[0033]

s150:采用所述多个样本眼底图像集合和所述多个样本特征数据集合,对所述基础眼底图像识别层进行监督训练,直到收敛或准确率达到预设要求。

[0034]

具体地,采集获取患有多个类别的多类病种的眼底图像,其中,示例性地,该多类病种包括:干性年龄相关性黄斑变性、湿性年龄相关性黄斑变性、视网膜分支静脉阻塞、视网膜中央静脉阻塞、中心性浆液性脉络膜视网膜病变、非增殖性糖尿病视网膜病变、增殖性糖尿病视网膜病变、黄斑部视网膜前膜、黄斑裂孔、玻璃体混浊、玻璃体积血、病理性近视、视盘相关疾病、视网膜色素变性、周边视网膜变性、视网膜脱离、其他、质量差。上述的多类病种均为可根据视网膜眼底图像进行诊断确认的病种。

[0035]

可基于此前就诊治疗患有多类病种的多个患者的就诊记录信息,采集获得多个患者的多个眼底图像,获得多个样本眼底图像。

[0036]

优选地,基于微清cro进行上述的多个视网膜眼底图像的采集,微清cro采用532nm波长激光器和785nm波长激光器,将两个波长的激光图像组合成多色照片,穿透能力强,不易被屈光介质吸收/反射,边缘采集获取具有不同层次的眼底病灶组织特征的视网膜眼底图像。

[0037]

对该多个样本眼底图像进行数据增强扩充,其中,示例性地,分别对多个样本眼底图像进行旋转处理、水平翻转处理、垂直反转处理和缩放处理等,获得处理后的多个样本眼底图像,并进行聚类,获得多个样本眼底图像集合,能够提升构建模型的视网膜眼底图像的数据维度,进而提升模型的准确性和泛化性。

[0038]

对多个样本眼底图像集合进行特征数据标识,其中,基于数据标识,分别对多个样

本眼底图像集合内的原视网膜眼底图像和处理后的视网膜眼底图像进行数据标识,获得多个样本特征数据集合,作为构建模型的数据。

[0039]

基于深度学习中的densenet,构建基础眼底图像识别层的基础网络结构,该基础网络结构包括:

[0040]

xi=hi([x0,x1,

…

,x

i-1

])

[0041]

其中,xi为第i层输出,[x0,x1,

…

,x

i-1

]为x0到x

i-1

层的所有输出特征向量的拼接组合,hi为第i层进行的非线性变换,非线性变换h为bn relu conv(3

×

3)的组合。其中,非线性变换h也称为denseblock。

[0042]

图2示出了本技术实施例中基础眼底图像识别层的一种可能的基础网络结构,如图2所示。在基础眼底图像识别层的基础网络结构内,第一层的denseblock的数量n1=6,第二层的denseblock的数量n2=12,第三层的denseblock的数量n3=64,第四层的denseblock的数量n4=48。

[0043]

基于构建完成的基础眼底图像识别层,采用上述的多个样本眼底图像集合和多个样本特征数据集合对该基础眼底图像识别层进行监督训练,直到训练至收敛或准确率达到预设要求,该预设要求可为准确率达到80%或90%等。

[0044]

基于训练完成的基础眼底图像识别层,向其中输入用户的视网膜眼底图像集合,即可经过多层的卷积处理和分析,最终输出较为准确的对应的多个特征数据。

[0045]

s200:构建图像分类器,根据所述基础眼底图像识别层和所述图像分类器,构建获得基础眼底图像分类模型;

[0046]

具体地,为实现根据视网膜眼底图像进行多病种的识别分类,本技术实施例还构建用于进行多病种分类识别的图像分类器,用以根据基础眼底图像识别层输出的多个特征数据,进行分类识别,最终获得对应用户的疾病类别。

[0047]

如图3所示,本技术实施例提供的方法中的步骤s200包括:

[0048]

s210:基于随机森林算法,有放回地在所述多个样本特征数据集合内随机选择m个样本特征数据集合,作为第一构建数据集;

[0049]

s220:采用所述第一构建数据集,构建所述图像分类器的第一子模型;

[0050]

s230:再次有放回地在所述多个样本特征数据集合内随机选择m个样本特征数据集合,作为第二构建数据集;

[0051]

s240:采用所述第二构建数据集,构建所述图像分类器的第二子模型;

[0052]

s250:继续构建所述图像分类器的多个子模型,集成所述多个子模型,获得所述图像分类器;

[0053]

s260:根据所述基础眼底图像识别层和所述图像分类器,构建获得所述基础眼底图像分类模型。

[0054]

本技术实施例中,基于随机森林算法,构建该图像分类器。

[0055]

具体地,有放回地在上述的多个样本特征数据集合内随机选择m个样本特征数据集合,作为第一构建数据集,用以构建图像分类器的第一子模型。其中,m为正整数,且m小于多个样本特征数据集合的数量,优选为多个样本特征数据集合数量的2/3。

[0056]

本技术实施例提供的方法中的步骤s220包括:

[0057]

s221:在所述第一构建数据集内随机选择一样本特征数据,作为第一划分阈值;

[0058]

s222:基于所述第一划分阈值,构建所述第一子模型的一级分类节点,其中,所述一级分类节点可对输入的特征数据进行二分类;

[0059]

s223:再次在所述第一构建数据集内随机选择一样本特征数据,作为第二划分阈值;

[0060]

s224:基于所述第二划分阈值,构建所述第一子模型的二级分类节点,其中,所述二级分类节点可对所述一级分类节点的分类结果进行二分类;

[0061]

s225:基于所述第一构建数据集,继续构建所述第一子模型的多级分类节点;

[0062]

s226:采集获取所述多个样本眼底图像的标签值,获得多个标签值;

[0063]

s227:获得所述多级分类节点进行多级二分类获得的多个分类结果,根据所述多个标签值,分别对所述多个分类结果设置不同的病种分类结果,获得所述第一子模型。

[0064]

具体地,基于随机森林算法,在上述的第一构建数据集内随机选择一样本特征数据,作为第一划分阈值,基于该第一划分阈值,构建第一子模型的一级分类节点,其中,该一级分类节点可对输入第一子模型的特征数据进行二分类,将大于该第一划分阈值的特征数据划分为一类,不大于该第一划分阈值的特征数据划分为另一类,获得二分类结果。

[0065]

在上述的第一构建数据集内再次随机选择一样本特征数据,作为第二划分阈值,基于该第二划分阈值,构建第一子模型的二级分类节点,其中,该二级分类节点可对一级分类节点的二分类结果再次进行二分类,获得四个分类结果。

[0066]

如此,继续构建第一子模型的多级分类节点,直到多级分类节点的级数达到预设值,其中,该预设值可根据第一构建数据集内样本特征数据的数量以及病种的分类数量进行自行设置。

[0067]

基于多级分类节点,可对输入的多个特征数据进行多次二分类,获得多个分类结果,每个分类结果包括一特征数据区间,采集获取多个样本眼底图像的标签值,获得多个标签值,标签值即为多个样本眼底图像对应用户真实诊断获得的是否患有上述的多类病种内的某一种疾病的真实值。

[0068]

采用该多个标签值,根据多个分类结果内的特征数据,对多个分类结果分别设置不同的标签值,获得多个分类结果的病种分类结果,构建完成第一子模型。

[0069]

如此,再次有放回地在多个样本特征数据集合内随机选择m个样本特征数据集合,作为第二构建数据集,并采用第二构建数据集构建图像分类器的第二子模型。第一子模型和第二子模型的构建数据不同,构建方法相同,因此,获得的第一子模型的具体性能和第二子模型是不同的。

[0070]

继续构建图像分类器的多个子模型,获得多个构建数据不完全相同、且性能相对较差的子模型,集成多个性能相对较差的子模型,获得性能相对较好、且较为稳定的图像分类器。

[0071]

基于构建完成的图像分类器,向其中输入基础眼底图像识别层根据眼底图像分析处理获得的特征数据后,将该特征数据输入多个子模型内,经过多个子模型的分析处理分类,获得多个病种分类结果,结合多个子模型的病种分类结果,可获得输入的特征数据对应的眼底图像患有各类病种的概率,作为参考数据,完成视网膜眼底图像的识别处理和多病种分类,较为准确和智能。

[0072]

基于构建完成的基础眼底图像识别层和图像分类器,进一步构建获得上述的基础

眼底图像分类模型。

[0073]

本技术实施例提供的方法中的步骤s260包括:

[0074]

s261:通过global avgpooling层连接所述基础眼底图像识别层和所述图像分类器;

[0075]

s262:根据基础模型损失函数,对连接的所述基础眼底图像识别层和所述图像分类器进行迭代训练,获得所述基础眼底图像分类模型,其中,所述基础模型损失函数如下式:

[0076][0077][0078][0079]

y_predm=round(outputm)

[0080]

diff=y_true-y_pred

[0081]

其中,outputm为所述图像分类器输出的第m种病种的概率,round为取整函数,y_predm为经取整后的outputm的值,y_true为onehot编码形式的实际的第m种病种的标签值,diff为y_true与y_pred的差,sumi(x)为统计x内值为i的个数,muliti_loss为所述基础模型损失函数。

[0082]

具体地,基于构建完成的基础眼底图像识别层和图像分类器,通过global a vgpooling层基础眼底图像识别层和图像分类器,其中,基础眼底图像识别层经过初步的监督训练,未连同图像分类器一同进行监督学习,准确率较低,因此,需要进一步地对连接的基础眼底图像识别层和图像分类器进行迭代训练。

[0083]

具体地,基于基础模型损失函数,对连接的基础眼底图像识别层和图像分类器进行迭代训练,该基础模型损失函数如下式:

[0084][0085][0086][0087]

y_predm=round(outputm)

[0088]

diff=y_true-y_pred

[0089]

其中,outputm为图像分类器输出的第m种病种的概率,round为取整函数,y_predm为经取整后的outputm的值,y_true为onehot编码形式的实际的第m种病种的标签值,diff

为y_true与y_pred的差,sumi(x)为统计x内值为i的个数,muliti_loss为基础模型损失函数。

[0090]

在迭代训练过程中,使连接的基础眼底图像识别层和图像分类器根据上述的基础模型损失函数进行误差计算,采用上述的多个样本眼底图像集合和多个病种的真实标签值,迭代训练至拟合,完成训练,获得构建完成的基础眼底图像分类模型。

[0091]

本技术实施例通过基于densenet构建基础眼底图像识别层,并基于随机森林算法构建图像分类器,获得基础眼底图像分类模型,能够保证最大程度分析获取视网膜眼底图像的特征信息,获得特征数据,并进一步进行多病种的分类识别,设置对应的损失函数,经过迭代训练后,准确率较高,能够实现视网膜眼底图像的识别处理,并进行多病种的分类识别,功能更为丰富。

[0092]

s300:根据所述基础眼底图像分类模型,通过知识蒸馏,获得移动端眼底图像分类模型;

[0093]

如图4所示,本技术实施例提供的方法中的步骤s300包括:

[0094]

s310:基于densenet,构建所述移动端眼底图像分类模型内移动端眼底图像识别层的移动端网络结构,其中,所述移动端网络结构的非线性变换的数量小于所述基础网络结构内的非线性变换的数量;

[0095]

s320:连接所述移动端眼底图像识别层和所述图像分类器,获得所述移动端眼底图像分类模型;

[0096]

s330:根据移动端损失函数和所述基础眼底图像分类模型,对所述移动端眼底图像分类模型进行迭代训练,其中,所述移动端损失函数如下式:

[0097]

l=αl

t

(1-α)ls[0098][0099][0100]

其中,l

t

为所述基础眼底图像分类模型的teacher loss,ls为移动端眼底图像分类模型的student loss,α为权重,n为多病种的病种类别数量,p

′i是基础眼底图像分类模型输出的第i类病种的概率,q

′i是经知识蒸馏学习后的移动端眼底图像分类模型输出的第i类病种的概率,ci为移动端眼底图像分类模型内对应的第i类病种的标签值,qi是经标签值学习后输出的第i类病种的概率。

[0101]

具体地,基于densenet,构建移动端眼底图像分类模型内移动端眼底图像识别层的移动端网络结构,其中,移动端网络结构内的网络结构与上述的基础网络结构相似,不同点在于,移动端网络结构更为轻量化,移动端网络结构内非线性变换h的数量小于基础网络结构内非线性变换h的数量,占用的计算资源更小,在移动端进行图像处理分析时,响应速度更快,更为便捷。

[0102]

示例性地,在移动端网络结构内,第一层的denseblock的数量为6,第二层的denseblock的数量为12,第三层的denseblock的数量为24,第四层的denseblock的数量为

16。

[0103]

基于前述内容中的图像分类器,连接该移动端眼底图像识别层和图像分类器,获得移动端眼底图像分类模型。

[0104]

基于机器学习中的知识蒸馏,采用teacher-student模式,将前述内容中复杂的基础眼底图像分类模型作为teacher,将移动端眼底图像分类模型作为student,根据移动端损失函数,对移动端眼底图像分类模型进行训练,使得轻量化的移动端眼底图像分类模型也具有较好的性能和泛化性。

[0105]

其中,该移动端损失函数如下式:

[0106]

l=αl

t

(1-α)ls[0107][0108][0109]

其中,l

t

为基础眼底图像分类模型的teacher loss,ls为移动端眼底图像分类模型的student loss,α为权重,优选为0.9,n为多病种的病种类别数量,p

′i是基础眼底图像分类模型输出的第i类病种的概率,q

′i是经知识蒸馏学习后的移动端眼底图像分类模型输出的第i类病种的概率,ci为移动端眼底图像分类模型内对应的第i类病种真实的标签值,qi是经标签值学习后输出的第i类病种的患病概率。

[0110]

基于前述内容中的多个样本眼底图像集合和多个标签值作为训练数据,根据该移动端损失函数,采用teacher-student模式,对该移动端眼底图像分类模型进行迭代训练,迭代的监督训练过程中,根据自身输出的多病种识别损失误差将网络训练至拟合,获得训练完成的移动端眼底图像分类模型。

[0111]

本技术实施例通过构建复杂且庞大的基础眼底图像分类模型,基于知识蒸馏的teacher-student模式,在移动端构建轻量化的移动端眼底图像分类模型,能够满足轻量快捷的视网膜眼底图像识别分类的要求,达到提升移动端视网膜眼底图像识别分类效率、响应速度的技术效果,且同时保证一定的精度。

[0112]

s400:采集获取目标用户的眼底图像,获得目标眼底图像;

[0113]

基于构建完成的移动端眼底图像分类模型,可进行用户的视网膜眼底图像的识别分类。

[0114]

具体地,采集获取当前目标用户的视网膜眼底图像,获得目标眼底图像。

[0115]

s500:对所述目标眼底图像进行数据增强扩充,获得目标眼底图像集合;

[0116]

本技术实施例提供的方法中的步骤s500包括:

[0117]

s510:对所述目标眼底图像进行旋转、水平翻转、垂直反转和缩放处理,获得多个扩充图像;

[0118]

s520:根据所述目标眼底图像和所述多个扩充图像,获得所述目标眼底图像集合。

[0119]

具体地,对目标眼底图像进行数据增强扩充,具体包括旋转处理、水平翻转处理、垂直反转处理和缩放处理,获得多个扩充图像。根据该目标眼底图像和多个扩充图像,获得

目标用户的目标眼底图像集合,通过数据增强扩充,能够提升眼底图像数据的维度,进而提升眼底图像识别分类的稳定性和准确率。

[0120]

s600:将所述目标眼底图像集合输入所述移动端眼底图像分类模型,获得图像分类结果。

[0121]

将该目标眼底图像集合输入移动端眼底图像分类模型,首先输入移动端眼底图像分类模型内的移动端眼底图像识别层内,经过卷积特征提取和特征重用,最终输出目标眼底图像集合内多个眼底图像的多个特征数据,然后将多个特征数据输入移动端眼底图像分类模型内的图像分类器内,输出各眼底图像对应具有各类病种的概率信息,结合目标眼底图像集合内的多个眼底图像,计算获得当前目标用户的眼底图像对应具有各类病种的概率信息,作为图像分类结果,作为眼底图像识别的参考数据,进行参考。

[0122]

经过移动端眼底图像分类模型对视网膜眼底图像进行识别分类的实验,本技术实施例提供的方法对每张视网膜眼底图像进行识别分类的时间为0.2s左右,效率较高,且准确率较高,各类别病种的视网膜眼底图像的识别分类auc值达到0.95以上,具备很高的时效性和精准度。

[0123]

综上所述,本技术所提供的一种基于移动端的眼底图像分类方法具有如下技术效果:

[0124]

本技术提供的技术方案通过基于densenet,在本地构建计算资源占用较大的基础眼底图像识别层,且能够保证在网络中各层之间最大信息传输的前提下,通过密集连接所有网络层的特征图,实现特征重用,提升图像分析处理的效率和准确性,并构建图像分类器,实现多病种的分类识别预测,提升视网膜眼底图像与深度学习结合的功能维度,继而通过知识蒸馏,采用teacher-student模式,获得轻量化但性能较好的移动端眼底图像分类模型,实现在移动端进行快捷、智能、准确的眼底图像识别分析处理,降低模型在移动端的计算资源占用,提升响应效率,然后采集获取当前用户的视网膜眼底图像,进行数据增强扩充,提升图像数据维度,进而提升图像数据分析处理的准确性,输入移动端眼底图像分类模型,获得当前用户的视网膜眼底图像的图像分类结果,本技术实现了在移动端基于深度学习进行较为复杂的眼底图像分析处理,更为轻量化和便捷,且能够进行多病种的识别分类,功能更为丰富,达到了降低眼底图像识别处理的计算资源占用,提升移动端使用的时效性和便捷性,以及丰富眼底图像识别处理功能的技术效果。

[0125]

实施例二

[0126]

基于与前述实施例中一种基于移动端的眼底图像分类方法同样的发明构思,如图5所示,本技术还提供了一种基于移动端的眼底图像分类系统,所述系统包括:

[0127]

基础识别层构建模块11,用于基于densenet,构建基础眼底图像识别层;

[0128]

基础识别模型构建模块12,用于构建图像分类器,根据所述基础眼底图像识别层和所述图像分类器,构建获得基础眼底图像分类模型;

[0129]

移动端识别模型构建模块13,用于根据所述基础眼底图像分类模型,通过知识蒸馏,获得移动端眼底图像分类模型;

[0130]

眼底图像采集模块14,用于采集获取目标用户的眼底图像,获得目标眼底图像;

[0131]

图像增强扩充模块15,用于对所述目标眼底图像进行数据增强扩充,获得目标眼底图像集合;

[0132]

图像识别分类模块16,用于将所述目标眼底图像集合输入所述移动端眼底图像分类模型,获得图像分类结果。

[0133]

进一步的,所述基础识别层构建模块11还用于实现以下功能:

[0134]

分别采集获取多类病种的多个眼底图像,获得多个样本眼底图像;

[0135]

对所述多个样本眼底图像进行数据增强扩充,获得多个样本眼底图像集合;

[0136]

分别对所述多个样本眼底图像集合进行特征数据标识,获得多个样本特征数据集合;

[0137]

基于densenet,构建所述基础眼底图像识别层的基础网络结构,其中,所述基础网络结构包括:

[0138]

xi=hi([x0,x1,

…

,x

i-1

])

[0139]

其中,xi为第i层输出,[x0,x1,

…

,x

i-1

]为x0到x

i-1

层的所有输出特征向量的拼接组合,hi为第i层进行的非线性变换,非线性变换h为bn relu conv(3

×

3)的组合;

[0140]

采用所述多个样本眼底图像集合和所述多个样本特征数据集合,对所述基础眼底图像识别层进行监督训练,直到收敛或准确率达到预设要求。

[0141]

进一步的,所述基础识别模型构建模块12还用于实现以下功能:

[0142]

基于随机森林算法,有放回地在所述多个样本特征数据集合内随机选择m个样本特征数据集合,作为第一构建数据集;

[0143]

采用所述第一构建数据集,构建所述图像分类器的第一子模型;

[0144]

再次有放回地在所述多个样本特征数据集合内随机选择m个样本特征数据集合,作为第二构建数据集;

[0145]

采用所述第二构建数据集,构建所述图像分类器的第二子模型;

[0146]

继续构建所述图像分类器的多个子模型,集成所述多个子模型,获得所述图像分类器;

[0147]

根据所述基础眼底图像识别层和所述图像分类器,构建获得所述基础眼底图像分类模型。

[0148]

其中,根据所述基础眼底图像识别层和所述图像分类器,构建获得所述基础眼底图像分类模型,包括:

[0149]

通过global avgpooling层连接所述基础眼底图像识别层和所述图像分类器;

[0150]

根据基础模型损失函数,对连接的所述基础眼底图像识别层和所述图像分类器进行迭代训练,获得所述基础眼底图像分类模型,其中,所述基础模型损失函数如下式:

[0151][0152][0153][0154]

y_predm=round(outputm)

[0155]

diff=y_true-y_pred

[0156]

其中,outputm为所述图像分类器输出的第m种病种的概率,round为取整函数,y_predm为经取整后的outputm的值,y_true为onehot编码形式的实际的第m种病种的标签值,diff为y_true与y_pred的差,sumi(x)为统计x内值为i的个数,muliti_loss为所述基础模型损失函数。

[0157]

其中,采用所述第一构建数据集,构建所述图像分类器的第一子模型,包括:

[0158]

在所述第一构建数据集内随机选择一样本特征数据,作为第一划分阈值;

[0159]

基于所述第一划分阈值,构建所述第一子模型的一级分类节点,其中,所述一级分类节点可对输入的特征数据进行二分类;

[0160]

再次在所述第一构建数据集内随机选择一样本特征数据,作为第二划分阈值;

[0161]

基于所述第二划分阈值,构建所述第一子模型的二级分类节点,其中,所述二级分类节点可对所述一级分类节点的分类结果进行二分类;

[0162]

基于所述第一构建数据集,继续构建所述第一子模型的多级分类节点;

[0163]

采集获取所述多个样本眼底图像的标签值,获得多个标签值;

[0164]

获得所述多级分类节点进行多级二分类获得的多个分类结果,根据所述多个标签值,分别对所述多个分类结果设置不同的病种分类结果,获得所述第一子模型。

[0165]

进一步的,所述移动端识别模型构建模块13还用于实现以下功能:

[0166]

基于densenet,构建所述移动端眼底图像分类模型内移动端眼底图像识别层的移动端网络结构,其中,所述移动端网络结构的非线性变换的数量小于所述基础网络结构内的非线性变换的数量;

[0167]

连接所述移动端眼底图像识别层和所述图像分类器,获得所述移动端眼底图像分类模型;

[0168]

根据移动端损失函数和所述基础眼底图像分类模型,对所述移动端眼底图像分类模型进行迭代训练,其中,所述移动端损失函数如下式:

[0169]

l=αl

t

(1-α)ls[0170][0171][0172]

其中,l

t

为所述基础眼底图像分类模型的teacher loss,ls为移动端眼底图像分类模型的student loss,α为权重,n为多病种的病种类别数量,p

′i是基础眼底图像分类模型输出的第i类病种的概率,q

′i是经知识蒸馏学习后的移动端眼底图像分类模型输出的第i类病种的概率,ci为移动端眼底图像分类模型内对应的第i类病种的标签值,qi是经标签值学习后输出的第i类病种的概率。

[0173]

进一步的,所述图像增强扩充模块15还用于实现以下功能:

[0174]

对所述目标眼底图像进行旋转、水平翻转、垂直反转和缩放处理,获得多个扩充图像;

[0175]

根据所述目标眼底图像和所述多个扩充图像,获得所述目标眼底图像集合。

[0176]

本说明书中各个实施例采用递进的方式描述,每个实施例重点说明的都是与其他实施例的不同之处,前述图1实施例一中的一种基于移动端的眼底图像分类方法和具体实例同样适用于本实施例的一种基于移动端的眼底图像分类系统,通过前述对一种基于移动端的眼底图像分类方法的详细描述,本领域技术人员可以清楚的知道本实施例中一种基于移动端的眼底图像分类系统,所以为了说明书的简洁,在此不再详述。对于实施例公开的装置而言,由于其与实施例公开的方法相对应,所以描述的比较简单,相关之处参见方法部分说明即可。

[0177]

对所公开的实施例的上述说明,使本领域专业技术人员能够实现或使用本技术。对这些实施例的多种修改对本领域的专业技术人员来说将是显而易见的,本文中所定义的一般原理可以在不脱离本技术的精神或范围的情况下,在其它实施例中实现。因此,本技术将不会被限制于本文所示的这些实施例,而是要符合与本文所公开的原理和新颖特点相一致的最宽广的范围。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。