1.本发明属于图像处理技术领域,尤其涉及有雨图像的雨线去除,提出了一个基于双字典学习模型驱动的去雨迭代算法,针对提出的优化模型进行深度展开成神经网络的形式来高效地完成雨线去除。

背景技术:

2.雨天是我们日常生活中常见的天气,雨线的存在会对许多多媒体任务产生负面影响,如人脸识别、人机交互、物体检测等。

3.为了缓解这个问题,人们提出了许多图像去雨方法。这些方法可以大致归纳为两类:模型驱动和数据驱动的方法。模型驱动的去雨方法需要手工构造复杂的先验,存在耗时和建模不充分等缺陷,尤其是当图像的先验和之前构造的先验不匹配时,所得到的最终图像效果会很差。

4.目前主流的图像去雨研究方法都是基于数据驱动的深度学习方法进行的,这类方法在借助gpu等设备的加速中可以又快又好的去除雨线。但是这类数据驱动的方法普遍存在以下几个问题:

5.1.可解释性差。绝大多数的网络是端到端的深度学习,导致整个网络看起来像一个黑盒子,对于用户来说缺乏可解释性。

6.2.忽略了背景层中的重要信息。许多方法直接预测雨纹层r而不是背景层b,因为雨条纹层r中的信息量比背景层b中的信息量更稀疏,从而使整个网络更容易收敛。一般来说,o=b r是一个很重要的先验估计,当雨纹稀疏时,上述方法的去雨效果差强人意。然而,这些方法忽略了b中的大量有用信息。随着雨纹变得更密集,它将覆盖背景层中的大部分内容。由于r中的信息是单调的,r中信息的增加无法补偿b中内容的丢失。这使得原本病态的问题更难处理,导致最终的去雨结果不理想。

技术实现要素:

7.本发明是为了解决上述现有技术存在的不足之处,提出一种基于模型驱动的字典学习去雨方法及其应用,以期能实现运行高效、去除效果好、可解释性强的图像去雨效果。

8.本发明为解决上述技术问题,采用如下技术方案:

9.本发明一种基于模型驱动的字典学习去雨方法,其特点在于,是按如下步骤进行:

10.步骤1:构建去雨网络,包括:初始预处理残差网络和t

max

个阶段的学习模块;每个阶段的学习模块包括:背景层学习模块和雨纹层学习模块;其中,背景层学习模块包括:背景层稀疏编码神经网络和背景层字典神经网络;雨纹层学习模块包括:雨纹层稀疏编码神经网络和雨纹层字典神经网络;

11.步骤2:定义当前迭代次数为i,最大迭代次数为t

max

;

12.步骤3:初始化i=1;

13.获取一张待处理的有雨图像并划分为背景层b和雨纹层r后,相应作为

第i-1次迭代时的背景层b

(i-1)

和雨纹层r

(i-1)

输入所述残差网络中,从而利用式(1)对所述第i-1次迭代时的背景层b

(i-1)

和雨纹层r

(i-1)

进行处理,得到第i-1次迭代时的背景层b

(i-1)

和雨纹层r

(i-1)

所对应的字典模型,其中,3表示图像的通道数,h和w分别表示图像的高度及宽度;表示实数空间;

[0014][0015]

式(1)中,表示由预处理残差网络处理后的第i-1次迭代时雨纹层r

(i-1)

对应的字典,表示由残差网络处理后的第i-1次迭代时雨纹层r

(i-1)

对应的稀疏编码,并由和组成第i-1次迭代时雨纹层r

(i-1)

的字典模型;表示由残差网络处理后的第i-1次迭代时背景层b

(i-1)

对应的字典,表示由残差网络处理后的第i-1次迭代时背景层b

(i-1)

对应的稀疏编码,并由和组成第i-1次迭代时背景层b

(i-1)

的字典模型;表示卷积操作;

[0016]

步骤4:利用式(2)和式(3)分别确定雨纹层和背景层字典模型的优化函数:

[0017][0018][0019]

式(2)为第i次迭代时雨纹层r(i)的字典模型优化函数;其中,为第i次迭代时雨纹层r(i)对应字典和对应稀疏编码的稀疏先验,和为第i次迭代时雨纹层r(i)字典模型优化函数的两个拉格朗日乘子;b

(i-1)

为第i-1次迭代时的背景层;

[0020]

式(3)为第i次迭代时背景层b(i)的字典模型优化函数,其中,为第i次迭代时背景层b(i)对应字典和对应稀疏编码的稀疏先验,和为第i次迭代时背景层b(i)字典模型优化函数的两个拉格朗日乘子;

[0021]

步骤4.1:对第i次迭代时雨纹层r(i)对应的稀疏编码进行深度展平后,得到式(4);

[0022][0023]

式(4)中,为的辅助变量,并由式(5)得到;和为第i次迭代时的两个惩罚项参数;为第i-1次迭代时雨纹层r

(i-1)

对应的稀疏编码;为的辅助变量,且初始化为一个随机数;为第i-1次迭代时雨纹层r(i)对应的字典;

[0024][0025]

式(5)中,表示快速傅里叶变换,表示快速傅里叶变换的逆变换;表示第i-1次迭代时的快速傅里叶变换,表示第i-1次迭代时的快速傅里叶变换;

表示第i-1次迭代时雨纹层r

(i-1)

的快速傅里叶变换;i为单位矩阵;为的共轭转置;

[0026]

将送入第i阶段的雨纹层学习模块中的雨纹层稀疏编码神经网络中进行处理后得到

[0027]

步骤4.2:对字典进行深度展平后,得到式(6):

[0028][0029]

式(6)中,为的辅助变量,并由式(7)得到,初始值为一个随机数;和为惩罚项参数;

[0030][0031]

式(7)中,表示第i-1次迭代时的快速傅里叶变换,表示第i次迭代时的快速傅里叶变换;表示第i-1次迭代时雨纹层r

(i-1)

的快速傅里叶变换;为的共轭转置;

[0032]

将送入第i阶段的雨纹层学习模块中的雨纹层字典神经网络中进行处理后,得到

[0033]

步骤4.3:利用式(8)得到第i次迭代时的背景层b(i):

[0034]

b(i)=o-r(i)ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(8)

[0035]

式(8)中,r(i)表示第i次迭代时的雨纹层,且

[0036]

步骤4.4:对第i次迭代时背景层b(i)对应的稀疏编码进行深度展平后,得到式(9):

[0037][0038]

式(9)中,为的辅助变量,并由式(10)得到;和为第i次迭代时的两个惩罚项参数;为第i-1次迭代时背景层b

(i-1)

对应的稀疏编码;为的辅助变量,且初始化为一个随机数;为第i-1次迭代时背景层b

(i-1)

对应的字典;

[0039][0040]

式(10)中,表示第i-1次迭代时的快速傅里叶变换,表示第i-1次迭代时的快速傅里叶变换;表示第i次迭代时雨纹层b(i)的快速傅里叶变换;为

的共轭转置;

[0041]

将送入第i阶段的背景学习模块中的背景层稀疏编码神经网络中进行处理后,得到

[0042]

步骤4.5:将式(3)的字典项深度展平得到式(11):

[0043][0044]

式(11)中,为的辅助变量,并由式(12)得到,初始值为一个随机数;和为惩罚项参数;

[0045][0046]

式(12)中,表示第i-1次迭代时的快速傅里叶变换,表示第i次迭代时的快速傅里叶变换;表示第i次迭代时雨纹层b(i)的快速傅里叶变换;为的共轭转置;

[0047]

将送入第i阶段的背景层学习模块中的背景层字典神经网络中进行处理后,得到

[0048]

步骤4.6:计算和的卷积,从而得到第i迭代时背景层b(i)的中间值b

*(i)

,再通过式(13)得到第i迭代时的背景层b(i):

[0049]

b(i)=(1-α)b

(i-1)

αb

*(i)

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(13)

[0050]

式(13)中,α表示第i阶段背景层的权重,且α∈(0,1);

[0051]

步骤4.7:判断i≥t

max

是否成立,若成立,则将第i次迭代时背景层b(i)作为最终的无雨图像输出;否则,令i 1赋值给i后,返回步骤4.1顺序执行;

[0052]

步骤5:按照步骤1-步骤4的过程对一批数量为batch_size的有雨图片集进行处理,并利用adam优化器对所述去雨网络进行优化,直到训练次数达到所设定的阈值为止,从而得到全局最优去雨网络并用于实现对任一图像的雨线去除。

[0053]

2、根据权利要求1所述的基于模型驱动的双字典学习去雨方法,其特征在于:

[0054]

所述雨纹层学习模块由四个部分组成,包括两个神经网络和两个解析解;其中一个神经网络是雨纹层稀疏编码神经网络,所述雨纹层稀疏编码神经网络由多个下采样残差块、一个普通残差块和多个上采样残差块组成的u-net网络,用于求解另一个网络是由若干个普通残差块连接组成的雨纹层字典神经网络,用于求解其中一个解析解是式(5),用于求解另一个解析解是式(7),用于求解

[0055]

所述背景层学习模块由四个部分组成,包括两个神经网络和两个解析解;其中一个神经网络是背景层稀疏编码神经网络,所述背景层稀疏编码神经网络是由多个下采样残差块、一个普通残差块和多个上采样残差块组成的u-net网络,用于求解另一个网络是

由若干个普通残差块连接组成的背景层字典神经网络,用于求解其中一个解析解是式(10),用于求解另一个解析解是式(12),用于求解

[0056]

本发明一种电子设备,包括存储器以及处理器,其特点在于,所述存储器用于存储支持处理器执行所述字典学习去雨方法的程序,所述处理器被配置为用于执行所述存储器中存储的程序。

[0057]

本发明一种计算机可读存储介质,计算机可读存储介质上存储有计算机程序,其特点在于,所述计算机程序被处理器运行时执行所述字典学习去雨方法的步骤。

[0058]

与现有技术相比,本发明的有益效果在于:

[0059]

1、本发明提出一种新的去雨网络,该网络尝试使用两个字典学习网络来分别学习雨纹层和背景层,更大程度的利用了原始图像的信息,从而可以在更加复杂的雨水条件下更好的恢复出原始图像的细节,避免了特征信息的丢失。

[0060]

2、本发明在去雨网络的优化函数中加入了自适应字典项,以根据图像内容为每个图像生成动态字典,在面对不同的雨水天气时可以更好的分离雨纹层和背景层,提高了去雨网络的泛化性。

[0061]

3、本发明提出的基于模型驱动的图像去雨方法是结合传统迭代和深度学习网络优势的高效算法,该方法严格按照半二次方分裂算法来构建网络模型,和一般的去雨网络对比,该去雨网络具有更好的可解释性的同时能高效且准确重建出无雨图片。实验结果表明,该去雨网络在峰值信噪比(psnr)和结构相似度(ssim)以及视觉观感方面对合成和真实数据集都具有出色的去雨效果。

附图说明

[0062]

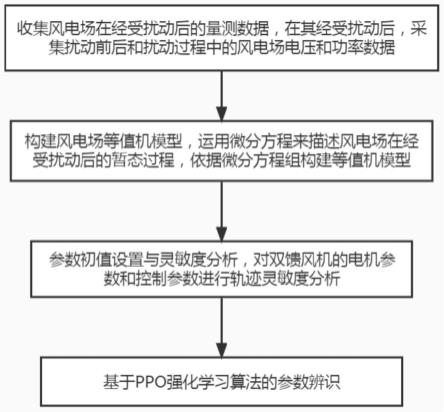

图1是本发明基于模型驱动的双字典学习图像去雨方法的流程图;

[0063]

图2是本发明中每个字典学习模块的算法流程图;

[0064]

图3是本发明中字典学习模块深度展平后的算法流程图;

[0065]

图4a是本发明深度展平层中求解稀疏编码部分subtr和subtb所使用的卷积神经网络结构;

[0066]

图4b是本发明深度展平层中求解动态字典部分subzr和subzb所使用的卷积神经网络结构;

[0067]

图5是本发明中不同雨纹层r和背景层b的字典可视化效果图;

[0068]

图6是本发明泛化性测试的可视化效果图;

[0069]

图7是本发明对比其他不同方法在多个数据集上的性能结果图;

[0070]

图8本发明的去雨方法在合成数据集rain200h数据集上的对比可视化结果图;

[0071]

图9本发明的去雨方法在真实数据集spa数据集上的对比可视化结果图。

具体实施方式

[0072]

本实施例中,一种模型驱动的神经网络去雨方法,是基于之前提出的雨水图像合成模型,并充分结合传统模型驱动方案的可解释性和数据驱动方案的高效性的优势,构建基于双字典学习的单幅图像去雨算法,并对于算法中部分步骤使用卷积神经网络代替,从

而在单幅图像去雨任务中能够达到一个运行高效且去除效果好的性能表现。具体的说,如图1所示,包括如下步骤:

[0073]

步骤1:构建去雨网络,包括:初始预处理残差网络和t

max

个阶段的学习模块;每个阶段的学习模块包括:背景层学习模块和雨纹层学习模块;其中,背景层学习模块包括:背景层稀疏编码神经网络和背景层字典神经网络;雨纹层学习模块包括:雨纹层稀疏编码神经网络和雨纹层字典神经网络;

[0074]

步骤2:定义当前迭代次数为i,最大迭代次数为t

max

;

[0075]

步骤3:初始化i=1;

[0076]

获取一张待处理的有雨图像并划分为背景层b和雨纹层r后,相应作为第i-1次迭代时的背景层b

(i-1)

和雨纹层r

(i-1)

输入残差网络中,从而利用式(1)对第i-1次迭代时的背景层b

(i-1)

和雨纹层r

(i-1)

进行处理,得到第i-1次迭代时的背景层b

(i-1)

和雨纹层r

(i-1)

所对应的字典模型,其中,3表示图像的通道数,h和w分别表示图像的高度及宽度;表示实数空间;

[0077][0078]

式(1)中,表示由预处理残差网络处理后的第i-1次迭代时雨纹层r

(i-1)

对应的字典,表示由残差网络处理后的第i-1次迭代时雨纹层r

(i-1)

对应的稀疏编码,并由和组成第i-1次迭代时雨纹层r

(i-1)

的字典模型;表示由残差网络处理后的第i-1次迭代时背景层b

(i-1)

对应的字典,表示由残差网络处理后的第i-1次迭代时背景层b

(i-1)

对应的稀疏编码,并由和组成第i-1次迭代时背景层b

(i-1)

的字典模型;表示卷积操作;预处理中,对输入的有雨图像和真实图像数据进行相同的预处理过程,包括裁剪、翻转、旋转等操作。

[0079]

步骤4:利用式(2)和式(3)分别确定雨纹层和背景层字典模型的优化函数:

[0080][0081][0082]

式(2)为第i次迭代时雨纹层r(i)的字典模型优化函数;这里是一个常见的拉格朗日对偶优化问题,且该优化问题为凸优化问题,所以可以通过后续深度展平的操作来解决。其中,为第i次迭代时雨纹层对应字典和对应稀疏编码的稀疏先验,和为第i次迭代时雨纹层字典模型优化函数的两个拉格朗日乘子;b

(i-1)

为第i-1次迭代时的背景层;

[0083]

式(3)为第i次迭代时背景层b(i)的字典模型优化函数,其中,为第i次迭代时背景层对应字典和对应稀疏编码的稀疏先验,和为第i次迭代时背景层字典模型优化函数的两个拉格朗日乘子;图2-3给出了本发明中深度展平操作的具体流程图;

[0084]

步骤4.1:通过使用半二次方分裂算法(hqs)对第i次迭代时雨纹层对应的稀疏编

码进行深度展平后,得到式(4);

[0085][0086]

式(4)中,为的辅助变量,并由式(5)得到;和为第i次迭代时的两个惩罚项参数;为第i-1次迭代时雨纹层对应的稀疏编码;为的辅助变量,且初始化为一个随机数;为第i-1次迭代时雨纹层对应的字典;

[0087][0088]

式(5)中,表示快速傅里叶变换,表示快速傅里叶变换的逆变换;表示第i-1次迭代时的快速傅里叶变换,表示第i-1次迭代时的快速傅里叶变换;表示第i-1次迭代时雨纹层r

(i-1)

的快速傅里叶变换;i为单位矩阵;为的共轭转置;

[0089]

将送入第i阶段的雨纹层学习模块中的雨纹层稀疏编码神经网络中进行处理后得到

[0090]

步骤4.2:对字典进行深度展平后,得到式(6):

[0091][0092]

式(6)中,为的辅助变量,并由式(7)得到,初始值为一个随机数;和为惩罚项参数;

[0093][0094]

式(7)中,表示第i-1次迭代时的快速傅里叶变换,表示第i次迭代时的快速傅里叶变换;表示第i-1次迭代时雨纹层r

(i-1)

的快速傅里叶变换;为的共轭转置;

[0095]

将送入第i阶段的雨纹层学习模块中的雨纹层字典神经网络中进行处理后,得到

[0096]

步骤4.3:利用式(8)得到第i次迭代时背景层b(i):

[0097]

b(i)=o-r(i)ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(8)

[0098]

式(8)中,r(i)表示第i次迭代后的背景层,且

[0099]

步骤4.4:通过使用半二次方分裂算法(hqs)对第i次迭代时背景层对应的稀疏编

码进行深度展平后,得到式(9):

[0100][0101]

式(9)中,为的辅助变量,并由式(10)得到;和为第i次迭代时的两个惩罚项参数;为第i-1次迭代时背景层对应的稀疏编码;为的辅助变量,且初始化为一个随机数;为第i-1次迭代时背景层对应的字典

[0102][0103]

式(10)中,表示第i-1次迭代时的快速傅里叶变换,表示第i-1次迭代时的快速傅里叶变换;表示第i次迭代时雨纹层b(i)的快速傅里叶变换;为的共轭转置;

[0104]

将送入第i阶段的背景学习模块中的背景层稀疏编码神经网络中进行处理后,得到

[0105]

步骤4.5:将式(3)的字典项深度展平得到式(11):

[0106][0107]

式(11)中,为的辅助变量,并由式(12)得到,初始值为一个随机数;和为惩罚项参数;

[0108][0109]

式(12)中,表示第i-1次迭代时的快速傅里叶变换,表示第i次迭代时的快速傅里叶变换;表示第i次迭代时雨纹层b(i)的快速傅里叶变换;为的共轭转置;

[0110]

将送入第i阶段的背景层学习模块中的背景层字典神经网络中进行处理后,得到

[0111]

步骤4.6:计算和的卷积从而得到第i迭代时背景层的中间值b

*(i)

,再通过式(13)得到第i迭代时背景层b(i):

[0112]

b(i)=(1-α)b

(i-1)

αb

*(i)

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(13)

[0113]

式(13)中,α表示第i阶段背景层的权重,且α∈(0,1);

[0114]

步骤4.7:判断i≥t

max

是否成立,若成立,则将第i次迭代时背景层b(i)作为最终的

无雨图像输出;否则,根据r(i)=o-b(i)得到r

(i 1)

,令i 1赋值给i后,返回步骤4.1顺序执行;

[0115]

步骤5:按照步骤1-4的过程对一批数量为batch_size的有雨图片集进行处理,并利用adam优化器对去雨网络进行优化,利用式(14)进行有监督训练,直到训练次数达到所设定的阈值为止,从而得到全局最优网络用于实现对任一图像的雨纹去除。本实施例中,学习率取6e-4,batch_size取10,最大迭代周期为800。

[0116][0117]

式(14)中,ssim的定义见式(16),

[0118]

具体实施中,背景层学习模块由四个部分组成,如图3所示,包括两个卷积神经网络和两个解析解;由于字典学习模型中稀疏编码的参数量远大于字典的参数量,所以背景层学习模块中的背景层稀疏编码神经网络的结构为如图4a所示的u-net结构,u-net网络是由多个下采样残差块、一个普通残差块和多个上采样残差块组成,用于求解对应图3中的sub cb;

[0119]

另一个网络是如图4b所示的由若干个普通残差块连接组成的背景层字典神经网络,用于求解对应图3中的sub kb;

[0120]

其中一个解析解是用于求解对应图3中的sub tb;

[0121]

另一个解析解是用于求解对应图3中的sub zb。

[0122]

雨纹层学习模块由四个部分组成,如图3所示,包括两个卷积神经网络和两个解析解;由于字典学习模型中稀疏编码的参数量远大于字典的参数量,所以雨纹层学习模块中的雨纹层稀疏编码神经网络的结构为如图4a所示的u-net结构,u-net网络是由多个下采样残差块、一个普通残差块和多个上采样残差块组成,用于求解对应图3中的sub cr;

[0123]

另一个网络是如图4b所示若干个普通残差块连接组成的雨纹层字典神经网络,用于求解对应图3中的sub kr;

[0124]

其中一个解析解是用于求解对应图3中的sub tr;

[0125]

另一个解析解是用于求解对应图3中的sub zr。

[0126]

为了验证去雨网络的动态字典,对网络的字典进行可视化;图5则为动态字典的可视化,可以看出,在处理不同特征的雨线和不同内容的背景时,本框架可以自适应的调整字典的内容,从而达到更优越的去雨效果。

[0127]

本实施例中,一种电子设备,包括存储器以及处理器,该存储器用于存储支持处理

器执行上述字典学习去雨方法的程序,该处理器被配置为用于执行该存储器中存储的程序。

[0128]

本实施例中,一种计算机可读存储介质,是在计算机可读存储介质上存储有计算机程序,该计算机程序被处理器运行时执行上述字典学习去雨方法的步骤。

[0129]

此外,本发明提出的去雨框架还具有较好的泛化性,图6展示了当训练集和测试集不匹配时的去雨效果。该图中训练集为合成数据集rain200h,然后分别在rain800,rain1200,spa数据集上进行去雨测试。图6的下半部分展示了即使在训练集和测试集不匹配的情况下,本发明提出的去雨框架仍然能够准确的捕捉到雨线的方向、粗细和长短,这得益于稀疏化系数和自适应字典的引入。

[0130]

为了量化评估本发明的效果并验证本发明的有效性,为此将本发明方法与gmm,dsc等传统算法以及rescan,rcdnet等基于深度学习的算法在5个公开合成数据集和1个真实数据集相比较。选择psnr(peak signal-to-noise ratio)峰值信噪比,ssim(structural similarity index metric)结构相似性距离两个性能指标作为评价指标。

[0131]

数值指标评估分为两个个部分:

[0132]

第一部分是基于误差敏感的图像质量评估,评价标准为psnr:

[0133][0134]

式(15)中,x与y分别为网络输出图像与目标图像,maxvalue表示该图像所能取到的最大动态范围的数值,h和w为图像的高度和宽度。

[0135]

第二部分是基于结构相似的图像质量评估,评价标准为ssim:

[0136][0137]

式(16)中,x与y分别为网络输出图像与目标图像,μ

x

为x的均值,μy为y的均值,为x的方差,为y的方差,σ

xy

为x与y的协方差,c1与c2为常数。

[0138]

图7展示了本发明在不同数据集上和其他方法的定量指标性能比较结果。可以看到,在和之前提出的方法比较中,本发明在所有数据集上都取得了最佳的性能指标,尤其是在雨线相对复杂的rain200h数据集上,和之前最好的方法相比我们的ssim指标提高了1.5个百分点。

[0139]

图8-9展示了本发明在测试集上的视觉对比效果。图8的图片选自于合成数据集rain200h;图9的图片选自于真实数据集spa。传统的模型驱动方法由于手工构造的先验与合成数据集的雨线不符合,所以去雨效果很差;先前的数据驱动去雨方法大多忽略了背景层中的信息,所以在图像的细节恢复上存在过度平滑的问题(图8中小孩帽子周围的绒毛)。相比之下,本方法在去除图像中雨线的同时可以更大程度的保留原始图像中的细节信息。在图9中,面对真实的雨水图片数据集时,之前的方法都无法去除雨水碰撞到墙壁后溅起的水珠,原因在于其网络框架并没有将这些水珠作为雨线进行处理;相对的,本方法则成功的去除了溅起的水珠并达到了和正确图像近乎相同的结果。这些结果都说明本发明的图像去雨方法比其他方法性能更加优越。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。