1.本发明涉及rgb图像光谱超分辨重建和3d点云重建的技术领域,更具体地,涉及一种三维图谱合一的高光谱点云数据生成方法及系统。

背景技术:

2.近年来,随着高光谱分辨率和高空间分辨率技术的不断发展,高光谱图像成为我国的经济、农业生活的重要信息源,高光谱遥感图像具有信息量丰富、光谱分辨率高、波段范围宽等优势,蕴含了更加准确的可辨识地物特征信息。然而,当前采集高光谱图像的成像光谱仪采集的高光谱图像虽然具有丰富的光谱信息,但却不具备高分辨率空间三维特性。

3.为了解决当前采集高光谱图像的成像光谱仪采集的高光谱图像不具备高分辨率空间三维特性的问题,现有的技术中公开了一种本征高光谱点云生成方法、系统及装置,该发明首先通过高光谱图像和激光雷达点云获取本征映射矩阵,然后分割提取高光谱图像h中属于建筑表面的像素集合,利用集合q中的像素确定入射光照方向的向量l;最后进行高光谱图像-激光雷达点云联合本征分解,生成本征高光谱点云,生成的光谱信息-空间三维信息一体化数据精度高且不受光照影响的。但是在该方案中,光谱与点云两种异构数据需要独立采集及融合,因此采集过程复杂,意味着高光谱点云的生成仍需要较高的成本。

技术实现要素:

4.为解决当前高光谱点云的生成需要光谱与点云两种异构数据独立采集及融合,采集过程复杂困难、所需成本较高的问题,本发明提出一种三维图谱合一的高光谱点云数据生成方法及系统,不仅实现了目标或场景的高分辨空间三维特性的准确获取,且在获取高空间分辨率的同时获得高光谱分辨率,从而获得三维图谱合一的数据特征,以指导农业等领域的生产。

5.为了达到上述技术效果,本发明的技术方案如下:

6.s1.利用移动传感器设备获取rgb图像数据;

7.s2.构建多级光谱变换网络并训练,将单帧rgb图像输入至训练好的多级光谱变换网络,重建并生成高光谱图像;

8.s3.构建深度预测网络并训练,将单帧rgb图像输入至训练好的深度预测网络,得到单帧rgb图像的初始深度信息;

9.s4.确定移动传感器设备的相机初始焦距,根据初始深度信息和初始相机焦距计算生成失真3d点云;

10.s5.构建3d点云生成网络,将失真3d点云数据输入3d点云生成网络中,得到深度偏移调整因子与焦距调整因子以调整预测最终的深度信息和相机焦距,重建并生成3d点云数据;

11.s6.对s2生成的高光谱图像进行数据处理,获取高光谱图像每个像素点对应多个波段的光谱信息,对s5生成的3d点云数据进行点云处理,获取3d点云上每个像素点对应的

波段信息;

12.s7.将高光谱图像对应像素点的多个波段光谱信息端到端映射到3d点云像素点的波段信息上,获得具有多波段光谱信息的高光谱点云。

13.本技术方案利用数据驱动学习的单帧rgb图像光谱超分辨重建和三维重建技术来生成高光谱点云,首先构建多级光谱变换网络,利用单帧rgb图像进行光谱超分辨重建,接着构建深度预测网络和3d点云生成网络,利用单帧rgb图像进行3d点云重建,最后将光谱超分辨重建的高光谱图像的多个波段光谱信息端到端映射到3d点云中,以生成高光谱点云数据,从而获得三维图谱合一的数据特征,不仅实现了目标或场景的高分辨空间三维特性的准确获取,且在获取高空间分辨率的同时获得高光谱分辨率,以指导农业等领域的生产。

14.优选地,在步骤s1中,还包括利用高光谱成像仪获取rgb-hsi图像对的过程,rgb-hsi图像对中的rgb图像数据包括gnss坐标和各波段名称,存储于图像的元数据中;对获取的rgb图像数据进行预处理操作,所述的预处理操作包括畸变校正和立体校正,以便后续利用rgb图像构建深度预测网络和3d点云生成网络,以及利用rgb-hsi图像对对模型进行训练。

15.优选地,在步骤s2中,多级光谱变换网络由级联的多个单级光谱变换模块组成,每一个单级光谱变换网络由encoder-decoder的u形结构模块构成,该u形结构模块由多个光谱注意力模块构成,每一个光谱注意力模块包括具有hsi空间稀疏且光谱自相似性质的光谱多头自注意力模块和前馈网络模块。

16.优选地,在多级光谱变换网络构建完成后,对其进行训练,方式如下:

17.基于优化器adam,使用步骤s1中获得的128

×

128 rgb-hsi图像对的自采数据集和ntire 2022公开数据集对多级光谱变换网络进行训练,在训练过程中,将rgb图像数据线性重缩放到[0,1],然后从ntire 2022数据集中裁剪出128

×

128 rgb-hsi样本对数据集,并将128

×

128rgb-hsi图像对的自采数据补充到该裁剪得到的数据集中,训练的数据通过随机旋转和翻转来增强。

[0018]

优选地,步骤s3构建的深度预测网络包括用于特征提取的标准主干resnet50和一个用于预测未知比例深度信息的decoder解码器,完成深度预测网络的构建后,训练深度预测网络;

[0019]

获取来自开源数据集的rgb-d图像数据,利用rgb-d图像数据训练深度预测网络,在训练过程中,将rgb-d图像数据的深度范围归一化为[0,1],进行图像归一化回归损失处理,图像归一化回归损失ilnr函数为:

[0020][0021]

其中,l

ilnr

表示图像归一化回归损失ilnr函数,di表示预测的深度信息,表示地面实况深度信息;μ

trim

和σ

trim

分别表示深度图的平均值与标准差;

[0022]

利用成对正态回归pwn损失来提高局部几何特征学习的性能,成对正态回归pwn损失函数表达式为:

[0023]

[0024]

其中,l

pwn

成对正态回归pwn损失函数,设采样点为{(ai,bi),i=0,...,n},则采样点对应的曲面法线为{(n

ai

,n

bi

),i=0,...,n};n

*

表示地面真实曲面法线;为(ai,bi)的地面真实曲面法线;图像归一化回归损失ilnr函数和正态回归pwn损失函数共同构成深度预测网络总的损失函数,然后,利用adam优化器训练深度预测网络,优化其网络参数,直至深度预测网络总的损失函数收敛,得到训练好的深度预测网络。

[0025]

在此,充分考虑了深度预测网络的训练中,使用的多源数据集提供的图像数据深度范围不同的因素,对进行了图像归一化回归损失处理,并提高了局部几何特征学习的性能,优化了深度预测网络的性能。

[0026]

优选地,步骤s4中所述的失真3d点云的计算过程如下:

[0027]

设深度预测网络预测得到的单帧rgb图像的初始深度信息为d

init

、初始相机焦距为f

init

,将预测出的初始深度信息和初始相机焦距经过坐标变换公式得到失真3d点云数据:

[0028]

其中,

[0029]

其中,(u,v)为图像坐标系下的任意坐标点,u0,v0分别为单帧rgb图像的中心坐标,(xw,yw,zw)表示世界坐标系下的三维坐标点,zc表示相机坐标的z轴值,即目标到相机的距离,r、t均为外参矩阵,d

init

为初始深度信息,f

init

为初始焦距。

[0030]

优选地,步骤s5中构建的3d点云生成网络由偏移点云网络nd()和焦距点云网络nf()构成;

[0031]

构建3d点云生成网络后使用adam优化器对3d点云生成网络进行训练,优化其网络参数;

[0032]

其中,3d点云生成网络的输入网络架构为pvcnn网络,将失真的3d点云数据输入3d点云生成网络中,获取深度偏移调整因子与焦距调整因子,调整预测最终的深度信息d

pred

以及重建3d点云数据;

[0033]

在调整与预测深度信息时,设失真的3d点云为将其作为偏移点云网络nd()的输入数据,构建训练目标函数为:

[0034][0035]

其中,θ是网络权重,f

*

是地面实况焦距,d

*

是地面实况深度,为深度偏移调整因子;

[0036]

当调整与预测相机焦距时,将失真的3d点云作为焦距点云网络nf()的输入数据,构建训练目标函数:

[0037][0038]

其中,θ是网络权重,f

*

是地面实况焦距,d

*

是地面实况深度,为焦距调整因子;

[0039]

重复调整深度信息和调整焦距若干次,接着将调整预测得到的深度信息d

pred

与相

机焦距f

pred

经过坐标变换公式重建生成3d点云数据,坐标变换公式如下:

[0040]

其中,

[0041]

其中,(u,v)为图像坐标系下的任意坐标点,u0,v0分别为图像的中心坐标,(xw,yw,zw)表示世界坐标系下的三维坐标点,zc表示相机坐标的z轴值,即目标到相机的距离,r、t分别为外参矩阵,d

pred

为最终预测的深度信息,f

pred

为最终预测的相机焦距。

[0042]

优选地,在步骤s6中,加载并读取步骤s2中生成的高光谱图像数据,并将高光谱图像数据转化为高光谱图像的多维矩阵,接着循环遍历高光谱图像的多维矩阵中的每一个元素,所述每一个元素即为高光谱图像的每一个像素点,在遍历的过程中得到每个像素点对应的矩阵,该矩阵表示每一个像素点对应的多个波段的光谱信息,最终,得到高光谱图像每个像素点对应多个波段的光谱信息;

[0043]

将步骤s5中三维重建生成的3d点云进行点云处理操作的步骤如下:

[0044]

加载并读取点云数据,将点云数据转化为点云的多维矩阵,进行点云离群点滤波操作,然后循环遍历点云的多维矩阵中的每一个元素,所述每一个元素即为点云的每一个像素点,去除点云中的nan点,在遍历的过程中得到点云中的每个像素点对应的矩阵,该矩阵表示每一个点的对应多个波段信息,最终,得到3d点云上每个像素点对应的波段信息。

[0045]

优选地,在步骤s7中,将3d点云和高光谱图像上每个像素点循环遍历,利用sift特征匹配算法对3d点云和高光谱图像进行像素点特征提取与匹配,找到相匹配的像素点对,匹配完成后将高光谱图像对应像素点的多个波段光谱信息端到端映射到相匹配的3d点云像素点的波段信息上,并将所有波段信息以点云形式进行数据存储,从而获得具有多波段光谱信息的三维图谱合一的高光谱点云数据。

[0046]

本技术还提出一种三维图谱合一的高光谱点云数据生成系统,所述系统包括:

[0047]

移动传感器设备,用于获取rgb图像数据;

[0048]

高光谱图像重建生成单元,用于构建多级光谱变换网络并训练,将单帧rgb图像输入至训练好的多级光谱变换网络,重建并生成高光谱图像;

[0049]

图像深度信息获取单元,用于构建深度预测网络并训练,将单帧rgb图像输入至训练好的深度预测网络,得到单帧rgb图像的初始深度信息;

[0050]

失真3d点云生成单元,用于确定移动传感器设备的相机初始焦距,根据初始深度信息和初始相机焦距计算生成失真3d点云;

[0051]

3d点云生成单元,用于构建3d点云生成网络,将失真3d点云数据作为输入,得到深度偏移调整因子与焦距调整因子以调整预测最终的深度信息和相机焦距,重建并生成3d点云数据;

[0052]

波段信息获取单元,用于对高光谱图像重建生成单元中得到的高光谱图像进行数据处理,获取高光谱图像每个像素点对应多个波段的光谱信息,对3d点云生成单元中生成的3d点云数据进行点云处理,获取3d点云上每个像素点对应的波段信息;

[0053]

三维图谱合一单元,将高光谱图像对应像素点的多个波段光谱信息端到端映射到3d点云像素点的波段信息上,获得具有多波段光谱信息的高光谱点云。

[0054]

在本技术方案中,利用传感器设备采集rgb图像数据,通过高光谱图像重建生成单元重建并生成高光谱图像,利用图像深度信息获取单元将单帧rgb图像输入至构建出并训练好的深度预测网络中,得到rgb图像的初始深度信息,然后利用失真3d点云生成单元根据初始深度信息和初始相机焦距生成失真3d点云,再利用3d点云生成单元构建3d点云生成网络,重建并生成3d点云数据,省略了通过外部设备采集高光谱图像数据和3d点云数据的过程,简化了采集过程并降低了成本。

[0055]

与现有技术相比,本发明技术方案的有益效果是:

[0056]

本发明提出一种三维图谱合一的高光谱点云数据生成方法及系统,首先利用移动传感器设备获取rgb图像数据,分别构建多级光谱变换网络和深度预测网络并进行训练,将单帧rgb图像输入,重建并生成高光谱图像并得到单帧rgb图像的初始深度信息,再确定移动传感器设备的相机初始焦距,计算生成失真3d点云,构建3d点云生成网络并将失真3d点云数据作为输入,重建并生成3d点云数据,对生成的高光谱图像和3d点云数据进行处理并获取光谱信息和波段信息,最后将高光谱图像对应像素点的多个波段光谱信息端到端映射到3d点云像素点的波段信息上,生成具有多波段光谱信息的高光谱点云,不仅能够准确获得目标或场景的高分辨空间三维特性,亦可在保留rgb图像高空间分辨率的同时获得高光谱分辨率,由此获取三维图谱合一的数据特征,提供丰富的光谱信息和物理几何信息,另外,高光谱点云的生成过程不需要光谱与点云两种异构数据独立采集及融合,简化了采集过程并降低了采集成本。

附图说明

[0057]

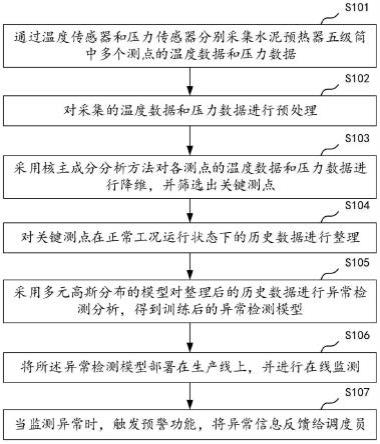

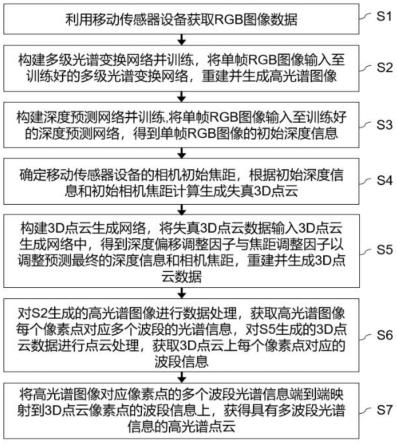

图1表示本发明实施例1中提出的三维图谱合一的高光谱点云数据生成方法的流程示意图;

[0058]

图2表示本发明实施例1中提出的三维图谱合一的高光谱点云数据生成方法的方法实施的流程框架示意图;

[0059]

图3表示本发明实施例1中移动传感器设备采集到的rgb图像;

[0060]

图4表示本发明实施例1中根据图3采集的rgb图像重建出的高光谱图像立方体可视化图像;

[0061]

图5表示本发明实施例1中根据图3采集的rgb图像预测的深度图;

[0062]

图6表示本发明实施例1中根据图3采集的rgb图像重建出的3d点云数据可视化图像;

[0063]

图7表示本发明实施例1中根据图4的高光谱图像和图6的3d点云数据生成的不同波段的高光谱点云数据伪彩色可视化图像;

[0064]

图8表示本发明实施例2中提出的三维图谱合一的高光谱点云数据生成方法的系统的整体结构示意图。

具体实施方式

[0065]

附图仅用于示例性说明,不能理解为对本专利的限制;

[0066]

为了更好地说明本实施例,附图某些部位会有省略、放大或缩小,并不代表实际尺寸;

[0067]

对于本领域技术人员来说,附图中某些公知内容说明可能省略是可以理解的。

[0068]

下面结合附图和实施例对本发明的技术方案做进一步的说明。

[0069]

附图中描述位置关系的仅用于示例性说明,不能理解为对本专利的限制;

[0070]

实施例1

[0071]

如图1所示,本实施例提出一种三维图谱合一的高光谱点云数据生成方法,该方法实施的流程框架示意图如图2所示,参见图1及图2,所述方法包括以下步骤:

[0072]

s1.利用移动传感器设备获取rgb图像数据,获取rgb图像如图3所示;

[0073]

在本实施例中,还需利用高光谱成像仪采集rgb-hsi图像对,rgb-hsi图像对中的rgb图像数据包括gnss坐标和各波段名称,存储于图像的元数据中;对获取的图3所示的rgb图像数据进行预处理操作,预处理操作包括畸变校正和立体校正。

[0074]

s2.构建多级光谱变换网络并训练,将单帧rgb图像输入至训练好的多级光谱变换网络,重建并生成高光谱图像,该过程生成的高光谱图像如图4所示;

[0075]

s3.构建深度预测网络并训练,将单帧rgb图像输入至训练好的深度预测网络,得到单帧rgb图像的初始深度信息,如图5所示;

[0076]

s4.确定移动传感器设备的相机初始焦距,根据初始深度信息和初始相机焦距计算生成失真3d点云;

[0077]

所述的失真3d点云的计算过程如下:

[0078]

设深度预测网络预测得到的单帧rgb图像的初始深度信息为d

init

、初始相机焦距为f

init

,将预测出的初始深度信息和初始相机焦距经过坐标变换公式得到失真3d点云数据:

[0079]

其中,

[0080]

其中,(u,v)为图像坐标系下的任意坐标点,u0,v0分别为单帧rgb图像的中心坐标,(xw,yw,zw)表示世界坐标系下的三维坐标点,zc表示相机坐标的z轴值,即目标到相机的距离,r、t均为外参矩阵,d

init

为初始深度信息,f

init

为初始焦距。

[0081]

s5.构建3d点云生成网络,将失真3d点云数据输入3d点云生成网络中,得到深度偏移调整因子与焦距调整因子以调整预测最终的深度信息和相机焦距,重建并生成3d点云数据,如图6所示;

[0082]

所述的3d点云生成网络由偏移点云网络nd()和焦距点云网络nf()构成;

[0083]

其中,3d点云生成网络的输入网络架构为pvcnn网络,将失真的3d点云数据输入3d点云生成网络中,获取深度偏移调整因子与焦距调整因子,调整预测最终的深度信息d

pred

以及重建3d点云数据;

[0084]

在调整与预测深度信息时,设失真的3d点云为将其作为偏移点云网络nd()的输入数据,构建训练目标函数为:

[0085][0086]

其中,θ是网络权重,f

*

是地面实况焦距,d

*

是地面实况深度,为深度偏移调整因

子;

[0087]

当调整与预测焦距时,将失真的3d点云作为焦距点云网络nf()的输入数据,构建训练目标函数:

[0088][0089]

其中,θ是网络权重,f

*

是地面实况焦距,d

*

是地面实况深度,为焦距调整因子;

[0090]

重复调整深度信息和调整焦距若干次,接着将调整预测得到的深度信息d

pred

与相机焦距f

pred

经过坐标变换公式重建生成3d点云数据,坐标变换公式如下:

[0091]

其中,

[0092]

其中,(u,v)为图像坐标系下的任意坐标点,u0,v0分别为图像的中心坐标,(xw,yw,zw)表示世界坐标系下的三维坐标点,zc表示相机坐标的z轴值,即目标到相机的距离,r、t分别为外参矩阵,d

pred

为最终预测的深度信息,f

pred

为最终预测的相机焦距。

[0093]

在本实施例中,对3d点云生成网络进行训练时,先从校准的立体diml中采样121k rgb-d图像,从来自kitti的rgb-d图像、来自3d ken burns论文的51k合成rgb-d图像采样数据,在训练期间,从所有数据集中保留1000张图像作为验证集,将图像调整为448

×

448,并以50%的几率水平翻转,每个批次在训练过程中均匀加载来自不同数据集的图像数据;此外,使用优化器adam进行网络优化,动量设置为0.8,对于超参数设置,网络的初始学习率固定为0.02,批量大小batch为40,学习率衰减为0.1。

[0094]

s6.对s2生成的高光谱图像进行数据处理,获取高光谱图像每个像素点对应多个波段的光谱信息,对s5生成的3d点云数据进行点云处理,获取3d点云上每个像素点对应的波段信息;

[0095]

加载并读取步骤s2中生成的高光谱图像数据,并将高光谱图像数据转化为高光谱图像的多维矩阵,接着循环遍历高光谱图像的多维矩阵中的每一个元素,所述每一个元素即为高光谱图像的每一个像素点,在遍历的过程中得到每个像素点对应的矩阵,该矩阵表示每一个像素点对应31个波段的光谱信息,最终,得到高光谱图像每个像素点对应多个波段的光谱信息;

[0096]

将步骤s5中三维重建生成的3d点云进行点云处理操作的步骤如下:

[0097]

加载并读取点云数据,将点云数据转化为点云的多维矩阵,进行点云离群点滤波操作,然后循环遍历点云的多维矩阵中的每一个元素,所述每一个元素即为点云的每一个像素点,去除点云中的nan点,在遍历的过程中得到点云中的每个像素点对应的矩阵,该矩阵表示每一个点的对应多个波段信息,最终,得到3d点云上每个像素点对应的6个波段信息(x,y,z,r,g,b)。

[0098]

s7.将高光谱图像对应像素点的多个波段光谱信息端到端映射到3d点云像素点的波段信息上,获得具有多波段光谱信息的高光谱点云,如图7所示。

[0099]

将3d点云和高光谱图像上每个像素点循环遍历,利用sift特征匹配算法对3d点云

和高光谱图像进行像素点特征提取与匹配,找到相匹配的像素点对,匹配完成后将高光谱图像对应像素点的多个波段光谱信息端到端映射到相匹配的3d点云像素点的波段信息上,并将所有波段信息以点云形式进行数据存储,从而获得具有多波段光谱信息的三维图谱合一的高光谱点云数据。

[0100]

实施例2

[0101]

本实施例针对步骤s2中构建的多级光谱变换网络、训练及将单帧rgb图像输入至训练好的多级光谱变换网络,重建并生成高光谱图像的过程、步骤s3构建的深度预测网络、训练及将单帧rgb图像输入至训练好的深度预测网络,得到单帧rgb图像的初始深度信息的过程进行说明。

[0102]

在步骤s2中,多级光谱变换网络由级联的多个单级光谱变换模块组成,每一个单级光谱变换网络由encoder-decoder的u形结构模块构成,该u形结构模块由多个光谱注意力模块构成,每一个光谱注意力模块包括具有hsi空间稀疏且光谱自相似性质的光谱多头自注意力模块和前馈网络模块;

[0103]

在多级光谱变换网络中,首先读取输入的rgb图像数据,并将rgb图像数据转化成多维矩阵表征信息,作为光谱多头自注意力模块s-msa的输入,其中,h表示多维矩阵的高度,w表示多维矩阵的宽度,c表示多维矩阵的光谱通道数;光谱多头自注意力模块s-msa将x

in

重塑为,将x线性投影到和,其中q为query,k为key,v为value,线性投影满足:

[0104]

q=xwq,k=xwk,v=xwv,其中为可学习的参数;

[0105]

沿着光谱通道,分别将q,k,v分割为n个head,且每个head维度其中c为光谱的通道数;根据每个光谱表征,计算headj的光谱自我注意力aj,同时,利用可学习参数与重新加权矩阵乘法来调整光谱自我注意力aj,表达式为:

[0106][0107]

其中,表示kj的转置矩阵;随后,通过引入位置嵌入函数f

p

()来编码不同光谱通道的位置信息,并且将n个head的输出信息连接起来,进行线性投影,满足:

[0108][0109]

其中为可学习参数,f

p

(

·

)为位置嵌入函数;

[0110]

最后通过改变数据的维度,对s-msa(x)的输出结果进行重塑,得到输出特征信息;利用ln归一化层对特征信息进行归一化,得到,将作为前馈网络模块的输入,利用conv 1

×

1对进行通道降维,引入gelu激活函数来增加其非线性因素,满足表达式为:

[0111]

;通过dw conv 3

×

3获得与的维度相同的特征图,利用gelu激活函数和conv 1

×

1构建瓶颈层进行特

征图通道升维,最终输出特征信息

[0112]

在光谱注意力模块中,首先将由原rgb图像数据经过conv 3

×

3层和单级光谱变换网络模块中的embedding层降维后得到的作为光谱注意力模块的输入,并利用ln层进行归一化,得到特征信息,接着x

in

经过光谱多头自注意力模块后获得特征信息,并且x

out

与x0进行矩阵加法操作后得到特征信息。再经过ln层的归一化后,得到特征信息,最后,x

out_0_ln

经过前馈网络模块后输出得到特征信息x

out_0_ln_ffn

,并与做矩阵加法操作,得到光谱注意力模块最终输出的特征信息

[0113]

在单级光谱变换网络模块中,单级光谱变换网络由encoder-decoder的u形结构模块所构成,其中encoder编码器由多个光谱注意力模块、embedding层和downsample层所构成;decoder编码器由多个光谱注意力模块、mapping层和upsample层所构成;首先将由原rgb图像数据经过embedding层降维后的得到作为encoder编码器的输入数据,经过encoder的编码与下采样后输出低维度的特征信息x2,接着将光谱注意力模块设置为bottleneck层;x2经过bottleneck层后输出特征信息x

2_o

,然后将x

2_o

作为decoder解码器的输入,经过decoder解码器的解码与上采样后输出特征信息,再将x0进行映射,得到具有多分辨率上下文信息的特征信息x

sst_out

。

[0114]

最后,多级光谱变换器网络模型由ns个单级光谱变换网络模块级联构成,能够从粗到细逐步提高光谱超分辨重建质量;首先将单帧rgb图像数据作为多级光谱变换网络模型的输入数据,利用conv 3

×

3来提取rgb图像的特征信息,接着将x

rgb

输入到单级光谱变换网络模块中,输出具有多分辨率上下文信息的特征信息x

sst_out

;然后利用conv 3

×

3从x

sst_out

中提取光谱特征信息,再与x

rgb

进行矩阵加法操作,从而获得具有多波段光谱信息的高光谱图像。

[0115]

在多级光谱变换网络构建完成后,对其进行训练,方式如下:

[0116]

使用步骤s1中获得的128

×

128 rgb-hsi图像对的自采数据集和ntire 2022公开数据集对多级光谱变换网络进行训练,在训练过程中,将rgb图像数据线性重缩放到[0,1],然后从ntire 2022数据集中裁剪出128

×

128 rgb-hsi样本对数据集,并将128

×

128 rgb-hsi图像对的自采数据补充到该裁剪得到的数据集中,训练的数据通过随机旋转和翻转来增强;此外,设批量大小batch为25,参数优化算法选择β1=0.8和β2=0.888的优化器adam,学习速率初始化为0.0003,并且对300个历元采用cosine annealing方案。

[0117]

步骤s3中构建的深度预测网络包括用于特征提取的标准主干resnet50和一个用于预测未知比例深度信息的decoder解码器,完成深度预测网络的构建后,训练深度预测网络;

[0118]

获取来自开源数据集的rgb-d图像数据,利用rgb-d图像数据训练深度预测网络,在训练过程中,将rgb-d图像数据的深度范围归一化为[0,1],进行图像归一化回归损失处理,图像归一化回归损失ilnr函数为:

[0119][0120]

其中,l

ilnr

表示图像归一化回归损失ilnr函数,,di表示预测的深度信息,表示地面实况深度信息;μ

trim

和σ

trim

分别表示深度图的平均值与标准差;

[0121]

利用成对正态回归pwn损失来提高局部几何特征学习的性能,成对正态回归pwn损失函数表达式为:

[0122][0123]

其中,l

pwn

成对正态回归pwn损失函数,设采样点为{(ai,bi),i=0,...,n},则采样点对应的曲面法线为{(n

ai

,n

bi

),i=0,...,n};n

*

表示地面真实曲面法线;为(ai,bi)的地面真实曲面法线;图像归一化回归损失ilnr函数和正态回归pwn损失函数共同构成深度预测网络总的损失函数;

[0124]

在本实施例中,对深度预测网络进行训练时,先从校准的立体diml的121k rgb-d图像、来自kitti的rgb-d图像、来自3d ken burns的51k合成rgb-d图像采样数据,在训练期间,从所有数据集中保留1000张图像作为验证集,将图像调整为448

×

448,并以50%的几率水平翻转,为每个批次均匀地加载来自不同数据集的数据,并使用批量大小为40的优化器adam进行网络优化,动量设置为0.8,对于超参数设置,网络的初始学习率固定为0.02,学习率衰减0.1;将单帧rgb图像数据输入至训练好的深度预测网络后,获得单帧rgb图像的初始深度信息。

[0125]

实施例3

[0126]

在本实施例中,如图8所示,提出了一种三维图谱合一的高光谱点云数据生成的系统,所述系统包括:

[0127]

移动传感器设备101,用于获取rgb图像数据;

[0128]

高光谱图像重建生成单元102,用于构建多级光谱变换网络并训练,将单帧rgb图像输入至训练好的多级光谱变换网络,重建并生成高光谱图像;

[0129]

图像深度信息获取单元103,用于构建深度预测网络并训练,将单帧rgb图像输入至训练好的深度预测网络,得到单帧rgb图像的初始深度信息;

[0130]

失真3d点云生成单元104,用于确定移动传感器设备的相机初始焦距,根据初始深度信息和初始相机焦距计算生成失真3d点云;

[0131]

3d点云生成单元105,用于构建3d点云生成网络,将失真3d点云数据作为输入,得到深度偏移调整因子与焦距调整因子以调整预测最终的深度信息和相机焦距,重建并生成3d点云数据;

[0132]

波段信息获取单元106,用于对高光谱图像重建生成单元中得到的高光谱图像进行数据处理,获取高光谱图像每个像素点对应多个波段的光谱信息,对3d点云生成单元中生成的3d点云数据进行点云处理,获取3d点云上每个像素点对应的波段信息;

[0133]

三维图谱合一单元107,将高光谱图像对应像素点的多个波段光谱信息端到端映射到3d点云像素点的波段信息上,获得具有多波段光谱信息的高光谱点云。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。