1.本发明涉及单图像超分辨率技术领域,特别涉及一种基于任务解耦的双分支超分辨率网络的图像超分辨率方法。

背景技术:

2.大数据时代,高分辨率图像在各个领域得到了越来越广泛的应用。在社媒领域,高分辨率图像可以提高用户的使用体验;在医疗领域,高分辨率图像可以帮助专业人士做出正确判断;在安防领域,高分辨率图像可以帮助有关部门维护社会治安。然而,由于设备成本、自然环境等因素的限制,往往导致采集到的图像分辨率较低、质量较差且纹理模糊。因此,单图像超分辨率(single image super-resolution,sisr)技术对各个领域都具有非常重要的研究意义。

3.单图像超分辨率是使用低分辨率(low-resolution,lr)图像生成高分辨率(high-resolution,hr)图像的一种技术。传统的单图像超分辨率基于插值策略,其代表性算法为最近邻插值算法(nearest neighbor interpolation)、双线性插值算法(bilinear interpolation)和双三次插值算法(bicubic interpolation)。然而,这些算法所使用的简单插值函数难以反映lr图像与hr图像之间复杂的映射关系,导致它们重建的超分辨率(super-resolution,sr)图像质量较差。

4.近年来,卷积神经网络(convolutional neural network,cnn)由于其拟合复杂映射的强大能力成为了研究的热点。许多使用cnn的单图像超分辨率策略被提出,如:基于深度的策略、基于注意力的策略和基于先验的策略。基于深度的策略的代表性算法为very deep convolutional network(vdsr),enhanced deep residual network(edsr)和residual dense network(rdn)。这些方法通过增加网络的深度以更好的拟合lr图像与hr图像之间的映射关系,从而重建更高质量的sr图像。基于注意力的策略的代表性算法为residual channel attention network(rcan),second-order attention network(san)和holistic attention network(han)。这些方法通过在网络中添加注意力模块以更好的利用来自不同特征图中的信息,使网络生成的sr图像含有更多纹理细节。基于先验的策略则通过利用图像中的先验信息,如:结构自相似性先验信息、噪声先验信息和梯度先验信息,以缓解sisr的不适定性,使得超分辨率过程更有效。该策略的代表性算法为non-local recurrent network(nlrn),residual non-local attention network(rnan)和cross-scale non-local network(csnln)。

5.然而,图像中不同类型信息的性质并不相同。以图像中最重要的两种信息结构信息和颜色信息为例,前者已经被证明具有长距离自相似性(long-range self-similarity),而图像中大量含有相似的颜色信息的区域则表明后者具有局部自相似性(local self-similarity)。因此,在超分辨率的过程中对这两种信息进行不加区分的处理是不合理的,并可能会导致网络的性能下降。例如,非局部操作(non-local operation)在挖掘图像中结构信息的长距离自相似性时,会不可避免的受到图像中颜色信息的局部自相

似性的影响。这一影响大大增加了网络的计算量。

6.因此,针对以上问题,如何设计出一种能够更灵活的处理图像中不同种类的信息的单图像超分辨率方法已经成为了一个亟待解决的问题。

技术实现要素:

7.本发明的目的在于提供一种基于任务解耦的双分支超分辨率网络的图像超分辨率方法,可以得到质量更佳的超分辨率图像。

8.为实现以上目的,本发明采用的技术方案为:一种基于任务解耦的双分支超分辨率网络的图像超分辨率方法,包括如下步骤:获取lr-hr图像对作为训练样本;搭建由结构提取分支和颜色提取分支构成的双分支超分辨率网络,利用训练样本对网络进行训练得到训练后的双分支超分辨率网络;将待处理图像作为lr图像导入到训练后的双分支超分辨率网络中,网络输出的结果即为hr图像。

9.与现有技术相比,本发明存在以下技术效果:通过构建双分支超分辨率网络,其中的结构提取分支可以方便的提取图像的结构特征,颜色提取分支在不断提取更深层次特征的同时,不断的增强其中的颜色信息,最后混合这两种信息,得到更加优秀的超分辨率图像,通过对图像中的结构信息和颜色信息作有针对性的处理,实现了在多种超分辨率任务下的优异表现。

附图说明

10.图1是本发明的流程示意图;

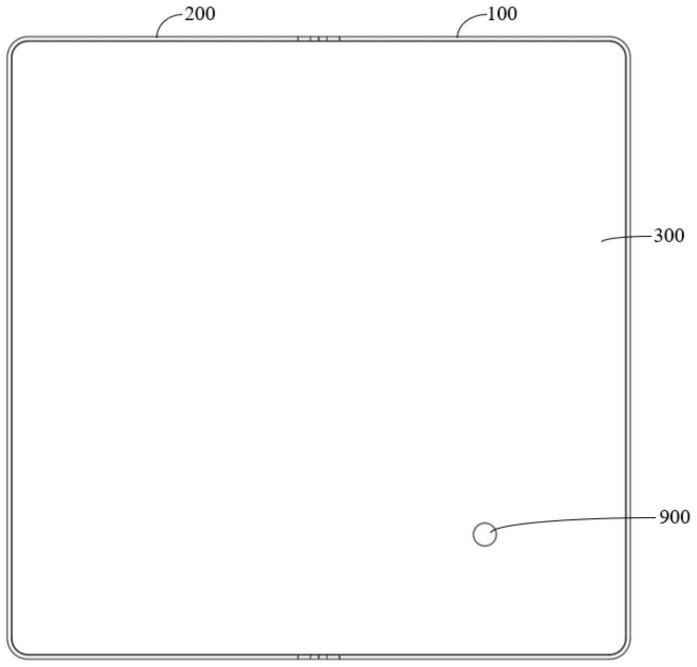

11.图2是本发明中双分支超分辨率网络的结构示意图;

12.图3是本发明中上下文归因池化层的结构示意图;

13.图4是本发明中色彩增强模块的结构示意图;

14.图5为本发明的bi超分辨率结果与其他方法的结果的对比示意图;

15.图6为本发明的bd超分辨率结果与其他方法的结果的对比示意图;

16.图7为本发明的dn超分辨率结果与其他方法的结果的对比示意图;

17.图8为本发明对单图像超分辨率任务的解耦示意图。

具体实施方式

18.下面结合图1至图8,对本发明做进一步详细叙述。

19.参阅图1,一种基于任务解耦的双分支超分辨率网络的图像超分辨率方法,包括如下步骤:获取lr-hr图像对作为训练样本;搭建由结构提取分支和颜色提取分支构成的双分支超分辨率网络,利用训练样本对网络进行训练得到训练后的双分支超分辨率网络;将待处理图像作为lr图像导入到训练后的双分支超分辨率网络中,网络输出的结果即为hr图像。通过构建双分支超分辨率网络,其中的结构提取分支可以方便的提取图像的结构特征,颜色提取分支在不断提取更深层次特征的同时,不断的增强其中的颜色信息,最后混合这两种信息,得到更加优秀的超分辨率图像,通过对图像中的结构信息和颜色信息作有针对性的处理,实现了在多种超分辨率任务下的优异表现。

20.进一步地,为了方便的获取到训练样本,我们对已经拥有的hr图像进行剪裁和下

采样操作以获取lr-hr图像对;其中,lr作为网络的输入,hr用于监督网络的训练;随后,所有lr-hr图像对被封装为一个训练数据集,以便输入网络中进行训练。为了方便讨论,设超分辨率的倍数为k,训练样本的维度为c

×h×

w,其中,h和w为图像的长和宽,c为图像的通道数。具体地,所述的获取lr-hr图像对作为训练样本包括如下步骤:获取准备作为训练样本的hr图像;对hr图像进行剪裁得到剪裁后的图像i

hr

,剪裁的目的是为了方便对其进行正确的下采样;对剪裁后的图像i

hr

按如下公式进行下采样得到lr图像i

lr

:i

lr

=imresize(crop(i

hr

,k),method=

′

bicubic

′

),其中,imresize()代表matlab软件中的imresize函数,crop(i

hr

,k)代表将训练样本i

hr

的h和w调整为k的整数倍,method代表下采样所使用的插值函数,通常为双三次插值;lr图像维度为c

×

h/k

×

w/k。将图像i

lr

和i

hr

组成图像对,并转换为张量形式;将张量形式的图像对进行封装得到训练样本,其中,封装的图像对总个数以及每批次的图像对个数可以通过程序自由调整。

21.参阅图2,进一步地,所述的双分支超分辨率网络包括浅层特征提取模块、结构提取分支、颜色填充分支、超分辨率重建模块,双分支超分辨率网络的表达式如下:i

sr

=h

rm

(h

se

(h

sfem

(i

lr

)),h

cf

(h

sfem

(i

lr

))),其中,i

lr

和i

sr

分别代表双分支超分辨率网络的输入和输出,h

sfem

、h

se

、h

cf

与h

rm

分别代表浅层特征提取模块、结构提取分支、颜色填充分支和超分辨率重建模块的函数。这里的结构提取分支和颜色填充分支即我们所说的双分支,浅层特征提取模块相当于两个分支前面的预处理,超分辨率重建模块用于对双分支进行特征融合。

22.进一步地,所述的浅层特征提取模块包括第一卷积层,其表达式如下:f

shallow

=c1(i

lr

),其中,f

shallow

代表该模块从其输入中提取的浅层特征,c1代表第一卷积层的函数。浅层特征提取模块即图2中的sfem,通过第一卷积层,可以方便的提出去浅层特征f

shallow

,后面的两个分支,都是针对浅层特征f

shallow

进行处理的。

23.进一步地,所述的结构提取分支包括1个编码器和1个解码器,其表达式如下:f

struct

=h

de

(h

en

(f

shallow

)),其中,f

struct

代表该分支从其输入中提取的含有结构信息的特征,h

en

和h

de

分别代表编码器和解码器的函数。结构提取分支即图2中的structure extraction branch方框中所包括的结构。图像中不同类型的信息拥有不同的性质,因此需要使用不同的处理方式对其进行处理。对于结构提取分支,设置编码器,通过不断的下采样操作,使该分支专注于提取和处理图像中的结构信息。设置解码器,通过不断的上采样操作,以恢复图像中的结构信息。

24.传统的最大池化层与平均池化层的池化规则是固定的,其使用滑动窗口进行池化操作;这使其难以准确的提取出最关键的特征,且限制了其利用全局上下文信息的能力。因此,为了使结构提取分支更加高效,我们设计了一个crpl进行下采样操作,作为本发明的优选方案,所述的编码器由3个编码块组成;每个编码块由1个残差块和1个上下文归因池化层组成,其表达式如下:f

en

=h

crpl

(h

rb

(f

in1

)),其中,f

en

和f

in1

分别代表编码器的输出和输入,h

crpl

和h

rb

分别代表上下文归因池化层和残差块的函数。残差块,即residual blocks,在图2中记为rb;上下文归因池化层,即context reasoning pooling layer,简写为crpl。crpl由一个卷积核2

×

2的卷积层修改而来。其步长也为2

×

2,以对输入进行降采样操作。这种做法使得其池化规则可学习,从而能够对输入的特征图进行更加灵活的处理。

25.参阅图3,此外,为了克服滑动窗口对利用全局上下文信息的限制,所述上下文归因池化层的表达式如下:f

crpl

=(w

⊙

wg)f

in2

b,其中,对上一层输出的特征图进行编码得到

门限矩阵wg,w是上下文归因池化层的卷积核,f

in2

和f

crpl

分别代表上下文归因池化层的输入和输出,b代表上下文归因池化层的偏差。这样,crpl便在全局上下文信息的监督下进行卷积核与步长均为2

×

2卷积操作,对输入进行下采样。这使得其能够利用包含在全局上下文信息中的图像中结构信息的长距离自相似性,从而在池化操作中更好保留相关特性。

26.进一步地,所述的解码器由3个解码块组成;每个解码块由1个残差块和1个转置卷积层组成,其表达式如下:f

de

=c

t

(h

rb

(f

in3

)),其中,f

de

和f

in3

分别代表解码器的输出和输入,c

t

和h

rb

分别为转置卷积层和残差块的函数。转置卷积层,即transposed convolutional layer,也称为反卷积,对应图2中的deconvolution 3

×

3这个框。

27.参阅图4,颜色填充分支则致力于恢复图像中的结构信息。作为本发明的优选方案,所述的颜色填充分支包括n个颜色增强组,其表达式如下:f

color

=hn(

…

h2(h1(f

shallow

))

…

),其中,f

color

代表该分支从其输入中提取的含有色彩信息的特征,hn代表第n个颜色增强组;所述的颜色增强组由m个颜色增强模块组成,每个颜色增强模块由一个残差块和一个颜色增强块组成,颜色增强块的表达式如下:f

ceb

=f

in4

αh

cbam

(f

in4-h

pi

(f

in4

)),其中,f

in4

与f

ceb

分别代表颜色增强块的输入和输出,h

cbam

代表cbam模块,h

pi

代表池化-插值操作。

28.为了方便描述该分支结构,首先需要知道三个概念:其一,颜色增强组,即color enhancement group,也即图2中的ceg;其二,颜色增强模块,即color enhancement module,也即图2中的cem;其三,颜色增强块,即color enhancement block,也即图2中的ceb。如前所述,该分支的基础模块为cem,由一个rb与一个ceb组成。ceb是基于图像中颜色特征的局部自相似性而设计的。首先,ceb使用池化-插值操作提取输入特征图中的平均颜色信息强度;然后,将该平均颜色信息强度从输入中减去以突出不同颜色信息之间的区别,并获得了差异特征,该差异特征随后被一个cbam模块所处理,以帮助ceb更好利用其中的信息;最后,cbam的输出被一个可学习权重α加权后,与输入相加以获得被增强了颜色信息的输出。这样,颜色提取分支便可以在不断的提取更深层次特征的同时,不断的增强其中的颜色信息,最终完成提取并恢复图像中颜色信息的任务。

29.在使用结构提取分支与颜色填充分支提取了丰富的结构信息和颜色信息后,我们使用简单的点乘操作混合这两种信息,并将其送入超分辨率重建模块进行超分辨率图像的重建工作。具体地,所述的超分辨率重建模块包括1个第二卷积层和1个亚像素卷积层,其表达式如下:i

sr

=p(c2(f

strcut

,f

color

)),其中,p和c2分别代表该亚像素卷积层和第二卷积层的函数。这样,双分支超分辨率网络便以更具有针对性的方式提取并处理了图像中的结构信息与颜色信息,并得以高质量的重建超分辨率图像。

30.在得到了超分辨率结果后,使用l1损失函数计算衡量超分辨率结果i

sr

与真实数据i

hr

之间的误差,并使用反向传播方法优化网络参数,这样才完成双分支超分辨率网络的训练。具体地,所述的利用训练样本对网络进行训练得到训练后的双分支超分辨率网络包括如下步骤:将lr-hr图像对中的图像i

lr

代入双分支超分辨率网络中得到图像i

sr

;根据图像i

sr

、lr-hr图像对中的图像i

hr

以及下列损失函数计算公式计算损失loss:

31.32.其中,为输入数据所对应的真实图像,为双分支超分辨率网络的超分辨率结果,上标i用于指明超分辨率结果与真实图像的对应关系,n为每一批次的总样本数,图8中的hr和sr即分别对应图像i

hr

和图像i

sr

,图8中的sebranch为结构提取分支structure extraction branch的简写,cfbranch为颜色填充分支color fill branch的简写。通过此步骤,可以方便的实现网络参数的训练,训练后得到的双分支超分辨率网络就可以直接用来直接对输入的lr图像进行超分辨率得到其对应的hr图像,非常方便。

33.下面结合实验对本发明的效果做进一步的说明。

34.1、实验条件:本发明实验的计算机硬件环境为intel corei9-10980xecpu和gtx3090gpu,软件环境为centos 7.6操作系统,编译环境为pycharm,深度学习框架为pytorch;后续所有的训练和测试均基于该平台。本发明所使用的训练数据集和验证数据集为div2k数据集的训练集和验证集,分别含有800张和100张2k分辨率的自然图像。本发明使用五个测试集以全面的评估其性能,分别为:set5数据集、set14数据集、bsd100数据集、urban100数据集和manga109数据集。

35.2、超分辨率评价指标:为了评估本发明超分辨率方法的超分辨率性能,本发明使用峰值信噪比(peak signal to noise ratio,psnr)与结构相似性(structural similarity,ssim)两种评价指标对超分辨率结果进行评估。

36.psnr是一种评价图像的客观的评价指标,其表达式如下:

[0037][0038]

其中,mse代表i

sr

与其对应的i

hr

的均方误差(mean-square error,mse)。然而,psnr的数值无法和人眼看到的视觉品质完全一致。为了克服这一缺点,我们还使用ssim对超分辨率结果进行评估,其表达式如下:

[0039][0040]

其中,μ

x

与μy分别代表x与y的平均值,σ

x

与σy分别代表x与y的方差,σ

xy

分别代表x与y的协方差,c1与c2是用于维持稳定的常数,由以下公式计算:c1=(k1l)2,c2=(k2l)2,其中,l是图像中像素值的最大值,k1=0.01,k2=0.03。ssim将失真建模为亮度、对比度和结构三个不同因素的组合,使得其相较于psnr而言更能反应图像的质量。

[0041]

3、实验内容及结果分析。

[0042]

实施例一:为了验证本发明所提出方法的有效性,我们对比了双分支超分辨率网络与其他最先进的(state-of-the-art,sota)方法在

×

2、

×

3和

×

4超分辨率倍数的bicubic(bi)超分辨率任务上的表现,测试结果如表1所示。

[0043]

[0044][0045]

[0046]

bi超分辨率任务使用bicubic插值函数从hr图像中生成lr图像,网络需要学习如何恢复因插值而丢失的图像中的细节。从表1的定量比较结果中可以看出,简单的插值函数限制了基于插值策略的方法的性能,使其表现远逊色于基于其他策略的方法。基于深度策略的方法由于拥有强大的拟合复杂映射的能力,取得了不错的超分辨率结果。然而这些网络往往由于过深而难以训练。基于注意力策略的方法通过对特征图中的信息进行更合理的利用,取得了比基于深度策略的方法更好的超分辨率结果。基于先验策略的方法缓解了sisr任务的不适定性。然而由于需要在更多的先验信息与更多的计算量之间做取舍,这些方法的表现往往逊色于基于注意力策略的方法。本发明所提出的基于任务解耦策略的方法,由于使用更加灵活的方法处理图像中不同种类的信息,在所有的情况下都取得了最优或者次优的超分辨率结果。图5展示了本发明所述方法与sota方法的定性比较结果。可以看出,本发明所述方法得到的超分辨率结果拥有更加锐利的边缘与更精细的细节,更少受伪影的影响。

[0047]

实施例二:为了进一步验证本发明所提出方法的有效性,我们还对比了双分支超分辨率网络与其他sota方法在

×

3超分辨率倍数的blur-downscale(bd)超分辨率任务上的表现。测试结果如表2所示。

[0048][0049][0050]

bd超分辨率任务先使用一个大小为7

×

7、标准差为1.6的高斯核对hr图像进行模

糊操作,然后使用bicubic插值函数从模糊后的hr图像中生成lr图像。相较于bi超分辨率任务,bd超分辨率任务更具有挑战性。网络不仅需要学习如何恢复因插值而丢失的图像中的细节,还需要学习如何去处理因模糊操作而混淆的图像中的细节信息。从表2的定量比较结果中可以看出,相较于基于其他策略的方法,本发明所提出的基于任务解耦策略的方法展现出了较大的优越性。在manga109数据集上,dbsrn超越现有最优方法0.18psnr与0.0008ssim。图6展示了本发明所述方法与sota的方法在bd超分辨率任务上的定性比较结果。由于模糊操作的加入,相比较的sota方法的超分辨率结果中均出现了不同程度的过平滑现象。而本发明所述方法的超分辨率结果则含有更丰富的纹理细节,并且看上去更加自然。

[0051]

实施例三:为了更加全面的验证本发明所提出方法的有效性,除了bi、bd超分辨率任务,我们还对比了双分支超分辨率网络与其他sota方法在

×

3超分辨率倍数的downscale-noise(dn)超分辨率任务上的表现,测试结果如表3所示。

[0052][0053]

dn超分辨率任务先使用传统的bicubic插值函数对hr图像进行下采样,然后对下采样得到的lr图像中添加强度为30的随机高斯噪声。由于高斯噪声的添加,lr图像丢失了许多关键性信息。从表3的定量比较结果中可以看出,本发明所述方法表现出了明显的优越性,在所有情况下均超越了比较的sota方法。在包含了大量纹理细节的urban100和manga09数据集上,本发明所述方法超越了sota方法各0.16与0.12psnr与0.0044与0.0013ssim。图7所展示的本发明所述方法与sota的方法在dn超分辨率任务上的定性比较结果进一步证明了这一结果。

[0054]

综上所述,本发明所提出的使用基于任务解耦策略的双分支超分辨率网络的单图像超分辨率方法,通过对图像中的结构信息和颜色信息作有针对性的处理,实现了在多种超分辨率任务下的优异表现。

[0055]

以上显示和描述了本发明的基本原理、主要特征和本发明的优点。本行业的技术人员应该了解,本发明不受上述实施例的限制,上述实施例和说明书中描述的只是本发明的原理,在不脱离本发明精神和范围的前提下本发明还会有各种变化和改进,这些变化和改进都落入要求保护的本发明的范围内。本发明要求的保护范围由所附的权利要求书及其等同物界定。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。