1.本发明涉及遥感图像分析和多模态分析技术领域,尤其涉及一种多模态表示学习的遥感图像异常事件检测方法及装置。

背景技术:

2.随着遥感技术的发展,从遥感图像上实现异常事件检测在多媒体计算研究领域受到广泛的关注。遥感图像异常事件检测对自然灾害(例如:火灾、爆炸等)、军事领域等方面都有很广泛的应用前景。然而,在面对高分辨率、场景内容复杂的遥感图像时,如何更好地有效地检测出异常的事件,依然是困扰很多人的难题。因此,建立科学合理的检测模型具有十分重要的意义。

3.多模态学习旨在通过研究多模态体的模态信息间的某种关系来优化提取的模态特征。而且,学习多模态数据间互补的信息可最大限度地减少信息冗余,有利于更高效地整合各种模态信息。多模态融合是将来自两个或多个模态的信息整合以得到一致的更全面的特征表示。在这个过程中,来自不同模态的信息可能具有不同的预测能力和噪声拓扑,而融合后的特征表示保证模型在某些模态缺失时仍能有效工作,提高了模型的鲁棒性。

4.目前,在遥感图像异常检测研究中,从多模态信息的角度来增强视觉信息的表达从而提高模型准确性仍未得到充分的探索。

技术实现要素:

5.本发明提供了一种多模态表示学习的遥感图像异常事件检测方法及装置,本发明充分利用了遥感图像的多种模态信息实现了高效、准确的遥感图像异常事件检测,详见下文描述:

6.一种多模态表示学习的遥感图像异常事件检测方法,所述方法包括:

7.利用多粒度语义联合表示网络中的属性加权模块和相似度匹配模块学习视觉语义属性信息与文本内容模态信息之间的联合表示;

8.利用视觉增强的语义私有表示网络增强私有视觉表示和私有文本内容表示,获得模态私有域增强表示;

9.融合联合表示和模态私有域增强表示得到遥感图像的增强表示,并输入到分类器中实现遥感图像异常事件检测;

10.利用分类损失、差异性损失和重建损失进行训练与模型学习,通过学习后的模型实现对遥感图像的异常事件检测。

11.其中,所述联合表示为:

12.计算视觉语义属性特征对文本内容序列特征中每一时间序列表示的权重因子,并做归一化处理得到注意力得分;

13.计算文本内容特征的隐藏表示对文本内容序列特征中每一时间序列表示的权重因子及其归一化结果;将两部分各自的注意力分数作为各自的权重系数加成到文本内容序

列特征上,使文本内容序列特征整体聚合成文本内容表示;

14.将感知增强文本内容表示与视觉语义属性之间进行匹配,使用余弦相似性来定义视觉语义属性与文本内容表示的匹配程度,并利用多层感知机学习被视觉语义匹配后的文本内容表示以获得视觉语义属性信息与文本内容信息的联合表示。

15.进一步地,所述文本内容表示为:

[0016][0017][0018]vt

=ψ(αara α

trt

)

[0019]

其中,γ(

·

)表示级联操作,将视觉语义属性的中间层隐藏表示或者文本内容特征的中间层隐藏表示与文本内容序列特征的每一时间序列表示级联;级联后再做线性变换和非线性变换得到对每一个时间序列不同的加权因子,线性变换得到对每一个时间序列不同的加权因子,是这个过程中需要训练的学习参数,表示视觉语义或者文本内容描述的权重,表示视觉语义或者文本内容描述与文本内容序列表示的对齐程度;ψ(

·

)表示降维操作,将经过加权计算后的文本内容序列特征压缩,以聚合成文本内容表示α

i,j

′

表示模态i的第j

′

个权重系数。

[0020]

其中,所述模态私有域增强表示为:

[0021][0022]

其中,表示模态m在共享子空间中的公共表示,dc代表其维度大小,xm表示输入模态特征(m∈{v,t}),表示模态m的公有域编码网络,使用全连接层实现,是编码网络的投影矩阵;

[0023]

私有视觉子空间或私有文本内容子空间则分别保留了视觉模态和文本内容模态各自独有的信息,体现了模态间信息的差异性,定义为:

[0024][0025]

其中,表示模态m在其私有空间中的私有表示,代表其维度大小,表示模态m的私有域编码网络,使用全连接层实现,是模态m在其子空间中的投影矩阵。

[0026]

进一步地,所述融合联合表示和模态私有域增强表示得到遥感图像的增强表示,并输入到分类器中实现遥感图像异常事件检测具体为:

[0027][0028]

其中,表示私有视觉表示和私有文本内容表示融合后的模态私有域增强表示,代表其维度大小;concat(

·

)表示级联操作,表示私有子空间的视

觉表示的特征维度大小,表示私有子空间下的文本内容表示的特征维度大小。

[0029]

其中,所述利用分类损失、差异性损失和重建损失进行训练与模型学习,通过学习后的模型实现对遥感图像的异常事件检测具体为:

[0030]

对于分类损失,使用二元交叉熵损失进行分类:

[0031][0032]

其中,σ(

·

)是sigmoid函数,表示第i个短视频的真实标签向量yi的第j类,表示第i个短视频的预测标签向量的第j类,n为训练样本数量,c为异常事件的类型数量;

[0033]

对于差异性损失,对共享子空间获得的共享表示和私有子空间获得的私有表示施加f-范数约束:

[0034][0035]

其中,表示f-范数;

[0036]

对于重建损失,增加重建损失约束:

[0037][0038]

其中,dm(

·

)表示模态m的解码网络,解码网络的输入是共享表示和私有表示的联合,concat(

·

)表示级联操作,被用于级联各个模态的共享表示和私有表示。

[0039]

一种多模态表示学习的遥感图像异常事件检测装置,所述装置包括:处理器和存储器,所述存储器中存储有程序指令,所述处理器调用存储器中存储的程序指令以使装置执行任一项所述的方法步骤。

[0040]

本发明提供的技术方案的有益效果是:

[0041]

1、本发明使用一种多模态表示学习方法解决了异常事件检测中遥感图像信息描述不准确、噪声干扰信息多的问题;

[0042]

2、本发明构建多粒度语义联合表示网络学习遥感图像异常事件中的视觉语义属性信息与文本内容模态之间的联合表示,联合探究遥感异常事件视觉模态信息与文本内容模态信息的关联性;

[0043]

3、本发明构建视觉增强的语义私有表示网络来学习异常事件检测各模态私有域增强表示,以最大程度地增强遥感图像异常事件的私有视觉表示和私有文本内容表示,其次考虑到各个模态信息间的互补性,将联合表示和模态私有域增强表示直接融合获得遥感图像异常事件的增强表示。

附图说明

[0044]

图1为一种多模态表示学习的遥感图像异常事件检测方法的流程图。

具体实施方式

[0045]

为使本发明的目的、技术方案和优点更加清楚,下面对本发明实施方式作进一步

地详细描述。

[0046]

实施例1

[0047]

一种多模态表示学习的遥感图像异常事件检测方法及装置方法,该方法包括以下步骤:

[0048]

步骤101:提取遥感图像的视觉模态特征和文本内容模态特征,同时对遥感卫星图提取视觉语义属性模态特征;构建包含视觉模态特征、文本内容模态特征及视觉语义属性模态特征向量的三元组数据集,将三元组数据集划分成训练集和验证集用于训练与验证;

[0049]

步骤102:利用多粒度语义联合表示网络中的属性加权模块和相似度匹配模块来学习视觉语义属性信息与文本内容模态信息之间的联合表示;

[0050]

步骤103:利用视觉增强的语义私有表示网络最大程度地增强私有视觉表示和私有文本内容表示,获得模态私有域增强表示;

[0051]

步骤104:融合联合表示和模态私有域增强表示得到遥感图像的增强表示,并输入到分类器中实现遥感图像异常事件检测;

[0052]

步骤105:利用分类损失、差异性损失和重建损失这三种损失进行训练与模型学习,通过学习后的模型实现对遥感图像的异常事件检测。

[0053]

综上所述,本发明实施例通过上述步骤101-105充分利用了遥感图像的多种模态信息实现了高效、准确的遥感图像异常事件检测。

[0054]

实施例2

[0055]

下面结合图1,具体的计算公式对实施例1中的方案进行进一步地介绍,详见下文描述:

[0056]

步骤201:提取遥感图像的视觉模态特征和文本内容模态特征,同时对遥感卫星图提取视觉语义属性模态特征;构建包含视觉模态特征、文本内容模态特征及视觉语义属性模态特征向量的三元组数据集,划分成训练集和验证集;

[0057]

其中,提取视觉模态特征xv,提取文本内容模态特征x

t

,提取视觉语义属性模态特征xa:

[0058][0059]

其中,iv、i

t

和ia分别是输入的遥感原始图像、通过rsimage2caption(遥感图像文本内容生产网络)获取的遥感图像的文本内容、通过cnn提取的视觉语义特征图。表示视觉特征,dv是其维度大小;表示文本内容特征,d

t

是其维度大小;表示从关键帧图像中获得视觉语义属性表示,da是其维度大小。βv,β

t

,βa是待学习的网络参数,avgpooling表示平均池化操作,sententce2vector表示语句生成向量操作,resnet表示resnet56残差网络用于提取遥感图像特征。

[0060]

步骤202:利用多粒度语义联合表示网络中的属性加权模块和相似度匹配模块来学习视觉语义属性信息与文本内容模态信息之间的联合表示;

[0061]

首先使用两个lstm(长短期记忆网络)编码视觉语义属性特征和文本内容模态特

征,由lstm产生视觉语义特征潜在表示和文本内容特征潜在表示:

[0062]

{ha,ra}=lstm(xa;γa)

[0063]

{h

t

,r

t

}=lstm(x

t

;γ

t

)

[0064]

其中,表示视觉语义属性特征的中间层隐藏表示,da是其维度大小;表示视觉语义属性特征的最终表示,da是维度大小,na是序列长度;表示文本内容模态特征的中间层隐藏表示,d

t

是其维度大小;表示文本内容模态特征的最终表示,d

t

是维度大小,n

t

是序列长度;γa、γ

t

是待学习的网络参数。通过lstm对视觉语义属性和文本内容信息编码得到更有意义和信息更丰富的视觉语义属性特征和文本内容模态特征。

[0065]

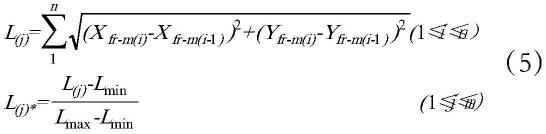

然后计算视觉语义感知的注意力得分。基本过程是计算视觉语义属性特征对文本内容序列特征中每一时间序列表示的权重因子,并做归一化处理得到注意力得分。受残差结构的启发,为保留原始文本内容描述中的有用信息,同样计算文本内容特征的隐藏表示对文本内容序列特征中每一时间序列表示的权重因子及其归一化结果。最后,将两部分各自的注意力分数当做各自的权重系数加成到文本内容序列特征上,使文本内容序列特征整体聚合成文本内容表示,公式如下:

[0066][0067][0068]vt

=ψ(αara α

trt

)

[0069]

其中,γ(

·

)表示级联操作,将视觉语义属性的中间层隐藏表示或者文本内容特征的中间层隐藏表示与文本内容序列特征的每一时间序列表示级联;级联后再做线性变换和非线性变换得到对每一个时间序列不同的加权因子,性变换得到对每一个时间序列不同的加权因子,是这个过程中需要训练的学习参数,表示视觉语义或者文本内容描述的权重,表示视觉语义或者文本内容描述与文本内容序列表示的对齐程度;ψ(

·

)表示降维操作,将经过加权计算后的文本内容序列特征压缩,以聚合成文本内容表示α

i,j

′

表示模态i的第j

′

个权重系数。

[0070]

在获得视觉语义感知增强的文本内容表示后,又考虑了此文本内容表示与视觉语义属性特征之间的细粒度匹配行为。具体来说,将感知增强文本内容表示与视觉语义属性之间的匹配行为定义为:

[0071]

sj=φ(v

t

,ha)

[0072]

其中,φ(

·

)可以通过不同的方法实现,例如:多层感知机(multi-layer perceptron,mlp)、内积或者余弦相似性等。

[0073]

经过分析,本发明实施例使用余弦相似性来定义视觉语义属性与文本内容表示的匹配程度,并利用mlp(多层感知机)学习被视觉语义匹配后的文本内容表示以获得视觉语义属性信息与文本内容信息的联合表示sj,具体公式如下所示:

[0074][0075]

步骤203:利用视觉增强的语义私有表示网络最大程度地增强私有视觉表示和私有文本内容表示,获得模态私有域增强表示;

[0076]

视觉增强的私有表示网络将原始视觉或文本内容表示分解为共享子空间表示和私有的视觉或文本内容子空间表示。这一过程通过编码网络实现。共享子空间倾向于提取公共的或不变的视觉和文本内容描述的共享表示特征,可定义为:

[0077][0078]

其中,表示模态m在共享子空间中的公共表示,dc代表其维度大小。xm表示输入模态特征(m∈{v,t}),表示模态m的公有域编码网络,使用全连接层实现,是编码网络的投影矩阵。

[0079]

类似地,私有视觉子空间或私有文本内容子空间则分别保留了视觉模态和文本内容模态各自独有的信息,体现了模态间信息的差异性,定义为:

[0080][0081]

其中,表示模态m在其私有空间中的私有表示,代表其维度大小。表示模态m的私有域编码网络,使用全连接层实现,是模态m在其子空间中的投影矩阵。

[0082]

步骤204:融合联合表示和模态私有域增强表示得到遥感图像的增强表示,并输入到分类器中实现遥感图像异常事件检测;

[0083]

为了突出视觉模态和文本内容模态之间的差异,最大程度地捕捉这种差异性。因此,模态融合阶段更多地关注不同模态之间的差异性。这一步骤通过联合私有视觉表示和私有文本内容表示实现从整体上获得模态私有域增强表示:

[0084][0085]

其中,表示私有视觉表示和私有文本内容表示融合后的模态私有域增强表示,代表其维度大小;concat(

·

)表示级联操作,表示私有子空间的视觉表示的特征维度大小,表示私有子空间下的文本内容表示的特征维度大小。

[0086]

最后,利用分类损失、差异性损失和重建损失这三种损失进行训练与模型学习。

[0087]

使用三种损失函数进行训练,包括:分类损失、差异性损失和重建损失。

[0088]

对于分类损失,由于事件检测任务可抽象为一个多分类问题,因此建议使用二元交叉熵损失进行分类:

[0089][0090]

其中,σ(

·

)是sigmoid函数,表示第i个短视频的真实标签向量yi的第j类,表示第i个短视频的预测标签向量的第j类,n为训练样本数量,c为异常事件的类型数量。

[0091]

对于差异性损失,在视觉增强的私有表示网络中,为了确保共享表示和私有表示

分别捕获输入的不同方面,对共享子空间获得的共享表示和私有子空间获得的私有表示施加f-范数约束:

[0092][0093]

其中,表示f-范数。

[0094]

对于重建损失,因为视觉增强的私有表示网络通过编码网络建立了共享子空间和私有子空间,为增强编码网络的鲁棒性,增加重建损失约束:

[0095][0096]

其中,dm(

·

)表示模态m的解码网络。而一个模态的共享表示和私有表示都是编码后的结果,为保证信息的完整性,解码网络的输入应当是共享表示和私有表示的联合,concat(

·

)表示级联操作,被用于级联各个模态的共享表示和私有表示。

[0097]

最后,在模型训练阶段最小化如下目标函数:

[0098]

l=λ1l

cls

λ2l

diff

λ3l

rec

[0099]

其中,λ1、λ2和λ3是平衡不同损失贡献的参数。

[0100]

通过进行合理的参数设置对模型进行训练,最终结果以平均绝对精度(map)作为模型性能评估指标。

[0101]

实施例3

[0102]

下面结合具体的算例对实施例1和2中的方案进行可行性验证,详见下文描述:

[0103]

本发明实施例描述如下:收集来自从baidu、bing、flickr网站上爬取得到的遥感异常检测数据集,数据集总共包含2000张遥感图像,6种类别的异常事件(火灾,爆炸,洪涝,海啸,风暴,泥石流)。其中张图片都通过rsimage2caption,2d-cnn获取包含数据模态,文本内容模态和视觉语义的多模态数据。随机将数据集分成三个组:按照80%作为训练集,20%作为验证集,且分别用p

train

和p

valid

来表示。每种集合包含三种模态特征p

set

={iv;i

t

;ia},其中set={train,valid}。将p

train

、p

valid

分别作为训练过程的训练集和验证集,用本发明实施例提出的方法进行训练。

[0104]

本发明实施例的检测性能使用平均精度均值(map)作为模型的评价指标。map的计算如下:首先计算准确率,对于预测结果来说,所有预测为正的样本包括:将正例预测为正(true positive,tp)和将负例预测为正(false positive,fp)两种情况。

[0105]

准确率是指预测正确的正例在所有预测为正例的样本中所占的比例,定义如下:

[0106][0107]

其次计算召回率,对于原始样本来说,原始的正例可能被预测为正例(true positive,tp)和负例(false negative,fn)两种情况。召回率是指预测正确的正例在原始所有正例样本中所占的比例,定义如下:

[0108][0109]

最后计算map,map是指计算所有类别平均精度(average precision,ap)的平均

值,代表着对ap的一个综合度量,ap通常是指p-r(p:precision,r:recall)曲线围起来的面积。其定义如下:

[0110][0111][0112]

其中,ik=1表示第k个样本为正,ik=0表示第k个样本为负。

[0113]

一种多模态表示学习的遥感图像异常事件检测装置,装置包括:处理器和存储器,存储器中存储有程序指令,处理器调用存储器中存储的程序指令以使装置执行任一项所述的方法步骤:

[0114]

利用多粒度语义联合表示网络中的属性加权模块和相似度匹配模块学习视觉语义属性信息与文本内容模态信息之间的联合表示;

[0115]

利用视觉增强的语义私有表示网络增强私有视觉表示和私有文本内容表示,获得模态私有域增强表示;

[0116]

融合联合表示和模态私有域增强表示得到遥感图像的增强表示,并输入到分类器中实现遥感图像异常事件检测;

[0117]

利用分类损失、差异性损失和重建损失进行训练与模型学习,通过学习后的模型实现对遥感图像的异常事件检测。

[0118]

其中,联合表示为:

[0119]

计算视觉语义属性特征对文本内容序列特征中每一时间序列表示的权重因子,并做归一化处理得到注意力得分;

[0120]

计算文本内容特征的隐藏表示对文本内容序列特征中每一时间序列表示的权重因子及其归一化结果;将两部分各自的注意力分数作为各自的权重系数加成到文本内容序列特征上,使文本内容序列特征整体聚合成文本内容表示;

[0121]

将感知增强文本内容表示与视觉语义属性之间进行匹配,使用余弦相似性来定义视觉语义属性与文本内容表示的匹配程度,并利用多层感知机学习被视觉语义匹配后的文本内容表示以获得视觉语义属性信息与文本内容信息的联合表示。

[0122]

进一步地,文本内容表示为:

[0123][0124][0125]vt

=ψ(αara α

trt

)

[0126]

其中,γ(

·

)表示级联操作,将视觉语义属性的中间层隐藏表示或者文本内容特征的中间层隐藏表示与文本内容序列特征的每一时间序列表示级联;级联后再做线性变换和非线性变换得到对每一个时间序列不同的加权因子,性变换得到对每一个时间序列不同的加权因子,是这个过程中需要训练的学习参数,表示视觉语义或者文本内容描述的

权重,表示视觉语义或者文本内容描述与文本内容序列表示的对齐程度;ψ(

·

)表示降维操作,将经过加权计算后的文本内容序列特征压缩,以聚合成文本内容表示α

i,j

′

表示模态i的第j

′

个权重系数。

[0127]

其中,模态私有域增强表示为:

[0128][0129]

其中,表示模态m在共享子空间中的公共表示,dc代表其维度大小,xm表示输入模态特征(m∈{v,t}),表示模态m的公有域编码网络,使用全连接层实现,是编码网络的投影矩阵;

[0130]

私有视觉子空间或私有文本内容子空间则分别保留了视觉模态和文本内容模态各自独有的信息,体现了模态间信息的差异性,定义为:

[0131][0132]

其中,表示模态m在其私有空间中的私有表示,代表其维度大小,表示模态m的私有域编码网络,使用全连接层实现,是模态m在其子空间中的投影矩阵。

[0133]

进一步地,融合联合表示和模态私有域增强表示得到遥感图像的增强表示,并输入到分类器中实现遥感图像异常事件检测具体为:

[0134][0135]

其中,表示私有视觉表示和私有文本内容表示融合后的模态私有域增强表示,代表其维度大小;concat(

·

)表示级联操作,表示私有子空间的视觉表示的特征维度大小,表示私有子空间下的文本内容表示的特征维度大小。

[0136]

其中,利用分类损失、差异性损失和重建损失进行训练与模型学习,通过学习后的模型实现对遥感图像的异常事件检测具体为:

[0137]

对于分类损失,使用二元交叉熵损失进行分类:

[0138][0139]

其中,σ(

·

)是sigmoid函数,表示第i个短视频的真实标签向量yi的第j类,表示第i个短视频的预测标签向量的第j类,n为训练样本数量,c为异常事件的类型数量;

[0140]

对于差异性损失,对共享子空间获得的共享表示和私有子空间获得的私有表示施加f-范数约束:

[0141][0142]

其中,表示f-范数;

[0143]

对于重建损失,增加重建损失约束:

[0144][0145]

其中,dm(

·

)表示模态m的解码网络,解码网络的输入是共享表示和私有表示的联合,concat(

·

)表示级联操作,被用于级联各个模态的共享表示和私有表示。

[0146]

本发明实施例对各器件的型号除做特殊说明的以外,其他器件的型号不做限制,只要能完成上述功能的器件均可。

[0147]

本领域技术人员可以理解附图只是一个优选实施例的示意图,上述本发明实施例序号仅仅为了描述,不代表实施例的优劣。

[0148]

以上所述仅为本发明的较佳实施例,并不用以限制本发明,凡在本发明的精神和原则之内,所作的任何修改、等同替换、改进等,均应包含在本发明的保护范围之内。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。