1.本技术涉及信息处理装置、信息处理方法和程序,特别涉及适合于在使摄影装置聚焦的情况下使用的信息处理装置、信息处理方法和程序。

背景技术:

2.通常,基于到成为待聚焦的对象的被摄体(以下称为摄影对象)的距离(以下称为被摄体距离)来调整相机的聚焦。

3.例如,在手动调整聚焦的情况下,用户通过估计到摄影对象的距离,粗略地调整聚焦。接下来,用户在查看由相机的成像元件生成的图像或者由镜头形成的摄影对象的图像的同时微调聚焦。

4.另一方面,在使聚焦调整自动化的情况下,例如,设置在相机附近的测距传感器测量到摄影对象的被摄体距离,并基于测量的被摄体距离调整相机的聚焦(例如,参见专利文献1)。

5.引文列表

6.专利文献

7.专利文献1:日本专利申请公开no.2019-3005

技术实现要素:

8.本发明要解决的问题

9.然而,测距传感器根据类型的不同而有优缺点。例如,根据测距传感器的类型,可以测量距离的范围变窄,距离测量的分辨率较粗,或者距离测量容易受到太阳光的影响。于是,并不总是能够精确地聚焦于摄影对象,存在聚焦的精度会随着状况的不同而降低的情况。

10.鉴于这种状况产生了本技术,本技术的目的是在不使用测距传感器的情况下,提高摄影装置的聚焦的自动调整的精度。

11.问题的解决方案

12.按照本技术的一个方面的信息处理装置包括:位置检测部,所述位置检测部基于第一摄影装置、第二摄影装置和作为待聚焦的对象的摄影对象之间的位置关系,检测第一摄影装置与摄影对象之间的距离;和聚焦控制部,所述聚焦控制部基于第一摄影装置与摄影对象之间的距离,控制第一摄影装置的聚焦。

13.按照本技术的一个方面的信息处理方法包括:基于第一摄影装置、第二摄影装置和摄影对象之间的位置关系,检测第一摄影装置与摄影对象之间的距离;和基于第一摄影装置与摄影对象之间的距离,控制第一摄影装置的聚焦。

14.按照本技术的一个方面的程序使计算机执行以下处理:基于第一摄影装置、第二摄影装置和摄影对象之间的位置关系,检测第一摄影装置与摄影对象之间的距离,和基于第一摄影装置与摄影对象之间的距离,控制第一摄影装置的聚焦。

15.在本技术的一个方面,基于第一摄影装置、第二摄影装置和摄影对象之间的位置关系,检测第一摄影装置与摄影对象之间的距离,并基于第一摄影装置与摄影对象之间的距离,控制第一摄影装置的聚焦。

附图说明

16.图1是图解说明本技术应用于的信息处理系统的构成例子的框图。

17.图2是图解说明摄影装置的构成例子的框图。

18.图3是图解说明摄影装置的信息处理部的构成例子的框图。

19.图4是图解说明信息处理装置的构成例子的框图。

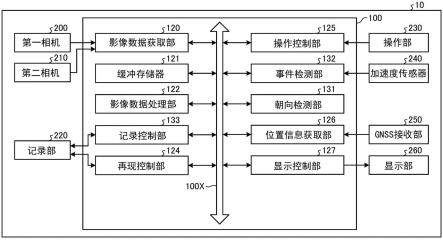

20.图5是图解说明信息处理装置的信息处理部的构成例子的框图。

21.图6是用于说明位置检测处理的流程图。

22.图7是用于说明摄影装置的外部参数的计算方法的示图。

23.图8是用于说明聚焦控制处理的流程图。

24.图9是图解说明各个摄影装置和摄影对象之间的位置关系的例子的示图。

25.图10是用于说明被摄体距离的计算方法的示图。

26.图11是用于说明被摄体距离的计算方法的示图。

27.图12是用于说明被摄体距离的计算方法的示图。

28.图13是图解说明待聚焦的对象的例子的示图。

29.图14是图解说明各个摄影装置和摄影对象之间的位置关系的例子的示图。

30.图15是图解说明各个摄影装置和摄影对象之间的位置关系的例子的示图。

31.图16是图解说明摄影对象信息的显示方法的例子的示图。

32.图17是图解说明摄影对象信息的显示方法的例子的示图。

具体实施方式

33.下面将说明用于实施本技术的实施方式(以下称为实施例)。将按照以下顺序进行说明。

34.1.实施例

35.2.变形例

36.3.其他

37.《《1.实施例》》

38.《信息处理系统1的构成》

39.图1图解说明本技术应用于的信息处理系统1的实施例的构成例子。

40.信息处理系统1包括摄影装置11-1~11-3和信息处理装置12。摄影装置11-1~11-3和信息处理装置12经由以有线或/和无线方式构成的网络相互连接,并交换各种数据。

41.注意,以下,在不需要单独区分摄影装置11-1~11-3的情况下,它们被简单地称为摄影装置11。

42.此外,图1图解说明了安装了3个摄影装置11的情况,不过只要存在至少2个摄影装置11就可以应用本技术,并且本技术也可以应用于存在4个以上的摄影装置11的情况。

43.摄影装置11拍摄静止图像或运动图像,并将与拍摄的静止图像或运动图像对应的

图像数据发送到信息处理装置12。

44.注意,摄影装置11只需要至少包括后面说明的聚焦自动调整功能,其方法和类型并无特别限制。

45.此外,在以下的说明中,图像表示构成由摄影装置11拍摄的静止图像或运动图像的一帧的图像。

46.通过分析由各个摄影装置11拍摄的图像,信息处理装置12检测各个摄影装置11和成为各个摄影装置11的待聚焦的对象的被摄体(摄影对象)之间的位置关系。此外,信息处理装置12基于各个摄影装置11和摄影对象之间的位置关系,调整各个摄影装置11的聚焦。

47.《摄影装置11的构成例子》

48.图2图解说明摄影装置11的构成例子。

49.摄影装置11包括光学系统101、成像元件102、数字信号处理器(dsp)103、中央处理器(cpu)104、显示单元105、操作系统106、帧存储器107、记录单元108、电源系统109、通信单元110等。光学系统101~通信单元110经由总线121相互连接。

50.光学系统101包括镜头系统等,捕捉来自被摄体的入射光(图像光),并在成像元件102的成像面上形成被摄体的图像。此外,光学系统101由cpu 104驱动,以调整摄影装置11的聚焦。

51.成像元件102将通过光学系统101入射到成像面的入射光的光量以像素为单位转换成电信号,并将其作为像素信号提供给dsp 103。

52.注意,可以使用任意类型的成像元件作为成像元件102。

53.dsp 103对从成像元件102供给的像素信号进行各种处理,并在帧存储器107上生成与由成像元件102拍摄的图像对应的图像数据。

54.cpu 104控制摄影装置11的各个单元。

55.显示单元105例如包括诸如液晶显示单元或有机电致发光(el)显示单元之类的面板型显示单元。显示单元105例如显示由成像元件102拍摄的静止图像或运动图像、操作屏幕等。

56.操作系统106例如包括各种操作设备,用于摄影装置11的操作。操作系统106生成基于用户操作的操作信号,并输出到总线121。

57.记录单元108例如将dsp 103生成的图像数据等记录在诸如硬盘驱动器(hdd)或数字通用光盘(dvd)之类的记录介质上。

58.电源系统109提供为摄影装置11的各个单元的操作所需的电力。

59.通信单元110通过预定通信方法与信息处理装置12通信。

60.注意,以下,省略了在摄影装置11中各个单元经由总线121交换数据等的情况下的总线121的记载。例如,在cpu 104和通信单元110经由总线121进行通信的情况下,省略了总线121的记载,简单地记载为cpu 104和通信单元110进行通信。

61.《信息处理部151的构成例子》

62.图3图解说明信息处理部151的构成例子,信息处理部151是通过cpu 104执行程序而实现的功能。

63.信息处理部151包括聚焦控制部161和显示控制部162。

64.聚焦控制部161例如通过基于从信息处理装置12接收的聚焦控制信号、包含在聚

焦控制部161中的自动聚焦(af)功能、或者从操作系统106供给的操作信号驱动光学系统101,来调整摄影装置11的聚焦。

65.显示控制部162控制显示单元105进行的各种图像的显示。

66.《信息处理装置12的构成例子》

67.图4图解说明信息处理装置12的硬件的构成例子。

68.信息处理装置12例如包括计算机。在信息处理装置12中,cpu 201、只读存储器(rom)202和随机存取存储器(ram)203经由总线204相互连接。输入/输出接口205也连接到总线204。输入单元206、输出单元207、存储单元208、通信单元209和驱动器210连接到输入/输出接口205。

69.输入单元206例如包括键盘、鼠标、麦克风等。

70.输出单元207例如包括显示器、扬声器等。

71.存储单元208例如包括诸如硬盘之类的非易失性存储器。

72.通信单元209通过预定的通信方法与各个摄影装置11通信。

73.驱动器210驱动诸如磁盘、光盘、磁光盘或半导体存储器之类的可拆卸记录介质211。

74.注意,由信息处理装置12(cpu 201)执行的程序可以通过记录在例如作为套装介质等的可拆卸记录介质211中来提供。例如,通过将可拆卸记录介质211附接到驱动器210,记录在可拆卸记录介质211中的程序经由输入/输出接口205安装在存储单元208中。

75.此外,程序例如经由诸如局域网、因特网或数字卫星广播之类的有线或无线传输介质被通信单元209接收,并被安装在存储单元208中。

76.此外,程序例如可以预先安装在rom 202或存储单元208中。

77.然后,在信息处理装置12中,例如,cpu 201经由输入/输出接口205和总线204,将存储在rom 202或存储单元208中的程序加载到ram 203中并执行该程序,从而进行一系列的处理。

78.注意,以下,省略了当在信息处理装置12中,各个单元经由总线204和输入/输出接口205交换数据等时的总线204和输入/输出接口205的记载。例如,在cpu 201和通信单元209经由总线204和输入/输出接口205进行通信的情况下,省略了总线204和输入/输出接口205的记载,简单地记载为cpu 201和通信单元209进行通信。

79.《信息处理部251的构成例子》

80.图5图解说明信息处理部251的构成例子,信息处理部251是通过cpu 201执行程序而实现的功能。

81.信息处理部251包括摄影装置控制部261和输出控制部262。摄影装置控制部261包括特征点检测部271、对象点设定部272、位置检测部273、运动预测部274和聚焦控制部275。

82.特征点检测部271检测由各个摄影装置11拍摄的图像的特征点。特征点检测部271将指示各个图像的特征点的检测结果的数据提供给对象点设定部272和位置检测部273。

83.对象点设定部272从各个图像的特征点中设定对象点,所述对象点是摄影对象中成为待聚焦的对象的部分(以下称为对象部分)。对象点设定部272将指示对象点的设定结果的数据提供给位置检测部273。

84.位置检测部273基于由各个摄影装置11拍摄的图像的特征点,检测各个摄影装置

11之间的位置关系。此外,位置检测部273基于各个摄影装置11之间的位置关系和设定的对象点,检测各个摄影装置11和摄影对象之间的位置关系。位置检测部273将指示各个摄影装置11和摄影对象之间的位置关系的检测结果的数据提供给运动预测部274和聚焦控制部275。

85.运动预测部274基于各个摄影装置11和摄影对象之间的位置关系的转变,预测摄影对象相对于各个摄影装置11的运动。运动预测部274将指示摄影对象相对于各个摄影装置11的运动的预测结果的数据提供给聚焦控制部275。此外,运动预测部274经由通信单元209,将指示摄影对象相对于各个摄影装置11的运动的预测结果的数据发送给各个摄影装置11。

86.聚焦控制部275调整各个摄影装置11的聚焦。例如,基于各个摄影装置11和摄影对象之间的位置关系,特别是各个摄影装置11和摄影对象之间的距离,聚焦控制部275为各个摄影装置11生成用于各个摄影装置11聚焦于摄影对象的聚焦控制信号。聚焦控制部275经由通信单元209,将对于各个摄影装置11的聚焦控制信号发送给各个摄影装置11。

87.此外,根据需要,聚焦控制部275基于摄影对象相对于各个摄影装置11的运动的预测结果,控制调整各个摄影装置11的聚焦的定时。

88.输出控制部262控制输出单元207进行的图像、声音等的输出。

89.《信息处理装置12的处理》

90.接下来,将说明信息处理装置12的处理。

91.《位置检测处理》

92.首先,将参考图6的流程图,说明由信息处理装置12执行的位置检测处理。

93.在步骤s101,信息处理装置12从各个摄影装置11获取图像数据。具体地,通信单元209从各个摄影装置11接收图像数据,并将图像数据提供给特征点检测部271。

94.注意,希望从各个摄影装置11获取的图像数据是与在彼此尽可能接近的定时(理想地同时)拍摄的图像对应的图像数据。

95.在步骤s102,特征点检测部271检测各个图像(即,基于从各个摄影装置11获取的图像数据的图像)的特征点。

96.例如,特征点检测部271检测表示出现在各个图像中的人的身体特征的部分作为特征点。例如,特征点检测部271检测人的关节,以及除人的关节以外的身体特征点,比如眼睛和鼻子。具体地,作为特征点,特征点检测部271例如检测人的左肩、右肩、左肘、右肘、左腕、右腕、指关节、指尖、左腰、右腰、左膝、右膝、左脚踝、右脚踝、头顶、脖子、右眼、左眼、鼻子、嘴巴、右耳、左耳等。

97.注意,这里作为身体特征提及的部分是例子,可以根据需要追加、删除或变更。

98.此外,特征点例如可以是具有一定大小的区域,或者诸如边缘之类的线段。例如,在检测眼睛作为特征点的情况下,眼睛的中央(虹膜的中央)、眼球、或者眼球和眼脸之间的边界(边缘)中的任何一个都可以是特征点。

99.注意,特征点检测部271例如可以对应于用户操作来检测特征点,或者可以使用预定的算法来检测特征点。

100.在前者的情况下,例如,在查看显示在包含于输出单元207中的显示器上的图像的同时,用户操作诸如包含在输入单元206中的鼠标之类的操作设备来指定图像中的期望部

分。然后,特征点检测部271检测用户指定的部分作为特征点。

101.在后者的情况下,例如,特征点检测部271通过应用称为open pose的技术来检测特征点,该技术记载在“zhe cao等,"realtime multi-person 2d pose estimation using part affinity fields",cvpr 2017”中(以下称为非专利文献1)。

102.非专利文献1中记载的技术是估计人的姿势的技术,并且检测具有上述人的身体特征的部分(例如,关节等),以便估计姿势。例如,在非专利文献1中记载的技术中,使用深度学习,从一张图像中估计关节位置,对于每个关节获得置信图,并通过连接各个关节,获得基于人的骨骼的姿势信息。

103.注意,特征点检测部271可以使用除非专利文献1的技术以外的技术来检测特征点。

104.此外,例如,特征点检测部271可以通过组合两者来检测特征点。例如,首先,特征点检测部271可以通过使用预定算法的图像分析来检测特征点,然后,用户可以对检测出的特征点进行验证,并指令特征点的追加、删除等。

105.特征点检测部271将指示各个图像的特征点的检测结果的数据提供给位置检测部273。

106.在步骤s103,位置检测部273检测各个摄影装置11之间的位置关系。

107.具体地,位置检测部273基于从由摄影装置11-1拍摄的图像中检测到的特征点以及从由摄影装置11-2拍摄的图像中检测到的特征点,检测摄影装置11-1和摄影装置11-2的相对位置关系。例如,位置检测部273检测当摄影装置11-1被设定为基准时的摄影装置11-2相对于摄影装置11-1的位置和定向(姿势)。

108.例如,作为摄影装置11-2相对于摄影装置11-1的位置和定向,位置检测部273计算用于将摄影装置11-1的相机坐标系转换成摄影装置11-2的相机坐标系的外部参数(以下称为摄影装置11-2的外部参数)。该外部参数包括旋转向量和平移向量。旋转向量表示摄影装置11-2的光轴在摄影装置11-1的相机坐标系中的定向,而平移向量表示摄影装置11-2的焦点在摄影装置11-1的相机坐标系中的位置。

109.该外部参数例如可以通过使用称为8点算法的算法来获得。

110.这里,如图7中图解所示,当用摄影装置11-1和摄影装置11-2拍摄三维空间中存在于摄影装置11-1的视野fov1和摄影装置11-2的视野fov2中的点p时,在各个摄影装置11的像平面上的投影点分别是q1和q2。在这种情况下,在投影点q1和投影点q2之间,以下的关系表达式(1)成立。

111.q

1t

fq2=0

···

(1)

112.这里,矩阵f是基础矩阵(fundamental matrix)。基础矩阵f可以通过当用各个摄影装置11拍摄三维空间中的点时准备8对以上的投影点(例如,(q1,q2))、并应用8点算法来获得。

113.此外,通过使用诸如焦距和图像中心之类的摄影装置11-1独有的内部参数k1、摄影装置11-2独有的内部参数k2、以及基本矩阵(essential matrix)e,可以将表达式(1)展开成以下的表达式(2)。

114.q

1tk1-t

ek2q2=0

···

(2)

115.此外,表达式(2)可以被展开成以下的表达式(3)。

116.e=k

1t

fk

2-1

···

(3)

117.在已知内部参数(k1,k2)的情况下,通过使用上述投影点对,可以计算基本矩阵e。此外,通过进行奇异值分解,可以将基本矩阵e分解成外部参数。此外,在表示摄影装置11-1的相机坐标系中的点p的向量为p1,并且表示摄影装置11-2的相机坐标系中的点p的向量为p2的情况下,基本矩阵e满足以下的表达式(4)。

118.p

1t

ep2=0

···

(4)

119.于是,通过对相对于三维空间中的点的矢量对(例如,(p1,p2))或者投影点对(例如,(q1,q2))应用8点算法,可以获得基本矩阵e。然后,通过对基本矩阵e进行奇异值分解,可以获得摄影装置11-2的外部参数。该外部参数表示摄影装置11-2相对于摄影装置11-1的位置和定向。

120.通过类似的方法,基于从由摄影装置11-1拍摄的图像中检测到的特征点以及从由摄影装置11-3拍摄的图像中检测到的特征点,位置检测部273检测当摄影装置11-1被用作基准时的摄影装置11-3相对于摄影装置11-1的位置和定向。

121.然后,位置检测部273通过整合摄影装置11-2相对于摄影装置11-1的位置和定向以及摄影装置11-2相对于摄影装置11-1的位置和定向,检测各个摄影装置11之间的位置关系。各个摄影装置11之间的位置关系例如用摄影装置11-2和摄影装置11-3在摄影装置11-1的相机坐标系中的位置和定向来表示。

122.注意,例如,位置检测部273可以将表示各个摄影装置11之间的位置关系的坐标系从摄影装置11-1的相机坐标系转换为世界坐标系。

123.之后,位置检测处理结束。

124.如上所述,仅基于由各个摄影装置11拍摄的图像来检测各个摄影装置11之间的位置关系。此外,基于各个摄影装置11之间的位置关系获得各个摄影装置11之间的距离和定向。注意,各个摄影装置11之间的距离例如由各个摄影装置11的焦点之间的距离来表示。各个摄影装置11之间的定向例如由各个摄影装置11的光轴之间的角度来表示。

125.此外,例如,通过重复执行该位置检测处理,即使在至少一个摄影装置11移动,从而各个摄影装置11的位置关系发生变化的情况下,也可以正确地检测各个摄影装置11的位置关系。在这种情况下,例如,通过在时间方向上平滑已计算的各个摄影装置11的外部参数,可以提高各个摄影装置11的位置关系的检测精度。

126.《聚焦控制处理的第一实施例》

127.接下来,将参考图8的流程图说明由信息处理装置12执行的聚焦控制处理的第一实施例。

128.该第一实施例是聚焦于存在于2个以上的摄影装置11的视野(摄影范围)内的摄影对象的情况下的处理。

129.以下,作为具体例子,将说明摄影装置11-1~11-3和作为人的摄影对象t1之间的位置关系如图9中图解所示的情况。

130.在本例中,摄影对象t1存在于摄影装置11-1的视野fov1中和摄影装置11-2的视野fov2中。另一方面,摄影对象t1存在于摄影装置11-3的视野fov3之外。

131.注意,假设通过上面参考图6说明的位置检测处理,已知各个摄影装置11之间的位置关系,更具体地,摄影装置11-1的位置pc1和定向、摄影装置11-2的位置pc2和定向、以及

摄影装置11-3的位置pc3和定向。于是,基于各个摄影装置11之间的位置关系,可以计算各个摄影装置11之间的距离和定向。

132.在步骤s151,通过与图6中的步骤s101中的处理类似的处理,从各个摄影装置获取图像数据。

133.在步骤s152,类似于图6中的步骤s102中的处理,特征点检测部271检测由各个摄影装置11拍摄的图像的特征点。特征点检测部271将指示特征点的检测结果的数据提供给对象点设定部272。

134.在步骤s153,对象点设定部272设定待聚焦的对象点。

135.这里,例如,对象点设定部272可以基于用户操作设定对象点,或者可以基于预定条件设定对象点。

136.在前者的情况下,例如,在输出控制部262的控制下,包含在输出单元207中的显示器显示各个图像以及各个图像的特征点的检测结果。

137.另一方面,用户操作诸如包含在输入单元206中的鼠标之类的输入设备,从显示的特征点当中选择期望各个摄影装置11聚焦于的一个特征点。此时,例如,能够选择对象点的范围被限定为在2个以上的图像中检测到的特征点。于是,只在一个图像中检测到的特征点从对象点的选择范围中被排除。然后,对象点设定部272将用户选择的特征点设定为对象点。

138.在后者的情况下,例如,对象点设定部272将在2个以上的图像中检测到的特征点当中,满足预定条件的特征点设定为对象点。例如,对象点设定部272将在2个以上的图像中检测到的特征点当中,与最接近摄影装置11-1的人的预定部位(例如,右眼)对应的特征点设定为对象点。

139.注意,在后者的情况下,例如,对象点设定部272基于预定条件设定的对象点可以由用户验证,并且可以根据需要进行变更。

140.然后,包括设定的对象点的被摄体成为摄影对象。

141.对象点设定部272将指示对象点的设定结果的数据提供给位置检测部273。

142.注意,以下,如图9中图解所示,假设摄影对象t1的特征点pt1(以下称为对象点pt1)被设定为对象点。

143.在步骤s154,位置检测部273检测各个摄影装置11的被摄体距离。

144.例如,通过以下方法,位置检测部273基于摄影装置11-1、摄影装置11-2和摄影对象t1之间的位置关系,检测摄影对象t1相对于摄影装置11-1的被摄体距离和摄影对象t1相对于摄影装置11-2的被摄体距离。

145.这里,如图10中图解所示,以摄影装置11-1的位置pc1(焦点)作为点a,摄影装置11-2的位置pc2(焦点)作为点b,并且摄影对象t1的对象点pt1作为点c,考虑连接点a、点b和点c的三角形abc。

146.注意,以下,边ab的长度为c1。长度c1与位置pc1和位置pc2之间的距离相等,表示摄影装置11-1和摄影装置11-2之间的距离。以下,边bc的长度为a1。长度a1与位置pc2和对象点pt1之间的距离相等,表示摄影对象t1相对于摄影装置11-2的被摄体距离。以下,边ca的长度为b。长度b等于对象点pt1和位置pc1之间的距离,表示摄影对象t1相对于摄影装置11-1的被摄体距离。

147.此外,以下,角cab的角度,即,边ca和边ab之间的角度为θa1。角度θa1等于相对于位置pc1的对象点pt1的方向和位置pc2的方向之间的角度,表示相对于摄影装置11-1的摄影对象t1的方向和摄影装置11-2的方向之间的角度。以下,角abc的角度,即,边ab和边bc之间的角度为θb。角度θb等于相对于位置pc2的位置pc1的方向和对象点pt1的方向之间的角度,表示相对于摄影装置11-2的摄影装置11-1的方向和摄影对象t1的方向之间的角度。

148.这里,由于位置pc1和位置pc2是已知的,因此可以计算出边ab的长度c1。于是,如果已知在边ab两端的角度θa1和角度θb,则三角形abc的形状和大小就会唯一地确定。即,位置pc1、位置pc2和对象点pt1之间的位置关系(摄影装置11-1、摄影装置11-2和摄影对象t1之间的位置关系)被唯一地确定。

149.例如,如图11中图解所示,考虑局部坐标系,其中摄影装置11-1的成像元件102的成像面is1的水平方向为x轴,垂直方向为y轴,并且光轴φ1的方向为z轴。

150.注意,为了使图易于理解,图11相反地图解说明了成像面is1和点a(摄影装置11-1的焦点)的位置关系。实际上,点a存在于点c和成像面is1之间。

151.表示摄影对象t1相对于摄影装置11-1的方向的方向向量vac等于通过成像面is1上与点c对应的点c'和摄影装置11-1的焦点(点a)的向量。于是,通过检测与摄影装置11-1拍摄的图像中的点c'对应的点,可以容易地计算方向向量vac。

152.此外,表示摄影装置11-2相对于摄影装置11-1的方向的方向向量vab等于通过摄影装置11-1的焦点(点a)和摄影装置11-2的焦点(点b)的向量。于是,由于已知点a的位置(位置pc1)和点b的位置(位置pc2),因此可以计算方向向量vab。

153.然后,全局坐标系中的角度θa1与局部坐标系中由向量vac和向量vab形成的角相等。于是,使用向量的内积公式,通过以下的表达式(5)计算角度θa1。

154.θa1=cos-1

(vac

·

vab)

···

(5)

155.注意,vac

·

vab表示方向向量vac和方向向量vab的内积。

156.类似地,使用表示摄影对象t1相对于摄影装置11-2的方向的方向向量vbc、和表示摄影装置11-1相对于摄影装置11-2的方向的向量vba,通过以下的表达式(6)计算角度θb。

157.θb=cos-1

(vbc

·

vba)

···

(6)

158.注意,vbc

·

vba表示方向向量vbc和方向向量vba的内积。

159.然后,基于边ab的长度c1、角度θa1和角度θb,利用正弦定律,通过以下的表达式(7)计算边ca的长度b。

160.b=c1

×

sin(θb)/sin(π-θb-θa1)

···

(7)

161.类似地,基于边ab的长度c1、角度θa1和角度θb,利用正弦定律,通过以下的表达式(8)计算边bc的长度a1。

162.a1=c1

×

sin(θa1)/sin(π-θa1-θb)

···

(8)

163.这样,计算出摄影对象t1相对于摄影装置11-1的被摄体距离(边ca的长度b),以及摄影对象t1相对于摄影装置11-2的被摄体距离(边bc的长度a1)。

164.此外,例如,位置检测部273通过以下方法,基于摄影装置11-1、摄影装置11-3和摄影对象t1之间的位置关系,检测摄影对象t1相对于摄影装置11-3的被摄体距离。更具体地,位置检测部273基于摄影装置11-1和摄影装置11-3的位置关系,以及摄影装置11-1和摄影对象t1的位置关系,检测摄影对象t1相对于摄影装置11-3的被摄体距离。

165.这里,如图12中图解所示,以摄影装置11-3的位置pc3作为点d,考虑连接点a、点d和点c的三角形adc。注意,在图12中,与图10对应的部分被赋予相同的附图标记。

166.注意,以下,边ad的长度为c2。长度c2等于位置pc1和位置pc3之间的距离,表示摄影装置11-1和摄影装置11-3之间的距离。以下,边dc的长度为a2。长度a2等于位置pc3和对象点pt1之间的距离,表示摄影对象t1相对于摄影装置11-3的被摄体距离。

167.此外,以下,角cad的角度,即,边ca和边ad之间的角度为θa2。角度θa2等于相对于位置pc1的对象点pt1的方向和位置pc3的方向之间的角度,表示相对于摄影装置11-1的摄影对象t1的方向和摄影装置11-3的方向之间的角度。以下,角adc的角度,即,边ad和边dc之间的角度为θd。角度θd等于相对于位置pc3的位置pc1的方向和对象点pt1的方向之间的角度,表示相对于摄影装置11-3的摄影装置11-1的方向和摄影对象t1的方向之间的角度。

168.这里,由于位置pc1和位置pc3是已知的,因此可以计算出边ad的长度c2。此外,通过上面参考图10说明的处理,已经计算出边ca的长度b。此外,通过上面参考图11说明的方法,可以计算出角cad的角度θa2。

169.于是,在三角形adc中,由于获得了边ca的长度b、边ad的长度c2、以及这两条边之间的角cad的角度θa2,因此三角形adc的形状和大小被唯一地确定。即,位置pc1、位置pc3和对象点pt1之间的位置关系(摄影装置11-1、摄影装置11-3和摄影对象t1之间的位置关系)被唯一地确定。

170.然后,通过以下的表达式(9)计算边dc的长度a2。

171.[表达式1]

[0172][0173]

以这种方式,计算摄影对象t1相对于摄影装置11-3的被摄体距离(边dc的长度a2)。

[0174]

注意,由于三角形adc的形状和大小被唯一地确定,因此还可以计算角度θd(相对于摄影装置11-3的摄影装置11-1的方向和摄影对象t1的方向之间的角度)。

[0175]

位置检测部273将指示摄影对象t1相对于各个摄影装置11的被摄体距离的检查结果的数据提供给聚焦控制部275。

[0176]

返回图8,在步骤s155,聚焦控制部275控制各个摄影装置11的聚焦。

[0177]

具体地,聚焦控制部275为每个摄影装置11生成用于控制聚焦于摄影对象t1(更确切地说,摄影对象t1的对象点pt1)的聚焦控制信号。聚焦控制部275经由通信单元209将聚焦控制信号发送给各个摄影装置11。

[0178]

另一方面,基于聚焦控制信号,各个摄影装置11的聚焦控制部161驱动光学系统101,以聚焦于摄影对象t1(更确切地说,摄影对象t1的对象点pt1)。

[0179]

例如,聚焦控制信号包括用于使摄影装置11聚焦于摄影对象t1的光学系统101的设定值。这里,摄影装置11的聚焦与被摄体距离关联,并且如果诸如变焦、光圈和焦距之类的光学系统101的状态被固定,则基于被摄体距离唯一地确定光学系统101的设定值(聚焦调整位置)。

[0180]

另一方面,摄影装置11的聚焦控制部161通过基于包含在聚焦控制信号中的设定值来驱动光学系统101,聚焦于摄影对象t1。

[0181]

或者,例如,聚焦控制信号包括摄影对象t1相对于摄影装置11的被摄体距离。

[0182]

另一方面,摄影装置11的聚焦控制部161基于包含在聚焦控制信号中的被摄体距离,计算用于聚焦于摄影对象t1的光学系统101的设定值。然后,聚焦控制部161通过基于计算的设定值驱动光学系统101,聚焦于摄影对象t1。

[0183]

如上所述,在不使用测距传感器的情况下,可以提高各个摄影装置11的聚焦的自动调整的精度。于是,例如,摄影装置11-1和摄影装置11-2能够正确地聚焦于摄影对象t1,并且在不模糊的情况下清晰地拍摄摄影对象t1。

[0184]

此外,摄影装置11-1和摄影装置11-2可以通过精确定位,聚焦于作为摄影对象t1的一部分的对象点pt1。于是,例如,如图13中图解所示,各个摄影装置11可以正确地聚焦于摄影对象t1的期望部分,比如手臂a1。

[0185]

此外,由于摄影对象t1不存在于摄影装置11-3的视野fov3内,因此摄影装置11-3无法单独检测摄影对象t1相对于摄影装置11-3的被摄体距离。于是,只有在摄影对象t1进入视野fov3之后,才能将摄影装置11-3调整为聚焦于摄影对象t1。

[0186]

然而,在本技术中,如上所述,即使摄影对象t1不存在于摄影装置11-3的视野fov3内,也能够检测摄影对象t1相对于摄影装置11-3的被摄体距离。结果,在摄影对象t1进入视野fov3之前,摄影装置11-3可以虚拟地聚焦于摄影对象t1。于是,在摄影对象t1进入视野fov3内的瞬间,摄影装置11-3进入聚焦于摄影对象t1的状态。

[0187]

此外,例如,如图14中图解所示,即使在摄影对象t1存在于摄影装置11-1的视野fov1内,但是由于障碍物o1(障碍物o1是与摄影对象t1不同的人)而处于盲区的情况下,也可以通过相似的方法检测摄影对象t1相对于摄影装置11-1的被摄体距离。然后,摄影装置11-1可以虚拟地聚焦于摄影对象t1。于是,例如,在摄影对象t1或障碍物o1移动,从而从摄影装置11-1变得可以看到摄影对象t1的瞬间,摄影装置11-1进入聚焦于摄影对象t1的状态。

[0188]

注意,例如,代替摄影装置11-1,可以使用摄影装置11-2,通过上面参考图12说明的方法来检测摄影装置11-3的被摄体距离。即,也可以基于摄影装置11-2、摄影装置11-3和摄影对象t1之间的位置关系,通过相似的方法检测摄影对象t1相对于摄影装置11-3的被摄体距离。

[0189]

此外,例如,可以基于摄影装置11-1、摄影装置11-3和摄影对象t1之间的位置关系,以及摄影装置11-2、摄影装置11-3和摄影对象t1之间的位置关系两者,来检测摄影对象t1相对于摄影装置11-3的被摄体距离。在这种情况下,例如,摄影装置11-3可以通过使用检测到的被摄体距离之一、被摄体距离的平均值等,聚焦于摄影对象t1。

[0190]

如果摄影装置11的数量增加,则可以相应地增加摄影对象t1相对于摄影装置11-3的被摄体距离的检测数量。类似地在这种情况下,例如,摄影装置11-3可以通过使用检测到的被摄体距离之一、被摄体距离的平均值、被摄体距离的中间值等,聚焦于摄影对象t1。

[0191]

此外,例如,通过重复地执行图8的聚焦控制处理,各个摄影装置11的聚焦可以跟随摄影对象t1的运动。

[0192]

此外,例如,在摄影装置11中的至少一个移动,从而各个摄影装置11之间的位置关系变化的情况下,通过重复执行图6中的位置检测处理和图8中的聚焦控制处理,各个摄影装置11的聚焦可以跟随各个摄影装置11和摄影对象t1的运动。

[0193]

《聚焦控制处理的第二实施例》

[0194]

接下来,将参考图15说明由信息处理装置12执行的聚焦控制处理的第二实施例。

[0195]

该第二实施例是聚焦于只存在于1个摄影装置11的视野内的被摄体的情况下的处理。

[0196]

以下,作为具体例子,将说明摄影装置11-1、摄影装置11-2和摄影对象t1之间的位置关系如图15中图解所示的情况。注意,图15没有例示摄影装置11-3。

[0197]

在本例中,摄影对象t1仅存在于摄影装置11-1的视野fov1内,并且存在于摄影装置11-2的视野fov2之外。

[0198]

注意,假设通过上面参考图6说明的位置检测处理,已知各个摄影装置11之间的位置关系。于是,基于各个摄影装置11之间的位置关系,可以计算各个摄影装置11之间的距离和定向。

[0199]

在这种情况下,由于摄影对象t1仅由摄影装置11-1拍摄,因此无法通过上面参考图10说明的方法检测摄影对象t1相对于摄影装置11-1的被摄体距离。

[0200]

另一方面,例如,摄影装置11-1可以通过诸如手动、反差自动聚焦(af)、相位差af和像平面相位差af之类的传统方法,聚焦于摄影对象t1。

[0201]

这里,如上所述,摄影装置11的聚焦与被摄体距离相关,并且当光学系统101的状态被固定时,基于被摄体距离唯一地确定聚焦调整位置。相反,当确定了聚焦调整位置时,摄影装置11处于焦点对准的距离也被确定。

[0202]

于是,如上所述,通过使摄影装置11-1聚焦于摄影对象t1,确定摄影装置11-1处于焦点对准的距离,并且可以获得摄影对象t1相对于摄影装置11-1的被摄体距离。然后,当获得摄影对象t1相对于摄影装置11-1的被摄体距离时,通过上面参考图12说明的方法,可以计算摄影对象t1相对于摄影装置11-2的被摄体距离。于是,摄影装置11-2可以虚拟地聚焦于摄影对象t1。

[0203]

注意,一般来说,摄影装置11-1处于焦点对准的距离具有一定的宽度(所谓的景深)。于是,即使确定了摄影装置11-1的聚焦调整位置,从摄影装置11-1到摄影对象t1的距离也不是唯一确定的,具有一定的宽度。于是,在基于摄影装置11-1的聚焦调整位置获得摄影对象t1相对于摄影装置11-1的被摄体距离的情况下,可能会出现轻微的误差。结果,在摄影对象t1相对于摄影装置11-2的被摄体距离方面也出现误差,从而存在摄影装置11-2没有正确地聚焦于摄影对象t1的可能性。

[0204]

然而,在这种情况下,由于摄影装置11-2的被摄体距离的误差非常小,因此即使摄影装置11-2没有正确地聚焦于摄影对象t1,差距也非常小。于是,与在摄影对象t1进入摄影装置11-2的视野fov2之后开始摄影装置11-2的聚焦调整的情况相比,当摄影对象t1进入摄影装置11-2的视野fov2时,摄影装置11-2可以在更短的时间内聚焦于摄影对象t1。

[0205]

《运动预测处理》

[0206]

例如,在各个摄影装置11的位置被固定的情况下,通过重复执行图8中的聚焦控制处理,能够实时地检测各个摄影装置11和摄影对象之间的位置关系的转变。此外,在至少一个摄影装置11移动的情况下,通过重复执行图6中的位置检测处理和图8中的聚焦控制处理,能够实时地检测各个摄影装置11和摄影对象之间的位置关系的转变。

[0207]

然后,信息处理装置12的运动预测部274可以基于各个摄影装置11和被摄体之间

的位置关系的转变,预测摄影对象相对于各个摄影装置11的运动。例如,运动预测部274可以基于摄影对象相对于摄影装置11-1的距离和方向的转变,预测摄影对象相对于摄影装置11-1的运动。

[0208]

例如,在摄影装置11通过上述方法聚焦的情况下,从检测到被摄体距离到摄影装置11聚焦于摄影对象,出现时间差δt。于是,例如,在摄影对象高速移动的情况下,在摄影装置11聚焦于摄影对象时被摄体距离变化,从而存在摄影对象未被正确聚焦的可能性。

[0209]

另一方面,时间差δt大致恒定,可以通过实际测量值或理论值计算预先获得。

[0210]

此外,通过预测摄影对象相对于摄影装置11的运动,运动预测部274可以预测时间差δt之后的摄影对象相对于摄影装置11的被摄体距离。然后,通过基于时间差δt之后的摄影对象相对于摄影装置11的被摄体距离的预测结果控制摄影装置11的聚焦,聚焦控制部275能够使摄影装置11更准确地聚焦于摄影对象。

[0211]

《被摄体接近通知处理》

[0212]

例如,运动预测部274可以基于摄影对象相对于摄影装置11的运动的预测结果,预测摄影对象进入摄影装置11的视野的方向、位置和定时。例如,在上面说明的图9的例子中,可以预测摄影对象t1进入摄影装置11-3的视野fov3的方向、位置和定时。例如,在上面说明的图15的例子中,可以预测摄影对象t1进入摄影装置11-2的视野fov2的方向、位置和定时。

[0213]

于是,例如,在摄影对象进入摄影装置11的视野(视角)之前,可以向摄影装置11的用户(例如,摄影者)通知存在于视野外的摄影对象的存在或运动。

[0214]

例如,运动预测部274经由通信单元209,将指示存在于摄影装置11的视野外的摄影对象的运动的预测结果的运动预测数据发送给摄影装置11。

[0215]

摄影装置11的显示控制部162经由通信单元110接收运动预测数据,并且基于运动预测数据,使显示单元105显示用于通知存在于视野外的摄影对象的存在和运动的摄影对象信息。

[0216]

图16和图17图解说明摄影对象信息的显示方法的例子。

[0217]

在图16的例子中,在由摄影装置11拍摄的图像301中添加并显示摄影对象信息。具体地,利用箭头指示预测摄影对象将来进入图像301(摄影装置11的视角)的方向。此外,还例示了预测作为摄影对象的人a进入的定时(2秒后)。

[0218]

在图17的例子中,在摄影装置11拍摄的图像301的外部添加并显示摄影对象信息。具体地,在图像301的外部显示指示作为摄影对象的人的动画311。例如,动画311表示摄影对象的移动方向和速度。

[0219]

如上所述,用户能够预先掌握摄影对象进入图像301(摄影装置11的视角)的方向和定时。结果,例如,能够更适当地拍摄摄影对象。

[0220]

注意,例如,和图14中图解所示的例子一样,可以向摄影装置11拍摄的图像添加并显示与存在于摄影装置11的盲区的摄影对象有关的摄影对象信息。

[0221]

《聚焦于摄影对象的定时》

[0222]

例如,和图9及15的例子一样,在摄影对象存在于摄影装置11的视野之外的情况下,可以设定聚焦于摄影对象的定时。

[0223]

例如,在图9的例子中,提供两种模式,作为使摄影装置11-3聚焦于摄影对象t1的模式。

[0224]

第一模式是使摄影装置11-3在检测到摄影对象t1相对于摄影装置11-3的被摄体距离之后s1秒后聚焦的模式。

[0225]

第二模式是使摄影装置11-3在预测摄影对象t1进入摄影装置11-3的视野fov3的定时之前s2秒聚焦的模式。注意,如上所述,运动预测部274可以预测摄影对象t1进入视野fov3的定时。

[0226]

例如,用户可以选择第一模式或第二模式,并且对设定时间s1或设定时间s2进行设定。然后,信息处理装置12的聚焦控制部275例如通过基于设定的模式和设定时间来控制向摄影装置11-3发送聚焦控制信号的定时,控制摄影装置11-3聚焦于摄影对象t1的定时。

[0227]

注意,例如,通过选择第一模式,并将设定时间s1设定为0秒,当检测到摄影对象t1相对于摄影装置11-3的被摄体距离时,摄影装置11-3可以立即聚焦于摄影对象t1。于是,摄影装置11-3始终聚焦于摄影对象t1,并且在摄影对象t1进入了视野fov3的瞬间,摄影装置11-3进入聚焦于摄影对象t1的状态。

[0228]

此外,例如,当选择第二模式,并将设定时间s2设定为0秒时,在摄影对象t1进入视野fov3的瞬间,摄影装置11-3可以立即聚焦于摄影对象t1。

[0229]

注意,在摄影装置11-3按照设定时间s1或设定时间s2聚焦于摄影对象t1之前的聚焦的位置是任意的。例如,特定的被摄体可能失焦,或者可能聚焦于除摄影对象以外的被摄体。

[0230]

《《2.变形例》》

[0231]

以下,将说明上面所述的本技术的实施例的变形例。

[0232]

《关于各个摄影装置11的位置关系的检测方法的变形例》

[0233]

各个摄影装置11之间的位置关系的检测方法不限于上述例子,可以使用任意方法。

[0234]

例如,各个摄影装置11可以检测当前位置和姿势,并且信息处理装置12可以基于各个摄影装置11的当前位置和姿势的检测结果,检测各个摄影装置11的位置关系。

[0235]

此外,例如,在各个摄影装置11的位置被固定,从而各个摄影装置11的位置关系不变化的情况下,可以事先测量各个摄影装置11的位置关系,并将测量结果提供给信息处理装置12。

[0236]

《关于聚焦控制处理的变形例》

[0237]

尽管上面说明了其中对于各个摄影装置11设定共同对象点的例子,不过对于各个摄影装置11可以设定不同的对象点。于是,各个摄影装置11可以聚焦于不同的对象点。

[0238]

在这种情况下,也可以对于各个摄影装置11设定不同的摄影对象。例如,对于摄影装置11-1,可以将摄影对象a的特征点设定为对象点,而对于摄影装置11-2,可以将摄影对象b的特征点设定为对象点。于是,各个摄影装置11可以聚焦于不同的摄影对象。

[0239]

注意,在按照上述第一实施例,各个摄影装置11聚焦于对象点的情况下,需要根据在至少2个摄影装置11拍摄的图像内检测到的特征点来设定各个对象点。

[0240]

此外,摄影对象不一定是人。例如,可以将诸如狗或猫之类的动物,或者诸如汽车、自行车之类的物体设定为摄影对象。

[0241]

《关于信息处理系统1的构成例子的变形例》

[0242]

例如,信息处理装置12的一些或全部功能可设置在摄影装置11中。

[0243]

例如,可以将摄影装置11中的一个设定为主装置,将其余的摄影装置11设定为从装置,并且主摄影装置11可以具备信息处理装置12的全部功能,从而可以省略信息处理装置12。在这种情况下,例如,图像数据从从摄影装置11发送到主摄影装置11,并且主摄影装置11检测各个摄影装置11和摄影对象之间的位置关系。此外,主摄影装置11控制从摄影装置11的聚焦。

[0244]

此外,例如,各个摄影装置11可以检测图像中的特征点,并将指示特征点的检测结果的数据发送给信息处理装置12。

[0245]

此外,例如,信息处理装置12可以应用于云计算等中的服务器,并且服务器可以提供控制各个摄影装置11的聚焦的服务。

[0246]

《《3.其他》》

[0247]

《计算机的构成例子》

[0248]

上述一系列处理可以用硬件执行或者可以用软件执行。在用软件执行所述一系列处理的情况下,构成所述软件的程序安装在计算机中。这里,计算机包括并入专用硬件中的计算机,以及例如通过安装各种程序而能够执行各种功能的通用个人计算机。

[0249]

注意,计算机执行的程序可以是按照本说明中描述的顺序,时序地进行处理的程序,或者可以是并行地或者在必要的定时(比如在进行调用时)进行处理的程序。

[0250]

此外,在本说明书中,系统意味一组多个构成元件(装置、模块(组件)等),并且所有构成元件是否位于同一外壳内并不重要。于是,容纳在单独的外壳内并经由网络连接的多个装置,以及其中多个模块容纳在一个外壳中的一个装置,都是系统。

[0251]

此外,本技术的实施例不限于上述实施例,可以作出各种修改,而不脱离本技术的要旨。

[0252]

例如,本技术可以具有其中一个功能经由网络由多个装置分担并协同地处理的云计算的构成。

[0253]

此外,在上述流程图中说明的各个步骤可以由一个装置执行,或者可以由多个装置分担地执行。

[0254]

此外,在一个步骤包含多个处理的情况下,包含在一个步骤中的多个处理可以由一个装置执行,或者可以由多个装置分担地执行。

[0255]

《构成组合例子》

[0256]

本技术还可以具有以下构成。

[0257]

(1)一种信息处理装置,包括:

[0258]

位置检测部,所述位置检测部基于第一摄影装置、第二摄影装置和作为待聚焦的对象的摄影对象之间的位置关系,检测第一摄影装置与摄影对象之间的距离;和

[0259]

聚焦控制部,所述聚焦控制部基于第一摄影装置与摄影对象之间的距离,控制第一摄影装置的聚焦。

[0260]

(2)按照(1)所述的信息处理装置,其中

[0261]

所述位置检测部基于第一摄影装置和第二摄影装置的位置关系,以及第二摄影装置和摄影对象的位置关系,检测第一摄影装置与摄影对象之间的距离。

[0262]

(3)按照(2)所述的信息处理装置,其中

[0263]

所述位置检测部基于第一摄影装置与第二摄影装置之间的距离,第二摄影装置与

摄影对象之间的距离,以及相对于第二摄影装置的第一摄影装置的方向和摄影对象的方向之间的角度,检测第一摄影装置与摄影对象之间的距离。

[0264]

(4)按照(3)所述的信息处理装置,其中

[0265]

所述位置检测部基于第二摄影装置与第三摄影装置之间的距离,相对于第二摄影装置的第三摄影装置的方向和摄影对象的方向之间的角度,以及相对于第三摄影装置的第二摄影装置的方向和摄影对象的方向之间的角度,检测第二摄影装置与摄影对象之间的距离。

[0266]

(5)按照(4)所述的信息处理装置,其中

[0267]

所述位置检测部基于第二摄影装置拍摄的摄影对象的图像,检测相对于第二摄影装置的第三摄影装置的方向和摄影对象的方向之间的角度,并基于第三摄影装置拍摄的摄影对象的图像,检测相对于第三摄影装置的第二摄影装置的方向和摄影对象的方向之间的角度。

[0268]

(6)按照(2)~(5)任意之一所述的信息处理装置,其中

[0269]

所述位置检测部基于第一摄影装置和第二摄影装置的位置关系,以及第二摄影装置和摄影对象的位置关系,检测存在于第一摄影装置的视野外或盲区中的摄影对象与第一摄影装置之间的距离。

[0270]

(7)按照(6)所述的信息处理装置,其中

[0271]

所述聚焦控制部控制第一摄影装置聚焦于摄影对象的定时。

[0272]

(8)按照(7)所述的信息处理装置,其中

[0273]

所述聚焦控制部控制第一摄影装置的聚焦,使得在检测到第一摄影装置与摄影对象之间的距离之后的预定时间,或在预测摄影对象将进入第一摄影装置的视角的定时之前的预定时间,第一摄影装置聚焦于摄影对象。

[0274]

(9)按照(6)~(8)任意之一所述的信息处理装置,还包括:

[0275]

显示控制部,所述显示控制部进行控制,以通过将与存在于第一摄影装置的视野外或盲区中的摄影对象有关的摄影对象信息添加到第一摄影装置拍摄的图像,来显示所述摄影对象信息。

[0276]

(10)按照(9)所述的信息处理装置,其中

[0277]

所述摄影对象信息包含摄影对象相对于第一摄影装置的运动的预测结果。

[0278]

(11)按照(2)所述的信息处理装置,其中

[0279]

所述位置检测部基于第二摄影装置和第三摄影装置的位置关系,第二摄影装置拍摄的摄影对象的图像,以及第三摄影装置拍摄的摄影对象的图像,检测第二摄影装置和摄影对象的位置关系。

[0280]

(12)按照(11)所述的信息处理装置,其中

[0281]

所述位置检测部基于第一摄影装置拍摄的图像,第二摄影装置拍摄的图像,以及第三摄影装置拍摄的图像,检测第一摄影装置、第二摄影装置和第三摄影装置之间的位置关系。

[0282]

(13)按照(1)~(12)任意之一所述的信息处理装置,其中

[0283]

所述位置检测部基于第一摄影装置和第二摄影装置的位置关系,以及第二摄影装置和摄影对象的位置关系,检测第一摄影装置和摄影对象的位置关系,

[0284]

所述信息处理装置还包括:

[0285]

运动预测部,所述运动预测部基于第一摄影装置和摄影对象的位置关系的转变,预测摄影对象相对于第一摄影装置的运动。

[0286]

(14)按照(13)所述的信息处理装置,其中

[0287]

所述运动预测部预测预定时间后的第一摄影装置与摄影对象之间的距离,和

[0288]

所述聚焦控制部基于预测的第一摄影装置与摄影对象之间的距离,控制第一摄影装置的聚焦。

[0289]

(15)按照(1)~(14)任意之一所述的信息处理装置,其中

[0290]

所述位置检测部基于第一摄影装置与第二摄影装置之间的距离,相对于第一摄影装置的第二摄影装置的方向和摄影对象的方向之间的角度,以及相对于第二摄影装置的第一摄影装置的方向和摄影对象的方向之间的角度,检测第一摄影装置与摄影对象之间的距离。

[0291]

(16)按照(1)~(15)任意之一所述的信息处理装置,其中

[0292]

所述位置检测部基于第一摄影装置拍摄的图像和第二摄影装置拍摄的图像,检测第一摄影装置和第二摄影装置的位置关系。

[0293]

(17)按照(1)~(16)任意之一所述的信息处理装置,其中

[0294]

所述位置检测部基于第一摄影装置、第二摄影装置和摄影对象的待聚焦的对象部分之间的位置关系,检测第一摄影装置与摄影对象的所述对象部分之间的距离,和

[0295]

所述聚焦控制部基于第一摄影装置与摄影对象的所述对象部分之间的距离,控制第一摄影装置的聚焦,以聚焦于摄影对象的所述对象部分。

[0296]

(18)按照(1)~(17)任意之一所述的信息处理装置,其中

[0297]

所述信息处理装置包含在第一摄影装置中。

[0298]

(19)一种信息处理方法,包括:

[0299]

基于第一摄影装置、第二摄影装置和摄影对象之间的位置关系,检测第一摄影装置与摄影对象之间的距离;和

[0300]

基于第一摄影装置与摄影对象之间的距离,控制第一摄影装置的聚焦。

[0301]

(20)一种程序,所述程序用于使计算机执行以下处理:

[0302]

基于第一摄影装置、第二摄影装置和摄影对象之间的位置关系,检测第一摄影装置与摄影对象之间的距离,和

[0303]

基于第一摄影装置与摄影对象之间的距离,控制第一摄影装置的聚焦。

[0304]

注意,记载在本说明书中的效果仅仅是例子,并不受限制,可以存在其他效果。

[0305]

附图标记列表

[0306]

1信息处理系统

[0307]

11-1~11-3摄影装置

[0308]

12信息处理装置

[0309]

101光学系统

[0310]

104cpu

[0311]

105显示单元

[0312]

151信息处理部

[0313]

161 聚焦控制部

[0314]

162 显示控制部

[0315]

201 cpu

[0316]

251 信息处理部

[0317]

261 摄影装置控制部

[0318]

262 输出控制部

[0319]

271 特征点检测部

[0320]

272 对象点设定部

[0321]

273 位置检测部

[0322]

274 运动预测部

[0323]

275 聚焦控制部

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。