1.本发明涉及表情识别技术领域,更具体的说是涉及一种基于正负样本对比学习的表情识别方法。

背景技术:

2.人脸表情识别技术是指通过计算机识别图像中人的情绪,具有重要的实际应用价值,包括智慧医疗、安全驾驶检测、在线教育、心理辅导和娱乐交互等方面。但是在实际场景下的表情识别精度来看,目前人脸表情识别的精度还没有达到人类能到达的水平。

3.自然场景下的表情识别比受控实验场景的表情识别任务更具有挑战性,因为在自然条件下的采集图像包含了更多的环境因素差异,比如光照,分辨率和更大幅度的姿态变化。其次,因采集条件不统一,自然场景下的表情识别任务表现出更大的类间相似类内差异大的问题,例如同样是“惊讶”的表情,因为拍摄角度、光照条件和人物表达方式的不同,外在样貌表现出很大的差异性。同样,来自不同类别的图像有着相似的外貌,表现出大的类间相似性。另一个例子如“开心”这个类别,由于采集条件不一,对于微笑和大笑都是同一类别,但是它们的图像外貌差异大,而对于“伤心”和“恐惧”这两个类别的图像,外貌差异却相差小。最后,自然场景采集的表情数据集通常需要标注人员进行人工打标签,这一行为需要耗费大量的人力,更为重要的是,由于人的主观性影响,对于同一张图像,不同的人可能做出不同的判断,从而导致表情的标签具有表较大的含糊性。

4.在自然场景下的人脸表情识别任务的关键是要提取出具有表情表示意义的特征,许多针对局部特征进行学习优化的方法和基于度量学习的方法都取得了不错的效果。尽管先前已经提出了许多方法来解决类间相似度大类内方差大和标签含糊的问题,但它们都是以传统的有监督的方式进行训练。而在自然场景下,表情识别任务存在标签含糊的问题不可忽视,单纯的利用原来的标签可能会引进错误的信息,含糊的标签反而可能误导网络模型对表情特征的学习,使得有监督学习无法完全挖掘出细微的表情判别特征。

5.因此,如何提出一种能够有效提高表情识别准确率的基于正负样本对比学习的表情识别方法是本领域技术人员亟需解决的问题。

技术实现要素:

6.有鉴于此,本发明提供了一种基于正负样本对比学习的表情识别方法,目的在于提供一种更加准确的表情识别方法。

7.为了实现上述目的,本发明采用如下技术方案:

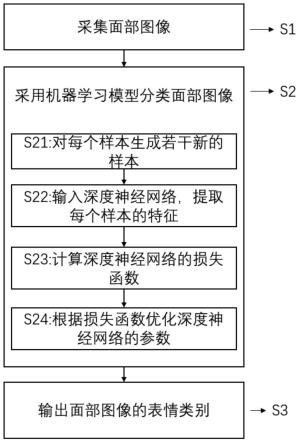

8.一种基于正负样本对比学习的表情识别方法,包括以下步骤:

9.s1.采集面部图像;

10.s2.将所述面部图像输入至训练好的机器学习模型中对面部图像中的表情进行识别;

11.s3.输出面部图像的表情类别;

12.s2中所述机器学习模型的训练方法具体为:

13.s21.对每个样本生成若干新的样本;

14.对一个批量的样本进行强数据增强后获得进行弱数据增强后获得其中,xi为人脸图像,yi为xi对应的表情标签;获取当前弱增强样本x``i及其强增强样本x`i视为正样本对;将与当前样本x``i不同类别的其他所有样本的增强样本作为负样本对,第i个样本的负样本对集合表示为

15.s22.输入深度神经网络,提取每个样本的特征;

16.对弱增强样本x``i和强增强样本x`i进行特征提取后分别获得特征表示:u= {ui|i=1,2,

……

hw},v={vj|j=1,2,

……

hw},其中ui,vj分别作为供给点和目的地点的特征向量表示;

17.s23.计算深度神经网络的损失函数;

18.定义第i个样本的负样本相似度集合为其集合大小为ki;

19.总损失函数为:

20.l=l

cls

βl

hard

21.其中β为超参数表示平衡系数;l

cls

为softmax分类损失函数,l

hard

为负样本自适应加权函数:

[0022][0023]

其中,n为批量内样本数目;为结构相似度转换概率,γ为缩放系数, s

i,j

代表第i个样本和第j个增强样本之间的结构相似度;所有样本的概率和为 1;

[0024]

s24.根据损失函数优化深度神经网络的参数。

[0025]

优选的,s23中,第i个特征表示和第j个增强后的特征之间的结构相似度s

i,j

的具体计算方法为:

[0026]si,j

=-s(ui,vj)

[0027][0028]

其中,h和w分别为卷积特征图u和v的高和宽,c

ij

表示源供给侧节点i 到目的地节点j之间的传输代价,ui表示第i个样本的卷积特征图,vj表示第j个样本的卷积特征图,表示最佳运输方案,其最佳运输方案通过计算下式求得最佳解方法为:

[0029][0030]

subject to f

ij

≥0,i=1,

…

,m,j=1,

…

,k

[0031][0032][0033]

其中,表示源节点和目的节点的局部权重,其计算方式通过下式求解:

[0034][0035][0036][0037][0038][0039][0040]

其中g

avg

表示全局平均池化操作。

[0041]

优选的,c

ij

的计算方式为:

[0042][0043]

其中ui,vj为供给点和目的地点的特征向量表示。

[0044]

优选的,s23中,第i个样本和第k个增强样本之间的结构相似度的相对大小p

i,k

的具体计算方法为:

[0045][0046]

当p

i,k

值越大,则给对应部分样本更大的学习权重。

[0047]

经由上述的技术方案可知,与现有技术相比,本发明公开提供了一种基于正负样本对比学习的表情识别方法,具有以下有益效果:

[0048]

1.本发明将emd距离作用在特征图上,能引导模型关注与表情相关的区域,而排除嘈杂背景等与表情表达无关的区域,从而有效关注表情区域。

[0049]

2.本发明采用自监督的思想设计了结构相似度约束损失,利用增强图像正负样本的对比学习,使其在不依赖原始标签的情况下,与分类损失一起优化,学习到更具泛化性的表情特征。

附图说明

[0050]

为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据提供的附图获得其他的附图。

[0051]

图1为本发明提供的一种基于正负样本对比学习的表情识别方法的流程示意图;

[0052]

图2为本发明提供的一种基于正负样本对比学习的表情识别方法中机器学习模型的训练方法示意图;

[0053]

图3为本发明提供的一种基于正负样本对比学习的表情识别方法中对负样本自适应加权示意图。

具体实施方式

[0054]

下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

[0055]

本发明实施例公开了一种基于正负样本对比学习的表情识别方法,包括以下步骤:

[0056]

s1.采集面部图像;

[0057]

s2.将面部图像输入至训练好的机器学习模型中对面部图像中的表情进行识别;

[0058]

s3.输出面部图像的表情类别;

[0059]

s2中机器学习模型的训练方法具体为:

[0060]

s21.对每个样本生成若干新的样本;

[0061]

对一个批量的样本进行强数据增强后获得进行弱数据增强后获得其中,xi为人脸图像,yi为xi对应的表情标签;获取当前弱增强样本x``i及其强增强样本x`i视为正样本对;将与当前样本x``i不同类别的其他所有样本的增强样本作为负样本对,第i个样本的负样本对集合表示为

[0062]

其中,通过弱增强和强增强,获得两个不同的视角的图像。弱增强指图像经过较小程度的放缩和翻转,强增强指数据增强方式还包含旋转和色彩变换。

[0063]

s22.输入深度神经网络,提取每个样本的特征;

[0064]

对弱增强样本x``i和强增强样本x`i进行特征提取后分别获得特征表示:u= {ui|i=1,2,

……

hw},v={vj|j=1,2,

……

hw},其中ui,vj分别作为供给点和目的地点的特征向量表示;

[0065]

s23.计算深度神经网络的损失函数;

[0066]

定义第i个样本的负样本相似度集合为其集合大小为ki;

[0067]

总损失函数为:

[0068]

l=l

cls

βl

hard

[0069]

其中β为超参数表示平衡系数;l

cls

为softmax分类损失函数,l

hard

为负样本自适应加权函数:

[0070][0071]

其中,n为批量内样本数目;为结构相似度转换概率,γ为缩放系数,γ影响了样本分类概率之间的均衡程度。γ值越大,分类概率差异越大,γ越小,样本之间的分类概率越相近。当γ值区于零时,概率分布退化成均匀分布;s

i,j

代表第i个样本和第j个增强样本之间的结构相似度;所有样本的概率和为1;其中s

i,j

代表第i个样本和第j个增强样本之间的结构相似度。

[0072]

s24.根据损失函数优化深度神经网络的参数。

[0073]

为了进一步实施上述技术方案,s23中,第i个特征表示和第j个增强后的特征之间的结构相似度s

i,j

的具体计算方法为:

[0074]si,j

=-s(ui,vj)

[0075][0076]

其中,h和w分别为卷积特征图u和v的高和宽,c

ij

表示源供给侧节点i 到目的地节点j之间的传输代价,ui表示第i个样本的卷积特征图,vj表示第 j个样本的卷积特征图,表示最佳运输方案,其最佳运输方案通过计算下式求得最佳解方法为:

[0077][0078]

subject to f

ij

≥0,i=1,

…

,m,j=1,

…

,k

[0079][0080][0081]

其中,表示源节点和目的节点的局部权重,其计算方式通过下式求解:

[0082][0083][0084]

[0085][0086][0087][0088]

其中g

avg

表示全局平均池化操作。

[0089]

为了进一步实施上述技术方案,c

ij

的计算方式为:

[0090][0091]

其中ui,vj为供给点和目的地点的特征向量表示。

[0092]

为了进一步实施上述技术方案,s23中,第i个样本和第k个增强样本之间的结构相似度的相对大小p

i,k

的具体计算方法为:

[0093][0094]

当p

i,k

值越大,则给对应部分样本更大的学习权重。

[0095]

p

i,k

表示了第i个样本和第k个增强样本之间的结构相似度的相对大小,反映了两个视角特征的相似程度。p

i,k

值越大,说明该样本对越相似,该增强样本越难以区分,模型应当给这部分样本更大的学习权重。

[0096]

需要说明的是:

[0097]

对于样本xi,正样本的定义为增强样本x`i。负样本应当维持较大的结构相似度差异,而一个批量内可能存在着原本标签为同一类的这些样本,这部分样本可能有着较高的结构相似度,将同一类的增强样本视为负样本会引入更多的错误信息。出于正确性考虑,本发明将负样本视为其他类别的增强样本,集合定义为即与当前样本不同类别的其他所有样本的增强样本。这在一定程度上保证了负样本的正确性。

[0098]

损失函数按如下计算,考虑了负样本的对比学习,并对困难负样本增加自适应权重。

[0099]

样本的难易度量问题。将每个样本视为一个单独的类别,每个负样本依据结构相似度得分经过softamx函数转化为类别概率。

[0100]

本实施例中,β是平衡系数,作为超参数,需要调节,本实施例β取值 0.6。

[0101]

本实施例的深度神经网络模型在搭载pytorch(v1.7)深度学习框架的 nvid ia t itan 3090gpu服务器上运行。本实施例以resnet-18为基础的骨干网络,所有图像放缩至256

×

256大小。在训练阶段,输入图像经过随机位置裁切为224

×

224大小,在测试阶段则是中心位置裁切224

×

224大小进行测试。在数据增强阶段有弱增强和强增强:在弱增强时,以0.5的概率翻转图像;强增强时,除包含弱增强之外,还以0.2的概率进行颜色随机抖动。

[0102]

由于考虑到结构相似度计算过程中的显存消耗过大,尤其是在批量内计算两两之间结构相似度的步骤,显存占用比例大,所以批量大小设置为32。模型使用带动量的随机梯度下降方法进行优化,学习率为0.01,动量为0.9,权重衰减速率为0.0001。emd距离计算模块需要计算出对应的最佳运输方案,其由opencv库函数计算得出。

[0103]

本说明书中各个实施例采用递进的方式描述,每个实施例重点说明的都是与其他实施例的不同之处,各个实施例之间相同相似部分互相参见即可。对于实施例公开的装置而言,由于其与实施例公开的方法相对应,所以描述的比较简单,相关之处参见方法部分说明即可。

[0104]

对所公开的实施例的上述说明,使本领域专业技术人员能够实现或使用本发明。对这些实施例的多种修改对本领域的专业技术人员来说将是显而易见的,本文中所定义的一般原理可以在不脱离本发明的精神或范围的情况下,在其它实施例中实现。因此,本发明将不会被限制于本文所示的这些实施例,而是要符合与本文所公开的原理和新颖特点相一致的最宽的范围。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。