1.本公开涉及计算机技术领域,尤其涉及一种模型训练方法、数据处理方法、装置及电子设备。

背景技术:

2.随着机器学习模型的广泛应用,在使用单一模型时通常存在模型瓶颈。具体的,建立一个单一模型后,该单一模型可能在解决某个问题的能力上比较出色,而解决其他问题时,结果却不尽人意。

3.因此,现有技术提出了多模型融合技术,即将多个预先训练好的模型进行融合,得到融合模型。融合模型由于综合了各个模型的优点,因此可以突破单一模型的模型瓶颈。然而,在实际应用中,由于各个模型之间相对割裂、关联性低,最终导致融合模型对多媒体资源的处理性能不够优异,进而无法得到准确的多媒体资源的标签。

技术实现要素:

4.本公开提供一种模型训练方法、数据处理方法、装置及电子设备,以加强各模型之间的关联、提升模型整体对多媒体资源的处理性能。本公开的技术方案如下:

5.根据本公开实施例的第一方面,提供一种模型训练方法,包括:获取多个资源样本以及多个资源样本对应的资源标签;将多个资源样本作为首批资源样本输入至待训练的标签生成模型,待训练的标签生成模型包括串行连接的n个子模型,n为大于1的正整数;对于首个子模型,根据首批资源样本以及首批资源样本对应的资源标签,确定首个子模型的评价参数;对于第m个子模型,从第m-1批资源样本中,确定第m个子模型对应的第m批资源样本;第m-1批资源样本包括第m-1个子模型的输入样本,第m批资源样本中的资源样本不满足第m-1个子模型的置信度指标,m为大于1小于或等于n的任意正整数;根据第m批资源样本以及第m批资源样本对应的资源标签,确定第m个子模型的评价参数;根据各子模型的评价参数,对待训练的标签生成模型进行训练,得到标签生成模型。

6.可选的,从第m-1批资源样本中,确定第m个子模型对应的第m批资源样本,包括:通过第m-1个子模型对第m-1批资源样本进行处理,获取第m-1批资源样本中各资源样本的置信度;将置信度小于或者等于第m-1个子模型的置信度指标的资源样本确定为第m批资源样本。

7.可选的,根据第m批资源样本以及第m批资源样本对应的资源标签,确定第m个子模型的评价参数,包括:在存在第m批资源样本的情况下,将第m批资源样本中各资源样本分别输入第m个子模型,得到第m批资源样本中各资源样本的置信度;根据第m批资源样本中各资源样本的置信度、第m批资源样本中各资源样本对应的资源标签以及预设的模型评价函数,确定第m个子模型的评价参数;在不存在第m批资源样本的情况下,将第m个子模型的评价参数确定为预设参数。

8.可选的,待训练的标签生成模型中各子模型按照复杂度从低到高的顺序串行连

接。

9.可选的,根据首批资源样本以及首批资源样本对应的资源标签,确定首个子模型的评价参数,包括:将首批资源样本中各资源样本分别输入首个子模型,得到首批资源样本中各资源样本的置信度;根据首批资源样本中各资源样本的置信度、首批资源样本中各资源样本对应的资源标签以及预设的模型评价函数,确定首个子模型的评价参数。

10.可选的,根据各子模型的评价参数,对待训练的标签生成模型进行训练,得到标签生成模型,包括:将各子模型的评价参数之和作为待训练的标签生成模型的评价参数,对待训练的标签生成模型进行训练,得到标签生成模型。

11.根据本公开实施例的第二方面,提供一种多媒体资源的数据处理方法,方法包括:获取待处理多媒体资源;将待处理多媒体资源输入至标签生成模型,标签生成模型为上述第一方面的模型训练方法训练得到的模型;通过标签生成模型对待处理多媒体资源进行处理,得到多媒体资源的标签。

12.可选的,标签生成模型包括串行连接的多个子模型;通过标签生成模型对待处理多媒体资源进行处理,得到多媒体资源的标签,包括:按照多个子模型的串行连接顺序,将待处理多媒体资源依次输入多个子模型,直至多个子模型中的目标子模型输出多媒体资源的标签;目标子模型为对待处理多媒体资源进行处理得到的标签置信度大于预设的置信度指标的模型,或者,目标子模型为最后一个子模型。

13.根据本公开实施例的第三方面,提供一种模型训练装置,包括获取单元、处理单元以及训练单元;获取单元,用于获取多个资源样本以及多个资源样本对应的资源标签;处理单元,用于将多个资源样本作为首批资源样本输入至待训练的标签生成模型,待训练的标签生成模型包括串行连接的n个子模型,n为大于1的正整数;对于首个子模型,处理单元,用于根据首批资源样本以及首批资源样本对应的资源标签,确定首个子模型的评价参数;对于第m个子模型,处理单元,用于从第m-1批资源样本中,确定第m个子模型对应的第m批资源样本;第m-1批资源样本包括第m-1个子模型的输入样本,第m批资源样本中的资源样本不满足第m-1个子模型的置信度指标,m为大于1小于或等于n的任意正整数;处理单元,还用于根据第m批资源样本以及第m批资源样本对应的资源标签,确定第m个子模型的评价参数;训练单元,用于根据各子模型的评价参数,对待训练的标签生成模型进行训练,得到标签生成模型。

14.可选的,处理单元,具体用于:通过第m-1个子模型对第m-1批资源样本进行处理,获取第m-1批资源样本中各资源样本的置信度;将置信度小于或者等于第m-1个子模型的置信度指标的资源样本确定为第m批资源样本。

15.可选的,处理单元,具体用于:在存在第m批资源样本的情况下,将第m批资源样本中各资源样本分别输入第m个子模型,得到第m批资源样本中各资源样本的置信度;根据第m批资源样本中各资源样本的置信度、第m批资源样本中各资源样本对应的资源标签以及预设的模型评价函数,确定第m个子模型的评价参数;在不存在第m批资源样本的情况下,将第m个子模型的评价参数确定为预设参数。

16.可选的,待训练的标签生成模型中各子模型按照复杂度从低到高的顺序串行连接。

17.可选的,处理单元,具体用于:将首批资源样本中各资源样本分别输入首个子模

型,得到首批资源样本中各资源样本的置信度;根据首批资源样本中各资源样本的置信度、首批资源样本中各资源样本对应的资源标签以及预设的模型评价函数,确定首个子模型的评价参数。

18.可选的,训练单元具体用于:将各子模型的评价参数之和作为待训练的标签生成模型的评价参数,对待训练的标签生成模型进行训练,得到标签生成模型。

19.根据本公开实施例的第四方面,提供一种电子设备,包括获取单元以及处理单元;获取单元,用于获取待处理多媒体资源;处理单元,用于将待处理多媒体资源输入至标签生成模型,标签生成模型为基于权利要求9-14中任意一项的模型训练装置训练得到的;处理单元,还用于通过标签生成模型对待处理多媒体资源进行处理,得到多媒体资源的标签。

20.可选的,处理单元具体用于:按照多个子模型的串行连接顺序,将待处理多媒体资源依次输入多个子模型,直至多个子模型中的目标子模型输出多媒体资源的标签;目标子模型为对待处理多媒体资源进行处理得到的标签置信度大于预设的置信度指标的模型,或者,目标子模型为最后一个子模型。

21.根据本公开实施例的第五方面,提供一种电子设备,包括:处理器、用于存储处理器可执行的指令的存储器;其中,处理器被配置为执行指令,以实现上述第一方面的模型训练方法或者上述第二方面的多媒体资源的数据处理方法。

22.根据本公开实施例的第六方面,提供一种计算机可读存储介质,计算机可读存储介质上存储有指令,当计算机可读存储介质中的指令由电子设备的处理器执行时,使得电子设备能够执行上述第一方面的模型训练方法或者上述第二方面的多媒体资源的数据处理方法。

23.根据本公开实施例的第七方面,提供一种计算机程序产品,计算机程序产品包括计算机指令,当计算机指令被处理器执行时,实现上述第一方面的模型训练方法或者上述第二方面的多媒体资源的数据处理方法。

24.本公开提供的技术方案至少带来以下有益效果:本公开中模型训练装置首先获取多个资源样本以及多个资源样本对应的资源标签,并将多个资源样本作为首批资源样本输入至待训练的标签生成模型。由于待训练的标签生成模型包括串行连接的n个子模型,n为大于1的正整数,对于首个子模型,模型训练装置根据首批资源样本以及首批资源样本对应的资源标签,确定首个子模型的评价参数;对于第m个子模型,模型训练装置从第m-1批资源样本中,确定第m个子模型对应的第m批资源样本,进一步根据第m批资源样本以及第m批资源样本对应的资源样本标签,确定第m个子模型的评价参数。其中,第m-1批资源样本包括第m-1个子模型的输入样本,第m批资源样本中的资源样本不满足第m-1个子模型的置信度指标,m为大于1小于或等于n的任意正整数。这样一来,模型训练装置得到了待训练的标签生成模型中每个子模型的评价参数。本公开根据上述特征得到各子模型的评价参数之后,相较于相关技术中对各子模型按照各自对应的评价参数单独训练,本公开基于各子模型的评价参数,对待训练的标签生成模型整体进行训练,即对待训练的标签生成模型中各子模型同时进行训练,这样使得在训练过程中各子模型之间的关联性得到提高,进而使得训练得到的标签生成模型对多媒体资源的处理性能得到提升,进而可以得到准确的多媒体资源的标签。

25.应当理解的是,以上的一般描述和后文的细节描述仅是示例性和解释性的,并不

能限制本公开。

附图说明

26.此处的附图被并入说明书中并构成本说明书的一部分,示出了符合本公开的实施例,并与说明书一起用于解释本公开的原理,并不构成对本公开的不当限定。

27.图1是根据一示例性实施例示出的一种数据处理系统的结构示意图;

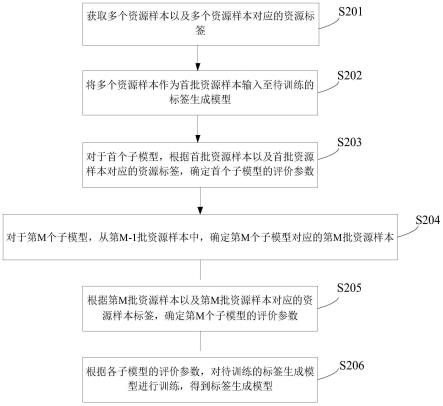

28.图2是根据一示例性实施例示出的一种模型训练方法的流程示意图之一;

29.图3是根据一示例性实施例示出的一种待训练模型的结构示意图之一;

30.图4是根据一示例性实施例示出的一种模型训练方法的流程示意图之二;

31.图5是根据一示例性实施例示出的一种模型训练方法的流程示意图之三;

32.图6是根据一示例性实施例示出的一种模型训练方法的流程示意图之四;

33.图7是根据一示例性实施例示出的一种待训练模型的结构示意图之二;

34.图8是根据一示例性实施例示出的一种模型训练方法的流程示意图之五;

35.图9是根据一示例性实施例示出的一种模型训练方法的流程示意图之六;

36.图10是根据一示例性实施例示出的一种标签生成模型的结构示意图;

37.图11是根据一示例性实施例示出的一种模型训练装置的结构示意图;

38.图12是根据一示例性实施例示出的一种电子设备的结构示意图之一;

39.图13是根据一示例性实施例示出的一种电子设备的结构示意图之二。

具体实施方式

40.为了使本领域普通人员更好地理解本公开的技术方案,下面将结合附图,对本公开实施例中的技术方案进行清楚、完整地描述。

41.需要说明的是,本公开的说明书和权利要求书及上述附图中的术语“第一”、“第二”等是用于区别类似的对象,而不必用于描述特定的顺序或先后次序。应该理解这样使用的数据在适当情况下可以互换,以便这里描述的本公开的实施例能够以除了在这里图示或描述的那些以外的顺序实施。以下示例性实施例中所描述的实施方式并不代表与本公开相一致的所有实施方式。相反,它们仅是与如所附权利要求书中所详述的、本公开的一些方面相一致的装置和方法的例子。

42.另外,在本公开实施例的描述中,除非另有说明,“/”表示或的意思,例如,a/b可以表示a或b。本文中的“和/或”仅仅是一种描述关联对象的关联关系,表示可以存在三种关系,例如,a和/或b,可以表示:单独存在a,同时存在a和b,单独存在b这三种情况。另外,在本公开实施例的描述中,“多个”是指两个或多于两个。

43.需要说明的,本公开所涉及的用户信息(包括但不限于用户设备信息、用户个人信息、用户行为信息等)和数据(包括但不限于程序代码等),均为经用户授权或者经过各方充分授权的信息和数据。

44.在对本公开实施例进行详细地解释说明之前,先对本公开实施例涉及到的一些相关技术进行介绍。

45.多模型融合技术,本质上为集成学习,就是用多重或者多个弱分类器结合为一个强分类器,从而达到提升分类效果的目的。集成学习并不算是一种分类器,本质上是一种分

类器结合的方法,集成学习时通常采用引导聚集算法(bootstrap aggregating,bagging)以及提升方法(boosting)。

46.引导聚集算法(bootstrap aggregating,bagging),又称装袋算法,是机器学习领域的一种团体学习算法。bagging是通过结合几个模型降低泛化误差的技术。其核心思想是分别训练几个不同的模型,然后让所有模型表决测试样例的输出。

47.提升方法(boosting),是一种可以用来减小监督式学习中偏差的机器学习算法。与bagging不同的是,基于boosting的多模型融合需要先用一个模型作为前置条件,过滤掉简单样本,然后将剩余的不确定的样本再经过另外一个模型进行针对性识别。bagging可以看做是多模型并联融合,而boosting可以看作是多模型串联融合。

48.然而在实际应用中,无论bagging还是boosting都是将多个预先训练好的模型进行融合,得到融合模型。由于各模型在融合之前都是单独训练的,即各模型的训练过程是割裂的,这样导致boosting将各模型串联后,各模型之间的关联性较低,最终影响融合模型对多媒体资源的处理性能不够优异,进而无法得到准确的多媒体资源的标签。

49.本公开实施例提供的模型训练方法,利用多个模型的训练样本差异化以及多个模型网络结构的差异化,对多个模型进行联合训练,使得一次联合训练就可以产生用于多个阶段的多个模型,且加强了各模型之间的关联性,进而还提升了整体模型对多媒体资源的处理效果。

50.在本公开实施例中多媒体资源(以下简称资源)包括但不限于视频、音频、图片、文字等。

51.本公开实施例提供的模型训练方法可以适用于多媒体资源的数据处理系统(以下简称数据处理系统),该数据处理系统用于加强各模型之间的关联、提升模型整体对多媒体资源的处理效果。图1示出了该数据处理系统的一种结构示意图。如图1所示,数据处理系统10包括模型训练装置11以及电子设备12。模型训练装置11与电子设备12连接。模型训练装置11与电子设备12之间可以采用有线方式连接,也可以采用无线方式连接,本发明实施例对此不作限定。

52.模型训练装置11用于根据各子模型的评价参数,对待训练的标签生成模型进行训练,得到标签生成模型。其中,子模型可以为分类模型,也可以为回归模型,本公开实施例对子模型的类型不作限定。在本公开实施例提供的以下实施例中,以子模型为分类模型为例进行说明。

53.模型训练装置11可以在各种电子设备12中实现,例如,该电子设备12可以为电脑、手机、平板电脑或者其他类型的终端,或者,服务器。可选地,该服务器可以为独立的物理服务器,或者是多个物理服务器构成的服务器集群或者分布式系统,或者是提供云服务、云数据库、云计算、云函数、云存储、网络服务、云通信、中间件服务、域名服务、安全服务、以及大数据和人工智能平台等基础云计算服务的云服务器。

54.当待训练模型完成训练后,模型训练装置11可以将训练好的标签生成模型存储到电子设备12中,以使得电子设备12可以基于训练好的标签生成模型对待处理多媒体资源进行处理,得到多媒体资源的标签。

55.在不同的应用场景中,模型训练装置11和电子设备12可以为相互独立的设备,也可以集成于同一设备中,本发明实施例对此不作具体限定。

56.模型训练装置11和电子设备12集成于同一设备时,模型训练装置11和电子设备12之间的数据传输方式为该设备内部模块之间的数据传输。这种情况下,二者之间的数据传输流程与“模型训练装置11和电子设备12之间相互独立的情况下,二者之间的数据传输流程”相同。

57.在本发明实施例提供的以下实施例中,本发明实施例以模型训练装置11和电子设备12相互独立设置为例进行说明。

58.图2是根据一些示例性实施例示出的一种模型训练方法的流程示意图。在一些实施例中,上述模型训练方法可以应用到如图1所示的模型训练装置、电子设备,也可以应用到其他类似设备。

59.如图2所示,本公开实施例提供的模型训练方法,包括下述s201-s206。

60.s201、模型训练装置获取多个资源样本以及多个资源样本对应的资源标签。

61.作为一种可能实现的方式,模型训练装置从电子设备中获取多个资源样本以及多个资源样本对应的资源标签。

62.在实际应用中,运维人员可以将多个资源样本以及多个资源样本对应的资源标签预先存储在电子设备中,用以为后续的训练任务做准备。例如,一次训练任务中运维人员准备了1000张图像作为此次训练任务的样本,并将1000张图像以及1000张图像对应的1000个标签存储在电子设备中。

63.s202、模型训练装置将多个资源样本作为首批资源样本输入至待训练的标签生成模型。

64.其中,待训练的标签生成模型包括串行连接的n个子模型,n为大于1的正整数。

65.需要说明的,待训练的标签生成模型(以下简称待训练模型)由n个子模型组成,本质上是将多重或多个弱分类器结合为一个强分类器。待训练模型中各子模型的功能相同,例如都是对训练样本进行分类或者都是对训练样本进行预测。每个子模型由多个卷积层构成,各子模型的网络结构可以相同也可以不同,本公开实施例对此不作限定。

66.例如,当各子模型为具有图像分类功能的模型时,各子模型可以为深度50残差网络(residual network depth 50,resnet 50d)模型、开端第三版(inception version 3,inception-v3)模型或者斯温转换(swin transformer)模型等。此时,待训练模型用于对样本图像进行分类。

67.如图3所示,示出了一种待训练模型的结构,其中,待训练模型由n个子模型串行连接后构成,串行连接顺序为子模型1、子模型2、子模型3、

……

、子模型n。

68.作为一种可能实现的方式,模型训练装置将多个资源样本作为首批资源样本,按照待训练的标签生成模型中n个子模型的串行连接顺序,输入至第一个子模型(即首个子模型)。

69.作为另一种可能实现的方式,模型训练装置按照待训练模型中各子模型的预设序号确定出首个子模型,并将多个资源样本作为首批资源样本输入至首个子模型。

70.需要说明的,预设序号为运维人员预先在各子模型中设置的,用以明确各子模型之间的连接顺序。

71.示例性的,模型训练装置获取了1000张图像以及1000张图像对应的1000个标签,模型训练装置则将1000张图像作为首批资源样本输入至待训练的标签生成模型中的首个

子模型。

72.s203、对于首个子模型,模型训练装置根据首批资源样本以及首批资源样本对应的资源标签,确定首个子模型的评价参数。

73.作为一种可能实现的方式,模型训练装置将首批资源样本输入至待训练的标签生成模型中的首个子模型,得到首个子模型对首批资源样本进行分类预测后输出的首批预测概率。进一步的,模型训练装置根据首批预测概率、首批资源样本对应的资源标签以及预设的评价函数,确定首个子模型的评价参数。

74.在实际应用中,评价参数可以为模型的损失,也可以其它可以衡量模型性能的参数指标,本公开实施例对评价参数的具体内容不做限定。

75.示例性的,对于图3所示的待训练模型,模型训练装置将根据获取到的首批输入样本(1000张图像)、首批输入样本对应的样本标签以及预设的损失函数,确定子模型1的损失l1。

76.s204、对于第m个子模型,模型训练装置从第m-1批资源样本中,确定第m个子模型对应的第m批资源样本。

77.其中,第m-1批资源样本包括第m-1个子模型的输入样本,第m批资源样本中的资源样本不满足第m-1个子模型的置信度指标,m为大于1小于或等于n的任意正整数。

78.作为一种可能实现的方式,对于第m个子模型,模型训练装置获取第m-1批资源样本的置信度,分别判断第m-1批资源样本中各资源样本的置信度是否满足第m-1个子模型的置信度指标。模型训练装置将第m-1批资源样本中置信度不满足置信度指标的资源样本,确定为第m个子模型对应的第m批资源样本。

79.需要说明的,第m个子模型为除首个子模型之外的任意一个子模型,第m-1个子模型为位于第m个子模型之前且与第m个子模型相邻的子模型(例如图3中,子模型2的上一子模型为子模型1)。即对于待训练模型中除首个子模型外的任意一个子模型,模型训练装置均采用上述方法确定该子模型对应的资源样本。在实际应用中,各子模型之间的顺序由待训练的标签生成模型中n个子模型的串行连接顺序决定,模型训练装置按照待训练的标签生成模型中n个子模型的串行连接顺序,确定出第m个子模型以及第m-1个子模型。置信度指标为运维人员预先在各子模型中设置的,每个子模型中的置信度指标可以相同也可以不同,本公开实施例对此不作限定。对于第m个子模型而言,第m批资源样本中任意一个资源样本的置信度反映了该子模型对该资源样本处理结果的可靠程度。

80.示例性的,对于子模型2,假设子模型1的资源样本包括图像1、图像2、图像3以及图像4,子模型1的置信度指标为0.8,其中只有图像1和图像2满足该置信度指标,而图像3和图像4不满足该置信度指标,模型训练装置则将图像3和图像4作为子模型2的输入样本。

81.s205、模型训练装置根据第m批资源样本以及第m批资源样本对应的资源样本标签,确定第m个子模型的评价参数。

82.作为一种可能实现的方式,模型训练装置根据确定到的第m个子模型对应的第m批资源样本,确定第m批资源样本对应的标签,并将第m批资源样本输入第m个子模型,得到第m个子模型对第m批资源样本进行分类预测后输出的当前批次预测概率。进一步的,模型训练装置根据当前批次预测概率、第m批资源样本对应的样本标签以及预设的评价函数,确定第m个子模型的评价参数。

83.需要说明的,此处第m个子模型是指多个子模型中除首个子模型之外的任意一个子模型。即每个非首个子模型都按照此步骤实施例来确定评价参数。

84.同理,评价参数可以为模型的损失,也可以其它可以衡量模型性能的参数指标,本公开实施例对评价参数的具体内容不做限定。

85.示例性的,对于图3所示的待训练模型,模型训练装置确定子模型2的损失l2,子模型3的损失l3,

……

,子模型n的损失ln。

86.s206、模型训练装置根据各子模型的评价参数,对待训练的标签生成模型进行训练,得到标签生成模型。

87.作为一种可能实现的方式,模型训练装置计算各子模型的评价参数之和,并将各子模型的评价参数之和作为待训练模型的评价参数,对待训练模型进行训练,得到标签生成模型。

88.例如,将损失作为评价参数时,当各子模型的损失之和小于或者等于预设损失时,确定完成训练,得到标签生成模型。当各子模型的损失之和大于预设损失时,重新获取训练样本,并执行上述步骤s202-s206,以对待训练模型进行迭代训练(不断调整各子模型的参数),直到各子模型的损失之和小于或者等于预设损失为止。重新获取的训练样本可以与步骤s201中获取的多个资源样相同,也可以不同,本公开实施例对此不作限定。

89.需要说明的,预设损失为运维人员预先在模型训练装置中设置的。当各子模型的损失之和大于预设损失时,重新获取的训练样本可以与s201中的多个资源样本相同,也可以不同。

90.在一些实施例中,模型训练装置还可以对各子模型的评价参数进行加权处理,并将加权处理后的评价参数作为待训练模型的评价参数,对待训练模型进行训练,得到标签生成模型。

91.作为一种另可能实现的方式,模型训练装置计算各子模型的损失之和,并将各子模型的损失之和作为待训练模型的损失,对待训练模型进行训练。当各子模型的损失收敛时(损失之和不再下降),确定完成训练,得到标签生成模型。当各子分类模型的损失之和未收敛时,重新获取训练样本,并执行上述步骤s202-s206,以对待训练模型进行迭代训练(不断调整各子模型的参数),直到各子模型的损失之和收敛为止。

92.作为再一种可能实现的方式,模型训练装置计算各子模型的损失之和,并将各子模型的损失之和作为待训练模型的损失,对待训练模型进行迭代训练,直到迭代次数达到预设次数为止,得到标签生成模型。

93.需要说明的,预设次数为运维人员预先在模型训练装置中设置的。

94.在对待训练模型进行迭代训练时,若训练样本为图像样本,则运维人员可以根据模型训练装置或者电子设备的图像处理器(graphics processing unit,gpu)位数或者卡数,决定一次训练所选取的首批资源样本数量batchsize。通常batchsize=64*gpu卡数。在模型训练装置获取到多个资源样本后,待训练模型整体的训练方法和训练深度卷积神经网络类似,模型训练装置将初始化学习率设为0.01,使用深度学习优化器(如sgd优化器)对待训练模型进行迭代训练。本公开提供的技术方案至少带来以下有益效果:本公开中模型训练装置首先获取多个资源样本以及多个资源样本对应的资源标签,并将多个资源样本作为首批资源样本输入至待训练的标签生成模型。由于待训练的标签生成模型包括串行连接的

n个子模型,n为大于1的正整数,对于首个子模型,模型训练装置根据首批资源样本以及首批资源样本对应的资源标签,确定首个子模型的评价参数;对于第m个子模型,模型训练装置从第m-1批资源样本中,确定第m个子模型对应的第m批资源样本,进一步根据第m批资源样本以及第m批资源样本对应的资源样本标签,确定第m个子模型的评价参数。其中,第m-1批资源样本包括第m-1个子模型的输入样本,第m批资源样本中的资源样本不满足第m-1个子模型的置信度指标,m为大于1小于或等于n的任意正整数。这样一来,模型训练装置得到了待训练的标签生成模型中每个子模型的评价参数。本公开根据上述特征得到各子模型的评价参数之后,相较于相关技术中对各子模型按照各自对应的评价参数单独训练,本公开基于各子模型的评价参数,对待训练的标签生成模型整体进行训练,即对待训练的标签生成模型中各子模型同时进行训练,这样使得在训练过程中各子模型之间的关联性得到提高,进而使得训练得到的标签生成模型对多媒体资源的处理性能得到提升,进而可以得到准确的多媒体资源的标签。

95.在一种设计中,为了确定第m个子模型对应的第m批资源样本,如图4所示,本公开实施例提供的上述s204,具体包括下述s2041-s2042:

96.s2041、模型训练装置通过第m-1个子模型对第m-1批资源样本进行处理,获取第m-1批资源样本中各资源样本的置信度。

97.作为一种可能的实现方式,模型训练装置从第m-1个子模型的输出结果中,获取第m-1批资源样本中各资源样本的置信度。

98.在实际应用中,第m-1批资源样本中各资源样本的置信度可以为第m-1个子模型对第m-1批资源样本进行分类预测后输出的预测概率。

99.示例性的,以图3所示的待训练模型为例,在训练任务为图像分类的情况下,各资源样本均为图像。对于首批资源样本中的任意一个图像,模型训练装置将图像输入首个子模型,首个子模型根据输入图像的轮廓、颜色等特征,来预测输入图像内容是否为猫,得到输入图像为猫(预测概率为0.6)。设首批资源样本包括图像1、图像2、图像3以及图像4,首个子模型对图像1、图像2、图像3以及图像4进行分类预测的结果分别为猫(预测概率为0.6)、猫(预测概率为0.9)、猫(预测概率为0.7)、猫(预测概率为0.8)。因此,对子模型2来讲,模型训练装置获取到的第m-1批资源样本中各资源样本的置信度分别为图像1:0.6,图像2:0.9,图像3:0.7,图像4:0.8。

100.s2042、模型训练装置将置信度小于或者等于第m-1个子模型的置信度指标的资源输入样本确定为第m批资源样本。

101.作为一种可能的实现方式,模型训练装置获取第m-1个子模型的置信度指标,并依据第m-1个子模型的置信度指标对第m-1批资源样本进行筛选,将第m-1批资源样本中置信度小于或者等于置信度指标的资源样本确定为第m批资源样本。

102.示例性的,以图3所示的待训练模型为例,对子模型1来讲,模型训练装置获取到的第1批资源样本的预测概率分别为图像1:0.6,图像2:0.9,图像3:0.7,图像4:0.8。若子模型1的预测概率门限为0.8,则模型训练装置确定到的第2批资源样本为图像1、图像3以及图像4。

103.可以理解的,对于非首个子模型而言,训练时只需关注其上一子模型识别困难的样本(例如子模型1对图像1的预测概率仅为0.6,表明子模型1对图像1的预测结果并不可

信),因此各子模型在确定输入样本时,通常对样本进行筛选,只需对筛选到的样本针对性训练即可,节省了训练资源且保障了模型整体的预测效果。

104.在一种设计中,为了确定第m个子模型的评价参数,如图5所示,本公开实施例提供的上述s205,具体包括下述s2051-s2054:

105.s2051、模型训练装置判断是否存在第m批资源样本。若存在第m批资源样本,则执行步骤s2052-s2053;若不存在第m批资源样本,则执行步骤s2054。

106.作为一种可能实现的方式,模型训练装置按照上述步骤s2041-s2042从第m-1批资源样本中确定第m批资源样本,并将确定到的资源样本进行标记。模型训练装置遍历第m-1批资源样本中各资源样本,以查询是否存在带有标记的资源样本。若存在,模型训练装置则判断存在第m批资源样本;若不存在,模型训练装置则判断不存在第m批资源样本。

107.示例性的,若以图3所示的待训练模型为例,对子模型2来讲,模型训练装置获取到的上一批次预测概率(即第1批资源样本的预测概率)分别为图像1:0.6,图像2:0.9,图像3:0.7,图像4:0.8。若子模型1的预测概率门限为0.5,模型训练装置则确定第2批资源样本不存在(即子模型2的资源样本不存在)。

108.s2052、在存在第m批资源样本的情况下,模型训练装置将第m批资源样本分别输入第m个子模型,得到第m批资源样本中各资源样本的置信度。

109.作为一种可能实现的方式,在存在第m批资源样本的情况下,模型训练装置将第m批资源样本中各资源样本分别输入第m个子模型,得到第m个子模型对第m批资源样本中各资源样本进行分类预测后输出的各资源样本的预测概率。

110.示例性的,若以图3所示的待训练模型为例,对子模型2来讲,若第2批资源样本为图像1、图像2以及图像3,模型训练装置分别将图像1、图像2以及图像3输入子模型2,得到各图像的分类预测概率:图像1为猫的预测概率0.6,图像2为猫的预测概率0.9,图像3为猫的预测概率0.7。

111.作为一种另可能实现的方式,在存在第m批资源样本的情况下,模型训练装置将第m批资源样本一次性输入第m个子模型,得到第m个子模型对第m批资源样本进行分类预测后输出的各资源样本的预测概率。

112.s2053、模型训练装置根据第m批资源样本中各资源样本的置信度、第m批资源样本中各资源样本对应的资源标签以及预设的评价函数,确定第m个子模型的评价参数。

113.作为一种可能实现的方式,模型训练装置将第m批资源样本中各资源样本的预测概率以及第m批资源样本中各资源样本对应的资源标签代入到预设的损失函数中,计算得到第m个子模型的损失,并将该损失确定第m个子模型的评价参数。

114.需要说明的,损失函数为运维人员预先在模型训练装置中设置的。例如,损失函数可以为分类错误率函数(classification error),还可以为交叉熵损失函数(cross entropy loss function)。本公开实施例对具体的损失函数不作限定。

115.s2054、在不存在第m批资源样本的情况下,模型训练装置将第m个子模型的评价参数确定为预设参数。

116.作为一种可能实现的方式,在不存在第m批资源样本的情况下,模型训练装置将第m个子模型的损失确定为零。

117.示例性的,若以图3所示的待训练模型为例,对子模型2来讲,模型训练装置获取到

的第m批资源样本中各资源样本的预测概率分别为图像1:0.6,图像2:0.9,图像3:0.7,图像4:0.8。若子模型2的预测概率门限为0.5,模型训练装置则确定子模型2的第2批资源样本不存在。此时,模型训练装置将子模型2的损失确定为零。

118.作为另一种可能实现的方式,在不存在第m批资源样本的情况下,模型训练装置将第m个子模型的损失确定为预设值。该预设值为运维人员预先在模型训练装置中设置的。

119.可以理解的,本公开实施例根据各非首个子模型是否存在对应的资源样本,确定如何计算各非首个子模型的损失,考虑因素全面,使得各非首个子模型的损失计算更加准确。

120.在一种设计中,为了确定首个子模型的评价参数,如图6所示,本公开实施例提供的上述s203,具体包括下述s2031-s2032:

121.s2031、模型训练装置将首批资源样本中各资源样本分别输入首个子模型,得到首批资源样本中各资源样本的置信度。

122.s2032、模型训练装置根据首批资源样本中各资源样本的置信度、首批资源样本中各资源样本对应的资源标签以及预设的评价函数,确定首个子模型的评价参数。

123.需要说明的,确定首个子模型的评价参数与确定第m个子模型的评价参数的方法相似。因此,此步骤具体可以参考上述步骤s2051-s2054,不同之处在于将第m批资源样本替换为首批资源样本、将第m个子模型替换为首个子模型即可。

124.在一种设计中,待训练的标签生成模型中各子模型按照复杂度从低到高的顺序串行连接。

125.需要说明的,复杂度可以为模型网络结构的复杂程度,也可以为模型算法的复杂度,本公开实施例对具体的复杂度不作限定。

126.在实际应用中,运维人员可以根据各子模型网络结构的复杂程度高低设置复杂度。进一步,运维人员可以按照各子模型的复杂度从低到高的顺序进行排列,并将排列后的各子模型作为待训练的标签生成模型。

127.例如,对于网络结构较为简单的模型(例如第三版移动网络模型(mobilenetv3)模型,深度34残差网络(residual network depth 34,resnet 34d),深度50残差网络(residual network depth 50,resnet 50d)模型等),其复杂度较可以设为0.1;对于网络结构较为复杂的模型(例如inception-v3模型模型),其复杂度较可以设为0.5;对于网络结构特别复杂的模型(例如swin transformer模型),其复杂度较可以设为0.9。经过排序后,模型训练装置可以将mobilenetv3模型设为首个子模型,将inception-v3模型设置在首个子模型之后,作为第二个子模型,

……

,将swin transformer模型作为第n个子模型。

128.可以理解的,本公开实施例关注到各子模型网络结构上的差异化,各子模型按照复杂度从低到高的顺序串行连接,使得待训练模型的结构由浅到深(越是排在后面的子模型结构越复杂,识别功能也就越强大),布局更加合理。

129.在一些实施例中,如图7所示,各子模型为分类模型,且均用于图像分类,按照上述布局方式,在一次完整的训练过程中,首个子分类模型在对首批图像进行分类后,模型训练装置可以确定出首个子分类模型的损失l1。进一步的,针对首批图像中预测概率较低的图像(即首个子分类模型识别困难的图像),模型训练装置将利用此类图像对第二子分类模型进行训练,并确定第二子分类模型的损失l2。以此类推,直到确定出最后一个子分类模型

(例如第n个子分类模型)的损失ln。最后,模型训练装置各子分类模型的损失之和loss=l1 l2

……

ln作为待训练模型的损失,对该待训练模型进行训练。其中,n-1批图像指的是第n-1个子分类模型对应的当前批次输入样本,n-1批图像中识别困难的图像指的是第n-1个子分类模型对n-1批图像中识别困难的图像。此处的识别困难相当于预测概率低于预设的概率阈值。

130.图8是根据一些示例性实施例示出的一种多媒体资源的数据处理方法的流程示意图。如图8所示,本公开实施例提供的多媒体资源的数据处理方法,包括下述s301-s303。

131.s301、电子设备获取待处理多媒体资源。

132.作为一种可能实现的方式,电子设备响应于用户的输入操作,获取用户输入的待处理多媒体资源。

133.s302、电子设备将待处理多媒体资源输入至标签生成模型。

134.其中,标签生成模型为基于上述实施例中的模型训练方法训练得到的模型。

135.作为一种可能实现的方式,电子设备将获取到的待处理多媒体资源输入到训练完成的标签生成模型。

136.需要说明的,标签生成模型为模型训练装置采用上述实施例公开的模型训练方法训练得到的,并存储在电子设备中。

137.s303、电子设备通过标签生成模型对待处理多媒体资源进行处理,得到多媒体资源的标签。

138.作为一种可能实现的方式,电子设备将获取到的待分类图像输入到训练完成的标签生成模型,得到多媒体资源的标签。

139.在一种设计中,标签生成模型包括串行连接的多个子模型,为了得到多媒体资源的标签,如图9所示,本公开实施例提供的上述s303,具体包括下述s3031:

140.s3031、电子设备按照多个子模型的串行连接顺序,将待处理多媒体资源依次输入多个子模型,直至多个分类子模型中的目标子模型输出多媒体资源的标签。

141.其中,目标子模型为对待处理多媒体资源进行分类处理得到的标签置信度大于预设的置信度指标的模型,或者,目标子模型为串行连接的多个子模型中的最后一个子模型。

142.示例性的,如图10所示,示出了一种标签生成模型的结构,其中,标签生成模型由n个子分类模型串行连接后构成,串行连接顺序为子分类模型1、子分类模型2、子分类模型3、

……

、子分类模型n。以待处理多媒体资源为待分类图像为例,按照图10中分类模型的结构,电子设备首先将待分类图像输入子分类模型1,得到待分类图像为猫的预测概率为0.6。

143.进一步的,电子设备判断预测概率0.6是否大于子分类模型1对应的预设概率阈值。在判断预测概率0.6大于子分类模型1对应的预设概率阈值的情况下,电子设备将预测概率0.6对应的标签(即待分类图像为猫)确定为分类结果,并输出分类结果。在判断预测概率0.6小于或者等于子分类模型1对应的预设概率阈值的情况下,电子设备将待分类图像输入子分类模型2,并重复执行以上步骤,直到电子设备将待分类图像输入至最后一个子分类模型(即子分类模型n),得到待分类图像为猫的预测概率为x。此时,电子设备并不需要关注子分类模型n的预测概率,而是直接将子分类模型n的预测结果“猫”作为待分类图像的分类结果直接输出。

144.上述实施例主要从装置(设备)的角度对本公开实施例提供的方案进行了介绍。可

以理解的是,为了实现上述方法,装置或设备包含了执行各个方法流程相应的硬件结构和/或软件模块,这些执行各个方法流程相应的硬件结构和/或软件模块可以构成一个电子设备。本领域技术人员应该很容易意识到,结合本文中所公开的实施例描述的各示例的算法步骤,本公开能够以硬件或硬件和计算机软件的结合形式来实现。某个功能究竟以硬件还是计算机软件驱动硬件的方式来执行,取决于技术方案的特定应用和设计约束条件。专业技术人员可以对每个特定的应用来使用不同方法来实现所描述的功能,但是这种实现不应认为超出本公开的范围。

145.本公开实施例可以根据上述方法示例对装置或设备进行功能模块的划分,例如,装置或设备可以对应各个功能划分各个功能模块,也可以将两个或两个以上的功能集成在一个处理模块中。上述集成的模块既可以采用硬件的形式实现,也可以采用软件功能模块的形式实现。需要说明的是,本公开实施例中对模块的划分是示意性的,仅仅为一种逻辑功能划分,实际实现时可以有另外的划分方式。

146.图11是根据一示例性实施例示出的模型训练装置的结构示意图。参照图11所示,本公开实施例提供的模型训练装置40,包括获取单元401、处理单元402以及训练单元403。

147.获取单元401,用于获取多个资源样本以及多个资源样本对应的资源标签;处理单元402,用于将多个资源样本作为首批资源样本输入至待训练的标签生成模型,待训练的标签生成模型包括串行连接的n个子模型,n为大于1的正整数;对于首个子模型,处理单元402,用于根据首批资源样本以及首批资源样本对应的资源标签,确定首个子模型的评价参数;对于第m个子模型,处理单元402,用于从第m-1批资源样本中,确定第m个子模型对应的第m批资源样本;第m-1批资源样本包括第m-1个子模型的输入样本,第m批资源样本中的资源样本不满足第m-1个子模型的置信度指标,m为大于1小于或等于n的任意正整数;处理单元402,还用于根据第m批资源样本以及第m批资源样本对应的资源标签,确定第m个子模型的评价参数;训练单元403,用于根据各子模型的评价参数,对待训练的标签生成模型进行训练,得到标签生成模型。

148.可选的,处理单元402,具体用于:通过第m-1个子模型对第m-1批资源样本进行处理,获取第m-1批资源样本中各资源样本的置信度;将置信度小于或者等于第m-1个子模型的置信度指标的资源样本确定为第m批资源样本。

149.可选的,处理单元402,具体用于:在存在第m批资源样本的情况下,将第m批资源样本中各资源样本分别输入第m个子模型,得到第m批资源样本中各资源样本的置信度;根据第m批资源样本中各资源样本的置信度、第m批资源样本中各资源样本对应的资源标签以及预设的模型评价函数,确定第m个子模型的评价参数;在不存在第m批资源样本的情况下,将第m个子模型的评价参数确定为预设参数。

150.可选的,待训练的标签生成模型中各子模型按照复杂度从低到高的顺序串行连接。

151.可选的,处理单元402,具体用于:将首批资源样本中各资源样本分别输入首个子模型,得到首批资源样本中各资源样本的置信度;根据首批资源样本中各资源样本的置信度、首批资源样本中各资源样本对应的资源标签以及预设的模型评价函数,确定首个子模型的评价参数。

152.可选的,训练单元403具体用于:将各子模型的评价参数之和作为待训练的标签生

成模型的评价参数,对待训练的标签生成模型进行训练,得到标签生成模型。

153.图12是根据一示例性实施例示出的电子设备的结构示意图。参照图12所示,本公开实施例提供的电子设备50,包括获取单元501以及处理单元502。

154.获取单元501,用于获取待处理多媒体资源;处理单元502,用于将待处理多媒体资源输入至标签生成模型,标签生成模型为基于上述实施例的模型训练装置训练得到的;处理单元,还用于通过标签生成模型对待处理多媒体资源进行处理,得到多媒体资源的标签。

155.可选的,处理单元502具体用于:按照多个子模型的串行连接顺序,将待处理多媒体资源依次输入多个子模型,直至多个子模型中的目标子模型输出多媒体资源的标签;目标子模型为对待处理多媒体资源进行处理得到的标签置信度大于预设的置信度指标的模型,或者,目标子模型为最后一个子模型。

156.图13是本公开提供的一种电子设备的结构示意图。如图13,该电子设备60可以包括至少一个处理器601以及用于存储处理器可执行指令的存储器602其中,处理器601被配置为执行存储器602中的指令,以实现上述实施例中的模型训练方法或者多媒体资源的数据处理方法。

157.另外,电子设备60还可以包括通信总线603以及至少一个通信接口604。

158.处理器601可以是一个处理器(central processing units,cpu),微处理单元,asic,或一个或多个用于控制本公开方案程序执行的集成电路。

159.通信总线603可包括一通路,在上述组件之间传送信息。

160.通信接口604,使用任何收发器一类的装置,用于与其他设备或通信网络通信,如以太网,无线接入网(radio access network,ran),无线局域网(wireless local area networks,wlan)等。

161.存储器602可以是只读存储器(read-only memory,rom)或可存储静态信息和指令的其他类型的静态存储设备,随机存取存储器(random access memory,ram)或者可存储信息和指令的其他类型的动态存储设备,也可以是电可擦可编程只读存储器(electrically erasable programmable read-only memory,eeprom)、只读光盘(compact disc read-only memory,cd-rom)或其他光盘存储、光碟存储(包括压缩光碟、激光碟、光碟、数字通用光碟、蓝光光碟等)、磁盘存储介质或者其他磁存储设备、或者能够用于携带或存储具有指令或数据结构形式的期望的程序代码并能够由计算机存取的任何其他介质,但不限于此。存储器可以是独立存在,通过总线与处理单元402相连接。存储器也可以和处理单元402集成在一起。

162.其中,存储器602用于存储执行本公开方案的指令,并由处理器601来控制执行。处理器601用于执行存储器602中存储的指令,从而实现本公开方法中的功能。

163.作为一个示例,结合图10,模型训练装置40中的获取单元401、处理单元402以及训练单元403实现的功能与图13中的处理器601的功能相同。

164.作为另一个示例,结合图11,电子设备50中的获取单元501以及处理单位502实现的功能与图13中的处理器601的功能相同。

165.在具体实现中,作为一种实施例,处理器601可以包括一个或多个cpu,例如图13中的cpu0和cpu1。

166.在具体实现中,作为一种实施例,电子设备60可以包括多个处理器,例如图13中的

处理器601和处理器1307。这些处理器中的每一个可以是一个单核(single-cpu)处理器,也可以是一个多核(multi-cpu)处理器。这里的处理器可以指一个或多个设备、电路、和/或用于处理数据(例如计算机程序指令)的处理核。

167.在具体实现中,作为一种实施例,电子设备60还可以包括输出设备605和输入设备606。输出设备605和处理器601通信,可以以多种方式来显示信息。例如,输出设备605可以是液晶显示器(liquid crystal display,lcd),发光二级管(light emitting diode,led)显示设备,阴极射线管(cathode ray tube,crt)显示设备,或投影仪(projector)等。输入设备606和处理器601通信,可以以多种方式接受用户对象的输入。例如,输入设备606可以是鼠标、键盘、触摸屏设备或传感设备等。

168.本领域技术人员可以理解,图13中示出的结构并不构成对电子设备60的限定,可以包括比图示更多或更少的组件,或者组合某些组件,或者采用不同的组件布置。

169.另外,本公开还提供一种计算机可读存储介质,当计算机可读存储介质中的指令由电子设备的处理器执行时,使得电子设备能够执行如上述实施例所提供的模型训练方法或者多媒体资源的数据处理方法。

170.另外,本公开还提供一种计算机程序产品,包括计算机指令,当计算机指令在电子设备上运行时,使得电子设备执行如上述实施例所提供的模型训练方法或者多媒体资源的数据处理方法。

171.本领域技术人员在考虑说明书及实践这里公开的公开后,将容易想到本公开的其它实施方案。本公开旨在涵盖本公开的任何变型、用途或者适应性变化,这些变型、用途或者适应性变化遵循本公开的一般性原理并包括本公开未公开的本技术领域中的公知常识或惯用技术手段。说明书和实施例仅被视为示例性的,本公开的真正范围和精神由权利要求指出。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。