1.本发明涉及手写数学公式识别技术领域,尤其是涉及一种手写数学公式识别方法、系统、设备和存储介质。

背景技术:

2.由于数学符号在科学文档中起着至关重要的作用,对于描述数学,物理学和许多其他领域中的问题和理论是必不可少的。近年来由于计算机的技术领域的不断革新,由于数字笔、平板电脑、智能手机等新产品的迅速出现,人们渐渐习惯使用手写数学符号来作为数据表达式的输入,但是手写体数学公式的复杂结构会引入很多歧义。手写数学公式识别问题可以看成是序列到序列进行转录的学习问题,并且是多数据模态序列数据之间的学习问题,也即轨迹坐标序列到latex符号序列之间的学习问题。传统的神经网络模型对手写体数学表达式的识别的识别范围较小且正确率较低,错误率较高,适用范围比较有限。

技术实现要素:

3.本发明提供一种手写数学公式识别方法、系统、设备和存储介质,提高了识别的正确率和识别率,减少了错误率。

4.本发明的一种技术方案是:提供一种手写数学公式识别方法,包括如下步骤:

5.对手写数学公式图像进行灰度化处理;

6.卷积神经网络对灰度化的图片进行编码处理;

7.bigru-attention模型对编码数据进行解码处理。

8.作为对本发明的改进,在上述卷积神经网络对灰度化的图片进行编码处理的步骤中,还包括如下内容:

9.对灰度化的图片进行卷积处理;

10.对卷积处理后的数据进行池化处理;

11.对池化后的数据进行压缩。

12.作为对本发明的改进,在上述对灰度化的图片进行卷积处理的步骤中,还包括如下内容:

13.将灰度化的图片分解为一系列有重叠的像素块;

14.将每个所述像素块输入到一个神经网路中,并保持权重不变;

15.将所述像素块转化成矩阵;

16.将输出值排成矩阵。

17.作为对本发明的改进,在上述bigru-attention模型对编码数据进行解码处理的步骤中,还包括如下内容:

18.读取所述编码数据并进行清洗和向量化;

19.对词向量进行处理;

20.输出识别后的数学公式。

21.作为对本发明的改进,在读取所述编码数据并进行清洗和向量化的步骤中,还包括如下内容:

22.读取所述编码数据并进行清洗;

23.将数据向量化为规定长度的形式;

24.随机初始化数据,按8:2划分训练集和测试集。

25.作为对本发明的改进,在对词向量进行处理的步骤中,还包括如下内容:

26.计算bigru层输出的词向量;

27.计算每个词向量应分配的概率权重;

28.对分配的不同概率权重与各个隐层状态的乘积进行累加,使用softmax函数做归一化操作。

29.本发明的另一种技术方案是:提供一种手写数学公式识别系统,包括:

30.灰度处理模块,用于对手写数学公式图像进行灰度化处理;

31.卷积神经网络,用于对灰度化的图片进行编码处理;

32.bigru-attention模型,用于对编码数据进行解码处理。

33.作为对本发明的改进,所述卷积神经网络包括:

34.卷积层,由于对灰度化的图片进行卷积处理;

35.池化层,用于对卷积处理后的数据进行池化处理;

36.压缩模块,用于对池化后的数据进行压缩。

37.作为对本发明的改进,所述卷积层包括如下内容:

38.分解模块,用于将灰度化的图片分解为一系列有重叠的像素块;

39.像素块输入模块,用于将每个所述像素块输入到一个神经网路中,并保持权重不变;

40.转化模块,用于将所述像素块转化成矩阵;

41.排列模块,用于将输出值排成矩阵。

42.作为对本发明的改进,所述bigru-attention模型包括:

43.向量化输入层,用于读取所述编码数据并进行清洗和向量化;

44.隐含层,用于对词向量进行处理;

45.输出层,用于输出识别后的数学公式。

46.作为对本发明的改进,所述向量化输入层包括如下内容:

47.清洗模块,用于读取所述编码数据并进行清洗;

48.规定模块,用于将数据向量化为规定长度的形式;

49.初始化模块,用于随机初始化数据,按8:2划分训练集和测试集。

50.作为对本发明的改进,所述隐含层包括如下内容:

51.词向量计算模块,用于计算bigru层输出的词向量;

52.权重计算模块,用于计算每个词向量应分配的概率权重;

53.归一化处理模块,用于对分配的不同概率权重与各个隐层状态的乘积进行累加,使用softmax函数做归一化操作。

54.本发明的第三种技术方案是:提供一种计算机设备,包括存储器和处理器,所述存储器存储有计算机程序,其特征在于,所述处理器执行所述计算机程序时,实现上述中任一

项所述的手写数学公式识别方法的步骤。

55.本发明的第四种技术方案是:提供一种计算机可读存储介质,其上存储有计算机程序,其特征在于,所述计算机程序被处理器执行时,实现上述中任一项所述的手写数学公式识别方法的步骤。

56.本发明由于采用了卷积神经网络和bigru-attention模型,加强了特征提取,促进了梯度传播,工作效率得到了提高,其识别率有了较大提升,正确率有了提高;在对输入的数据集进行图像的特征提取时,丢掉了图像不重要的特征,保留了重要的图像特征,降低了编码和解码的时间;提高了对特征的提取速率,对数学表达式的识别效率。

附图说明

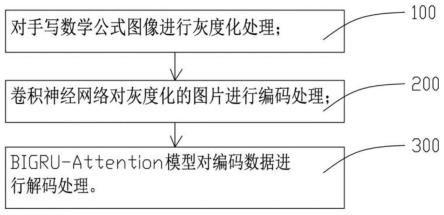

57.图1是本发明中手写数学公式识别方法的流程示意图。

58.图2是本发明中手写数学公式图像。

59.图3是图2的数学表达式识别图。

60.图4是本发明中手写数学公式识别系统的方框示意图。

61.图5是本发明中计算机设备的结构方框示意图。

62.其中:

63.1.灰度处理模块;2.卷积神经网络;3.bigru-attention模型;71.处理器;72.输入接口;73.网络端口;74.显示单元;75.存储器。

具体实施方式

64.在本发明的描述中,需要理解的是,术语中“中心”、“上”、“下”、“前”、“后”、“左”、“右”等指示的方位或位置关系为基于附图所示的方位或位置关系,仅是为了便于描述本发明和简化描述,而不是指示或暗示所指的装置或组件必须具有特定的方位、以特定的方位构造和操作,因此不能理解为对本发明的限制。此外,术语“第一”、“第二”仅用于描述目的,而不能理解为指示或暗示相对重要性。

65.在本发明的描述中,需要说明的是,除非另有明确的规定和限定,术语“安装”、“连接”、“相连”应做广义理解,例如,可以是固定连接,也可以是拆卸连接,或一体地连接;可以是机械连接,也可以是电连接;可以是直接相连,也可以是通过中间媒介间接相连,可以是两个组件内部的连通。对于本领域的普通技术人员而言,可以具体情况理解上述术语在本发明的具体含义。

66.一、本发明提供一种手写数学公式识别方法,请参见图1,包括如下步骤:

67.100.对手写数学公式图像进行灰度化处理;

68.200.卷积神经网络对灰度化的图片进行编码处理;

69.300.bigru-attention模型对编码数据进行解码处理。

70.在本方法中,使用摄像头拍摄手写数学公式图像(请参见图2所示),得到清晰的手写数学公式图像,采用的拍摄装置可以是手机,也可以是摄像头,还可以是平板电脑。

71.在本方法的上述步骤100中,对手写数学公式图像进行灰度化处理,目的在于简化图片的像素信息,提高后续步骤神经网络处理图片的计算速度。还包括如下内容。

72.灰度化处理:彩色图像由rgb(r:红,g:绿,b:蓝)三个颜色通道组成,彩色图像上的

每个像素点都由rgb三个颜色变量表示,将图像每个像素点的rgb三个通道根据公式1算出新的像素值,当图像上的每个像素点的rgb值都相等时,彩色图像就会变为单通道的灰度图像,将三通道的彩色图像转换成单通道的灰度图像可以加快图像的处理。

73.gray=r*0.299 g*0.587 b*0.114

ꢀꢀꢀꢀ

公式1

74.其中gray表示图像的灰度值。

75.在本方法的上述步骤200中,卷积神经网络由5个密集块组成,每个密集块包括3个卷积层和1个池化层,3个卷积层设置在前面,1个池化层设置在后面,其中第一个卷积层与第二个卷积层均为为3*3,第三个卷积层为1*1;最后一层为池化层。

76.在本方法的上述步骤200中,卷积神经网络对灰度化的图片进行编码处理,还包括如下步骤。

77.201.对灰度化的图片进行卷积处理。

78.2011.将灰度化的图片分解为一系列有重叠的h*w像素块,有利于特征的提取。

79.2012.将每个像素块输入到一个简单的、单层的神经网路中,并保持权重不变,这一步骤主要用于提取特征。

80.2013.将像素块转化成矩阵,为进一步提取重要的特征信息提供便利。

81.2014.将输出值排成矩阵,以数据形式表示图片中每个区域的内容,不同轴分别代表宽度和高度。

82.202.对卷积处理后的数据进行池化处理。

83.对矩阵在空间维度上进行采样并处理为池化阵列,这其中只包含重要部分图像,并且丢掉了其他部分,目的在于提高对于图像特征的识别,有利于提高识别的效率。

84.203.对池化后的数据进行压缩。

85.需要说明的是,densenet提出了一个更激进的密集连接机制:即互相连接所有的层,具体来说就是每个层都会接受其前面所有层作为其额外的输入。densenets不是在特征传递给某一层之前将其进行相加(combine),而是将其进行拼接(concatenate)。在保证网络中层与层之间最大程度的信息传输的前提下,直接将所有层连接起来。为了能够保证前馈的特性,每一层将之前所有层的输入进行拼接,之后将输出的特征图传递给之后的所有层。在densenet中,每个层都会与前面所有层在channel维度上连接(concat)在一起(这里各个层的特征图大小是相同的,后面会有说明),并作为下一层的输入。对于一个l层的网络,densenet共包含个连接而且densenet是直接concat来自不同层的特征图,这可以实现特征重用,提升效率。

86.在densenet中,会连接前面所有层作为输入:

87.xl=ηl([x0,x1,.....,xl-1])

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

公式2

[0088]

其中,上面的ηl()代表是非线性转化函数(non-liear transformation),它是一个组合操作,其可能包括一系列的bn(batch normalization),relu,pooling及conv操作。注意这里l层与l-1层之间可能实际上包含多个卷积层。

[0089]

b.本发明所使用的densenet的网络架构及其原理

[0090]

我们所使用的densenet由5个密集块(dense block)组成,每个密集块都由3个卷积层和1个池化层组成,前3层为卷积层,其中第一层与第二层均为为3*3,第3层为1*1;最后

一层为池化层。在每个密集块中都包含以下结构:

[0091]

(1)紧密连接(dense connectivity)

[0092]

在densenet结构中,每一层的输出都导入后面的所有层,densenet结构使用的是连结结构(concatenate)。这样的结构可以减少网络参数,避免被选择性丢弃,信息阻塞等的缺点。

[0093]

(2)卷积层

[0094]

3*3的卷积层用于对图像的重要特征的提取;1*1的卷积层用于压缩参数。每一层输出k个特征(feature),理论上将每个密集块(dense block)输出为4k个特征(feature)。卷积层的作用是将一个密集块(dense block)的参数压缩到4k个

[0095]

(3)池化层

[0096]

由于采用了密集连接(dense connectivity)结构,直接在各个层之间加入池化层是不可行的,因此采用的是密集块(dense block)组合的方式,在各个密集块(dense block)之间加入卷积层和池化层。

[0097]

(4)增长率(growth rate)

[0098]

这里的增长率代表的是每一层输出的特征(feature)的厚度。由于densenet中每一层都能直接为后面网络所用,所以k被限制在一个很小的数值

[0099]

(5)压缩(compression)

[0100]

跟1*1卷积层作用类似,压缩参数。

[0101]

在本方法的上述步骤300中,bigru-attention模型对编码数据进行解码处理,bigru-attention模型包括向量化输入层、隐含层和输出层,包括如下步骤。

[0102]

301.读取编码数据并进行清洗和向量化。

[0103]

读取编码数据并进行清洗;将数据向量化为规定长度的形式;随机初始化数据,按8:2划分训练集和测试集;将数据向量化后,特征都变成了统一长度的索引向量,每一个索引对应一个词向量。最后,将输入的数据变成根据索引对应向量的形成特征矩阵。

[0104]

302.对词向量进行处理。

[0105]

3021.计算bigru层输出的词向量。

[0106]

对输入的文本向量进行深层次特征的提取,通过bigru层的特征提取后,可以充分地学习上下文之间的关系,进行语义编码。计算bigru层输出的词向量。图像向量为bigru层的输入向量。bigru层的目的主要是对输入的图像向量进行图像深层次特征的提取。根据bigru神经网络模型图,可以把bigru模型看做由向前gru和反向gru两部分组成,在这里简化为式公式3。在第i时刻输入的第j个图像的第t个图像的特征向量为cijt,通过bigru层特征提取后,可以更加充分地学习上下文之间的关系,进行语义编码,具体计算公式如式所示。

[0107]

hijt=bigru(cijt),t∈[1,m]

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

公式3

[0108]

3022.计算每个词向量应分配的概率权重。

[0109]

主要是为不同的图像特征向量分配相应的概率权重,进一步提取图像特征,突出图像的关键信息bigru-attention模型中引入了attention机制层。attention机制层的输入为上一层中经过bigru神经网络层激活处理的输出向量h

ijt

,attention机制层的权重系数具体通过以下几个公式进行计算:

[0110][0111]

其中:hijt为上一层bigru神经网络层的输出向量,ww表示权重系数,bw表示偏置系数,uw表示随机初始化的注意力矩阵。attention机制矩阵由attention机制分配的不同概率权重与各个隐层状态的乘积的累加和,使用softmax函数做归一化操作得到。

[0112]

3023.对分配的不同概率权重与各个隐层状态的乘积进行累加,使用softmax函数做归一化操作。

[0113]

303.输出识别后的数学公式。

[0114]

将归一化的结果输入到输出层,由输出层逐字生成latex序列,识别出所有的手写体数据公式的latex序列,请参见图3所示。

[0115]

本发明由于采用了卷积神经网络和bigru-attention模型,加强了特征提取,促进了梯度传播,工作效率得到了提高,其识别率有了较大提升,正确率有了提高;在对输入的数据集进行图像的特征提取时,丢掉了图像不重要的特征,保留了重要的图像特征,降低了编码和解码的时间;提高了对特征的提取速率,对数学表达式的识别效率,同时减少计算机的损耗。

[0116]

二、本发明提供一种手写数学公式识别系统,请参见图4,手写数学公式识别系统包括灰度处理模块1、卷积神经网络2和bigru-attention模型3。

[0117]

本实施例中,灰度处理模块1,用于对手写数学公式图像进行灰度化处理。卷积神经网络2,用于对灰度化的图片进行编码处理。bigru-attention模型3,用于对编码数据进行解码处理。

[0118]

本实施例中,使用摄像头拍摄手写数学公式图像,得到清晰的手写数学公式图像,采用的拍摄装置可以是手机,也可以是摄像头,还可以是平板电脑。

[0119]

本实施例中,卷积神经网络2由5个密集块组成,每个密集块包括3个卷积层和1个池化层,3个卷积层设置在前面,1个池化层设置在后面,其中第一个卷积层与第二个卷积层均为为3*3,第三个卷积层为1*1;最后一层为池化层。

[0120]

本实施例中,卷积神经网络2包括卷积层(未画图)、池化层(未画图)和压缩模块(未画图)。卷积层,由于对灰度化的图片进行卷积处理。池化层,用于对卷积处理后的数据进行池化处理,对矩阵在空间维度上进行采样并处理为池化阵列,这其中只包含重要部分图像,并且丢掉了其他部分,目的在于提高对于图像特征的识别,有利于提高识别的效率。压缩模块,用于对池化后的数据进行压缩。

[0121]

卷积层包括分解模块、像素块输入模块、转化模块和排列模块,分解模块,用于将灰度化的图片分解为一系列有重叠的像素块;像素块输入模块,用于将每个所述像素块输入到一个神经网路中,并保持权重不变;转化模块,用于将所述像素块转化成矩阵;排列模块,用于将输出值排成矩阵。

[0122]

本实施例中,bigru-attention模型3包括向量化输入层(未画图)、隐含层(未画

图)和输出层(未画图)。

[0123]

向量化输入层,用于读取所述编码数据并进行清洗和向量化。向量化输入层包括如下内容:清洗模块,用于读取所述编码数据并进行清洗;规定模块,用于将数据向量化为规定长度的形式;初始化模块,用于随机初始化数据,按8:2划分训练集和测试集。

[0124]

隐含层,用于对词向量进行处理。所述隐含层包括如下内容:词向量计算模块,用于计算bigru层输出的词向量;权重计算模块,用于计算每个词向量应分配的概率权重;归一化处理模块,用于对分配的不同概率权重与各个隐层状态的乘积进行累加,使用softmax函数做归一化操作。

[0125]

输出层,用于输出识别后的数学公式。将归一化的结果输入到输出层,由输出层逐字生成latex序列,识别出所有的手写体数据公式的latex序列。

[0126]

需要说明的是,前述方法实施例中的内容均适用于对应的系统实施例中,因而本系统实施例具体实现的功能与前述方法实施例相同,并且达到的有益效果也与前述方法实施例相同。并且,不再对系统实施例中的内容进行详细赘述,详细请参见上述方法内容。

[0127]

三、结合上述方法和系统的内容,本发明提供一种最佳实施方案。

[0128]

21.选择学生志愿者。在目标班级中随机选择50名学生作为学生志愿者,50名学生来自于不同年级。(学生数据采集涉及到人权,伦理,信息安全多个方面的问题,需要和教育部门,学校,学生家长以及学生本人做好沟通,采取志愿形式开展实验。)

[0129]

22.购置手写数学公式数据采集设备。为选择的50名志愿者学生分别配置一台ipad以及电子笔,共50套。

[0130]

23.录制手写数学公式视频数据。为学生安排不同的数学试题或数学公式利用电子笔进行书写,并采用高清的摄像头对学生的书写过程进行录制,将录制的视频存入ipad中。ipad与配置有win10系统、nvida 3080ti gpu、机器视觉库opencv、基于python语言的pytorch深度学习框架、8g ram的计算机相连接,拍摄到的照片发送至计算机。

[0131]

24.截取手写数学公式。安排数据记录员从录制的手写数学公式视频中截取最终的数据公式高清彩色图片,并将结果及时存入计算机中。

[0132]

25.对计算机中接收的彩色高清图片进行灰度化处理。彩色图像一般是由rgb三个颜色通道组成,其中r代表红色、g代表绿色、b代表蓝色。当图像上的每个像素点的rgb值都相等时,彩色的三通道图像就变成灰色的单通道图像。这里我们使用最大值法将彩色的三通道图像就变成灰色的单通道图像,这样可以加快图像的处理。

[0133]

26.对灰度化处理后的图片进行降噪处理。要想从图片中识别目前字符,需要对噪声和背景去除。由于字符通常都是黑色或者较深的颜色,所以对生成的灰度图形进行二值化处理。通过处理后,图像中中字符为白色,背景变为黑色。

[0134]

28.提取图片中高质量的特征。经处理后的图片输入到密集卷积神经网络对图像数据进行编码,提取高质量的图像特征,比如图像的宽度、高度、像素等特征。以数据的形式表示图像的每一个区域,形成一个数据矩阵。

[0135]

29.对数据进行压缩。密集卷积神经网络的池化层对这些矩阵在空间维度上进行采样,处理结果为池化阵列,这其中只包含重要部分图像。丢掉了其他部分经过下采样的矩阵作为全连接层的输入,经过了池化和卷积操作,输入的尺寸被大幅减小。

[0136]

30.将压缩后的数据矩阵输入到bigru-attention网络中对数据进行解码。通过

bigru循环神经网络可以充分学习到上下文信息和交互信息,突出字符或文本的关键信息,对这些信息进行编码。

[0137]

31.bigru-attention模型中的attention层对分配的不同概率权重与各个隐层状态的乘积进行累加,再使用softmax函数做归一化操作,在将结果输入到输出层,由输出层逐字生成latex序列。

[0138]

32.识别出所有的手写体数据公式的latex序列。

[0139]

四、本发明提供一种计算机设备,请参见图5,本技术实施例提供的一种计算机设备的结构图,包括存储器75和处理器71,所述存储器75存储有计算机程序,所述处理器71执行所述计算机程序时,实现如上述公开的任一种手写数学公式识别方法的步骤。

[0140]

具体的,存储器75包括非易失性存储介质、内存储器。该非易失性存储介质存储有操作系统和计算机可读指令,该内存储器为非易失性存储介质中的操作系统和计算机可读指令的运行提供环境。处理器71在一些实施例中可以是一中央处理器(centralprocessingunit,cpu)、控制器、微控制器、微处理器或其他数据处理芯片,为计算机设备提供计算和控制能力。

[0141]

所述计算机设备还包括:输入接口72,与处理器71相连,用于获取外部导入的计算机程序、参数和指令,经处理器71控制保存至存储器75中。该输入接口72可以与输入装置相连,接收用户手动输入的参数或指令。该输入装置可以是显示屏上覆盖的触摸层,也可以是终端外壳上设置的按键、轨迹球或触控板,也可以是键盘、触控板或鼠标等。

[0142]

显示单元74,与处理器71相连,用于显示处理器71处理的数据以及用于显示可视化的用户界面。该显示单元74可以为led显示器、液晶显示器、触控式液晶显示器以及oled(organiclight-emittingdiode,有机发光二极管)触摸器等。

[0143]

网络端口73,与处理器71相连,用于与外部各终端设备进行通信连接。该通信连接所采用的通信技术可以为有线通信技术或无线通信技术,如移动高清链接技术(mhl)、通用串行总线(usb)、高清多媒体接口(hdmi)、无线保真技术(wifi)、蓝牙通信技术、低功耗蓝牙通信技术、基于ieee802.11s的通信技术等。

[0144]

图5仅示出了具有组件71-75的计算机设备,本领域技术人员可以理解的是,图5示出的结构并不构成对计算机设备的限定,可以包括比图示更少或者更多的部件,或者组合某些部件,或者不同的部件布置。

[0145]

五、本发明提供一种计算机可读存储介质,该存储介质可以包括:u盘、移动硬盘、只读存储器(read-onlymemory,rom)、随机存取存储器(randomaccessmemory,ram)、磁碟或者光盘等各种可以存储程序代码的介质。该存储介质上存储有计算机程序,所述计算机程序被处理器执行时时实现如上述公开的任一种手写数学公式识别方法的步骤。

[0146]

前述方法实施例中的内容均适用于对应的存储介质实施例中,因而本存储介质实施例具体实现的功能与前述方法实施例相同,并且达到的有益效果也与前述方法实施例相同。

[0147]

本领域技术人员可以理解的是,上述步骤在实际运行中可以根据需要调换顺序,或者并行处理。应当认识到,本技术的实施例可以由计算机硬件、硬件和软件的组合、或者通过存储在非暂时性计算机可读存储器中的计算机指令来实现或实施。所述方法可以使用标准编程技术-包括配置有计算机程序的非暂时性计算机可读存储介质在计算机程序中实

现,其中如此配置的存储介质使得计算机以特定和预定义的方式操作——根据在具体实施例中描述的方法和附图。每个程序可以以高级过程或面向对象的编程语言来实现以与计算机系统通信。然而,若需要,该程序可以以汇编或机器语言实现。在任何情况下,该语言可以是编译或解释的语言。此外,为此目的该程序能够在编程的专用集成电路上运行。

[0148]

此外,可按任何合适的顺序来执行本文描述的过程的操作,除非本文另外指示或以其他方式明显地与上下文矛盾。本文描述的过程(或变型和/或其组合)可在配置有可执行指令的一个或多个计算机系统的控制下执行,并且可作为共同地在一个或多个处理器上执行的代码(例如,可执行指令、一个或多个计算机程序或一个或多个应用)、由硬件或其组合来实现。所述计算机程序包括可由一个或多个处理器执行的多个指令。

[0149]

进一步地,所述方法可以在可操作地连接至合适的任何类型的计算平台中实现,包括但不限于个人电脑、迷你计算机、主框架、工作站、网络或分布式计算环境、单独的或集成的计算机平台、或者与带电粒子工具或其它成像装置通信等等。本技术的各方面可以以存储在非暂时性存储介质或设备上的机器可读代码来实现,无论是可移动的还是集成至计算平台,如硬盘、光学读取和/或写入存储介质、ram、rom等,使得其可由可编程计算机读取,当存储介质或设备由计算机读取时可用于配置和操作计算机以执行在此所描述的过程。此外,机器可读代码,或其部分可以通过有线或无线网络传输。当此类媒体包括结合微处理器或其他数据处理器实现上文所述步骤的指令或程序时,本文所述的发明包括这些和其他不同类型的非暂时性计算机可读存储介质。当根据本技术所述的方法和技术编程时,本技术还包括计算机本身。

[0150]

计算机程序能够应用于输入数据以执行本文所述的功能,从而转换输入数据以生成存储至非易失性存储器的输出数据。输出信息还可以应用于一个或多个输出设备如显示器。在本技术优选的实施例中,转换的数据表示物理和有形的对象,包括显示器上产生的物理和有形对象的特定视觉描绘。

[0151]

需要说明的是,针对上述各实施方式的详细解释,其目的仅在于对本发明进行解释,以便于能够更好地解释本发明,但是,这些描述不能以任何理由解释成是对本发明的限制,特别是,在不同的实施方式中描述的各个特征也可以相互任意组合,从而组成其他实施方式,除了有明确相反的描述,这些特征应被理解为能够应用于任何一个实施方式中,而并不仅局限于所描述的实施方式。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。