1.本发明属于计算机技术领域,特别涉及人脸人眼朝向分析技术。

背景技术:

2.注视点分析是心理学基础研究的重要方法。其记录人在处理视觉信息时的眼动轨迹特征,广泛用于注意、视知觉、阅读等领域的研究。随着注视点分析工具向智能化,系列化,便携化方向的发展,其理论研究以及在心理学众多分支领域中的应用得以迅速发展,如:阅读的眼动研究、眼动分析法在广告心理学研究中的应用等。

3.现代注视点分析硬件的结构一般包括四个系统,即光学系统,瞳孔中心坐标提取系统,视景与瞳孔坐标迭加系统和图像与数据的记录分析系统,用来记录用户眼动情况。眼动有三种基本方式:注视,眼跳和追随运动。眼动可以反映视觉信息的选择模式,对于揭示认知加工的心理机制具有重要意义,从研究报告看,利用眼动数据进行心理学研究常用的资料或参数主要包括:注视点轨迹图,眼动时间,眼跳方向的平均速度时间和距离(或称幅度),瞳孔大小(面积或直径,单位象素)和眨眼。

4.但是现有的注视点分析工具一般使用头戴式眼动仪或桌面式眼动仪,有赖于硬件系统的设计,且会对被测者形成干扰,不利于大规模推广使用。

技术实现要素:

5.针对上述当前技术存在的不足,本发明公开了一种基于深度学习的注视点分析装置及分析方法,该系统使用的人眼朝向分析方法,和以往的注视点分析方法相比,本发明提出的方法不依赖于设计精细的眼动仪硬件系统,日常接触到的摄像头中都能使用该技术,可以大规模推广使用。

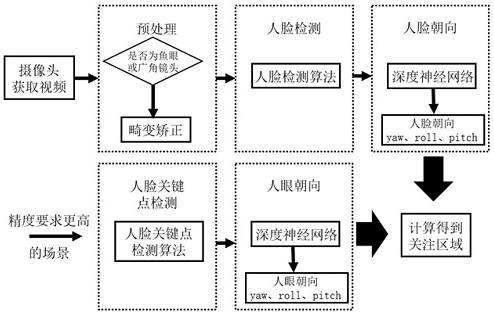

6.为了实现上述目的,本发明提供了以下技术方案:一方面,本发明提供了一种基于深度学习的注视点分析方法,所述注视点分析方法需要利用场景中已标定且固定好的摄像头获取视频信息,具体包括:s1:视频捕获模块获取视频画面,输入数据处理中心模块对输入视频画面进行预处理;s2:使用人脸检测算法,检测人脸位置,得到人脸图片;s3:将人脸图片输入到深度神经网络中,得到人脸朝向信息;s4:对于精度要求更高的场景,使用人脸关键点检测算法,检测人脸关键点信息(包含人眼关键点信息);s5:将得到的人脸关键点位置信息输入到训练好的深度学习神经网络中,得到人眼的朝向信息;s6:根据人脸或者人脸加人眼的朝向信息,计算出该人关注的区域。

7.进一步地,s1中对输入视频画面进行预处理,判断输入的视频是否存在畸变,当输入视频存在畸变时则进行畸变矫正,如果不存在则直接进行s2操作。

8.进一步地,s3中得到所述人脸朝向信息,输出的是为人脸朝向的方向向量,包含偏航角、转动角、倾斜角。

9.进一步地,s4中检测人脸关键点信息,所述关键点信息中包含人眼以及人脸轮廓的位置信息。

10.进一步地,s5中得到所述人眼朝向信息,输出的是为视线的方向向量,包含偏航角、转动角、倾斜角。

11.进一步地,s6中计算出该人关注的区域,需要根据场景先对所述摄像头的参数进行提前标定,参数包括假设位置、高度,并用热力图表示时段内注意力分布情况。

12.另一方面,本发明同时提供了一种注视点分析装置,包括:视频捕获模块,数据处理中心模块,通讯模块,信息显示平台;所述视频捕获模块用于采集场景中使用人员行为特征,将原始信息传输给所述数据处理中心模块;所述数据处理中心模块包括低精度模块、高精度模块,低精度模块通过人脸检测算法及深度神经网络对输入原始信息进行处理,得到人脸的朝向信息,高精度模块可进一步检测出人眼的朝向信息,可选择同时工作或者单独工作;所述通讯模块用于将所述数据处理中心模块的注视点分析结果传输到信息显示平台;所述信息显示平台用于以热图等方式显示注视点分析结果。

13.进一步地,所述视频捕获模块包括摄像头,可为标准镜头、长焦镜头、广角镜头、鱼眼镜头、红外镜头。

14.进一步地,所述注视点分析装置,还包括畸变矫正模块,判断输入的视频是否为鱼眼或广角镜头,如果是则需要对画面进行畸变矫正。

15.进一步地,所述注视点分析装置,还包括关键点模块检测关键点信息,所述关键点信息中包含人眼以及人脸轮廓的位置信息。

16.进一步地,所述注视点分析装置,还包括通讯模块,包含蓝牙模块、wifi模块。

17.进一步地,所述注视点分析装置,还包括信息显示平台,可为移动终端设备,包括计算机、智能手机。

18.本发明相对于现有技术具有如下的优点和效果:1、本发明的使用场景较为广泛,可以应用于各类场景下,包含但不限于桌面式,电梯轿厢。

19.2、本发明使用深度学习技术,得到的人脸人眼朝向更加精确且快速。

20.3、本发明使用的模型较为轻量化,对算力要求不高,便于移动端使用。

附图说明

21.图1 是本发明算法总的流程图图2 是本发明的一实施例的示意图。

具体实施方式

22.下面结合附图对本发明做进一步的具体说明:如图1所示,所述的注视点分析方法,具体包括:s1:视频捕获模块获取视频画面,输入数据处理中心模块对输入视频画面进行预

处理;s2:使用人脸检测算法,检测人脸位置,得到人脸图片;s3:启用低精度模块,将人脸图片输入到深度神经网络中,得到人脸的朝向;s4:对于精度要求更高的场景,同时启用高精度模块,使用人脸关键点检测算法,检测人脸关键点信息(包含人眼关键点信息);s5:将得到的人脸关键点位置信息输入到训练好的深度学习神经网络中,得到人眼的朝向信息;s6:根据人脸或者人脸加人眼的朝向信息,计算出该人关注的区域。进一步地,所使用的摄像头,包含但不限于:标准镜头、长焦镜头、广角镜头、鱼眼镜头、红外摄像头。

23.具体实施实例请参阅图2所示,如下:本发明提出了一种基于深度学习的注视点分析装置及分析方法,注视点分析装置包括视频捕获模块,数据处理中心模块,通讯模块,信息显示平台;所述视频捕获模块用于采集场景中使用人员行为特征,将原始信息传输给所述数据处理中心模块;所述数据处理中心模块包括低精度模块、高精度模块,低精度模块通过人脸检测算法及深度神经网络对输入原始信息进行处理,得到人脸的朝向信息,高精度模块可进一步检测出人眼的朝向信息,可选择同时工作或者单独工作;所述通讯模块用于将所述数据处理中心模块的注视点分析结果传输到信息显示平台;所述信息显示平台用于以热图等方式显示注视点分析结果该装置的输入为视频捕获模块在使用场景中拍摄的视频画面,所使用的视频捕获模块,包含但不限于:标准镜头、广角镜头、鱼眼镜头、红外摄像头。

24.这里以标准镜头作为示例,首先,对输入的视频进行预处理,我们首先计算得到相机的参数,后根据这些参数进行畸变矫正。

25.接下来对畸变矫正后的画面进行处理,使用人脸检测算法,检测人脸位置,得到人脸图片。

26.启用数据处理中心模块中的低精度模块将人脸图片输入到训练好的深度神经网络中,得到人脸的朝向信息。

27.对于精度要求更高的使用场景比如桌面使用场景,同时启用数据处理中心模块中的高精度模块,使用人脸关键点检测算法,检测人脸关键点位置信息,包含人眼以及人脸轮廓的关键点位置。

28.之后对得到的这些关键点位置信息,将其输入到我们训练好的神经网络系统中,神经网络输出人眼朝向的信息,得到的是一组视线的方向向量,包含偏航角、转动角、倾斜角。

29.根据测量好相机的高度以及角度信息,计算出人脸或人脸加人眼关注的区域。

30.最后将结果通过通讯模块传输给信息显示平台显示,当具体场景发生变化时,具体步骤流程及各模块的部署位置也随之变化。以电梯轿厢场景为示例,此时的摄像头为电梯轿厢内的鱼眼监控摄像头,该种摄像头获取的图像一般直接传输到监控室,因此除视频捕获模块以外的模块都会相应地部署在监控室处理器上,并且省去了通讯模块地部署。即只有视频捕获步骤在轿厢内硬件完成,其余步骤均在监控室完成。

31.以上实施方式只是对本发明专利的优选实施进行例行描述,并非对本发明专利的

构思和范围进行限定,在不脱离本发明专利设计思想的前提下,本领域中专业技术人员对本发明专利的技术方案做出的各种变化和改进,均属于本发明的保护范围。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。