1.本发明涉及语音交互技术领域,尤其涉及一种智能语音交互系统的语音技能训练方法及系统。

背景技术:

2.当前市面上有很多智能语音助理类型的语音交互系统,较常见的如苹果的siri、微软的cortana、阿里的阿里精灵、百度的度秘、小米的小爱同学以及车载语音助理如小鹏汽车的小p等。这些智能语音交互系统往往支持一系列垂直领域的能力支持,可支持完成诸如语音操控(如开闭开关、升降车窗、调节空调等)、咨询搜索(如搜索新闻等)、生活服务查询(如查询车票酒店、搜索美食影票)、娱乐查询和控制(搜索和播放音乐,调节进度等)。这一系列的垂直领域我们可以称之为ds(domain set),即领域集,常见的智能语音交互系统中支持的ds元素数量往往有几十到上百个,而每一个垂直领域即domain又支持数个intent(意图),致使每个domain都支持相当多的语音指令集,在较早期的语音交互系统中,每个domain支持的语音指令往往是需要严格匹配的。

3.随着技术和产品演进,近年来每个domain支持的语音指令具备一定的泛化性,但总体上还是有一定的约束边界,支持的指令相对固定和冗长。这些智能语音助理一旦定型,它所支持的指令集也就大概确定下来,用户就只能根据它支持的说法格式来输入语音指令并获取相应的服务,即语音交互系统不能正确识别边界之外的语音指令输入。在约束边界范围内的指令格式与某些用户的用语习惯不相符的情况下,语音交互系统无法对用户个性化语音输入(对应于特定技能)进行响应。同时,对于常见的智能语音交互系统来说,其所支持的语音指令集合也相当庞大,对于普通用户来说,掌握每个intent支持哪些指令说法,学习难度较高、学习成本较大,这使得系统支持的应用功能无法在实际使用过程中进行应用,对应的这些领域或意图就成为了dead domain或dead intent。

4.其次,语音交互系统的系统功能是被动被用户使用,因此无法有效获取用户的使用习惯、个性化使用需求等用户主动性方面的维度信息,不能很好的形成闭环的体验,不能很好的根据用户的使用习惯形成更好的用户画像,这就不利于系统贴合用户的需求进行持续迭代和优化演进,也不利于根据用户的个性化习惯进行智能的推荐。

技术实现要素:

5.本发明提供一种智能语音交互系统的语音技能训练方法及系统,解决了现有的语音交互系统语音指令局限于约束边界,用户使用难度大(语音指令庞大且固定,导致学习难度较高、学习成本较大),无法针对性的给予用户个性化服务的技术问题。

6.为解决以上技术问题,本发明提供一种智能语音交互系统的语音技能训练方法,包括步骤:

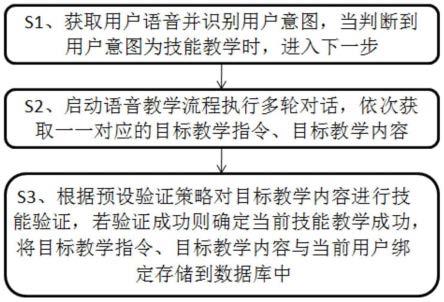

7.s1、获取用户语音并识别用户意图,当判断到所述用户意图为技能教学时,进入下一步;

8.s2、启动语音教学流程执行多轮对话,依次获取一一对应的目标教学指令、目标教学内容;

9.s3、根据预设验证策略对所述目标教学内容进行技能验证,若验证成功则确定当前技能教学成功,将所述目标教学指令、目标教学内容与当前用户绑定存储到数据库中。

10.本基础方案在现有的语音交互机制中增设技能教学进程,在根据语音识别确定用户意图为技能教学时,启动语音教学流程执行多轮对话,依次获取一一对应的目标教学指令、目标教学内容,随后根据预设验证策略对目标教学内容进行技能验证,进一步确定其是否可被执行,最后将教学成功的目标教学指令、目标教学内容与当前用户绑定存储到数据库中。如此,通过对话技能教学,将符合用户使用习惯的语音指令(即目标教学指令)与智能语音交互系统的语音技能联系起来,将相关的语音指令映射为简化的个性化指令,不仅可有效解决冗长的指令匹配和识别率低的问题,同时提高了系统整体的指令命中率,从而大大地提升了语音交互系统的服务效率和用户的使用体验。

11.在进一步的实施方案中,所述步骤s1包括:

12.s11a、获取用户语音并识别,得到语音文本信息;

13.s12a、解析所述语音文本信息,与语音指令库进行比对,若比对不成功,则提醒当前用户是否需要技能教学,若是则判断用户意图为技能教学,若否则执行正常的技能处理流程。

14.在进一步的实施方案中,所述步骤s1包括:

15.s11b、获取用户语音并识别,得到语音文本信息;

16.s12b、解析所述语音文本信息,并与语音教学指令进行比对,若比对成功则判断用户意图为技能教学,若否则执行正常的技能处理流程。

17.本方案针对实际交互场景预置了两种用户意图识别方式,一是在语音识别失败后由系统主动提问是否需要技能教学;二是预先设置语音教学指令,当识别到用户输入语音教学指令时,直接判断用户意图为技能教学,两种方式相互兼容,从而满足用户的使用需求。

18.在进一步的实施方案中,所述步骤s2包括:

19.s21、启动语音教学流程,并执行第一轮对话,输出指令请求语音;

20.s22、获取当前用户的第一交互语音并识别,将得到第一文本指令作为目标教学指令;

21.s23、执行第二轮对话,输出内容请求语音;

22.s24、获取当前用户的第二交互语音并识别,将得到第二文本指令作为目标教学内容。

23.本方案采用多轮语音交互实现语音教学,通过依次输出指令请求语音、内容请求语音,依次获取符合用户使用习惯的目标教学指令、目标教学内容,将个性化的自定义目标教学指令与符合语音识别要求的目标教学内容进行一一绑定,使得智能语音交互系统能够学会用户的个性化语音指令。

24.在进一步的实施方案中,所述步骤s3包括:

25.s31、解析所述目标教学内容,提取相对应的语义信息;

26.s32、根据所述语义信息查询技能库进行技能验证,若查询成功,则判断所述目标

教学内容验证成功、当前技能教学成功,否则判断当前技能教学失败;

27.s33、将所述目标教学指令、目标教学内容与当前用户绑定存储到数据库中。

28.本方案在获取到用户需求的目标教学内容后,根据所述语义信息查询技能库进行技能验证,如果技能库中支持该目标教学内容对应的指令和服务,则教学过程成功,否则,教学过程失败,提示用户暂不支持该技能,从而确保技能教学后的使用可行性。

29.在进一步的实施方案中,本发明还包括步骤s4:

30.a、获取当前用户的控制语音,识别得到控制文本指令;

31.b、从数据库中获取与所述当前用户对应的语音教学集合;

32.c、将所述控制文本指令与所述语音教学集合进行匹配,若匹配成功,则根据匹配得到的目标教学指令,获取对应的目标教学内容;

33.d、将所述控制文本指令映射为所述目标教学内容,进而获取对应的技能并执行。

34.本方案规划了对应的教学成功后的使用逻辑,从而在教学过程结束之后的使用过程中,用户可以通过输入自定义的个性化指令启动智能语音交互系统对应的技能,完成相关的语音控制、咨询搜索和服务查询等任务。

35.本发明提供一种智能语音交互系统的语音技能训练系统,包括输入输出模块、语音教学模块和存储分析模块;

36.所述输入输出模块用于进行人机交互,获取用户语音或触控操作;

37.所述语音教学模块用于,识别用户语音或触控操作确定用户意图,并在判断到所述用户意图为技能教学时,启动语音教学流程执行多轮对话,依次获取一一对应的目标教学指令、目标教学内容;进而根据预设验证策略对所述目标教学内容进行技能验证,若验证成功则确定当前技能教学成功;

38.所述存储分析模块用于,将教学成功的所述目标教学指令、目标教学内容与当前用户绑定写入数据库进行存储。

39.在进一步的实施方案中,所述输入输出模块包括端侧输入模块和端侧输出模块;

40.所述端侧输入模块用于进行人机交互,获取用户语音或触控操作;

41.所述端侧输出模块用于输出引导语音或者显示引导界面,以引导当前用户进行技能教学。

42.在进一步的实施方案中,所述语音教学模块包括语音识别模块、语义分析模块、对话管理模块和cp/sp模块;

43.所述语音识别模块用于将获取到的用户语音转化为文本信息;

44.所述语义分析模块用于对所述文本信息进行分析得到语义信息,从而确定所述用户语音所属于的垂直领域、所表达的用户意图以及所含的关键信息槽值,进而确定对应的所述目标教学指令、目标教学内容;

45.所述对话管理模块用于管理人机对话,根据上下文信息补充所述语义信息;

46.所述cp/sp模块用于向所述目标教学内容提供垂直领域的内容和服务支持,得到对应的技能并执行。

47.本方案根据语音识别模块、语义分析模块、对话管理模块和cp/sp模块组建语音教学机制,实现语音交互教学,将将符合用户使用习惯的语音指令(即目标教学指令)与智能语音交互系统的语音技能联系起来,将相关的语音指令映射为简化的个性化指令,不仅可

有效解决冗长的指令匹配和识别率低的问题,同时提高了系统整体的指令命中率,从而大大地提升了语音交互系统的服务效率和用户的使用体验。

48.在进一步的实施方案中,所述存储分析模块包括读写模块、数据库、统计分析模块;

49.所述读写模块用于将将教学成功的所述目标教学指令、目标教学内容与当前用户绑定写入数据库;

50.所述读写模块还用于在检测到用户输入的控制文本指令时,从数据库中读取与所述当前用户对应的语音教学集合;将所述控制文本指令与所述语音教学集合进行匹配,若匹配成功,则根据匹配得到的目标教学指令,获取对应的目标教学内容;将所述控制文本指令映射为所述目标教学内容,进而获取对应的技能并执行;

51.所述统计分析模块,用于对所述数据库中的教学内容进行统计和自动化学习,分析用户使用习惯。

52.本方案设立统计分析模块,通过后台对教学内容的统计和自动化学习,从统计学意义上了解用户使用习惯得到更加清晰的用户画像,从而有利于语音交互系统的迭代升级和优化演进。

附图说明

53.图1是本发明实施例提供的一种智能语音交互系统的语音技能训练方法的工作流程图;

54.图2是本发明实施例提供的一种智能语音交互系统的语音技能训练方法的语音教学过程流程图;

55.图3是本发明实施例提供的教学完成后教学指令的使用流程图;

56.图4是本发明实施例提供的一种智能语音交互系统的语音技能训练系统的系统框架图。

具体实施方式

57.下面结合附图具体阐明本发明的实施方式,实施例的给出仅仅是为了说明目的,并不能理解为对本发明的限定,包括附图仅供参考和说明使用,不构成对本发明专利保护范围的限制,因为在不脱离本发明精神和范围基础上,可以对本发明进行许多改变。

58.实施例1

59.本发明实施例提供的一种智能语音交互系统的语音技能训练方法及系统,如图1、图2所示,在本实施例中,包括步骤s1~s4:

60.s1、获取用户语音并识别用户意图,当判断到用户意图为技能教学时,进入下一步;

61.在本实施例的一种实施方式中,步骤s1包括步骤s11a~s12a:

62.s11a、获取用户语音并识别,得到语音文本信息;

63.s12a、解析语音文本信息,与语音指令库进行比对,若比对不成功,则提醒当前用户是否需要技能教学,若是则判断用户意图为技能教学,若否则执行正常的技能处理流程。

64.在本实施例中另一种实施方式中,步骤s1包括步骤s11b~s12b:

65.s11b、获取用户语音并识别,得到语音文本信息;

66.s12b、解析语音文本信息,并与语音教学指令进行比对,若比对成功则判断用户意图为技能教学,若否则执行正常的技能处理流程。

67.本实施例针对实际交互场景预置了两种用户意图识别方式,一是在语音识别失败后由系统主动提问是否需要技能教学;二是预先设置语音教学指令,当识别到用户输入语音教学指令时,直接判断用户意图为技能教学,两种方式相互兼容,从而满足用户的使用需求。

68.s2、启动语音教学流程执行多轮对话,依次获取一一对应的目标教学指令、目标教学内容,包括步骤s21~s24:

69.s21、启动语音教学流程,并执行第一轮对话,输出指令请求语音,和/或输出指令请求界面;

70.s22、获取当前用户的第一交互语音并识别,将得到第一文本指令作为目标教学指令;

71.s23、执行第二轮对话,输出内容请求语音,和/或输出内容请求界面;

72.s24、获取当前用户的第二交互语音并识别,将得到第二文本指令作为目标教学内容。

73.本实施例采用多轮语音交互实现语音教学,通过依次输出指令请求语音、内容请求语音,依次获取符合用户使用习惯的目标教学指令、目标教学内容,将个性化的自定义目标教学指令与符合语音识别要求的目标教学内容进行一一绑定,使得智能语音交互系统能够学会用户的个性化语音指令。

74.s3、根据预设验证策略对目标教学内容进行技能验证,若验证成功则确定当前技能教学成功,将目标教学指令、目标教学内容与当前用户绑定存储到数据库中;包括步骤s31~s33:

75.s31、解析目标教学内容,提取相对应的语义信息;

76.s32、根据语义信息查询技能库进行技能验证,若查询成功,则判断目标教学内容验证成功、当前技能教学成功,否则判断当前技能教学失败;

77.s33、将目标教学指令、目标教学内容与当前用户绑定存储到数据库中。

78.本实施例在获取到用户需求的目标教学内容后,根据语义信息查询技能库进行技能验证,如果技能库中支持该目标教学内容对应的指令和服务,则教学过程成功,否则,教学过程失败,提示用户暂不支持该技能,从而确保技能教学后的使用可行性。

79.在本实施例中,步骤s4包括步骤a~d:

80.a、获取当前用户的控制语音,识别得到控制文本指令;

81.b、从数据库中获取与当前用户对应的语音教学集合;

82.c、将控制文本指令与语音教学集合进行匹配,若匹配成功,则根据匹配得到的目标教学指令,获取对应的目标教学内容;

83.d、将控制文本指令映射为目标教学内容,进而获取对应的技能并执行。

84.本实施例规划了对应的教学成功后的使用逻辑,从而在教学过程结束之后的使用过程中,用户可以通过输入自定义的个性化指令启动智能语音交互系统对应的技能,完成相关的语音控制、咨询搜索和服务查询等任务。

85.本发明实施例在现有的语音交互机制中增设技能教学进程,在根据语音识别确定用户意图为技能教学时,启动语音教学流程执行多轮对话,依次获取一一对应的目标教学指令、目标教学内容,随后根据预设验证策略对目标教学内容进行技能验证,进一步确定其是否可被执行,最后将教学成功的目标教学指令、目标教学内容与当前用户绑定存储到数据库中。如此,通过对话技能教学,将符合用户使用习惯的语音指令(即目标教学指令)与智能语音交互系统的语音技能联系起来,将相关的语音指令映射为简化的个性化指令,不仅可有效解决冗长的指令匹配和识别率低的问题,同时提高了系统整体的指令命中率,从而大大地提升了语音交互系统的服务效率和用户的使用体验。

86.实施例2

87.本实施例中说明书附图中的附图标记包括:输入输出模块1,端侧输入模块11、端侧输出模块12;语音教学模块2,语音识别模块21、语义分析模块22、对话管理模块23、cp/sp模块24;存储分析模块3,读写模块31、数据库32、统计分析模块33。

88.本发明实施例提供一种智能语音交互系统的语音技能训练系统,参见图4,包括输入输出模块1、语音教学模块2和存储分析模块3;

89.输入输出模块1用于进行人机交互,获取用户语音或触控操作;

90.语音教学模块2用于,识别用户语音或触控操作确定用户意图,并在判断到用户意图为技能教学时,启动语音教学流程执行多轮对话,依次获取一一对应的目标教学指令、目标教学内容;进而根据预设验证策略对目标教学内容进行技能验证,若验证成功则确定当前技能教学成功;

91.语音教学模块2的可部署在端侧如嵌入式端,也可部署在云端服务器。

92.存储分析模块3用于,将教学成功的目标教学指令、目标教学内容与当前用户绑定写入数据库32进行存储。

93.在本实施例中,输入输出模块1包括端侧输入模块11和端侧输出模块12;

94.端侧输入模块11用于进行人机交互,获取用户语音或触控操作;

95.端侧输出模块12用于输出引导语音或者显示引导界面,以引导当前用户进行技能教学。

96.其中,端侧是指如智能语音助理类的语音交互系统中用户可感知的系统前端,包括但不限于手机或车机上语音助理app的ui界面。端侧输入模块11主要是作为语音对话技能教学系统的信息源,同时包括教学系统的触发方式。

97.触发方式包括但不限于语音方式和gui方式(graphical user interface,又称图形用户接口)。具体的,gui方式采用在前端界面上设置ui元素(教学按键),点击即可触发语音教学流程。

98.对应的,端侧输出模块12的输出形式包括但不限于一段用于反馈的语音播报、gui上的界面显示,两者兼而有之。

99.在本实施例中,语音教学模块2包括语音识别模块21、语义分析模块22、对话管理模块23和cp/sp模块24;

100.语音识别模块21用于将获取到的用户语音转化为文本信息;

101.语义分析模块22用于对文本信息进行分析得到语义信息,从而确定用户语音所属于的垂直领域、所表达的用户意图以及所含的关键信息槽值,进而确定对应的目标教学指

令、目标教学内容;

102.对话管理模块23用于管理人机对话,根据上下文信息补充语义信息;

103.具体地,对话管理模块23对整个人机对话的过程进行管理,对对话的状态进行跟踪,根据对话的上下文信息和一系列的策略来丰富、完善、融合和补充语义分析的结果。

104.cp(内容提供商)/sp(服务提供商)模块用于向目标教学内容提供垂直领域的内容和服务支持,得到对应的技能并执行。

105.例如:用户的语音输入意图为查询天气,而具体时间的天气预报信息就需要访问天气内容提供商来获取,类似的查询酒店、美食、院线以及视频等信息的query也需要对应的内容或服务提供商来支持,该子模块获取的内容数据与语义分析的数据结合可作为完整的对用户语音请求的响应。

106.本实施例根据语音识别模块21、语义分析模块22、对话管理模块23和cp/sp模块24组建语音教学机制,实现语音交互教学,将将符合用户使用习惯的语音指令(即目标教学指令)与智能语音交互系统的语音技能联系起来,将相关的语音指令映射为简化的个性化指令,不仅可有效解决冗长的指令匹配和识别率低的问题,同时提高了系统整体的指令命中率,从而大大地提升了语音交互系统的服务效率和用户的使用体验。

107.在本实施例中,存储分析模块3包括读写模块31、数据库32、统计分析模块33;

108.读写模块31用于将将教学成功的目标教学指令、目标教学内容与当前用户绑定写入数据库32;

109.其中,数据库32根据具体的应用场景进行选择,包括redis数据库、mysql等其他类型的数据库。

110.读写模块31还用于在检测到用户输入的控制文本指令时,从数据库32中读取与当前用户对应的语音教学集合;将控制文本指令与语音教学集合进行匹配,若匹配成功,则根据匹配得到的目标教学指令,获取对应的目标教学内容;将控制文本指令映射为目标教学内容,进而获取对应的技能并执行;若匹配不成功,则执行正常的技能处理流程。

111.统计分析模块33,用于对数据库32中的教学内容进行统计和自动化学习,分析用户使用习惯。

112.例如,对每一用户的教学历史进行统计分析,对具备相同特质的不同用户的教学历史进行统计分析等,从而分析用户使用习惯得到更加清晰的用户画像。

113.本实施例设立统计分析模块33,通过后台对教学内容的统计和自动化学习,从统计学意义上了解用户使用习惯得到更加清晰的用户画像,从而有利于语音交互系统的迭代升级和优化演进。

114.以空调温度控制、预先设置语音教学指令为例,步骤s2中的语音对话技能教学流程如下:

115.用户在启动语音交互流程之后,说出语音教学指令“我想教你一下”,启动了语音教学流程;此时,用户的语音输入(即语音教学指令)在语音识别模块21进行识别,通过识别后得到对应的文本信息“我想教你一下”,并将文本信息“我想教你一下”发送给语义分析模块22。

116.语义分析模块22对输入的文本信息进行语义信息的提取,提取对应的domain和intent等信息,得到对应的语义信息后,输出指令请求语音和/或输出指令请求界面到端侧

输出模块12,执行第一轮对话。

117.端侧输入模块11获取当前用户的第一交互语音,由语音识别模块21、语义分析模块22进行识别、分析,将得到第一文本指令作为目标教学指令,比如“太热了”;

118.语义分析模块22对输入的文本信息“太热了”进行语义信息的提取,提取对应的domain和intent等信息,得到对应的语义信息后,输出内容请求语音、和/或输出内容请求界面到端侧输出模块12,执行第二轮对话。

119.端侧输入模块11获取当前用户的第二交互语音,由语音识别模块21、语义分析模块22进行识别、分析,,将得到第二文本指令作为目标教学内容,如“把空调调到24度”。

120.随后,语义分析模块22会将该目标教学内容进行解析后,进一步到可以支持的技能库中进行查询,如果技能库中支持该教学内容对应的指令和服务,则教学过程成功,否则,教学过程失败,提示用户暂不支持该技能,教学流程结束。

121.最后,将目标教学指令“太热了”、目标教学内容“把空调调到24度”与当前用户绑定存储到数据库32中,教学流程结束。

122.对应的,参见图3,教学指令的使用流程如下:

123.用户说出已经经过语音教学之后的语音指令,如用户说出“太热了”,用户的语音指令首先会发送给语音识别模块21,语音识别模块21将对应的音频信息识别为文本指令。

124.读写模块31从数据库32中读取与当前用户对应的语音教学集合与文本指令进行匹配,若匹配成功,则根据匹配得到的目标教学指令,获取对应的目标教学内容将控制文本指令映射为目标教学内容(即将用户的语音指令“太热了”替换为“把空调调到24度”),进而获取对应的技能并执行;若匹配不成功,则执行正常的技能处理流程。

125.本实施例所提供的技能训练系统采用各个模块实现技能训练方法中的各个步骤,为技能训练方法提供硬件基础,便于方法实施。

126.上述实施例为本发明较佳的实施方式,但本发明的实施方式并不受上述实施例的限制,其他的任何未背离本发明的精神实质与原理下所作的改变、修饰、替代、组合、简化,均应为等效的置换方式,都包含在本发明的保护范围之内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。