1.本发明涉及遥感图像处理技术,具体涉及一种遥感高光谱与激光雷达图像融合分类方法及装置。

背景技术:

2.遥感高光谱图像是一种高维图像,其数据量庞大,可反映地物的空间信息和详细的光谱信息。但是对于同一材质的物体,由于它们具有相似的光谱响应,使得高光谱图像对它们的区分性较差。激光雷达图像可以记录物体的高程信息,为高光谱图像提供互补信息,因此遥感高光谱与激光雷达图像融合被广泛应用于地物分类领域。

3.近年来,深度学习在遥感图像处理中得到了广泛的应用并取得了良好的性能。深度学习中的卷积神经网络可以自动学习图像的深层特征,便于多模态图像融合处理,因此越来越多的基于卷积神经网络的深度学习算法应用于遥感高光谱图像与lidar图像融合分类任务中。但是现有的深度学习算法存在感受野有限、难以泛化等问题。为了应对上述问题,注意力机制被深入研究并应用。例如,he 等人在文献“hsi-bert: hyperspectral image classification using the bidirectional encoder representation from transformers. ieee transactions on geoscience and remote sensing, 2019.2934760.

ꢀ”

中采用了基于自注意力机制的transformer的双向编码器表示(bert)模型,使得神经网络在高光谱分类任务中具有全局感受野,可以捕获像素之间的全局依赖性。对于多模态图像融合任务,如何深入挖掘并联合利用多模态图像的互补信息成为亟需解决的难题。hong等人在文献“deep encoder-decoder networks for classification of hyperspectral and lidar data. ieee geoscience and remote sensing letters, 2020.3017414.”中提出了一种基于编码器-解码器结构的全连接网络,通过编码器对输入的高光谱与lidar图像提取并融合特征信息,再通过解码器对特征信息进行重构,实现比级联方法更紧凑的信息混合和更有效的信息传递。zhao等人在“joint classification of hyperspectral and lidar data using hierarchical random walk and deep cnn architecture. ieee transactions on geoscience and remote sensing, 2020.2982064.

”ꢀ

中首先开发了双通道卷积神经网络 (cnn) 架构来捕获高光谱图像的光谱和空间特征;提出了一种像素相似性分支,用于从lidar中获取具有不同高程信息的类之间的关系,并确定分类的空间对比度;然后在设计的分层随机游走层中,双通道cnn的预测分布作为全局先验,而像素间的相似性反映了像素对的局部相似性,增强了网络深层的空间一致性。hong等人在文献“more diverse means better: multimodal deep learning meets remote-sensing imagery classification. ieee transactions on geoscience and remote sensing, 2020.3016820.”中提出了一种多模态数据的深度学习框架,并且设计了一种新的基于紧凑性的融合方式,通过在网络学习过程中进行参数交叉利用来对多模态数据之间的互补信息进一步学习。但是,上述几种方法的不足之处在于,没有深入挖掘并联合利用多模态图像以及多层级特征间的互补信息,导致整体分类性能不佳。

技术实现要素:

4.本发明要解决的技术问题:针对现有技术的上述问题,提供一种遥感高光谱与激光雷达图像融合分类方法及装置,本发明针对现有多模态图像融合分类研究中对于多模态图像内和多层级特征间互补信息利用不充分的问题,旨在结合高光谱图像的空间光谱信息与雷达图像的高程信息,充分利用像素级/超像素级光谱差异特性和空间结构特性,通过双重特征提取以提取结构更加紧凑、辨识性更高的多模态多层级融合特征,实现面向遥感高光谱图像与雷达图像的高效融合分类。

5.为了解决上述技术问题,本发明采用的技术方案为:一种遥感高光谱与激光雷达图像融合分类方法,包括:1)将高光谱图像t1和雷达图像t2融合得到像素级融合图像t

p

;2)对像素级融合图像t

p

进行超像素分割得到标签矩阵l,参照标签矩阵l对像素级融合图像t

p

进行逐超像素均值化处理得到超像素级融合图像t

sp

;3)对像素级融合图像t

p

进行降维得到降维后的像素级融合图像t

pd

,对超像素级融合图像t

sp

进行降维得到降维后的超像素级融合图像t

spd

;4)对降维后的像素级融合图像t

pd

和超像素级融合图像t

spd

进行特征融合得到融合特征f,引入空间注意力模块对融合特征f进行优化,得到优化融合特征fo;5)利用预设的分类器对优化融合特征fo进行分类,得到分类结果g。

6.可选地,步骤1)包括:1.1)将高光谱图像t1和雷达图像t2的地理坐标信息进行统一;1.2)采用gram-schmidt算法,将高光谱图像t1作为低分辨率图像、将雷达图像t2作为高分辨率图像,利用高光谱图像t1波段的平均值来模拟低分辨率的全色波段,并将其作为行gram-schmidt变换的第一个分量gs1对高光谱图像t1进行gram-schmidt变换;1.3)通过调整雷达图像t2的统计值来匹配gram-schmidt变换的第一个分量gs1以产生修改的高分辨率波段图像,将修改的高分辨率波段图像替换gram-schmidt变换的第一个分量gs1得到一个新的数据集,对新的数据集进行gram-schmidt反变换得到像素级融合图像t

p

。

7.可选地,步骤2)包括:利用简单线性迭代聚类算法将像素级融合图像t

p

分割为设定的超像素个数n_segments个不规则的超像素块,每个超像素块被分配给不同的标签值,得到标签矩阵l;参照标签矩阵l中相同标签的索引位置计算得到像素级融合图像t

p

的每个超像素块中的像素均值v

mean

,用求得的像素均值v

mean

替代像素级融合图像t

p

中每个超像素块对应索引位置的像素值,得到超像素级融合图像t

sp

。

8.可选地,步骤2)之前还包括设定超像素个数n_segments的步骤,且超像素个数n_segments的计算函数表达式为:n_segments=(w

×

h)/num_pixels,上式中,w和h分别表示像素级融合图像t

p

的宽度与高度,num_pixels为定义的每个超像素包含的像素个数。

9.可选地,步骤4)中对降维后的像素级融合图像t

pd

和超像素级融合图像t

spd

进行特征融合之前还包括对降维后的像素级融合图像t

pd

和超像素级融合图像t

spd

进行零填充使图像大小与降维前一致。

10.可选地,步骤4)中对降维后的像素级融合图像t

pd

和超像素级融合图像t

spd

进行特征融合是指利用双通道参数交叉卷积神经网络对降维后的像素级融合图像t

pd

和超像素级

融合图像t

spd

进行特征融合,所述双通道参数交叉卷积神经网络包括依次相连的浅层特征学习模块、参数交叉特征融合模块与深层特征学习模块;所述浅层特征学习模块为三层结构,第一层和第三层由卷积模块和relu函数模块组成,第二层由卷积模块、最大池化模块和relu函数模块组成,降维后的像素级融合图像t

pd

经过浅层特征学习模块后得到对应的初始特征f

tp

,降维后的超像素级融合图像t

spd

经过浅层特征学习模块后得到对应的初始特征f

tsp

;参数交叉特征融合模块为两层结构,第一层由卷积模块、最大池化模块和relu函数模块组成,第二层为级联层,初始特征f

tp

和f

tsp

在参数交叉特征融合模块中通过参数交叉利用并级联得到交叉级联融合特征f

ii

;深层特征学习模块为三层结构,第一层由卷积模块和relu函数模块组成,第二层由卷积模块、平均池化模块和relu函数模块组成,第三层为卷积模块,深层特征学习模块通过三层结构对交叉级联融合特征f

ii

进行深层特征学习得到融合特征f;步骤4)中引入空间注意力模块对融合特征f进行优化包括:对融合分类特征f分别从通道维度进行最大池化与平均池化,再将这两个计算结果合并为二维特征f

[maxpool,avgpool]

,最后通过一层卷积操作和sigmoid激活函数得到网络最终输出的一维的优化融合特征fo。

[0011]

可选地,所述参数交叉特征融合模块中,初始特征f

tp

通过参数交叉特征融合模块的第一层得到的单源特征f1,初始特征f

tsp

通过参数交叉特征融合模块的第一层得到的单源特征f2;在参数交叉特征融合模块的级联层中,将浅层特征学习模块对降维后的超像素级融合图像t

spd

学习到的网络参数作用于单源特征f1得到特征p2(f1),将单源特征f1和特征p2(f1)进行级联得到级联特征f

1i

=[f1,p2(f1)];将浅层特征学习模块对降维后的像素级融合图像t

pd

学习到的网络参数作用于单源特征f2得到特征p1(f2),将单源特征f2和特征p1(f2)进行级联得到级联特征f

2i

=[f1,p1(f2)];将单源特征f1和级联特征f

2i

=[f1,p1(f2)]进行交叉得到交叉特征f1 p1(f2);将单源特征f2和级联特征f

1i

=[f1,p2(f1)]进行交叉得到交叉特征f2 p2(f2);将交叉特征f1 p1(f2)和交叉特征f2 p2(f2)进行级联得到交叉级联融合特征[f1 p1(f2), f2 p2(f1)]并作为交叉级联融合特征f

ii

。

[0012]

可选地,步骤4)之前包括对双通道参数交叉卷积神经网络、空间注意力模块进行训练的步骤,且对双通道参数交叉卷积神经网络、空间注意力模块进行训练时采用的损失函数loss函数表达式为:上式中,ys为真实标签,y

fsi

为分类器预测得到的标签,i表示第i个样本,s表示不同的网络分支,n表示样本总数,c表示每个地物类别的真实标签,m表示地物类别总数,y

ic

表示为符号函数,如果样本i等于真实标签c时符号函数y

ic

取1、否则符号函数y

ic

取0,p

ic

表示样本i等于真实标签c的概率。

[0013]

此外,本发明还提供一种遥感高光谱与激光雷达图像融合分类系统,包括相互连接的微处理器和存储器,该微处理器被编程或配置以执行所述遥感高光谱与激光雷达图像融合分类方法的步骤。

[0014]

此外,本发明还提供一种计算机可读存储介质,该计算机可读存储介质中存储有计算机程序,且该计算机程序用于被计算机设备执行以实施所述遥感高光谱与激光雷达图像融合分类方法的步骤。

[0015]

和现有技术相比,本发明主要具有下述优点:本发明遥感高光谱与激光雷达图像

融合分类方法针对全波段的遥感高光谱图像和单波段的雷达图像可实现多源图像融合以及像素级/超像素级多特征融合,结合对t

pd

、t

spd

特征融合得到融合特征f并引入空间注意力模块优化得到优化融合特征fo以进一步学习深层融合特征,充分挖掘并联合利用多源图像互补信息和多层级特征空间-光谱联合信息,提高不同地物之间的可区分性能,从而实现整体分类精度的提升,能够充分利用像素级/超像素级光谱差异特性和空间结构特性,可提取结构更加紧凑、辨识性更高的多模态多层级融合特征,实现面向遥感高光谱图像与雷达图像的高效融合分类。

附图说明

[0016]

图1为本发明实施例方法的基本流程示意图。

[0017]

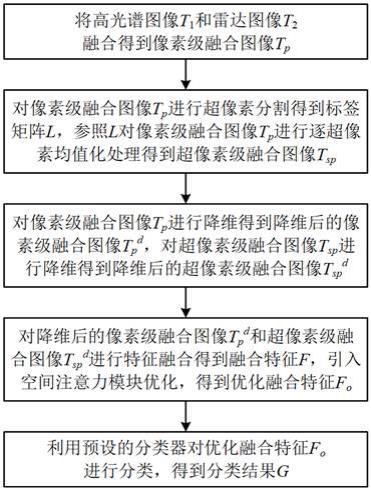

图2为本发明实施例中步骤1)~步骤3)部分的原理示意图。

[0018]

图3为本发明实施例中超像素级融合图像构建原理示意图。

[0019]

图4为本发明实施例中步骤4)~步骤5)部分的原理示意图。

[0020]

图5是本发明实施例中参数交叉特征融合模块模型示意图。

[0021]

图6是本发明实施例中空间注意力模块模型示意图。

[0022]

图7是每类训练样本数n从20增加到100时本发明实施例和其他现有方法的总体精度对比示曲线(%)。

[0023]

图8是每类训练样本数n从20增加到100时本发明实施例和其他现有方法的kappa系数对比曲线(%)。

[0024]

图9是每类训练样本数n从20增加到100时本发明实施例和其他现有方法的平均精度对比示曲线(%)。

具体实施方式

[0025]

如图1和图2所示,本实施例遥感高光谱与激光雷达图像融合分类方法包括:1)将高光谱图像t1和雷达图像t2融合得到像素级融合图像t

p

;2)对像素级融合图像t

p

进行超像素分割得到标签矩阵l,参照标签矩阵l对像素级融合图像t

p

进行逐超像素均值化处理得到超像素级融合图像t

sp

;3)对像素级融合图像t

p

进行降维得到降维后的像素级融合图像t

pd

,对超像素级融合图像t

sp

进行降维得到降维后的超像素级融合图像t

spd

;4)对降维后的像素级融合图像t

pd

和超像素级融合图像t

spd

进行特征融合得到融合特征f,引入空间注意力模块对融合特征f进行优化,得到优化融合特征fo;5)利用预设的分类器对优化融合特征fo进行分类,得到分类结果g。

[0026]

本实施例中,步骤1)包括:1.1)将高光谱图像t1和雷达图像t2的地理坐标信息进行统一;1.2)采用gram-schmidt算法,将高光谱图像t1作为低分辨率图像、将雷达图像t2作为高分辨率图像,利用高光谱图像t1波段的平均值来模拟低分辨率的全色波段,并将其作为行gram-schmidt变换的第一个分量gs1对高光谱图像t1进行gram-schmidt变换(gs变换);其中,进行gram-schmidt变换的函数表达式为:

上式中,gsn(i,j)表示对高光谱图像t1进行gram-schmidt变换后得到的第n个分量gsn中对应坐标(i,j)的值,bn(i,j)表示高光谱图像t1的第n个波段图像bn中对应坐标(i,j)的值,un表示高光谱图像t1的第n个波段图像bn灰度值的均值,φ表示计算协方差,gs

l

(i,j)表示对高光谱图像t1进行gram-schmidt变换后得到的第l个分量gs

l

中对应坐标(i,j)的值,l为高光谱图像t1的波段序号;1.3)通过调整雷达图像t2的统计值来匹配gram-schmidt变换的第一个分量gs1以产生修改的高分辨率波段图像,将修改的高分辨率波段图像替换gram-schmidt变换的第一个分量gs1得到一个新的数据集,对新的数据集进行gram-schmidt反变换(gs反变换)得到像素级融合图像t

p

。其中,进行gram-schmidt反变换(gs反变换)的函数表达式为:上式中,bn(i,j)表示gram-schmidt反变换后得到的高光谱图像t1的第n个波段图像bn中对应坐标(i,j)的值,gsn(i,j)表示对高光谱图像t1进行gram-schmidt变换后得到的第n个分量gsn中对应坐标(i,j)的值,un表示高光谱图像t1的第n个波段图像bn灰度值的均值,φ表示计算协方差,gs

l

(i,j)表示对高光谱图像t1进行gram-schmidt变换后得到的第l个分量gs

l

中对应坐标(i,j)的值,l为高光谱图像t1的波段序号。本实施例步骤1)中具体是在envi软件中实现的。

[0027]

如图3所示,本实施例步骤2)中为利用简单线性迭代聚类(simple linear iterative clustering,slic)算法对t

p

进行超像素分割得到标签矩阵l,并参照标签矩阵l对t

p

逐超像素均值化处理,具体地,步骤2)包括:利用简单线性迭代聚类算法将像素级融合图像t

p

分割为设定的超像素个数n_segments个不规则的超像素块,每个超像素块被分配给不同的标签值,得到标签矩阵l;参照标签矩阵l中相同标签的索引位置计算得到像素级融合图像t

p

的每个超像素块中的像素均值v

mean

,用求得的像素均值v

mean

替代像素级融合图像t

p

中每个超像素块对应索引位置的像素值,得到超像素级融合图像t

sp

。

[0028]

本实施例中,步骤2)之前还包括设定超像素个数n_segments的步骤,且超像素个数n_segments的计算函数表达式为:n_segments=(w

×

h)/num_pixels,上式中,w和h分别表示像素级融合图像t

p

的宽度与高度,num_pixels为定义的每个超像素包含的像素个数。

[0029]

本实施例中,步骤3)对像素级融合图像t

p

进行降维得到降维后的像素级融合图像t

pd

,对超像素级融合图像t

sp

进行降维得到降维后的超像素级融合图像t

spd

时,所采用的降维方法为主成分分析(principal component analysis,pca)方法,通过主成分分析(principal component analysis,pca)分别对t

p

和t

sp

进行pca变换,保留变换后的前10个主成分构建降维后的像素级融合图像t

pd

和超像素级融合图像t

spd

,以达到提升分类效率的目的。

[0030]

作为一种优选的实施方式,本实施例步骤4)中对降维后的像素级融合图像t

pd

和超像素级融合图像t

spd

进行特征融合之前还包括对降维后的像素级融合图像t

pd

和超像素级融合图像t

spd

进行零填充使图像大小与降维前一致,通过保持卷积操作中的图像大小不变,可避免发生信息丢失的情况,本实施例中零填充时的填充长度设置为3。采用零填充方法对对

降维后的像素级融合图像t

pd

和超像素级融合图像t

spd

进行零填充进行四周填充后,即可构建训练样本与测试样本。

[0031]

本实施例中,步骤4)中对降维后的像素级融合图像t

pd

和超像素级融合图像t

spd

进行特征融合是指利用双通道参数交叉卷积神经网络对降维后的像素级融合图像t

pd

和超像素级融合图像t

spd

进行特征融合。

[0032]

如图4所示,本实施例中双通道参数交叉卷积神经网络包括依次相连的浅层特征学习模块、参数交叉特征融合模块与深层特征学习模块:浅层特征学习模块为三层结构,第一层和第三层由卷积模块和relu函数模块组成(图中表示为convolution relu),第二层由卷积模块、最大池化模块和relu函数模块组成(图中表示为convolution maxpooling relu),降维后的像素级融合图像t

pd

经过浅层特征学习模块后得到对应的初始特征f

tp

,降维后的超像素级融合图像t

spd

经过浅层特征学习模块后得到对应的初始特征f

tsp

;在初始特征提取阶段,即浅层特征学习模块中对降维后的像素级融合图像t

pd

和超像素级融合图像t

spd

的两个处理通道是彼此独立的;参数交叉特征融合模块为两层结构,第一层由卷积模块、最大池化模块和relu函数模块组成(图中表示为convolution maxpooling relu),第二层为级联层(cascade layer),初始特征f

tp

和f

tsp

在参数交叉特征融合模块中通过参数交叉利用并级联得到交叉级联融合特征f

ii

;深层特征学习模块为三层结构,第一层由卷积模块和relu函数模块组成(图中表示为convolution relu),第二层由卷积模块、平均池化模块和relu函数模块组成(图中表示为convolution avgpooling relu),第三层为卷积模块(图中表示为convolution),深层特征学习模块通过三层结构对交叉级联融合特征f

ii

进行深层特征学习得到融合特征f。

[0033]

参见图5,本实施例的参数交叉特征融合模块中,初始特征f

tp

通过参数交叉特征融合模块的第一层(图中表示为convolution maxpooling relu)得到的单源特征f1,初始特征f

tsp

通过参数交叉特征融合模块的第一层(图中表示为convolution maxpooling relu)得到的单源特征f2;在参数交叉特征融合模块的级联层中,将浅层特征学习模块对降维后的超像素级融合图像t

spd

学习到的网络参数作用于单源特征f1得到特征p2(f1),将单源特征f1和特征p2(f1)进行级联得到级联特征f

1i

=[f1,p2(f1)];将浅层特征学习模块对降维后的像素级融合图像t

pd

学习到的网络参数作用于单源特征f2得到特征p1(f2),将单源特征f2和特征p1(f2)进行级联得到级联特征f

2i

=[f1,p1(f2)];将单源特征f1和级联特征f

2i

=[f1,p1(f2)]进行交叉得到交叉特征f1 p1(f2);将单源特征f2和级联特征f

1i

=[f1,p2(f1)]进行交叉得到交叉特征f2 p2(f2);将交叉特征f1 p1(f2)和交叉特征f2 p2(f2)进行级联得到交叉级联融合特征[f1 p1(f2), f2 p2(f1)]并作为交叉级联融合特征f

ii

。参数交叉特征融合模块得到中间特征包括:f

1i

=[f1,p2(f1)]f

2i

=[f1,p1(f2)]最终得到的交叉级联融合特征f

ii

的函数表达式为:f

ii

=[f1 p1(f2), f2 p2(f1)],其中,f1为初始特征f

tp

通过参数交叉特征融合模块的第一层得到的单源特征,f2为初始特征f

tsp

通过参数交叉特征融合模块的第一层得到的单源特征,p1(f2)表示将浅层特

classification using the bidirectional encoder representation from transformers)、endnet(encoder-decoder networks)、hrwn(hierarchical random walk network)和mdl-rs(multimodal deep learning meets remote-sensing imagery classification)与本实施例方法中执行网络(sadcnn)进行对比,对所有对比方法的参数进行了优化。为了公平比较,所有对比方法采用相同的训练和测试样本,其中hsi-bert方法只采用高光谱图像进行实验,endnet、hrwn和mdl-rs同时采用高光谱图像和lidar图像进行多模态图像融合分类,当每类取20个训练样本时具体结果如表1所示。

[0039]

表1:本实施例执行网络(sadcnn)与现有四种方法分类结果对比表(%)。

[0040]

参见表1,本实施例中采用的评价指标共有3种,分别为总体精度(oa),平均精度(aa)和kappa系数,最终三种评价指标取10次分类结果的平均值。结合表1(每一行最好结果已用粗体标出)可以看出,本实施例方法(sadcnn)在三种评价指标中均是最优结果。当每类取20个训练样本时,本实施例方法中执行网络(sadcnn)得到的oa值分别比hsi-bert、endnet、hrwn和mdl-rs提高25.01%、19.51%、5.29%和4.66%,验证了本实施例方法中执行网络(sadcnn)的有效性。

[0041]

为了进一步验证本实施例方法中执行网络(sadcnn)中各个模块的有效性,设计了三组消融实验:sadcnn-w/o sp表示不采用超像素级融合图像构建模块,只向网络中输入像素级融合图像t

p

;sadcnn-w/o pca表示不采用pca方法对像素级融合图像t

p

和超像素级融合图像t

sp

降低数据维度;sadcnn-w/o sa表示不采用空间注意力模块;结果如表2所示。

[0042]

表2:本实施例执行网络(sadcnn)与三种消融实验方法分类结果对比表(%)。

[0043]

参见表2可知,当每类取20个训练样本时,本实施例方法中执行网络(sadcnn)得到的oa值分别比sadcnn-w/o sp、sadcnn-w/o pca和sadcnn-w/o sa提高2.73%、2.44%和0.29%,验证了本实施例方法中执行网络(sadcnn)中各个模块的有效性。

[0044]

为了验证本实施例方法中执行网络(sadcnn)的鲁棒性,设置每类训练样本数n范围为20~100,步长为20进行独立重复试验。为了公平比较,三个评价指标取10次分类结果的平均值。参见图7~图9可知,当每类训练样本数从20增加到100时,本实施例提出的算法与其他高光谱图像分类方法的分类总体精度、卡帕系数和平均精度都随着每训练样本数n的增加而提高。所提出的方法在三个客观指标上都优于hsi-bert、endnet、hrwn、 mdl-rs以及三种消融实验方法sadcnn-w/o sp、sadcnn-w/o pca和sadcnn-w/o sa。特别是当每类训练样本数n较小时,所提出的方法在三种指标上的优势更明显,在解决小样本问题上发展空间更大。

[0045]

此外,本实施例还提供一种遥感高光谱与激光雷达图像融合分类系统,包括相互连接的微处理器和存储器,该微处理器被编程或配置以执行前述遥感高光谱与激光雷达图像融合分类方法的步骤。

[0046]

此外,本实施例还提供一种计算机可读存储介质,该计算机可读存储介质中存储有计算机程序,且该计算机程序用于被计算机设备执行以实施前述遥感高光谱与激光雷达图像融合分类方法的步骤。

[0047]

本领域内的技术人员应明白,本技术的实施例可提供为方法、系统、或计算机程序产品。因此,本技术可采用完全硬件实施例、完全软件实施例、或结合软件和硬件方面的实施例的形式。而且,本技术可采用在一个或多个其中包含有计算机可用程序代码的计算机可读存储介质(包括但不限于磁盘存储器、cd-rom、光学存储器等)上实施的计算机程序产品的形式。本技术是参照根据本技术实施例的方法、设备(系统)、和计算机程序产品的流程图和/或方框图来描述的。应理解可由计算机程序指令实现流程图和/或方框图中的每一流程和/或方框、以及流程图和/或方框图中的流程和/或方框的结合。可提供这些计算机程序指令到通用计算机、专用计算机、嵌入式处理机或其他可编程数据处理设备的处理器以产生一个机器,使得通过计算机或其他可编程数据处理设备的处理器执行的指令产生用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的装置。

这些计算机程序指令也可存储在能引导计算机或其他可编程数据处理设备以特定方式工作的计算机可读存储器中,使得存储在该计算机可读存储器中的指令产生包括指令装置的制造品,该指令装置实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能。这些计算机程序指令也可装载到计算机或其他可编程数据处理设备上,使得在计算机或其他可编程设备上执行一系列操作步骤以产生计算机实现的处理,从而在计算机或其他可编程设备上执行的指令提供用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的步骤。

[0048]

以上所述仅是本发明的优选实施方式,本发明的保护范围并不仅局限于上述实施例,凡属于本发明思路下的技术方案均属于本发明的保护范围。应当指出,对于本技术领域的普通技术人员来说,在不脱离本发明原理前提下的若干改进和润饰,这些改进和润饰也应视为本发明的保护范围。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。