1.至少一个实施例涉及计算资源的分配以使用神经网络执行推理。

背景技术:

2.使用神经网络来执行推理会使用大量的计算资源。为神经网络分配足够量的计算资源以用于执行推理可能是有挑战性的。可改进用于分配计算资源以执行推理的技术。

附图说明

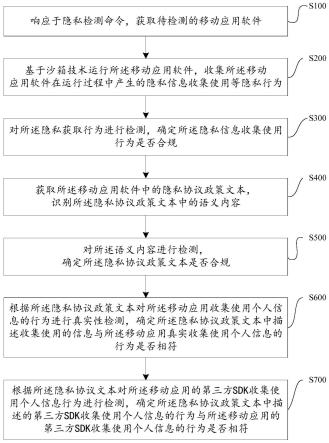

3.图1示出了根据至少一个实施例的用于执行ai辅助的负载平衡的系统的示例;

4.图2示出了根据至少一个实施例的用于获得服务器上的机器学习模型的性能特性的系统的示例;

5.图3示出了根据至少一个实施例的用于预测机器学习模型的性能要求的一个或更多个神经网络的示例;

6.图4示出了根据至少一个实施例的机器学习模型的托管和重新分配的示例;

7.图5示出了根据至少一个实施例的机器学习模型的负载平衡计算的示例;

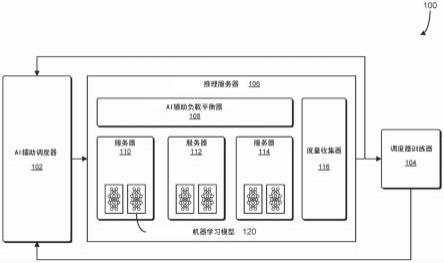

8.图6示出了根据至少一个实施例的用于训练神经网络来预测机器学习模型的资源要求的示例过程;

9.图7示出了根据至少一个实施例的用于平衡多个机器学习模型的计算资源利用率的示例过程;

10.图8示出了根据至少一个实施例的用于分配计算资源以使用机器学习模型来执行推理的示例过程;

11.图9a示出了根据至少一个实施例的推理和/或训练逻辑;

12.图9b示出了根据至少一个实施例的推理和/或训练逻辑;

13.图10示出了根据至少一个实施例的神经网络的训练和部署;

14.图11示出了根据至少一个实施例的示例数据中心系统;

15.图12a示出了根据至少一个实施例的自主车辆的示例;

16.图12b示出了根据至少一个实施例的图12a的自主车辆的相机位置和视野的示例;

17.图12c是根据至少一个实施例的示出图12a的自主车辆的示例系统架构的框图;

18.图12d是根据至少一个实施例的示出用于一个或更多个基于云的服务器与图12a的自主车辆之间进行通信的系统的图;

19.图13是根据至少一个实施例的示出计算机系统的框图;

20.图14是根据至少一个实施例的示出计算机系统的框图;

21.图15示出了根据至少一个实施例的计算机系统;

22.图16示出了根据至少一个实施例的计算机系统;

23.图17a示出了根据至少一个实施例的计算机系统;

24.图17b示出了根据至少一个实施例的计算机系统;

25.图17c示出了根据至少一个实施例的计算机系统;

26.图17d示出了根据至少一个实施例的计算机系统;

27.图17e和图17f示出了根据至少一个实施例的共享编程模型;

28.图18示出了根据至少一个实施例的示例性集成电路和相关的图形处理器;

29.图19a和图19b示出了根据至少一个实施例的示例性集成电路和相关联的图形处理器;

30.图20a和图20b示出了根据至少一个实施例的附加的示例性图形处理器逻辑;

31.图21示出了根据至少一个实施例的计算机系统;

32.图22a示出了根据至少一个实施例的并行处理器;

33.图22b示出了根据至少一个实施例的分区单元;

34.图22c示出了根据至少一个实施例的处理集群;

35.图22d示出了根据至少一个实施例的图形多处理器;

36.图23示出了根据至少一个实施例的多图形处理单元(gpu)系统;

37.图24示出了根据至少一个实施例的图形处理器;

38.图25是根据至少一个实施例的示出用于处理器的处理器微架构的框图;

39.图26示出了根据至少一个实施例的深度学习应用程序处理器;

40.图27是根据至少一个实施例的示出了示例神经形态处理器的框图;

41.图28示出了根据一个或更多个实施例的图形处理器的至少部分;

42.图29示出了根据一个或更多个实施例的图形处理器的至少部分;

43.图30示出了根据一个或更多个实施例的图形处理器的至少部分;

44.图31是根据至少一个实施例的图形处理器的图形处理引擎的框图;

45.图32是根据至少一个实施例的图形处理器核心的至少部分的框图;

46.图33a和图33b示出了根据至少一个实施例的线程执行逻辑,其包括图形处理器核心的处理元件的阵列。

47.图34示出了根据至少一个实施例的并行处理单元(“ppu”);

48.图35示出了根据至少一个实施例的通用处理集群(“gpc”);

49.图36示出了根据至少一个实施例的并行处理单元(“ppu”)的存储器分区单元;

50.图37示出了根据至少一个实施例的流式多处理器;

51.图38是根据至少一个实施例的高级计算管线的示例数据流图;

52.图39是根据至少一个实施例的用于在高级计算管线中训练、适应、实例化和部署机器学习模型的示例系统的系统图;

53.图40包括根据至少一个实施例的用于处理成像数据的高级计算管线的示例图示;

54.图41a包括根据至少一个实施例的支持超声设备的虚拟仪器的示例数据流图;

55.图41b包括根据至少一个实施例的支持ct扫描仪的虚拟仪器的示例数据流图;

56.图42a示出了根据至少一个实施例的用于训练机器学习模型的过程的数据流图;以及

57.图42b是根据至少一个实施例的利用预训练的注释模型来增强注释工具的客户端-服务器架构的示例图示。

具体实施方式

58.图1示出了根据至少一个实施例的用于执行与机器学习模型相关的ai辅助的负载平衡和工作量调度的系统的示例。在至少一个实施例中,示例系统100包括推理服务器106,具体地包括服务器110-114,所述推理服务器106执行与一个或更多个机器学习模型120的训练和使用有关的推理操作。

59.在至少一个实施例中,机器学习模型包括用于实现多种机器学习和人工智能技术中的任何一种的软件或数据。在至少一个实施例中,机器学习模型包括这样的数据:该数据可以包括但不限于权重、偏差、参数、元参数、超参数、网络定义和图定义。在至少一个实施例中,通过机器学习模型实现的技术包括神经网络、线性回归、决策树、随机森林、基因算法、维度减少算法、受监督学习、无监督学习和增强学习中的一个或更多个。

60.在至少一个实施例中,服务器110-114各自托管一个或更多个机器学习模型。在至少一个实施例中,机器学习模型的托管指的是提供用于训练机器学习模型或使用机器学习模型来执行推理操作的资源。在至少一个实施例中,服务器110-114各自包括至少一个处理器和用于存储处理器可执行指令的至少一个存储器。在至少一个实施例中,服务器110-114各自包括或连接至存储设备,该存储设备包含与机器学习模型相关的数据,如权重、偏差、参数等。

61.在至少一个实施例中,服务器110托管多个机器学习模型120,每个机器学习模型消耗由托管服务器110提供的不同且变化的计算资源量。在至少一个实施例中,不同的机器学习模型可能消耗不同组合的计算资源,并且有时可能竞争计算资源。例如,在至少一个实施例中,第一机器学习模型可以广泛地利用服务器110的并行处理单元,并且如果同样由所述服务器110托管的第二机器学习模型也广泛地利用该服务器的并行处理能力,则第一机器学习模型与该第二机器学习模型竞争,并且由此降低了一个或者两个机器学习模型的性能特性。

62.在至少一个实施例中,ai辅助调度器102、ai辅助负载平衡器108、度量收集器116和调度器训练器104各自是系统100的组件。在至少一个实施例中,这些组件各自包括计算系统,所述计算系统具有至少一个处理器和用于存储指令的存储器,所述指令在由所述至少一个处理器执行时使所述计算系统执行与所述组件相关描述的功能。

63.在至少一个实施例中,机器学习模型120的性能通过服务器110-114之间的负载平衡而增强。在至少一个实施例中,负载平衡包括将与不同机器学习模型120相关联的工作量分布在服务器110-114之间。例如,在至少一个实施例中,可使机器学习模型m1在可用服务器110-114中的任一个上执行推理,并且ai辅助负载平衡器108可采用各种负载平衡技术中的任一个来在可用服务器110-114之间更均匀地分布计算资源利用率。在至少一个实施例中,这些包括基于监控服务器110-114的计算资源利用率并且将工作分配给具有相对低利用率的服务器的技术、循环技术等。在至少一个实施例中,这些技术由预测给定模型m1在服务器上的放置方面的预测技术来替代或补充。在至少一个实施例中,所述预测技术预测给定模型m1在特定服务器s1上的放置方面。在至少一个实施例中,一个或更多个神经网络被训练成考虑模型m1在特定服务器s1上的过去的性能方面来预测所述模型m1在所述服务器s1上的性能方面。在至少一个实施例中,所述神经网络由ai辅助调度器维护。

64.在至少一个实施例中,度量收集器116收集指示由服务器110-114上的模型120所

利用的计算能力的度量,其中所述度量可以包括在每个模型的范围上考虑的cpu利用率、gpu利用率、存储器消耗等。在至少一个实施例中,这允许考虑特定模型的性能特性,而不是作为整体的服务器的性能特性。在至少一个实施例中,度量收集器116还收集关于作为整体的每个服务器的计算能力利用率度量。

65.在至少一个实施例中,ai辅助调度器102维护被训练成预测机器学习模型120的性能特性的一个或更多个神经网络。在至少一个实施例中,一个或更多个神经网络被训练成考虑模型m1在特定服务器s1上的过去的性能特性来预测所述模型m1在所述服务器s1上的性能。在至少一个实施例中,对所述一个或更多个神经网络的输入包括模型m1的身份的表示和服务器s1的身份的表示。在至少一个实施例中,所述一个或更多个神经网络基于所述输入来预测所述模型m1在服务器s1上的一个或更多个性能特性。在至少一个实施例中,这些预测至少部分地基于由度量收集器116在连续或正在进行的基础上收集的信息,并且由调度器训练器104应用于一个或更多个神经网络。

66.在至少一个实施例中,ai辅助调度器采用基于规则的方法来确定用于机器学习模型的托管和调度决策。在至少一个实施例中,来自所述一个或更多个神经网络的预测影响所述规则的应用。例如,在至少一个实施例中,模型m1的高ppu或gpu利用率的预测可能使调度器102指示模型m1由服务器110-114中的具有低ppu或gpu利用率的一个托管。类似地,在至少一个实施例中,低ppu或gpu利用率的预测可能使调度器102指示模型m1由服务器110-114中的具有低cpu利用率的一个托管,即使ppu或gpu利用率在该服务器上高。在至少一个实施例中,所述预测还可以表示机器学习模型m1在最近历史中在服务器s1上表现不佳,而致使此模型由另一个服务器s2托管。

67.在至少一个实施例中,调度器训练器104将如由ai辅助调度器102的一个或更多个神经网络所预测的性能特性与由度量收集器116在服务器110-114上观察到的性能特性进行比较。在至少一个实施例中,预测的特性和观察的特性之间的差异用于训练或细化所述一个或更多个神经网络的训练。在至少一个实施例中,所述训练或细化持续进行,并且可以随着由任何一个服务器执行的工作量随着时间变化而随着时间发生。例如,最初,服务器s1可以执行与机器学习模型m1和m2相关的工作。在至少一个实施例中,所述一个或更多个神经网络可能因此被训练为预测在模型m2的工作也正在服务器s1上执行的时候m1在服务器s1上的性能特性。在至少一个实施例中,这意味着,所述一个或更多个神经网络关于模型m1的性能的预测是考虑了在服务器s1上正执行的m2的影响而做出的。在至少一个实施例中,随着时间另一模型m3的工作也在s1上执行。在至少一个实施例中,鉴于可能由托管机器学习模型m3引起的对性能的新影响,所述一个或更多个神经网络的连续或正在进行的训练使得其预测变得更准确。

68.在至少一个实施例中,ai辅助调度器102与基于模型的负载平衡器组合。在至少一个实施例中,上文描述的如由ai辅助调度器102执行的功能由部件的组合执行,诸如用于分析和预测机器学习模型的性能特性的模型分析器以及用于与ai辅助负载平衡器108协作调度服务器110-114上的机器学习模型的托管或执行的调度器部件。在至少一个实施例中,归属于所描绘的ai辅助调度器102、ai辅助负载平衡器108、度量收集器116和调度器训练器104的功能被组合或重新组合到部件的其他组合中。

69.图2示出了根据至少一个实施例的用于获得服务器上的机器学习模型的性能特性

的系统的示例。在至少一个实施例中,系统的示例200包括服务器s

1 210和度量收集器216,其可分别对应于如图1所描绘的服务器s

1 110和度量收集器116。在至少一个实施例中,服务器s

1 210托管多个机器学习模型220,出于说明的目的,这些机器学习模型可以被指定为m1和m2。

70.在至少一个实施例中,机器学习模型在服务器210上执行学习或推理任务。在至少一个实施例中,所述任务经由应用编程接口(“api”)启动。在至少一个实施例中,所述api由系统(诸如图1所示的系统100)的客户端调用或代表所述系统的客户端被调用,所述系统提供被托管机器学习能力。在至少一个实施例中,所述api包括用于收集和提供特定模型(例如m1,如在服务器s

1 210上的该模型执行任务期间所观察到的)的性能度量的功能的实现。

71.在至少一个实施例中,度量是测量或以其他方式反映状态或状况的值或一系列值。在至少一个实施例中,这些状态或状况包括cpu利用率、gpu利用率、存储器利用率、存储消耗、网络带宽消耗、吞吐量等中的一个或更多个。应当理解,这些示例旨在是说明性的,并且因此不应当以将潜在实施例的范围仅限于包括这些示例的那些实施例的方式来解释。

72.在至少一个实施例中,从服务器s

1 210获得度量。在至少一个实施例中,所述度量中的至少一些度量是经由实现涉及由服务器s

1 210托管的模型的训练或推理操作的api来获得的。在至少一个实施例中,所述度量中的至少一些度量经由其他编程接口(诸如操作系统api)获得,所述其他编程接口允许测量与可能在服务器s

1 210上执行的各种过程、服务等有关的度量。在至少一个实施例中,关于特定模型的度量可以是经由这样的过程或服务的观察而能获得的。在至少一个实施例中,获得关于作为整体的服务器s

1 210的度量。

73.在至少一个实施例中,当模型m1正在服务器s

1 210上执行时,模型m1度量202包括指示与模型m1相关的度量的数据。在至少一个实施例中,这些度量包括指示cpu利用率、gpu利用率和存储器利用率的值。应当理解,这些示例旨在是说明性的,并且因此不应当以将潜在实施例的范围仅限于包括这些示例的那些实施例的方式来解释。在至少一个实施例中,度量202经由网络连接从服务器s

1 210发送到度量收集器216。在至少一个实施例中,用于对模型m1执行训练或推理操作的api将周期性地使度量202被周期性地发送到度量收集器216。在至少一个实施例中,度量收集器216调用服务器s

1 210上的api,以便使所述度量从服务器s

1 210发送到度量收集器216。

74.在至少一个实施例中,模型m2度量204包括类似于模型m1度量202的那些但与第二模型m2有关的度量。

75.在至少一个实施例中,附加模型(如机器学习模型m3)被添加到服务器s1。在至少一个实施例中,当服务器s

1 210开始执行与模型m3相关的工作时,度量收集器216开始收集关于模型m3的度量数据。在至少一个实施例中,在一些情况下,由于诸如模型m1、m2和m3与服务器s1之间的新交互的因素,执行所述工作可使模型m1和m2的性能特性被改变。

76.图3示出了根据至少一个实施例的用于预测机器学习模型的性能要求的一个或更多个神经网络的示例。在至少一个实施例中,预测器的示例300包括与模型m1预测器302、模型m2预测器304以及模型m3预测器306对应的一个或更多个神经网络。在至少一个实施例中,所述一个或更多个神经网络是卷积神经网络、前馈神经网络、多层感知器神经网络、深度学习神经网络、模块化神经网络、递归神经网络、长短期记忆网络、自动编码器等中的一个或更多个。在至少一个实施例中,代替神经网络或除了神经网络之外,另一个机器学习模型用

于模型预测器302-206。

77.在至少一个实施例中,模型m1预测器302的输入310包括服务器标识符310,并且输出320包括一个或更多个预测的性能特性320。在至少一个实施例中,属于另外的模型m2和m3的另外的预测器304、306包括相似的输入和输出。在至少一个实施例中,预测器302-306被组合成也采用模型标识符作为输入的单个预测器。

78.在至少一个实施例中,所预测的性能特性320-324包括指示在给定输入服务器的情况下特定模型将如何执行的预测的数据。在至少一个实施例中,合适的值包括可以用于衡量机器学习模型的相对性能的任何值。此类值的示例可以包括吞吐量、cpu利用率、gpu利用率、指示预期性能的分数、指示预期性能的字母等级(例如,“a”至“f”)等的预测。

79.图4示出了根据至少一个实施例的学习模型的托管和重新分配的示例。在至少一个实施例中,服务器410-414分别被认为通过执行与所述模型相关的训练任务、通过执行与所述模型相关的推理或分类任务、或者通过以其他方式分配或使用与所述模型相关的计算资源来托管机器学习模型。

80.在至少一个实施例中,ai辅助调度器402维护用于预测服务器410-414上的机器学习模型的性能特性的一个或更多个预测器430-434。在至少一个实施例中,ai辅助调度器402、预测器430-434和服务器410对应于图1-3中描述的调度器、预测器和服务器。

81.在至少一个实施例中,ai辅助调度器402使用预测器430-434来预测在服务器410-414上托管的机器学习模型的未来性能。在至少一个实施例中,ai辅助调度器402预测机器学习模型420的未来性能,并且至少部分地基于该预测而确定与机器学习模型420相关的操作应当改为在另一个服务器414上执行。

82.在至少一个实施例中,将机器学习模型420的托管重新分配给不同服务器414的确定,是至少部分地基于模型420在其当前服务器410上表现不佳的预测。

83.在至少一个实施例中,将机器学习模型420的托管重新分配给不同的服务器414的确定,是至少部分地基于对模型420要使用的计算能力的预测、以及这个预测的能力量将超过当前服务器414的能力的确定。

84.在至少一个实施例中,将机器学习模型420的托管重新分配给不同的服务器414的确定,是至少部分地基于对模型420要使用的计算能力的预测,以及用于确定哪个可用服务器420最适合于托管模型420的一个或更多个规则的应用。

85.在至少一个实施例中,托管责任的分配包括对与模型420相关联的数据的存储容量的分派,如权重、偏差、参数等。

86.在至少一个实施例中,托管责任的分配包括使与模型420相关的操作能够在服务器410、414上执行。例如,在至少一个实施例中,托管责任的分配包括使服务器414存储定义模型420的数据,或者使服务器414将模型420加载到存储器中。

87.在至少一个实施例中,托管责任的分配包括使与模型420相关的操作由服务器414执行。例如,在至少一个实施例中,可以指示服务器414执行使用模型420完成推理所必需的那些计算中的一些或全部。

88.在至少一个实施例中,ai辅助调度器402调度使用机器学习模型402完成训练或推理任务的操作的执行。例如,在至少一个实施例中,调度器402使用预测器430-434来确定哪些服务器被预测为有效地执行与模型420相关联的那些操作中的一些或全部,并且随后使

那些服务器各自执行那些操作中的一些或全部。

89.在至少一个实施例中,ai辅助调度器402与负载平衡器结合或组合进行工作以执行各种不同的负载平衡功能。图5示出了根据至少一个实施例的机器学习模型的负载平衡计算的示例。

90.在至少一个实施例中,根据所描绘的示例500,ai辅助负载平衡器508接收源自预测器532-534并且包括服务器510-514中的单独服务器上的模型性能的预测的输入。在至少一个实施例中,预测器530-534用于预测资源r1针对具有要执行的操作的所有机器学习模型的资源利用率,并且ai辅助负载平衡器508在服务器510-514之间分配操作,使得r1的总利用率低于某个阈值。在至少一个实施例中,预测器530-534预测多个资源r1…rn

的利用率,并且ai辅助负载平衡器508分配操作,使得对于任何单独的服务器510-514,资源r1…rn

的总利用率分别、单独地低于某个阈值。

91.图6示出了根据至少一个实施例的用于训练神经网络来预测机器学习模型的资源要求的示例过程。尽管示例过程600被描绘为操作序列,但是将理解,在各实施例中,所描绘的操作可以各种方式被改变,并且一些操作可以被省略、重新排序或与其他操作并行地执行,除非顺序被明确地陈述或逻辑地暗示,诸如当来自一个操作的输入取决于另一操作的输出时。在至少一个实施例中,示例程序600由图1中描绘的系统的组件执行。

92.在602处,在至少一个实施例中,系统预测要在服务器s1上执行的机器学习模型m1的操作的性能。在604处,在至少一个实施例中,该系统在服务器s1上执行机器学习模型m1的操作。

93.在606处,在至少一个实施例中,如关于示例过程600的元素606所描述的,该系统获得针对在服务器s1上执行的m1的操作的性能度量。

94.在608处,在至少一个实施例中,计算预测的性能度量与所获得的性能度量之间的差异,以便获得用于训练一个或更多个神经网络来预测这些度量的误差信号。在610处,在至少一个实施例中,基于此误差信号对所述一个或更多个神经网络进行训练。

95.在至少一个实施例中,如示例过程600的元素612所描绘的,当在系统100的服务器上执行与不同机器学习模型相关联的操作时,元素602-610所描绘的操作无限地继续。

96.图7示出了根据至少一个实施例的用于促进多个机器学习模型的平衡资源利用率的示例过程。尽管示例过程700被描绘为操作序列,但是将理解,在各实施例中,所描绘的操作可以不同方式被改变,并且一些操作可以被省略、重新排序或与其他操作并行地执行,除非顺序被明确地陈述或逻辑地暗示,诸如当来自一个操作的输入取决于另一操作的输出时。在至少一个实施例中,示例过程700由图1中描绘的系统的组件执行。

97.在702处,在至少一个实施例中,系统在所分配的服务器上执行机器学习模型。在至少一个实施例中,机器学习模型的执行包括使用该模型来执行推理。在至少一个实施例中,在训练和操作阶段两者中使用推理。

98.在704处,在至少一个实施例中,收集度量,其中,所述度量指示由机器学习模型用来执行推理的计算资源利用率。在至少一个实施例中,这些度量被存储或分布以用于训练一个或更多个神经网络来预测机器学习模型的资源利用率。在至少一个实施例中,在每个服务器上为每个模型保持不同的度量,使得神经网络的训练能够基于包括模型和可用于执行该模型的计算资源的输入来预测性能要求。

99.在706处,在至少一个实施例中,训练神经网络来预测所述机器学习模型的计算资源利用率。在至少一个实施例中,该神经网络被训练来针对机器学习模型和可用于执行该机器学习模型的计算资源的给定组合来预测计算资源利用率。

100.在708处,在至少一个实施例中,预测机器学习模型的资源利用率,并且分析可用服务器的容量。在至少一个实施例中,对候选服务器(或其他计算资源)和模型的每个组合做出预测。在至少一个实施例中,该信息用于选择模型与候选服务器的适当分配。在至少一个实施例中,适当的分配包括尝试使任何可用容量(诸如cpu利用率或存储器)将耗尽的可能性最小化。

101.在710处,在至少一个实施例中,系统100将机器学习模型重新分配给另一个系统。在至少一个实施例中,这是出于诸如关于元素708所描述的那些原因而进行的。

102.在至少一个实施例中,如示例过程700的元素712所描绘的,当在系统100的服务器上执行与各种机器学习模型相关联的操作时,元素702-710所描绘的操作无限期地继续。在至少一个实施例中,随着周期性重新分配的进行,此过程的重复促进基于在共享资源上执行的过去组合模型的预测,且使用这些预测可有助于避免导致不利组合的分配。

103.图8示出了根据至少一个实施例的用于分配使用机器学习模型来执行推理的计算资源的示例过程。尽管示例过程800被描绘为操作序列,但是将理解,在各实施例中,所描绘的操作可以不同方式被改变,并且一些操作可以被省略、重新排序或与其他操作并行地执行,除非顺序被明确地陈述或逻辑地暗示,诸如当来自一个操作的输入取决于另一操作的输出时。在至少一个实施例中,示例过程800由图1中描绘的系统的组件执行。

104.在802处,在至少一个实施例中,系统训练第一一个或更多个神经网络来预测第二一个或更多个神经网络或其他机器学习模型的性能要求。

105.在至少一个实施例中,性能要求的预测包括:在给定计算资源的情况下,如果该资源将用于使用该机器学习模型来执行推理操作,对将被使用的计算能力的预测。

106.在804处,在至少一个实施例中,系统确定用于执行所述第二一个或更多个神经网络的推理操作的计算资源。在至少一个实施例中,评估相对于候选计算资源作出的预测,并且使用此信息来确定合适的资源以用给定的机器学习模型来执行推理操作。

107.在806处,在至少一个实施例中,系统测量第二一个或更多个神经网络对它们所确定的计算资源的资源要求。在至少一个实施例中,使用这些机器学习模型来执行推理操作,并且指示它们执行的情况以及它们使用的资源的度量被收集。在至少一个实施例中,在后续迭代中使用此信息以细化所述系统的预测能力。

108.在至少一个实施例中,如图8中由元素808所描绘的,在正在进行的基础上重复此过程。在至少一个实施例中,这导致随时间训练所述一个或更多个神经网络来预测给定的机器学习模型将使用每个计算资源执行的情况。在至少一个实施例中,这些预测还将反映资源分配的最近组合,使得由不同机器学习模型之间的交互引起的影响反映在资源要求预测中。

109.在至少一个实施例中,一种处理器包括电路,所述电路用于使用第一一个或更多个神经网络来使计算资源至少部分地基于第二一个或更多个神经网络的性能要求而被确定。

110.在至少一个实施例中,计算资源包括服务器或其他类型的计算设备。在至少一个

实施例中,计算资源包括硬件组件,例如gpu、ppu、微控制器等。

111.在至少一个实施例中,性能要求包括计算能力的一个或更多个元素,如可能由诸如处理器利用率、存储器利用率、网络带宽消耗、吞吐量等的度量反映。

112.在至少一个实施例中,对计算资源的确定包括选择该计算资源用于执行神经网络或其他机器学习模型的推理操作。在至少一个实施例中,这些计算资源中的被确定的计算资源执行第二一个或更多个神经网络的推理操作。

113.在至少一个实施例中,训练第一一个或更多个神经网络来预测第二一个或更多个神经网络的资源要求。在至少一个实施例中,所述预测是鉴于第二一个或更多个神经网络的操作将通过特定计算资源执行的假设而做出的。在至少一个实施例中,该预测可因此基于假设哪个计算资源而变化。在至少一个实施例中,提供资源的标识符作为所述第一一个或更多个神经网络的输入。在至少一个实施例中,针对每个候选计算资源进行预测。在至少一个实施例中,处理器的一个或更多个电路使用第一一个或更多个神经网络来预测第二一个或更多个神经网络的性能要求,以便于在这些计算资源的候选计算资源上执行推理操作。

114.在至少一个实施例中,处理器的一个或更多个电路训练第一一个或更多个神经网络来预测第二一个或更多个神经网络或其他机器学习模型的资源要求。在至少一个实施例中,该训练根据被确定来执行第二一个或更多个神经网络的推理操作的计算资源的变化而发生。在至少一个实施例中,训练周期性地发生,以便反映这样的变化。在至少一个实施例中,正在进行的训练使第一一个或更多个神经网络学习预测第二一个或更多个神经网络对先前已经被分配来使用第二一个或更多个神经网络执行推理操作的多个计算资源中的每一个计算资源的计算资源要求。

115.在至少一个实施例中,通过使用应用编程接口的度量收集来促进对第一一个或更多个神经网络的训练以预测第二一个或更多个神经网络的资源要求。在至少一个实施例中,应用编程接口提供指示第二一个或更多个神经网络的推理操作的计算资源要求的一个或更多个度量。

116.推理和训练逻辑

117.图9a示出了用于执行与一个或更多个实施例相关联的推理和/或训练操作的推理和/或训练逻辑915。下面结合图9a和/或图9b提供关于推理和/或训练逻辑915的细节。

118.在至少一个实施例中,推理和/或训练逻辑915可以包括但不限于代码和/或数据存储901,用于存储前向和/或输出权重和/或输入/输出数据,和/或在一个或更多个实施例的方面中配置被训练为和/或用于推理的神经网络的神经元或层的其他参数。在至少一个实施例中,训练逻辑915可以包括或耦合到用于存储图形代码或其他软件以控制时序和/或顺序的代码和/或数据存储901,其中权重和/或其他参数信息被加载以配置逻辑,包括整数和/或浮点单元(统称为算术逻辑单元(alu))。在至少一个实施例中,代码(诸如图代码)基于该代码所对应的神经网络的架构将权重或其他参数信息加载到处理器alu中。在至少一个实施例中,代码和/或数据存储901存储在使用一个或更多个实施例的方面训练和/或推理期间的输入/输出数据和/或权重参数的前向传播期间结合一个或更多个实施例训练或使用的神经网络的每个层的权重参数和/或输入/输出数据。在至少一个实施例中,代码和/或数据存储901的任何部分都可以包括在其他片上或片外数据存储内,包括处理器的l1、l2

或l3高速缓存或系统存储器。

119.在至少一个实施例中,代码和/或数据存储901的任何部分可以在一个或更多个处理器或其他硬件逻辑设备或电路的内部或外部。在至少一个实施例中,代码和/或数据存储901可以是高速缓存存储器、动态随机可寻址存储器(“dram”)、静态随机可寻址存储器(“sram”)、非易失性存储器(例如闪存)或其他存储。在至少一个实施例中,对代码和/或数据存储901是在处理器的内部还是外部的选择,例如,或者由dram、sram、闪存或某种其他存储类型组成,可以取决于存储片上或片外的可用存储空间,正在执行训练和/或推理功能的延迟要求,在神经网络的推理和/或训练中使用的数据的批大小或这些因素的某种组合。

120.在至少一个实施例中,推理和/或训练逻辑915可以包括但不限于代码和/或数据存储905,以存储与在一个或更多个实施例的方面中被训练为和/或用于推理的神经网络的神经元或层相对应的反向和/或输出权重和/或输入/输出数据神经网络。在至少一个实施例中,在使用一个或更多个实施例的方面训练和/或推理期间,代码和/或数据存储905存储在输入/输出数据和/或权重参数的反向传播期间结合一个或更多个实施例训练或使用的神经网络的每个层的权重参数和/或输入/输出数据。在至少一个实施例中,训练逻辑915可以包括或耦合到用于存储图代码或其他软件以控制时序和/或顺序的代码和/或数据存储905,其中权重和/或其他参数信息被加载以配置逻辑,该逻辑包括整数和/或浮点单元(统称为算术逻辑单元(alu))。

121.在至少一个实施例中,代码(诸如图代码)使得基于该代码所对应的神经网络的架构将权重或其他参数信息加载到处理器alu中。在至少一个实施例中,代码和/或数据存储905的任何部分可以与其他片上或片外数据存储一起包括,包括处理器的l1、l2或l3高速缓存或系统存储器。在至少一个实施例中,代码和/或数据存储905的任何部分可以在一个或更多个处理器或其他硬件逻辑设备或电路上的内部或外部。在至少一个实施例中,代码和/或数据存储905可以是高速缓存存储器、dram、sram、非易失性存储器(例如闪存)或其他存储。在至少一个实施例中,代码和/或数据存储905是在处理器的内部还是外部的选择,例如,是由dram、sram、闪存还是其他某种存储类型组成,取决于可用存储是片上还是片外,正在执行的训练和/或推理功能的延迟要求,在神经网络的推理和/或训练中使用的数据批量大小或这些因素的某种组合。

122.在至少一个实施例中,代码和/或数据存储901以及代码和/或数据存储905可以是分开的存储结构。在至少一个实施例中,代码和/或数据存储901以及代码和/或数据存储905可以是相同的存储结构。在至少一个实施例中,代码和/或数据存储901以及代码和/或数据存储905可以部分地被组合和部分分离。在至少一个实施例中,代码和/或数据存储901以及代码和/或数据存储905的任何部分可以与其他片上或片外数据存储包括在一起,包括处理器的l1、l2或l3高速缓存或系统存储器。

123.在至少一个实施例中,推理和/或训练逻辑915可以包括但不限于一个或更多个算术逻辑单元(“alu”)910(包括整数和/或浮点单元),用于至少部分地基于训练和/或推理代码(例如,图代码)或由其指示来执行逻辑和/或数学运算,其结果可能会产生存储在激活存储920中的激活(例如,来自神经网络内部的层或神经元的输出值),其是存储在代码和/或数据存储901和/或代码和/或数据存储905中的输入/输出和/或权重参数数据的函数。在至少一个实施例中,激活响应于执行指令或其他代码,由alu 910执行的线性代数和/或基于

矩阵的数学生成在激活存储920中存储的激活,其中存储在代码和/或数据存储905中和/或代码和/或数据存储901中的权重值用作具有其他值的操作数,例如偏置值、梯度信息、动量值或其他参数或超参数,可以将任何或所有这些存储在代码和/或数据存储905或代码和/或数据存储901或其他片上或片外存储中。

124.在至少一个实施例中,一个或更多个处理器或其他硬件逻辑设备或电路中包括一个或更多个alu 910,而在另一实施例中,一个或更多个alu 910可以在处理器或其他硬件逻辑设备或使用它们(例如协处理器)的电路外。在至少一个实施例中,可以将一个或更多个alu 910包括在处理器的执行单元之内,或者以其他方式包括在由处理器的执行单元可访问的alu组中,该处理器的执行单元可以在同一处理器内或者分布在不同类型的不同处理器之间(例如,中央处理单元、图形处理单元、固定功能单元等)。在至少一个实施例中,代码和/或数据存储901、代码和/或数据存储905以及激活存储920可以共享处理器或其他硬件逻辑设备或电路,而在另一实施例中,它们可以在不同的处理器或其他硬件逻辑设备或电路或相同和不同处理器或其他硬件逻辑设备或电路的某种组合中。在至少一个实施例中,激活存储920的任何部分可以与其他片上或片外数据存储包括在一起,包括处理器的l1、l2或l3高速缓存或系统存储器。此外,推理和/或训练代码可以与处理器或其他硬件逻辑或电路可访问的其他代码一起存储,并可以使用处理器的提取、解码、调度、执行、退出和/或其他逻辑电路来提取和/或处理。

125.在至少一个实施例中,激活存储920可以是高速缓存存储器、dram、sram、非易失性存储器(例如,闪存)或其他存储。在至少一个实施例中,激活存储920可以完全地或部分地在一个或更多个处理器或其他逻辑电路内部或外部。在至少一个实施例中,可以取决于片上或片外可用的存储,进行训练和/或推理功能的延迟要求,在推理和/或训练神经网络中使用的数据的批量大小或这些因素的某种组合,选择激活存储920是处理器的内部还是外部,例如,或者包含dram、sram、闪存或其他存储类型。

126.在至少一个实施例中,图9a中所示的推理和/或训练逻辑915可以与专用集成电路(“asic”)结合使用,例如来自google的处理单元、来自graphcore

tm

的推理处理单元(ipu)或来自intel corp的(例如“lake crest”)处理器。在至少一个实施例中,图9a所示的推理和/或训练逻辑915可与中央处理单元(“cpu”)硬件,图形处理单元(“gpu”)硬件或其他硬件(例如现场可编程门阵列(“fpga”))结合使用。

127.图9b示出了根据至少一个实施例的推理和/或训练逻辑915。在至少一个实施例中,推理和/或训练逻辑915可以包括但不限于硬件逻辑,其中计算资源被专用或以其他方式唯一地连同对应于神经网络内的一层或更多层神经元的权重值或其他信息一起使用。在至少一个实施例中,图9b中所示的推理和/或训练逻辑915可以与专用集成电路(asic)结合使用,例如来自google的处理单元,来自graphcore

tm

的推理处理单元(ipu)或来自intel corp的(例如“lake crest”)处理器。在至少一个实施例中,图9b中所示的推理和/或训练逻辑915可以与中央处理单元(cpu)硬件、图形处理单元(gpu)硬件或其他硬件(例如现场可编程门阵列(fpga))结合使用。在至少一个实施例中,推理和/或训练逻辑915包括但不限于代码和/或数据存储901以及代码和/或数据存储905,其可以用于存储代码(例如,图代码)、权重值和/或其他信息,包括偏置值、梯度信息、动量值和/或其他参数或超参数信息。在图9b中所示的至少一个实施例中,代码和/或数据存储901以及代码

和/或数据存储905中的每一个都分别与专用计算资源(例如计算硬件902和计算硬件906)相关联。在至少一个实施例中,计算硬件902和计算硬件906中的每一个包括一个或更多个alu,这些alu仅分别对存储在代码和/或数据存储901和代码和/或数据存储905中的信息执行数学函数(例如线性代数函数),执行函数的结果被存储在激活存储920中。

128.在至少一个实施例中,代码和/或数据存储901和905以及相应的计算硬件902和906中的每一个分别对应于神经网络的不同层,使得从代码和/或数据存储901和计算硬件902的一个“存储/计算对901/902”得到的激活提供作为代码和/或数据存储905和计算硬件906的下一个“存储/计算对905/906”的输入,以便反映神经网络的概念组织。在至少一个实施例中,每个存储/计算对901/902和905/906可以对应于一个以上的神经网络层。在至少一个实施例中,在推理和/或训练逻辑915中可以包括在存储计算对901/902和905/906之后或与之并行的附加存储/计算对(未示出)。

129.神经网络训练和部署

130.图10示出了根据至少一个实施例的深度神经网络的训练和部署。在至少一个实施例中,使用训练数据集1002来训练未经训练的神经网络1006。在至少一个实施例中,训练框架1004是pytorch框架,而在其他实施例中,训练框架1004是tensorflow,boost,caffe,microsoft cognitive toolkit/cntk,mxnet,chainer,keras,deeplearning4j或其他训练框架。在至少一个实施例中,训练框架1004训练未经训练的神经网络1006,并使它能够使用本文所述的处理资源来训练,以生成经训练的神经网络1008。在至少一个实施例中,权重可以被随机选择或通过使用深度信念网络预训练。在至少一个实施例中,可以以有监督、部分有监督或无监督的方式执行训练。

131.在至少一个实施例中,使用有监督学习来训练未经训练的神经网络1006,其中训练数据集1002包括与用于输入的期望输出配对的输入,或者其中训练数据集1002包括具有已知输出的输入和神经网络1006是手动层次的输出。在至少一个实施例中,以有监督的方式来训练未经训练的神经网络1006,并且处理来自训练数据集1002的输入,并将结果输出与一组期望或想要的输出进行比较。在至少一个实施例中,然后通过未经训练的神经网络1006将误差传播回去。在至少一个实施例中,训练框架1004调整控制未经训练的神经网络1006的权重。在至少一个实施例中,训练框架1004包括用于监视未经训练的神经网络1006向模型(例如,经训练的神经网络1008)收敛的程度的工具,适于基于输入数据(例如新数据集1012)生成正确答案(例如结果1014)的模型。在至少一个实施例中,训练框架1004反复训练未经训练的神经网络1006,同时调整权重以使用损失函数和调整算法(例如随机梯度下降)来改善未经训练的神经网络1006的输出。在至少一个实施例中,训练框架1004训练未经训练的神经网络1006,直到未经训练的神经网络1006达到期望的精度为止。在至少一个实施例中,然后可以部署经训练的神经网络1008以实现任何数量的机器学习操作。

132.在至少一个实施例中,使用无监督学习来训练未经训练的神经网络1006,其中未经训练的神经网络1006尝试使用未标记的数据来训练自己。在至少一个实施例中,无监督学习训练数据集1002将包括输入数据,而没有任何关联的输出数据或“地面实况”数据。在至少一个实施例中,未经训练的神经网络1006可以学习训练数据集1002内的分组,并且可以确定各个输入如何与未经训练的数据集1002相关。在至少一个实施例中,可以使用无监督训练来在经训练的神经网络1008中生成自组织图,其能够执行对减少新数据集1012的维

度有用的操作。在至少一个实施例中,无监督训练也可以用于执行异常检测,这允许识别新数据集1012中偏离新数据集1012的正常模式的数据点。

133.在至少一个实施例中,可以使用半监督学习,这是一种技术,其中在训练数据集1002中包括标记数据和未标记数据的混合。在至少一个实施例中,训练框架1004可以用于例如通过转移的学习技术来执行递增学习。在至少一个实施例中,递增学习使得经训练的神经网络1008能够适应新数据集1012,而不会忘记在初始训练期间注入到经训练的神经网络1008内的知识。

134.数据中心

135.图11示出了可以使用至少一个实施例的示例数据中心1100。在至少一个实施例中,数据中心1100包括数据中心基础设施层1110、框架层1120、软件层1130和应用程序层1140。

136.在至少一个实施例中,如图11所示,数据中心基础设施层1110可以包括资源协调器1112、分组计算资源1114和节点计算资源(“节点c.r.”)1116(1)-1116(n),其中“n”代表正整数(其可以是与其他图中使用的整数不同的整数“n”)。在至少一个实施例中,节点c.r.1116(1)-1116(n)可以包括但不限于任何数量的中央处理单元(“cpu”)或其他处理器(包括加速器、现场可编程门阵列(fpga)、图形处理器等),存储器存储设备1118(1)-1118(n)(例如动态只读存储器、固态硬盘或磁盘驱动器),网络输入/输出(“nw i/o”)设备,网络交换机,虚拟机(“vm”),电源模块和冷却模块等。在至少一个实施例中,节点c.r.1116(1)-1116(n)中的一个或更多个节点c.r.可以是具有一个或更多个上述计算资源的服务器。

137.在至少一个实施例中,分组计算资源1114可以包括容纳在一个或更多个机架内的节点c.r.的单独分组(未示出),或者容纳在各个地理位置的数据中心内的许多机架(也未示出)。在至少一个实施例中,分组的计算资源1114内的节点c.r.的单独分组可以包括可以被配置或分配为支持一个或更多个工作负载的分组的计算、网络、存储器或存储资源。在至少一个实施例中,可以将包括cpu或处理器的几个节点c.r.分组在一个或更多个机架内,以提供计算资源来支持一个或更多个工作负载。在至少一个实施例中,一个或更多个机架还可以包括任何数量的电源模块、冷却模块和网络交换机,以任意组合。

138.在至少一个实施例中,资源协调器1112可以配置或以其他方式控制一个或更多个节点c.r.1116(1)-1116(n)和/或分组的计算资源1114。在至少一个实施例中,资源协调器1112可以包括用于数据中心1100的软件设计基础结构(“sdi”)管理实体。在至少一个实施例中,资源协调器912可以包括硬件、软件或其某种组合。

139.在至少一个实施例中,如图11所示,框架层1120包括作业调度器1122、配置管理器1124、资源管理器1126和分布式文件系统1128。在至少一个实施例中,框架层1120可以包括支持软件层1130的软件1132和/或应用程序层1140的一个或更多个应用程序1142的框架。在至少一个实施例中,软件1132或应用程序1142可以分别包括基于web的服务软件或应用程序,例如由amazon web services,google cloud和microsoft azure提供的服务或应用程序。在至少一个实施例中,框架层1120可以是但不限于一种免费和开放源软件网络应用程序框架,例如可以利用分布式文件系统1128来进行大范围数据处理(例如“大数据”)的apache spark

tm

(以下称为“spark”)。在至少一个实施例中,作业调度器1132可以包括spark驱动器,以促进对数据中心1100的各个层所支持的工作负载进行调度。在至少一个实施例

中,配置管理器1124可以能够配置不同的层,例如软件层1130和包括spark和用于支持大规模数据处理的分布式文件系统1128的框架层1120。在至少一个实施例中,资源管理器1126能够管理映射到或分配用于支持分布式文件系统1128和作业调度器1122的集群或分组计算资源。在至少一个实施例中,集群或分组计算资源可以包括数据中心基础设施层1110上的分组计算资源1114。在至少一个实施例中,资源管理器1126可以与资源协调器1112协调以管理这些映射的或分配的计算资源。

140.在至少一个实施例中,包括在软件层1130中的软件1132可以包括由节点c.r.1116(1)-1116(n)的至少一部分,分组的计算资源1114和/或框架层1120的分布式文件系统1128使用的软件。在至少一个实施例中,一种或更多种类型的软件可以包括但不限于internet网页搜索软件、电子邮件病毒扫描软件、数据库软件和流视频内容软件。

141.在至少一个实施例中,应用程序层1140中包括的一个或更多个应用程序1142可以包括由节点c.r.1116(1)-1116(n)的至少一部分、分组计算资源1114和/或框架层1120的分布式文件系统1128使用的一种或更多种类型的应用程序。在至少一个实施例中,一种或更多种类型的应用程序可以包括但不限于任何数量的基因组学应用程序、认知计算、应用程序和机器学习应用程序,包括训练或推理软件,机器学习框架软件(例如pytorch、tensorflow、caffe等)或其他与一个或更多个实施例结合使用的机器学习应用程序。

142.在至少一个实施例中,配置管理器1124、资源管理器1126和资源协调器1112中的任何一个可以基于以任何技术上可行的方式获取的任何数量和类型的数据来实现任何数量和类型的自我修改动作。在至少一个实施例中,自我修改动作可以减轻数据中心1100的数据中心操作员做出可能不好的配置决定并且可以避免数据中心的未充分利用和/或执行差的部分。

143.在至少一个实施例中,数据中心1100可以包括工具、服务、软件或其他资源,以根据本文所述的一个或更多个实施例来训练一个或更多个机器学习模型或者使用一个或更多个机器学习模型来预测或推理信息。例如,在至少一个实施例中,可以通过使用上文关于数据中心1100描述的软件和计算资源,根据神经网络架构通过计算权重参数来训练机器学习模型。在至少一个实施例中,通过使用通过本文所述的一种或更多种训练技术计算出的权重参数,可以使用上面与关于数据中心1100所描述的资源,使用对应于一个或更多个神经网络的经训练的机器学习模型来推理或预测信息。

144.在至少一个实施例中,数据中心可以使用cpu、专用集成电路(asic)、gpu、fpga或其他硬件来使用上述资源来执行训练和/或推理。此外,上述的一个或更多个软件和/或硬件资源可以配置成一种服务,以允许用户训练或执行信息推理,例如图像识别、语音识别或其他人工智能服务。

145.推理和/或训练逻辑915用于执行与一个或更多个实施例相关联的推理和/或训练操作。本文结合图9a和/或图9b提供关于推理和/或训练逻辑915的细节。在至少一个实施例中,推理和/或训练逻辑915可以在系统图11中使用,用于至少部分地基于使用神经网络训练操作、神经网络函数和/或体系架构,或者本文所述的神经网络用例计算的权重参数推理或预测操作。

146.在至少一个实施例中,适配了一个或更多个电路、处理器、计算系统或其他设备或技术,参照所述图,以使第一一个或更多个神经网络使得至少部分地基于第二一个或更多

个神经网络或其他机器学习模型的性能要求来确定计算资源以执行推理。在至少一个实施例中,根据在此关于之前的图1-8所描述的各种技术和实施例,这在所述附图的实施例中执行。

147.自主车辆

148.图12a示出了根据至少一个实施例的自动驾驶车辆1200的示例。在至少一个实施例中,自动驾驶车辆1200(在本文中可替代地称为“车辆1200”)可以是但不限于客运车辆,例如汽车、卡车、公共汽车和/或可容纳一个或更多个乘客的另一种类型的车辆。在至少一个实施例中,车辆1200可以是用于拖运货物的半牵引车-拖车。在至少一个实施例中,车辆1200可以是飞机、机器人车辆或其他类型的车辆。

149.可以根据由美国运输部下属的国家公路交通安全管理局(“nhtsa”)和汽车工程师学会(“sae”)“与用于道路机动车辆的驾驶自动化系统有关的术语(taxonomy and definitions for terms related to driving automation systems for on-road motor vehicles)”(例如,于2018年6月15日发布的标准号j3016-201806,于2016年9月30日发布的标准号j3016-201609,以及该版本的以前和将来的版本此标准)定义的自动化级别来描述自动驾驶汽车。在至少一个实施例中,车辆1200可能能够根据自动驾驶级别的级别1至级别5中的一个或更多个来进行功能。例如,在至少一个实施例中,根据实施例,车辆1200可能能够进行条件自动化(级别3)、高度自动化(级别4)和/或全自动(级别5)。

150.在至少一个实施例中,车辆1200可以包括但不限于组件,诸如底盘、车身、车轮(例如2、4、6、8、18等)、轮胎、车轴和车辆的其他组件。在至少一个实施例中,车辆1200可以包括但不限于推进系统1250,例如内燃机、混合动力装置、全电动发动机和/或另一种推进系统类型。在至少一个实施例中,推进系统1250可以连接至车辆1200的传动系,其可以包括但不限于变速器,以使得能够对车辆1200进行推进。在至少一个实施例中,可以响应于从油门/加速器1252接收信号以控制推进系统1250。

151.在至少一个实施例中,当推进系统1250正在运行时(例如,当车辆1200行驶时),转向系统1254(其可以包括但不限于方向盘)用于使车辆1200转向(例如,沿着期望的路径或路线)。在至少一个实施例中,转向系统1254可以从转向致动器1256接收信号。在至少一个实施例中,方向盘对于全自动化(级别5)功能可以是可选的。在至少一个实施例中,制动传感器系统1246可以用于响应于从制动致动器1248和/或制动传感器接收到的信号来操作车辆制动器。

152.在至少一个实施例中,控制器1236可以包括但不限于一个或更多个片上系统(“soc”)(图12a中未示出)和/或图形处理单元(“gpu”)向车辆1200的一个或更多个组件和/或系统提供信号(例如,代表命令)。例如,在至少一个实施例中,控制器1236可以发送信号以通过制动致动器1248操作车辆制动,通过一个或更多个转向致动器1256操作转向系统1254,通过一个或更多个油门(throttle)/加速器1252操作推进系统1250。在至少一个实施例中,一个或更多个控制器1236可以包括一个或更多个机载(例如,集成)计算设备,其处理传感器信号并输出操作命令(例如,表示命令的信号)以实现自动驾驶和/或协助驾驶员驾驶车辆1200。在至少一个实施例中,一个或更多个控制器1236可以包括用于自动驾驶功能的第一控制器,用于功能安全功能的第二控制器,用于人工智能功能(例如计算机视觉)的第三控制器,用于信息娱乐功能的第四控制器,用于紧急情况下的冗余的第五控制器和/或

其他控制器。在至少一个实施例中,单个控制器可以处理上述功能中的两个或更多个,两个或更多控制器可以处理单个功能和/或其任何组合。

153.在至少一个实施例中,一个或更多个控制器1236响应于从一个或更多个传感器(例如,传感器输入)接收到的传感器数据,提供用于控制车辆1200的一个或更多个组件和/或系统的信号。在至少一个实施例中,传感器数据可以从传感器接收,传感器类型例如但不限于一个或更多个全球导航卫星系统(“gnss”)传感器1258(例如,一个或更多个全球定位系统传感器)、一个或更多个radar传感器1260、一个或更多个超声波传感器1262、一个或更多个lidar传感器1264、一个或更多个惯性测量单元(imu)传感器1266(例如,一个或更多个加速度计、一个或更多个陀螺仪、一个或更多个磁罗盘、一个或更多个磁力计等)、一个或更多个麦克风1296、一个或更多个立体声相机1268、一个或更多个广角相机1270(例如鱼眼相机)、一个或更多个红外相机1272、一个或更多个环绕相机1274(例如,360度相机)、远程相机(图12a中未示出)、中程相机(图12a中未示出)、一个或更多个速度传感器1244(例如,用于测量车辆1200的速度)、一个或更多个振动传感器1242、一个或更多个转向传感器1240、一个或更多个制动传感器(例如,作为制动传感器系统1246的一部分)和/或其他传感器类型接收。

154.在至少一个实施例中,一个或更多个控制器1236可以从车辆1200的仪表板1232接收输入(例如,由输入数据表示)并通过人机接口(“hmi”)显示器1234、声音信号器、扬声器和/或车辆1200的其他组件提供输出(例如,由输出数据、显示数据等表示)。在至少一个实施例中,输出可包括信息,诸如车速、速度、时间、地图数据(例如,高清晰度地图(图12a中未显示)、位置数据(例如,车辆1200的位置,例如在地图上)、方向、其他车辆的位置(例如,占用光栅)、关于对象的信息以及由一个或更多个控制器1236感知到的对象的状态等。例如,在至少一个实施例中,hmi显示器1234可以显示关于一个或更多个对象的存在的信息(例如,路牌、警告标志、交通信号灯变更等)和/或有关驾驶操作车辆已经、正在或将要制造的信息(例如,现在改变车道、在两英里内驶出34b出口等)。

155.在至少一个实施例中,车辆1200还包括网络接口1224,其可以使用一个或更多个无线天线1226和/或一个或更多个调制解调器通过一个或更多个网络进行通信。例如,在至少一个实施例中,网络接口1224可能能够通过长期演进(“lte”)、宽带码分多址(“wcdma”)、通用移动电信系统(“umts”)、全球移动通信系统(“gsm”)、imt-cdma多载波(“cdma2000”)网络等进行通信。在至少一个实施例中,一个或更多个无线天线1226还可以使用一个或更多个局域网(例如bluetooth、bluetooth low energy(le)、z-wave、zigbee等)和/或一个或更多个低功耗广域网(以下简称“lpwan”)(例如lorawan、sigfox等协议),使环境中的对象(例如,车辆、移动设备)之间进行通信。

156.推理和/或训练逻辑915用于执行与一个或更多个实施例相关联的推理和/或训练操作。本文结合图9a和/或图9b提供关于推理和/或训练逻辑915的细节。在至少一个实施例中,推理和/或训练逻辑915可以在系统图12a中用于至少部分地基于使用神经网络训练操作\神经网络功能和/或架构或本文所述的神经网络用例计算出的权重参数来推理或预测操作。

157.在至少一个实施例中,适配了一个或更多个电路、处理器、计算系统或其他设备或技术,参照所述图,以使第一一个或更多个神经网络使得至少部分地基于第二一个或更多

个神经网络或其他机器学习模型的性能要求来确定计算资源以执行推理。在至少一个实施例中,根据在此关于之前的图1-8所描述的各种技术和实施例,这在所述附图的实施例中执行。

158.图12b示出了根据至少一个实施例的图12a的自动驾驶车辆1200的相机位置和视野的示例。在至少一个实施例中,相机和各自的视野是一个示例实施例,并且不旨在进行限制。例如,在至少一个实施例中,可以包括附加的和/或替代的相机和/或相机可以位于车辆1200上的不同位置。

159.在至少一个实施例中,用于相机的相机类型可以包括但不限于可以适于与车辆1200的组件和/或系统一起使用的数字相机。在至少一个实施例中,一个或更多个相机可以以汽车安全完整性级别(“asil”)b和/或其他asil进行操作。在至少一个实施例中,根据实施例,相机类型可以具有任何图像捕获速率,例如60帧每秒(fps)、1220fps、240fps等。在至少一个实施例中,相机可以能够使用滚动快门、全局快门、另一种类型的快门或其组合。在至少一个实施例中,滤色器阵列可以包括红色透明透明(“rccc”)滤色器阵列、红色透明透明蓝色(“rccb”)滤色器阵列、红色蓝色绿色透明(“rbgc”)滤色器阵列、foveon x3滤色器阵列、拜耳(bayer)传感器(“rggb”)滤色器阵列、单色传感器滤色器阵列和/或其他类型的滤色器阵列。在至少一个实施例中,可以使用透明像素相机,例如具有rccc、rccb和/或rbgc滤色器阵列的相机,以努力提高光敏性。

160.在至少一个实施例中,一个或更多个相机可以用于执行先进驾驶员辅助系统(“adas”)功能(例如,作为冗余或故障安全设计的一部分)。例如,在至少一个实施例中,可以安装多功能单声道相机以提供包括车道偏离警告、交通标志辅助和智能大灯控制的功能。在至少一个实施例中,一个或更多个相机(例如,所有相机)可以同时记录并提供图像数据(例如,视频)。

161.在至少一个实施例中,可以将一个或更多个相机安装在安装组件中,例如定制设计的(三维(“3d”)打印的)组件,以便切出杂散光和来自在车辆1200内的反光(例如,仪表板的反射在挡风玻璃镜中反光),其可能会干扰相机的图像数据捕获能力。关于后视镜安装组件,在至少一个实施例中,后视镜组件可以是3d打印定制的,使得相机安装板匹配后视镜的形状。在至少一个实施例中,一个或更多个相机可以被集成到后视镜中。在至少一个实施例中,对于侧视相机,一个或更多个相机也可以集成在舱室的每个角落的四个支柱内。

162.在至少一个实施例中,具有包括车辆1200前面的环境的部分的视野的相机(例如,前向相机)可以用于环视,以及在一个或更多个控制器1236和/或控制soc的帮助下帮助识别向前的路径和障碍物,从而提供对于生成占用网格和/或确定优选的车辆路径至关重要的信息。在至少一个实施例中,前向相机可以用于执行许多与lidar相似的adas功能,包括但不限于紧急制动、行人检测和避免碰撞。在至少一个实施例中,前向相机也可以用于adas功能和系统,包括但不限于车道偏离警告(“ldw”)、自动巡航控制(“acc”)和/或其他功能(例如交通标志识别)。

163.在至少一个实施例中,各种相机可以用于前向配置,包括例如包括cmos(“互补金属氧化物半导体”)彩色成像器的单目相机平台。在至少一个实施例中,广角相机1270可以用于感知从外围进入的对象(例如,行人、过马路或自行车)。尽管在图12b中仅示出了一个广角相机1270,但是,在其他实施例中,车辆1200上可以有任何数量(包括零)的广角相机。

在至少一个实施例中,任何数量的远程相机1298(例如,远程立体相机对)可用于基于深度的对象检测,尤其是对于尚未训练神经网络的对象。在至少一个实施例中,远程相机1298也可以用于对象检测和分类以及基本对象跟踪。

164.在至少一个实施例中,任何数量的立体声相机1268也可以包括在前向配置中。在至少一个实施例中,一个或更多个立体声相机1268可以包括集成控制单元,该集成控制单元包括可缩放处理单元,该可缩放处理单元可以提供可编程逻辑(“fpga”)和具有单个芯片上集成的控制器局域网(“can”)或以太网接口的多核心微处理器。在至少一个实施例中,这样的单元可以用于生成车辆1200的环境的3d地图,包括对图像中所有点的距离估计。在至少一个实施例中,一个或更多个立体相机1268可以包括但不限于紧凑型立体视觉传感器,其可以包括但不限于两个相机样本(左右分别一个)和一个图像处理芯片,其可以测量从车辆1200到目标对象的距离并使用所生成的信息(例如,元数据)来激活自主紧急制动和车道偏离警告功能。在至少一个实施例中,除了本文所述的那些之外,还可以使用其他类型的立体相机1268。

165.在至少一个实施例中,具有包括车辆1200侧面的环境的一部分的视野的相机(例如,侧视相机)可以用于环绕查看,从而提供用于创建和更新占据网格的信息,以及产生侧面碰撞警告。例如,在至少一个实施例中,环绕相机1274(例如,如图12b所示的四个环绕相机)可以定位在车辆1200上。在至少一个实施例中,一个或更多个环绕相机1274可以包括但不限于,任意数量和组合的广角相机、一个或更多个鱼目样本、一个或更多个360度相机和/或类似相机。例如,在至少一个实施例中,四个鱼目样本相机可以位于车辆1200的前、后和侧面。在至少一个实施例中,车辆1200可以使用三个环绕相机1274(例如,左、右和后面),并且可以利用一个或更多个其他相机(例如,前向相机)作为第四个环视相机。

166.在至少一个实施例中,具有包括车辆1200后方的环境的一部分的视野的相机(例如,后视相机)可以用于停车辅助、环视、后方碰撞警告、以及创建和更新占用光栅。在至少一个实施例中,可以使用各种各样的相机,包括但不限于还适合作为一个或更多个前向相机的相机(例如,远程相机1298和/或一个或更多个中程相机1276、一个或更多个立体相机1268、一个或更多个红外相机1272等),如本文所述。

167.推理和/或训练逻辑915用于执行与一个或更多个实施例相关联的推理和/或训练操作。结合图9a和/或图9b,在本文中提供了关于推理和/或训练逻辑915的细节。在至少一个实施例中,推理和/或训练逻辑915可以在图12b的系统中使用,用于至少部分地基于使用神经网络训练操作计算出的权重参数、神经网络函数和/或架构、或本文所述的神经网络用例来推理或预测操作。

168.在至少一个实施例中,适配了一个或更多个电路、处理器、计算系统或其他设备或技术,参照所述图,以使第一一个或更多个神经网络使得至少部分地基于第二一个或更多个神经网络或其他机器学习模型的性能要求来确定计算资源以执行推理。在至少一个实施例中,根据在此关于之前的图1-8所描述的各种技术和实施例,这在所述附图的实施例中执行。

169.图12c示出了根据至少一个实施例的图12a的自动驾驶车辆1200的示例系统架构的框图。在至少一个实施例中,图12c中的车辆1200的一个或更多个组件、一个或更多个特征和一个或更多个系统中的每一个都示出为经由总线1202连接。在至少一个实施例中,总

线1202可包括但不限于can数据接口(在本文中可替代地称为“can总线”)。在至少一个实施例中,can可以是车辆1200内部的网络,用于帮助控制车辆1200的各种特征和功能,例如制动器的致动、加速、制动、转向、雨刷等。在一个实施例中,总线1202可以配置成具有数十个甚至数百个节点,每个节点具有其自己的唯一标识符(例如,can id)。在至少一个实施例中,可以读取总线1202以找到方向盘角度、地面速度、发动机每分钟转动次数(“rpm”)、按钮位置和/或其他车辆状态指示器。在至少一个实施例中,总线1202可以是符合asil b的can总线。

170.在至少一个实施例中,除了can之外或来自can,可使用flexray和/或以太网(ethernet)协议。在至少一个实施例中,可以有任意数量的成型总线1202,其可以包括但不限于零或更多的can总线,零或更多的flexray总线,零或更多的以太网总线,和/或零或更多的使用其他协议的其他类型的总线。在至少一个实施例中,两个或更多个总线可以用于执行不同的功能,和/或可以用于冗余。例如,第一总线可以用于碰撞避免功能,并且第二总线可以用于致动控制。在至少一个实施例中,总线1202的每个总线可以与车辆1200的任何组件通信,并且总线1202的两个或更多个可以与相应的组件通信。在至少一个实施例中,任何数量的片上系统(“soc”)1204(例如,soc 1204(a)和soc 1204(b))中的每一个,一个或更多个控制器1236中的每一个和/或车辆内的每个计算机都可以访问相同的输入数据(例如,来自车辆1200的传感器的输入),并且可以连接到公共总线,例如can总线。

171.在至少一个实施例中,车辆1200可以包括一个或更多个控制器1236,诸如本文关于图12a所描述的那些。在至少一个实施例中,控制器1236可以用于多种功能。在至少一个实施例中,控制器1236可以耦合到车辆1200的各种其他组件和系统中的任何一个,并且可以用于控制车辆1200、车辆1200的人工智能、车辆1200的信息娱乐和/或其他功能。

172.在至少一个实施例中,车辆1200可以包括任何数量的soc 1204。在至少一个实施例中,soc 1204中的每一个可以包括但不限于中央处理单元(“一个或更多个cpu”)1206、图形处理单元(“一个或更多个gpu”)1208、一个或更多个处理器1210、一个或更多个高速缓存1212、一个或更多个加速器1214、一个或更多个数据存储1216和/或其他未显示的组件和特征。在至少一个实施例中,一个或更多个soc 1204可以用于在各种平台和系统中控制车辆1200。例如,在至少一个实施例中,一个或更多个soc 1204可以与高清晰度(“hd”)地图1222在系统(例如,车辆1200的系统)中组合,该高清晰度地图1222可以经由网络接口1224从一个或更多个服务器(图12c中未示出)获得地图刷新和/或更新。

173.在至少一个实施例中,一个或更多个cpu 1206可以包括cpu集群或cpu复合体(在本文中可替代地称为“ccplex”)。在至少一个实施例中,一个或更多个cpu 1206可以包括多个核心和/或二级(“l2”)高速缓存。例如,在至少一个实施例中,一个或更多个cpu 1206可以在相互耦合的多处理器配置中包括八个核心。在至少一个实施例中,一个或更多cpu 1206可以包括四个双核心集群,其中每个集群具有专用的l2高速缓存(例如,2mb l2高速缓存)。在至少一个实施例中,一个或更多cpu 1206(例如,ccplex)可以配置成支持同时的集群操作,使得一个或更多cpu1206的集群的任何组合在任何给定的时间都可以是活跃的。

174.在至少一个实施例中,一个或更多个cpu 1206可以实现电源管理功能,这些功能包括但不限于以下特征中的一个或更多个:空闲时可以自动对各个硬件模块进行时钟门控以节省动态功率;当该核心由于执行等待中断(“wfi”)/事件等待(“wfe”)指令而未主动执

行指令时,可以对每个核心时钟进行门控;每个核心都可以独立供电;当所有核心都被时钟门控或功率门控时,每个核心集群可以被独立地时钟门控;以及/或当所有核心都被功率门控时,每个核心集群可以被独立地功率门控。在至少一个实施例中,一个或更多cpu 1206可以进一步实现用于管理功率状态的增强算法,其中指定了允许的功率状态和预期的唤醒时间,并且硬件/微码确定了针对核心、集群和ccplex输入的最佳功率状态。在至少一个实施例中,处理核心可以在软件中支持简化的功率状态输入序列,其中工作被分担给微码。

175.在至少一个实施例中,一个或更多个gpu 1208可以包括集成的gpu(在本文中或者称为“igpu”)。在至少一个实施例中,一个或更多个gpu 1208可以是可编程的,并且对于并行工作负载可以是有效的。在至少一个实施例中,一个或更多个gpu 1208可以使用增强的张量指令集。在至少一个实施例中,一个或更多个gpu 1208可以包括一个或更多个流式微处理器,其中每个流式微处理器可以包括一级(“l1”)高速缓存(例如,具有至少96kb的存储容量的l1高速缓存),以及两个或更多个流式微处理器可以共享l2高速缓存(例如,具有512kb存储容量的l2高速缓存)。在至少一个实施例中,一个或更多个gpu 1208可以包括至少八个流式微处理器。在至少一个实施例中,一个或更多个gpu 1208可以使用计算应用程序编程接口(api)。在至少一个实施例中,一个或更多gpu 1208可以使用一个或更多个并行计算平台和/或编程模型(例如,nvidia的cuda模型)。

176.在至少一个实施例中,一个或更多个gpu 1208可以经功耗优化以在汽车和嵌入式用例中获得最佳性能。例如,在至少一个实施例中,可以在鳍式场效应晶体管(“finfet”)电路上制造一个或更多个gpu 1208。在至少一个实施例中,每个流式微处理器可以包含多个划分为多个块的混合精度处理核心,。例如但不限于,可以将64个pf32核心和32个pf64核心划分为四个处理块。在至少一个实施例中,可以为每个处理块分配16个fp32核心、8个fp64核心、16个int32核心、两个用于深度学习矩阵算术的混合精度nvidia张量核心、零级(“l0”)指令缓存、线程束调度器、分派单元和/或64kb寄存器文件。在至少一个实施例中,流式微处理器可以包括独立的并行整数和浮点数据路径来提供混合了计算和寻址运算的工作量的有效执行。在至少一个实施例中,流式微处理器可以包括独立的线程调度能力,以实现更细粒度的同步和并行线程之间的协作。在至少一个实施例中,流式微处理器可以包括组合的l1数据高速缓存和共享存储器单元,以便在简化编程的同时提高性能。

177.在至少一个实施例中,一个或更多个gpu 1208可以包括高带宽存储器(“hbm”)和/或16gb hbm2存储器子系统,以在一些示例中提供约900gb/秒的峰值存储带宽。在至少一个实施例中,除了或替代于hbm存储器,可以使用同步图形随机存取存储器(“sgram”),例如图形双倍数据速率类型的五同步随机存取存储器(“gddr5”)。

178.在至少一个实施例中,一个或更多个gpu 1208可以包括统一存储器技术。在至少一个实施例中,地址转换服务(“ats”)支持可以用于允许一个或更多个gpu 1208直接访问一个或更多个cpu 1206页表。在至少一个实施例中,当一个或更多个gpu 1208中的gpu的一个存储器管理单元(“mmu”)经历未命中时,可以将地址转换请求发送到一个或更多个cpu 1206。作为响应,在至少一个实施例中,一个或更多个cpu 1206中的2cpu可以在其页面表中查找地址的虚拟-物理的映射并将转换传送回一个或更多个gpu 1208。在至少一个实施例中,统一存储器技术可以允许单个统一虚拟地址空间用于一个或更多个cpu 1206和一个或更多个gpu 1208两者的存储器,从而简化了一个或更多个gpu 1208的编程以及将应用程序

移植到一个或更多个gpu 1208。

179.在至少一个实施例中,一个或更多个gpu 1208可以包括任意数量的访问计数器,其可以跟踪一个或更多个gpu 1208对其他处理器的存储器的访问频率。在至少一个实施例中,一个或更多个访问计数器可以帮助确保将存储器页移动到最频繁访问页面的处理器的物理存储器中,从而提高处理器之间共享的存储器范围的效率。

180.在至少一个实施例中,一个或更多个soc 1204可以包括任何数量的高速缓存1212,包括本文所述的那些。例如,在至少一个实施例中,一个或更多个高速缓存1212可以包括可用于一个或更多个cpu 1206和一个或更多个gpu 1208(例如,连接到cpu 1206和gpu 1208)的三级(“l3”)高速缓存。在至少一个实施例中,一个或更多个高速缓存1212可以包括回写式高速缓存,该回写式高速缓存可以例如通过使用高速缓存相干协议(例如,mei、mesi、msi等)来跟踪线的状态。在至少一个实施例中,尽管可以使用较小的高速缓存大小,根据实施例,l3高速缓存可以包括4mb存储器或更多。

181.在至少一个实施例中,一个或更多个soc 1204可以包括一个或更多个加速器1214(例如,硬件加速器、软件加速器或其组合)。在至少一个实施例中,一个或更多个soc 1204可以包括硬件加速集群,其可以包括优化的硬件加速器和/或大的片上存储器。在至少一个实施例中,大的片上存储器(例如4mb的sram)可以使硬件加速集群能够加速神经网络和其他计算。在至少一个实施例中,硬件加速集群可以用于补充一个或更多个gpu 1208并且卸载一个或更多个gpu 1208的一些任务(例如,释放一个或更多个gpu 1208的更多周期以执行其他任务)。在至少一个实施例中,一个或更多个加速器1214可以用于足够稳定以经得起加速检验的目标工作负载(例如,感知、卷积神经网络(“cnn”)、递归神经网络(“rnn”)等)。在至少一个实施例中,cnn可以包括基于区域或区域卷积神经网络(“rcnn”)和快速rcnn(例如,如用于对象检测)或其他类型的cnn。

182.在至少一个实施例中,一个或更多个加速器1214(例如,硬件加速集群)可以包括一个或更多个深度学习加速器(“dla”)。在至少一个实施例中,一个或更多个dla可以包括但不限于一个或更多个tensor处理单元(“tpu”),其可以配置成每秒提供额外的10万亿次操作用于深度学习应用程序和推理。在至少一个实施例中,tpu可以是配置成并被优化用于执行图像处理功能(例如,用于cnn、rcnn等)的加速器。在至少一个实施例中,可以针对神经网络类型和浮点运算以及推理的特定集合进一步优化一个或更多个dla。在至少一个实施例中,一个或更多个dla的设计可以提供比典型的通用gpu更高的每毫米性能,并且通常大大超过cpu的性能。在至少一个实施例中,一个或更多个tpu可执行若干功能,包括支持例如int8、int16和fp16数据类型以用于特征和权重的单实例卷积功能以及后处理器功能的。在至少一个实施例中,一个或更多个dla可以针对各种功能中的任何功能,在处理或未处理的数据上快速且有效地执行神经网络,尤其是cnn,包括例如但不限于:用于使用来自相机传感器的数据进行对象识别和检测的cnn;用于使用来自相机传感器的数据进行距离估算的cnn;用于使用来自麦克风的数据进行紧急车辆检测以及识别和检测的cnn;用于使用来自相机传感器的数据进行人脸识别和车主识别的cnn;以及/或用于安全和/或安全相关事件的cnn。

183.在至少一个实施例中,dla可以执行一个或更多个gpu 1208的任何功能,并且通过使用推理加速器,例如,设计者可以将一个或更多个dla或一个或更多个gpu 1208作为目标

用于任何功能。例如,在至少一个实施例中,设计者可以将cnn的处理和浮点运算集中在一个或更多个dla上,并将其他功能留给一个或更多个gpu 1208和/或一个或更多个加速器1214。

184.在至少一个实施例中,一个或更多个加速器1214可以包括可编程视觉加速器(“pva”),其在本文中可以可替代地称为计算机视觉加速器。在至少一个实施例中,一个或更多个pva可以设计和配置为加速用于高级驾驶员辅助系统(“adas”)1238、自动驾驶、增强现实(“ar”)应用程序和/或虚拟现实(“vr”)应用程序的计算机视觉算法。在至少一个实施例中,一个或更多个pva可以在性能和灵活性之间取得平衡。例如,在至少一个实施例中,一个或更多个pva中的每一个可以包括例如但不限于任何数量的精简指令集计算机(“risc”)核心、直接存储器访问(“dma”)和/或任意数量的向量处理器。

185.在至少一个实施例中,risc核心可以与图像传感器(例如,本文描述的任意相机的图像传感器)、图像信号处理器等交互。在至少一个实施例中,每个risc核心可以包括任意数量的存储器。在至少一个实施例中,根据实施例,risc核心可以使用多种协议中的任意一种。在至少一个实施例中,risc核心可以执行实时操作系统(“rtos”)。在至少一个实施例中,可以使用一个或更多个集成电路设备、专用集成电路(“asic”)和/或存储设备来实现risc核心。例如,在至少一个实施例中,risc核心可以包括指令高速缓存和/或紧密耦合的ram。

186.在至少一个实施例中,dma可以使pva的组件能够独立于一个或更多个cpu 1206访问系统存储器。在至少一个实施例中,dma可以支持用于向pva提供优化的任何数量的特征,包括但不限于,支持多维寻址和/或循环寻址。在至少一个实施例中,dma可以支持多达六个或更多个寻址的维度,其可以包括但不限于块宽度、块高度、块深度、水平块步进、垂直块步进和/或深度步进。

187.在至少一个实施例中,向量处理器可以是可编程处理器,其可以设计为有效且灵活地执行用于计算机视觉算法并提供信号处理能力的编程。在至少一个实施例中,pva可以包括pva核心和两个向量处理子系统分区。在至少一个实施例中,pva核心可以包括处理器子系统、dma引擎(例如,两个dma引擎)和/或其他外围设备。在至少一个实施例中,向量处理子系统可以用作pva的主要处理引擎,并且可以包括向量处理单元(“vpu”)、指令高速缓存和/或向量存储器(例如“vmem”)。在至少一个实施例中,vpu核心可以包括数字信号处理器,例如,单指令多数据(“simd”)、超长指令字(“vliw”)数字信号处理器。在至少一个实施例中,simd和vliw的组合可以提高吞吐量和速度。

188.在至少一个实施例中,每个向量处理器可以包括指令高速缓存并且可以耦合到专用存储器。结果,在至少一个实施例中,每个向量处理器可以配置为独立于其他向量处理器执行。在至少一个实施例中,特定pva中包括的向量处理器可以配置为采用数据并行性。例如,在至少一个实施例中,单个pva中包括的多个向量处理器可以执行通用计算机视觉算法,除了在图像的不同区域上之外。在至少一个实施例中,包括在特定pva中的向量处理器可以在一个图像上同时执行不同的计算机视觉算法,或者甚至在序列图像或部分图像上执行不同的算法。在至少一个实施例中,除其他外,在硬件加速集群中可以包括任何数量的pva,并且在每个pva中可以包括任何数量的向量处理器。在至少一个实施例中,pva可以包括附加的纠错码(“ecc”)存储器,以增强整体系统安全性。

189.在至少一个实施例中,一个或更多个加速器1214可以包括片上计算机视觉网络和静态随机存取存储器(“sram”),用于为一个或更多个加速器1214提供高带宽,低延迟sram。在至少一个实施例中,片上存储器可以包括至少4mb sram,其包括例如但不限于八个现场可配置的内存块,pva和dla均可以对其进行访问。在至少一个实施例中,每对存储块可以包括高级外围总线(“apb”)接口、配置电路、控制器和多路复用器。在至少一个实施例中,可以使用任何类型的存储器。在至少一个实施例中,pva和dla可以经由为pva和dla提供对存储器的高速访问的主干网来访问存储器。在至少一个实施例中,主干网可以包括片上计算机视觉网络,其将pva和dla互连到存储器(例如,使用apb)。

190.在至少一个实施例中,片上计算机视觉网络可以包括接口,该接口在传输任何控制信号/地址/数据之前确定pva和dla均提供就绪和有效信号。在至少一个实施例中,接口可以提供用于发送控制信号/地址/数据的单独的相位和单独的信道,以及用于连续数据传输的突发型通信。在至少一个实施例中,尽管可以使用其他标准和协议,但是接口可以符合国际标准化组织(“iso”)26262或国际电工委员会(“iec”)61508标准。

191.在至少一个实施例中,一个或更多个soc 1204可以包括实时视线追踪硬件加速器。在至少一个实施例中,实时视线追踪硬件加速器可以用于快速且有效地确定对象的位置和范围(例如,在世界模型内),以生成实时可视化模拟,以用于radar信号解释,用于声音传播合成和/或分析,用于sonar系统的模拟,用于一般的波传播模拟,与用于定位和/或其他功能的lidar数据进行比较,和/或用于其他用途。

192.在至少一个实施例中,一个或更多个加速器1214具有用于自动驾驶的广泛用途。在至少一个实施例中,pva可以用于adas和自动驾驶汽车中的关键处理阶段。在至少一个实施例中,在低功耗和低延迟下pva的能力与需要可预测的处理的算法域良好匹配。换句话说,pva在半密集或密集的常规计算中表现出色,即使在小型数据集上也是如此,这些数据集可能需要具有低延迟和低功耗的可预测的运行时间。在至少一个实施例中,诸如在车辆1200中pva可能被设计为运行经典的计算机视觉算法,因为它们可以在对象检测和整数数学运算方面是有效的。

193.例如,根据技术的至少一个实施例,pva被用于执行计算机立体视觉。在至少一个实施例中,可以在一些示例中使用基于半全局匹配的算法,尽管这并不意味着限制性。在至少一个实施例中,用于3-5级自动驾驶的应用程序在运行中使用动态的估计/立体匹配(例如,从运动中恢复结构、行人识别、车道检测等)。在至少一个实施例中,pva可以对来自两个单目相机的输入执行计算机立体视觉功能。

194.在至少一个实施例中,pva可以用于执行密集的光流。例如,在至少一个实施例中,pva可以处理原始radar数据(例如,使用4d快速傅立叶变换)以提供处理后的radar数据。在至少一个实施例中,例如,通过处理原始飞行时间数据以提供处理后的飞行时间数据,将pva用于飞行时间深度处理。

195.在至少一个实施例中,dla可用于运行任何类型的网络以增强控制和驾驶安全性,包括例如但不限于神经网络,其输出用于每个对象检测的置信度。在至少一个实施例中,可以将置信度表示或解释为概率,或者表示为提供每个检测相对于其他检测的相对“权重”。在至少一个实施例中,置信度测量结果使系统能够做出进一步的决定,即关于哪些检测应当被认为是真正的阳性检测而不是假阳性检测。在至少一个实施例中,系统可以为置信度

设置阈值,并且仅将超过阈值的检测视为真阳性检测。在使用自动紧急制动(“aeb”)系统的实施例中,假阳性检测将导致车辆自动执行紧急制动,这显然是不希望的。在至少一个实施例中,高度自信的检测可以被认为是aeb的触发。在至少一个实施例中,dla可以运行用于回归置信度值的神经网络。在至少一个实施例中,神经网络可以将参数的至少一些子集作为其输入,例如包围盒尺寸,获得的地平面估计(例如,从另一子系统),与从神经网络和/或其他传感器(例如,一个或更多个lidar传感器1264或一个或更多个radar传感器1260)等获得的对象的车辆1200方向、距离、3d位置估计相关的一个或更多个imu传感器1266的输出。

196.在至少一个实施例中,一个或更多个soc 1204可以包括一个或更多个数据存储装置1216(例如,存储器)。在至少一个实施例中,一个或更多个数据存储1216可以是一个或更多个soc 1204的片上存储器,其可以存储要在一个或更多个gpu 1208和/或dla上执行的神经网络。在至少一个实施例中,一个或更多个数据存储1216可以具有足够大的容量以存储神经网络的多个实例以用于冗余和安全。在至少一个实施例中,一个或更多个数据存储1216可以包括l2或l3高速缓存。

197.在至少一个实施例中,一个或更多个soc 1204可以包括任何数量的处理器1210(例如,嵌入式处理器)。在至少一个实施例中,一个或更多个处理器1210可以包括启动和电源管理处理器,该启动和电源管理处理器可以是专用处理器和子系统,以处理启动电源和管理功能以及相关的安全实施。在至少一个实施例中,启动和电源管理处理器可以是一个或更多个soc 1204启动序列的一部分,并且可以提供运行时电源管理服务。在至少一个实施例中,启动功率和管理处理器可以提供时钟和电压编程,辅助系统低功率状态转换,一个或更多个soc 1204热和温度传感器管理和/或一个或更多个soc 1204功率状态管理。在至少一个实施例中,每个温度传感器可以实现为其输出频率与温度成比例的环形振荡器,并且一个或更多个soc 1204可以使用环形振荡器来检测一个或更多个cpu 1206,一个或更多个gpu 1208和/或一个或更多个加速器1214的温度。在至少一个实施例中,如果确定温度超过阈值,则启动和电源管理处理器可以进入温度故障例程,并将一个或更多个soc 1204置于较低功耗状态和/或将车辆1200置于司机的安全停车图案(例如,使车辆1200安全停车)。

198.在至少一个实施例中,一个或更多个处理器1210可以还包括一组嵌入式处理器,其可以用作音频处理引擎,所述音频处理引擎可以是音频子系统,其能够通过多个接口以及广泛且灵活范围的音频i/o接口为硬件提供对多通道音频的完全硬件支持。在至少一个实施例中,音频处理引擎是专用处理器核心,其具有带专用ram的数字信号处理器。

199.在至少一个实施例中,一个或更多个处理器1210可以还包括始终在线的处理器引擎,该引擎可以提供必要的硬件特征以支持低功率传感器管理和唤醒用例。在至少一个实施例中,始终在线的处理器引擎上的处理器可以包括但不限于处理器核心、紧密耦合的ram、支持外围设备(例如,定时器和中断控制器)、各种i/o控制器外围设备以及路由逻辑。

200.在至少一个实施例中,一个或更多个处理器1210可以还包括安全集群引擎,该安全集群引擎包括但不限于用于处理汽车应用程序的安全管理的专用处理器子系统。在至少一个实施例中,安全集群引擎可以包括但不限于两个或更多个处理器核心、紧密耦合的ram、支持外围设备(例如,定时器、中断控制器等)和/或路由逻辑。在安全模式下,在至少一个实施例中,两个或更多个核心可以以锁步模式操作,并且可以用作具有用以检测其操作之间的任何差异的比较逻辑的单个核心。在至少一个实施例中,一个或更多个处理器1210

可以还包括实时相机引擎,该实时相机引擎可以包括但不限于用于处理实时相机管理的专用处理器子系统。在至少一个实施例中,一个或更多个处理器1210可以还包括高动态范围信号处理器,该高动态范围信号处理器可以包括但不限于图像信号处理器,该图像信号处理器是作为相机处理管线的一部分的硬件引擎。

201.在至少一个实施例中,一个或更多个处理器1210可以包括视频图像合成器,该视频图像合成器可以是处理块(例如,在微处理器上实现),该处理块实现视频回放应用程序产生最终的视频所需要的视频后处理功能,以产生用于播放器窗口的最终图像。在至少一个实施例中,视频图像合成器可以在一个或更多个广角相机1270、一个或更多个环绕相机1274和/或一个或更多个舱内监控相机传感器上执行透镜畸变校正。在至少一个实施例中,优选地,由在soc 1204的另一实例上运行的神经网络来监控舱室内监控相机传感器,该神经网络被配置为识别舱室事件并相应地做出响应。在至少一个实施例中,舱室内系统可以执行但不限于唇读以激活蜂窝服务和拨打电话、指示电子邮件、改变车辆的目的地、激活或改变车辆的信息娱乐系统和设置、或者提供语音激活的网上冲浪。在至少一个实施例中,当车辆以自主模式运行时,某些功能对于驾驶员是可用的,否则将其禁用。

202.在至少一个实施例中,视频图像合成器可以包括用于同时空间和时间降噪的增强的时间降噪。例如,在至少一个实施例中,在运动发生在视频中的情况下,降噪适当地对空间信息加权,从而减小由相邻帧提供的信息的权重。在至少一个实施例中,在图像或图像的一部分不包括运动的情况下,由视频图像合成器执行的时间降噪可以使用来自先前图像的信息来降低当前图像中的噪声。

203.在至少一个实施例中,视频图像合成器还可以配置为对输入的立体透镜帧执行立体校正。在至少一个实施例中,当使用操作系统桌面时,视频图像合成器还可以用于用户接口合成,并且不需要一个或更多个gpu 1208来连续渲染新表面。在至少一个实施例中,当对一个或更多个gpu 1208供电并使其活跃地进行3d渲染时,视频图像合成器可以被用于卸载一个或更多个gpu 1208以改善性能和响应性。

204.在至少一个实施例中,soc 1204中的一个或更多个soc可以还包括用于从相机接收视频和输入的移动工业处理器接口(“mipi”)相机串行接口、高速接口和/或可用于相机和相关像素输入功能的视频输入块。在至少一个实施例中,一个或更多个soc 1204可以还包括输入/输出控制器,该输入/输出控制器可以由软件控制并且可以被用于接收未提交给特定角色的i/o信号。

205.在至少一个实施例中,soc 1204中的一个或更多个soc可以还包括广泛的外围接口,以使得能够与外围设备、音频编码器/解码器(“编解码器”),电源管理和/或其他设备通信。在至少一个实施例中,一个或更多个soc 1204可用于处理来自(例如,通过千兆位多媒体串行链路和以太网通道连接)相机、传感器(例如,一个或更多个lidar传感器1264,一个或更多个radar传感器1260等,其可以通过以太网通道连接)的数据,来自总线1202的数据(例如,车辆1200的速度、方向盘位置等),来自一个或更多个gnss传感器1258的数据(例如,通过以太网总线或can总线连接)等。在至少一个实施例中,soc 1204中的一个或更多个soc可以还包括专用高性能海量存储控制器,其可以包括它们自己的dma引擎,并且可以用于使一个或更多个cpu 1206摆脱常规数据管理任务。

206.在至少一个实施例中,一个或更多个soc 1204可以是具有灵活架构的端到端平

台,其跨越自动化级别3-5级,从而提供利用并有效使用计算机视觉和adas技术来实现多样性和冗余的综合的功能安全架构,其提供了可提供灵活、可靠的驾驶软件堆栈以及深度学习工具的平台。在至少一个实施例中,一个或更多个soc 1204可以比常规系统更快、更可靠,并且甚至在能量效率和空间效率上也更高。例如,在至少一个实施例中,一个或更多个加速器1214当与一个或更多个cpu 1206、一个或更多个gpu 1208以及一个或更多个数据存储装置1216结合时,可以提供用于3-5级自动驾驶车辆的快速、有效的平台。

207.在至少一个实施例中,计算机视觉算法可以在cpu上执行,cpu可以使用高级编程语言(例如c)配置为在多种视觉数据上执行多种处理算法。然而,在至少一个实施例中,cpu通常不能满足许多计算机视觉应用程序的性能要求,例如与执行时间和功耗有关的性能要求。在至少一个实施例中,许多cpu不能实时执行复杂的对象检测算法,该算法被用于车载adas应用程序和实际3-5级自动驾驶车辆中。

208.本文所述的实施例允许同时和/或序列地执行多个神经网络,并且允许将结果结合在一起以实现3-5级自动驾驶功能。例如,在至少一个实施例中,在dla或离散gpu(例如,一个或更多个gpu 1220)上执行的cnn可包括文本和单词识别,从而允许超级计算机读取和理解交通标志,包括神经网络尚未被专门训练的标志。在至少一个实施例中,dla还可包括神经网络,该神经网络能够识别、解释并提供符号的语义理解,并将该语义理解传递给在cpu complex上运行的路径规划模块。

209.在至少一个实施例中,对于3、4或5级的驱动,可以同时运行多个神经网络。例如,在至少一个实施例中,由“警告标志声明:闪烁的灯指示结冰状况(caution:flashing lights indicate icy conditions)”连通电灯一起组成的警告标志可以由多个神经网络独立地或共同地解释。在至少一个实施例中,可以通过第一部署的神经网络(例如,已经训练的神经网络)将该警告标志本身识别为交通标志,可以通过第二部署的神经网络来解释文本“闪烁的灯指示结冰状况(flashing lights indicate icy conditions)”,其通知车辆的路径规划软件(最好在cpu complex上执行):当检测到闪烁的灯光时,就会存在结冰状况。在至少一个实施例中,可以通过在多个帧上操作第三部署的神经网络来识别闪烁的灯,向车辆的路径规划软件通知存在(或不存在)闪烁的灯。在至少一个实施例中,所有三个神经网络可以同时运行,例如在dla内和/或在一个或更多个gpu 1208上。

210.在至少一个实施例中,用于面部识别和车辆所有者识别的cnn可以使用来自相机传感器的数据来识别授权驾驶员和/或车辆1200的所有者的存在。在至少一个实施例中,当所有者接近驾驶员门并打开灯时,常开传感器处理器引擎可用于解锁车辆,并且,在安全模式下,当所有者离开该车辆时,可用于禁用该车辆。以此方式,一个或更多个soc 1204提供防止盗窃和/或劫车的保障。

211.在至少一个实施例中,用于紧急车辆检测和识别的cnn可以使用来自麦克风1296的数据来检测和识别紧急车辆警报器。在至少一个实施例中,一个或更多个soc 1204使用cnn来对环境和城市声音进行分类,以及对视觉数据进行分类。在至少一个实施例中,训练在dla上运行的cnn以识别紧急车辆的相对接近速度(例如,通过使用多普勒效应)。在至少一个实施例中,还可以训练cnn来识别针对车辆正在运行的区域的紧急车辆,如一个或更多个gnss传感器1258所识别。在至少一个实施例中,当在欧洲运行时,cnn将寻求检测欧洲警报器,而在北美洲时,cnn将寻求仅识别北美警报器。在至少一个实施例中,一旦检测到紧急

车辆,就可以在一个或更多个超声波传感器1262的辅助下使用控制程序来执行紧急车辆安全例程、减速车辆、将车辆驶至路边、停车、和/或使车辆闲置,直到紧急车辆通过。

212.在至少一个实施例中,车辆1200可以包括一个或更多个cpu 1218(例如,一个或更多个离散cpu或一个或更多个dcpu),其可以经由高速互连(例如pcie)耦合到一个或更多个soc 1204。在至少一个实施例中,一个或更多个cpu 1218可以包括x86处理器,例如一个或更多个cpu 1218可用于执行各种功能中的任何功能,例如包括在adas传感器和一个或更多个soc 1204之间潜在的仲裁不一致的结果,和/或一个或更多个监控控制器1236的状态和健康和/或片上信息系统(“信息soc”)1230。

213.在至少一个实施例中,车辆1200可以包括一个或更多个gpu 1220(例如,一个或更多个离散gpu或一个或更多个dgpu),其可以经由高速互连(例如nvidia的nvlink通道)耦合到一个或更多个soc 1204。在至少一个实施例中,一个或更多个gpu 1220可以提供附加的人工智能功能,例如通过执行冗余和/或不同的神经网络,并且可以至少部分地基于来自车辆1200的传感器的输入(例如,传感器数据)来用于训练和/或更新神经网络。

214.在至少一个实施例中,车辆1200可以还包括网络接口1224,其可以包括但不限于一个或更多个无线天线1226(例如,用于不同通信协议的一个或更多个无线天线,诸如蜂窝天线、蓝牙天线等)。在至少一个实施例中,网络接口1224可以用于使能通过互联网云服务(例如,采用服务器和/或其他网络设备)与其他车辆和/或计算设备(例如乘客的客户端设备)的无线连接。在至少一个实施例中,为了与其他车辆通信,可以在车辆1200和另一车辆之间建立直接链路和/或可以建立间接链路(例如,通过网络和互联网)。在至少一个实施例中,可以使用车辆到车辆的通信链路来提供直接链路。在至少一个实施例中,车辆到车辆的通信链路可以向车辆1200提供关于车辆1200附近的车辆的信息(例如,车辆1200前面、侧面和/或后面的车辆)。在至少一个实施例中,该前述功能可以是车辆1200的协作自适应巡航控制功能的一部分。

215.在至少一个实施例中,网络接口1224可以包括soc,其提供调制和解调功能并使一个或更多个控制器1236能够通过无线网络进行通信。在至少一个实施例中,网络接口1224可以包括射频前端,用于从基带到射频的上转换以及从射频到基带的下转换。在至少一个实施例中,可以以任何技术上可行的方式执行频率转换。例如,可以通过公知的过程和/或使用超外差过程来执行频率转换。在至少一个实施例中,射频前端功能可以由单独的芯片提供。在至少一个实施例中,网络接口可以包括用于通过lte、wcdma、umts、gsm、cdma2000、蓝牙、蓝牙le、wi-fi、z-wave、zigbee、lorawan和/或其他无线协议进行通信的无线功能。

216.在至少一个实施例中,车辆1200可以还包括一个或更多个数据存储1228,其可以包括但不限于片外(例如,一个或更多个soc 1204)存储。在至少一个实施例中,一个或更多个数据存储1228可以包括但不限于一个或更多个存储元件,包括ram、sram、动态随机存取存储器(“dram”)、视频随机存取存储器(“vram”)、闪存、硬盘和/或其他组件和/或可以存储至少一位数据的设备。

217.在至少一个实施例中,车辆1200可以还包括一个或更多个gnss传感器1258(例如,gps和/或辅助gps传感器),以辅助地图绘制、感知、占用光栅生成和/或路径规划功能。在至少一个实施例中,可以使用任何数量的gnss传感器1258,包括例如但不限于使用具有以太网的usb连接器连接到串行接口(例如rs-232)桥的gps。

218.在至少一个实施例中,车辆1200可以还包括一个或更多个radar传感器1260。在至少一个实施例中,一个或更多个radar传感器1260可以由车辆1200用于远程车辆检测,即使在黑暗和/或恶劣天气条件下。在至少一个实施例中,radar功能安全级别可以是asil b。在至少一个实施例中,一个或更多个radar传感器1260可以使用can总线和/或总线1202(例如,以传输由一个或更多个radar传感器1260生成的数据)来进行控制和访问对象跟踪数据,在某些示例中可以访问以太网通道以访问原始数据。在至少一个实施例中,可以使用各种各样的radar传感器类型。例如但不限于,radar传感器1260中的一个或更多个传感器可适合于前、后和侧面radar使用。在至少一个实施例中,一个或更多个radar传感器1260是脉冲多普勒radar传感器。

219.在至少一个实施例中,一个或更多个radar传感器1260可以包括不同的配置,例如具有窄视野的远程、具有宽事业的近程、近程侧面覆盖等。在至少一个实施例中,远程radar可以用于自适应巡航控制功能。在至少一个实施例中,远程radar系统可以提供通过两次或更多次独立扫描(例如在250m范围内)实现的宽广的视野。在至少一个实施例中,一个或更多个radar传感器1260可以帮助在静态对象和运动对象之间区分,并且可以被adas系统1238用于紧急制动辅助和向前碰撞警告。在至少一个实施例中,包括在远程radar系统中的一个或更多个传感器1260可以包括但不限于具有多个(例如六个或更多个)固定radar天线以及高速can和flexray接口的单基地多模式radar。在至少一个实施例中,具有六个天线、中央四个天线可以创建聚焦的波束图,该波束图设计为以较高的速度记录车辆1200的周围环境,而相邻车道的交通干扰最小。在至少一个实施例中,其他两个天线可以扩大视野,从而可以快速检测进入或离开车道的车辆1200。

220.在至少一个实施例中,作为示例,中程radar系统可包括例如高达160m(前)或80m(后)的范围,以及高达42度(前)或150度(后)的视野。在至少一个实施例中,短程radar系统可以包括但不限于设计成安装在后保险杠的两端的任意数量的radar传感器1260。当安装在后保险杠的两端时,在至少一个实施例中,radar传感器系统可以产生两个光束,该两个光束不断地监测车辆后部方向和附近的盲点。在至少一个实施例中,短程radar系统可以在adas系统1238中用于盲点检测和/或车道改变辅助。

221.在至少一个实施例中,车辆1200可以还包括一个或更多个超声传感器1262。在至少一个实施例中,可以定位在车辆1200的前、后和/或侧面位置的一个或更多个超声传感器1262可以用于停车辅助和/或创建和更新占用光栅。在至少一个实施例中,可以使用各种各样的超声传感器1262,并且可以将不同的超声传感器1262用于不同的检测范围(例如2.5m、4m)。在至少一个实施例中,超声传感器1262可以在asil b的功能安全级别下操作。

222.在至少一个实施例中,车辆1200可以包括一个或更多个lidar传感器1264。在至少一个实施例中,一个或更多个lidar传感器1264可以用于对象和行人检测、紧急制动、避免碰撞和/或其他功能。在至少一个实施例中,一个或更多个lidar传感器1264可以在功能安全级别asil b操作。在至少一个实施例中,车辆1200可以包括可以使用以太网通道的多个(例如,两个、四个、六个等)lidar传感器1264(例如,将数据提供给千兆以太网交换机)。

223.在至少一个实施例中,一个或更多个lidar传感器1264可能能够提供针对360度视野的对象及其距离的列表。在至少一个实施例中,市售的一个或更多个lidar传感器1264例如可以具有大约100m的广告范围,具有2cm-3cm的精度,并且支持100mbps的以太网连接。在

至少一个实施例中,可以使用一个或更多个非突出的lidar传感器。在这样的实施例中,一个或更多个lidar传感器1264可以包括可以嵌入到车辆1200的前、后、侧面和/或拐角位置中的小型设备。在至少一个实施例中,一个或更多个lidar传感器1264,在这样的实施例中,即使对于低反射率的对象,也可以提供高达120度的水平视野和35度的垂直视野,并且具有200m的范围。在至少一个实施例中,可将前向一个或更多个lidar传感器1264配置为用于45度至135度之间的水平视野。

224.在至少一个实施例中,也可以使用lidar技术(诸如3d闪光lidar)。在至少一个实施例中,3d闪光lidar使用激光闪光作为传输源,以照亮车辆1200周围大约200m。在至少一个实施例中,闪光lidar单元包括但不限于接收器,该接收器记录激光脉冲传播时间和每个像素上的反射光,该像素又对应于从车辆1200到对象的范围。在至少一个实施例中,闪光lidar可以允许利用每个激光闪光来生成周围环境的高度准确且无失真的图像。在至少一个实施例中,可以部署四个闪光lidar传感器,在车辆1200的每一侧部署一个传感器。在至少一个实施例中,3d闪光lidar系统包括但不限于除了风扇(例如非扫描lidar设备)以外没有移动部件的固态3d视线阵列lidar相机。在至少一个实施例中,闪光lidar设备可以每帧使用5纳秒的i类(人眼安全)激光脉冲,并且可以捕获反射激光,作为3d测距点云和共同登记的强度数据。

225.在至少一个实施例中,车辆1200还可包括一个或更多个imu传感器1266。在至少一个实施例中,一个或更多个imu传感器1266可位于车辆1200的后轴中心。在至少一个实施例中,一个或更多个imu传感器1266可以包括,例如但不限于,一个或更多个加速度计、一个或更多个磁力计、一个或更多个陀螺仪、一个磁罗盘、多个磁罗盘和/或其他传感器类型。在至少一个实施例中,例如在六轴应用程序中,一个或更多个imu传感器1266可以包括但不限于加速度计和陀螺仪。在至少一个实施例中,例如在九轴应用程序中,一个或更多个imu传感器1266可以包括但不限于加速度计、陀螺仪和磁力计。

226.在至少一个实施例中,一个或更多个imu传感器1266可以实现为结合了微机电系统(“mems”)惯性传感器,高灵敏度gps接收器和先进的卡尔曼滤波算法的微型高性能gps辅助惯性导航系统(“gps/ins”),以提供位置、速度和姿态的估算;在至少一个实施例中,一个或更多个imu传感器1266可使车辆1200估算航向而无需来自磁传感器通过直接观测和关联从gps到一个或更多个imu传感器1266的速度变化来实现的输入。在至少一个实施例中,一个或更多个imu传感器1266和一个或更多个gnss传感器1258可以组合在单个集成单元中。

227.在至少一个实施例中,车辆1200可以包括放置在车辆1200内和/或周围的一个或更多个麦克风1296。在至少一个实施例中,此外,一个或更多个麦克风1296可以用于紧急车辆检测和识别。

228.在至少一个实施例中,车辆1200可以还包括任何数量的相机类型,包括一个或更多个立体相机1268、一个或更多个广角相机1270、一个或更多个红外相机1272、一个或更多个环绕相机1274、一个或更多个远程相机1298、一个或更多个中程相机1276和/或其他相机类型。在至少一个实施例中,相机可用于捕获车辆1200的整个外围周围的图像数据。在至少一个实施例中,所使用的相机的类型取决于车辆1200。在至少一个实施例中,相机类型的任何组合可以是用于在车辆1200周围提供必要覆盖范围。在至少一个实施例中,部署的相机的数量可以根据实施例而不同。例如,在至少一个实施例中,车辆1200可以包括六个相机、

七个相机、十个相机、十二个相机或其他数量的相机。在至少一个实施例中,相机可以作为示例但不限于支持千兆位多媒体串行链路(“gmsl”)和/或千兆位以太网通信。在至少一个实施例中,本文先前参照图12a和图12b可以更详细地描述了每个相机。

229.在至少一个实施例中,车辆1200可以还包括一个或更多个振动传感器1242。在至少一个实施例中,一个或更多个振动传感器1242可以测量车辆1200的部件(例如,轴)的振动。例如,在至少一个实施例中,振动的变化可以指示路面的变化。在至少一个实施例中,当使用两个或更多个振动传感器1242时,振动之间的差异可以用于确定路面的摩擦或打滑(例如,当在动力驱动轴和自由旋转轴之间存在振动差异时)。

230.在至少一个实施例中,车辆1200可以包括adas系统1238。在至少一个实施例中,adas系统1238可以包括但不限于soc。在至少一个实施例中,adas系统1238可以包括但不限于任何数量的自主/自适应/自动巡航控制(“acc”)系统、协作自适应巡航控制(“cacc”)系统、前撞警告(“fcw”)系统、自动紧急制动(“aeb”)系统、车道偏离警告(“ldw”)系统、车道保持辅助(“lka”)系统、盲区警告(“bsw”)系统、后方交叉交通警告(“rctw”)系统、碰撞警告(“cw”)系统、车道对中(“lc”)系统和/或其他系统、特征和/或功能及其组合。

231.在至少一个实施例中,acc系统可以使用一个或更多个radar传感器1260、一个或更多个lidar传感器1264和/或任何数量的相机。在至少一个实施例中,acc系统可以包括纵向acc系统和/或横向acc系统。在至少一个实施例中,纵向acc系统监控并控制到紧邻车辆1200的另一车辆的距离,并自动调节车辆1200的速度以保持与前方车辆的安全距离。在至少一个实施例中,横向acc系统执行距离保持,并在需要时建议车辆1200改变车道。在至少一个实施例中,横向acc与其他adas应用程序有关,例如lc和cw。

232.在至少一个实施例中,cacc系统使用来自其他车辆的信息,该信息可以经由网络接口1224和/或一个或更多个无线天线1226从其他车辆接收经由无线链路或者间接经由网络连接(例如,经由互联网)接收。在至少一个实施例中,直接链路可以由车辆到车辆(“v2v”)的通信链路提供,而间接链路可以由基础设施到车辆(“i2v”)的通信链路提供。通常,v2v通信提供关于紧接在前的车辆(例如,紧接在车辆1200之前并与之在同一车道上的车辆)的信息,而i2v通信提供关于更前方交通的信息。在至少一个实施例中,cacc系统可以包括i2v和v2v信息源之一或两者。在至少一个实施例中,在给定车辆1200之前的车辆的信息的情况下,cacc系统可以更可靠,并且具有改善交通流的平滑度并减少道路拥堵的潜力。

233.在至少一个实施例中,fcw系统被设计成警告驾驶员危险,以便该驾驶员可以采取纠正措施。在至少一个实施例中,fcw系统使用前向相机和/或一个或更多个radar传感器1260,其耦合至专用处理器、dsp、fpga和/或asic,其电耦合至提供驾驶员反馈,例如显示器、扬声器和/或振动组件。在至少一个实施例中,fcw系统可以提供警告,例如以声音、视觉警告,振动和/或快速制动脉冲的形式。

234.在至少一个实施例中,aeb系统检测到与另一车辆或其他对象的即将发生的向前碰撞,并且如果驾驶员在指定的时间或距离参数内未采取纠正措施,则可以自动施加制动。在至少一个实施例中,aeb系统可以使用耦合到专用处理器、dsp、fpga和/或asic的一个或更多个前向相机和/或一个或更多个radar传感器1260。在至少一个实施例中,当aeb系统检测到危险时,它通常首先警告驾驶员采取纠正措施以避免碰撞,并且,如果该驾驶员没有采取纠正措施,则该aeb系统可以自动施加制动器以试图防止或至少减轻预测碰撞的影响。在

至少一个实施例中,aeb系统可以包括诸如动态制动器支持和/或即将发生碰撞的制动的技术。

235.在至少一个实施例中,当车辆1200越过车道标记时,ldw系统提供视觉、听觉和/或触觉警告,例如方向盘或座椅振动,以警告驾驶员。在至少一个实施例中,当驾驶员诸如通过激活转向信号灯指示有意的车道偏离时,ldw系统不活跃。在至少一个实施例中,ldw系统可以使用耦合到专用处理器、dsp、fpga和/或asic的面向正面的相机,其被电耦合以提供诸如显示器、扬声器和/或振动组件之类的驾驶员反馈。在至少一个实施例中,lka系统是ldw系统的一种变型。在至少一个实施例中,如果车辆1200开始离开车道,则lka系统提供转向输入或制动以校正车辆1200。

236.在至少一个实施例中,bsw系统检测并警告汽车盲区中的车辆驾驶员。在至少一个实施例中,bsw系统可以提供视觉、听觉和/或触觉警报,以指示合并或改变车道是不安全的。在至少一个实施例中,当驾驶员使用转向灯时,bsw系统可以提供附加警告。在至少一个实施例中,bsw系统可以使用耦合到专用处理器、dsp、fpga和/或asic的一个或更多个朝后侧的相机和/或一个或更多个radar传感器1260,其电耦合到驾驶员反馈,例如显示器、扬声器和/或振动组件。

237.在至少一个实施例中,当在车辆1200倒车时在后相机范围之外检测到对象时,rctw系统可以提供视觉、听觉和/或触觉通知。在至少一个实施例中,rctw系统包括aeb系统,以确保应用程序车辆制动器以避免碰撞。在至少一个实施例中,rctw系统可以使用一个或更多个面向后方的radar传感器1260,其耦合到专用处理器、dsp、fpga和/或asic,其被电耦合以提供诸如显示器、扬声器和/或振动组件之类的驾驶员反馈。

238.在至少一个实施例中,常规的adas系统可能易于产生误报结果,这可能使驾驶员烦恼和分散注意力,但通常不是灾难性的,因为常规的adas系统会警告驾驶员并允许该驾驶员决定安全状况是否真正存在并采取相应动作。在至少一个实施例中,在结果冲突的情况下,车辆1200本身决定是否听从主计算机或副计算机(例如,控制器1236的第一控制器或第二控制器)的结果。例如,在至少一个实施例中,adas系统1238可以是用于将感知信息提供给备份计算机合理性模块的备用和/或辅助计算机。在至少一个实施例中,备用计算机合理性监控器可以在硬件组件上运行冗余的各种软件,以检测感知和动态驾驶任务中的故障。在至少一个实施例中,可以将来自adas系统1238的输出提供给监控mcu。在至少一个实施例中,如果来自主计算机的输出和来自辅助计算机的输出冲突,则监督mcu决定如何协调冲突以确保安全操作。

239.在至少一个实施例中,主计算机可以配置为向监督mcu提供置信度分数,以指示该主计算机对所选结果的置信度。在至少一个实施例中,如果该置信度得分超过阈值,则该监督mcu可以遵循该主计算机的指示,而不管该辅助计算机是否提供冲突或不一致的结果。在至少一个实施例中,在置信度得分不满足阈值的情况下,并且在主计算机和辅助计算机指示不同的结果(例如,冲突)的情况下,监督mcu可以在计算机之间仲裁以确定适当的结果。

240.在至少一个实施例中,监督mcu可以配置为运行神经网络,该神经网络被训练和配置为至少部分地基于来自主计算机的输出和来自辅助计算机的输出来确定该辅助计算机提供错误警报的条件。在至少一个实施例中,监督mcu中的神经网络可以学习何时可以信任辅助计算机的输出,以及何时不能信任。例如,在至少一个实施例中,当该辅助计算机是基

于radar的fcw系统时,该监督mcu中的神经网络可以学习fcw系统何时识别实际上不是危险的金属对象,例如会触发警报的排水格栅或井盖。在至少一个实施例中,当辅助计算机是基于相机的ldw系统时,当存在骑自行车的人或行人并且实际上车道偏离是最安全的操作时,监督mcu中的神经网络可以学会覆盖ldw。在至少一个实施例中,监督mcu可以包括适合于运行具有相关联的存储器的神经网络的dla或gpu中的至少一个。在至少一个实施例中,监督mcu可以包括和/或被包括为一个或更多个soc 1204的组件。

241.在至少一个实施例中,adas系统1238可以包括使用传统的计算机视觉规则执行adas功能的辅助计算机。在至少一个实施例中,该辅助计算机可以使用经典计算机视觉规则(如果-则),并且监督mcu中的神经网络的存在可以提高可靠性、安全性和性能。例如,在至少一个实施例中,多样化的实现方式和有意的非同一性使得整个系统更加容错,尤其是对于由软件(或软件-硬件接口)功能引起的故障。例如,在至少一个实施例中,如果在主计算机上运行的软件中存在软件漏洞或错误,并且在辅助计算机上运行的不相同的软件代码提供了一致的总体结果,则监督mcu可以更有把握地认为总体结果是正确,并且该主计算机上的软件或硬件中的漏洞不会导致重大错误。

242.在至少一个实施例中,可以将adas系统1238的输出输入到主计算机的感知模块和/或主计算机的动态驾驶任务模块中。例如,在至少一个实施例中,如果adas系统1238由于正前方的对象而指示向前碰撞警告,则感知块可以在识别对象时使用该信息。在至少一个实施例中,如本文所述,辅助计算机可以具有其自己的神经网络,该神经网络经过训练从而降低了误报的风险。

243.在至少一个实施例中,车辆1200可以还包括信息娱乐soc 1230(例如,车载信息娱乐系统(ivi))。尽管被示出和描述为soc,但是在至少一个实施例中,信息娱乐系统soc 1230可以不是soc,并且可以包括但不限于两个或更多个分立组件。在至少一个实施例中,信息娱乐soc 1230可以包括但不限于硬件和软件的组合,其可以用于提供音频(例如,音乐、个人数字助理、导航指令、新闻、广播等)、视频(例如,电视、电影、流媒体等)、电话(例如,免提通话)、网络连接(例如,lte、wifi等)和/或信息服务(例如,导航系统、后停车辅助、无线电数据系统、与车辆相关的信息,例如燃油水平、总覆盖距离、制动燃油水平、油位、车门打开/关闭、空气滤清器信息等)到车辆1200。例如,信息娱乐soc 1230可以包括收音机、磁盘播放器、导航系统、视频播放器、usb和蓝牙连接、汽车、车载娱乐系统、wifi、方向盘音频控制、免提语音控制、抬头显示器(“hud”)、hmi显示器1234、远程信息处理设备、控制面板(例如,用于控制各种组件、特征和/或系统和/或与之交互)和/或其他组件。在至少一个实施例中,信息娱乐soc 1230可以进一步用于向车辆1200的用户提供信息(例如,视觉和/或听觉的),诸如来自adas系统1238的信息、自动驾驶信息(诸如计划的车辆操纵)、轨迹、周围环境信息(例如,交叉路口信息、车辆信息、道路信息等)和/或其他信息。

244.在至少一个实施例中,信息娱乐soc 1230可以包括任何数量和类型的gpu功能。在至少一个实施例中,信息娱乐soc 1230可以通过总线1202与车辆1200的其他设备、系统和/或组件通信。在至少一个实施例中,信息娱乐soc 1230可以是耦合到监控mcu,使得信息娱乐系统的gpu可以在主控制器1236(例如,车辆1200的主计算机和/或备用计算机)发生故障的情况下执行一些自动驾驶功能。在至少一个实施例中,信息娱乐soc 1230可以使车辆1200进入司机到安全停止模式,如本文所述。

245.在至少一个实施例中,车辆1200可以还包括仪表板1232(例如,数字仪表板、电子仪表板、数字仪表操纵板等)。在至少一个实施例中,仪表板1232可以包括但不限于控制器和/或超级计算机(例如,离散控制器或超级计算机)。在至少一个实施例中,仪表板1232可以包括但不限于一组仪表的任何数量和组合,例如车速表、燃料水平、油压、转速表、里程表、转弯指示器、换档位置指示器、一个或更多个安全带警告灯、一个或更多个驻车制动警告灯、一个或更多个发动机故障灯、辅助约束系统(例如安全气囊)信息、照明控件、安全系统控件、导航信息等。在某些示例中,信息可能是在信息娱乐soc 1230和仪表板1232之间显示和/或共享。在至少一个实施例中,仪表板1232可以被包括作为信息娱乐soc 1230的一部分,反之亦然。

246.推理和/或训练逻辑915用于执行与一个或更多个实施例相关联的推理和/或训练操作。本文结合图9a和/或图9b提供关于推理和/或训练逻辑915的细节。在至少一个实施例中,推理和/或训练逻辑915可以在系统图12c中用于至少部分地基于使用神经网络训练操作\神经网络功能和/或架构或本文所述的神经网络用例计算出的权重参数来推理或预测操作。

247.在至少一个实施例中,适配了一个或更多个电路、处理器、计算系统或其他设备或技术,参照所述图,以使第一一个或更多个神经网络使得至少部分地基于第二一个或更多个神经网络或其他机器学习模型的性能要求来确定计算资源以执行推理。在至少一个实施例中,根据在此关于之前的图1-8所描述的各种技术和实施例,这在所述附图的实施例中执行。

248.图12d是根据至少一个实施例的在基于云的服务器与图12a的自动驾驶车辆1200之间进行通信的系统1276的图。在至少一个实施例中,系统1276可以包括但不限于一个或更多个服务器1278、一个或更多个网络1290以及任何数量和类型的车辆,包括车辆1200。在至少一个实施例中,一个或更多个服务器1278可以包括但不限于,多个gpu 1284(a)-1284(h)(在本文中统称为gpu 1284)、pcie交换机1282(a)-1282(d)(在本文中统称为pcie交换机1282),和/或cpu 1280(a)-1280(b)(在本文中统称为cpu 1280)、gpu 1284、cpu 1280和pcie交换机1282可以与高速连接线互连,例如但不限于,由nvidia开发的nvlink接口1288和/或pcie连接1286。在至少一个实施例中,gpu 1284通过nvlink和/或nvswitchsoc连接,gpu 1284和pcie交换机1282通过pcie互连连接。尽管示出了八个gpu 1284、两个cpu 1280和四个pcie交换机1282,但这并不旨在进行限制。在至少一个实施例中,一个或更多个服务器1278中的每一个可以包括但不限于任意数量的gpu 1284、cpu 1280和/或pcie交换机1282的任何组合。例如,在至少一个实施例中,一个或更多个服务器1278可各自包括八个、十六个、三十二个和/或更多个gpu 1284。

249.在至少一个实施例中,一个或更多个服务器1278可以通过一个或更多个网络1290并从车辆接收表示图像的图像数据,该图像示出了意外的或改变的道路状况,例如最近开始的道路工程。在至少一个实施例中,一个或更多个服务器1278可以通过一个或更多个网络1290并且向车辆传输经更新的等神经网络1292,和/或地图信息1294,包括但不限于关于交通和道路状况的信息。在至少一个实施例中,对地图信息1294的更新可以包括但不限于对hd地图1222的更新,例如关于建筑工地、坑洼、便道、洪水和/或其他障碍物的信息。在至少一个实施例中,神经网络1292和/或地图信息1294可能是由从环境中的任何数量的车辆

接收的数据中表示的新训练和/或经验产生的,和/或至少基于在数据中心执行的训练(例如,使用一个或更多个服务器1278和/或其他服务器)。

250.在至少一个实施例中,一个或更多个服务器1278可以用于至少部分地基于训练数据来训练机器学习模型(例如,神经网络)。在至少一个实施例中,训练数据可以由车辆产生,和/或可以在模拟中产生(例如,使用游戏引擎)。在至少一个实施例中,标记任何数量的训练数据(例如,在相关的神经网络受益于监督学习的情况下)和/或经历其他预处理。在至少一个实施例中,没有对任何数量的训练数据进行标记和/或预处理(例如,在相关联的神经网络不需要监督学习的情况下)。在至少一个实施例中,一旦机器学习模型被训练,机器学习模型就可以被车辆使用(例如,通过一个或更多个网络1290传输到车辆,和/或机器学习模型可以被一个或更多个服务器1278使用以远程监控车辆。

251.在至少一个实施例中,一个或更多个服务器1278可以从车辆接收数据并且将数据应用程序于最新的实时神经网络以用于实时智能推理。在至少一个实施例中,一个或更多个服务器1278可以包括由一个或更多个gpu 1284供电的深度学习超级计算机和/或专用ai计算机,例如由nvidia开发的dgx和dgx station机器。然而,在至少一个实施例中,一个或更多个服务器1278可以包括使用cpu供电的数据中心的深度学习基础设施。

252.在至少一个实施例中,一个或更多个服务器1278的深度学习基础结构可能能够进行快速、实时的推理,并且可以使用该能力来评估和验证车辆1200中处理器、软件和/或相关硬件的健康。例如,在至少一个实施例中,深度学习基础设施可以从车辆1200接收周期性更新,例如车辆1200在该图像序列中所定位的图像序列和/或对象(例如,通过计算机视觉和/或其他机器学习对象分类技术)。在至少一个实施例中,深度学习基础设施可以运行其自己的神经网络以识别对象并将它们与车辆1200所识别的对象进行比较,并且,如果结果不匹配和深度学习基础设施断定车辆1200中的ai正在发生故障,则一个或更多个服务器1278可以将信号发送到车辆1200,以指示车辆1200的故障安全计算机采取控制、通知乘客并完成安全停车操作。

253.在至少一个实施例中,一个或更多个服务器1278可以包括一个或更多个gpu 1284和一个或更多个可编程推理加速器(例如nvidia的tensorrt 3设备)。在至少一个实施例中,gpu驱动的服务器和推理加速的组合可以使实时响应成为可能。在至少一个实施例中,例如在性能不太关键的情况下,可以将由cpu、fpga和其他处理器驱动的服务器用于推理。在至少一个实施例中,硬件结构915用于执行一个或更多个实施例。本文结合图9a和/或图9b提供关于硬件结构915的细节。

254.计算机系统

255.图13是示出根据至少一个实施例示例性计算机系统的框图,该示例性计算机系统可以是具有互连的设备和组件的系统,片上系统(soc)或它们的某种形成有处理器的组合,该处理器可以包括执行单元以执行指令。在至少一个实施例中,根据本公开,例如本文所述的实施例,计算机系统1300可以包括但不限于组件,例如处理器1302,其执行单元包括逻辑以执行用于过程数据的算法。在至少一个实施例中,计算机系统1300可以包括处理器,例如可从加利福尼亚圣塔克拉拉的英特尔公司(intel corporation of santa clara,california)获得的处理器家族、xeon

tm

、xscale

tm

和/或strongarm

tm

,core

tm

或nervana

tm

微处理器,尽管也可以使用其他系统(包括

具有其他微处理器的pc、工程工作站、机顶盒等)。在至少一个实施例中,计算机系统1300可以执行可从华盛顿州雷蒙德市的微软公司(microsoft corporation of redmond,wash.)获得的windows操作系统版本,尽管其他操作系统(例如unix和linux)、嵌入式软件和/或图形用户界面也可以使用。

256.实施例可以用在其他设备中,例如手持设备和嵌入式应用程序。手持设备的一些示例包括蜂窝电话、互联网协议(internet protocol)设备、数码相机、个人数字助理(“pda”)和手持pc。在至少一个实施例中,嵌入式应用程序可以包括微控制器、数字信号处理器(“dsp”)、片上系统、网络计算机(“netpc”)、机顶盒、网络集线器、广域网(“wan”)交换机,或根据至少一个实施例可以执行一个或更多个指令的任何其他系统。

257.在至少一个实施例中,计算机系统1300可包括但不限于处理器1302,该处理器1302可包括但不限于一个或更多个执行单元1308,以根据本文描述的技术执行机器学习模型训练和/或推理。在至少一个实施例中,计算机系统1300是单处理器台式机或服务器系统,但是在另一实施例中,计算机系统1300可以是多处理器系统。在至少一个实施例中,处理器1302可以包括但不限于复杂指令集计算机(“cisc”)微处理器、精简指令集计算(“risc”)微处理器、超长指令字(“vliw”)微处理器、实现指令集组合的处理器,或任何其他处理器设备,例如数字信号处理器。在至少一个实施例中,处理器1302可以耦合到处理器总线1310,该处理器总线1310可以在处理器1302与计算机系统1300中的其他组件之间传输数据信号。

258.在至少一个实施例中,处理器1302可以包括但不限于1级(“l1”)内部高速缓存存储器(“cache”)1304。在至少一个实施例中,处理器1302可以具有单个内部高速缓存或多级内部缓存。在至少一个实施例中,高速缓存存储器可以驻留在处理器1302的外部。根据特定的实现和需求,其他实施例也可以包括内部和外部高速缓存的组合。在至少一个实施例中,寄存器文件1306可以在各种寄存器中存储不同类型的数据,包括但不限于整数寄存器、浮点寄存器、状态寄存器和指令指针寄存器。

259.在至少一个实施例中,包括但不限于执行整数和浮点运算的逻辑的执行单元1308,其也位于处理器1302中。在至少一个实施例中,处理器1302还可以包括微码(“ucode”)只读存储器(“rom”),用于存储某些宏指令的微代码。在至少一个实施例中,执行单元1308可以包括用于处理封装指令集1309的逻辑。在至少一个实施例中,通过将封装指令集1309包括在通用处理器的指令集中,以及要执行指令的相关电路,可以使用处理器1302中的封装数据来执行许多多媒体应用程序使用的操作。在至少一个实施例中,可以通过使用处理器的数据总线的全宽度来在封装的数据上执行操作来加速和更有效地执行许多多媒体应用程序,这可能不需要在该处理器的数据总线上传输较小的数据单元来一次执行一个数据元素的一个或更多个操作。

260.在至少一个实施例中,执行单元1308也可以用在微控制器、嵌入式处理器、图形设备、dsp和其他类型的逻辑电路中。在至少一个实施例中,计算机系统1300可以包括但不限于存储器1320。在至少一个实施例中,存储器1320可以为动态随机存取存储器(“dram”)设备、静态随机存取存储器(“sram”)设备、闪存设备或另一个存储设备。在至少一个实施例中,存储器1320可以存储由处理器1302可以执行的由数据信号表示的指令1319和/或数据1321。

261.在至少一个实施例中,系统逻辑芯片可以耦合到处理器总线1310和存储器1320。在至少一个实施例中,系统逻辑芯片可以包括但不限于存储器控制器集线器(“mch”)1316,并且处理器1302可以经由处理器总线1310与mch 1316通信。在至少一个实施例中,mch 1316可以提供到存储器1320的高带宽存储器路径1318以用于指令和数据存储以及用于图形命令、数据和纹理的存储。在至少一个实施例中,mch 1316可以在处理器1302、存储器1320和计算机系统1300中的其他组件之间启动数据信号,并且在处理器总线1310、存储器1320和系统i/o接口1322之间桥接数据信号。在至少一个实施例中,系统逻辑芯片可以提供用于耦合到图形控制器的图形端口。在至少一个实施例中,mch 1316可以通过高带宽存储器路径1318耦合到存储器1320,并且图形/视频卡1312可以通过加速图形端口(accelerated graphics port)(“agp”)互连1314耦合到mch 1316。

262.在至少一个实施例中,计算机系统1300可以使用系统i/o接口1322作为专有集线器接口总线来将mch 1316耦合到i/o控制器集线器(“ich”)1330。在至少一个实施例中,ich 1330可以通过本地i/o总线提供与某些i/o设备的直接连接。在至少一个实施例中,本地i/o总线可以包括但不限于用于将外围设备连接到存储器1320、芯片组和处理器1302的高速i/o总线。示例可以包括但不限于音频控制器1329、固件集线器(“flash bios”)1328、无线收发器1326、数据存储1324、包含用户输入和键盘接口1325的传统i/o控制器1323、串行扩展端口1327(例如通用串行总线(usb)端口)和网络控制器1334。在至少一个实施例中,数据存储1324可以包括硬盘驱动器、软盘驱动器、cd-rom设备、闪存设备或其他大容量存储设备。

263.在至少一个实施例中,图13示出了一种系统,该系统包括互连的硬件设备或“芯片”,而在其他实施例中,图13可以示出示例性soc。在至少一个实施例中,图13中所示出的设备可以与专用互连、标准化互连(例如,pcie)或其某种组合互连。在至少一个实施例中,计算机系统1300的一个或更多个组件使用快速计算链路(cxl)互连来互连。

264.推理和/或训练逻辑915用于执行与一个或更多个实施例相关联的推理和/或训练操作。本文结合图9a和/或9b提供了关于推理和/或训练逻辑915的细节。在至少一个实施例中,推理和/或训练逻辑915可以用于系统图13中,用于至少部分地基于使用在此描述的神经网络训练操作、神经网络功能和/或架构或神经网络使用情况计算的权重参数来推理或预测操作。

265.在至少一个实施例中,适配了一个或更多个电路、处理器、计算系统或其他设备或技术,参照所述图,以使第一一个或更多个神经网络使得至少部分地基于第二一个或更多个神经网络或其他机器学习模型的性能要求来确定计算资源以执行推理。在至少一个实施例中,根据在此关于之前的图1-8所描述的各种技术和实施例,这在所述附图的实施例中执行。

266.图14是示出根据至少一个实施例的用于利用处理器1410的电子设备1400的框图。在至少一个实施例中,电子设备1400可以是例如但不限于笔记本、塔式服务器、机架式服务器、刀片式服务器、膝上型计算机、台式计算机、平板计算机、移动设备、电话、嵌入式计算机或任何其他合适的电子设备。

267.在至少一个实施例中,电子设备1400可以包括但不限于通信地耦合到任何合适数量或种类的组件、外围设备、模块或设备的处理器1410。在至少一个实施例中,处理器1410使用总线或接口耦合,诸如i2c总线、系统管理总线(“smbus”)、低引脚计数(lpc)总线、串行

外围接口(“spi”),高清晰度音频(“hda”)总线、串行高级技术附件(“sata”)总线、通用串行总线(“usb”)(版本1、2、3等)或通用异步接收器/发送器(“uart”)总线。在至少一个实施例中,图14示出了包括互连的硬件设备或“芯片”的系统,而在其他实施例中,图14可以示出示例性soc。在至少一个实施例中,图14中所示出的设备可以与专用互连、标准化互连(例如,pcie)或其某种组合互连。在至少一个实施例中,使用计算快速链路(cxl)互连来互连图14的一个或更多个组件。

268.在至少一个实施例中,图14可包括显示器1424、触摸屏1425、触摸板1430、近场通信单元(“nfc”)1445、传感器集线器1440、热传感器1446、快速芯片组(“ec”)1435、受信平台模块(“tpm”)1438、bios/固件/闪存(“bios,fw闪存”)1422、dsp 1460、驱动器1420(如固态磁盘(“ssd”)或硬盘驱动器(“hdd”))、无线局域网单元(“wlan”)1450、蓝牙单元1452、无线广域网单元(“wwan”)1456、全球定位系统(gps)单元1455、相机(“usb 3.0相机”)1454(如usb 3.0相机)和/或以例如lpddr3标准实现的低功率双倍数据速率(“lpddr”)存储器单元(“lpddr3”)1415。这些组件可以各自以任何合适的方式实现。

269.在至少一个实施例中,其他组件可通过本文描述的组件通信地耦合到处理器1410。在至少一个实施例中,加速度计1441、环境光传感器(“als”)1442、罗盘1443和陀螺仪1444可以通信地耦合至传感器集线器1440。在至少一个实施例中,热传感器1439、风扇1437、键盘1436和触摸板1430可以通信地耦合到ec 1435。在至少一个实施例中,扬声器1463、耳机1464和麦克风(“mic”)1465可以通信地耦合至音频单元(“音频编解码器和d类放大器”)1462,该音频单元又可以通信地耦合至dsp 1460。在至少一个实施例中,音频单元1462可包括,例如但不限于,音频编码器/解码器(“编解码器”)和d类放大器。在至少一个实施例中,sim卡(“sim”)1457可以通信地耦合到wwan单元1456。在至少一个实施例中,可以在下一代形状因子(“ngff”)中实现诸如wlan单元1450和蓝牙单元1452以及wwan单元1456之类的组件。

270.推理和/或训练逻辑915用于执行与一个或更多个实施例相关联的推理和/或训练操作。本文结合图9a和/或9b提供了关于推理和/或训练逻辑915的细节。在至少一个实施例中,推理和/或训练逻辑915可以在图14的系统中用于至少部分地基于使用在此描述的神经网络训练操作、神经网络功能和/或架构或神经网络使用情况计算的权重参数来推理或预测操作。

271.在至少一个实施例中,适配了一个或更多个电路、处理器、计算系统或其他设备或技术,参照所述图,以使第一一个或更多个神经网络使得至少部分地基于第二一个或更多个神经网络或其他机器学习模型的性能要求来确定计算资源以执行推理。在至少一个实施例中,根据在此关于之前的图1-8所描述的各种技术和实施例,这在所述附图的实施例中执行。

272.图15示出了根据至少一个实施例的计算机系统1500。在至少一个实施例中,计算机系统1500被配置为实现贯穿本公开所描述的不同过程和方法。

273.在至少一个实施例中,计算机系统1500包括但不限于至少一个中央处理单元(“cpu”)1502,该中央处理单元连接至使用任何合适的协议实现的通信总线1510,诸如pci(“外围组件互连”)、快速外围组件互连(“pci-express”)、agp(“加速图形端口”)、超传输或任何其他总线或点对点通信协议。在至少一个实施例中,计算机系统1500包括但不限于主

存储器1504和控制逻辑(例如,被实现为硬件、软件或其组合),并且数据被存储在主存储器1504中,该主存储器可以采取随机存取存储器(“ram”)的形式。在至少一个实施例中,网络接口子系统(“网络接口”)1522提供到其他计算设备和网络的接口,该接口用于从具有计算机系统1500的其他系统接收数据和向具有计算机系统1500的其他系统传输数据。

274.在至少一个实施例中,在至少一个实施例中,计算机系统1500包括但不限于输入设备1508、并行处理系统1512、以及可以使用常规阴极射线管(“crt”)、液晶显示器(“lcd”)、发光二极管(“led”)显示器、等离子体显示器或其他适合的显示技术实现的显示设备1506。在至少一个实施例中,从诸如键盘、鼠标、触摸板、麦克风等之类的输入设备1508接收用户输入。在至少一个实施例中,本文所述的每个模块可位于单个半导体平台上以形成处理系统。

275.推理和/或训练逻辑915用于执行与一个或更多个实施例相关联的推理和/或训练操作。本文结合图9a和/或9b提供了关于推理和/或训练逻辑915的细节。在至少一个实施例中,推理和/或训练逻辑915可以用于系统图15中,用于至少部分地基于使用在此描述的神经网络训练操作、神经网络功能和/或架构或神经网络使用情况计算的权重参数来推理或预测操作。

276.在至少一个实施例中,适配了一个或更多个电路、处理器、计算系统或其他设备或技术,参照所述图,以使第一一个或更多个神经网络使得至少部分地基于第二一个或更多个神经网络或其他机器学习模型的性能要求来确定计算资源以执行推理。在至少一个实施例中,根据在此关于之前的图1-8所描述的各种技术和实施例,这在所述附图的实施例中执行。

277.图16示出了根据至少一个实施例的计算机系统1600。在至少一个实施例中,计算机系统1600包括但不限于计算机1610和usb棒1620。在至少一个实施例中,计算机1610可包括但不限于任何数量和类型的处理器(未示出)和存储器(未示出)。在至少一个实施例中,计算机1610包括但不限于服务器、云实例、膝上型计算机和台式计算机。

278.在至少一个实施例中,usb棒1620包括但不限于处理单元1630、usb接口1640和usb接口逻辑1650。在至少一个实施例中,处理单元1630可以是能够执行指令的任何指令执行系统、装置或设备。在至少一个实施例中,处理单元1630可以包括但不限于任何数量和类型的处理核(未示出)。在至少一个实施例中,处理单元1630包括被优化成执行与机器学习相关联的任何量和类型的操作的专用集成电路(“asic”)。例如,在至少一个实施例中,处理单元1630是被优化为执行机器学习推理操作的张量处理单元(“tpc”)。在至少一个实施例中,处理单元1630是被优化为执行机器视觉和机器学习推理操作的视觉处理单元(“vpu”)。

279.在至少一个实施例中,usb接口1640可以是任何类型的usb连接器或usb插座。例如,在至少一个实施例中,usb接口1640是用于数据和电力的usb 3.0类型c插座。在至少一个实施例中,usb接口1640是usb 3.0类型a连接器。在至少一个实施例中,usb接口逻辑1650可以包括使得处理单元1630能够经由usb连接器1640与设备(例如,计算机1610)接合的任何量和类型的逻辑。

280.推理和/或训练逻辑915用于执行与一个或更多个实施例相关联的推理和/或训练操作。本文结合图9a和/或图9b提供了关于推理和/或训练逻辑915的细节。在至少一个实施例中,推理和/或训练逻辑915可以用于至少部分地基于使用在此描述的神经网络训练操

作、神经网络功能和/或架构、或神经网络使用情况计算的权重参数来推理或预测操作。

281.在至少一个实施例中,适配了一个或更多个电路、处理器、计算系统或其他设备或技术,参照所述图,以使第一一个或更多个神经网络使得至少部分地基于第二一个或更多个神经网络或其他机器学习模型的性能要求来确定计算资源以执行推理。在至少一个实施例中,根据在此关于之前的图1-8所描述的各种技术和实施例,这在所述附图的实施例中执行。

282.图17a示出了示例性架构,其中多个gpu 1710(1)-1710(n)通过高速链路1740(1)-1740(n)(例如,总线/点对点互连等)通信地耦合到多个多核心处理器1705(1)-1705(m)。在至少一个实施例中,高速链路1740(1)-1740(n)支持4gb/s、30gb/s、80gb/s或更高的通信吞吐量。在至少一个实施例中,可以使用各种互连协议,包括但不限于pcie 4.0或5.0以及nvlink 2.0。在各个图中,“n”和“m”表示正整数,其值可因图而异。

283.此外,在至少一个实施例中,两个或更多个gpu 1710通过高速链路1729(1)-1729(2)互连,该高速链路可以使用与用于高速链路1740(1)-1740(n)的协议/链路类似或不同的协议/链路来实现。类似地,两个或更多个多核心处理器1705可以通过高速链路1728连接,该高速链路可以是以20gb/s、30gb/s、120gb/s或更高的速度运行的对称多处理器(smp)总线。可替代地,可以使用类似的协议/链路(例如,通过公共互连结构)来完成图17a中所示的各种系统组件之间的所有通信。

284.在至少一个实施例中,每个多核心处理器1705分别经由存储器互连1726(1)-1726(m)通信地耦合到处理器存储器1701(1)-1701(m),并且每个gpu 1710(1)-1710(n)分别通过gpu存储器互连1750(1)-1750(n)通信地耦合到gpu存储器1720(1)-1720(n)。在至少一个实施例中,存储器互连1726和1750可以利用相似或不同的存储器访问技术。作为示例而非限制,处理器存储器1701(1)-1701(m)和gpu存储器1720可以是易失性存储器,诸如动态随机存取存储器(dram)(包括堆叠的dram)、图形ddr sdram(gddr)(例如gddr5、gddr6),或高带宽存储器(hbm),和/或可以是非易失性存储器,例如3d xpoint或nano-ram。在至少一个实施例中,处理器存储器1701的某些部分可以是易失性存储器,而另一部分可以是非易失性存储器(例如,使用两级存储器(2lm)层次)。

285.如本文所述,尽管各种多核心处理器1705和gpu 1710可以分别物理地耦合到特定存储器1701、1720,和/或可以实现统一存储器架构,其中虚拟系统地址空间(也称为“有效地址”空间)分布在各个物理存储器之间。例如,处理器存储器1701(1)-1701(m)可以各自包含64gb的系统存储器地址空间,并且gpu存储器1720(1)-1720(n)可以各自包含32gb的系统存储器地址空间,从而当m=2和n=4时,导致总计256gb的可寻址存储器大小。n和m也可能是其他值。

286.图17b示出了根据一个示例性实施例的用于多核心处理器1707和图形加速模块1746之间互连的附加细节。在至少一个实施例中,图形加速模块1746可以包括集成在线路卡上的一个或更多个gpu芯片,该线路卡经由高速链路1740(例如,pcie总线、nvlink等)耦合到处理器1707。在至少一个实施例中,图形加速模块1746可以选择性地集成在具有处理器1707的封装或芯片上。

287.在至少一个实施例中,处理器1707包括多个核心1760a-1760d,每个核心都具有转换后备缓冲区(“tlb”)1761a-1761d和一个或更多个高速缓存1762a-1762d。在至少一个实

施例中,核心1760a-1760d可以包括未示出的各种其他组件,用于执行指令和处理数据。在至少一个实施例中,高速缓存1762a-1762d可以包括级别1(l1)和级别2(l2)高速缓存。此外,一个或更多个共享高速缓存1756可以被包括在高速缓存1762a-1762d中,并且由各组核心1760a-1760d共享。例如,处理器1707的一个实施例包括24个核心,每个核心具有其自己的l1高速缓存,十二个共享的l2高速缓存,和十二个共享的l3高速缓存。在该实施例中,两个相邻核心共享一个或更多个l2和l3高速缓存。在至少一个实施例中,处理器1707和图形加速模块1746与系统存储器1714连接,该系统存储器1714可以包括图17a中的处理器存储器1701(1)-1701(m)。

288.在至少一个实施例中,通过一致性总线1764经由核心间通信为存储在各个高速缓存1762a-1762d、1756和系统存储器1714中的数据和指令维护一致性。在至少一个实施例中,例如,每个高速缓存可以具有与其相关联的高速缓存一致性逻辑/电路,以响应于检测到对特定高速缓存行的读取或写入通过一致性总线1764进行通信。在至少一个实施例中,通过一致性总线1764实现高速缓存监听协议,以监听(snoop)高速缓存访问。

289.在至少一个实施例中,代理电路1725将图形加速模块1746通信地耦合到一致性总线1764,从而允许图形加速模块1746作为核心1760a-1760d的对等方参与高速缓存一致性协议。特别地,在至少一个实施例中,接口1735通过高速链路1740提供到代理电路1725的连接,并且接口1737将图形加速模块1746连接到高速链路1740。

290.在至少一个实施例中,加速器集成电路1736代表图形加速模块的多个图形处理引擎1731(1)-1731(n)提供高速缓存管理、存储器访问、上下文管理和中断管理服务。在至少一个实施例中,图形处理引擎1731(1)-1731(n)可各自包括单独的图形处理单元(gpu)。在至少一个实施例中,图形处理引擎1731(1)-1731(n)选择性地可以包括gpu内的不同类型的图形处理引擎,诸如图形执行单元、媒体处理引擎(例如,视频编码器/解码器)、采样器和blit引擎。在至少一个实施例中,图形加速模块1746可以是具有多个图形处理引擎1731(1)-1731(n)的gpu,或者图形处理引擎1731(1)-1731(n)可以是集成在通用封装、线路卡或芯片上的各个gpu。

291.在至少一个实施例中,加速器集成电路1736包括存储器管理单元(mmu)1739,用于执行各种存储器管理功能,例如虚拟到物理存储器转换(也称为有效到真实存储器转换),还包括用于访问系统存储器1714的存储器访问协议。在至少一个实施例中,mmu 1739还可包括转换后备缓冲区(“tlb”)(未示出),用于高速缓存虚拟/有效到物理/真实地址转换。在至少一个实施例中,高速缓存1738可以存储命令和数据,用于图形处理引擎1731(1)-1731(n)有效地访问。在至少一个实施例中,可能使用获取单元1744,将存储在高速缓存1738和图形存储器1733(1)-1733(m)中的数据与核心高速缓存1762a-1762d、1756和系统存储器1714保持一致。如前所述,可以经由代表高速缓存1738和图形存储器1733(1)-1733(m)的代理电路1725来完成该任务(例如,将与处理器高速缓存1762a-1762d、1756上的高速缓存行的修改/访问有关的更新发送到高速缓存1738,并从高速缓存1738接收更新)。

292.在至少一个实施例中,一组寄存器1745存储由图形处理引擎1731(1)-1731(n)执行的线程的上下文数据,并且上下文管理电路1748管理线程上下文。例如,上下文管理电路1748可以执行保存和恢复操作,以在上下文切换期间保存和恢复各个线程的上下文(例如,其中保存第一线程并且存储第二线程,以便可以由图形处理引擎执行第二线程)。例如,上

下文管理电路1748在上下文切换时,可以将当前寄存器值存储到存储器中的(例如,由上下文指针识别的)指定区域。然后,当返回上下文时可以恢复寄存器值。在至少一个实施例中,中断管理电路1747接收并处理从系统设备接收的中断。

293.在至少一个实施例中,mmu 1739将来自图形处理引擎1731的虚拟/有效地址转换为系统存储器1714中的真实/物理地址。在至少一个实施例中,加速器集成电路1736支持多个(例如,4、8、16)图形加速器模块1746和/或其他加速器设备。在至少一个实施例中,图形加速器模块1746可以专用于在处理器1707上执行的单个应用程序,或者可以在多个应用程序之间共享。在至少一个实施例中,呈现了虚拟化的图形执行环境,其中图形处理引擎1731(1)-1731(n)的资源与多个应用程序或虚拟机(vm)共享。在至少一个实施例中,可以基于处理要求和与vm和/或应用程序相关联的优先级,将资源细分为“切片”,其被分配给不同的vm和/或应用程序。

294.在至少一个实施例中,加速器集成电路1736作为图形加速模块1746的系统的桥来执行,并提供地址转换和系统存储器高速缓存服务。另外,在至少一个实施例中,加速器集成电路1736可以为主机处理器提供虚拟化设施,以管理图形处理引擎1731(1)-1731(n)的虚拟化、中断和存储器管理。

295.在至少一个实施例中,由于图形处理引擎1731(1)-1731(n)的硬件资源被明确地映射到主机处理器1707看到的真实地址空间,因此任何主机处理器都可以使用有效地址值直接寻址这些资源。在至少一个实施例中,加速器集成电路1736的一个功能是物理分离图形处理引擎1731(1)-1731(n),使得它们在系统看来为独立的单元。

296.在至少一个实施例中,一个或更多个图形存储器1733(1)-1733(m)分别耦合到每个图形处理引擎1731(1)-1731(n),并且n=m。在至少一个实施例中,图形存储器1733(1)-1733(m)存储指令和数据,所述指令和数据由每个图形处理引擎1731(1)-1731(n)处理。在至少一个实施例中,图形存储器1733(1)-1733(m)可以是易失性存储器,例如dram(包括堆叠的dram)、gddr存储器(例如,gddr5,gddr6)或hbm,和/或可以是非易失性存储器,例如3d xpoint或nano-ram。

297.在至少一个实施例中,为了减少高速链路1740上的数据流量,使用偏置技术以确保存储在图形存储器1733(1)-1733(m)中的数据是图形处理引擎1731(1)-1731(n)最常使用的,并且最好核心1760a-1760d不使用(至少不经常使用)的数据。类似地,在至少一个实施例中,偏置机制试图将核心(并且优选地不是图形处理引擎1731(-1)-1731(n))需要的数据保持在高速缓存1762a-1762d、1756和系统存储器1714中。

298.图17c示出了另一个示例性实施例,其中加速器集成电路1736被集成在处理器1707内。在该实施例中,图形处理引擎1731(1)-1731(n)经由接口1737和接口1735(同样可以是任何形式的总线或接口协议)通过高速链路1740直接与加速器集成电路1736通信。在至少一个实施例中,加速器集成电路1736可以执行与关于图17b描述的操作类似的操作。但是由于它紧密靠近一致性总线1764和高速缓存1762a-1762d、1756,可能具有更高的吞吐量。在至少一个实施例中,加速器集成电路支持不同的编程模型,包括专用进程编程模型(无图形加速模块虚拟化)和共享编程模型(具有虚拟化),所述编程模型可以包括由加速器集成电路1736控制的编程模型和由图形加速模块1746控制的编程模型。

299.在至少一个实施例中,图形处理引擎1731(1)-1731(n)专用于单个操作系统下的

单个应用程序或进程。在至少一个实施例中,单个应用程序可以将其他应用程序请求汇聚(funnel)到图形处理引擎1731(1)-1731(n),从而在vm/分区内提供虚拟化。

300.在至少一个实施例中,图形处理引擎1731(1)-1731(n)可以被多个vm/应用程序分区共享。在至少一个实施例中,共享模型可以使用系统管理程序来虚拟化图形处理引擎1731(1)-1731(n),以允许每个操作系统进行访问。在至少一个实施例中,对于没有管理程序的单分区系统,操作系统拥有图形处理引擎1731(1)-1731(n)。在至少一个实施例中,操作系统可以虚拟化图形处理引擎1731(1)-1731(n),以提供对每个进程或应用程序的访问。

301.在至少一个实施例中,图形加速模块1746或个体图形处理引擎1731(1)-1731(n)使用进程句柄来选择进程元素。在至少一个实施例中,进程元素被存储在系统存储器1714中,并且可使用本文所述的有效地址到真实地址转换技术来寻址。在至少一个实施例中,进程句柄可以是特定于实现方式的值,其在向图形处理引擎1731(1)-1731(n)注册其上下文时提供给主机进程(即,调用系统软件以将进程元素添加到进程元素链接列表)。在至少一个实施例中,进程句柄的较低16位可以是进程元素在进程元素链接列表中的偏移量。

302.图17d示出了示例性加速器集成切片1790。在至少一个实施例中,“切片”包括加速器集成电路1736的处理资源的指定部分。在至少一个实施例中,应用程序是系统存储器1714中的有效地址空间1782,其存储进程元素1783。在至少一个实施例中,响应于来自在处理器1707上执行的应用程序1780的gpu调用1781,存储进程元素1783。在至少一个实施例中,进程元素1783包含相应的应用程序1780的进程状态。在一个实施例中,包含在进程元素1783中的工作描述符(wd)1784可以是由应用程序请求的单个作业,或者可以包含指向作业队列的指针。在至少一个实施例中,wd 1784是指向应用程序的有效地址空间1782中的作业请求队列的指针。

303.在至少一个实施例中,图形加速模块1746和/或各个图形处理引擎1731(1)-1731(n)可以由系统中所有进程或进程子集共享。在至少一个实施例中,可以包括用于设置进程状态并将wd 1784发送到图形加速模块1746以在虚拟化环境中开始作业的基础设施。

304.在至少一个实施例中,专用进程编程模型是特定于实现方式的。在至少一个实施例中,在该模型中,单个进程拥有图形加速模块1746或个体图形处理引擎1731。在至少一个实施例中,当图形加速模块1746由单个进程拥有时,管理程序初始化用于所拥有的分区的加速器集成电路,当指派了图形加速模块1746时,操作系统初始化用于所拥有的进程的加速器集成电路1736。

305.在至少一个实施例中,在操作中,加速器集成切片1790中的wd获取单元1791获取下一个wd 1784,其包括要由图形加速模块1746的一个或更多个图形处理引擎完成的工作的指示。在至少一个实施例中,来自wd 1784的数据可以存储在寄存器1745中,并由mmu 1739、中断管理电路1747和/或上下文管理电路1748使用,如图所示。例如,mmu 1739的一个实施例包括用于访问os虚拟地址空间1785内的段/页表1786的段/页漫游电路。在至少一个实施例中,中断管理电路1747可以处理从图形加速模块1746接收的中断事件1792。在至少一个实施例中,当执行图形操作时,由图形处理引擎1731(1)-1731(n)生成的有效地址1793被mmu 1739转换为实地址。

306.在至少一个实施例中,为每个图形处理引擎1731(1)-1731(n)和/或图形加速模块1746复制寄存器1745,并且所述寄存器1745可以由管理程序或操作系统初始化。在至少一

个实施例中,这些复制的寄存器中的每一个可以被包括在加速器集成切片1790中。可以由管理程序初始化的示例性寄存器在表1中示出。

[0307][0308][0309]

表2中示出了可由操作系统初始化的示例性寄存器。

[0310][0311]

在至少一个实施例中,每个wd 1784特定于特定的图形加速模块1746和/或图形处理引擎1731(1)-1731(n)。在至少一个实施例中,它包含图形处理引擎1731(1)-1731(n)完成工作所需的所有信息,或者它可以是指向存储器位置的指针,在该存储器位置应用程序已经设置了要完成的工作的命令队列。

[0312]

图17e示出了共享模型的一个示例性实施例的附加细节。该实施例包括管理程序真实地址空间1798,其中存储了进程元素列表1799。在至少一个实施例中,可经由管理程序1796来访问管理程序实地址空间1798,所述管理程序1796虚拟化用于操作系统1795的图形加速模块引擎。

[0313]

在至少一个实施例中,共享编程模型允许来自系统中全部分区或分区子集的全部进程或进程子集使用图形加速模块1746。在至少一个实施例中,存在两种编程模型,其中图形加速模块1746由多个进程和分区共享,即,时间切片共享和图形定向共享。

[0314]

在至少一个实施例中,在该模型中,系统管理程序1796拥有图形加速模块1746,并使其功能可用于所有操作系统1795。在至少一个实施例中,对于图形加速模块1746通过系统管理程序1796支持虚拟化,图形加速模块1746可以遵守某些要求,例如(1)应用程序的作业请求必须是自主的(即,不需要在作业之间保持状态),或者图形加速模块1746必须提供上下文保存和恢复机制,(2)图形加速模块1746保证应用程序的作业请求在指定的时间量内完成,包括任何转换错误,或者图形加速模块1746提供了抢占作业处理的能力,并且(3)在有向共享编程模型中进行操作时,必须确保图形加速模块1746进程之间的公平性。

[0315]

在至少一个实施例中,需要应用程序1780使用图形加速模块类型、工作描述符(wd)、权限屏蔽寄存器(amr)值和上下文保存/恢复区域指针(csrp)进行操作系统1795系统调用。在至少一个实施例中,图形加速模块类型描述了用于系统调用的目标加速函数。在至少一个实施例中,图形加速模块类型可以是系统特定的值。在至少一个实施例中,wd是专门为图形加速模块1746格式化的,并且可以采用图形加速模块1746命令、指向用户定义的结构的有效地址指针、指向命令队列的有效地址指针的形式,或描述要由图形加速模块1746完成的工作的任何其他数据结构。

[0316]

在至少一个实施例中,amr值是用于当前进程的amr状态。在至少一个实施例中,传递给操作系统的值与设置amr的应用程序类似。在至少一个实施例中,如果加速器集成电路1736(未示出)和图形加速模块1746的实现不支持用户权限屏蔽覆写寄存器(uamor),则在管理程序调用中传递amr之前,操作系统可以将当前uamor值应用于amr值。在至少一个实施例中,管理程序1796可以在将amr放入进程元素1783中之前选择性地应用当前权限屏蔽覆写寄存器(amor)值。在至少一个实施例中,csrp是寄存器1745中的一个,所述寄存器包含应用程序的有效地址空间1782中的区域的有效地址,供图形加速模块1746保存和恢复上下文状态。在至少一个实施例中,如果不需要在作业之间保存状态或者当作业被抢占时,则该指针是可选的。在至少一个实施例中,上下文保存/恢复区域可以是固定的系统存储器。

[0317]

在接收到系统调用时,操作系统1795可以验证应用程序1780已经注册并且被授予使用图形加速模块1746的权限。然后,在至少一个实施例中,操作系统1795使用表3中所示的信息来调用管理程序1796。

[0318]

[0319][0320]

在至少一个实施例中,在接收到管理程序调用时,管理程序1796验证操作系统1795已注册并被授予使用图形加速模块1746的权限。然后,在至少一个实施例中,管理程序1796将进程元素1783放入相应的图形加速模块1746类型的进程元素链接列表中。在至少一个实施例中,进程元素可以包括表4中所示的信息。

[0321][0322]

在至少一个实施例中,管理程序初始化多个加速器集成切片1790寄存器1745。

[0323]

如图17f所示,在至少一个实施例中,使用统一存储器,所述统一存储器可经由用于访问物理处理器存储器1701(1)-1701(n)和gpu存储器1720(1)-1720(n)的公共虚拟存储器地址空间来寻址。在该实现方式中,在gpu 1710(1)-1710(n)上执行的操作利用相同的虚拟/有效存储器地址空间来访问处理器存储器1701(1)-1701(m),反之亦然,从而简化了可编程性。在至少一个实施例中,虚拟/有效地址空间的第一部分被分配给处理器存储器1701(1),第二部分被分配给第二处理器存储器1701(n),第三部分被分配给gpu存储器1720(1),以此类推。在至少一个实施例中,整个虚拟/有效存储器空间(有时称为有效地址空间)由此分布在处理器存储器1701和gpu存储器1720的每一个中,从而允许任何处理器或gpu采用映

射到任何物理存储器的虚拟地址访问该存储器。

[0324]

在至少一个实施例中,一个或更多个mmu 1739a-1739e内的偏置/一致性管理电路1794a-1794e确保一个或更多个主机处理器(例如,1705)与gpu 1710的高速缓存之间的高速缓存一致性,并实现指示应在其中存储某些类型的数据的物理存储器的偏置技术。在至少一个实施例中,虽然在图17f中示出了偏置/一致性管理电路1794a-1794e的多个实例,但可以在一个或更多个主机处理器1705的mmu内和/或在加速器集成电路1736内实现偏置/一致性电路。

[0325]

一个实施例允许将gpu存储器1720映射为系统存储器的一部分,并使用共享虚拟存储器(svm)技术进行访问,但不会遭受与完整系统高速缓存一致性相关的性能缺陷。在至少一个实施例中,将gpu存储器1720作为系统存储器来访问而无需繁重的高速缓存一致性开销的能力为gpu卸载提供了有利的操作环境。在至少一个实施例中,该布置允许主机处理器1705的软件设置操作数并访问计算结果,而没有传统的i/o dma数据拷贝的开销。在至少一个实施例中,这样的传统拷贝包括驱动程序调用、中断和存储器映射i/o(mmio)访问,相对于简单的存储器访问而言,这些访问效率均较低。在至少一个实施例中,在没有高速缓存一致性开销的情况下访问gpu存储器1720的能力对于卸载的计算的执行时间可能是关键的。在至少一个实施例中,例如,在具有大量流式写入存储器流量的情况下,高速缓存一致性开销可以显著降低gpu 1710所看到的有效写入带宽。在至少一个实施例中,操作数设置的效率、结果访问的效率和gpu计算的效率可能会在确定gpu卸载的有效性方面发挥作用。

[0326]

在至少一个实施例中,gpu偏置和主机处理器偏置的选择由偏置跟踪器数据结构驱动。在至少一个实施例中,例如,可以使用偏置表,所述偏置表可以是页面粒度结构(例如,以存储器页面的粒度来控制),该页面粒度结构包括每个gpu附加的存储器页面1或2位。在至少一个实施例中,在gpu 1710中具有或不具有偏置高速缓存(例如,用于高速缓存偏置表的频繁/最近使用的条目)的情况下,可以在一个或更多个gpu存储器1720的被盗存储器范围中实现偏置表。替代地,在至少一个实施例中,可以在gpu内维护整个偏置表。

[0327]

在至少一个实施例中,在实际访问gpu存储器之前,访问与对gpu附加存储器1720的每次访问相关联的偏置表条目,从而引起以下操作。在至少一个实施例中,来自gpu 1710的在gpu偏置中找到其页面的本地请求被直接转发到对应的gpu存储器1720。在至少一个实施例中,来自gpu的在主机偏置中找到其页面的本地请求被转发至处理器1705(例如,通过本文所述的高速链路)。在至少一个实施例中,来自处理器1705的在主机处理器偏置中找到所请求页面的请求完成了与正常存储器读取类似的请求。替代地,可以将指向gpu偏置页面的请求转发到gpu 1710。在至少一个实施例中,如果gpu当前不使用页面,则gpu可随后将页面迁移到主机处理器偏置。在至少一个实施例中,页面的偏置状态可以通过基于软件的机制、基于硬件辅助的软件的机制、或者在有限的情况下通过纯粹基于硬件的机制来改变。

[0328]

在至少一个实施例中,一种用于改变偏置状态的机制采用api调用(例如opencl),所述api调用随后调用gpu的设备驱动程序,所述设备驱动程序随后发送消息(或使命令描述符入队)到gpu,引导gpu改变偏置状态,并在某些迁移中在主机中执行高速缓存刷新操作。在至少一个实施例中,高速缓存刷新操作用于从主机处理器1705偏置到gpu偏置的迁移,但是不用于相反的迁移。

[0329]

在至少一个实施例中,高速缓存一致性是通过暂时渲染主机处理器1705无法高速

缓存的gpu偏置页面来维护的。在至少一个实施例中,为了访问这些页面,处理器1705可以请求来自gpu 1710的访问,gpu 1710可以或可以不立即授予访问权限。因此,在至少一个实施例中,为了减少处理器1705和gpu 1710之间的通信,确保gpu偏置页面是gpu所需的页面而不是主机处理器1705所需的页面是有益的,反之亦然。

[0330]

一个或更多个硬件结构915用于执行一个或更多个实施例。在本文中可以结合图9a和/或图9b提供关于一个或更多个硬件结构915的细节。

[0331]

图18示出了根据本文所述的各个实施例的示例性集成电路和相关联的图形处理器,其可以使用一个或更多个ip核心来制造。除了图示之外,在至少一个实施例中可以包括其他逻辑和电路,包括附加的图形处理器/核心、外围接口控制器或通用处理器核心。

[0332]

图18是示出根据至少一个实施例的可使用一个或更多个ip核心制造的芯片集成电路1800上的示例性系统的框图。在至少一个实施例中,集成电路1800包括一个或更多个应用程序处理器1805(例如,cpu)、至少一个图形处理器1810,并且可以另外包括图像处理器1815和/或视频处理器1820,其中任意一个可能是模块化ip核心。在至少一个实施例中,集成电路1800包括外围或总线逻辑,其包括usb控制器1825、uart控制器1830、spi/sdio控制器1835和i22s/i22c控制器1840。在至少一个实施例中,集成电路1800可以包括显示设备1845耦合到高清多媒体接口(hdmi)控制器1850和移动工业处理器接口(mipi)显示接口1855中的一个或更多个。在至少一个实施例中,存储可以由闪存子系统1860提供,包括闪存和闪存控制器。在至少一个实施例中,可以经由存储器控制器1865提供存储器接口以用于访问sdram或sram存储器设备。在至少一个实施例中,一些集成电路还包括嵌入式安全引擎1870。

[0333]

推理和/或训练逻辑915用于执行与一个或更多个实施例相关联的推理和/或训练操作。本文结合图9a和/或图9b提供关于推理和/或训练逻辑915的细节。在至少一个实施例中,推理和/或训练逻辑915可以在集成电路1800中用于至少部分地基于使用神经网络训练操作、神经网络功能和/或架构或本文描述的神经网络用例计算的权重参数来推理或预测操作。

[0334]

在至少一个实施例中,适配了一个或更多个电路、处理器、计算系统或其他设备或技术,参照所述图,以使第一一个或更多个神经网络使得至少部分地基于第二一个或更多个神经网络或其他机器学习模型的性能要求来确定计算资源以执行推理。在至少一个实施例中,根据在此关于之前的图1-8所描述的各种技术和实施例,这在所述附图的实施例中执行。

[0335]

图19a和图19b示出了根据本文所述的各个实施例的示例性集成电路和相关联的图形处理器,其可以使用一个或更多个ip核心来制造。除了图示之外,在至少一个实施例中可以包括其他逻辑和电路,包括附加的图形处理器/核心、外围接口控制器或通用处理器核心。

[0336]

图19a-19b是示出根据本文描述的实施例的在soc内使用的示例性图形处理器的框图。图19a示出了根据至少一个实施例的片上系统集成电路的示例性图形处理器1910,其可以使用一个或更多个ip核心来制造。图19b示出了根据至少一个实施例的片上系统集成电路的附加示例性图形处理器1940,其可以使用一个或更多个ip核心来制造。在至少一个实施例中,图19a的图形处理器1910是低功耗图形处理器核心。在至少一个实施例中,图19b

的图形处理器1940是更高性能的图形处理器核心。在至少一个实施例中,每个图形处理器1910、1940可以是图18的图形处理器1810的变体。

[0337]

在至少一个实施例中,图形处理器1910包括顶点处理器1905和一个或更多个片段处理器1915a-1915n(例如1915a、1915b、1915c、1915d至1915n-1和1915n)。在至少一个实施例中,图形处理器1910可以经由单独的逻辑来执行不同的着色器程序,使得顶点处理器1905被优化以执行针对顶点着色器程序的操作,而一个或更多个片段处理器1915a-1915n执行片段(例如,像素)着色操作用于片段或像素或着色器程序。在至少一个实施例中,顶点处理器1905执行3d图形管线的顶点处理阶段并生成图元和顶点数据。在至少一个实施例中,一个或更多个片段处理器1915a-1915n使用由顶点处理器1905生成的图元和顶点数据来生成在显示设备上显示的帧缓冲区。在至少一个实施例中,一个或更多个片段处理器1915a-1915n被优化以执行如在opengl api中所提供的片段着色器程序,其可以用于执行与在direct 3d api中所提供的像素着色器程序类似的操作。

[0338]

在至少一个实施例中,图形处理器1910附加地包括一个或更多个存储器管理单元(mmu)1920a-1920b、一个或更多个高速缓存1925a-1925b和一个或更多个电路互连1930a-1930b。在至少一个实施例中,一个或更多个mmu 1920a-1920b提供用于图形处理器1910的虚拟到物理地址的映射,包括用于顶点处理器1905和/或片段处理器1915a-1915n,其可以引用存储在存储器中的顶点或图像/纹理数据,除了存储在一个或更多个高速缓存1925a-1925b中的顶点或图像/纹理数据之外。在至少一个实施例中,一个或更多个mmu 1920a-1920b可以与系统内的其他mmu同步,包括与图18的一个或更多个应用程序处理器1805、图像处理器1815和/或视频处理器1820相关联的一个或更多个mmu,使得每个处理器1805-1820可以参与共享或统一的虚拟存储器系统。在至少一个实施例中,一个或更多个电路互连1930a-1930b使图形处理器1910能够经由soc的内部总线或经由直接连接与soc内的其他ip核心相连接。

[0339]

在至少一个实施例中,图形处理器1940包括一个或更多个着色器核心1955a-1955n(例如,1955a、1955b、1955c、1955d、1955e、1955f到1955n-1和1955n),如图19b所示,其提供了统一的着色器核心架构,其中单个核心或类型或核心可以执行所有类型的可编程着色器代码,包括用于实现顶点着色器、片段着色器和/或计算着色器的着色器程序代码。在至少一个实施例中,多个着色器核心可以变化。在至少一个实施例中,图形处理器1940包括核心间任务管理器1945,其充当线程分派器以将执行线程分派给一个或更多个着色器核心1955a-1955n和分块单元1958,以加速基于图块渲染的分块操作,其中在图像空间中细分了场景的渲染操作,例如,以利用场景内的局部空间一致性或优化内部缓存的使用。

[0340]

推理和/或训练逻辑915用于执行与一个或更多个实施例相关联的推理和/或训练操作。本文结合图9a和/或图9b提供关于推理和/或训练逻辑915的细节。在至少一个实施例中,推理和/或训练逻辑915可以在集成电路图19a和/或图19b中用于至少部分地基于使用神经网络训练操作、神经网络函数或架构,或本文所述的神经网络用例计算的权重参数来进行推理或预测操作。

[0341]

在至少一个实施例中,适配了一个或更多个电路、处理器、计算系统或其他设备或技术,参照所述图,以使第一一个或更多个神经网络使得至少部分地基于第二一个或更多个神经网络或其他机器学习模型的性能要求来确定计算资源以执行推理。在至少一个实施

例中,根据在此关于之前的图1-8所描述的各种技术和实施例,这在所述附图的实施例中执行。

[0342]

图20a-20b示出了根据本文描述的实施例的附加示例性图形处理器逻辑。在至少一个实施例中,图20a示出了可以包括在图18的图形处理器1810内的图形核心2000,并且在至少一个实施例中,其可以是如图19b所示的统一着色器核心1955a-1955n。图20b示出了在至少一个实施例中的适用于在多芯片模块上部署的高度并行的通用图形处理单元(“gpgpu”)2030。

[0343]

在至少一个实施例中,图形核心2000包括共享指令高速缓存2002、纹理单元2018和高速缓存/共享存储器2020,它们对于图形核心2000内的执行资源是通用的。在至少一个实施例中,图形核心2000可包括多个切片2001a-2001n或每个核心的分区,并且图形处理器可包括图形核心2000的多个实例。在至少一个实施例中,切片2001a-2001n可包括支持逻辑,所述逻辑包括本地指令高速缓存2004a-2004n、线程调度器2006a-2006n、线程分派器2008a-2008n和一组寄存器2010a-2010n。在至少一个实施例中,切片2001a-2001n可以包括一组附加功能单元(afu 2012a-2012n)、浮点单元(fpu 2014a-2014n)、整数算术逻辑单元(alu 2016a-2016n)、地址计算单元(acu 2013a-2013n)、双精度浮点单元(dpfpu 2015a-2015n)和矩阵处理单元(mpu 2017a-2017n)。

[0344]

在至少一个实施例中,fpu 2014a-2014n可以执行单精度(32位)和半精度(16位)浮点运算,而dpfpu 2015a-2015n则执行双精度(64位)浮点运算点操作。在至少一个实施例中,alu 2016a-2016n可以以8位、16位和32位精度执行可变精度整数运算,并且可以配置为混合精度运算。在至少一个实施例中,mpu 2017a-2017n还可被配置用于混合精度矩阵运算,包括半精度浮点运算和8位整数运算。在至少一个实施例中,mpu 2017a-2017n可以执行各种矩阵运算以加速机器学习应用程序框架,包括使得能够支持加速的通用矩阵到矩阵乘法(gemm)。在至少一个实施例中,afu 2012a-2012n可以执行浮点数或整数单元不支持的附加逻辑运算,包括三角运算(例如,正弦,余弦等)。

[0345]

推理和/或训练逻辑915用于执行与一个或更多个实施例相关联的推理和/或训练操作。这里结合图9a和/或图9b提供关于推理和/或训练逻辑915的细节。在至少一个实施例中,推理和/或训练逻辑915可以在图形核心2000中使用,用于至少部分地基于使用神经网络训练操作、神经网络函数和/或架构或本文所述的神经网络用例计算的权重参数来推理或预测操作。

[0346]

在至少一个实施例中,适配了一个或更多个电路、处理器、计算系统或其他设备或技术,参照所述图,以使第一一个或更多个神经网络使得至少部分地基于第二一个或更多个神经网络或其他机器学习模型的性能要求来确定计算资源以执行推理。在至少一个实施例中,根据在此关于之前的图1-8所描述的各种技术和实施例,这在所述附图的实施例中执行。

[0347]

图20b示出了在至少一个实施例中的通用处理单元(gpgpu)2030,其可以被配置为使得高度并行的计算操作能够由一组图形处理单元来执行。在至少一个实施例中,gpgpu 2030可以直接链接到gpgpu 2030的其他实例,以创建多gpu集群以提高用于深度神经网络的训练速度。在至少一个实施例中,gpgpu 2030包括主机接口2032,以实现与主机处理器的连接。在至少一个实施例中,主机接口2032是pci express接口。在至少一个实施例中,主机

接口2032可以是厂商专用的通信接口或通信结构。在至少一个实施例中,gpgpu 2030接收主机处理器的命令,并使用全局调度器2034,以将与那些命令相关联的执行线程分配给一组计算集群2036a-2036h。在至少一个实施例中,计算群集2036a-2036h共享高速缓存存储器2038。在至少一个实施例中,高速缓存存储器2038可以用作计算群集2036a-2036h内的高速缓存存储器的更高级别的高速缓存。

[0348]

在至少一个实施例中,gpgpu 2030包括存储器2044a-2044b,所述存储器2044a-2044b经由一组存储器控制器2042a-2042b与计算集群2036a-2036h耦合。在至少一个实施例中,存储器2044a-2044b可以包括各种类型的存储器设备,包括动态随机存取存储器(dram)或图形随机存取存储器,例如同步图形随机存取存储器(sgram),其包括图形双倍数据速率(gddr)存储器。

[0349]

在至少一个实施例中,计算集群2036a-2036h每个都包括一组图形核心,例如图20a的图形核心2000,所述图形核心可以包括多种类型的整数和浮点逻辑单元,所述逻辑单元可以在计算机各种精度范围上执行计算操作,包括适用于机器学习计算的精度。例如,在至少一个实施例中,每个计算集群2036a-2036h中的浮点单元的至少一个子集可以被配置为执行16位或32位浮点运算,而浮点单元的不同子集可以配置为执行64位浮点运算。

[0350]

在至少一个实施例中,gpgpu 2030的多个实例可以被配置为用作计算集群。在至少一个实施例中,计算集群2036a-2036h用于同步和数据交换的通信在实施例之间变化。在至少一个实施例中,gpgpu 2030的多个实例通过主机接口2032进行通信。在至少一个实施例中,gpgpu 2030包括i/o集线器2039,所述集线器将gpgpu 2030与gpu链路2040耦合,使得能够直接连接到gpgpu 2030的其他实例。在至少一个实施例中,gpu链路2040耦合到专用gpu到gpu桥,所述桥使得gpgp 2030的多个实例之间能够通信和同步。在至少一个实施例中,gpu链路2040与高速互连耦合,以向其他gpgpu或并行处理器发送和接收数据。在至少一个实施例中,gpgpu 2030的多个实例位于单独的数据处理系统中,并通过可通过主机接口2032访问的网络设备进行通信。在至少一个实施例中,gpu链路2040可被配置为使得能够连接到主机除主机接口2032之外或作为其替代的处理器。

[0351]

在至少一个实施例中,gpgpu 2030可以被配置为训练神经网络。在至少一个实施例中,可以在推理平台内使用gpgpu 2030。在至少一个实施例中,在其中使用gpgpu 2030进行推理的情况下,相对于使用gpgpu 2030训练神经网络时,gpgpu 2030可以包括更少的计算集群2036a-2036h。在至少一个实施例中,与存储器2044a-2044b相关联的存储器技术可以在推理和训练配置之间有所不同,其中更高带宽的存储器技术专用于训练配置。在至少一个实施例中,gpgpu 2030的推理配置可以支持推理特定指令。例如,在至少一个实施例中,推理配置可以提供对一个或更多个8位整数点积指令的支持,该指令可以在部署的神经网络的推理操作期间使用。

[0352]

推理和/或训练逻辑915用于执行与一个或更多个实施例相关联的推理和/或训练操作。本文结合图9a和/或图9b提供关于推理和/或训练逻辑915的细节。在至少一个实施例中,推理和/或训练逻辑915可以在gpgpu2030中使用,用于至少部分地基于使用神经网络训练操作、神经网络功能和/或架构或本文所述的神经网络用例计算的权重参数来推理或预测操作。

[0353]

在至少一个实施例中,适配了一个或更多个电路、处理器、计算系统或其他设备或

技术,参照所述图,以使第一一个或更多个神经网络使得至少部分地基于第二一个或更多个神经网络或其他机器学习模型的性能要求来确定计算资源以执行推理。在至少一个实施例中,根据在此关于之前的图1-8所描述的各种技术和实施例,这在所述附图的实施例中执行。

[0354]

图21示出了根据至少一个实施例的计算机系统2100的框图。在至少一个实施例中,计算机系统2100包括具有经由可包括存储器集线器2105的互连路径通信的一个或更多个处理器2102和系统存储器2104的处理子系统2101。在至少一个实施例中,存储器集线器2105可以是芯片组部件内的单独部件,或者可以集成在一个或更多个处理器2102内。在至少一个实施例中,存储器集线器2105通过通信链路2106与i/o子系统2111耦合。在一个实施例中,i/o子系统2111包括i/o集线器2107,所述i/o集线器可以使计算机系统2100能够接收来自一个或更多个输入设备2108的输入。在至少一个实施例中,i/o集线器2107可以使显示控制器向一个或更多个显示设备2110a提供输出,所述显示控制器可以包括在一个或更多个处理器2102中。在至少一个实施例中,与i/o集线器2107耦合的一个或更多个显示设备2110a可以包括本地,内部或嵌入式显示设备。

[0355]

在至少一个实施例中,处理子系统2101包括经由总线或其他通信链路2113耦合到存储器集线器2105的一个或更多个并行处理器2112中。在至少一个实施例中,通信链路2113可以使用任何一种许多基于标准的通信链路技术或协议,例如但不限于pci express,或者可以是特定于供应商的通信接口或通信结构。在至少一个实施例中,一个或更多个并行处理器2112形成计算集中的并行或矢量处理系统,所述系统可以包括大量处理核心和/或处理集群,例如多集成核心(mic)处理器。在至少一个实施例中,一个或更多个并行处理器2112形成图形处理子系统,所述图形处理子系统可以将像素输出到经由i/o集线器2107耦合的一个或更多个显示设备2110a之一。在至少一个实施例中,并行处理器2112还可以包括显示控制器和显示接口(未示出),以使得能够直接连接到一个或更多个显示设备2110b。

[0356]

在至少一个实施例中,系统存储单元2114可以连接到i/o集线器2107,以提供用于计算机系统2100的存储机制。在至少一个实施例中,i/o交换机2116可以用于提供一个接口机制,以实现i/o集线器2107与其他组件之间的连接,例如可以集成到平台中的网络适配器2118和/或无线网络适配器2119,以及可以通过一个或更多个附加设备2120添加的各种其他设备。在至少一个实施例中,网络适配器2118可以是以太网适配器或另一有线网络适配器。在至少一个实施例中,无线网络适配器2119可以包括wi-fi、蓝牙、近场通信(nfc)中的一个或更多个,或包括一个或更多个无线电设备的其他网络设备。

[0357]

在至少一个实施例中,计算机系统2100可以包括未明确示出的其他组件,所述其他组件包括usb或其他端口连接、光学存储驱动器、视频捕获设备等,所述其他组件也可以连接到i/o集线器2107。在至少一个实施例中,可以使用任何合适的协议(例如基于pci(外围组件互连)的协议(例如pci-express)或其他总线或点对点通信接口和/或协议)来实现互连图21中各个组件的通信路径,例如nv-link高速互连或互连协议。

[0358]

在至少一个实施例中,一个或更多个并行处理器2112包括为图形和视频处理而优化的电路,所述电路包括例如视频输出电路,并构成图形处理单元(gpu)。在至少一个实施例中,并行处理器2112包括为通用处理而优化的电路。在至少一个实施例中,计算机系统2100的组件可以与单个集成电路上的一个或更多个其他系统元件集成。例如,在至少一个

实施例中,并行处理器2112、存储器集线器2105、处理器2102和i/o集线器2107,可以被集成到片上系统(soc)集成电路中。在至少一个实施例中,计算机系统2100的组件可以被集成到单个封装中,以形成系统级封装(sip)配置。在至少一个实施例中,计算机系统2100的组件的至少一部分可以被集成到多芯片模块(mcm)中,所述多芯片模块可以与其他多芯片模块互连到模块化计算机系统中。

[0359]

推理和/或训练逻辑915用于执行与一个或更多个实施例相关联的推理和/或训练操作。本文结合图9a和/或图9b提供关于推理和/或训练逻辑915的细节。在至少一个实施例中,推理和/或训练逻辑915可以在图21的系统2100中使用,用于至少部分地基于使用神经网络训练操作、神经网络函数和/或架构或本文所述的神经网络用例计算的权重参数来推理或预测操作。

[0360]

在至少一个实施例中,适配了一个或更多个电路、处理器、计算系统或其他设备或技术,参照所述图,以使第一一个或更多个神经网络使得至少部分地基于第二一个或更多个神经网络或其他机器学习模型的性能要求来确定计算资源以执行推理。在至少一个实施例中,根据在此关于之前的图1-8所描述的各种技术和实施例,这在所述附图的实施例中执行。

[0361]

处理器

[0362]