1.本发明属于图像处理技术领域,具体涉及一种基于最小二乘圆拟合法对多光学目标进行识别的方法。

技术背景

2.大型激光装置光路模拟光准直是三大准直流程(光路自准直、模拟光准直和光路对接准直)之一。由于大型激光装置共包含8路光束,在光路对接准直过程中,虽然每束光路采集的图像不同,但每束光路具备相同的特征,只需要一种图像处理算法就能实现不同光路光学目标的识别。但是,对于三个不同的准直流程来说,每个准直流程所采集的图像特征是完全不同的。相比其他两个准直流程,模拟光准直所处理的准直图像具备不同的特点,其不同图像特征主要表现在:光学目标个数、光学目标纹理、置入特殊识别标志,如十字叉、边框、小球等。这就需要针对不同特征的图像设计不同的目标识别算法,才能分别完成大型激光装置三个不同准直流程的光路自动准直工作。

3.相比其他两个准直流程,模拟光准直所处理的准直图像具备不同的特点,光学目标主要特点为:

4.1)准直图像包含2个光学目标,分别是模拟光目标和远场目标;

5.2)模拟光目标光束质量较好,为实心的圆形光斑,光学目标较小,光斑直径大约40个像素;

6.3)远场目标光束质量较差,光斑形状及其不规则,主要表现在:光束存在不确定的纹理、边缘曲折、非连续、合计面积较大;

7.4)远场目标光强分布很不稳定,光斑形状、强弱、位置随着时间而变化;

8.5)模拟光和远场各自目标的大小、相对位置、强弱不确定,而且会随着光路准直的过程而变化。

9.基于以上模拟光准直图像的特点,模拟光准直图像处理算法不仅需要确定两个目标的相对位置,而且需要确定哪个目标是远场目标,哪个目标是模拟光目标,也就是说模拟光准直图像处理算法需要实现对两个不同光学目标的识别。

10.针对以上需求,提出一种对多光学目标进行识别的方法是十分必要的。

技术实现要素:

11.为了满足大型激光装置准直流程中光学目标识别处理对于精度和效率的要求,本发明提出一种基于最小二乘圆拟合法对多光学目标进行识别的方法。

12.本发明的具体技术方案如下:

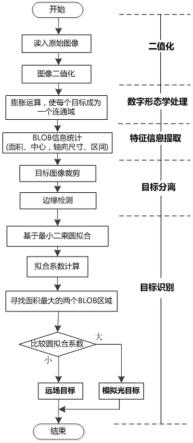

13.一种基于最小二乘圆拟合法对多光学目标进行识别的方法,包括以下步骤:

14.步骤1:对采集的原始图像进行二值化;

15.步骤2:数字形态学处理;

16.使用数字形态学的膨胀运算对二值化图像进行处理,将远场目标可能出现的多个

连通域合并为一个连通域,使得模拟光目标和远场目标分别对应一个独立的连通域;

17.步骤3:提取blob区域特征信息;

18.blob区域特征信息包含面积、中心坐标、blob区域所在图像中x方向的区间和轴长、blob区域所在图像中y方向的区间和轴长;

19.步骤4:连通域图像裁剪和边缘检测;

20.首先将每个blob区域从二值化图像裁剪出来,然后对每一个blob区域裁剪图像按照sobel算法进行边缘检测;

21.步骤5:基于最小二乘圆拟合法进行目标识别

22.步骤5.1:统计每个blob区域对应的二值化图像灰度值之和sum_all;

23.步骤5.2:将每个连通域检测到的边缘图像作为输入,使用fitcircle算法,对每个连通域进行圆拟合,并且得到边缘对应的圆心和半径;

24.步骤5.3:统计每个连通域裁剪图像位于拟合圆内的二值化图像灰度值之和sum_inner;

25.步骤5.4:计算每个连通域对应的圆拟合系数,具体公式如下:

26.fit_ratio=sum_inner/sum_all;

27.步骤5.5:从所有连通域中搜索面积最大的两个连通域,作为远场目标和模拟光目标的候选目标;

28.步骤5.6:比较两个连通域的圆拟合系数,圆拟合系数较大的作为远场目标,较小的作为远场目标。

29.进一步地,上述步骤1的具体执行过程如下:

30.设原始图像为f(x,y),将原始图像f(x,y)使用类间最大方差法进行二值化处理,二值化后取值0或255,用公式表示为:

31.f

bin

(x,y)=ostu(f(x,y))

32.式中,ostu表示类间最大方差法,(x,y)表示图像坐标。

33.进一步地,上述步骤3中每个blob区域的面积、xy方向轴长、中心坐标用公式表示为:

[0034][0035]

式中,endsnumber为链码表个数,area表示面积,lenx和leny分别表示x和y方向轴长,centerx和centery分别表示x和y方向坐标;ppoint[k].x为水平线段表起始位置,

ppoint[k 1].x为水平线段表终点位置,point_sum为blob区域包含的像素个数。

[0036]

进一步地,上述步骤4中每个blob区域的裁剪图像用公式表示为:

[0037][0038]

需要满足的条件为:

[0039][0040]

式中,i表示blob区域编号,blobcount表示blob区域个数,表示任意一个blob区域;

[0041]

每个blob区域边缘检测函数用公式表示为:

[0042][0043]

进一步地,上述步骤5.2中对每个连通域进行圆拟合的公式具体为:

[0044]

上式中,a、b代表圆心坐标;r代表半径;

[0045]

圆拟合函数fitcircle中,拟合出的圆心坐标a、b和半径r的表达式为:

[0046][0047]

上式中,p,q表示用于将每个blob区域边缘的x和y坐标分别记录的数组;y表示某个像素y方向坐标值。

[0048]

本发明的有益效果是:

[0049]

本发明的方法通过圆拟合的方式,不仅实现了模拟光目标和远场目标的识别,识别误差精度小于3个像素,处理时间小于5秒钟,满足了大型激光装置模拟光准直过程对于精度和效率的要求,为模拟光准直流程中用于光学目标判读提供有效的支撑。

附图说明

[0050]

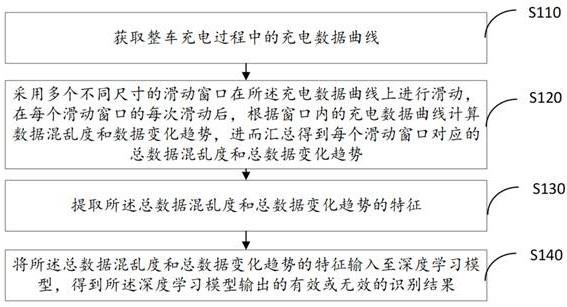

图1为本发明方法实施例的流程示意图。

[0051]

图2为模拟光准直原始图像。

[0052]

图3为图2进行二值化处理后的图像。

[0053]

图4a为图3进行一次膨胀运算后的图像。

[0054]

图4b为图4a中远场目标的放大图像。

[0055]

图4c为图3进行五次膨胀运算后的图像。

[0056]

图4d为图4c中远场目标的放大图像。

[0057]

图5a为blob1的剪裁图像;

[0058]

图5b为blob2的剪裁图像;

[0059]

图5c为blob3的剪裁图像;

[0060]

图5d为blob1的边缘检测图像;

[0061]

图5e为blob2的边缘检测图像;

[0062]

图5f为blob3的边缘检测图像;

[0063]

图6为每个blob区域图像裁剪和边缘检测结果的示意图;

[0064]

图7为8幅图像对应的模拟光目标和远场目标裁剪结果。

具体实施方式

[0065]

为了满足大型激光装置准直流程中光学目标识别处理对于精度和效率的要求,本发明提出一种基于最小二乘圆拟合法对多光学目标进行识别的方法,目标识别流程如图1所示。

[0066]

本发明的技术方案如下:

[0067]

首先,原始图像二值化;

[0068]

其次,数字形态学处理,使用膨胀运算将远场目标合并成一个较完整的连通区域;

[0069]

然后,blob区域特征信息的提取和统计;

[0070]

接着,blob区域图像裁剪和边缘检测

[0071]

最后,使用基于最小二乘圆拟合法对两个光学目标进行分类和识别;

[0072]

本文提出了基于圆拟合的多光学目标识别算法,主要步骤为:1)二值化;2)数字形态学处理;3)blob区域特征信息提取;4)blob区域图像裁剪和边缘检测;5)基于最小二乘圆拟合法目标识别。光学目标识别方法数据流程如图1所示。

[0073]

以下结合图1,通过一个实施例来进一步详述本发明。

[0074]

一、二值化

[0075]

在模拟光准直流程中,模拟光准直图像是用准直ccd采集获得的,选择一幅ccd采集图像作为原始图像,原始图像如图2所示。使用类间最大方差法对原始图像进行二值化处理,结果如图3所示。由于模拟光束质量较好,模拟光目标只有一个连通域;相反,由于远场光束质量较差、分布极为不均匀,二值化图像包含4个连通域。

[0076]

假设一路模拟光准直图像(原始图像)为f(x,y),图像尺寸为1600

×

1200,8位bmp图像,原始图像二值化处理后的二值化图像用公式表示为:

[0077]fbin

(x,y)=ostu(f(x,y)) (1)

[0078]

式中,ostu表示类间最大方差法,(x,y)表示图像坐标。

[0079]

二、数字形态学处理,blob区域合并

[0080]

(binary large object,blob)是指图像中具有相似特征(如纹理、颜色等),而且在空间上是相互连通的像素集合,即连通域。由于模拟光准直图像包含两个光学目标,两个目标具有不同的特点:模拟光目标为光束质量较好的圆形光斑,远场目标为具有不规则纹理、边缘曲折、非连续、面积较大、形态不确定光斑。为了能够将包含4个连通域的远场目标作为同一个光学目标进行识别,需要对二值化图像使用数字形态学的膨胀运算进行处理,

使得包含4个连通域的远场目标合并为一个面积更大的、较完整的光学目标。膨胀运算的图像如图4a所示。

[0081]

相比二值化图像中的光学目标,远场目标由原来的3个blob区域被合并成2个blob区域,其中一个面积较大,一个面积较小。而模拟光目标由于连通性较好,经过膨胀处理后也是一个完整的blob区域,只是面积相比原二值化图像增加了。远场目标1次膨胀运算结果图4(b)所示。经过5次膨胀运算后,远场目标完全被合并成一个完整的连通区域,整幅图像处理结果如图4(c)所示,远场目标5次膨胀运算处理如图4(d)所示。

[0082]

虽然经过多次膨胀运算可以将远场目标完全合并为一个更完整的目标,但是多次膨胀处理会消耗更多的时间,例如:1次膨胀运算用时0.359秒,经过5次膨胀运算用时2.781秒。为了提高图像识别效率,本实施例选择1次膨胀运算,结果如图4(a)(b)所示。

[0083]

按照数字形态学理论,膨胀定义为集合运算,a被b膨胀是所有结构单元原点位置组成的集合。a被b膨胀,记为定义为

[0084][0085]

其中,为空集,b为结构元素。

[0086]

为了将包含不规则纹理的远场目标合并成一个面积更大的、较完整的目标,选择5*5的结构单元,结构单元如矩阵b所示。

[0087][0088]

因此,对二值化图像进行膨胀处理,用公式表示为:

[0089][0090]

三、blob区域特征信息提取和统计

[0091]

blob分析是将预处理后的图片通过形态学处理和连通性标记分析,进而提取出物体的特征参数,依据其参数进行目标识别。一幅图像的目标识别函数,用公式表示为:

[0092]fblob

(x,y)=blobrecognize(f

delate

(x,y))(4)

[0093]

式中,blobrecognize为目标识别函数,需要统计的blob区域特征信息主要包括:面积、中心坐标、xy方向轴长等。以本实施例为例,经过膨胀运算处理后,共检测到3个bolb区域,每个blob区域的特征信息统计如表1所示。

[0094]

表1每个blob区域的特征信息统计

[0095]

[0096][0097]

表1中,面积是指为每个blob区域包含的像素个数;x和y方向区间表示blob区域所在坐标的最小值和最大值;x和y方向轴长=坐标最大值-最小值 1。以上blob区域的特征信息标识了每个blob的面积大小、位置坐标,以及每个blob所在的矩形区域四个角所包含的坐标信息,为目标识别后续步骤(blob区域裁剪和边缘检测)做好准备。

[0098]

一幅准直图像每个blob区域的特征信息存储在链表oneblob中,blob区域和链表相同,用blobcount表示,每个blob区域的面积、xy方向轴长、中心坐标用公式表示为:

[0099][0100]

式中,endsnumber为链码表个数,area表示面积,lenx和leny分别表示x和y方向轴长,centerx和centery分别表示x和y方向坐标。ppoint[k].x为水平线段表起始位置,ppoint[k 1].x为水平线段表终点位置,point_sum为blob区域包含的像素个数。

[0101]

一幅准直图像每个blob区域的特征信息存储在链表oneblob中,对应数据结构类型如表2所示。

[0102]

表2blob区域特征信息数据结构表

[0103][0104]

其中,code存储连码表,链码表code由下标和存放内容构成,表的第一列和第二列分别存放边界起点的坐标x、y,第三列存放链码的个数n,第四列开始存放第一个边界点的链码值,第二个边界点的链码值

……

一直到最后的第n个边界点的链码值,用一维整形数组code[]来存储。

[0105]

四、blob区域裁剪和边缘检测

[0106]

对于每个blob区域的裁剪,是以blob区域的中心坐标和xy方向轴长为基准进行裁剪的,其中裁剪图像xy方向尺寸为xy方向轴长的两倍。blob区域的裁剪尺寸比轴向尺寸大,是因为在二值化处理过程中,二值化图像的每个blob区域相比原始灰度图像面积较小,特别是原始图像的边缘过渡区域一般处于blob区域边缘的外围。为了在裁剪区域中包含原始图像完整的目标信息,选择的blob区域裁剪范围为原有blob区域的水平和垂直方向的2倍。本次实验准直图像每个blob裁剪区域如图5a至5c所示。

[0107]

对于每个blob区域裁剪如图5a至5c所示,其中图5a、5b、5c分别为每个blob的裁剪结果,blob1区域裁剪区间为[133:236,87:182],尺寸为104

×

96,面积1959,中心坐标(185,135);blob2区域的裁剪区间为[324:407,412:507],尺寸为84

×

96,面积674,中心坐标(366,460);blob3区域裁剪[359:372,437:448],尺寸为14

×

12,面积36,中心坐标(366,

443)。从裁剪图像可以看出,blob1和blob2面积最大,为候选光学目标和远场目标,blob3面积最小,虽然属于远场目标的一部分,但只能看做一般的离散目标,不参与后续基于圆拟合的目标识别。事实上,在真实自动准直流程和目标识别过程中,由于ccd噪声和存在坏点的原因,离散目标是经常存在的,是需要舍弃掉的。

[0108]

对每一个blob区域裁剪图像进行边缘检测,选择sobel算子,每个blob区域的边缘检测结果分别如图5d,5e,5f所示,对于每个blob区域的图像裁剪和边缘检测结果示意如图6所示。虽然sobel算子,是最常见的边缘检测算子之一,但因为目标识别算法具有处理时间的要求(小于1秒)。为了减少边缘检测的时间,本发明中只是对每个blob区域裁剪图像进行边缘检测,实际边缘检测区域大小与原始图像大小之比为(104*96 84*96 14*12)/(1600*1200)=0.0095,即实际边缘检测区域大小只占原始图像大小的0.95%。通过实验对比,对1600*1200的二值化进行边缘检测,边缘检测用时0.469秒,只对三个blob区域进行边缘检测用时0.094秒处理时间减少为原来的20.04%。

[0109]

对于每个blob区域来说,裁剪图像用公式表示为:

[0110][0111]

需要满足的条件为:

[0112][0113]

式中,i表示blob区域编号,blobcount表示blob区域个数,表示第一blob区域。

[0114]

对每一个blob区域裁剪图像进行边缘检测,选择sobel算法,每个blob区域边缘检测函数用公式表示为:

[0115][0116]

五、基于最小二乘圆拟合法进行光学目标分类与识别

[0117]

使用基于最小二乘圆拟合法目标识别基本思路为:(1)统计每个blob区域对应的二值化图像灰度值之和sum_all;(2)将每一个blob区域检测到的边缘图像作为输入,使用fitcircle算法,拟合每个blob区域边缘对应的圆心和半径;(3)统计blob区域裁剪图像位于拟合圆内的二值化图像灰度值之和sum_inner;(4)计算每个blob区域对应的圆拟合系数fit_ratio=sum_inner/sum_all;(5)从所有blob区域中搜索面积最大的两个blob区域,作为远场目标和模拟光目标的候选目标;(6)比较两个blob区域的圆拟合系数,圆拟合系数较大的为远场目标,较小的远场目标。

[0118]

基于以上思路,将圆拟合目标识别算模型化,目标识别的主要过程为圆拟合算法、圆拟合系数计算、圆拟合系数比较。

[0119]

1、基于最小二乘圆拟合

[0120]

对每个blob区域经过图像裁剪和边缘检测后,获得了每个blob的边缘图像,如图5(d)、(e)、(f)所示。将每个blob区域的边缘x和y坐标分别记录在数组p,q中,数组长度为包

含的像素个数,即每个裁剪图像中灰度值为255的像素个数,用n表示。x和y坐标值是在原始图像(1600*1200)中的绝对坐标,在圆拟合过程中不需要经过坐标变换,简化运算步骤。使用基于最小二乘法的圆拟合方法,获得每个blob区域边缘对应的圆心和半径,每个blob区域的圆拟合过程和结果如图6。

[0121]

具体计算过程为:每一个边缘坐标可表示为(pj,qj),其中,p(j)=x,q(j)=y,0<=j<n。圆拟合公式用公式表示为:

[0122][0123]

令圆拟合函数fitcircle中,拟合出的圆心坐标a、b和半径r的表达式为:

[0124][0125]

其中,y表示某个像素y方向坐标值;

[0126]

图6中展示基于最小二乘圆拟合法的目标识别过程,主要是对两个面积最大的、候选目标的识别,图中第

③

列为边缘检测结果,第

④

列为圆拟合结果。在图6的第

①

行第

④

列,可以看出模拟光目标的边缘圆环和拟合圆环相似度非常好,两个圆环基本上是重叠在一起的,拟合圆心和半径分别为(184.60,134.63)和25;在第

②

行第

④

列,远场目标的边缘曲线和拟合圆环形状是完全不同的,只有重心坐标基本上是重合的,其中拟合圆心和半径分别为(362.30,461.29)和19.25,这因为远场目标是不规则、分布不均匀的光学目标,各个边缘点不符合圆环的坐标分布。

[0127]

2、拟合系数计算

[0128]

为了利用圆拟合结果定量描述两个目标的分布特征,将每个blob区域的拟合圆环和blob区域的二值化图像叠加在一起,如图6第

⑤

列所示,通过观察,模拟光目标的所有灰度值为255的像素都位于拟合圆环以内,而远场目标的灰度值为255的像素中只有一部分像素位于拟合圆以内。

[0129]

因此,可以使用每个blob区域位于拟合圆内像素个数与blob区域像素个数之比作为指标来区分哪个目标是远场目标,哪个目标是模拟光目标。基于此,两个像素比值定义为圆拟合系数,计算每个blob区域对应的圆拟合系数fit_ratio=sum_inner/sum_all。则圆拟合系数fit_ratio可以用公式表示为:

[0130]

[0131]

式中,为每个blob区域灰度为255的二值化图像灰度之和,为每个blob区域位于拟合圆内的灰度为255的二值化图像灰度之和。blob1区域的圆拟合系数=1888/1959=0.9309,blob2区域的圆拟合系数=485/674=0.8278。

[0132]

3、圆拟合系数比较

[0133]

从所有blob区域中搜索面积最大的两个blob区域,作为远场目标和模拟光目标的候选目标,用公式表示为:

[0134][0135]

比较面积最大的两个blob区域的圆拟合系数,blob1的圆拟合系数fit_ratio1=0.9309,blob2的圆拟合系数为fit_ratio2=0.8278,由于fit_ratio1》fit_ratio2,将blob1对应的目标识别标志为1,目标识别结果为模拟光目标;将blob2对应的目标识别标志为2,目标识别结果为远场目标。

[0136][0137]

每个blob区域的目标识别结果如表3所示。

[0138]

表3每个blob区域的目标识别结果

[0139][0140][0141]

准直ccd图像经过二值化、膨胀、图像裁剪、边缘检测、圆拟合、圆拟合系数计算、圆拟合系数比较等过程,完成了对模拟光目标和远场目标的识别。

[0142]

经过步骤1)到步骤5)的处理过程,实现了对一幅准直图像中模拟光目标和远场目标的识别。为了构建8幅准直图像的目标识别函数模型,将8幅图像中的每1幅图像的目标识别结果分别表示为:

[0143]

将公式14的base

xy

、center

xy

和fit_flag的所有元素构建成一个8

×

5的矩阵,该矩阵不仅包含了8幅准直图像的远场中心和模拟光中心(1-4列),也包含了圆拟合标志(第5

列),即目标识别标志。因此,该多目标识别算法是一个基于多光路的、多目标识别算法,适合用于大型激光装置8路模拟光准直流程中的多目标识别。将8路光束模拟光准直图像多目标识别函数用公式表示为

[0144]

[base

xy

,center

xy

,fit_flag]=recognizebycirclefit(f)

ꢀꢀꢀꢀꢀꢀꢀꢀ

(15)

[0145]

式中,输入值f为8幅1600*1200图像,输出为远场中心base

xy

和模拟光中心center

xy

,圆拟合标志fit_flag,其中base

xy

和center

xy

都是8

×

2矩阵,fit_flag为8维列向量。

[0146]

图像处理结果分析

[0147]

经过数据处理过程,完成了对模拟光准直过程中远场目标和模拟光目标的识别,为了验证本文算法在目标识别准确率和识别精度,需要以下几个角度进行分析:1)光学目标中心识别精度分析;2)目标识别算法重复精度分析;3)目标识别算法数据处理性能提升分析;。

[0148]

目标识别算法对于光学目标中心的识别精度分析

[0149]

本发明的目标识别算法主要完成实验指标:一是两个光学目标的分类和识别;二是本文算法对于两个光学目标中心的识别精度。

[0150]

对于两个光学目标中心的识别精度来说,由于本发明目标识别算法对于每个blob区域获得了两个中心,即blob区域中心和圆拟合中心,这就需要将每个区域的blob区域中心和圆拟合中心与真实标定中心进行比较,从而选择最佳中心点。每个blob区域的标定中心与模拟光中心和远场目标中心比较结果如表4所示。

[0151]

表4光学目标中心识别精度分析比较

[0152][0153]

将本次实验准直图像的模拟光目标和远场目标中心进行标定。标定方法为:对于模拟光目标来说,标定中心x=(上边缘坐标 下边缘坐标)/2,标定中心y=(左边缘坐标 右边缘坐标)/2,边缘位置为上升沿/下降区间峰值50%位置的坐标值。对于远场目标来说,由于远场目标是分布不均匀的、具有不规则纹理的图像,选择二值化图像对应的连通域内、面积最大的、灰度峰值作为远场目标的标定中心,标定中心x=连通域内灰度峰值的x坐标值,标定中心y=连通域内灰度峰值的y坐标值。

[0154]

根据以上标定方法,每个目标的blob区域中心与标定中心误差如表3第4列,每个目标的圆拟合中心与标定中心误差如表3第6列。其中,两个面积的(模拟光目标和远场目标)圆拟合中心与标定中心误差小于3个像素,最大值误差为2.79。两个面积的(模拟光目标和远场目标)blob区域中心与标定中心误差不是全部小于3个像素,最大值误差为5.81。由于圆拟合方法获得的模拟光目标和远场目标中心与标定中心的误差小于3个像素,根据准

直实验对于误差精度的要求,选择圆拟合方法获得的圆拟合中心作为光路准直过程中两个目标的计算中心。在公式(6)中,center

xy

=模拟光目标的圆拟合中心,base

xy

=远场目标标的圆拟合中心。

[0155]

目标识别算法重复精度分析

[0156]

为了验证基于圆拟合的多目标识别算法的重复精度,在同一个准直流程中,对不同时间、不同光路的准直图像进行目标识别操作,统计和分析该目标识别算法的识别精度、识别时间、识别准确率等参数,以确定该算法的重复精度。表4是对每1路2幅图像目标识别结果的统计,共16幅图像,其中前8幅图像对应的模拟光目标和远场目标裁剪结果如图7所示。

[0157]

表5每路2幅图像(共16幅)目标识别结果的统计

[0158][0159]

从表5可以看出,16幅准直图像的目标识别时间最大1.484秒,最小时间0.656秒,

平均准直时间为0.95245,小于1秒。16幅准直图像的目标识别结果全部为成功,大于目标识别准确率大于90%的要求。通过在长时间准直流程中对大量准直图像识别成功率的统计,成功率为98.3%,造成识别失败的是由于模拟光目标特征的改变而造成的。因为准直ccd在光轴上前后移动存在一定定位的误差,导致模拟光聚焦性能不好,会出现模拟光目标不是较为标准的圆形。这就需要结合其他特征综合判断,以提升特殊情况下目标识别的准确率,这也为该目标识别算法的性能提升提出了更高的要求,需要开展更进一步的研究工作。

[0160]

对于目标识别误差来说,由于本发明将每个blob的圆拟合中心作为最终模拟光中心和远场目标的目标识别中心。因此,识别误差只需要将模拟光远场/目标的圆拟合中心与标定中心进行比较,比较结果如表5所示。从表5可以看出,模拟光目标的识别误差最大值,其中x方向为3.20,y方向-4.00,x方向和y方向的平均值为-1.8487和-2.604。模拟光目标的识别误差最大值,其中x方向为-3.30,y方向-5.03,x方向和y方向的平均值为2.40和-1.63。平均识别误差都小于3个像素,满足了准直流程对于目标识别精度的要求。相比来说,模拟光目标的识别误差较小,而远场目标的识别误差较大,这是因为模拟光目标为较为标准的圆形,而远场目标为不规则的光斑所引起的。

[0161]

对16幅准直图像进行目标识别日志信息如下:

[0162]

s1 1模拟光标定:184 133拟合::184.6 134.63远场目标标定:360 457拟合:362.3 461.29

[0163]

s1 2模拟光标定:261 256拟合:61.38 258.48远场目标标定:484 382拟合:485.34 380.92

[0164]

s2 1模拟光标定:261 245拟合:57.8 241.94远场目标标定:467 290拟合:468.9 294.4

[0165]

s2 2模拟光标定:480 198拟合:79.01 200远场目标标定:169 276拟合:171.23 281.03

[0166]

s3 1模拟光标定:236 427拟合:34.6 429.63远场目标标定:360 457拟合:362.3 461.29

[0167]

s3 2模拟光标定:260 436拟合:58.6 438.63远场目标标定:360 457拟合:362.3 461.29

[0168]

s4 1模拟光标定:272 462拟合:69.6 464.63远场目标标定:360 457拟合:362.3 461.29

[0169]

s4 2模拟光标定:334 88拟合:32.6 91.63远场目标标定:884 592拟合:886.3 596.29

[0170]

n1 1模拟光标定:442 276拟合:42.01 279远场目标标定:304 184拟合:304.94 184.094

[0171]

n1 2模拟光标定:365 360拟合:66.01 363远场目标标定:170 312拟合:170.18 313.29

[0172]

n2 1模拟光标定:165 74拟合:66.01 78远场目标标定:170 309拟合:170.18 308.29

[0173]

n2 2模拟光标定:258 160拟合:57.01 162远场目标标定:469 308拟合:471.18 309.29

[0174]

n3 1模拟光标定:354 221拟合:53.01 225远场目标标定:146 340拟合:147.23 343.03

[0175]

n3 2模拟光标定:515 438拟合:13.6 441.63远场目标标定:360 458拟合:362.3 461.29

[0176]

n4 1模拟光标定:235 428拟合:34.6 429.6远场目标标定:360 460拟合:362.3 461.29

[0177]

n4 2模拟光标定:261 437拟合:58.6 438.63远场目标标定:359 459拟合:362.3 461.29

[0178]

通过以上分析说明,本发明的目标识别算法不仅实现了模拟光目标和远场目标的识别,而且能够满足不同图像识别对于重复精度的要求,是模拟光准直流程中用于光学目标判读的一个非常有效的方法。

[0179]

光路自动准直处理时间性能提升分析

[0180]

模拟光准直流程需要在打靶实验前完成工作,不仅对于目标识别具有准确度和精度的要求,而且对于准直流程具有处理时间的要求。而影响准直流程处理时间的要素主要分为两类:一是目标识别图像处理算法所需时间;二是8路准直流程串行执行所消耗的时间。

[0181]

对于目标识别算法时间的提升主要采取2个因素:1)数字形态学所节约的时间;2)边沿检测所节约的时间。在本发明的数字形态学算法中,为了尽可能将每个blob区域合并成一个完成的连通域,选择了膨胀运算。但是,选择怎样的结构单元需要根据处理图像的特征来确定,本文选择如公式(3)所示的结构单元。此外,对于一个确定的结果单元来说,虽然经过多次膨胀运算可以将远场目标完全合并为一个更完整的目标,但是多次膨胀是消耗耗更多的处理时间为代价的。经过实验分析,1次膨胀运算用时0.359秒,5次膨胀运算用时2.781秒。为了提高图像识别效率,本发明选择1次膨胀运算,结果如图4a和图4b所示。

[0182]

由于目标识别算法具有处理时间小于1秒的要求,因此通过边缘检测节约处理时间是十分必要的。为了减少边缘检测的时间,主要措施是只对包含blob区域的二值化图像对应区域进行边缘检测。以本次实验选择图像为例(表6img1),只对每个blob区域裁剪图像进行边缘检测,实际边缘检测区域大小与原始图像大小之比为(104*96 84*96 14*12)/(1600*1200)=0.0095,即实际边缘检测区域大小只占原始图像大小的0.95%。对1600*1200的二值化进行边缘检测,边缘检测用时0.469秒,只对三个blob区域进行边缘检测用时0.094秒处理时间减少为原来的20.04%。

[0183]

表6目标识别图像处理算法时间提升分析

[0184][0185][0186]

为了说明通过膨胀次数的选择和边缘检测区域的选择对目标识别算法在时间上的提升作用,选择了5幅不同的准直图像,在膨胀和边缘检测步骤中的时间提升如表6所示。从表6可以看出,如果选择1次膨胀处理,平均膨胀时间0.312秒,提升比例最小73.33%。此外,对每个blob区域裁剪图像进行边缘检测,提升后边缘检测平均时间0.113秒,平均提升比例83.10%,整个图像的目标识别时间,包括二值化、数字形态学处理、特征提取、边缘检测、圆拟合,最大提升比例92.61%,总提升比例的平均值为76.75%。对于整个目标识别时间而言,最长时间1.237秒,最小0.656秒,平均目标识别时间0.9722秒,满足了准直流程中对于目标识别时间小于1秒的要求。

[0187]

综上所述,本发明方法的结果表明:本发明提出的基于圆拟合的多光学目标识别图像处理算法,实现了模拟光准直流程中的模拟光目标和远场目标的识别,识别误差精度小于3个像素,处理时间小于5秒钟,满足了大型激光装置模拟光准直过程对于精度和效率的要求。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。