1.本公开涉及信息处理装置、信息处理方法和信息处理程序。

背景技术:

2.已知一种技术,该技术从由附接到诸如无人机之类的无人移动体的立体相机捕获图像中检测物体。

3.例如,专利文献1公开了一种测距系统,该测距系统设有包括立体相机的多个测距系统,并且将由相应测距系统获得的多个测距值当中的最小值作为最终测距值。而且,专利文献2公开了一种系统,该系统设有多个立体相机,并且根据车辆的雨刷器的运动来切换使用的立体相机。

4.引文列表

5.专利文献

6.专利文献1:jp 2018-146457 a

7.专利文献2:jp 2018-32986 a

技术实现要素:

8.技术问题

9.在使用立体相机的物体检测中,例如,基于从右侧和左侧相机看到的物体的视差,测量相机和物体之间的距离。但是,当作为测量目标的物体在立体相机的基线长度的方向上延伸时,存在难以测量距离的问题。

10.就此而言,本公开提出了能够以高精度检测物体的信息处理装置、信息处理方法和信息处理程序。

11.问题的解决方案

12.根据本公开,提供了一种信息处理装置,包括:多个立体相机,被布置为使得各个立体相机的基线长度的方向彼此相交;深度估计单元,根据由该多个立体相机捕获的捕获图像来估计包括在捕获图像中的物体的深度;以及物体检测单元,基于由深度估计单元估计的深度和深度的可靠度来检测物体,深度的可靠度是根据物体的边缘线的方向相对于多个立体相机的基线长度的方向的角度来确定的。

附图说明

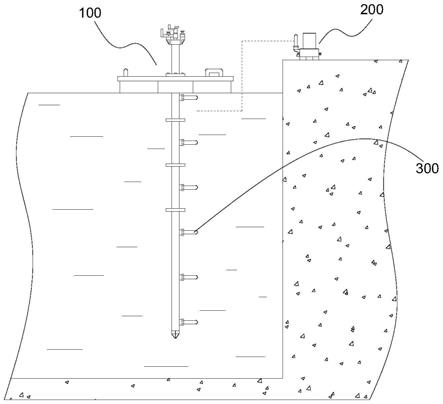

13.图1是用于解释一般立体相机系统的配置的视图。

14.图2是图示在由立体相机进行的深度估计中基线长度的方向与物体的延伸方向彼此不同的情况的示例的图。

15.图3是图示在由立体相机进行的深度估计中基线长度的方向与物体的延伸方向相同的情况的示例的图。

16.图4是图示无法适当地估计深度的情况的示例的视图。

17.图5是图示无法适当地估计深度的情况的示例的视图。

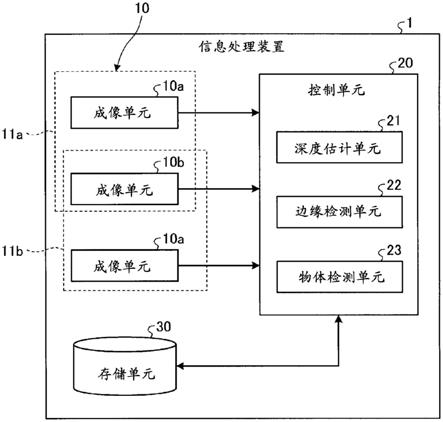

18.图6是图示根据本公开的第一实施例的信息处理装置的配置的框图。

19.图7是图示根据本公开的第一实施例的信息处理装置中提供的立体相机系统的配置示例的图。

20.图8是图示根据本公开的第一实施例的信息处理装置中提供的立体相机系统的配置示例的图。

21.图9是图示由根据本公开的第一实施例的信息处理装置进行的信息处理的概述的图。

22.图10是图示在由根据本公开的第一实施例的信息处理装置执行的信息处理中从rgb图像生成边缘图像的状态的视图。

23.图11是图示由根据本公开的第一实施例的信息处理装置执行的信息处理中的占用网格地图的示例的图。

24.图12是图示由根据本公开的第一实施例的信息处理装置执行的信息处理中的边缘图像的示例的视图。

25.图13是图示根据本公开的第一实施例的信息处理装置中提供的立体相机系统中的第一立体相机的图。

26.图14是图示在由根据本公开的第一实施例的信息处理装置执行的信息处理中基于边缘方向的地图投票概率(概率分布)的示例的视图,该地图投票概率与第一立体相机对应。

27.图15是图示在根据本公开的第一实施例的信息处理装置中提供的立体相机系统中的第二立体相机的图。

28.图16是图示在由根据本公开的第一实施例的信息处理装置执行的信息处理中基于边缘方向的地图投票概率(概率分布)的示例的视图,该地图投票概率与第二立体相机对应。

29.图17是图示由根据本公开的第一实施例的信息处理装置执行的信息处理的示例的流程图。

30.图18是图示根据本公开的第二实施例的信息处理装置的配置的框图。

31.图19是图示在由根据本公开的第二实施例的信息处理装置执行的信息处理中改变立体相机系统的位置和姿态的状态的图。

32.图20是图示在由根据本公开的第二实施例的信息处理装置执行的信息处理中的地图投票概率(概率分布)的变形的示例的视图,该变形基于当立体相机系统的位置和姿态改变时的边缘方向。

33.图21是图示在由根据本公开的第二实施例的信息处理装置执行的信息处理中的地图投票概率(概率分布)的变形的示例的视图,该变形基于当立体相机系统的位置和姿态改变时的边缘方向。

34.图22是图示由根据本公开的第二实施例的信息处理装置执行的信息处理的示例的流程图。

35.图23是图示在由根据本公开的第二实施例的信息处理装置执行的信息处理的变形例中的地图投票概率(概率分布)的变形的示例的视图,该变形基于当立体相机系统的位

置和姿态改变时的边缘方向。

36.图24是图示由根据本公开的第二实施例的信息处理装置执行的信息处理的变形例的示例的流程图。

37.图25是图示说明实现根据本公开的实施例的信息处理装置的功能的计算机的示例的硬件配置示例的说明图。

具体实施方式

38.下面将结合附图对本公开的实施例进行详细描述。注意的是,在以下相应实施例中,相同的附图标记被赋予相同的部分,并且将省略重复的描述。

39.注意的是,将按照以下次序给出描述。

40.《1.概述》

41.《2.第一实施例》

42.《2-1.配置》

43.《2-2.处理的概述》

44.《2-3.处理的流程》

45.《3.第二实施例》

46.《4.第二实施例的变形例》

47.《5.硬件配置示例》

48.《6.效果》

49.《1.概述》

50.首先,参考图1至图5,将给出由根据本公开的实施例的信息处理装置执行的信息处理的概述的描述。图1图示了例如将被附接到诸如无人机之类的无人移动体的一般立体相机系统110的配置。这个立体相机系统110是设有两个成像单元(相机)110a和110b的双目相机系统。立体相机系统110例如隔着支撑构件120附接到无人移动体的下部。

51.在使用如上所述的这种立体相机系统110的物体检测中,例如通过使用诸如三角测量之类的方法,基于从左侧和右侧成像单元110a和110b看到的物体的视差来估计到物体的距离(下文中,该距离将被称为“深度”)。在这种深度估计中,当指示成像单元110a的中心和成像单元110b的中心之间的距离的基线长度的方向与作为测量目标的物体的延伸方向不是彼此平行而是彼此相交时,例如如图2中所示,那么可以适当地估计深度,因为容易掌握在右侧相机的视频中反映的这种物体与在左侧相机的视频中反映的这种物体之间的相关性。

52.同时,当基线长度的方向与作为测量目标的物体的延伸方向彼此平行或接近平行时,例如如图3中所示,深度不能被适当地估计,因为难以掌握在右侧相机的视频中反映的物体与在左侧相机的视频中反映的物体之间的相关性。因此,例如,在将立体相机系统110附接到无人移动体以使其基线长度的方向与水平方向彼此一致的同时操作立体相机系统110的情况下(参见图1),发生无法识别图4的部分a中所示的电线,或者识别出图5的部分b中所示的建筑物的顶部向前突出的误动。

53.因而,根据本公开的信息处理装置使用具有例如以v形布置的三个透镜的三目相机系统,通过两个立体相机估计深度,然后对捕获图像执行边缘处理,并检测物体的边缘。

然后,根据本公开的信息处理装置基于深度的可靠度来计算占用网格地图的地图投票概率,该可靠度与边缘的方向(在下文中,该方向将被称为“边缘方向”)对应,将计算出的地图投票概率反映在占用网格地图上,从而检测物体。

54.《2.第一实施例》

55.《2-1.配置》

56.接下来,参考图6至图8,将给出根据第一实施例的信息处理装置1的配置的描述。信息处理装置1是例如安装在诸如无人机之类的无人移动体上并从由三目相机系统捕获的图像中检测物体的装置。注意的是,在本实施例中,将给出信息处理装置1安装在无人移动体上的示例的描述。但是,除此之外,信息处理装置1可以安装在用在工厂、家庭等中的自主移动机器人、车辆、便携式终端等上。如图6中所示,信息处理装置1包括三个成像单元(相机)10a、10b和10c、控制单元20,以及存储单元30。

57.成像单元10a、10b和10c中的每一个都具有由透镜、光圈等构成的光学系统,并且具有图像传感器,并且执行用于捕获被摄体的处理。成像单元10a、10b和10c中的每一个向控制单元20输出由此捕获的图像(在下文中,该图像将被称为“捕获图像”)。而且,成像单元10a、10b和10c构成包括第一立体相机11a和第二立体相机11b的立体相机系统10。

58.例如,如图7中所示,立体相机系统10是包括三个成像单元10a、10b和10c的三目相机系统。立体相机系统10附接到例如无人移动体的下部,而支撑构件12插入其之间。成像单元10a、10b和10c布置为v形。即,第一立体相机11a和第二立体相机11b被布置为使得第一立体相机11a的基线长度的方向与第二立体相机11b的基线长度的方向彼此垂直。

59.构成第一立体相机11a的成像单元10a和成像单元10b在水平方向上并排布置。即,连接成像单元10a和成像单元10b的基线长度的方向与水平方向一致。而且,构成第二立体相机11b的成像单元10b和成像单元10c在垂直方向上并排布置。即,将成像单元10b和成像单元10c彼此连接的基线长度的方向与垂直方向一致。注意的是,第一立体相机11a和第二立体相机11b只需要被布置为使得相应的基线长度的方向彼此相交,并且相应基线长度的方向可以形成除直角之外的其它角度。

60.在本文中,第一立体相机11a和第二立体相机11b的基线长度的方向不必与水平方向或垂直方向一致。例如,在信息处理装置1中,可以使用图8中所示的立体相机系统10a代替图7中所示的立体相机系统10。在立体相机系统10a中,构成第一立体相机11a的成像单元10a和成像单元10b被布置为偏离水平方向或垂直方向。而且,以相同的方式,构成第二立体相机11b的成像单元10b和成像单元10c被布置为偏离水平方向或垂直方向。

61.控制单元20可以由多种处理器(例如,诸如中央处理单元(cpu)、图形处理单元(gpu)、现场可编程门阵列(fpga)等)实现。控制单元20对从成像单元10a、10b和10c输入的捕获图像执行各种处理。控制单元20包括深度估计单元21、边缘检测单元22和物体检测单元23。

62.根据由第一立体相机11a和第二立体相机11b捕获的捕获图像,深度估计单元21估计包括在捕获图像中的物体的深度。基于从成像单元10a和10b看到的物体的视差以及从成像单元10b和10c看到的物体的视差,深度估计单元21通过使用例如已知的方法(诸如三角测量)来估计深度。

63.根据由第一立体相机11a和第二立体相机11b捕获的捕获图像,边缘检测单元22检

测捕获图像中包括的物体的边缘。注意的是,“边缘”是指指示物体的边界的连续线。边缘检测单元22从由成像单元10a、10b和10c中的任何一个捕获的单目图像(rgb图像)检测物体的边缘,并生成边缘图像(参见稍后描述的图10)。

64.物体检测单元23基于由深度估计单元21生成的深度信息和由边缘检测单元22生成的边缘信息来检测物体。物体检测单元23基于由深度估计单元21估计的深度和深度的可靠度来检测物体,深度的可靠度要根据物体在边缘方向上相对于第一立体相机11a和第二立体相机11b的基线长度的方向的角度来确定。注意的是,稍后将描述物体检测单元23中的处理的细节。

65.存储单元30保持各种信息。存储单元30存储例如用于实现控制单元20的相应单元的程序。在这种情况下,控制单元20展开并执行存储单元30中存储的程序,从而实现相应单元的功能。存储单元30例如可以通过诸如随机存取存储器(ram)、只读存储器(rom)和闪存之类的半导体存储元件,或者通过诸如硬盘、固态驱动器和光盘之类的存储设备来实现。而且,存储单元30可以由彼此不同的多个存储器等组成。

66.《2-2.处理的概述》

67.接下来,参考图9至图16,将给出根据本实施例的信息处理装置1的处理的概述的描述。如图9中所示,信息处理装置1以此次序实现图像捕获处理pr1、深度估计处理pr2、边缘检测处理pr3、地图投票概率计算处理pr4和地图投票处理pr5。

68.(图像捕获处理prl)

69.在图像捕获处理pr1中,成像单元10a、10b和10c捕获例如rgb图像,并将捕获的rgb图像输出到深度估计单元21和边缘检测单元22。

70.(深度估计处理pr2)

71.在深度估计处理pr2中,深度估计单元21估计包括在rgb图像中的物体的深度,并将估计的深度信息输出到物体检测单元23。

72.(边缘检测处理pr3)

73.在边缘检测处理pr3中,边缘检测单元22检测rgb图像中包括的物体的边缘。在边缘检测处理pr3中,例如如图10中所示,边缘检测单元22将这种rgb图像转换成边缘图像,并将包括关于边缘的方向和位置的信息的边缘信息输出到物体检测单元23。

74.(地图投票概率计算处理pr4)

75.在地图投票概率计算处理pr4中,物体检测单元23计算占有网格地图的地图投票概率。在下文中,例如如图11中所示,“占用网格地图”是指其中将rgb图像中包括的空间划分为网格状并且从上方俯视的地图。其上安装有信息处理装置1的无人移动体基于这个占用网格地图掌握移动路径上是否存在障碍物。在图11中,密集阴影线网格指示“物体存在”,空白网格指示“物体不存在”,而浅阴影线网格指示“未知物体是否存在”。

76.地图投票概率是指物体在占用网格地图中占用每个网格的概率。例如,图11中所示的占用网格地图中的某个网格(cell i)中的事件的后验概率(物体占用某个网格的概率)可以由以下表达式(1)表示。

77.p(mi|z

1:t

,x

1:t

)

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(1)

78.其中,

79.z

1:t

:观察数据

80.x

1:t

:自身位置

81.而且,上述表达式(1)可以通过以下表达式(2)计算。即,通过将“1时间前为止的事件的后验概率”乘以“基于当前时间点的观察的地图投票概率”可以获得“直到时间t的事件的后验概率”。即,将1时间前为止的占用网格地图所拥有的这种概率乘以基于当前观察的概率,由此获得当前占用网格地图。

82.p(mi|z

1:t

,x

1:t

)=p(mi|z

1:t-1

,x

1:t-1

)xp(mi|z

t

,x

t

)

ꢀꢀꢀꢀ

(2)

83.其中,p(mi|z

1:t

,x

1:t

):直到时间t的事件的后验概率

84.p(mi|z

1:t-1

,x

1:t-1

):1时间前为止的事件的后验概率

85.p(mi|z

t

,x

t

):基于当前时间点的观察的地图投票概率

86.在本实施例中,上述表达式(2)中的“p(mi|z

t

,x

t

)”通过以下表达式(3)获得。即,将“基于到观察事件的距离的地图投票概率(第一概率分布)”乘以“基于观察事件的边缘方向的地图投票概率(第二概率分布)”,从而获得“基于当前时间点的观察的地图投票概率”。即,地图投票概率是三维获得的。

87.p(mi|z

t

,x

t

)=p(mi|l

i,t

)xp(mi|e

i,t

)

ꢀꢀꢀꢀ

(3)

88.其中,p(mi|l

i,t

):基于到观察事件的距离的地图投票概率

89.p(mi|e

i,t

):基于观察事件的边缘方向的地图投票概率

90.在地图投票概率计算处理pr4中,物体检测单元23计算基于由深度估计单元21估计的深度的第一概率分布和指示深度的可靠度的第二概率分布。在本文中,第一概率分布是指上述表达式(3)中的“基于观测事件的距离的地图投票概率”,第二概率分布是指上述表达式(3)中的“基于观察事件的边缘方向的地图投票概率”。

[0091]“深度的可靠度”是指在捕获图像中存在物体边缘的位置处的概率分布,以及随着边缘方向相对于基线长度的方向更接近直角而概率更高的概率分布。

[0092]

例如,考虑由边缘检测单元22检测到水平方向上的边缘和垂直方向上的边缘的情况,例如图12中所示。在这种情况下,与如图13中所示的基线长度的方向是水平方向的第一立体相机11a对应的第二概率分布变成如图14中所示的最高概率与垂直于基线长度的垂直方向上的边缘重叠的分布。同时,与如图15中所示的基线长度的方向是垂直方向的第二立体相机11b对应的第二概率分布变成如图16中所示的最高概率与垂直于基线长度的水平方向的边缘重叠的分布。

[0093]

如上所述,在地图投票概率计算处理pr4中,指示深度有多可靠的这种可靠度被近似为例如如图14和16中所示的此类二维正态分布,该深度是从第一立体相机11a和第二立体相机11b的捕获图像估计的。

[0094]

在地图投票概率计算处理pr4中,物体检测单元23基于第一概率分布和第二概率分布计算占用网格地图中的地图投票概率。即,如上述表达式(3)中所示,物体检测单元23将第一概率分布(基于到物体的距离的地图投票概率)和第二概率分布(基于物体的边缘方向的地图投票概率)彼此相乘,从而计算地图投票概率。

[0095]

(地图投票处理pr5)

[0096]

在地图投票处理pr5中,物体检测单元23基于计算出的地图投票概率对每个网格进行投票,从而创建占用网格地图。信息处理装置1基于如此创建的占用网格地图来检测物体。

[0097]

《2-3.处理的流程》

[0098]

接下来,参考图17,将给出根据本实施例的信息处理装置1的处理流程的描述。首先,控制单元20获取由第一立体相机11a和第二立体相机11b捕获图像(步骤s1)。随后,控制单元20的深度估计单元21估计包括在捕获图像中的物体的深度(步骤s2)。

[0099]

随后,控制单元20确定深度估计单元21是否已经能够适当地估计深度(步骤s3)。在确定不能适当地估计深度的情况下(步骤s3中的“否”),控制单元20结束这个处理。同时,在确定能够适当地估计深度的情况下(步骤s3中的“是”),控制单元20的边缘检测单元22检测包括在捕获图像中的物体的边缘(步骤s4)。

[0100]

随后,控制单元20确定边缘检测单元22是否能够适当地检测边缘(步骤s5)。在确定不能适当地检测边缘的情况下(步骤s5中的“否”),控制单元20的物体检测单元23对占用网格地图进行投票(步骤s6),并结束这个处理。同时,在确定已经能够适当地检测边缘的情况下(步骤s5中的“是”),物体检测单元23基于上述表达式(1)至(3)计算地图投票概率(步骤s7)。

[0101]

随后,物体检测单元23确定是否存在多个地图投票概率的计算结果(步骤s8)。注意的是,“存在多个地图投票概率的计算结果”是指例如单独计算出与其中图13中所示的基线长度的方向是水平方向的第一立体相机11a对应的地图投票概率和与其中图15中所示的基线长度的方向是垂直方向的第二立体相机11b对应的地图投票概率的情况。

[0102]

在步骤s8中确定不存在多个地图投票概率的计算结果的情况下(步骤s8中的“否”),物体检测单元23基于计算出的地图投票概率对占用网格地图进行投票(步骤s9),并结束这个处理。

[0103]

在步骤s8中确定存在多个地图投票概率的计算结果的情况下(步骤s8中的“是”),物体检测单元23将多个地图投票概率相乘并彼此相加(步骤s10)。随后,物体检测单元23基于相加的地图投票概率对占用网格地图进行投票(步骤s11),并结束这个处理。

[0104]

《3.第二实施例》

[0105]

接下来,参考图18至22,将给出根据第二实施例的信息处理装置1a的描述。除了上述信息处理装置1的相应组成部分之外,信息处理装置1a还包括惯性测量单元40。而且,信息处理装置1a的控制单元20a除了上述控制单元20的相应组成部分之外还包括位置/姿态估计单元24。

[0106]

惯性测量单元40由例如包括三轴加速度传感器、三轴陀螺仪传感器等的惯性测量单元(imu)构成,并将获取的传感器信息输出到控制单元20a的位置/姿态估计单元24。位置/姿态估计单元24基于由成像单元10a、10b和10c捕获的捕获图像以及从惯性测量单元40输入的传感器信息来检测其上安装有信息处理装置1a的无人移动体的位置和姿态(例如,朝向、倾斜度等)。注意的是,用于检测无人移动体的位置和姿态的方法不限于使用上述imu的方法。

[0107]

本实施例中的物体检测单元23将前一帧中计算出的第二概率分布(即,基于物体

的边缘方向的地图投票概率)作为关键帧,并且当第一立体相机11a和第二立体相机11b的位置和姿态在当前帧中改变时,基于第一立体相机11a和第二立体相机11b的位置和姿态的变化使关键帧变形(例如,移动和旋转),从而计算第二概率分布。

[0108]

如果在立体相机系统10的姿态每次如图19中所示改变时(例如,当无人移动体飞行时)重新计算第二概率分布,那么信息处理装置1a的处理负载会增加。就此而言,信息处理装置1a的物体检测单元23将在前一帧中计算出的第二概率分布预先注册为关键帧。然后,当立体相机系统10的姿态在下一帧(当前帧)中改变时,物体检测单元23根据本机器的姿态的变化旋转对应的关键帧(第二概率分布),如图20中所示,本机器的姿态是由位置/姿态估计单元24估计的,从而计算当前帧的第二概率分布。随后,物体检测单元23将计算出的第二概率分布和第一概率分布彼此相乘,从而计算地图投票概率。注意的是,当由位置/姿态估计单元24估计的本机器的位置和姿态的变化等于或大于预定阈值时,物体检测单元23重新计算第二概率分布,并且将计算出的第二概率分布重新注册为关键帧。

[0109]

参考图21,下面将给出第二概率分布的变形的示例的描述,其中考虑了本机器的位置和姿态的改变。例如,当第二概率分布通过边缘的外围的二维正态分布被近似时,如图21中所示,这个正态分布可以用x平均值、y平均值、边缘水平离散度、边缘垂直离散度、倾斜度、整体分布的尺寸等的值表示。这些值根据边缘的角度以及本机器的位置和姿态的变化而改变。注意的是,根据到边缘的距离以及成像单元10a、10b和10c的参数,有可能估计边缘如何在图像中移动。

[0110]

例如,当第一立体相机11a的基线长度的方向是水平方向时(参见图13),如图21中所示,两个离散度(边缘水平离散度、边缘垂直离散度)都随着边缘相对于基线长度的方向的角度变小而增加。而且,随着边缘相对于基线长度的方向的角度变小,整个分布的大小减小。

[0111]

信息处理装置1a执行如上所述的这种处理,从而可以降低第二概率分布(基于物体的边缘方向的地图投票概率)的计算频率,因此可以降低处理负荷。

[0112]

接下来,参考图22,将给出根据本实施例的信息处理装置1a的处理流程的描述。首先,控制单元20a的位置/姿态估计单元24估计本机器的位置和姿态(步骤s11)。随后,控制单元20a确定由位置/姿态估计单元24估计的本机器的位置和姿态的变化是否小于预定阈值(步骤s12)。

[0113]

当在步骤s12中由控制单元20a的位置/姿态估计单元24估计的本机器的位置和姿态的变化小于预定阈值时(步骤s12中的“是”),物体检测单元23计算由本机器的位置和姿态的改变引起的地图投票概率(步骤s13)。在步骤s13中,物体检测单元23根据本机器的位置和姿态的变化对预先注册的关键帧进行变形,从而计算第二概率分布。然后,物体检测单元23将计算出的第二概率分布和第一概率分布彼此相乘,从而计算地图投票概率。随后,物体检测单元23对占用网格地图进行投票(步骤s14),并结束这个处理。

[0114]

当在步骤s12中由控制单元20a的位置/姿态估计单元24估计的本机器的位置和姿态的变化等于或大于预定阈值时(步骤s12中的“否”),物体检测单元23计算由边缘方向引起的地图投票概率(步骤s15)。在步骤s15中,物体检测单元23再次计算第二概率分布,并将计算出的第二概率分布和第一概率分布相乘,从而计算地图投票概率。随后,物体检测单元23对占用网格地图进行投票(步骤s16),并将第二概率分布重新注册为关键帧(步骤s17),

并结束这个处理。

[0115]

《4.第二实施例的变形例》

[0116]

接下来,参考图23和图24,将给出根据第二实施例的信息处理装置1a的变形例的描述。根据本实施例的信息处理装置1a的配置与图18中的配置相似,并将相应地省略其说明。

[0117]

本实施例中的物体检测单元23将通过对关键帧进行变形计算出的第二概率分布与在当前帧中计算出的第二概率分布彼此进行比较,从而对第二概率分布进行滤波。即,如图23中所示,物体检测单元23将由于本机器的位置和姿态的改变而计算出的第二概率分布与由于当前边缘方向而计算出的第二概率分布彼此进行比较,消除与其它的极不相同的概率分布和具有违和感的概率分布,从而提高物体检测的稳定性。

[0118]

接下来,参考图24,将给出根据本实施例的信息处理装置1a的处理流程的描述。首先,控制单元20a的位置/姿态估计单元24估计本机器的位置和姿态(步骤s21)。随后,控制单元20a确定由位置/姿态估计单元24估计的本机器的位置和姿态的变化是否小于预定阈值(步骤s22)。

[0119]

当在步骤s22中由控制单元20a的位置/姿态估计单元24估计的本机器的位置和姿态的变化小于预定阈值时(步骤s22中的“是”),物体检测单元23计算由本机器的位置和姿态的改变引起的地图投票概率(步骤s23)。在步骤s23中,物体检测单元23根据本机器的位置和姿态的变化对预先注册的关键帧进行变形,从而计算第二概率分布。然后,物体检测单元23将计算出的第二概率分布和第一概率分布彼此相乘,从而计算地图投票概率。

[0120]

随后,物体检测单元23将由于本机器的位置和姿态的改变而计算出的第二概率分布与由于当前边缘方向而计算出的第二概率分布彼此进行比较(步骤s24),并且过滤与其它极不相同的概率分布(步骤s25)。随后,物体检测单元23对占用网格地图进行投票(步骤s26),并结束这个处理。

[0121]

当在步骤s22中由控制单元20a的位置/姿态估计单元24估计的本机器的位置和姿态的变化等于或大于预定阈值时(步骤s22中的“否”),物体检测单元23计算由边缘方向引起的地图投票概率(步骤s27)。在步骤s27中,物体检测单元23再次计算第二概率分布,并将计算出的第二概率分布与第一概率分布相乘,从而计算地图投票概率。随后,物体检测单元23对占用网格地图进行投票(步骤s28),并将第二概率分布重新注册为关键帧(步骤s29),并结束这个处理。

[0122]

《5.硬件配置示例》

[0123]

例如,通过具有如图25中所示的配置的计算机1000来实现诸如根据上述实施例的信息处理装置1、1a等的信息仪器。计算机1000包括cpu 1100、ram 1200、只读存储器(rom)1300、硬盘驱动器(hdd)1400、通信接口1500和输入/输出接口1600。计算机1000的相应单元通过总线1050彼此连接。

[0124]

cpu 1100基于存储在rom 1300或hdd 1400中的程序进行操作并且控制相应单元。例如,cpu 1100在ram 1200中展开存储在rom 1300或hdd 1400中的程序,并执行其中每一个与各种程序中的每一个对应的处理。

[0125]

rom 1300存储启动程序,诸如在计算机1000启动时要被cpu 1100执行的基本输入输出系统(bios)、依赖于计算机1000的硬件的程序等。

[0126]

hdd 1400是非临时地记录要被cpu 1100执行的程序、要被程序使用的数据等的计算机可读记录介质。具体而言,hdd 1400是记录根据本公开的信息处理程序(其是程序数据1450的示例)的记录介质。

[0127]

通信接口1500是用于使计算机1000连接到外部网络1550(例如,互联网)的接口。例如,经由通信接口1500,cpu 1100从另一个仪器接收数据,并将cpu 1100生成的数据发送到另一个仪器。

[0128]

输入/输出接口1600是用于将输入/输出设备1650和计算机1000彼此连接的接口。例如,经由输入/输出接口1600,cpu 1100从诸如键盘和鼠标之类的输入设备接收数据。而且,经由输入/输出接口1600,cpu 1100将数据传输到诸如显示器、扬声器和打印机之类的输出设备。另外,输入/输出接口1600可以用作读取记录在预定记录介质中的程序等的介质接口。例如,介质是诸如数字多功能盘(dvd)和相变可重写盘(pd)之类的光记录介质、诸如磁光盘(mo)之类的磁光记录介质、带介质、磁记录介质、半导体存储器等。

[0129]

例如,当计算机1000用作根据实施例的信息处理装置1和1a时,计算机1000的cpu 1100执行加载到ram 1200上的信息处理程序,从而实现控制单元130等的功能。而且,hdd 1400将根据本公开的信息处理程序和数据存储在存储单元30中。注意的是,cpu 1100从hdd 1400读取程序数据1450并执行它;但是,作为另一个示例,cpu 1100可以经由外部网络1550从另一个设备获取这些程序。

[0130]

《6.效果》

[0131]

信息处理装置1和1a包括第一立体相机11a和第二立体相机11b、深度估计单元21,以及物体检测单元23。第一立体相机11a和第二立体相机11b被布置为使得相应的基线长度的方向彼此相交。而且,根据由第一立体相机11a和第二立体相机11b捕获的捕获图像,深度估计单元21估计捕获图像中包括的物体的深度。而且,物体检测单元23基于由深度估计单元21估计的深度和深度的可靠度来检测物体,深度的可靠度要根据物体在边缘方向上相对于第一立体相机11a和第二立体相机11b的基线长度的方向的角度来确定。

[0132]

因此,通过使用深度的可靠度,深度的可靠度要根据物体在边缘方向上相对于第一立体相机11a和第二立体相机11b的基线长度的方向的角度来确定,信息处理装置1和1a可以高精度检测物体,与边缘方向无关。而且,信息处理装置1和1a例如被应用于例如诸如无人机之类的无人移动体,从而可以适当地识别诸如电线之类的水平线,并且可以避免建筑物的顶部被识别为向前突出。而且,根据信息处理装置1和1a,可以使用现有深度估计系统,其使用立体相机,并且相应地可以以低成本提高物体的检测精度。

[0133]

在信息处理装置1和1a中,深度的可靠度是捕获图像中存在物体的边缘的位置处的概率分布,以及边缘方向相对于基线长度的方向更接近直角的概率更高的概率分布。

[0134]

因此,信息处理装置1和1a将要根据物体在边缘方向上相对于第一立体相机11a和第二立体相机11b的基线长度的方向的角度确定的深度的可靠度建模到概率分布,从而可以以高精度检测物体。

[0135]

在信息处理装置1和1a中,物体检测单元23基于由深度估计单元21估计的深度计算第一概率分布(即,基于到物体的距离的地图投票概率)和指示深度的可靠度的第二概率分布(即,基于物体的边缘方向的地图投票概率)来计算第一概率分布。基于第一概率分布和第二概率分布,物体检测单元23计算指示物体在占用网格地图中占用的每个网格的概率

的地图投票概率,其中包括在捕获图像中的空间被划分成网格形状,并基于地图投票概率对每个网格进行投票,从而创建占用网格地图。

[0136]

因此,信息处理装置1和1a创建占用网格地图,从而可以掌握物体的位置和到物体的距离。

[0137]

在信息处理装置1和1a中,物体检测单元23将第一概率分布和第二概率分布彼此相乘,从而计算地图投票概率。

[0138]

因此,信息处理装置1和1a可以考虑基于到物体的距离的概率分布和基于物体的边缘方向的概率分布来三维地获得地图投票概率。

[0139]

在信息处理装置1a中,物体检测单元23将在前一帧中计算出的第二概率分布(即,基于物体的边缘方向的地图投票概率)注册为关键帧,并且当第一立体相机11a和第二立体相机11b的位置和姿态在当前帧中改变时,基于第一立体相机11a和第二立体相机11b的位置和姿态的变化对关键帧进行变形,从而计算第二概率分布。

[0140]

因此,信息处理装置1a可以通过使用关于本机器(第一立体相机11a和第二立体相机11b)的移动和旋转的信息来减少计算量,并相应地减少处理负荷。

[0141]

在信息处理装置1a中,物体检测单元23将通过对关键帧进行变形计算出的第二概率分布(基于物体的边缘方向的地图投票概率)与在当前帧中计算出的第二概率分布彼此进行比较,从而过滤第二概率分布。

[0142]

因此,信息处理装置1a过滤掉与其它极不相同的概率分布和具有违和感的概率分布,从而可以增强物体检测的稳定性。

[0143]

在信息处理装置1和1a中,第一立体相机11a和第二立体相机11b包括第一立体相机11a和第二立体相机11b,并且第一立体相机11a和第二立体相机11b被布置为使得方向第一立体相机11a的基线长度的方向与第二立体相机11b的基线长度的方向彼此垂直。

[0144]

因此,由于第一立体相机11a和第二立体相机11b被布置为使得第一立体相机11a的基线长度的方向与第二立体相机11b的基线长度的方向彼此垂直的事实,信息处理装置1和1a可以以高精度检测物体,与边缘方向无关。

[0145]

一种信息处理方法包括:根据由被布置为使得其相应基线长度的方向彼此相交的第一立体相机11a和第二立体相机11b捕获的捕获图像,估计包括在捕获图像中的物体的深度;并基于深度和深度的可靠度来检测物体,深度的可靠度是根据物体在边缘方向上相对于第一立体相机11a和第二立体相机11b的基线长度的方向的角度来确定的。

[0146]

因此,通过使用要根据物体的边缘方向确定的深度的可靠度,该信息处理方法可以以高精度检测物体,而与边缘方向无关。而且,该信息处理方法被应用于例如诸如无人机之类的无人移动体,从而可以适当地识别诸如电线之类的水平线,并且可以避免建筑物的顶部被识别为向前突出。而且,根据该信息处理方法,可以使用现有深度估计系统,其使用立体相机,并且相应地可以以低成本提高物体的检测精度。

[0147]

信息处理程序使计算机用作深度估计单元21、边缘检测单元22和物体检测单元23。根据由被布置为使得其相应基线长度的方向彼此相交的第一立体相机11a和第二立体相机11b捕获的捕获图像,深度估计单元21估计包括在捕获图像中的物体的深度。而且,物体检测单元23基于由深度估计单元21估计的深度和深度的可靠度来检测物体,深度的可靠度要根据物体在边缘方向上相对于第一立体相机11a和第二立体相机11b的基线长度的方

向的角度来确定。

[0148]

因此,通过使用要根据物体的边缘方向确定的深度的可靠度,信息处理程序可以以高精度检测物体,而不管边缘方向。而且,该信息处理程序被应用于例如诸如无人机之类的无人移动体,从而可以适当地识别诸如电线之类的水平线,并且可以避免建筑物的顶部被识别为向前突出。而且,根据该信息处理程序,可以使用现有深度估计系统,其使用立体相机,并且相应地可以以低成本提高物体的检测精度。

[0149]

注意的是,本说明书中描述的效果仅是示例而非限制,并且可以呈现其它效果。

[0150]

以上参考附图详细描述了本公开的优选实施例;但是,本公开的技术范围不限于此类示例。显然,本公开技术领域的普通技术人员可以在权利要求中描述的技术构思的范围内想到各种修改或变更,并且应该理解的是,这些也自然落入本公开的技术范围内。

[0151]

例如,上述信息处理装置1和1a中的每一个的立体相机系统10是设有三个成像单元10a、10b和10c(参见图7)的三目相机系统;但是,成像单元的数量可以是四个或更多。而且,在上述信息处理装置1和1a中的每一个中,指示深度的可靠度的概率分布由二维正态分布(参见图14和图16)表示,但可以由除二维正态分布以外的其它分布表示。

[0152]

而且,在上述信息处理装置1和1a中,物体的边缘由边缘检测单元22检测,并且深度的可靠度根据物体在边缘方向上相对于第一立体相机11a和第二立体相机11b的基线长度的方向的角度来确定;但是,可以检测除该边缘以外的物体的边缘线,并且深度的可靠度可以根据物体在边缘线的方向上相对于基线长度的上述方向的角度来确定。例如,除边缘以外的物体的边缘线还包括指示物体中颜色、图案等之间的边界的连续线等。

[0153]

另外,在上述信息处理装置1中,当存在地图投票概率的多个计算结果时,将多个地图投票概率彼此相乘并相加(参见步骤s10图17);但是,可以基于具有更高概率的地图投票概率对占用网格地图进行投票,而不将地图投票概率彼此相加。

[0154]

而且,上述信息处理装置1和1a可以获取可靠的深度信息,而不管用作被摄体的物体的边缘方向如何,并且相应地可以被广泛用于创建占用网格地图以外的目的。例如,信息处理装置1和1a使用获取的数据作为关键帧,从而可以检查其后获取的数据(可以允许由单个立体声获取的数据)是否具有不自然的部分,或者可以被用于确定短时间的碰撞。

[0155]

注意的是,本技术还可以采用如下这样的配置。

[0156]

(1)

[0157]

一种信息处理装置,包括:

[0158]

多个立体相机,被布置为使得各个立体相机的基线长度的方向彼此相交;

[0159]

深度估计单元,根据由该多个立体相机捕获的捕获图像来估计包括在捕获图像中的物体的深度;以及

[0160]

物体检测单元,基于由深度估计单元估计的深度和深度的可靠度来检测物体,深度的可靠度是根据物体的边缘线的方向相对于多个立体相机的基线长度的方向的角度来确定的。

[0161]

(2)

[0162]

根据(1)所述的信息处理装置,其中深度的可靠度是在捕获图像中物体的边缘线存在的位置处的概率分布,是边缘线的方向相对于基线长度的方向越接近直角而越具有高概率的概率分布。

[0163]

(3)

[0164]

根据(1)或(2)所述的信息处理装置,其中

[0165]

物体检测单元

[0166]

计算基于由深度估计单元估计的深度的第一概率分布和指示深度的可靠度的第二概率分布,

[0167]

基于第一概率分布和第二概率分布,计算指示物体在占用网格地图中占用每个网格的概率的地图投票概率,在占用网格地图中,包括在捕获图像中的空间被划分成网格形状,以及

[0168]

基于地图投票概率对每个网格进行投票以创建占用网格地图。

[0169]

(4)

[0170]

根据(3)所述的信息处理装置,其中物体检测单元将第一概率分布和第二概率分布彼此相乘以计算地图投票概率。

[0171]

(5)

[0172]

根据(1)至(4)中的任一项所述的信息处理装置,其中

[0173]

物体检测单元

[0174]

将在前一帧中计算出的第二概率分布注册为关键帧,以及

[0175]

当在当前帧中多个立体相机的位置和姿态改变时,基于多个立体相机的位置和姿态的变化量对关键帧进行变形,以计算第二概率分布。

[0176]

(6)

[0177]

根据(1)至(5)中的任一项所述的信息处理装置,其中

[0178]

物体检测单元将通过对关键帧进行变形而计算出的第二概率分布与在当前帧中计算出的第二概率分布彼此进行比较,以对第二概率分布进行过滤。

[0179]

(7)

[0180]

根据(1)至(6)中的任一项所述的信息处理装置,其中

[0181]

多个立体相机包括第一立体相机和第二立体相机,以及

[0182]

第一立体相机和第二立体相机被布置为使得第一立体相机的基线长度的方向与第二立体相机的基线长度的方向彼此垂直。

[0183]

(8)

[0184]

一种信息处理方法,包括:

[0185]

根据由多个立体相机捕获的捕获图像来估计包括在捕获图像中的物体的深度,该多个立体相机被布置为使得各个立体相机的基线长度的方向彼此相交;以及

[0186]

基于深度和深度的可靠度来检测物体,深度的可靠度是根据物体的边缘线的方向相对于多个立体相机的基线长度的方向的角度来确定的。

[0187]

(9)

[0188]

一种使计算机具有以下功能的信息处理程序:

[0189]

深度估计单元,根据由多个立体相机捕获的捕获图像来估计包括在捕获图像中的物体的深度,该多个立体相机被布置为使得各个立体相机的基线长度的方向彼此相交;以及

[0190]

物体检测单元,基于由深度估计单元估计的深度和深度的可靠度来检测物体,深

度的可靠度是根据物体的边缘线的方向相对于多个立体相机的基线长度的方向的角度来确定的。

[0191]

附图标记列表

[0192]

1,1a 信息处理装置

[0193]

10,10a,110 立体相机系统

[0194]

10a,10b,10c,110a,110b 成像单元

[0195]

11a 第一立体相机

[0196]

11b 第二立体相机

[0197]

12,120 支撑构件

[0198]

20,20a 控制单元

[0199]

21 深度估计单元

[0200]

22 边缘检测单元

[0201]

23 物体检测单元

[0202]

24 位置/姿态估计单元

[0203]

30 存储单元

[0204]

40 惯性测量单元

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。