1.本技术涉及智能图像处理技术领域,特别涉及一种针对网络授课的学习专注度的检测方法及终端设备。

背景技术:

2.网络授课是在新形势下尤其重要的一种教学方式。网络教学时,学生通常通过平板电脑等终端设备开启应用软件,连接老师的电脑,通过视频接收教育。但是当前网络授课中暴露出很多问题,比如老师无法像线下课堂一样去监控学生学习的专注度,导致授课质量下降。因此消费者尤其是学生家长非常希望学生在使用终端设备进行网络课程学习时,能够通过有效的方法提高学生的专注度,确保学生能够专注的学习。

3.相关技术中,有些终端设备虽然具备专注度检测技术,但这些终端设备用于课堂的专注度检测的方法是检测人眼视线或者检测人头部的朝向,以此判定终端用户是否专注于学习。这些方法检测方式过于粗糙,对于学习专注度的检测结果准确度较低。

技术实现要素:

4.本技术的目的是提供一种针对网络授课的学习专注度的检测方法及终端设备,用以解决相关技术中对学习专注度的检测结果准确度较低的问题。

5.第一方面,本技术提供一种针对网络授课的学习专注度的检测方法,所述方法包括:

6.检测网络授课的音频数据中的教学指令,并获取所述教学指令的有效期内的待匹配动作类别;所述待匹配动作类别是对视频数据中的目标对象进行动作检测得到的;

7.将所述待匹配动作类别与所述教学指令进行匹配操作,得到所述目标对象的学习专注度。

8.在一种可能的实施方式中,所述对视频数据中的目标对象进行动作检测,包括:

9.将所述视频数据中每连续n帧图像作为一个图像序列,n为正整数;

10.针对每个图像序列分别执行:

11.获取所述图像序列的每帧图像中所述目标对象的关键点数据,得到由每帧图像的关键点数据组建的关键点序列;所述关键点数据包括人脸关键点和人体关键点;

12.将所述关键点序列输入动作识别深度学习模型,得到所述目标对象的动作类别。

13.在一种可能的实施方式中,所述将所述待匹配动作类别与所述教学指令进行匹配操作,得到所述目标对象的学习专注度,包括:

14.在预先存储的对应关系表中查找所述待匹配动作类别和所述教学指令是否具有对应关系;

15.若具有对应关系则确定所述目标对象的学习专注度为第一值;

16.若不具有所述对应关系则确定所述目标对象的学习专注度为第二值。

17.在一种可能的实施方式中,所述获取所述教学指令的有效期内的待匹配动作类

别,包括:

18.在所述教学指令为最新教学指令的前提下,将检测到的所述目标对象的动作类别确定为所述待匹配动作类别;或者,

19.记录所述教学指令的第一检测时间和各动作类别的第二检测时间,若所述动作类别的第二检测时间在指定时间区间内,则确定所述动作类别为所述待匹配动作类别,所述指定时间区间的起始时间为所述教学指令的第一检测时间,所述指定时间区间的结束时间为下一教学指令的第一检测时间。

20.在一种可能的实施方式中,所述方法还包括:

21.确定与所述教学指令匹配的第一个动作类别的第二检测时间;

22.确定所述第一个动作类别的第二检测时间和所述教学指令的第一检测时间之间的时间差;

23.将预设的动作延迟时长除以所述时间差之后乘以所述第一值,得到更新后的所述第一值,其中所述预设的动作延迟时长用于表示发出所述教学指令到执行所述教学指令所需的时长。

24.在一种可能的实施方式中,所述方法还包括:

25.将所述教学指令的有效期的时长作为有效时长,并确定与所述教学指令匹配的待匹配动作类别的延续时长;

26.将所述延续时长除以所述有效时长之后乘以更新后的所述第一值,得到所述目标对象的第一值的最终值。

27.在一种可能的实施方式中,所述检测网络授课的音频数据中的教学指令,包括:

28.对所述音频数据进行音频识别,得到文本序列;

29.基于预设的教学指令关键词对所述文本序列进行检测得到教学指令。

30.在一种可能的实施方式中,所述获取所述图像序列的每帧图像中所述目标对象的关键点数据,包括:

31.基于人体关键点检测模型,得到所述图像序列中每帧图像的人体关键点;

32.基于人脸关键点检测模型,得到所述图像序列中每帧图像的人脸关键点。

33.在一种可能的实施方式中,所述方法还包括:

34.针对所述图像序列中相似度高于相似度阈值的多帧相似图像,采用所述人体关键点检测模型和所述人脸关键点检测模型处理所述多帧相似图像中的一帧图像,得到所述多帧相似图像分别对应的人体关键点和人脸关键点。

35.第二方面,本技术提供一种终端设备,包括:

36.显示器、处理器和存储器;

37.所述显示器用于显示屏幕显示区域;

38.所述存储器,用于存储所述处理器可执行指令;

39.所述处理器被配置为执行所述指令以实现如上述第一方面中任一项所述的针对网络授课的学习专注度的检测方法。

40.第三方面,本技术提供一种计算机可读存储介质,当所述计算机可读存储介质中的指令由终端设备执行时,使得所述终端设备能够执行如上述第一方面中任一项所述的针对网络授课的学习专注度的检测方法。

41.第四方面,本技术提供一种计算机程序产品,包括计算机程序:

42.所述计算机程序被处理器执行时实现如上述第一方面中任一项所述的针对网络授课的学习专注度的检测方法。

43.本技术的实施例提供的技术方案至少带来以下有益效果:

44.本技术实施例通过检测网络授课的音频数据中的教学指令,并获取教学指令的有效期内的待匹配动作类别;所述待匹配动作类别是对视频数据中的目标对象进行动作检测得到的;将待匹配动作类别与教学指令进行匹配操作,得到目标对象的学习专注度。由此通过对比老师的教学指令与教学指令的有效期内目标对象的动作类别的符合程度,根据符合程度确定目标对象的学习专注度,可以提高目标对象的学习专注度的检测结果的准确性,使得老师能够更加准确的监控目标对象的学习专注度,提高授课质量。

45.本技术的其它特征和优点将在随后的说明书中阐述,并且,部分地从说明书中变得显而易见,或者通过实施本技术而了解。本技术的目的和其他优点可通过在所写的说明书、权利要求书、以及附图中所特别指出的结构来实现和获得。

附图说明

46.为了更清楚地说明本技术实施例的技术方案,下面将对本技术实施例中所需要使用的附图作简单地介绍,显而易见地,下面所介绍的附图仅仅是本技术的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

47.图1为本技术实施例提供的一种终端设备的结构示意图;

48.图2为本技术实施例提供的终端设备的软件结构框图;

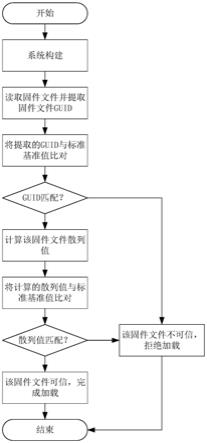

49.图3为本技术实施例提供的一种针对网络授课的学习专注度的检测方法的流程示意图;

50.图4为本技术实施例提供的网络授课的音频数据中的教学指令的检测方法的流程示意图;

51.图5为本技术实施例提供的图像序列中目标对象的动作类别的检测方法的流程示意图;

52.图6为本技术实施例提供的获取图像序列中目标对象的关键点序列的流程示意图;

53.图7为本技术实施例提供的人体关键点检测模型中关键点的示意图;

54.图8为本技术实施例提供的人脸关键点检测模型中关键点的示意图;

55.图9为本技术实施例提供的图像序列中目标对象的动作类别识别过程的示意图;

56.图10为本技术实施例提供的一种确定检测时间吻合的动作类别与教学指令的示意图;

57.图11为本技术实施例提供的另一种确定检测时间吻合的动作类别与教学指令的示意图;

58.图12为本技术实施例提供的另一种针对网络授课的学习专注度的检测方法的流程示意图。

具体实施方式

59.为使本技术实施例的目的、技术方案和优点更加清楚,下面将结合本技术实施例中的附图,对本技术实施例中的技术方案进行清楚、完整地描述。其中,所描述的实施例是本技术一部分实施例,而不是全部的实施例。基于本技术中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其它实施例,都属于本技术保护的范围。

60.并且,在本技术实施例的描述中,除非另有说明,“/”表示或的意思,例如,a/b可以表示a或b;文本中的“和/或”仅仅是一种描述关联对象的关联关系,表示可以存在三种关系,例如,a和/或b,可以表示:单独存在a,同时存在a和b,单独存在b这三种情况,另外,在本技术实施例的描述中,“多个”是指两个或多于两个。

61.以下,术语“第一”、“第二”仅用于描述目的,而不能理解为暗示或暗示相对重要性或者隐含指明所指示的技术特征的数量。由此,限定有“第一”、“第二”、的特征可以明示或者隐含地包括一个或者更多个该特征,在本技术实施例的描述中,除非另有说明,“多个”的含义是两个或两个以上。

62.网络授课是在新形势下尤其重要的一种教学方式。网络教学时,学生通常通过平板电脑等终端设备开启应用软件,连接老师的电脑,通过视频接受教育。但是当前网络授课中暴露出很多问题,比如老师无法像线下课堂一样去监控学生学习的专注度,导致授课质量下降。因此消费者尤其是学生家长非常希望学生在使用终端设备进行网络课程学习时,能够通过有效的方法提高学生的专注度,确保学生能够专注的学习。

63.相关技术中,有些终端设备并不具备专注度检测技术,而有些终端设备虽然具备专注度检测技术,但这些终端设备用于课堂的专注度检测的方法是检测人眼视线或者检测人头部的朝向,以此判定终端用户是否专注于学习。这些检测方法过于粗糙,忽视了终端用户在学习过程并非单纯的注视观看视频,还需要进行听写、跟读、动作模仿等操作,导致这些方法在听写、跟读、动作模仿等操作上的对于用户学习专注度的检测结果准确度较低。

64.有鉴于此,本技术提供了一种针对网络授课的学习专注度的检测方法及终端设备,用以解决相关技术中对用户学习专注度的检测结果准确度较低的问题。

65.本技术的发明构思可概括为:本技术实施例通过检测网络授课的音频数据中的教学指令,并获取教学指令的有效期内的待匹配动作类别;所述待匹配动作类别是对视频数据中的目标对象进行动作检测得到的;将待匹配动作类别与教学指令进行匹配操作,得到目标对象的学习专注度。由此通过对比老师的教学指令与教学指令的有效期内目标对象的动作类别的符合程度,根据符合程度确定目标对象的学习专注度,可以提高目标对象的学习专注度的检测结果的准确性,使得老师能够更加准确的监控目标对象的学习专注度,提高授课质量。

66.在介绍完本技术的发明构思之后,下面先对本技术提供的终端设备进行说明。图1示出了一种终端设备100的结构示意图。应该理解的是,图1所示终端设备100仅是一个范例,并且终端设备100可以具有比图1中所示的更多的或者更少的部件,可以组合两个或多个的部件,或者可以具有不同的部件配置。图中所示出的各种部件可以在包括一个或多个信号处理和/或专用集成电路在内的硬件、软件、或硬件和软件的组合中实现。

67.图1中示例性示出了根据示例性实施例中终端设备100的硬件配置框图。如图1所示,终端设备100包括:射频(radio frequency,rf)电路110、存储器120、显示单元130、摄像

头140、传感器150、音频电路160、无线保真(wireless fidelity,wi-fi)模块170、处理器180、蓝牙模块181、以及电源190等部件。

68.rf电路110可用于在收发信息或通话过程中信号的接收和发送,可以接收基站的下行数据后交给处理器180处理;可以将上行数据发送给基站。通常,rf电路包括但不限于天线、至少一个放大器、收发信机、耦合器、低噪声放大器、双工器等器件。

69.存储器120可用于存储软件程序及数据。处理器180通过运行存储在存储器120的软件程序或数据,从而执行终端设备100的各种功能以及数据处理。存储器120可以包括高速随机存取存储器,还可以包括非易失性存储器,例如至少一个磁盘存储器件、闪存器件、或其他易失性固态存储器件。存储器120存储有使得终端设备100能运行的操作系统。本技术中存储器120可以存储操作系统及各种应用程序,还可以存储执行本技术实施例所述针对网络授课的学习专注度的检测方法的程序代码。

70.显示单元130可用于接收输入的数字或字符信息,产生与终端设备100的用户设置以及功能控制有关的信号输入,具体地,显示单元130可以包括设置在终端设备100正面的触摸屏131,可收集用户在其上或附近的触摸操作,例如点击按钮。

71.显示单元130还可用于显示由用户输入的信息或提供给用户的信息以及终端设备100的各种菜单的图形用户界面(graphical user interface,gui)。具体地,显示单元130可以包括设置在终端设备100正面的显示屏132。其中,显示屏132可以采用液晶显示器、发光二极管等形式来配置。显示单元130可以用于显示本技术中终端设备的屏幕显示区域。

72.其中,触摸屏131可以覆盖在显示屏132之上,也可以将触摸屏131与显示屏132集成而实现终端设备100的输入和输出功能,集成后可以简称触摸显示屏。本技术中显示单元130可以显示应用程序以及对应的操作步骤。

73.摄像头140可用于捕获静态图像或视频。物体通过镜头生成光学图像投射到感光元件。感光元件可以是电荷耦合器件(charge coupled device,ccd)或互补金属氧化物半导体(complementary metal-oxide-semiconductor,cmos)光电晶体管。感光元件把光信号转换成电信号,之后将电信号传递给处理器180转换成数字图像信号。

74.终端设备100还可以包括至少一种传感器150,比如加速度传感器151、距离传感器152、指纹传感器153、温度传感器154。终端设备100还可配置有陀螺仪、气压计、湿度计、温度计、红外线传感器、光传感器、运动传感器等其他传感器。

75.音频电路160、扬声器161、麦克风162可提供用户与终端设备100之间的音频接口。音频电路160可将接收到的音频数据转换后的电信号,传输到扬声器161,由扬声器161转换为声音信号输出。终端设备100还可配置音量按钮,用于调节声音信号的音量,还可以用于组合其他按钮,调整封闭区域。另一方面,麦克风162将收集的声音信号转换为电信号,由音频电路160接收后转换为音频数据,再将音频数据输出至rf电路110以发送给比如另一终端设备,或者将音频数据输出至存储器120以便进一步处理。

76.wi-fi属于短距离无线传输技术,终端设备100可以通过wi-fi模块170帮助用户收发电子邮件、浏览网页和访问流媒体等,它为用户提供了无线的宽带互联网访问。

77.处理器180是终端设备100的控制中心,利用各种接口和线路连接整个终端设备的各个部分,通过运行或执行存储在存储器120内的软件程序,以及调用存储在存储器120内的数据,执行终端设备100的各种功能和处理数据。在一些实施例中,处理器180可包括一个

或多个处理单元;处理器180还可以集成应用处理器和基带处理器,其中,应用处理器主要处理操作系统、用户界面和应用程序等,基带处理器主要处理无线通信。可以理解的是,上述基带处理器也可以不集成到处理器180中。本技术中处理器180可以运行操作系统、应用程序、用户界面显示及触控响应,以及本技术实施例所述的针对网络授课的学习专注度的检测方法。另外,处理器180与显示单元130耦接。

78.蓝牙模块181,用于通过蓝牙协议来与其他具有蓝牙模块的蓝牙设备进行信息交互。例如,终端设备100可以通过蓝牙模块181与同样具备蓝牙模块的可穿戴电子设备(例如智能手表)建立蓝牙连接,从而进行数据交互。

79.终端设备100还包括给各个部件供电的电源190(比如电池)。电源可以通过电源管理系统与处理器180逻辑相连,从而通过电源管理系统实现管理充电、放电以及功耗等功能。终端设备100还可配置有电源按钮,用于终端设备的开机和关机,以及锁屏等功能。

80.图2是本技术实施例的终端设备100的软件结构框图。

81.分层架构将软件分成若干个层,每一层都有清晰的角色和分工。层与层之间通过软件接口通信。在一些实施例中,可将android系统分为四层,从上至下分别为应用程序层,应用程序框架层,安卓运行时(android runtime)和系统库,以及内核层。

82.应用程序层可以包括一系列应用程序包。

83.如图2所示,应用程序包可以包括腾讯课堂,钉钉,学而思,高途,相机,视频,图库,日历,wlan,蓝牙等应用程序。

84.应用程序框架层为应用程序层的应用程序提供应用编程接口(application programming interface,api)和编程框架。应用程序框架层包括一些预先定义的函数。

85.如图2所示,应用程序框架层可以包括窗口管理器,内容提供器,视图系统,电话管理器,资源管理器,通知管理器等。

86.窗口管理器用于管理窗口程序。窗口管理器可以获取显示屏大小,判断是否有状态栏,锁定屏幕,截取屏幕等。

87.内容提供器用来存放和获取数据,并使这些数据可以被应用程序访问。所述数据可以包括视频,图像,音频,拨打和接听的电话,浏览历史和书签,电话簿、短信息等。

88.视图系统包括可视控件,例如显示文字的控件,显示图片的控件等。视图系统可用于构建应用程序。显示界面可以由一个或多个视图组成的。例如,包括短信息通知图标的显示界面,可以包括显示文字的视图以及显示图片的视图。

89.电话管理器用于提供终端设备100的通信功能。例如通话状态的管理(包括接通,挂断等)。

90.资源管理器为应用程序提供各种资源,比如本地化字符串,图标,图片,布局文件,视频文件等。

91.通知管理器使应用程序可以在状态栏中显示通知信息(例如短信息的消息内容),可以用于传达告知类型的消息,可以短暂停留后自动消失,无需用户交互。比如通知管理器被用于告知下载完成,消息提醒等。通知管理器还可以是以图表或者滚动条文本形式出现在系统顶部状态栏的通知,例如后台运行的应用程序的通知,还可以是以对话窗口形式出现在屏幕上的通知。例如在状态栏提示文本信息,发出提示音,终端设备振动,指示灯闪烁等。

92.android runtime包括核心库和虚拟机。android runtime负责安卓系统的调度和管理。

93.核心库包含两部分:一部分是java语言需要调用的功能函数,另一部分是安卓的核心库。

94.应用程序层和应用程序框架层运行在虚拟机中。虚拟机将应用程序层和应用程序框架层的java文件执行为二进制文件。虚拟机用于执行对象生命周期的管理,堆栈管理,线程管理,安全和异常的管理,以及垃圾回收等功能。

95.系统库可以包括多个功能模块。例如:表面管理器(surface manager),媒体库(media libraries),三维图形处理库(例如:opengl es),2d图形引擎(例如:sgl)等。

96.表面管理器用于对显示子系统进行管理,并且为多个应用程序提供了2d和3d图层的融合。

97.媒体库支持多种常用的音频,视频格式回放和录制,以及静态图像文件等。媒体库可以支持多种音视频编码格式,例如:mpeg4,h.264,mp3,aac,amr,jpg,png等。

98.三维图形处理库用于实现三维图形绘图,图像渲染,合成,和图层处理等。

99.2d(一种动画方式)图形引擎是2d绘图的绘图引擎。

100.内核层是硬件和软件之间的层。内核层至少包含显示驱动,摄像头驱动,音频驱动,传感器驱动。

101.本技术实施例中的终端100可以为包括但不限于智能手机、平板电脑、可穿戴电子设备(例如智能手表)、笔记本电脑等电子设备。

102.为了便于理解本技术实施例提供的针对网络授课的学习专注度的检测方法,下面结合附图对此进行进一步说明。

103.图3为本技术实施例提供的针对网络授课的学习专注度的检测方法的流程示意图。如图3所示,该方法包括以下步骤:

104.在步骤301中,检测网络授课的音频数据中的教学指令,并获取教学指令的有效期内的待匹配动作类别;其中,待匹配动作类别是对视频数据中的目标对象进行动作检测得到的。

105.在一种可能的实施方式中,本技术实施例中检测网络授课的音频数据中的教学指令,可以实施为:对音频数据进行音频识别,得到文本序列;基于预设的教学指令关键词对文本序列进行检测得到教学指令。

106.示例性的,网络授课的音频数据中的教学指令的检测方法的流程示意图如图4所示,包括以下步骤:

107.在步骤401中,提取网络授课的视频流中的音频数据,输入给语音识别模块。

108.在步骤402中,将音频数据进行特征提取,将特征提取出来的音频数据转换为文本序列。

109.其中,语音识别模块可以采用开源的kaldi hmm-gmm(kaldi-hidden markov model-gaussian mixture model,语音识别-隐马尔可夫模型-高斯混合模型)模型,将音频数据进行特征提取,例如进行语音特征参数mfcc(mel frequency cepstrum coefficient,梅尔倒谱系数)提取。语音识别模块可以使用gmm模型(gaussian mixture model,高斯混合模型)将特征提取出来的音频数据转换为文本序列。

110.在步骤403中,基于预设的教学指令关键词找出教学指令。

111.首先将步骤402中输出的文本序列输入教学指令分析模块,然后教学指令分析模块基于预设的教学指令关键词,从语音识别模块输出的文本序列中找出教学指令。

112.其中,预设的教学指令包含老师教学中常用的词汇,如:“请跟我读”,“请大声朗诵”,“请看”,“请看屏幕”,“听写测试”,“做眼保健操”等。

113.其中,若在文本序列中未检测到任意预设的教学指令关键词,则确定检测到默认教学指令。例如将“请看”设置为默认教学指令,当未检测到任意预设的教学指令关键词时,认为检测到的网络授课的音频数据中老师的教学指令为“请看”。由此,可以针对听讲状态准确获取网络授课的音频数据中老师的教学指令。

114.在一种可能的实施方式中,为了基于目标对象的视频数据对视频数据中的目标对象进行动作检测,本技术实施例中可以将视频数据中每连续n帧图像作为一个图像序列,其中,n为正整数,并针对每个图像序列分别执行如图5所示的步骤:

115.在步骤501中,获取图像序列的每帧图像中目标对象的关键点数据,得到由每帧图像的关键点数据组建的目标对象的关键点序列;关键点数据包括人脸关键点和人体关键点。

116.在一种可能的实施方式中,获取图像序列的每帧图像中目标对象的关键点数据,具体可以实施为:基于人体关键点检测模型,得到图像序列中每帧图像的人体关键点;基于人脸关键点检测模型,得到图像序列中每帧图像的人脸关键点。

117.示例性的,可以将一段视频数据中每连续10帧图像作为一个图像序列,例如首先将第1帧图像到第10帧图像作为第一个图像序列,将第2帧图像到第11帧图像作为第二个图像序列,将第3帧图像到第12帧图像作为第三个图像序列,以此类推得到多个图像序列。

118.在一种可能的实施方式中,获取图像序列的目标对象的关键点序列,可以实施为如图6所示的步骤:

119.在步骤601中,获取图像序列中的每一帧图像;

120.在步骤602中,将图像序列中的每一帧图像输入人体关键点检测模型和人脸关键点检测模型;

121.在步骤603中,人体关键点检测模型和人脸关键点检测模型分别输出人体关键点和人脸关键点,图像序列中的所有图像的人体关键点和人脸关键点组成关键点序列。

122.如图7所示,经过人体关键点检测模型输出的人体关键点有25个,分别对应的人体位置为:(0,“鼻子”)、(1,“脖子”)、(2,“右肩”)、(3,“右肘”)、(4,“右手腕”)、(5,“左肩”)、(6,“左肘”)、(7,“左手腕”)、(8,“中臀部”)、(9,“右臀部”)、(10,“右膝”)、(11,“右踝关节”)、(12,“左臀部”)、(13,“左膝”)、(14,“左踝关节”)、(15,“右眼”)、(16,“左眼”)、(17,“右耳”)、(18,“左耳”)、(19,“左大脚趾”)、(20,“左小脚趾”)、(21,“左脚后跟”)、(22,“右大脚趾”)、(23,“右小脚趾”)、(24,“右脚后跟”)。如图8所示,经过人脸关键点检测模型输出的人脸关键点有98个,分别对应人脸中的各个部位。在一帧图像中检测到如图7所示的人体关键点和如图8所示的人脸关键点后,可以将人体关键点和人脸关键点共同组建,得到一帧图像的关键点数据,如{人体关键点0,1

……

24、人脸关键点0,1

……

97},然后将图像序列中所有图像的关键点数据共同组建,得到关键点序列,如{第一帧图像的人体关键点0,1

……

24、第一帧图像的人脸关键点0,1

……

97、第二帧图像的人体关键点0,1

……

24、第二帧图像的

人脸关键点0,1

……

97、

……

}为一个关键点序列。

123.当然,在本技术中人体关键点检测模型检测的人体关键点个数也可以更多或更少,例如只检测18个人体关键点或者只检测腰部及腰部以上的人体关键点,只要能够识别出目标对象的动作类别即可。在本技术中人脸关键点检测模型检测的人脸关键点个数也可以分别从图8所示的98个人脸关键点中的眉、眼、鼻、嘴中各抽取一部分人脸关键点组成人脸关键点集,也可以分别增加更细密的人脸关键点达到更多的人脸关键点,可以根据实际情况进行设置,本技术实施例不做限制。

124.其中,本技术实施例适用的人体关键点检测模型包括但不限于cpm(convolutional pose machines,卷积姿态机)、openpose(人体姿态识别模型)、hourglass(人体姿态估计模型)等,本技术实施例适用的人脸关键点检测模型包括但不限于dan(deep alignment network,人脸对齐模型),pfld(practical facial landmark detector,人脸检测模型)及dlib(人脸检测)开源库。

125.其中,本技术实施例不限制获取图像序列中每帧图像的人体关键点和获取图像序列中每帧图像的人脸关键点的先后顺序,可以同时进行,也可以先获取图像序列中每帧图像的人体关键点再获取图像序列中每帧图像的人脸关键点,还可以先获取图像序列中每帧图像的人脸关键点再获取图像序列中每帧图像的人体关键点。

126.由此,基于人体关键点检测模型和人脸关键点检测模型,可以获取图像序列的每帧图像中目标对象的人体关键点和人脸关键点,然后将每帧图像的人体关键点和人脸关键点共同组建,得到目标对象的关键点序列,然后在步骤502中,将关键点序列输入动作识别深度学习模型,得到目标对象的动作类别。

127.示例性的,动作类别识别过程如图9所示,获取图像序列的每帧图像中目标对象的关键点数据之后得到由每帧图像的关键点数据组建的目标对象的关键点序列,然后将目标对象的关键点序列输入动作识别深度学习模型,经过动作识别深度学习模型的计算最终会得到图像序列中目标对象的动作类别。

128.其中,本技术实施例中训练动作识别深度学习模型可以预先采集多个目标对象的学习相关视频,然后人工按动作分类对视频片段中的动作类别进行标注分类,如将视频片段分别标注成对应的“朗读”、“书写”等动作类别,然后将标注好的视频文件转换为关键点序列。将关键点序列作为训练动作识别深度学习模型的训练样本,输入动作识别深度学习模型,得到输出的目标对象的动作类别,与标注好的动作类别对比,得到损失函数,然后基于损失函数调整模型参数,经过多次训练最终得到稳定的动作识别深度学习模型。

129.其中,本技术实施例适用的动作识别深度学习模型包括但不限于st-gcn(spatial temporal-graph convolution networks,时空图卷积网络)、as-gcn(actional-structural graph convolutional networks,动作结构图卷积网络)、2s-agcn(two-stream-adaptive graph convolutional networks,双流自适应图卷积网络)等。

130.由此,可以基于目标对象的视频数据对视频数据中的目标对象进行动作检测得到目标对象的动作类别。

131.其中,在本技术实施例中不限制检测网络授课的音频数据中老师的教学指令和基于目标对象的视频数据对视频数据中的目标对象进行动作检测的执行顺序。

132.在一种可能的实施方式中,在基于目标对象的视频数据对视频数据中的目标对象

进行动作检测得到目标对象的动作类别之后,需要获取教学指令的有效期内的待匹配动作类别,因此本技术实施例中可以在教学指令为最新教学指令的前提下,将检测到的目标对象的动作类别确定为待匹配动作类别;或者可以记录教学指令的第一检测时间和各动作类别的第二检测时间,若动作类别的第二检测时间在指定时间区间内,则确定动作类别为待匹配动作类别,其中指定时间区间的起始时间为教学指令的第一检测时间,指定时间区间的结束时间为下一教学指令的第一检测时间。

133.示例性的,如图10所示,在a时刻检测到教学指令1,在b时刻检测到教学指令2,在c时刻检测到动作类别1,a时刻早于b时刻,b时刻早于c时刻,则确定教学指令2为最新教学指令,则确定动作类别1为教学指令2的待匹配动作类别。

134.示例性的,如图11所示,教学指令1的第一检测时间为a时刻,动作类别1的第二检测时间为b时刻,教学指令2的第一检测时间为c时刻,a时刻早于b时刻,b时刻早于c时刻,则检测到动作类别1的第二检测时间在检测到教学指令1的第一检测时间和检测到教学指令2的第一检测时间之间,则确定动作类别1为教学指令1的待匹配动作类别。

135.在步骤302中,将待匹配动作类别与教学指令进行匹配操作,得到目标对象的学习专注度。

136.在一种可能的实施方式中,本技术实施例中将待匹配动作类别与教学指令进行匹配操作,得到目标对象的学习专注度,具体可以实施为:在预先存储的对应关系表中查找待匹配动作类别和教学指令是否具有对应关系;若具有对应关系则确定目标对象的学习专注度为第一值;若不具有对应关系则确定目标对象的学习专注度为第二值。

137.其中,预先存储的对应关系表如表1所示:

138.表1

[0139][0140]

示例性的,示例性的,在表1中查找待匹配动作类别和教学指令是否具有对应关系,若具有对应关系,则设置目标对象的学习专注度为1,若不具有对应关系,则设置目标对象的学习专注度为0。

[0141]

若检测到待匹配动作类别为“注视”,教学指令为“请跟我读”,在表1中查找待匹配动作类别和教学指令不具有对应关系,则确定目标对象的学习专注度为0;若检测到待匹配

动作类别为“注视”,教学指令为“请看”,在表1中查找待匹配动作类别和教学指令具有对应关系,则确定目标对象的学习专注度为1。

[0142]

在一种可能的实施方式中,为了进一步提高目标对象的学习专注度的检测结果的准确性,本技术实施例中除了考虑教学指令和待匹配动作类别是否具有对应关系外,还考虑了与教学指令匹配的待匹配动作类别的时效性,具体可以实施为:确定与教学指令匹配的第一个待匹配动作类别的第二检测时间;以及确定第一个待匹配动作类别的第二检测时间和教学指令的第一检测时间之间的时间差;将预设的动作延迟时长除以时间差之后乘以第一值,得到更新后的第一值。

[0143]

其中,预设的动作延迟时长用于表示发出教学指令到执行教学指令所需的时长,是一个经验值。例如在9:15:00检测到“写”的教学指令,预设的动作延迟时长为30秒,则允许执行教学指令的最迟时间为9:15:30,即允许检测到目标对象的“写”的动作类别的最迟时间为9:15:30。

[0144]

示例性的,若已经检测出目标对象的学习专注度为第一值,且得到教学指令的第一检测时间为tx,与教学指令匹配的第一个待匹配动作类别的第二检测时间为tx’,则第一个待匹配动作类别的第二检测时间和教学指令的第一检测时间之间的时间差为δtx=tx

’‑

tx,预设的动作延迟时长为t

delay

,则更新后的目标对象的学习专注度为(t

delay

/δtx)

×

第一值。例如已经检测出目标对象的学习专注度为1,得到教学指令的第一检测时间为第8秒,与教学指令匹配的第一个待匹配动作类别的第二检测时间为第2秒,则第一个待匹配动作类别的第二检测时间和教学指令的第一检测时间之间的时间差为6秒,预设的动作延迟时长为5秒,则更新后的目标对象的学习专注度为(5/6)

×

1,得到更新后的目标对象的学习专注度为5/6。

[0145]

在一种可能的实施方式中,为了进一步提高目标对象的学习专注度的检测结果的准确性,本技术实施例中除了考虑教学指令和待匹配动作类别是否具有对应关系和与教学指令匹配的待匹配动作类别的时效性之外,还可以考虑与教学指令匹配的待匹配动作类别的延续时长在教学指令的有效时长中的占比,具体可以实施为:将教学指令的有效期的时长作为有效时长,并确定与教学指令匹配的待匹配动作类别的延续时长;以及将延续时长除以有效时长之后乘以更新后的第一值,得到目标对象的第一值的最终值。

[0146]

其中,一个教学指令的有效时长指的是发出一个教学指令后到发出下一个教学指令之间的时长。例如老师在9:15发出教学指令“写”,紧接着在9:30发出下一个教学指令“读”,则教学指令“写”的有效时长为15分钟。

[0147]

示例性的,若已经检测出目标对象的学习专注度,且教学指令的有效时长为t1,与教学指令匹配的待匹配动作类别的延续时长t1’,则与教学指令匹配的待匹配动作类别的延续时长在教学指令的有效时长中的占比为t1’/t1,则更新后的目标对象的学习专注度为(t1’/t1)

×

学习专注度。例如在考虑与教学指令匹配的待匹配动作类别的时效性之后,已经检测出目标对象的学习专注度为5/6,且得到教学指令的有效时长为5分钟,与教学指令匹配的待匹配动作类别的延续时长为3分钟,则最终的目标对象的学习专注度为(3/5)

×

(5/6),得到最终的目标对象的学习专注度为0.5。

[0148]

由此,通过考虑教学指令和待匹配动作类别是否具有对应关系、与教学指令匹配的待匹配动作类别的时效性以及与教学指令匹配的待匹配动作类别的延续时长在教学指

令的有效时长中的占比等各种因素可以更加准确的检测出目标对象的学习专注度。

[0149]

在一种可能的实施方式中,在提高目标对象的学习专注度的检测结果的准确性的同时,还需要节省计算资源,降低计算的复杂度,因此本技术实施例中可以针对图像序列中相似度高于相似度阈值的多帧相似图像,采用人体关键点检测模型和人脸关键点检测模型处理多帧相似图像中的一帧图像,得到多帧相似图像分别对应的人体关键点和人脸关键点。

[0150]

示例性的,若已经采用人体关键点检测模型和人脸关键点检测模型处理10帧图像中的第一帧图像,得到第一帧图像的人体关键点和人脸关键点,此时若检测出剩余的9帧图像与第一帧图像的相似度均高于相似度阈值,则不需要采用人体关键点检测模型和人脸关键点检测模型处理剩余的9帧图像,只需要直接将第一帧图像的人体关键点和人脸关键点作为剩余9帧图像的人体关键点和人脸关键点即可。

[0151]

为了确定图像序列中的多帧图像相似度高于相似度阈值,需要在提前检测图像序列中当前帧图像和前一帧图像的相似度,加入判断当前帧和前一帧图像的相似度之后,针对网络授课的学习专注度的检测方法的流程示意图如图12所示,具体包括以下步骤:

[0152]

在步骤121中,输入当前帧图像。

[0153]

在步骤122中,计算当前帧图像与前一帧图像的相似度。

[0154]

在步骤123中,判断相似度是否高于相似度阈值,若相似度高于相似度阈值,则在步骤124中,将前一帧图像的关键点序列作为当前帧图像的关键点序列,然后执行步骤126;若相似度小于或等于相似度阈值,则在步骤125中,基于人体关键点检测模型,获取当前帧图像的人体关键点以及基于人脸关键点检测模型,获取当前帧图像的人脸关键点,得到关键点序列。

[0155]

其中,判断图像序列中多帧相似图像的相似度可以采用亮度均值对比算法或lsb(least significant bit,最低有效位)等哈希算法。

[0156]

在步骤126中,将关键点序列输入动作识别深度学习模型,得到对应的动作类别。

[0157]

在步骤127中,检测网络授课的音频数据中的教学指令。

[0158]

其中,执行步骤121到步骤125的过程与执行步骤127的过程同步进行。

[0159]

在步骤128中,将检测时间吻合的动作类别与教学指令进行匹配操作。

[0160]

在步骤129中,获取目标对象的学习专注度。

[0161]

由此,在提高目标对象的学习专注度的检测结果的准确性的同时,还大大节省终端设备的计算资源,降低计算的复杂度,简便了计算过程。

[0162]

在一种可能的实施方式中,若需要同时获取较短时间的目标对象的学习专注度和较长时间段的目标对象的学习专注度,则需要分别对较短时间的目标对象的学习专注度和较长时间段的目标对象的学习专注度进行检测,需要重复很多计算过程,浪费计算资源。因此为了节省计算资源,简化计算过程,本技术实施例中还可以确定第一周期内目标对象的学习专注度的均值作为目标对象的平均专注度;之后将第一周期的学习专注度求均值或加权求和,得到第二周期的学习专注度;第二周期包括多个第一周期。

[0163]

示例性的,若需要同时获取目标对象每一节课和每一天的学习专注度,则第一周期为一节课,第二周期为一天,此时只需要检测目标对象每一节课的学习专注度,然后将这一天中所有课堂的目标对象的学习专注度求均值或者加权求和,从而获取目标对象这一天

的学习专注度,而不用再检测这一天的目标对象的学习专注度。

[0164]

其中,可以根据每一堂课对于学习专注度要求的不同,对不同课堂的学习专注度设置不同的权重,然后对所有课堂的学习专注度进行加权求和,从而获取目标对象每一天的学习专注度。例如一天中只上了一节体育课和一节数学课,体育课可能需要的学习专注度低于数学课需要的学习专注度,则计算这一天目标对象的学习专注度时,可以将体育课的学习专注度的权重设置为0.3,将数学课的学习专注度的权重设置为0.7,然后将体育课的学习专注度乘以0.3再加上数学课的学习专注度乘以0.7,得到这一天目标对象的学习专注度。

[0165]

由此,在检测较长时间段的目标对象的学习专注度时,可以节省终端设备的计算资源,简便了计算过程。

[0166]

基于前文的描述,本技术实施例通过检测网络授课的音频数据中的教学指令,并获取教学指令的有效期内的待匹配动作类别;待匹配动作类别是对视频数据中的目标对象进行动作检测得到的;将待匹配动作类别与教学指令进行匹配操作,得到目标对象的学习专注度。由此通过对比老师的教学指令与教学指令的有效期内目标对象的动作类别的符合程度,根据符合程度确定目标对象的学习专注度,与仅基于视线检测、头部动作检测的专注度检测方法相比,本技术可以提高目标对象的学习专注度的检测结果的准确性,使得老师能够更加准确的监控目标对象的学习专注度,提高授课质量。

[0167]

在示例性实施例中,本技术还提供了一种包括指令的计算机可读存储介质,例如包括指令的存储器120,上述指令可由终端设备100的处理器180执行以完成上述针对网络授课的学习专注度的检测方法。可选地,计算机可读存储介质可以是非临时性计算机可读存储介质,例如,所述非临时性计算机可读存储介质可以是rom、随机存取存储器(ram)、cd-rom、磁带、软盘和光数据存储设备等。

[0168]

在示例性实施例中,还提供一种计算机程序产品,包括计算机程序,所述计算机程序被处理器180执行时实现如本技术提供的针对网络授课的学习专注度的检测方法。

[0169]

本领域内的技术人员应明白,本技术的实施例可提供为方法、系统、或计算机程序产品。因此,本技术可采用完全硬件实施例、完全软件实施例、或结合软件和硬件方面的实施例的形式。而且,本技术可采用在一个或多个其中包含有计算机可用程序代码的计算机可用存储介质(包括但不限于磁盘存储器、cd-rom、光学存储器等)上实施的计算机程序产品的形式。

[0170]

本技术是参照根据本技术的方法、设备(系统)、和计算机程序产品的流程图和/或方框图来描述的。应理解可由计算机程序指令实现流程图和/或方框图中的每一流程和/或方框、以及流程图和/或方框图中的流程和/或方框的结合。可提供这些计算机程序指令到通用计算机、专用计算机、嵌入式处理机或其他可编程数据处理设备的处理器以产生一个机器,使得通过计算机或其他可编程数据处理设备的处理器执行的指令产生用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的装置。

[0171]

这些计算机程序指令也可存储在能引导计算机或其他可编程数据处理设备以特定方式工作的计算机可读存储器中,使得存储在该计算机可读存储器中的指令产生包括指令装置的制造品,该指令装置实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能。

[0172]

这些计算机程序指令也可装载到计算机或其他可编程数据处理设备上,使得在计算机或其他可编程设备上执行一系列操作步骤以产生计算机实现的处理,从而在计算机或其他可编程设备上执行的指令提供用于实现在流程图一个流程或多个流程和/或方框图一个方框或多个方框中指定的功能的步骤。

[0173]

显然,本领域的技术人员可以对本技术进行各种改动和变型而不脱离本技术的精神和范围。这样,倘若本技术的这些修改和变型属于本技术权利要求及其等同技术的范围之内,则本技术也意图包含这些改动和变型在内。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。