1.本发明涉及分布式光纤振动传感应用技术领域,特别涉及一种基于vision transformer分布式光纤传感器系统模式识别的方法。

背景技术:

2.传感器作为信息获取的首要和关键部件,在信息科学技术中占有重要地位。光纤传感器利用光波信号进行传感,利用光纤进行传感信号的传输,对被测参量实现测量。分布式光纤传感技术是指多个传感单元分布在同一条传输光纤上,通过一个通道采集信号。相对于传统的电学传感器,光纤传感器具有一系列独特的优势:屏蔽电磁场干扰;不产生电磁场干扰;损耗低;抗腐蚀;本质安全;灵敏度高;传感光纤全天候大范围监测;具有遥感和分布式传感的能力;复用和多参数传感功能;成本低等。随着信息技术和光纤技术的发展,光纤传感器作为一种新兴传感器正逐步吸引人们的注意。截至目前,分布式光纤传感器被应用到土木工程领域、通信领域、石油化工危险场合领域、电力工业领域等多种应用场景中。

3.随着机器学习算法的发展,最初的学者将分布式光纤传感器事件识别与机器学习算法进行结合。首先将应用场景中采集到的事件数据进行特征提取,再通过机器学习算法进行特征的分类,常见的机器学习算法有svm(支持向量机)、rvm(相关向量机)、hmms(马尔可夫模型)、ann(人工神经网络)等。随着深度学习算法的发展和进步,学者们将深度学习算法引入到分布式光纤传感器模式识别中,常见的深度学习算法有cnn(卷积神经网络算法)、lstm(长短时记忆网络算法)、rnn(循环神经网络算法)以及多种深度学习算法结合的算法等。

4.在使用机器学习算法中,会面临着需要人工进行特征提取、识别事件种类少、识别效果低的缺点,通过深度学习算法能够解决机器学习算法存在的问题。深度学习算法应用于分布式光纤传感模式识别中,也面临着算法整体权重大、随着网络深度的加深,容易出现梯度弥散和性能退化的问题等。

5.cnn(卷积神经网络)算法作为深度学习中经典和用途最广的算法,现在也被广大学者应用到多种领域中。cnn(卷积神经网络)算法具有自动提取特征、参数共享、系数连接、平移不变性等优点,但也面需要将数据集归一化、没有记忆功能、不能一次提取全局特征等缺点。

技术实现要素:

6.本发明为了弥补现有技术中的不足,提供了一种基于vision transformer的分布式光纤传感器模式识别的方法,将注意力机制算法引入到分布式光纤传感器领域中

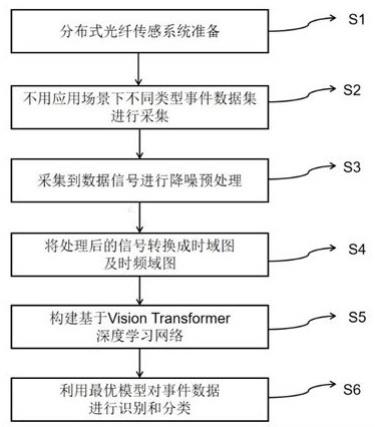

7.一种分布式光纤振动传感器模式识别的方法,其特征在于,包括以下步骤:

8.步骤1:分布式光纤传感器系统准备。

9.步骤2:数据信号采集,构建不同事件的数据集。

10.步骤3:信号数据进行降噪处理。

11.步骤4:将信号数据转换到对应事件的时域图和时频域图。

12.步骤5:构建基于vision transformer的深度学习网络。

13.步骤6:进行识别分类。

14.进一步地,所述步骤1具体包括以下步骤:

15.步骤1.1:在分布式光纤传感器技术方案中,选择基于光时域反射计方案作为分布式光纤传感器技术方案。

16.步骤1.2:准备分布式光纤系统中的窄线激光器、耦合器、声光调制器、第一掺饵放大器、带通滤波器、环形器、第二掺饵放大器、可调谐光衰减器、光电探测器、数据采集卡、个人电脑、单模单侧光纤等设备。

17.步骤1.3:将分布式光纤传感器系统进行组装,为多种应用场景下事件数据采集做准备。

18.进一步地,所述步骤2具体包括以下步骤:

19.步骤2.1:根据要探测和应用的场景,将分布式光纤传感系统布置在场景中。依据不同场景下采集场景对应事件数据。在采集数据时要依据分布式光纤传感系统设置对应的采样频率、脉冲宽度等相关参数。

20.步骤2.2:在数据集采集时,记录事件作用下分布式光纤传感通道数据变化情况。

21.步骤2.3:将上一步事件作用下发生信号强度变化的通道数据进行保存和备份。

22.进一步地,所述步骤3具体包括以下步骤:

23.步骤3.1:将步骤2采集到的事件数据,从通道中提取出来。

24.步骤3.2:将采集到的不同事件数据通过滤波器进行滤波操作。

25.步骤3.3:将步骤3.2中的数据通过小波去噪进行降噪声处理,通过设置特定的小波基函数,对信号进行小波变换,将信号分解到多个尺度上,根据尺度上噪声和信号取值的不同,剔除或修正部分尺度分量重构信号,可以使用分解后得到的小波系数对噪声进行判定,噪声信号的小波系数通常较小,可以通过设定阈值的方法出去噪声,当小波系数小于阈值时,判定为噪声信号,反之,则判定为有效信号。

26.进一步地,所述步骤4具体包括以下步骤:

27.步骤4.1:将步骤3中经过降噪预处理后的数据,依据事件数据采集时设定的采样频率和时间,批量将数据转换成对应多种事件下的时域图。时域图主要为信号强度随时间的变化情况,时域信号中的特征是直观、显著的,通过统计一定时间内信号在时域上所呈现出来的某种规律变化可以区分入侵事件。

28.步骤4.2:将步骤3中经过降噪预处理后的数据,依据事件数据采集时设定的采样频率和时间,经过短时傅里叶变换将数据转换成对应多种事件下的时频域图。时频域图不仅包含某一时间内频谱特性,也包含每个频段时间的变化情况。

29.进一步地,所述步骤5具体包括以下步骤:

30.步骤5.1:将步骤4中处理好的事件的时域图进行打标签操作,并按照8:1:1的比例划分为训练集、检验集和测试集。

31.步骤5.2:将步骤4中处理好的事件时频域图进行打标签操作,并按照8:1:1的比例划分为训练集、检验集和测试集。

32.步骤5.3:基于事件数据的时域图和时频域图数据集,构建vision transformer深

度学习图像分类模型,并设置vision transformer网络模型参数。

33.进一步,步骤5.3中的网络模型,具体包括:embedding层、transformer encoder层、mlp head层。

34.在embedding层中,包括:卷积层、线性映射层、class token层、position embedding层以及dropout层。

35.在transformer encoder层中:包括:layer norm层、多头注意力层、droppath层、mlp block层,其中mlp block层又包括全连接层、gelu激活函数层、dropout层。

36.在mlp head层中包括:全连接层、tanh激活函数层。

37.进一步所述步骤5.3具体包括以下步骤:

38.步骤5.3.1:初始化vision transformer网络模型参数。

39.步骤5.3.2:使用卷积层将三维rgb图像展平成二维矩阵,即向量序列。

40.步骤5.3.3:将步骤5.3.2中的二维矩阵进行压平处理,对应的为flatten层。压平处理不会影响batch的大小,其目的为将高纬度的数组变成一维的向量序列。

41.步骤5.3.4:为了能够进项有监督学习,能将输入的神经网络的图片做标记,引入class token层,class token是一个可训练的参数,和步骤5.3.3中的向量系列格式一样。将class token与步骤5.3.3中的向量序列拼接在一起。

42.步骤5.3.5:为了能够确定向量序列内的位置关系,使用position embedding层,position embedding层使用的是一个可训练的参数,将position embedding层与步骤5.3.4的最终向量序列叠加在一起。

43.步骤5.3.6:将步骤5.3.5中的最终向量序列经过dropout层。dropout层能够降低神经元之间的耦合,使每个神经元自身能提取到合适的特征,同样也能够进行网络的集成,每次训练的网络都是不同的,能够防止过拟合。

44.步骤5.3.7:经过transformer encoder层。该网络层为本算法的核心主干部分。

45.进一步的步骤5.3.7具体包括以下步骤:

46.步骤5.3.7.1:先经过一个layer normalization层。batch normalization是对一个的batch数据的每个channel进行norm处理,但layer normalization是对单个数据的指定维度进行norm处理处理与batch无关。layer normalization层是对数据做归一化处理,也就是对数据以某种角度或层面做均值为0方差为1的处理。通过layer normalization层能够将梯度变大,避免梯度消失的问题,能够加速神经网络的训练时间,能够容易更高的学习率和初始化权重更加容易,能够支持更多的损失函数等优点。

47.步骤5.3.7.2:经过multi-head attention(多头注意力层)层。多头注意力层是在自注意力层的基础上发展过来的。使用多头注意力机制能够联合来自不同模块的学习信息。将输入的向量ai分别通过wq,wk,wv,得到对应的qi,ki,vi再通过使用的head数目h进一步把得到的qi,ki,vi分成h份。对应的head公式为:

[0048][0049]

通过得到每个headi对应的qi,ki,vi参数,针对每个head使用自注意力机制得到对应的结果,其中在自注意力机制中对应的公式为:

[0050][0051]

接着将每个head得到的结果进行拼接,再将拼接后的结果通过wo(可学习的参数)进行融合,对的最终的结果。对应的公式为:

[0052][0053]

步骤5.3.7.3:经过与步骤5.36中同样的dropout层。

[0054]

步骤5.3.7.4:经过带权的shortcut将步骤5.3.7.1前的数据和步骤5.3.7.3后的数据进行相连接。单纯地增加网络深度并不能简单地提升网络的效果,由于梯度发散,反而可能损害模型的效果,引入shortcut能够解决深度模型中的退化问题。

[0055]

步骤5.3.7.5:经过与步骤5.3.7.1中同样的layer normalization层,目的是将梯度变大,避免梯度消失问题,加速神经网络的训练时间。

[0056]

步骤5.3.7.6:经过mlp block层。在mlp block层中主要由全连接层、gelu激活函数层、dropout层组成。

[0057]

进一步的步骤5.3.7.6包括以下步骤:

[0058]

步骤5.3.7.6.1:经过全连接层,将数据前面步骤提取到的特征综合起来,将多头注意力机制学习到的特征表示映射到样本标记空间中。

[0059]

步骤5.3.7.6.2:经过gelu激活函数层。激活函数的作用为加入非线性因素,针对线性模型表达能力不够的情况。对应的gelu激活函数的公式为:

[0060]

gelu(x)=x

×

p(x《=x)=x

×

φ(x),x~n(0,1)

[0061]

其中x为对应的输入值,x是具有零均值和单位方差的高斯随机变量。p(x《=x)是x小于或等于给定值x的概率。、

[0062]

步骤5.3.7.6.3:经过dropout层,降低神经元之间的耦合,防止过拟合。

[0063]

步骤5.3.7.6.4:经过与步骤5.3.7.6.1中的全连接层。

[0064]

步骤5.3.7.6.5:经过与步骤5.3.7.6.3中的dropout,防止过拟合。

[0065]

步骤5.3.8:经过与步骤5.3.7.1步骤中相同的layer normalization层。避免前面步骤提取特征后梯度消失问题,加速神经网络训练的时间。

[0066]

步骤5.3.9:提取class token层,将步骤5.3.3步骤中的class token层进行提取,获取标记样本信息。

[0067]

步骤5.3.10:经过全连接层,将将数据前面步骤提取到的特征综合起来,将多头注意力机制学习到的特征表示映射到样本标记空间中。

[0068]

步骤5.3.11:经过tanh激活函数层。tanh激活函数是以原点为中心,收敛速度更快,对应的公式为:

[0069][0070]

步骤5.3.12:经过全连接层,对上述步骤中的特征进行综合,为下一步的输出结果做准备。

[0071]

步骤5.3.13:结果输出。

[0072]

步骤5.4:训练步骤5.3中所得到的vision transformer网络模型。

[0073]

步骤5.5:对训练后的vision transformer网络模型进行网络调优,若找到最优参数则保存最好结果的模型作为最终事件识别的模型,否则跳转至步骤5.4再进行网络模型的训练。

[0074]

本发明的有益效果是:

[0075]

本发明预处理步骤简单,对数据没有进行大量的数据出来操作。保证了数据的原始性和防止数据的丢失。本发明首次将vision transformer算法与分布式光纤传感器事件图像进行结合,用来场景下事件分类。vision transformer算法是基于注意力机制的算法,与以往的卷积神经网络不同,其在大规模数据集上识别效果更高,一次能够提取全局特征等多种优点。在本发明中,将分布式光纤传感中时域图和时频域图分别作为vision transformer算法的数据集,能够起到对比的效果。

附图说明

[0076]

图1为本发明的总体流程图;

[0077]

图2为本发明的分布式光纤传感信号识别的流程图;

[0078]

图3为本发明的分布式光纤传感系统机构及工作原理图;

[0079]

图4为本发明的高速桥梁路段采集的汽车喇叭、汽车、撞击、挖掘、行人、下雨事件对应的时域图;

[0080]

图5为本发明的高速桥梁路段采集的汽车喇叭、汽车、撞击、挖掘、行人、下雨事件对应的时频域图。

[0081]

具体实施方

[0082]

下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述。显然,所描述的实施例仅仅是本发明的一部分实施例,而不是全部的实施例。通常在此处附图中描述和示出的本发明实施例的组件可以以各种不同的配置来布置和设计。

[0083]

因此,以下对在附图中提供的本发明的实施例的详细描述并非旨在限制要求保护的本发明的范围,而是仅仅表示本发明的选定实施例。基于本发明的实施例,本领域技术人员在没有做出创造性劳动的前提下所获得的所有其他实施例,都属于本发明保护的范围。

[0084]

应注意到:相似的标号和字母在下面的附图中表示类似项,因此,一旦某一项在一个附图中被定义,则在随后的附图中不需要对其进行进一步定义和解释。

[0085]

在本发明的描述中,需要说明的是,术语“中”、“上”、“下”、“水平”、“内”、“外”等指示的方位或位置关系为基于附图所示的方位或位置关系,或者是该发明产品使用时惯常摆放的方位或位置关系,仅是为了便于描述本发明和简化描述,而不是指示或暗示所指的装置或元件必须具有特定的方位、以特定的方位构造和操作,因此不能理解为对本发明的限制。此外,术语“第一”、“第二”等仅用于区分描述,而不能理解为指示或暗示相对重要性。

[0086]

此外,术语“水平”、“竖直”等术语并不表示要求部件绝对水平或悬垂,而是可以稍微倾斜。如“水平”仅仅是指其方向相对“竖直”而言更加水平,并不是表示该结构一定要完全水平,而是可以稍微倾斜。

[0087]

在本发明的描述中,需要说明的是,除非另有明确的规定和限定,术语“设置”、“相连”、“连接”应做广义理解,例如,可以是固定连接,也可以是可拆卸连接,或一体地连接。可

以是机械连接,也可以是电性连接。可以是直接相连,也可以通过中间媒介间接相连,可以是两个元件内部的连通。对于本领域的普通技术人员而言,可以具体情况理解上述术语在本发明中的具体含义。

[0088]

下面结合附图,对本发明的一些实施方式作详细说明。在不冲突的情况下,下述的实施例及实施例中的特征可以相互组合。

[0089]

图1-图5为本发明的一种具体实施例,该实施例以高速公路桥梁路段入侵检测应用为例,基于vision transformer的分布式光纤传感器模式识别的方法,整体流程如图1,具体的信号处理和深度学习网络结构如图2所示。

[0090]

步骤1:分布式光纤传感系统准备。本实例中选择基于相敏光时域反射(φ-otdr)技术的分布式光纤传感系统,在本系统中主要用到的设备有:窄线激光器、耦合器、声光调制器、第一掺饵放大器、带通滤波器、环形器、第二掺饵放大器、可调谐光衰减器、平衡探测器、数据采集卡、个人电脑、单模单侧光纤等。系统的机构和工作原理如图3。采用线宽为5khz的窄线激光器作为光源,窄线激光器输出的光源经过耦合器分解成95:5两个光路分支,上分支,通过声光调制器对连续波进行调制,产生一个频移60mhz的光脉冲序列。再通过第一掺饵放大器将光源放大,防止光源在传输过程中的损失,再通过0.8nm的通带滤波器进行降低噪声,经过环形器后光脉冲发射到单模光纤中,如有不同事件作用于单模光纤则瑞利后向散射轨迹经被第二掺饵放大器进一步放大,在通过0.8nm的通带滤波器进行降噪,经过第二个耦合器时上分支光路和下分支光路进行结合,光源再通过光电探测器进行光信号与电信号的转换,之后再经过14位数据采集卡将事件数据进行采集。最后通过个人电脑或存储设备将事件信号进行存储。

[0091]

步骤2:高速桥梁路段现场数据采集。通过将分布式光纤传感系统布置在高速桥梁路段,将2km单模光纤将高速桥梁进行围绕后,现场实地采集汽车喇叭、汽车、汽车撞击(模拟)、铁锹挖掘、行人走路、下雨六种事件。其中分布式光纤传感系统的采样频率为6khz,每种事件采集事件为5~8min。

[0092]

步骤3:依据步骤2高速桥梁路段采集信号参数和单模光纤事件发生通道情况,按照事件种类将采集到的信号分好类后,提取单模光纤中通道中的时间数据并结合小波去噪法进行降噪处理。

[0093]

步骤4:将经过步骤3处理后的数据,依据数据采集时的参数情况,批量将数据转换成对应3秒内的时域图,六种现场采集事件的时域图如图4所示。按照相同的方法,经步骤3处理后的数据,依据数据采样时的参数情况,批量将6种事件数据转换成对应3秒内的时频域图。六种现场采集事件的时频域图如图5所示。

[0094]

步骤5:按照图2中的vision transformer算法结构将算法进行搭建,并将采集到的高速公路桥梁路段的时域图和时频域图数据集按照训练集、检验集、测试集8:1:1的比例进行网络的训练与迭代。并将多次迭代中最优一次对应的参数进行保存,并作为步骤6中的预训练权重。

[0095]

步骤6:事件识别和分类:将步骤5中预训练好的网络权重进行保存后,将新一批数据集输入到网络算法中,得到最终的事件识别结果。

[0096]

最后说明的是,以上实施例仅用以说明本发明的技术方案而非限制,本领域普通技术人员对本发明的技术方案所做的其他修改或者等同替换,只要不脱离本发明技术方案

的精神和范围,均应涵盖在本发明的权利要求范围当中。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。