1.本发明涉及互联网大数据技术领域,具体涉及基于数据分布的分层加权抗噪深度度量学习方法。

背景技术:

2.度量学习方法是学习一种特征映射方法,通过这种特征映射方法将数据集中的样本映射到一个特征表示空间,使得相似的样本距离得很近,不相似的样本距离得很远,从而达到正负样本分离的结果。度量学习在视觉分析中起着非常重要的作用,其目的在于学习一个可以衡量图像对之间相似度的距离度量,以提高接下来分类或者聚类任务的正确率。度量学习可以广泛地应用于多种视觉应用中,如人脸识别,行人再识别,目标跟踪,物体识别和血缘关系验证等。

3.随着深度学习的发展,深度度量学习方法在计算机视觉领域应用十分广泛。例如,公开号为cn108304864a的中国专利公开了《一种深度对抗度量学习方法及装置》方法包括:从训练集中提取出图像的深度特征并生成三元组;根据三元组中的负样本通过生成器将三元组中的负样本转化为对度量训练有信息的难样本;获取难样本在度量空间下的表示,并同时训练整个网络,以得到图片在度量空间下的表示。

4.上述现有方案的深度对抗度量学习方法可以对已有的难样本进行补充,进而能够有效提高度量的鲁棒性。但申请人发现,现有深度度量学习方法的采样策略中设定的采样边界是固定不变的,其不会随着模型训练进程的推进做出适应的调整,这会使得到训练后期,模型采样得到的样本数量稀少,模型的训练会陷入瓶颈,导致模型的训练准确性不好。同时,现有方案仅补充难样本的方式,未充分考虑模型实际应用场景中的噪声,导致模型的训练鲁棒性不够好。因此,如何设计一种能够提高模型训练准确性和训练鲁棒性的深度度量学习方法是亟需解决的技术问题。

技术实现要素:

5.针对上述现有技术的不足,本发明所要解决的技术问题是:如何提供一种基于数据分布的分层加权抗噪深度度量学习方法,以能够提高模型的训练准确性和训练鲁棒性,从而能够保证模型的训练效果。

6.为了解决上述技术问题,本发明采用了如下的技术方案:

7.基于数据分布的分层加权抗噪深度度量学习方法,包括以下步骤:

8.s1:将随机合成的噪声样本加载到训练数据集中;

9.s2:基于数据间的距离关系刻画数据分布,随着训练进程推进数据分布的记录更新;

10.s3:基于数据分布的分布矩阵,去除每个训练batch中的噪声样本;

11.s4:基于数据分布自适应指导采样策略的学习并完成采样;

12.s5:最小化模型的损失函数以更新模型参数,并同步更新数据分布。

13.优选的,步骤s1中,具体包括如下步骤:

14.s101:从预训练的神经网络中获取提取特征,通过提取特征将训练数据集中随机选择的真实类别的图像聚类为大量的小簇;

15.s102:将每个小簇中的样本合并到一个随机选择的真实类别中,以完成噪声样本加载。

16.优选的,提取特征是从imagenet上预训练得到的googlenet的l2归一化特征;

17.小簇的数量为对应真实类别中图像数的二分之一。

18.优选的,步骤s2中,具体包括如下步骤:

19.s201:初始化记录不同类间距离的均值和方差的距离均值矩阵m和距离方差矩阵v;

20.其中,c表示训练数据集中样本的类别数量;

21.s202:针对每个训练batch,利用类别标签下标从距离均值矩阵m和距离方差矩阵v中抽取该训练batch中出现的类别,生成记录训练batch中样本间距离的均值和方差变化值的训练均值矩阵和训练方差矩阵

22.其中,b表示训练batch中的类别数量;

23.s203:根据训练进程中数据真实的距离关系,记录当前训练轮次t下训练均值矩阵和训练方差矩阵的时序更新情况,并对应更新训练轮次t下的距离均值矩阵m

t

和距离方差矩阵v

t

。

24.优选的,通过如下公式更新距离均值矩阵m

t

:

[0025][0026]

其中,

[0027]

式中:和分别表示t和t-1轮次下的训练均值矩阵变化值;d

mean

表示真实计算出来的不同类间样本距离值的均值,即训练均值矩阵真实值;β1用于衡量训练均值矩阵的变化值和真实值之间的比例关系;γ1用于衡量训练均值矩阵的变化值与原始值之间的比例关系,每次训练后,γ1进行0.9倍的衰减;

[0028]

通过如下公式更新距离方差矩阵v

t

:

[0029][0030]

其中,

[0031]

式中:和分别表示t和t-1轮次下的训练方差矩阵变化值;d

std

表示真实计算出来的不同类间样本距离值的方差,即训练方差矩阵真实值;β2用于衡量训练方差矩阵的变化值和真实值之间的比例关系;γ2用于衡量训练方差矩阵的变化值与原始值之间的比例关系,γ2比γ1小,每次训练后,γ2进行0.9倍的衰减。

[0032]

优选的,步骤s3中,每次更新信息前,判断选择的样本xi与该类其他样本的相似度;然后基于相似度计算样本xi的标签为k的概率当概率大于当前训练进程中的时,样本xi作为标签为k的干净样本加入训练过程中,否则,将样本xi视为噪声样本并舍弃。

[0033]

优选的,通过如下公式计算样本xi的相似度:

[0034][0035]

式中:t(xi,k)表示样本xi与训练batch中具有相同标签k的样本的相似度;nk表示训练batch中该类的样本个数;f(xi)表示样本xi的特征向量;s(f(xi),vj)表示样本xi的特征向量与样本xj的相似度;

[0036]

通过如下公式计算样本xi的标签为k的概率:

[0037][0038]

优选的,步骤s4中具体包括如下步骤:

[0039]

s401:将训练均值矩阵扩充为矩阵将训练方差矩阵扩充为矩阵

[0040]

其中,的大小为t

×

t;t表示训练batch中的类别数量;表示输入数据的真实距离;

[0041]

s402:计算得到正样本的采样策略p表示跟随训练进程推进而发生改变的变量;

[0042]

s403:计算得到负样本的采样策略n表示跟随训练进程推进而发生改变的变量;

[0043]

s404:基于正样本和负样本的采样策略完成采样。

[0044]

优选的,步骤s5中,基于样本携带的信息量、分层分配权重计算模型的损失函数。

[0045]

优选的,步骤s5中,具体包括如下步骤:

[0046]

s501:根据样本携带的信息量设置分层的负样本权重系数,基于负样本权重系数计算对应的负样本损失函数;

[0047]

负样本权重系数为ω

ij

=-exp(ψ

×

(α-d

ij

)),xj∈n

i,c

;

[0048]

负样本损失函数为

[0049]

式中:ψ表示控制权重程度的超参数;α表示当前训练进程的采样边界;

[0050]

s502:根据样本的距离远近设置正样本权重系数,基于正样本权重系数计算对应的正样本损失函数;

[0051]

正样本权重系数为

[0052]

正样本损失函数为

[0053]

s503:基于负样本损失函数和正样本损失函数相加得到模型的损失函数;

[0054]

模型的损失函数为l(xi,xj)=ln(xi,xj) l

p

(xi,xj)。

[0055]

本发明的分层加权抗噪深度度量学习方法与现有技术相比,具有如下有益效果:

[0056]

本发明通过将随机合成的噪声样本加载到训练数据集中,使得噪声样本能够伴随训练数据集参与模型训练,充分考虑了模型实际应用场景中的噪声影响,从而能够提高模型的训练鲁棒性和泛化能力。

[0057]

本发明基于数据间的距离关系刻画数据分布并跟随训练进程不断更新,进而基于数据分布自适应指导采样策略的学习并完成采样,一方面,本发明通过不断更新数据分布,能够考虑到不同类间关系的差异性,使得能够针对当前的距离分布做出自适应的记录,能够提高模型的训练效果;另一方面,本发明通过数据分布的更新变化自适应采样,能够削弱每次采样过程中噪声样本的占比,通过采样边界的自适应调整优化度量学习方法中的采样策略,打破了模型限于局部最优值的瓶颈,并能够充分挖掘信息丰富的负样本,从而能够有效提高模型的训练准确性。

[0058]

本发明基于样本携带的信息量、分层分配权重计算模型的损失函数,使得能够在保证模型训练方向不被影响的前提下,进一步加快模型的收敛速度,从而能够兼顾模型的训练效率和效果。

附图说明

[0059]

为了使发明的目的、技术方案和优点更加清楚,下面将结合附图对本发明作进一步的详细描述,其中:

[0060]

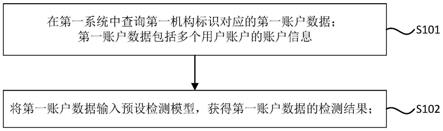

图1为基于数据分布的分层加权抗噪深度度量学习方法的逻辑框图。

具体实施方式

[0061]

下面通过具体实施方式进一步详细的说明:

[0062]

实施例:

[0063]

本实施例中公开了一种基于数据分布的分层加权抗噪深度度量学习方法。

[0064]

如图1所示,基于数据分布的分层加权抗噪深度度量学习方法,包括以下步骤:

[0065]

s1:将随机合成的噪声样本加载到训练数据集中;

[0066]

s2:基于数据间的距离关系刻画数据分布,随着训练进程推进数据分布的记录更新;

[0067]

s3:基于数据分布的分布矩阵,去除每个训练batch中的噪声样本;

[0068]

s4:基于数据分布自适应指导采样策略的学习并完成采样;

[0069]

s5:最小化模型的损失函数以更新模型参数,并同步更新数据分布。基于样本携带的信息量、分层分配权重计算模型的损失函数。

[0070]

需要说明的是,本发明中的训练batch是一个超参数,用于定义在更新内部模型参数之前要处理的样本数,可以理解为把整套训练数据集分成数个批次进行训练,每个批次就是一个训练batch。例如,一个有2000个训练样本的训练数据集,将2000个样本分成大小为500的训练batch,那么完成一个epoch需要4个iteration。

[0071]

本发明通过将随机合成的噪声样本加载到训练数据集中,使得噪声样本能够伴随训练数据集参与模型训练,充分考虑了模型实际应用场景中的噪声影响,从而能够提高模型的训练鲁棒性和泛化能力。同时,本发明基于数据间的距离关系刻画数据分布并跟随训

练进程不断更新,进而基于数据分布自适应指导采样策略的学习并完成采样,一方面,通过不断更新数据分布,能够考虑到不同类间关系的差异性,使得能够针对当前的距离分布做出自适应的记录,能够提高模型的训练效果;另一方面,通过数据分布的更新变化自适应采样,能够削弱每次采样过程中噪声样本的占比,通过采样边界的自适应调整优化度量学习方法中的采样策略,打破了模型限于局部最优值的瓶颈,并能够充分挖掘信息丰富的负样本,从而能够有效提高模型的训练准确性。最后,本发明基于样本携带的信息量、分层分配权重计算模型的损失函数,使得能够在保证模型训练方向不被影响的前提下,进一步加快模型的收敛速度,从而能够兼顾模型的训练效率和效果。

[0072]

步骤s1中,具体包括如下步骤:

[0073]

s101:从预训练的神经网络中获取提取特征,通过提取特征将训练数据集中随机选择的真实类别的图像聚类为大量的小簇;

[0074]

s102:将每个小簇中的样本合并到一个随机选择的真实类别中,以完成噪声样本加载。本实施例通过不断的迭代训练,每次迭代类的数量减少一个,通过这种方式,小集群模型就得到了更符合现实分布的包含噪声标签样本的训练数据集。

[0075]

具体实施过程中,提取特征是从imagenet上预训练得到的googlenet的l2归一化特征;

[0076]

小簇的数量为对应真实类别中图像数的二分之一:

[0077][0078]

式中:t表示迭代的步数;表示第k类的聚类中心,对于每一个样本xi,将其分配到距离最近的中心。

[0079]

本发明通过将随机合成的噪声样本加载到训练数据集中,使得噪声样本能够伴随训练数据集参与模型训练,充分考虑了模型实际应用场景中的噪声影响,从而能够提高模型的训练鲁棒性和泛化能力。

[0080]

步骤s2中,具体包括如下步骤:

[0081]

s201:初始化记录不同类间距离的均值和方差的距离均值矩阵m和距离方差矩阵v;

[0082]

其中,c表示训练数据集中样本的类别数量;

[0083]

s202:针对每个训练batch,利用类别标签下标从距离均值矩阵m和距离方差矩阵v中抽取该训练batch中出现的类别,生成记录训练batch中样本间距离的均值和方差变化值的训练均值矩阵和训练方差矩阵

[0084]

其中,b表示训练batch中的类别数量;

[0085]

s203:根据训练进程中数据真实的距离关系,记录当前训练轮次t下训练均值矩阵和训练方差矩阵的时序更新情况,并对应更新训练轮次t下的距离均值矩阵m

t

和距离方差矩阵v

t

。

[0086]

具体的,由于在第一次训练时,不存在之前的训练轮次信息,所以在第一次训练中,直接更新为当前轮次的值,之后再按照如下方式进行迭代更新。

[0087]

通过如下公式更新距离均值矩阵m

t

:

[0088][0089]

其中,

[0090]

式中:和分别表示t和t-1轮次下的训练均值矩阵变化值;d

mean

表示真实计算出来的不同类间样本距离值的均值,即训练均值矩阵真实值;β1用于衡量训练均值矩阵的变化值和真实值之间的比例关系;γ1用于衡量训练均值矩阵的变化值与原始值之间的比例关系,每次训练后,γ1进行0.9倍的衰减;

[0091]

通过如下公式更新距离方差矩阵v

t

:

[0092][0093]

其中,

[0094]

式中:和分别表示t和t-1轮次下的训练方差矩阵变化值;d

std

表示真实计算出来的不同类间样本距离值的方差,即训练方差矩阵真实值;β2用于衡量训练方差矩阵的变化值和真实值之间的比例关系;γ2用于衡量训练方差矩阵的变化值与原始值之间的比例关系,γ2比γ1小,每次训练后,γ2进行0.9倍的衰减。

[0095]

记录每个轮次更新的变化值,即利用训练均值矩阵和训练方差矩阵存储的信息,以此作为变化值更新距离均值矩阵m和距离方差矩阵v。训练均值矩阵和训练方差矩阵两个矩阵需要借助前序信息作为变化值,加上当前真实值进行更新。

[0096]

本发明利用遗传算法的思想,不断融合变化值与记录值,使得模型在训练过程中不断学习数据分布,使得能够考虑到不同类间关系的差异性,能够针对当前的距离分布做出自适应的记录,从而能够提高模型的训练效果,并为后续的采样策略打下基础。

[0097]

具体实施过程中,每次更新信息前,判断选择的样本xi与该类其他样本的相似度;然后基于相似度计算样本xi的标签为k的概率当概率大于当前训练进程中的时,样本xi作为标签为k的干净样本加入训练过程中,否则,将样本xi视为噪声样本并舍弃。

[0098]

其中,表示在t轮次下,矩阵中记录的第i类与第k类之间的值。

[0099]

本实施例选定当前训练进程中的相似度平均值,由于已经定义了当前训练进程中的不同类间距离的均值,该边界值的选定就等价为距离平均值的倒数。

[0100]

具体实施过程中,通过如下公式计算样本xi的相似度:

[0101][0102]

式中:t(xi,k)表示样本xi与训练batch中具有相同标签k的样本的相似度;nk表示训练batch中该类的样本个数;f(xi)表示样本xi的特征向量;s(f(xi),vj)表示样本xi的特征向量与样本xj的相似度;

[0103]

通过如下公式计算样本xi的标签为k的概率:

[0104][0105]

步骤s4中,具体包括如下步骤:

[0106]

s401:将训练均值矩阵扩充为矩阵将训练方差矩阵扩充为矩阵

[0107]

其中,的大小为t

×

t;t表示训练batch中的类别数量;表示输入数据的真实距离;本实施例选定大小为120个训练样本的训练batch,包含40个类,每个类有3个样本,即中的每一个元素扩充为有相同元素的3

×

3的矩阵,由40

×

40的矩阵扩充为120

×

120的矩阵。

[0108]

s402:计算得到正样本的采样策略p表示跟随训练进程推进而发生改变的变量;一般来说,到训练后期,可以采样得到的包含信息丰富的正例困难样本逐渐减少,此时增大p的值(调整采样边界),将采样范围扩大,从而使模型打破陷入局部最优值的瓶颈。p的初始值为2,并每次以0.01的额度进行递减,保证每次都在扩大采样边界,避免出现训练后期采样不到样本的情况。

[0109]

s403:计算得到负样本的采样策略n表示跟随训练进程推进而发生改变的变量;为了使模型到训练后期可以采样得到包含信息丰富的负例困难样本,可以减小n的值(调整采样边界)。n是一个变量集合,要对应后续的分层加权策略,初始值采用的{1.5,1.8,2.1},也是随着训练进程以0.01进行递减。

[0110]

s404:基于正样本和负样本的采样策略完成采样。

[0111]

本发明通过数据分布的更新变化自适应更新采样边界,能够削弱每次采样过程中噪声样本的占比,并且,通过采样边界的自适应调整优化度量学习方法中的采样策略,打破了模型限于局部最优值的瓶颈,并能够充分挖掘信息丰富的负样本,从而能够有效提高模型的训练准确性。

[0112]

步骤s5中,具体包括如下步骤:

[0113]

s501:s501:根据样本携带的信息量设置分层的负样本权重系数,基于负样本权重系数计算对应的负样本损失函数;由于负样本在一个训练batch中的数量众多,无差别对待负样本可能会使得模型收敛速度缓慢;但单纯地对困难程度高的负样本赋予更高的权重,可能会使模型的训练方向发生偏移。

[0114]

负样本权重系数为ω

ij

=-exp(ψ

×

(α-d

ij

)),xj∈n

i,c

;

[0115]

负样本损失函数为

[0116]

式中:ψ表示控制权重程度的超参数;α表示当前训练进程的采样边界;针对α,在采样过程中,可以根据不同的困难程度设置不同的变量n,从而调节不同的采样边界,进而实现为不同的采样边界限制下采样得到的样本设置不同程度的权重系数的目的。

[0117]

s502:根据样本的距离远近设置正样本权重系数,基于正样本权重系数计算对应的正样本损失函数;针对于正样本来说,由于正负样本在一个训练batch中的数量相差十分大,过度地对正样本分层加权,可能会削弱正样本的作用。所以针对正样本,本发明只是对正样本距离进行单纯的加权求取损失函数。其中,离较远的正样本在模型中区分比较困难,可以看作是困难样本,携带的信息会更多,距离远近等价于携带的信息量。

[0118]

正样本权重系数为

[0119]

正样本损失函数为

[0120]

s503:基于负样本损失函数和正样本损失函数相加得到模型的损失函数;

[0121]

模型的损失函数为l(xi,xj)=ln(xi,xj) l

p

(xi,xj)。

[0122]

最终的损失函数由两部分组成,一部分代表了正样本提供的损失函数,另一部分则是负样本提供的损失函数。

[0123]

本发明基于样本的困难程度、分层分配权重计算模型的损失函数,使得能够在保证模型训练方向不被影响的前提下,加快模型的收敛速度,从而能够兼顾模型的训练效率和效果。

[0124]

最后需要说明的是,以上实施例仅用以说明本发明的技术方案而非限制技术方案,本领域的普通技术人员应当理解,那些对本发明的技术方案进行修改或者等同替换,而不脱离本技术方案的宗旨和范围,均应涵盖在本发明的权利要求范围当中。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。