1.本技术涉及图像处理技术领域,特别是涉及一种特征融合方法和装置、服务器、计算机可读存储介质。

背景技术:

2.随着自动驾驶或无人驾驶技术的不断发展,自动驾驶或无人驾驶将逐渐步入人们的日常生活中,为人们的生活带来便利。其中,自动驾驶或无人驾驶技术所面临的核心问题是:车辆的视觉感知能力不足,无法形成对整体道路交通坏境的全面感知,使得车辆行驶安全性得不到全面保障。

3.近些年出现了通过激光雷达与相机一起来提高车辆的视觉感知能力的方案,弥补了单一传感器在测距或视觉感知能力上的不足。但是采用传统方法在通过激光雷达与相机联合进行图像融合时,融合效果较差,检测精度较低。

技术实现要素:

4.本技术实施例提供一种特征融合方法、装置、服务器、计算机可读存储介质,可以提高图像融合的精确度,进而提高目标检测的精确度。

5.一种特征融合方法,包括:

6.获取同一时刻、同一场景下采集的激光点云和图像;

7.获取所述激光点云的前视图的特征图、所述激光点云的特征图及所述图像的特征图;

8.对所述前视图的特征图、所述激光点云的特征图及所述图像的特征图进行融合,生成特征融合图。

9.在其中一个实施例中,所述获取所述激光点云的前视图的特征图,包括:

10.将所述激光点云的三维坐标映射到圆柱体上,得到所述激光点云的前视图;

11.对所述前视图进行特征提取,得到所述前视图的特征图。

12.在其中一个实施例中,所述前视图的特征图包括强度特征图、高度特征图及深度特征图;对所述前视图进行特征提取,得到所述前视图的特征图,包括:

13.从所述激光点云中提取点云强度信息,根据所述点云强度信息生成所述前视图的强度特征图;

14.从所述激光点云中提取点云高度信息,根据所述点云高度信息生成所述前视图的高度特征图;

15.从所述激光点云中提取点云深度信息,根据所述点云深度信息生成所述前视图的深度特征图。

16.在其中一个实施例中,获取所述激光点云的特征图,包括:

17.对所述激光点云按照相同尺寸的体素网格进行分组,得到多个体素网格;

18.对每个所述体素网格中的激光点云进行下采样处理,得到多个处理后的体素网

格;每个所述处理后的体素网格中的激光点云数目相同;

19.对各所述处理后的体素网格中的激光点云进行特征提取,生成所述激光点云的特征图。

20.在其中一个实施例中,对所述前视图的特征图、所述激光点云的特征图及所述图像的特征图进行融合,生成特征融合图,包括:

21.将所述前视图的特征图映射到所述激光点云的特征图上,得到第一映射结果;

22.将所述图像的特征图映射到所述激光点云的特征图上,得到第二映射结果;

23.将所述激光点云的特征图、所述第一映射结果及所述第二映射结果进行特征融合,生成特征融合图。

24.在其中一个实施例中,对所述前视图的特征图、所述目标激光点云的特征图及所述图像的特征图进行融合,生成特征融合图,还包括:

25.从所述激光点云中确定感兴趣区域;

26.从所述激光点云的特征图中获取所述感兴趣区域的第一特征图,从前视图的特征图中获取所述感兴趣区域的第二特征图,从所述图像的特征图中获取所述感兴趣区域的第三特征图;

27.将所述感兴趣区域的第一特征图、所述感兴趣区域的第二特征图及所述感兴趣区域的第三特征图进行融合,生成特征融合图。

28.一种目标检测方法,所述方法包括:

29.利用上述任一项所述的特征融合方法,获取特征融合图;

30.基于所述特征融合图进行目标检测,得到目标检测结果。

31.一种特征融合装置,包括:

32.数据采集模块,用于获取同一时刻、同一场景下采集的激光点云和图像;

33.特征图获取模块,用于获取所述激光点云的前视图的特征图、所述激光点云的特征图及所述图像的特征图;

34.特征图融合模块,用于对所述前视图的特征图、所述激光点云的特征图及所述图像的特征图进行融合,生成特征融合图。

35.一种目标检测装置,包括:

36.获取模块,用于利用上述任一项所述的特征融合方法,获取特征融合图;

37.目标检测模块,用于基于所述特征融合图进行目标检测,得到目标检测结果。

38.一种服务器,包括存储器及处理器,所述存储器中储存有计算机程序,所述计算机程序被所述处理器执行时,使得所述处理器执行如上方法的步骤。

39.一种计算机可读存储介质,其上存储有计算机程序,计算机程序被处理器执行时实现如上方法的步骤。

40.上述特征融合方法、装置、服务器、计算机可读存储介质,获取同一时刻、同一场景下采集的激光点云和图像,获取激光点云的前视图的特征图、激光点云的特征图及图像的特征图。对前视图的特征图、激光点云的特征图及图像的特征图进行融合,生成特征融合图。从激光点云的前视图、激光点云及图像这三个维度来提取特征图,进而对这三种特征图进行融合,从而提高了图像融合的精确度及目标检测的精确度。

附图说明

41.为了更清楚地说明本技术实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本技术的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

42.图1为一个实施例中特征融合方法的应用场景图;

43.图2为一个实施例中特征融合方法的流程图;

44.图3为图2中获取前视图的特征图方法的流程图;

45.图4为图2中获取所述激光点云的特征图方法的流程图;

46.图5为图2中对所述前视图的特征图、所述激光点云的特征图及所述图像的特征图进行融合,生成特征融合图方法的流程图;

47.图6为一个具体的实施例中特征融合方法的流程图;

48.图7为一个实施例中特征融合装置的结构框图;

49.图8为图7中特征图获取模块的结构框图;

50.图9为一个实施例中服务器的内部结构示意图。

具体实施方式

51.为了使本技术的目的、技术方案及优点更加清楚明白,以下结合附图及实施例,对本技术进行进一步详细说明。应当理解,此处所描述的具体实施例仅仅用以解释本技术,并不用于限定本技术。

52.可以理解,本技术所使用的术语“第一”、“第二”等可在本文中用于描述各种元件,但这些元件不受这些术语限制。这些术语仅用于将第一个元件与另一个元件区分。

53.图1为一个实施例中特征融合方法的应用场景图。如图1所示,该应用环境包括激光雷达120、相机140及服务器160。通过相机采集得到图像,通过激光雷达在同一时刻、同一场景下采集得到激光点云。服务器获取同一时刻、同一场景下采集的激光点云和图像;获取激光点云的前视图的特征图、激光点云的特征图及图像的特征图;对前视图的特征图、激光点云的特征图及图像的特征图进行融合,生成特征融合图。其中,相机在提取目标的纹理,颜色特征方面有较大优势,却不能准确获取目标的速度和位置,且在恶劣天气下,如雨天、雾天等无法正常工作。而激光雷达探测距离远,测量精度高,能够准确获取物体的三维信息和速度信息,且在恶劣天气下,如雨天、雾天等影响相对较小,但成本高,噪点多,缺少rgb信息。因此,将激光雷达与相机两者进行融合,就可以发挥各自的优势。在融合的基础上,进行信息交互,最大限度地获取周边环境信息。

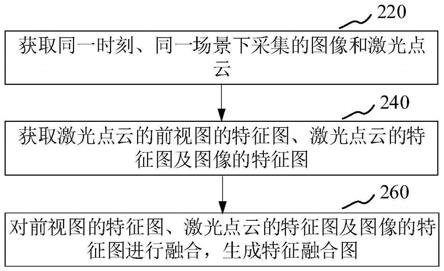

54.图2为一个实施例中特征融合方法的流程图,提供了一种特征融合方法,应用于服务器,包括步骤220至步骤260。

55.步骤220,获取同一时刻、同一场景下采集的图像和激光点云。

56.预先将激光雷达及相机调整至预设角度,并固定激光雷达及相机之间的相对位置。然后,通过相机拍摄得到图像,通过激光雷达在同一时刻、同一场景下采集得到激光点云。最后,服务器从相机所采集到的图像及激光雷达所采集到的激光点云中,获取同一时刻对应的图像和与图像对应的激光点云,组成一对图像数据。其中,激光点云也可以认为是激

光点云图像。

57.具体的,分别获取到激光雷达与相机的系统时间戳,分别计算激光雷达与工控机的系统时间差值、相机与工控机的系统时间差值。再通过同一台工控机同时采集激光点云和图像,基于激光雷达与工控机的系统时间差值、相机与工控机的系统时间差值,将激光点云和图像对应的数据的系统时间戳转换到工控机的时间轴上,即可获取时间同步(同一时刻)的激光点云和图像。当然,还可以采用其他的方式来获取时间同步(同一时刻)的激光点云和图像,本技术对此不做限定。

58.步骤240,获取激光点云的前视图的特征图、激光点云的特征图及图像的特征图。

59.其中,激光点云中的每一个点都包含了丰富的信息,例如包括三维坐标(x,y,z)、分类值、强度信息、时间、反射率等,本技术对此不做限定。其中,由相机所采集的图像对应的数据是指用数值表示的各像素(pixel)的rgb值集合。

60.其中,激光点云的前视图也可以称之为激光点云的主视图。激光点云的前视图为将激光点云的三维坐标转换为二维坐标所得到的图像,具体为将激光点云的三维坐标映射到圆柱体上,得到激光点云的前视图。

61.然后,分别对激光点云的前视图提取特征图、对激光点云提取特征图及对图像提取特征图。具体可以采用神经网络模型来提取特征图,例如采用backbone网络进行特征提取,例如采用vgg16、resnet系列、darknet系列等神经网络来进行特征提取。

62.步骤260,对前视图的特征图、激光点云的特征图及图像的特征图进行融合,生成特征融合图。

63.在生成了前视图的特征图、激光点云的特征图及图像的特征图之后,采用特征融合算法对前视图的特征图、激光点云的特征图及图像的特征图进行融合,生成特征融合图。

64.本技术实施例中,获取同一时刻、同一场景下采集的激光点云和图像,获取激光点云的前视图的特征图、激光点云的特征图及图像的特征图。对前视图的特征图、激光点云的特征图及图像的特征图进行融合,生成特征融合图。从激光点云的前视图、激光点云及图像这三个维度来提取特征图,进而对这三种特征图进行融合,从而提高了图像融合的精确度及目标检测的精确度。

65.在一个实施例中,获取激光点云的前视图的特征图,包括:

66.将激光点云的三维坐标映射到圆柱体上,得到激光点云的前视图;

67.对前视图进行特征提取,得到前视图的特征图。

68.具体的,在获取激光点云的前视图的特征图时,首先,将激光点云的三维坐标转换为极坐标。激光点云p的三维坐标为p=(x,y,z),将该激光点云投影到可以展开的圆柱体表面上,展开的圆柱体表面就构了激光点云的前视图。将该激光点云投影到可以展开的圆柱体表面上,得到激光点云p的极坐标为(r,c)其中,r为激光点云p的极径,c为激光点云p的极径。

69.实际上,r为前视图的y轴坐标,c为前视图的x轴坐标。如此,便基于激光点云的三维坐标得到了激光点云的前视图的二维坐标,也就得到了激光点云的前视图。再采用特征融合算法对前视图进行特征提取,得到前视图的特征图。

70.本技术实施例中,通过将激光点云的三维坐标映射到圆柱体上,便得到了激光点云的前视图。再对前视图进行特征提取,便得到前视图的特征图。将三维的激光点云转换为

二维的前视图,进而得到前视图的特征图。由于新增了一种特征图,因此,通过丰富特征图的方式提高了后续进行特征图融合的准确性。

71.在一个实施例中,前视图的特征图包括强度特征图、高度特征图及深度特征图;如图3所示,对前视图进行特征提取,得到前视图的特征图,包括:

72.步骤320,从激光点云中提取点云强度信息,根据点云强度信息生成前视图的强度特征图。

73.其中,激光点云中的每一个点都包含了丰富的信息,例如包括三维坐标(x,y,z)、颜色信息、分类值、强度信息、时间、反射率等,本技术对此不做限定。从激光点云中提取每个点的点云强度信息,基于激光点云中的点p与前视图上的点q之间的映射关系,根据激光点云中点p的点云强度信息计算出该点p映射到前视图上的点q的点云强度信息。然后,基于前视图上的点q的点云强度信息就可以生成前视图的强度特征图。

74.步骤340,从激光点云中提取点云高度信息,根据点云高度信息生成前视图的高度特征图。

75.从激光点云中提取每个点的点云高度信息,其中点云高度信息是指在三维激光点云(x,y,z)每个点的z轴的坐标。基于激光点云中的点p与前视图上的点q之间的映射关系,根据激光点云中点p的点云高度信息计算出该点p映射到前视图上的点q的点云高度信息。然后,基于前视图上的点q的点云高度信息就可以生成前视图的高度特征图。

76.步骤360,从激光点云中提取点云深度信息,根据点云深度信息生成前视图的深度特征图。

77.从激光点云中提取每个点的点云深度信息,根据三维激光点云(x,y,z)计算将作为点云深度信息。基于激光点云中的点p与前视图上的点q之间的映射关系,根据激光点云中点p的点云深度信息计算出该点p映射到前视图上的点q的点云深度信息。然后,基于前视图上的点q的点云深度信息就可以生成前视图的深度特征图。

78.本技术实施例中,前视图的特征图包括强度特征图、高度特征图及深度特征图。从激光点云中提取点云强度信息,根据点云强度信息生成前视图的强度特征图,从激光点云中提取点云高度信息,根据点云高度信息生成前视图的高度特征图,从激光点云中提取点云深度信息,根据点云深度信息生成前视图的深度特征图。从点云强度信息、点云高度信息及点云深度信息三个角度来提取前视图的特征,并共同形成了前视图的特征图。从多个角度、全方位丰富了前视图的特征图,避免遗漏前视图上的特征。因此,通过丰富前视图的特征图的方式提高了后续进行特征图融合的准确性。

79.在一个实施例中,如图4所示,获取激光点云的特征图,包括:

80.步骤420,对激光点云按照相同尺寸的体素网格进行分组,得到多个体素网格。

81.其中,体素的概念类似于像素,像素是二维的一个个点,而体素则是三维的一个个小空间。因此,体素网格视为一组空间中的微小3d小空间。可以对激光点云按照相同尺寸的体素网格进行分组,得到多个体素网格。其中,每个体素网格中包含或多或少的激光点云。假设采用深度、高度和宽度分别为(d,h,w)的立方体表示所输入的激光点云,每个体素的深高宽为(vd,vh,vw),那么对所有的激光点云进行体素网格划分之后得到了在深度、高度和宽

度上的网格个数为在这里,可以按照10cm

×

10cm的尺寸大小的体素网格对激光点云进行分组,得到多个体素网格。当然,还可以按照20cm

×

20cm的尺寸大小的体素网格对激光点云进行分组,得到多个体素网格。本技术并不对体素网格的尺寸大小进行限定。

82.步骤440,对每个体素网格中的激光点云进行下采样处理,得到多个处理后的体素网格;每个处理后的体素网格中的激光点云数目相同。

83.因为激光点云的分布密度不均匀,有的区域激光点云分布的密度太大,数据冗余量大。而有的区域激光点云分布的密度太小,数据冗余量较小。所以对激光点云进行体素网格划分之后,每个体素网格中包含了不同数目的激光点云。且由于激光点云的数据量太大不便于计算,例如,激光雷达一次扫描所得的激光点云包含数以万计甚至更多的点。因此,可以对每个体素网格中的激光点云进行下采样处理,得到多个处理后的体素网格。即对每个体素网格中的多余激光点云进行了过滤剔除,每个体素网格中留下预设数目的激光点云。例如,可以对每个体素网格中留下1个激光点云即可,当然还可以是其他合理的数值,本技术并不对此进行限定。每个从每个体素网格中提取出等量的激光点云来进行提取特征,以实现在缩小数据量的同时,保证了激光点云分布的均匀性。当然,这里也可以不是从每个体素网格中提取出等量的激光点云来进行提取特征,而是从每个体素网格中提取出数量在一定范围的激光点云来进行提取特征。

84.步骤460,对各处理后的体素网格中的激光点云进行特征提取,生成激光点云的特征图。

85.处理后的体素网格中均包含预设数目的激光点云,对所有体素网格中的预设数目的激光点云进行特征提取,生成激光点云的特征图。在这里,对所有体素网格中的预设数目的激光点云进行特征提取,是指对激光点云的三维坐标进行特征提取,生成激光点云的特征图。

86.在本技术实施例中,对激光点云进行体素网格化处理,实现了对激光点云在三维空间上进行等间距划分。然后,对每一个体素网格中的激光点云进行下采样处理,从每一个体素网格中筛选出等量的激光点云。再对所筛选出的所有激光点云进行特征提取,生成激光点云的特征图。从而,在实现缩小数据量的同时,保证了激光点云分布的均匀性,避免遗漏激光点云的重要特征。

87.在一个实施例中,如图5所示,步骤260,对前视图的特征图、激光点云的特征图及图像的特征图进行融合,生成特征融合图,包括:

88.步骤262,将前视图的特征图映射到激光点云的特征图上,得到第一映射结果。

89.因为激光点云的前视图为将激光点云的三维坐标映射到圆柱体上,得到激光点云的前视图,所以激光点云的前视图与激光点云之间存在强相关性。那么就可以基于激光点云的前视图与激光点云之间存在强相关性,将前视图的特征图映射到激光点云的特征图上,得到第一映射结果。

90.步骤264,将图像的特征图映射到激光点云的特征图上,得到第二映射结果。

91.预先对相机与激光雷达进行了联合标定,得到了激光雷达相对于相机的联合标定参数。因此,就可以基于激光雷达相对于相机的联合标定参数,建立相机所拍摄的图像与激光雷达所采集的激光点云之间的对应关系。然后,基于相机所拍摄的图像与激光雷达所采

集的激光点云之间的对应关系,就可以将图像的特征图映射到激光点云的特征图上,得到第二映射结果。

92.步骤266,将激光点云的特征图、第一映射结果及第二映射结果进行特征融合,生成特征融合图。

93.通过激光点云的特征图作为桥梁,实现了将前视图的特征图映射到激光点云的特征图上得到第一映射结果,将图像的特征图映射到激光点云的特征图上得到第二映射结果。然后,就可以将激光点云的特征图、第一映射结果及第二映射结果进行特征融合,生成特征融合图。

94.本技术实施例中,通过激光点云的特征图作为桥梁,实现了将前视图的特征图、激光点云的特征图及图像的特征图这三种不同类型的特征图进行了融合。从而提高了图像融合的精确度及目标检测的精确度。

95.在一个实施例中,对前视图的特征图、目标激光点云的特征图及图像的特征图进行融合,生成特征融合图,还包括:

96.从激光点云中确定感兴趣区域;

97.从激光点云的特征图中获取感兴趣区域的第一特征图,从前视图的特征图中获取感兴趣区域的第二特征图,从图像的特征图中获取感兴趣区域的第三特征图;

98.将感兴趣区域的第一特征图、感兴趣区域的第二特征图及感兴趣区域的第三特征图进行融合,生成特征融合图。

99.具体的,这里的感兴趣区域(也可称之为可提取区域)可以指的是目标所在的区域。例如,激光点云中行人、车辆所在的区域,本技术并不对此进行限定。从激光点云中确定感兴趣区域,可以通过神经网络模型从激光点云中确定目标所在的区域。

100.然后,在从激光点云中确定感兴趣区域之后,基于激光点云的特征图与激光点云之间的对应关系,从激光点云的特征图中获取感兴趣区域的第一特征图。基于激光点云的前视图与激光点云之间的映射关系,从激光点云的前视图的特征图中获取感兴趣区域的第二特征图。基于相机所拍摄的图像与激光雷达所采集的激光点云之间的对应关系,从图像的特征图中获取感兴趣区域的第三特征图。

101.最后,采用特征融合算法将感兴趣区域的第一特征图、感兴趣区域的第二特征图及感兴趣区域的第三特征图进行融合,生成特征融合图。

102.本技术实施例中,从激光点云中确定感兴趣区域(即目标所在区域),剔除无关区域,从而,从激光点云的特征图中获取感兴趣区域的第一特征图,从前视图的特征图中获取感兴趣区域的第二特征图,从图像的特征图中获取感兴趣区域的第三特征图。即实现了根据感兴趣区域缩小了每一种特征图的范围,实际上就大大减小了计算量,提高了特征融合的效率。

103.在一个实施例中,还提供了一种目标检测方法,方法包括:

104.利用上述任意一个实施例中的特征融合方法,获取特征融合图;

105.基于特征融合图进行目标检测,得到目标检测结果。

106.具体的,首先,获取同一时刻、同一场景下采集的激光点云和图像。其次,获取激光点云的前视图的特征图、激光点云的特征图及图像的特征图。最后,对前视图的特征图、激光点云的特征图及图像的特征图进行融合,生成特征融合图。从激光点云的前视图、激光点

云及图像这三个维度来提取特征图,进而对这三种特征图进行融合,从而提高了图像融合的精确度。

107.进而,基于特征融合图进行目标检测,得到目标检测结果。例如,从特征融合图中检测出行人、车辆等目标,以便进行无人驾驶或路况分析等,本技术对此不做限定。

108.本技术实施例中,利用上述任意一个实施例中的特征融合方法,获取特征融合图,再基于特征融合图进行目标检测得到目标检测结果。从激光点云的前视图、激光点云及图像这三个维度来提取特征图,进而对这三种特征图进行融合,从而提高了图像融合的精确度及目标检测的精确度。

109.在一个具体的实施例中,如图6所示,提供了一种特征融合方法,包括:

110.步骤602,获取同一时刻、同一场景下采集的图像;

111.步骤604,获取同一时刻、同一场景下采集的激光点云;

112.步骤606,对采集的图像进行特征提取,得到图像的特征图;

113.步骤608,根据所采集的激光点云生成激光点云的前视图;

114.步骤610,对前视图进行特征提取,得到前视图的特征图;

115.步骤612,对所采集的激光点云进行体素网格化处理,得到体素网格;

116.步骤614,对体素网格中的激光点云进行下采样得到一定数量的激光点云;

117.步骤616,对这些一定数量的激光点云进行特征提取,得到激光点云的特征图;

118.步骤618,对前视图的特征图、激光点云的特征图及图像的特征图进行融合,生成特征融合图;

119.步骤620,基于特征融合图进行目标检测,得到目标检测结果。

120.本技术实施例中,获取同一时刻、同一场景下采集的激光点云和图像,获取激光点云的前视图的特征图、激光点云的特征图及图像的特征图。对前视图的特征图、激光点云的特征图及图像的特征图进行融合,生成特征融合图。从激光点云的前视图、激光点云及图像这三个维度来提取特征图,进而对这三种特征图进行融合,从而提高了图像融合的精确度及目标检测的精确度。

121.在一个实施例中,如图7所示,提供了一种特征融合装置700,包括:

122.数据采集模块720,用于获取同一时刻、同一场景下采集的激光点云和图像;

123.特征图获取模块740,用于获取激光点云的前视图的特征图、激光点云的特征图及图像的特征图;

124.特征图融合模块760,用于对前视图的特征图、激光点云的特征图及图像的特征图进行融合,生成特征融合图。

125.在一个实施例中,特征图获取模块740,还用于将激光点云的三维坐标映射到圆柱体上,得到激光点云的前视图;对前视图进行特征提取,得到前视图的特征图。

126.在一个实施例中,前视图的特征图包括强度特征图、高度特征图及深度特征图;特征图获取模块740,还用于从激光点云中提取点云强度信息,根据点云强度信息生成前视图的强度特征图;从激光点云中提取点云高度信息,根据点云高度信息生成前视图的高度特征图;从激光点云中提取点云深度信息,根据点云深度信息生成前视图的深度特征图。

127.在一个实施例中,如图8所示,特征图获取模块740,还包括:

128.体素网格分组单元742,用于对激光点云按照相同尺寸的体素网格进行分组,得到

多个体素网格;

129.下采样单元744,用于对每个体素网格中的激光点云进行下采样处理,得到多个处理后的体素网格;每个处理后的体素网格中的激光点云数目相同;

130.特征提取单元746,用于对各处理后的体素网格中的激光点云进行特征提取,生成激光点云的特征图。

131.在一个实施例中,特征图融合模块760,包括:

132.前视图的特征图映射单元,用于将前视图的特征图映射到激光点云的特征图上,得到第一映射结果;

133.图像的特征图映射单元,用于将图像的特征图映射到激光点云的特征图上,得到第二映射结果;

134.特征融合单元,用于将激光点云的特征图、第一映射结果及第二映射结果进行特征融合,生成特征融合图。

135.在一个实施例中,特征图融合模块760,还用于从激光点云中确定感兴趣区域;从激光点云的特征图中获取感兴趣区域的第一特征图,从前视图的特征图中获取感兴趣区域的第二特征图,从图像的特征图中获取感兴趣区域的第三特征图;将感兴趣区域的第一特征图、感兴趣区域的第二特征图及感兴趣区域的第三特征图进行融合,生成特征融合图。

136.在一个实施例中,提供了一种目标检测装置,包括:

137.获取模块,用于利用上述实施例中任一项的特征融合方法,获取特征融合图;

138.目标检测模块,用于基于特征融合图进行目标检测,得到目标检测结果。

139.上述特征融合装置、目标检测装置中各个模块的划分仅用于举例说明,在其他实施例中,可将特征融合装置、目标检测装置按照需要划分为不同的模块,以完成上述特征融合装置、目标检测装置的全部或部分功能。

140.图9为一个实施例中服务器的内部结构示意图。如图9所示,该服务器包括通过系统总线连接的处理器和存储器。其中,该处理器用于提供计算和控制能力,支撑整个服务器的运行。存储器可包括非易失性存储介质及内存储器。非易失性存储介质存储有操作系统和计算机程序。该计算机程序可被处理器所执行,以用于实现以下各个实施例所提供的一种特征融合方法、目标检测方法。内存储器为非易失性存储介质中的操作系统计算机程序提供高速缓存的运行环境。该服务器可以是手机、平板电脑或者个人数字助理或穿戴式设备等。

141.本技术实施例中提供的特征融合装置中的各个模块的实现可为计算机程序的形式。该计算机程序可在终端或服务器上运行。该计算机程序构成的程序模块可存储在终端或服务器的存储器上。该计算机程序被处理器执行时,实现本技术实施例中所描述方法的步骤。

142.本技术实施例还提供了一种计算机可读存储介质。一个或多个包含计算机可执行指令的非易失性计算机可读存储介质,当计算机可执行指令被一个或多个处理器执行时,使得处理器执行特征融合方法、目标检测方法的步骤。

143.一种包含指令的计算机程序产品,当其在计算机上运行时,使得计算机执行特征融合方法、目标检测方法。

144.本技术实施例所使用的对存储器、存储、数据库或其它介质的任何引用可包括非

易失性和/或易失性存储器。合适的非易失性存储器可包括只读存储器(rom)、可编程rom(prom)、电可编程rom(eprom)、电可擦除可编程rom(eeprom)或闪存。易失性存储器可包括随机存取存储器(ram),它用作外部高速缓冲存储器。作为说明而非局限,ram以多种形式可得,诸如静态ram(sram)、动态ram(dram)、同步dram(sdram)、双数据率sdram(ddr sdram)、增强型sdram(esdram)、同步链路(synchlink)dram(sldram)、存储器总线(rambus)直接ram(rdram)、直接存储器总线动态ram(drdram)、以及存储器总线动态ram(rdram)。

145.以上实施例仅表达了本技术的几种实施方式,其描述较为具体和详细,但并不能因此而理解为对本技术专利范围的限制。应当指出的是,对于本领域的普通技术人员来说,在不脱离本技术构思的前提下,还可以做出若干变形和改进,这些都属于本技术的保护范围。因此,本技术专利的保护范围应以所附权利要求为准。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。