1.本发明涉及图像语义分割技术领域,尤其涉及一种图像语义分割网络持续学习方法、系统、设备及存储介质。

背景技术:

2.近年来,深度神经网络在语义分割任务上取得了巨大的成功。然而传统语义分割网络训练方法需要一次性获取全部的训练数据,且训练完成后难以更新。在实际应用中,常要求网络能从数据流中逐渐的学习、更新已学会的知识,从而有效降低数据存储代价与训练代价。但是令深度神经网络直接在新数据上学习会导致已学习知识的严重遗忘。而持续学习技术通过对学习过程中施加额外的约束,以达到学习新知识的同时不会遗忘已学会的知识的目的。

3.持续学习的一般手段为使用知识蒸馏来保持新旧网络间知识的一致性。这一操作常在输出空间或者特征空间进行。具体到语义分割领域,除了使用上述手段防止旧知识的遗忘以外,还有两个新的挑战:首先,随着学习的进行,可能需要学习过去曾经忽略的类别,从而导致对于某一特定输入,其包含的语义信息并不是一成不变的,这要求网络有更强的新知识学习能力。其次,由于获取标注数据需要大量人力物力,因此希望在新增数据上只对需要学习的类别进行标注,这将导致被标注为背景类的区域可能包含已学习类别,引入的语义不一致性会给网络训练带来较大的挑战。因此,图像分类领域的持续学习方法无法胜任语义分割持续学习任务。

4.具体的:公布号为cn111191709a的中国专利申请《深度神经网络的持续学习框架及持续学习方法》中,使用一生成网络生成旧类别的数据,并与新数据混合用以训练网络,但是其仅解决图像分类任务。此外,这种方式严重依赖生成器的生成质量,难以胜任大规模、复杂的数据,特别是图像语义分割任务。公布号为cn111368874a的中国专利申请《一种基于单分类技术的图像类别增量学习方法》中,采用输出空间的知识蒸馏和偏好纠正两个手段以实现图像分类任务的持续学习。但是,其仍无法解决前述语义分割持续学习任务中特有的挑战,因而无法在图像语义分割中直接应用。公布号为cn103366163a的中国专利申请《基于增量学习的人脸检测系统和方法》、公布号为cn106897705a的中国专利申请《一种基于增量学习的海洋观测大数据分布方法》、以及公布号为cn103593680a的中国专利申请《一种基于隐马尔科夫模型自增量学习的动态手势识别方法》均为在某一特定领域专用的方法,无法证明其具有泛化性与普适性。

5.因此,针对语义分割持续学习任务设计一种泛用的,尽可能降低旧知识遗忘的同时解决语义分割持续学习任务中的前后语义不一致性的方法具有重要的实用价值和现实意义。

技术实现要素:

6.本发明的目的是提供一种图像语义分割网络持续学习方法、系统、设备及存储介

质,对应用场景均无限制,具有很强的泛化能力与实用价值,填补语义分割持续学习任务上的空白。

7.本发明的目的是通过以下技术方案实现的:一种图像语义分割网络持续学习方法,包括:获取新增语义分割数据集及对应新增类别的标签,利用原始图像语义分割网络提取所述新增语义分割数据集中图像数据的原始特征图,通过特征变换模块对所述原始特征图进行变换,并利用变换结果重构的特征图与所述原始特征图的差异初步训练所述特征变换模块;使用所述原始图像语义分割网络与初步训练的特征变换模块初始化一个相同的图像语义分割网络与特征变换模块,将所述原始图像语义分割网络称为旧网络,初步训练的特征变换模块称为旧特征变换模块,初始化产生的图像语义分割网络称为新网络,初始化产生的特征变换模块称为新特征变换模块;固定所述旧网络与旧特征变换模块,训练所述新网络与新特征变换模块;训练时,将新增语义分割数据集的图像数据同时输入至所述旧网络与新网络,所述旧网络与新网络中各自进行特征图提取、解码与语义分割,获得分割结果;其中,所述旧网络提取的特征图通过所述旧特征变换模块进行变换,所述新网络提取的特征图通过所述新特征变换模块进行变换,并计算两种变换结果的对齐损失;利用所述旧网络与新网络的分割结果及解码获得的特征向量对于旧类别分别独自构建相应的类间关系矩阵与类内关系集合,并利用所述旧网络与新网络的类间关系矩阵计算类间结构保持损失,利用所述旧网络与新网络的类内关系集合计算类内结构保持损失,所述类间结构保持损失与类内结构保持损失用于保持旧类别中类间结构与类内结构的一致性;同时,对于新增类别,利用所述新网络解码获得的特征向量计算初始结构优化损失,所述初始结构优化损失用于拉近相同新增类别的特征向量的分布,疏远不同新增类别的特征向量的分布,并且,利用逐类别动态阈值对旧网络的分割结果进行优化去噪,获得相应的伪标签,利用所述伪标签计算所述新网络的分类损失;结合所述对齐损失、类间结构保持损失、类内结构保持损失、初始结构优化损失及分类损失训练所述新网络与新特征变换模块。

8.一种图像语义分割网络持续学习系统,该系统包括:数据收集与初步训练单元,用于获取新增语义分割数据集及对应新增类别的标签,利用原始图像语义分割网络提取所述新增语义分割数据集中图像数据的原始特征图,通过特征变换模块对所述原始特征图进行变换,并利用变换结果重构的特征图与所述原始特征图的差异初步训练所述特征变换模块;学习单元,用于使用所述原始图像语义分割网络与初步训练的特征变换模块初始化一个相同的图像语义分割网络与特征变换模块,将所述原始图像语义分割网络称为旧网络,初步训练的特征变换模块称为旧特征变换模块,初始化产生的图像语义分割网络称为新网络,初始化产生的特征变换模块称为新特征变换模块;固定所述旧网络与旧特征变换模块,训练所述新网络与新特征变换模块;训练时,将新增语义分割数据集的图像数据同时输入至所述旧网络与新网络,所述旧网络与新网络中各自进行特征图提取、解码与语义分割,获得分割结果;其中,所述旧网络提取的特征图通过所述旧特征变换模块进行变换,所述新网络提取的特征图通过所述新特征变换模块进行变换,并计算两种变换结果的对齐损

失;利用所述旧网络与新网络的分割结果及解码获得的特征向量对于旧类别分别独自构建相应的类间关系矩阵与类内关系集合,并利用所述旧网络与新网络的类间关系矩阵计算类间结构保持损失,利用所述旧网络与新网络的类内关系集合计算类内结构保持损失,所述类间结构保持损失与类内结构保持损失用于保持旧类别中类间结构与类内结构的一致性;同时,对于新增类别,利用所述新网络解码获得的特征向量计算初始结构优化损失,所述初始结构优化损失用于拉近相同新增类别的特征向量的分布,疏远不同新增类别的特征向量的分布,并且,利用逐类别动态阈值对旧网络的分割结果进行优化去噪,获得相应的伪标签,利用所述伪标签计算所述新网络的分类损失;结合所述对齐损失、类间结构保持损失、类内结构保持损失、初始结构优化损失及分类损失训练所述新网络与新特征变换模块。

9.一种处理设备,包括:一个或多个处理器;存储器,用于存储一个或多个程序;其中,当所述一个或多个程序被所述一个或多个处理器执行时,使得所述一个或多个处理器实现前述的方法。

10.一种可读存储介质,存储有计算机程序,当计算机程序被处理器执行时实现前述的方法。

11.由上述本发明提供的技术方案可以看出,一方面,通过特征空间中的非线性变换提取旧知识表征进行对齐的手段,有效保持旧知识不变性的同时提高对新知识学习的能力。另一方面,在嵌入空间中对新类别优化其拓扑结构,对旧类别维护其拓扑结构的不变性,达到降低遗忘,防止类间混淆的效果;此外,联合伪标签及伪标签降噪技术,使得在语义分割持续学习中无需提供旧类别的标签,降低标注成本。总体来说,本发明作为一种通用性的语义分割持续学习方法,对应用场景均无限制,具有很强的泛化能力与实用价值。

附图说明

12.为了更清楚地说明本发明实施例的技术方案,下面将对实施例描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的一些实施例,对于本领域的普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他附图。

13.图1为本发明实施例提供的一种图像语义分割网络持续学习方法的模型示意图;图2为本发明实施例提供的初始结构优化部分原理示意图;图3为本发明实施例提供的类间与类内结构保持部分原理示意图;图4为本发明实施例提供的不同图像语义分割网络分割结果的对比示意图;图5为本发明实施例提供的一种图像语义分割网络持续学习系统的示意图;图6为本发明实施例提供的一种处理设备的示意图。

具体实施方式

14.下面结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。基于本发明的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本发明的保护范围。

15.首先对本文中可能使用的术语进行如下说明:

术语“包括”、“包含”、“含有”、“具有”或其它类似语义的描述,应被解释为非排它性的包括。例如:包括某技术特征要素(如原料、组分、成分、载体、剂型、材料、尺寸、零件、部件、机构、装置、步骤、工序、方法、反应条件、加工条件、参数、算法、信号、数据、产品或制品等),应被解释为不仅包括明确列出的某技术特征要素,还可以包括未明确列出的本领域公知的其它技术特征要素。

16.下面对本发明所提供的一种图像语义分割网络持续学习方法、系统、设备及存储介质进行详细描述。本发明实施例中未作详细描述的内容属于本领域专业技术人员公知的现有技术。本发明实施例中未注明具体条件者,按照本领域常规条件或制造商建议的条件进行。

17.实施例一本发明实施例提供一种图像语义分割网络持续学习方法,它是一种基于类别结构保持与特征对齐的语义分割持续学习方法。目前主流的图像语义分割网络由特征提取器、解码器与分类器组成,主要过程流程为:通过特征提取器提取输入的待分割图像的特征图,经解码器获得相应的特征向量,最后由分类器进行语义分割,获得每一像素的分类结果(即分割结果)。本发明针对图像语义分割网络设计对应的模块以防止旧知识遗忘。具体地,该方法核心内容包含特征变换模块、类别结构信息保持模块、伪标签生成模块和联合损失函数训练语义分割网络四个部分。特征变换模块通过对特征提取器输出特征图实施非线性变换,进而提取出旧知识的表征以对齐,达到为新知识的学习提供高自由度的同时仍有效保持旧知识完整性。类别结构信息保持模块使用解码器输出建立类内拓扑结构与类间拓扑结构,通过在学习过程中维持上述结构一致性,有效降低持续学习过程中类别拓扑结构破坏的现象,从而降低遗忘与类间混淆。进一步地,针对前后语义不一致问题,伪标签生成模块利用逐类别动态阈值对旧网络输出的分割结果进行优化去噪,从而生成高质量的伪标签以弥补缺失的旧类别标注。最后,联合上述模块的损失函数对语义分割网络进行训练,以达到持续学习的效果。

18.每一次持续学习的过程可以描述为:获取新增语义分割数据集及对应新增类别的标签,利用原始图像语义分割网络提取所述新增语义分割数据集中图像数据的原始特征图,通过特征变换模块对所述原始特征图进行变换,并利用变换结果重构的特征图与所述原始特征图的差异初步训练所述特征变换模块;使用所述原始图像语义分割网络与初步训练的特征变换模块初始化一个相同的图像语义分割网络与特征变换模块,将所述原始图像语义分割网络称为旧网络,初步训练的特征变换模块称为旧特征变换模块,初始化产生的图像语义分割网络称为新网络,初始化产生的特征变换模块称为新特征变换模块;固定所述旧网络与旧特征变换模块,训练所述新网络与新特征变换模块;训练时,将新增语义分割数据集的图像数据同时输入至所述旧网络与新网络,所述旧网络与新网络中各自进行特征图提取、解码与语义分割,获得分割结果;其中,所述旧网络提取的特征图通过所述旧特征变换模块进行变换,所述新网络提取的特征图通过所述新特征变换模块进行变换,并计算两种变换结果的对齐损失;利用所述旧网络与新网络各自的分割结果及解码获得的特征向量,对于旧类别分别独自构建相应的类间关系矩阵与类

内关系集合,并利用所述旧网络与新网络的类间关系矩阵计算类间结构保持损失,利用所述旧网络与新网络的类内关系集合计算类内结构保持损失,所述类间结构保持损失与类内结构保持损失用于保持旧类别中类间结构与类内结构的一致性;同时,对于新增类别,利用所述新网络解码获得的特征向量计算初始结构优化损失,所述初始结构优化损失用于拉近相同新增类别的特征向量的分布,疏远不同新增类别的特征向量的分布,并且,利用逐类别动态阈值为旧网络的分割结果进行优化去噪,获得相应的伪标签,利用所述伪标签计算所述新网络的分类损失;结合所述对齐损失、类间结构保持损失、类内结构保持损失、初始结构优化损失及分类损失训练所述新网络与新特征变换模块。

19.为了便于理解,下面针对上述学习过程做进一步的介绍。

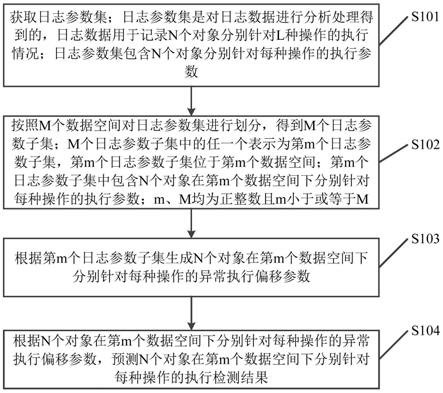

20.如图1所示,为本发明提供的一种图像语义分割网络持续学习方法的模型示意图,其展示了持续学习过程中所涉及的相关流程与损失函数,主要说明如下:一、特征变换模块及相关损失函数。

21.本发明实施例中,利用新增语义分割数据集对图像语义分割网络进行学习之前,需要对特征变换模块部分进行初步训练。

22.如之前所述图像语义分割网络包含了特征提取器,使用特征提取器提取新增语义分割数据集中每一图像数据的原始特征图,记为。然后,利用特征变换模块(feature projector)进行非线性变换,生成关于旧知识的表征,通过训练特征变换模块引导其输出的表征中包含丰富、有效的信息。

23.本发明实施例中,使用自编码器结构初步训练特征变换模块,将特征变换模块记为p

*

;通过特征变换模块p

*

对原始特征图进行变换包括:先通过卷积操作(例如,1*1卷积)进行通道降维,再通过若干空洞卷积操作(例如,两个3*3空洞卷积)进行局部空间信息混合,生成关于原始特征图的表征。初步训练时,使用重构网络r

*

(例如,可采用两个3*3卷积构成)对变换结果进行重构,通过尝试从特征变换模块的输出变换结果中重构原始特征图,并使用原始特征图与重构特征图的差异构造重构损失函数,利用重构损失初步训练所述特征变换模块p

*

,从而引导特征变换模块p

*

输出的表征中包含丰富的信息。

24.本领域技术人员可以理解,所述卷积操作与空洞卷积操作均为常规的两类卷积操作,相较而言,所述卷积操作为标准卷积操作,空洞卷积操作则能以较少的层数混合较大范围内的空间信息。

25.具体的,重构损失函数可以为重构的特征图与所述原始特征图的欧氏距离,表示为: 。

26.当特征变换模块p

*

能有效生成旧知识的表征时,完成初步训练,此时的特征变换模块记为。

[0027] 之后,可以使用原始图像分割网络及特征变换模块的参数初始化用于学习新知识的新网络与相应的特征变换模块,学习新知识的过程中保持原始图像分割网络(即旧网络,old model)及其特征变换模块(即特征变换模块)不变,只更新初始化产生的图像分

割网络(即新网络,new model)及其特征变换模块(即初始化产生的特征变换模块)。学习阶段是增量学习的关键概念,初始阶段记为1,每新增一次类别集合,即为一个新的持续学习阶段。图1中,下标t-1、t代表不同学习阶段,相对而言,t-1学习阶段的网络为旧网络,t学习阶段的网络为新网络,e代表编码器(特征提取器),d代表解码器,g代表分类器。

[0028]

本发明实施例中,通过对两个网络特征变换模块的输出施加一致性约束,以保证旧知识在持续学习的过程中保持不变,同时又给与特征图较高的变化自由度以良好的学习新知识。

[0029] 本发明实施例中,前述阶段原始图像分割网络并未更新,因此,其提取的特征图即为所述原始特征图,因此依旧记为,旧特征变换模块的变换结果表示为;将所述新网络提取的特征图记为,将所述新特征变换模块记为,变换结果表示为,对齐损失(alignment loss)为两种变换结果的l1距离,表示为: 。

[0030]

二、类别结构信息保持模块及相关损失函数。

[0031]

本发明实施例中,类别结构信息保持模块基于图像分割网络的解码器输出在嵌入空间中分别构建类内结构关系与类间结构关系。通过在持续学习的过程中保持上述两种关系,从而有效的保持网络对于旧类别的判别力。类别结构信息保持模块主要包括三个部分:初始结构优化部分、类间结构保持部分、类内结构保持部分三部分。其中,初始结构优化部分主要针对新增类别,计算初始结构优化损失,它属于对比损失(contrastive loss);后两个部分主要针对旧类别,计算结构保持损失(structure preserving loss),包含类间结构保持损失与类内结构保持损失;所述旧类别与新增类别是相对概念,即持续学习之前图像分割网络能够识别的类别。以上三个部分的原理及相关损失函数主要如下:1、初始结构优化部分。

[0032]

如图2所示,为初始结构优化部分的原理示意图。仅使用交叉熵训练时,不同类别(例如图中左侧的a,b类)在嵌入空间中的分布常常较为分散,且容易发生部分重叠,而这一分布较容易在后续学习的过程中引发类别混淆,进而产生遗忘。通过引导特征向量(图中三角形)尽量靠近其对应的特征原型(图中x字形),同时令不同类别原型间的距离不小于给定阈值(右侧图灰色圆形),达到优化类别分布,减少混淆的作用。

[0033]

所述的初始结构优化模块为,在学习新类别的时候,对于其在嵌入空间中的分布进行引导,使相同类别的特征向量分布尽量紧凑,使相异类别的特征向量分布尽量离散。此部分能使模型的分类边界更加清晰,减少混淆,同时对于遗忘现象也有更强的鲁棒性。初由于始结构优化模块仅针对新增类别,因此,仅利用所述新网络的输出计算初始结构优化损失。

[0034]

为了达到上述目的,初始结构优化部分的损失函数(初始结构优化损失)中使用两个损失函数分别引导类内结构与类间结构的学习,表示为:其中,表示引导类内结构的损失,表示引导类间结构的损失,为的权重(具体大小可根据实际情况或者经验设定)。

[0035]

引导类内结构的损失用于拉近相同新增类别的特征向量的分布,表示为:

其中,表示当前学习阶段t新增类别的集合,表示当前学习阶段t新增类别的数量,所述当前学习阶段t表示训练所述新网络与新特征变换模块的阶段;表示新增类别c对应的类别原型,表示属于新增类别c的特征向量。

[0036]

引导类间结构的损失用于疏远不同新增类别的分布,表示为:其中,与分别表示新增类别m与新增类别n对应的类别原型, 表示类别原型与的余弦相似度,为预定义的距离(具体大小可根据实际情况或者经验设定)。

[0037]

本发明实施例中,类别原型为相应类别下所有特征向量的平均,对于新增类别c,类别原型表示为: 其中,y为当前阶段中新增类别的标签,|y=c|表示标签中属于新增类别c的像素的数量, 为指示函数,当y=c时,输出为1,其他情况输出为0。

[0038] 本领域技术人员可以理解,类别原型(class prototypes)是计算机视觉领域中的专有名词,表示对属于某个类别的一系列特征进行均值计算,用其均值表征整个类别的信息,后文所涉及的各个类别原型也是采用前述类似方式计算。

[0039]

2、类间结构保持部分。

[0040]

训练良好的深度神经网络可将输入样本映射到一嵌入空间中,并依类别分布于嵌入空间中的不同区域。这是深度神经网络得以正确划分各个类别的重要特性。基于此特性,通过构建嵌入空间中的类间拓扑结构,并在持续学习的过程中维护此结构,以保持类别间线性可分。

[0041]

本发明实施例中,利用所述旧网络的分割结果以及解码获得的特征向量对于旧类别构建的类间关系矩阵,利用所述新网络的分割结果以及解码获得的特征向量对于旧类别构建的类间关系矩阵;其中,类间关系矩阵中的单个元素表示两个旧类别对应的类别原型之间的余弦距离;对于旧类别i与旧类别j,旧网络中对应的类别原型分别表示为与,新网络中对应的类别原型分别表示为与,则类间关系矩阵与中相应元素与的计算方式表示为: 其中, 、分别表示类别原型与余弦相似度、类别原型与的余弦相似度。

[0042]

在持续学习的过程中,使用类间结构保持损失函数维护二者的一致性,表示为:

其中,||.||f表示矩阵的f范数。

[0043]

3、类内结构保持部分。

[0044]

类内关系定义为每个特征向量与其类别原型相对关系的集合,利用所述旧网络的分割结果以及解码获得的特征向量对于旧类别构建的类内关系集合表示为,利用所述新网络的分割结果以及解码获得的特征向量对于旧类别构建的类内关系集合表示为,此处的d表示某一种距离度量函数,例如,欧式距离。类内关系集合反映了嵌入空间中细粒度的拓扑结构信息。在持续学习的过程中保持类内特征向量在嵌入空间中的拓扑结构保持不变,能有效维护单类别知识的完整性。建模类内结构时所选取的距离函数为欧式距离,以利用其敏感性反应反映类内结构的微小变化。

[0045]

在持续学习的过程中,使用类内结构保持损失用于保持旧类别中类内结构(即类内关系集合与在位置信息与距离信息)的一致性,表示为:其中,与分别表示旧网络获得的属于旧类别i的特征向量与相应的类别原型;与表示新网络获得的属于旧类别i的特征向量与相应的类别原型;表示旧类别集合(即已学习过的所有旧类别),表示旧类别的数量。

[0046]

类间结构保持部分与类内结构保持部分中所涉及的类别原型利用相应网络输出的分割结果与特征向量进行计算,计算公式可参见前文的公式,区别主要在于,由于此部分是针对旧类别,因此,需要将分割结果带入公式。

[0047]

以类别原型为例,其计算公式为:其中,表示新网络输出的分割结果,表示新网络输出的分割结果中预测类别为旧类别i的像素的数量。

[0048]

对于旧网络而言也是类似的,结合其分割结果带入上述式子计算相应的类别原型。

[0049]

如图3所示,为类间与类内结构保持部分的原理示意图。当需要学习新类别时,类间拓扑结构维护仅保证类别间的相邻、相关关系在更新过程中保持不变,但是允许其在嵌入空间中进行旋转,平移等变化,因此在有效保持旧类别知识的同时,更有利于新类别的学习。当不对类内结构进行约束时,网络的更新常导致相同输入对于特征原型的相对关系发生较大变化(图3左下侧)。而类内结构保持损失则可以减少这种变化,进而在更细粒度上维护旧知识的完整性。

[0050]

三、伪标签生成模块及相关损失函数。

[0051]

本发明实施例中,利用逐类别动态阈值为旧网络的分割结果进行优化去噪,从而生成高质量的伪标签以弥补缺失的旧类别标注,该过程称为伪标签细化(pseudo label refinement)。原理如下:在持续学习过程中,旧类别的标签在当前学习阶段并不会给出,即已学习类别在

给定的标签中被标记为背景类。因此当使用给定标签作为监督信号直接训练网络时,将会加剧已学习类别的遗忘效应。为此,使用旧网络的语义分割结果标记给定标签的背景类,从而为已学习类别提供伪标签。进一步地,在旧网络输出的分割结果中,难以避免的包含有错误的结果。针对这一问题,采用输出类别概率的熵作为置信度评价指标,并仅使用置信度较高的结果作为伪标签使用。由于网络对于不同类别学习的情况不一,本发明针对每个类别分别计算其输出的熵的分布情况,并依此选取阈值使得相应旧类别i保留固定比例的伪标签,融合新增类别的真实标签(在前述阶段获取得到)后生成最终的监督标签,监督标签(伪标签)生成的方法表示为:其中,表示当前学习阶段t输入图像中像素k对应的新增类别的真实标签,表示旧网络对像素k的分类置信度,表示旧类别i对应的动态阈值,表示旧类别集合,表示旧网络对输入图像输出的分割结果,即每一像素的分类结果,为最终生成的像素k的伪标签。

[0052]

之后,利用所述最终生成的伪标签计算所述新网络的分类损失,具体为交叉熵损失(cross entropy loss),表示为:其中,表示所述新网络对于输入图像输出的分割结果。

[0053]

四、联合损失函数训练语义分割网络。

[0054]

本发明实施例中,联合前述一~三中的对齐损失、类间结构保持损失、类内结构保持损失、初始结构优化损失及分类损失训练所述新网络与新特征变换模块,最终达到在语义分割任务上实现持续学习的目的。训练的目标损失函数为以上损失函数的加权和:其中,及分别为相应损失的权重。

[0055]

本发明实施例提供一种图像语义分割网络持续学习方法,主要获得如下有益效果:1)通过特征空间中的非线性变换提取旧知识表征进行对齐的手段,有效保持旧知识不变性的同时提高对新知识学习的能力。

[0056]

2)在嵌入空间中对新类别优化其拓扑结构,对旧类别维护其拓扑结构的不变性,达到降低遗忘,防止类间混淆的效果。

[0057]

3)联合伪标签及伪标签降噪技术,使得在语义分割持续学习中无需提供旧类别的标签,降低标注成本。

[0058]

总体来说,本发明作为一种通用性的语义分割持续学习方法,对应用场景均无限制,具有很强的泛化能力与实用价值。

[0059]

基于上述介绍,下面提供一个完整的实施流程,包括图像语义分割网络初始阶段学习、图像语义分割网络持续学习、以及图像语义分割网络测试。

[0060]

一、图像语义分割网络初始阶段学习。

[0061]

1、准备初始语义分割数据集及对应的类别标签构成训练数据,通过随机裁剪的方式改变图像的空间分辨率,使得图像的宽与高均为512,并进行归一化处理。

[0062]

2、使用深度学习框架建立基于类别结构保持与特征对齐的图像语义分割模型,包含全卷积语义分割网络、特征变换模块、类别结构信息保持模块和伪标签生成模块等。其中全卷积语义分割网络为deeplabv3,其特征提取器可选择resnet,mobilenet等。此处使用resnet-101作为特征提取器。其解码器部分为aspp模块。在特征提取器的输出部分设置特征变换模块对特征进行非线性变换及对齐操作。在语义分割网络的解码器部分设置类别结构信息保持模块。在语义分割网络的输出部分设置伪标签生成模块。

[0063]

3、在初始阶段学习过程中,每次随机从训练数据中选择一组数据输入网络,经由模型给出语义分割结果,使用交叉熵损失及初始结构优化损失训练网络。

[0064]

此部分所涉及的训练流程均为常规技术,故不再赘述;此外,上述流程所涉及的具体图像尺寸以及网络结构与类型均为举例,并非构成限制。

[0065]

二、图像语义分割网络持续学习。

[0066]

1、初始阶段训练完成后,准备新增语义分割数据集及对应新增类别的标签。通过随机裁剪的方式改变图像的空间分辨率,使得图像的宽与高均为512,并进行归一化处理。

[0067]

同样的,此处所涉及的具体图像尺寸仅为举例,并非构成限制。

[0068]

本领域技术人员可以理解,新增语义分割数据集中包含了新增类别以及旧类别,当然,有可能少数图像中不包含旧类别,但对学习效果的影响较小。此外,对于新增类别会进行标注,旧类别无需进行标注。

[0069]

2、初步训练特征变换模块。每次迭代随机从训练数据中选择一组数据输入图像语义分割网络,得到特征提取器输出的特征图,使用损失函数训练特征变换模块,使其在新增的数据上能完成特征变换操作。

[0070] 3、使用图像语义分割网络及特征变换模块的权重初始化一相同的网络与特征变换模块(即新网络与新特征变换模块)用以学习新增类别,同时旧网络及其特征变换模块不再更新。每次迭代随机从训练数据中选择一组数据同时输入新、旧网络。二者特征提取器输出特征图分别经由新旧特征变换模块得到旧知识表征,计算对齐损失。使用新、旧网络解码器输出对旧类别构建类间关系矩阵、及类内关系集合、。并计算类间结构保持损失与类内结构保持损失。同时对新类别计算初始结构优化损失。最后,使用旧网络的输出经由伪标签生成模块生成完整的语义标签,在新网络的分割结果上计算交叉熵损失。

[0071] 4、根据上述步骤的损失函数,计算总损失函数l,通过反向传播算法以及梯度下降策略,使得损失函数最小化,更新语义分割网络及特征变换模块的参数权重。

[0072]

此阶段所涉及的反向传播算法以及梯度下降策略均可参照常规技术,故不做赘述。

[0073]

当需要继续学习新增类别时,重复执行图像语义分割网络持续学习部分的步骤1~步骤4,直至所有感兴趣的类别全部学习完毕。

[0074]

三、图像语义分割网络测试。

[0075]

将测试数据集中的图像输入至经持续学习后的图像语义分割网络,依次通过其内

部的特征提取器与解码器获得分割结果。通过设定指标可以对分割结果进行评估,以判断持续学习后的图像语义分割网络的语义分割性能。

[0076]

如图4所示,展示了不同图像语义分割网络分割结果的对比示意图;从左至右四列图像分别表示:输入的图像、现有方案的分割结果、本发明的分割结果、真实分割结果,从图4可以发现本发明的分割结果与真实分割结果接近,并远远优于现有方案的分割结果。

[0077]

实施例二本发明还提供一种图像语义分割网络持续学习系统,其主要基于前述实施例一提供的方法实现,如图5所示,该系统主要包括:数据收集与初步训练单元,用于获取新增语义分割数据集及对应新增类别的标签,利用原始图像语义分割网络提取所述新增语义分割数据集中图像数据的原始特征图,通过特征变换模块对所述原始特征图进行变换,并利用变换结果重构的特征图与所述原始特征图的差异初步训练所述特征变换模块;学习单元,用于使用所述原始图像语义分割网络与初步训练的特征变换模块初始化一个相同的图像语义分割网络与特征变换模块,将所述原始图像语义分割网络称为旧网络,初步训练的特征变换模块称为旧特征变换模块,初始化产生的图像语义分割网络称为新网络,初始化产生的特征变换模块称为新特征变换模块;固定所述旧网络与旧特征变换模块,训练所述新网络与新特征变换模块;训练时,将新增语义分割数据集的图像数据同时输入至所述旧网络与新网络,所述旧网络与新网络中各自进行特征图提取、解码与语义分割,获得分割结果;其中,所述旧网络提取的特征图通过所述旧特征变换模块进行变换,所述新网络提取的特征图通过所述新特征变换模块进行变换,并计算两种变换结果的对齐损失;利用所述旧网络与新网络各自的分割结果及解码获得的特征向量,对于旧类别分别独自构建相应的类间关系矩阵与类内关系集合,并利用所述旧网络与新网络的类间关系矩阵计算类间结构保持损失,利用所述旧网络与新网络的类内关系集合计算类内结构保持损失,所述类间结构保持损失与类内结构保持损失用于保持旧类别中类间结构与类内结构的一致性;同时,对于新增类别,利用所述新网络解码获得的特征向量计算初始结构优化损失,所述初始结构优化损失用于拉近相同新增类别的特征向量的分布,疏远不同新增类别的特征向量的分布,并且,利用逐类别动态阈值对旧网络的分割结果进行优化去噪,获得相应的伪标签,利用所述伪标签计算所述新网络的分类损失;结合所述对齐损失、类间结构保持损失、类内结构保持损失、初始结构优化损失及分类损失训练所述新网络与新特征变换模块。

[0078]

所属领域的技术人员可以清楚地了解到,为描述的方便和简洁,仅以上述各功能模块的划分进行举例说明,实际应用中,可以根据需要而将上述功能分配由不同的功能模块完成,即将系统的内部结构划分成不同的功能模块,以完成以上描述的全部或者部分功能。

[0079]

需要说明的是,上述各单元所涉及的主要原理在之前的实施例一中已经做了详细的说明,故不再赘述。

[0080]

实施例三本发明还提供一种处理设备,如图6所示,其主要包括:一个或多个处理器;存储器,用于存储一个或多个程序;其中,当所述一个或多个程序被所述一个或多个处理器执行

时,使得所述一个或多个处理器实现前述实施例提供的方法。

[0081]

进一步的,所述处理设备还包括至少一个输入设备与至少一个输出设备;在所述处理设备中,处理器、存储器、输入设备、输出设备之间通过总线连接。

[0082]

本发明实施例中,所述存储器、输入设备与输出设备的具体类型不做限定;例如:输入设备可以为触摸屏、图像采集设备、物理按键或者鼠标等;输出设备可以为显示终端;存储器可以为随机存取存储器(random access memory,ram),也可为非不稳定的存储器(non-volatile memory),例如磁盘存储器。

[0083]

实施例四本发明还提供一种可读存储介质,存储有计算机程序,当计算机程序被处理器执行时实现前述实施例提供的方法。

[0084]

本发明实施例中可读存储介质作为计算机可读存储介质,可以设置于前述处理设备中,例如,作为处理设备中的存储器。此外,所述可读存储介质也可以是u盘、移动硬盘、只读存储器(read-only memory,rom)、磁碟或者光盘等各种可以存储程序代码的介质。

[0085]

以上所述,仅为本发明较佳的具体实施方式,但本发明的保护范围并不局限于此,任何熟悉本技术领域的技术人员在本发明披露的技术范围内,可轻易想到的变化或替换,都应涵盖在本发明的保护范围之内。因此,本发明的保护范围应该以权利要求书的保护范围为准。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。