1.本技术涉及视频处理技术领域,尤其涉及一种视频片段的整合方法、装置、电子设备及存储介质。

背景技术:

2.综艺影视视频中,会存在一些精彩的片段作为视频中的高潮部分,这部分片段的内容精彩、信息量大、吸引力足等特点,通常被称为高光片段。随着视频数量的爆发式增长,特别是近年来短视频领域的迅速崛起,视频已经成为大部分互联网用户娱乐的首要选择,占据了用户大部分娱乐时间。面对如此海量的视频,视频网站通常会提取高光视频片段,并将这些高光片段整合后再进行播放,以吸引用户,提高用户的观看体验,提升用户粘性。因此,提取高光片段是视频内容运营的重要部分。

3.在现有技术中,整合视频中的高光片段时,通常是由人工先观看完整段视频,然后判断视频高光片段在视频中的时间位置,进行人工打点,然后利用视频剪辑工具进行剪辑,以提取出高光片段,最后将提取出的高光片段进行整合。这种方式由于需要人工操作,流程慢,效率低,无法满足快速整合高光片段的需求。

技术实现要素:

4.有鉴于此,本技术提供一种视频片段的整合方法、装置、电子设备及存储介质,以解决现有技术中整合视频中的高光片段时,通常是由人工去剪辑,导致视频的处理效率低,效果差的问题。

5.为实现上述目的,本技术提供如下技术方案:

6.本技术第一方面公开了一种视频片段的整合方法,包括:

7.对目标视频进行分段,得到多个视频片段;

8.提取每一个视频片段的视觉特征和音频特征;

9.针对每一个视频片段,将所述视频片段的视觉特征和音频特征进行融合,得到所述视频片段对应的视频特征;

10.调用预先训练的视频评估模型对所述视频特征进行处理,依据处理结果确定出待整合视频片段,所述待整合视频片段为符合预先设定条件的视频片段,所述视频评估模型为利用样本视频进行训练后得到的模型,所述样本视频为符合所述预先设定条件的视频片段;

11.对识别出的待整合视频片段进行整合,得到所述目标视频的高光片段。

12.可选的,上述的方法,所述提取每一个视频片段的视觉特征和音频特征,包括:

13.针对每一个视频片段,提取所述视频片段的视频帧和音频帧;

14.将所述视频帧输入到3d卷积神经网络模型中,得到所述视频片段的视觉特征;

15.获取所述音频帧的梅尔倒频滤波系数,并将所述梅尔倒频滤波系数输入到vggsih神经网络模型中,得到所述视频片段的音频特征。

16.可选的,上述的方法,所述视频评估模型的构建过程,包括:

17.获取样本视频的视频特征以及样本视频的高光性评分;

18.将所述样本视频的视频特征输入到初始模型中进行运算,得到当前视频片段的高光性评分;

19.判断所述当前视频片段的高光性评分与实际标注的视频片段的高光性评分是否一致;

20.若所述当前视频片段的高光性评分与实际标注的视频片段的高光性评分一致,则完成所述视频评估模型的构建;

21.若所述当前视频片段的高光性评分与实际标注的视频片段的高光性评分不一致,则求出误差函数,并利用所述误差函数调整所述神经网络模型的参数,直至输出的所述当前视频片段的高光性评分与实际标注的视频片段的高光性评分一致,则完成所述视频评估模型构建。

22.可选的,上述的方法,所述对识别出的待整合视频片段进行整合,得到所述目标视频的高光片段,包括:

23.获取每一个视频片段的时间区间;

24.将时间区间有重合的视频片段进行合并,得到合并后的视频片段,并计算所述合并后的视频片段的高光性评分;

25.将所述合并后的视频片段和未合并的视频片段按照所述高光性评分的高低进行排序;

26.按照排序后的顺序对所述合并后的视频片段和所述未合并的视频片段进行合并,得到所述目标视频的高光片段。

27.可选的,上述的方法,所述对识别出的待整合视频片段进行整合,得到所述目标视频的高光片段之后,还包括:

28.对所述目标视频的高光片段进行镜头切分,得到视频的分镜数据;

29.基于所述分镜数据对所述高光片段的时间区间进行调整,得到调整后的高光片段。

30.本技术第二方面公开了一种视频片段的整合装置,包括:

31.分段单元,用于对目标视频进行分段,得到多个视频片段;

32.提取单元,用于提取每一个视频片段的视觉特征和音频特征;

33.融合单元,用于针对每一个视频片段,将所述视频片段的视觉特征和音频特征进行融合,得到所述视频片段对应的视频特征;

34.处理单元,用于调用预先训练的视频评估模型对所述视频特征进行处理,依据处理结果确定出待整合视频片段,所述待整合视频片段为符合预先设定条件的视频片段,所述视频评估模型为利用样本视频进行训练后得到的模型,所述样本视频为符合所述预先设定条件的视频片段;

35.整合单元,用于对识别出的待整合视频片段进行整合,得到所述目标视频的高光片段。

36.可选的,上述的装置,所述提取单元,包括:

37.提取子单元,用于针对每一个视频片段,提取所述视频片段的视频帧和音频帧;

38.第一运算子单元,用于将所述视频帧输入到3d卷积神经网络模型中,得到所述视频片段的视觉特征;

39.第二运算子单元,用于获取所述音频帧的梅尔倒频滤波系数,并将所述梅尔倒频滤波系数输入到vggsih神经网络模型中,得到所述视频片段的音频特征。

40.可选的,上述的装置,所述处理单元,包括:

41.获取子单元,用于获取样本视频的视频特征以及样本视频的高光性评分;

42.第三运算子单元,用于将所述样本视频的视频特征输入到初始模型中进行运算,得到当前视频片段的高光性评分;

43.判断子单元,用于判断所述当前视频片段的高光性评分与实际标注的视频片段的高光性评分是否一致;

44.构建子单元,用于若所述当前视频片段的高光性评分与实际标注的视频片段的高光性评分一致,则完成所述视频评估模型的构建;

45.调参子单元,用于若所述当前视频片段的高光性评分与实际标注的视频片段的高光性评分不一致,则求出误差函数,并利用所述误差函数调整所述神经网络模型的参数,直至输出的所述当前视频片段的高光性评分与实际标注的视频片段的高光性评分一致,则完成所述视频评估模型构建。

46.可选的,上述的装置,所述整合单元,包括:

47.获取子单元,用于获取每一个视频片段的时间区间;

48.第一合并子单元,用于将时间区间有重合的视频片段进行合并,得到合并后的视频片段,并计算所述合并后的视频片段的高光性评分;

49.排序子单元,用于将所述合并后的视频片段和未合并的视频片段按照所述高光性评分的高低进行排序;

50.第二合并子单元,用于按照排序后的顺序对所述合并后的视频片段和所述未合并的视频片段进行合并,得到所述目标视频的高光片段。

51.可选的,上述的装置,还包括:

52.切分单元,用于对所述目标视频的高光片段进行镜头切分,得到视频的分镜数据;

53.调整单元,用于基于所述分镜数据对所述高光片段的时间区间进行调整,得到调整后的高光片段。

54.本技术第三方面公开了一种电子设备,包括:

55.一个或多个处理器;

56.存储装置,其上存储有一个或多个程序;

57.当所述一个或多个程序被所述一个或多个处理器执行时,使得所述一个或多个处理器实现如本发明第一方面中任意一项所述的方法。

58.本技术第四方面公开了一种计算机存储介质,其上存储有计算机程序,其中,所述计算机程序被处理器执行时实现如本发明第一方面中任意一项所述的方法。

59.从上述技术方案可以看出,本技术提供的视频片段的整合方法中,首先对目标视频进行分段,得到多个视频片段。然后提取每一个视频片段的视觉特征和音频特征,并针对每一个视频片段,将视频片段的视觉特征和音频特征进行融合,得到视频片段对应的视频特征。接着调用预先训练的视频评估模型对视频特征进行处理,依据处理结果确定出待整

合视频片段。最后对识别出的待整合视频片段进行整合,得到目标视频的高光片段。由此可知,利用本技术的方法,可以自动将视频切分成多个视频片段,并对各个视频片段进行高光性评分,然后筛选出其中的评分较高的视频片段进行整合,得到视频最终的高光片段。解决了现有技术中整合视频中的高光片段时,通常是由人工去剪辑,导致视频的处理效率低,效果差的问题。

附图说明

60.为了更清楚地说明本技术实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本技术的实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据提供的附图获得其他的附图。

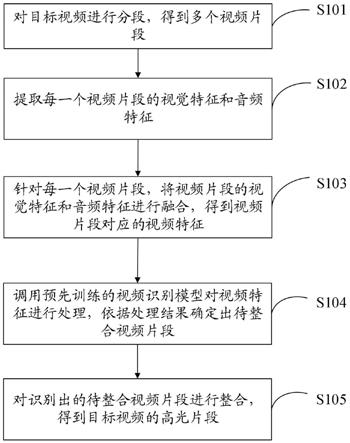

61.图1为本技术另一实施例公开的一种视频片段的整合方法的流程图;

62.图2为本技术另一实施例公开的步骤s104中视频评估模型的构建过程的一种实施方式的流程图;

63.图3为本技术另一实施例公开的步骤s105的一种实施方式的流程图;

64.图4为本技术另一实施例公开的一种视频片段的整合装置的示意图;

65.图5为本技术另一实施例公开的一种电子设备的示意图。

具体实施方式

66.下面将结合本技术实施例中的附图,对本技术实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本技术一部分实施例,而不是全部的实施例。基于本技术中的实施例,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其他实施例,都属于本技术保护的范围。

67.在本技术中,术语“包括”、“包含”或者其任何其他变体意在涵盖非排他性的包含,从而使得包括一系列要素的过程、方法、物品或者设备不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种过程、方法、物品或者设备所固有的要素。在没有更多限制的情况下,由语句“包括一个

……”

限定的要素,并不排除在包括所述要素的过程、方法、物品或者设备中还存在另外的相同要素。

68.并且,在本文中,诸如第一和第二等之类的关系术语仅仅用来将一个实体或者操作与另一个实体或操作区分开来,而不一定要求或者暗示这些实体或操作之间存在任何这种实际的关系或者顺序。

69.由背景技术可知,在现有技术中,整合视频中的高光片段时,通常是由人工先观看完整段视频,然后判断视频高光片段在视频中的时间位置,进行人工打点,然后利用视频剪辑工具进行剪辑。这种方式由于需要人工操作,流程慢,效率低,且由于人的主观性,选取的片段不一定是大众喜爱的高光片段,不一定具有吸引用户的作用。

70.鉴于此,本技术提供一种视频片段的整合方法、装置、电子设备及存储介质,以解决现有技术中整合视频中的高光片段时,通常是由人工去剪辑,导致视频的处理效率低,效果差的问题。

71.本技术实施例提供了一种视频片段的整合方法,如图1所示,具体包括:

72.s101、对目标视频进行分段,得到多个视频片段。

73.需要说明的是,使用滑窗机制对目标视频进行分段,得到多个连续且部分重复的视频片段。分段的视频时长、步长可以预先设定,例如时长为30s,步长为15s。

74.s102、提取每一个视频片段的视觉特征和音频特征。

75.需要说明的是,在将目标视频拆分成多个视频片段之后,则提取每一个视频的视觉特征和提取每一个视频的音频特征,得到一个多模态的视频表达,用于后续的视频高光性评估。

76.可选的,在本技术的另一实施例中,步骤s102的一种实施方式,可以包括:

77.针对每一个视频片段,提取视频片段的视频帧和音频帧。

78.将视频帧输入到3d卷积神经网络模型中,得到视频片段的视觉特征。

79.获取音频帧的梅尔倒频滤波系数,并将梅尔倒频滤波系数输入到vggsih神经网络模型中,得到视频片段的音频特征。

80.需要说明的是,针对目标视频拆分得到的每一个视频片段,首先提取视频片段的视频帧和音频帧。提取视频帧时一般每秒提取两张视频帧,提取音频帧时,可以按41000hz进行抽样提取。然后将提取的视频帧输入到利用三维卷积核构建的3d卷积神经网络模型中,得到视频片段的视觉特征。将提取到的音频帧进行预加重、分帧和加窗,对每一个短时分析窗,通过fft(fast fourier transform,快速傅立叶变换)得到对应的频谱,将上面的频谱通过梅尔滤波器组得到梅尔频谱,在梅尔频谱上面进行倒谱分析,获得梅尔倒频滤波系数。然后将梅尔倒频滤波系数输入到vggsih神经网络模型中,得到视频片段的音频特征。

81.s103、针对每一个视频片段,将视频片段的视觉特征和音频特征进行融合,得到视频片段对应的视频特征。

82.需要说明的是,针对每一个视频片段,将视频片段的视觉特征以及音频特征进行特征融合,例如将视觉特征和音频特征进行向量拼接,得到视频片段对应的视频特征,用于表征当前视频片段的特征。

83.s104、调用预先训练的视频评估模型对视频特征进行处理,依据处理结果确定出待整合视频片段,待整合视频片段为符合预先设定条件的视频片段,视频评估模型为利用样本视频进行训练后得到的模型,样本视频为符合预先设定条件的视频片段。

84.需要说明的是,在得到视频片段对应的视频特征之后,则调用预先训练的视频评估模型对视频特征进行处理,得到每一个视频片段的高光性评分,该评分的数值范围为0到1。并依据每一个视频片段的高光性评分确定出待整合视频片段,具体地,从所有视频片段中筛选出高光性评分符合预设条件的视频片段作为待整合视频片段,预设条件可以根据实际情况进行设定。例如,筛选出评分为0.5以上的视频片段,评分越高,说明视频片段具备亮点的是可能性越大。其中,视频评估模型为利用样本视频进行训练后得到的模型,样本视频为符合预先设定条件的视频片段。

85.可选的,在本技术的另一实施例中,步骤s104中视频评估模型的构建过程,如图2所示,具体包括:

86.s201、获取样本视频的视频特征以及样本视频的高光性评分。

87.需要说明的是,首先获取样本视频的视频特征以及样本视频的高光性评分,将这些数据作为训练数据,输入到神经网络模型中进行训练。

88.s202、将样本视频的视频特征输入到初始模型中进行运算,得到当前视频片段的高光性评分。

89.s203、判断当前视频片段的高光性评分与实际标注的视频片段的高光性评分是否一致。

90.需要说明的是,在初始运算模型中运算得到当前视频片段的高光性评分之后,将运算得到的视频片段的高光性评分与实际标注的视频片段的高光性评分进行对比,从而判断初始运算模型中运算得到的视频片段的高光性评分是否准确。

91.s204、若当前视频片段的高光性评分与实际标注的视频片段的高光性评分一致,则完成视频评估模型的构建。

92.s205、若当前视频片段的高光性评分与实际标注的视频片段的高光性评分不一致,则求出误差函数,并利用误差函数调整神经网络模型的参数,直至输出的当前视频片段的高光性评分与实际标注的视频片段的高光性评分一致,则完成视频评估模型构建。

93.需要说明的是,如果运算出来的当前视频片段的高光性评分与实际标注的视频片段的高光性评分不一致,则求出神经网络模型的误差函数,利用误差函数调整神经网络模型的参数,并重新进行新一轮的运算,直至输出的视频片段的高光性评分与实际标注的视频片段的高光性评分一致,则完成文本情感模型的构建。

94.s105、筛选出高光性评分符合预设条件的视频片段。

95.需要说明的是,在得到每一个视频片段的高光性评分,从中筛选出高光性评分符合预设条件的视频片段,例如评分为0.5以上的视频片段,评分越高,说明视频片段具备亮点的是可能性越大。

96.s105、对识别出的待整合视频片段进行整合,得到目标视频的高光片段。

97.需要说明的是,在筛选出所有高光性评分符合条件的视频片段之后,则自动根据各个视频片段的是时间区间或者其他的整合条件对筛选出的视频片段进行整合,得到目标视频的高光片段。

98.可选的,在本技术的另一实施例中,步骤s105的一种实施方式,如图3所示,可以包括:

99.s301、获取每一个视频片段的时间区间。

100.s302、将时间区间有重合的视频片段进行合并,得到合并后的视频片段,并计算合并后的视频片段的高光性评分。

101.需要说明的是,将时间区间有重合的视频片段进行合并,得到合并后的视频片段,合并后的视频片段的高光性评分则为所合并视频片段的高光性评分的平均值。

102.s303、将合并后的视频片段和未合并的视频片段按照高光性评分的高低进行排序。

103.需要说明的是,将合并后的视频片段和未合并的视频片段按照高光性评分的高低从高到低进行排序。

104.s304、按照排序后的顺序对合并后的视频片段和未合并的视频片段进行合并,得到目标视频的高光片段。

105.需要说明的是,根据实际制作视频的时长,选择按照排序后的视频片段的顺序,选择前k个视频片段进行合并,得到目标视频的高光片段,其中,k为正整数。

106.可选的,在本技术的另一实施例中,执行步骤s105之后,还可以包括:

107.对目标视频的高光片段进行镜头切分,得到视频的分镜数据。

108.基于分镜数据对高光片段的时间区间进行调整,得到调整后的高光片段。

109.需要说明的是,对目标视频的高光片段进行镜头切分,得到视频的分镜数据,根据分镜数据对高光片段的时间区间进行微调,以保证高光片段是由完整的镜头所组成。

110.本技术实施例提供的视频片段的整合方法中,首先对目标视频进行分段,得到多个视频片段。然后提取每一个视频片段的视觉特征和音频特征,并针对每一个视频片段,将视频片段的视觉特征和音频特征进行融合,得到视频片段对应的视频特征。接着调用预先训练的视频评估模型对视频特征进行处理,依据处理结果确定出待整合视频片段。最后对识别出的待整合视频片段进行整合,得到目标视频的高光片段。由此可知,利用本技术的方法,可以自动将视频切分成多个视频片段,并对各个视频片段进行高光性评分,然后筛选出其中的评分较高的视频片段进行整合,得到视频最终的高光片段。解决了现有技术中整合视频中的高光片段时,通常是由人工去剪辑,导致视频的处理效率低,效果差的问题。

111.本技术另一实施例还公开了一种视频片段的整合装置,如图4所示,具体包括:

112.分段单元401,用于对目标视频进行分段,得到多个视频片段。

113.提取单元402,用于提取每一个视频片段的视觉特征和音频特征。

114.融合单元403,用于针对每一个视频片段,将视频片段的视觉特征和音频特征进行融合,得到视频片段对应的视频特征。

115.处理单元404,用于调用预先训练的视频评估模型对视频特征进行处理,依据处理结果确定出待整合视频片段,待整合视频片段为符合预先设定条件的视频片段,视频评估模型为利用样本视频进行训练后得到的模型,样本视频为符合预先设定条件的视频片段。

116.整合单元405,用于对识别出的待整合视频片段进行整合,得到目标视频的高光片段。

117.本实施例中,分段单元401、提取单元402、融合单元403、处理单元404、整合单元405的具体执行过程,可参见对应图1的方法实施例内容,此处不再赘述。

118.本技术实施例提供的视频片段的整合装置中,首先分段单元401对目标视频进行分段,得到多个视频片段。然后提取单元402提取每一个视频片段的视觉特征和音频特征,融合单元403针对每一个视频片段,将视频片段的视觉特征和音频特征进行融合,得到视频片段对应的视频特征。接着处理单元404调用预先训练的视频评估模型对视频特征进行处理,依据处理结果确定出待整合视频片段。最后整合单元405对识别出的待整合视频片段进行整合,得到目标视频的高光片段。由此可知,利用本技术的方法,可以自动将视频切分成多个视频片段,并对各个视频片段进行高光性评分,然后筛选出其中的评分较高的视频片段进行整合,得到视频最终的高光片段。解决了现有技术中整合视频中的高光片段时,通常是由人工去剪辑,导致视频的处理效率低,效果差的问题。

119.可选的,在本技术的另一实施例中,提取单元402的一种实施方式,包括:

120.提取子单元,用于针对每一个视频片段,提取视频片段的视频帧和音频帧。

121.第一运算子单元,用于将视频帧输入到3d卷积神经网络模型中,得到视频片段的视觉特征。

122.第二运算子单元,用于获取音频帧的梅尔倒频滤波系数,并将梅尔倒频滤波系数

输入到vggsih神经网络模型中,得到视频片段的音频特征。

123.本实施例中,提取子单元、第一运算子单元、第二运算子单元的具体执行过程,可参见对应上述方法实施例内容,此处不再赘述。

124.可选的,在本技术的另一实施例中,处理单元404的一种实施方式,包括:

125.获取子单元,用于获取样本视频的视频特征以及样本视频的高光性评分。

126.第三运算子单元,用于将样本视频的视频特征输入到初始模型中进行运算,得到当前视频片段的高光性评分。

127.判断子单元,用于判断当前视频片段的高光性评分与实际标注的视频片段的高光性评分是否一致。

128.构建子单元,用于若当前视频片段的高光性评分与实际标注的视频片段的高光性评分一致,则完成视频评估模型的构建。

129.调参子单元,用于若当前视频片段的高光性评分与实际标注的视频片段的高光性评分不一致,则求出误差函数,并利用误差函数调整神经网络模型的参数,直至输出的当前视频片段的高光性评分与实际标注的视频片段的高光性评分一致,则完成视频评估模型构建。

130.本实施例中,提取子单元、第一运算子单元、第二运算子单元的具体执行过程,可参见对应图2方法实施例内容,此处不再赘述。

131.可选的,在本技术的另一实施例中,整合单元405的一种实施方式,包括:

132.获取子单元,用于获取每一个视频片段的时间区间。

133.第一合并子单元,用于将时间区间有重合的视频片段进行合并,得到合并后的视频片段,并计算合并后的视频片段的高光性评分。

134.排序子单元,用于将合并后的视频片段和未合并的视频片段按照高光性评分的高低进行排序。

135.第二合并子单元,用于按照排序后的顺序对合并后的视频片段和未合并的视频片段进行合并,得到目标视频的高光片段。

136.本实施例中,获取子单元、第一合并子单元、排序子单元、第二合并子单元的具体执行过程,可参见对应图3方法实施例内容,此处不再赘述。

137.可选的,在本技术的另一实施例中,上述视频片段的整合装置,还可以包括:

138.切分单元,用于对目标视频的高光片段进行镜头切分,得到视频的分镜数据。

139.调整单元,用于基于分镜数据对高光片段的时间区间进行调整,得到调整后的高光片段。

140.本实施例中,切分单元、调整单元的具体执行过程,可参见对应上述方法实施例内容,此处不再赘述。

141.本技术另一实施例还提供了一种电子设备,如图5所示,具体包括:

142.一个或多个处理器501。

143.存储装置502,其上存储有一个或多个程序。

144.当一个或多个程序被一个或多个处理器501执行时,使得一个或多个处理器501实现如上述实施例中任意一项方法。

145.本技术另一实施例还提供了计算机存储介质,其上存储有计算机程序,其中,计算

机程序被处理器执行时实现如上述实施例中任意一项方法。

146.本说明书中的各个实施例均采用递进的方式描述,各个实施例之间相同相似的部分互相参见即可,每个实施例重点说明的都是与其他实施例的不同之处。尤其,对于系统或系统实施例而言,由于其基本相似于方法实施例,所以描述得比较简单,相关之处参见方法实施例的部分说明即可。以上所描述的系统及系统实施例仅仅是示意性的,其中所述作为分离部件说明的单元可以是或者也可以不是物理上分开的,作为单元显示的部件可以是或者也可以不是物理单元,即可以位于一个地方,或者也可以分布到多个网络单元上。可以根据实际的需要选择其中的部分或者全部模块来实现本实施例方案的目的。本领域普通技术人员在不付出创造性劳动的情况下,即可以理解并实施。

147.专业人员还可以进一步意识到,结合本文中所公开的实施例描述的各示例的单元及算法步骤,能够以电子硬件、计算机软件或者二者的结合来实现,为了清楚地说明硬件和软件的可互换性,在上述说明中已经按照功能一般性地描述了各示例的组成及步骤。这些功能究竟以硬件还是软件方式来执行,取决于技术方案的特定应用和设计约束条件。专业技术人员可以对每个特定的应用来使用不同方法来实现所描述的功能,但是这种实现不应认为超出本发明的范围。

148.对所公开的实施例的上述说明,使本领域专业技术人员能够实现或使用本发明。对这些实施例的多种修改对本领域的专业技术人员来说将是显而易见的,本文中所定义的一般原理可以在不脱离本技术的精神或范围的情况下,在其它实施例中实现。因此,本技术将不会被限制于本文所示的这些实施例,而是要符合与本文所公开的原理和新颖特点相一致的最宽的范围。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。