1.本公开涉及计算机技术领域,具体而言,涉及一种容器分配方法、装置、电子设备以及计算机可读存储介质。

背景技术:

2.由于机器学习在数据挖掘、自然语言处理、计算机视觉、搜索引擎等领域应用越来越广泛,使得机器训练模型以及训练数据也越来越多。然而,数量剧增的训练数据使得单机式的机器学习无法满足时代的要求,分布式的机器学习模型训练应运而生。

3.鉴于,云计算机平台可以方便地实现物理资源的共享,大规模的分布式机器学习模型训练均在云平台上执行。然而,在基于云计算机平台的分布式机器学习中,存在带宽消耗较大的工作节点,如何将高带宽消耗的工作节点分配到不同的物理计算节点以减少物理计算节点的带宽压力,从而提高物理计算节点之间的通信效率,成为分布式机器学习场景中需要迫切解决的问题。

4.需要说明的是,在上述背景技术部分公开的信息仅用于加强对本公开的背景的理解,因此可以包括不构成对本领域普通技术人员已知的现有技术的信息。

技术实现要素:

5.本公开实施例的目的在于提供一种容器分配方法、装置、电子设备以及计算机可读存储介质,进而至少在一定程度上克服分布式机器学习任务中计算机节点带宽瓶颈的问题。

6.本公开的其他特性和优点将通过下面的详细描述变得显然,或部分地通过本公开的实践而习得。

7.根据本公开实施例的第一方面,提供了一种容器分配方法,包括:获取分布式机器学习任务,确定所述分布式机器学习任务中的角色信息;确定所述角色信息对应的属性标签以及不同所述角色信息的所述属性标签之间对应的权重数据;生成运行所述角色信息的角色容器,并根据所述属性标签以及所述权重数据对所述角色容器进行标记;基于所述属性标签以及所述权重数据,将标记后的所述角色容器分配到不同的物理计算节点。

8.在本公开的一些示例实施例中,基于前述方案,所述属性标签包括角色名称标签、资源需求标签和任务编码标签;所述确定所述角色信息对应的属性标签,包括:通过所述角色信息对应的关联信息确定所述角色名称标签;基于所述角色名称标签与所述资源需求标签之间的映射关系,通过所述角色名称标签确定所述角色信息对应的资源需求标签;以及根据所述分布式机器学习任务确定所述角色信息对应的任务编码标签。

9.在本公开的一些示例实施例中,基于前述方案,所述确定所述角色信息的所述属性标签对应的权重数据,包括:获取所述角色信息的权重配置文件;其中,所述权重配置文件包括不同所述角色信息的所述属性标签之间的权重映射关系;根据所述属性标签以及所述权重映射关系确定不同所述角色信息的所述属性标签之间对应的权重数据以通过所述

权重数据确定不同所述角色信息之间的关联程度。

10.在本公开的一些示例实施例中,基于前述方案,所述基于所述属性标签以及所述权重数据,将标记后的所述角色容器分配到不同的物理计算节点,包括:将大于第一权重阈值的所述权重数据对应的角色容器作为亲和性角色容器,并将所述亲和性角色容器分配到第一物理计算节点;将小于第二权重阈值的所述权重数据对应的角色容器作为反亲和性角色容器,并将所述反亲和性角色容器分配到第二物理计算节点。

11.在本公开的一些示例实施例中,基于前述方案,所述权重数据包括所述角色名称标签之间对应的角色名称权重数据、资源需求标签之间对应的资源需求权重数据和所述任务编码标签之间对应的任务编码权重数据;所述基于所述属性标签以及所述权重数据,将标记后的所述角色容器分配到不同的物理计算节点,包括:基于预设的所述角色名称权重数据、所述资源需求权重数据和所述任务编码权重数据之间的优先级,将标记后的所述角色容器分配到不同的物理计算节点。

12.在本公开的一些示例实施例中,基于前述方案,在基于所述属性标签以及所述权重数据,将标记后的所述角色容器分配到不同的物理计算节点之前,所述方案还包括:确定所述角色信息对应的计算特性;根据所述计算特性确定所述角色信息对应的角色容器的待分配物理计算节点。

13.在本公开的一些示例实施例中,基于前述方案,在获取分布式机器学习任务,确定所述分布式机器学习任务中的角色信息之前,所述方法还包括:根据不同的所述角色信息之间的数量关系,添加目标数量个所述资源需求标签中属于高资源消耗的目标角色信息。

14.根据本公开实施例的第二方面,提供了一种容器分配装置,包括:角色信息确定模块,用于获取分布式机器学习任务,确定所述分布式机器学习任务中的角色信息;属性标签确定模块,用于确定所述角色信息对应的属性标签以及不同所述角色信息的所述属性标签之间对应的权重数据;角色容器标记模块,用于生成运行所述角色信息的角色容器,并根据所述属性标签以及所述权重数据对所述角色容器进行标记;角色容器分配模块,用于基于所述属性标签以及所述权重数据,将标记后的所述角色容器分配到不同的物理计算节点。

15.在本公开的一种示例性实施例中,基于前述方案,所述属性标签确定模块还包括属性标签确定单元,所述属性标签确定单元被配置为:通过所述角色信息对应的关联信息确定所述角色名称标签;基于所述角色名称标签与所述资源需求标签之间的映射关系,通过所述角色名称标签确定所述角色信息对应的资源需求标签;以及根据所述分布式机器学习任务确定所述角色信息对应的任务编码标签。

16.在本公开的一种示例性实施例中,基于前述方案,所述属性标签确定单元还被配置为:获取所述角色信息的权重配置文件;其中,所述权重配置文件包括不同所述角色信息的所述属性标签之间的权重映射关系;根据所述属性标签以及所述权重映射关系确定不同所述角色信息的所述属性标签之间对应的权重数据以通过所述权重数据确定不同所述角色信息之间的关联程度。

17.在本公开的一种示例性实施例中,基于前述方案,所述角色容器分配模块还包括角色容器分配单元,所述角色容器分配单元被配置为:将大于第一权重阈值的所述权重数据对应的角色容器作为亲和性角色容器,并将所述亲和性角色容器分配到第一物理计算节点;将小于第二权重阈值的所述权重数据对应的角色容器作为反亲和性角色容器,并将所

述反亲和性角色容器分配到第二物理计算节点。

18.在本公开的一种示例性实施例中,基于前述方案,所述角色容器分配单元还被配置为:基于预设的所述角色名称权重数据、所述资源需求权重数据和所述任务编码权重数据之间的优先级,将标记后的所述角色容器分配到不同的物理计算节点。

19.在本公开的一种示例性实施例中,基于前述方案,所述容器分配装置还包括计算特性确定单元,所述计算特性确定单元被配置为:确定所述角色信息对应的计算特性;根据所述计算特性确定所述角色信息对应的角色容器的待分配物理计算节点。

20.在本公开的一种示例性实施例中,基于前述方案,所述容器分配装置还包括目标角色信息添加单元,所述目标角色信息添加单元被配置为:根据不同的所述角色信息之间的数量关系,添加目标数量个所述资源需求标签中属于高资源消耗的目标角色信息。

21.根据本公开实施例的第三方面,提供了一种电子设备,包括:处理器;以及存储器,所述存储器上存储有计算机可读指令,所述计算机可读指令被所述处理器执行时实现上述任意一项所述的容器分配方法。

22.根据本公开实施例的第四方面,提供一种计算机可读存储介质,其上存储有计算机程序,所述计算机程序被处理器执行时实现根据上述任意一项所述的容器分配方法。

23.本公开实施例提供的技术方案可以包括以下有益效果:

24.本公开的示例实施例中的容器分配方法,获取分布式机器学习任务,确定所述分布式机器学习任务中的角色信息;确定所述角色信息对应的属性标签以及不同所述角色信息的所述属性标签之间对应的权重数据;生成运行所述角色信息的角色容器,并根据所述属性标签以及所述权重数据对所述角色容器进行标记;基于所述属性标签以及所述权重数据,将标记后的所述角色容器分配到不同的物理计算节点。一方面,根据不同的角色信息对应的属性标签以及不同角色信息的属性标签对应的权重数据,对不同的角色容器进行标记以使关联程度较高的角色容器分配到相同或相近的物理计算节点,提高角色容器的管理效率;另一方面,通过不同角色信息对应的属性标签以及不同角色信息的属性标签对应的权重数据,对不同的角色容器进行标记,可以通过将带宽消耗较高的角色容器近乎均匀地分配到多个物理计算节点,以有效地缓解单个物理计算节点的带宽压力,进一步提高物理计算节点间的通信效率;再一方面,通过确定不同角色信息对应的属性标签以及不同角色的属性标签对应的权重数据,对不同的角色容器进行标记,并将同一分布式机器学习任务对应的多个角色容器尽量的分配到同一个或相近的物理计算节点上,在一定程度上减少了物理计算节点间的通信成本,进一步实现了资源利用收益最大化。

25.应当理解的是,以上的一般描述和后文的细节描述仅是示例性和解释性的,并不能限制本公开。

附图说明

26.此处的附图被并入说明书中并构成本说明书的一部分,示出了符合本公开的实施例,并与说明书一起用于解释本公开的原理。显而易见地,下面描述中的附图仅仅是本公开的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。在附图中:

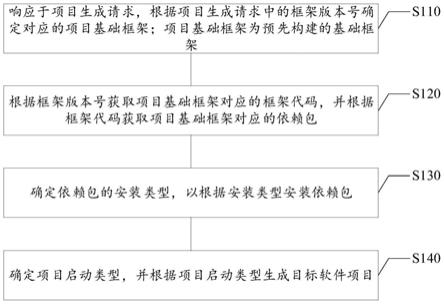

27.图1示意性示出了根据本公开的一些实施例的容器分配方法的示意图;

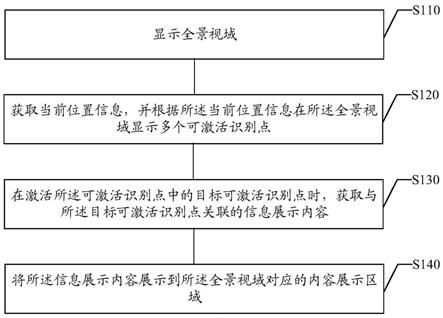

28.图2示意性示出了根据本公开的一些实施例的确定不同角色的属性标签的示意图;

29.图3示意性示出了根据本公开的一些实施例的确定不同角色信息的属性标签对应的权重数据的示意图;

30.图4示意性示出了根据本公开的一些实施例的确定不同角色容器的亲和性或反亲和性的示意图;

31.图5示意性示出了根据本公开的一些实施例的将不同角色容器分配到不同的计算节点的示意图;

32.图6示意性示出了根据本公开的一些实施例的对不同计算特性的角色信息对应的角色容器分配相应的计算节点的示意图;

33.图7示意性示出了根据本公开的一些实施例的对目标角色信息进行调整的示意图;

34.图8示意性示出了根据本公开的一些实施例的容器分配装置的示意图;

35.图9示意性示出了根据本公开的一些实施例的电子设备的计算机系统的结构示意图;

36.图10示意性示出了根据本公开的一些实施例的计算机可读存储介质的示意图。

37.在附图中,相同或对应的标号表示相同或对应的部分。

具体实施方式

38.现在将参考附图更全面地描述示例实施方式。然而,示例实施方式能够以多种形式实施,且不应被理解为限于在此阐述的范例;相反,提供这些实施方式使得本公开将更加全面和完整,并将示例实施方式的构思全面地传达给本领域的技术人员。

39.此外,所描述的特征、结构或特性可以以任何合适的方式结合在一个或更多实施例中。在下面的描述中,提供许多具体细节从而给出对本公开的实施例的充分理解。然而,本领域技术人员将意识到,可以实践本公开的技术方案而没有特定细节中的一个或更多,或者可以采用其它的方法、组元、装置、步骤等。在其它情况下,不详细示出或描述公知方法、装置、实现或者操作以避免模糊本公开的各方面。

40.此外,附图仅为示意性图解,并非一定是按比例绘制。附图中所示的方框图仅仅是功能实体,不一定必须与物理上独立的实体相对应。即,可以采用软件形式来实现这些功能实体,或在一个或多个硬件模块或集成电路中实现这些功能实体,或在不同网络和/或处理器装置和/或微控制器装置中实现这些功能实体。

41.相关的技术方案中,通过把分布式训练的各个容器调度到几台集中的物理计算节点上以解决计算机节点之间的通信效率,但并未解决物理计算节点的带宽瓶颈以及资源利用收益最大化的问题。

42.基于以上的问题,在本示例实施例中,首先提供了一种容器分配方法。图1示意性示出了根据本公开的一些实施例的容器分配方法流程的示意图。参考图1所示,该容器分配方法可以包括以下步骤:

43.步骤s110,获取分布式机器学习任务,确定所述分布式机器学习任务中的角色信息;

44.步骤s120,确定所述角色信息对应的属性标签以及不同所述角色信息的所述属性标签之间对应的权重数据;

45.步骤s130,生成运行所述角色信息的角色容器,并根据所述属性标签以及所述权重数据对所述角色容器进行标记;

46.步骤s140,基于所述属性标签以及所述权重数据,将标记后的所述角色容器分配到不同的物理计算节点。

47.根据本示例实施例中的容器分配方法,一方面,根据不同的角色信息对应的属性标签以及不同角色信息的属性标签对应的权重数据,对不同的角色容器进行标记以使关联程度较高的角色容器分配到相同或相近的物理计算节点,提高角色容器的管理效率;另一方面,通过不同角色信息对应的属性标签以及不同角色信息的属性标签对应的权重数据,对不同的角色容器进行标记,可以通过将带宽消耗较高的角色容器近乎均匀地分配到多个物理计算节点,以有效地缓解单个物理计算节点的带宽压力,进一步提高物理计算节点间的通信效率;再一方面,通过确定不同角色信息对应的属性标签以及不同角色的属性标签对应的权重数据,对不同的角色容器进行标记,并将同一分布式机器学习任务对应的多个角色容器尽量的分配到同一个或相近的物理计算节点上,在一定程度上减少了物理计算节点间的通信成本,进一步实现了资源利用收益最大化。

48.下面,将对本示例实施例中的容器分配方法进行进一步的说明。

49.参考图1,在步骤s110中,获取分布式机器学习任务,确定所述分布式机器学习任务中的角色信息。

50.在本公开的一个示例实施例中,分布式机器学习任务可以指在分布式应用场景下完成机器模型训练等的任务;分布式机器学习任务中的角色信息可以指分布式机器学习任务中包含的不同角色的名称、每种角色的数量、每种角色占用的资源如cpu(central processing unit,中央处理器)资源、gpu(graphic processing unit,图形处理器)资源、内存大小、带宽大小、每种角色具有的功能以及分布式机器学习任务对应的id等信息,例如,角色信息可以指包含执行机器学习任务的角色的信息如负责计算参数梯度的worker(工作节点),也可以指负责存放模型参数的parameter server(参数服务器节点),还可以指负责控制任务流程的controller(控制节点),当然,角色信息还可以指其他角色的信息,本例实施例对此不作特殊限定。

51.举例而言,完成分布式机器学习任务001,角色信息可以指包含3个计算参数梯度的worker,2个存放模型参数的parameter server,1个控制任务流程的controller,1个评估任务进度的evaluator(任务进度评价节点),且parameter server的带宽消耗较高等信息;当然,角色信息中的角色,每种角色的数量以及资源占用的情况还可以是其他情况,本例实施例对此不作特殊限定。

52.根据分布式机器学习任务,可以确定完成每个分布式机器学习任务所需的角色、每个角色的数量、每种角色占用的资源等角色信息;基于分布式机器学习任务的角色信息,可以初步确定完成该任务所需的物理计算节点类型如cpu计算节点和gpu计算节点,以及物理计算节点的数量,进而调整角色信息中角色的数目,提高物理计算节点之间的通信效率,实现资源利用收益最大化。

53.参考图1,在步骤s120中,确定所述角色信息对应的属性标签以及不同所述角色信

息的所述属性标签之间对应的权重数据。

54.在本公开的一个示例实施例中,属性标签可以指区分不同的角色信息的标签,例如,属性标签可以是表示角色信息特别需要的资源对应的资源需求标签,如参数服务器节点需要较高的带宽,parameter server对应的属性标签可以是“高带宽消耗”,属性标签也可以是角色信息中角色名称对应的英文缩写,如参数服务器-parameter server的缩写ps,属性标签还可以是表示分布式机器学习任务对应的任务编码标签,如分布式机器学习任务001对应的任务编码“id 001”;当然,属性标签还可以是角色信息对应的其他标签,本例实施例对此不作特殊限定。

55.权重数据可以指用于衡量不同角色信息之间的紧密程度的数据,例如,权重数据可以是区分多个角色信息的资源需求标签之间的紧密程度的数据,也可以是区分多个角色信息的任务编码标签之间的紧密程度,当然,权重数据还可以指其他衡量不同角色信息之间的紧密程度的数据,本例实施例对此不作特殊限定。

56.举例而言,分布式机器学习任务001需要3个计算参数梯度的worker,如worker1、worker2、worker3,2个存放模型参数的parameter server,如parameter server1、parameter server2,且worker需要在gpu节点上运行,则worker的资源需求标签为“gpu节点”,parameter server需要较高的带宽,则parameter server的资源需求标签为“高带宽消耗”,分布式机器学习任务001的任务编码标签为“id001”;分布式机器学习任务001中预先配置的文件如下:

57.replicas:2//表示会批量生成2个ps容器

58.labels:

59.role:ps

60.highio:true//表示2个ps容器的资源需求标签为“高带宽消耗”61.instanceid:001//任务编码标签为001

62.affinity://亲和性选项

63.key=“role”,value in“worker”,weight:8

64.//ps与role:worker标签的容器亲和权重数据为8

65.key=“instanceid”,value in“001”,weight:8

66.//ps与instanceid:001标签的容器亲和权重数据为8

67.anti-affinity://反亲和性选项

68.key=“highio”,value in“true”,weight:-100

69.//ps与ps标签的容器亲和权重数据为-100

70.replicas:3//表示会批量生成3个worker容器

71.labels:

72.role:worker

73.instanceid:001

74.affinity:

75.key=“role”,value in“ps”,weight:8

76.//worker与ps标签的容器亲和权重数据为8

77.key=“instanceid”,value in“001”,weight:8

78.//worker与instanceid:001标签的容器亲和权重数据为8

79.根据配置文件可知,worker1与worker2的权重数据为8,worker1与worker3的权重数据为8,worker1与parameter server1的权重数据为8,worker1与parameter server2的权重数据为8,worker2与worker3的权重数据为8,worker2与parameter server1的权重数据为8,worker2与parameter server2的权重数据为8,worker3与parameter server1的权重数据为8,worker3与parameter server2的权重数据为8;parameter server1与parameter server2的权重数据为-100。

80.由于在分布式机器学习任务001中,parameter server具有高带宽消耗的标识,为了缓解物理计算节点的带宽瓶颈,会将两个parameter server部署在不同的物理计算节点上。具体的,根据分布式机器学习任务中不同角色信息或不同角色信息的属性标签之间的权重数据,可以得到多个角色信息之间的紧密程度,进而根据不同角色信息的属性标签的权重数据,合理地分配资源或物理计算节点。

81.参考图1,在步骤s130中,生成运行所述角色信息的角色容器,并根据所述属性标签以及所述权重数据对所述角色容器进行标记。

82.在本公开的一个示例实施例中,角色容器可以指承载角色信息以及与角色信息相关的数据的虚拟容器,例如,角色容器可以指承载参数服务器信息以及与参数服务器信息相关数据的parameter server容器,也可以指承载工作节点信息以及与工作节点相关的数据的worker容器,还可以指承载任务流程控制信息以及与任务流程控制信息相关的数据的controller容器,当然,角色容器还可以指承载其他角色信息以及与角色信息相关的数据的其他角色容器,本例实施例对此不作特殊限定。

83.根据不同的分布式机器学习任务中不同的角色信息,生成与每个角色信息对应的角色容器,基于不同角色信息的属性标签以及不同角色信息的属性标签对应的权重数据,对该角色信息的角色容器进行标记,以根据不同角色信息之间或不同角色信息的属性标签之间的权重数据,将不同的角色容器分配到不同的计算节点,使得资源利用收益最大化。

84.举例而言,分布式机器学习任务001需要3个计算参数梯度的worker,如worker11、worker12、worker13,2个存放模型参数的parameter server,如parameter server11、parameter server12,且worker需要在gpu节点上运行,parameter server需要较高的带宽;根据分布式机器学习任务001中预先配置的文件可知,分布式机器学习任务001生成的角色容器有:worker11容器、worker12容器、worker13容器、parameter server11容器、parameter server12容器;同时,worker11容器、worker12容器、worker13容器的资源需求标签均为“gpu节点”,任务编码标签均为“id001”,worker11容器、worker12容器、worker13容器之间亲和权重数据均为8;此外,parameter server11容器和parameter server12容器的资源需求标签均为“高带宽消耗”,任务编码标签均为“id001”,parameter server11容器和parameter server12容器之间的亲和权重数据均为-100,且parameter server11容器和parameter server12容器与worker11容器、worker12容器、worker13容器之间亲和权重数据均为8。

85.根据分布式机器学习任务中的角色信息生成与角色信息对应的角色容器,即一种角色信息对应一个角色容器;通过不同的角色信息以及不同角色信息的属性标签对应的权重数据,可以有效地分配资源以及将角色容器分配到相应的物理计算节点,缓解物理计算

节点的带宽压力,进而提高计算节点之间的通信效率,最终,实现资源利用收益最大化。

86.参考图1,在步骤s140中,基于所述属性标签以及所述权重数据,将标记后的所述角色容器分配到不同的物理计算节点。

87.在本公开的一个示例实施例中,根据不同角色信息对应的属性标签以及不同角色信息的属性标签对应的权重数据,对基于角色信息生成的角色容器进行标记,并根据不同角色容器的属性标签的权重数据,确定多个角色容器之间的关联程度,进而将关联程度较高的角色容器分配到相同的或相近的物理计算节点上以使资源利用收益最大化。

88.举例而言,根据上个实例中生成的5个角色容器,worker11容器、worker12容器、worker13容器、parameter server11容器、parameter server12容器,以及1个物理计算节点可以存放3个worker容器,由于worker11容器、worker12容器、worker13容器之间具有亲和性,则将worker11容器、worker12容器、worker13容器放在同一个物理计算节点n1上,且物理计算节点n1调度了parameter server1容器;由于parameter server11容器、parameter server12容器与worker11容器、worker12容器、worker13容器之间具有亲和性,且每个parameter server与每个worker容器之间的权重数据均为8,每个worker容器之间的权重数据也均为8,每个parameter server之间具有反亲和性,即亲和权重数据为-100,根据每个worker容器与parameter server容器之间的权重数据之和、每个parameter server容器与每个worker容器之间的权重数据之和、每个parameter server容器与每个parameter server容器之间的权重数据之和,得到5个角色容器的权重数据之和小于0,即parameter server12容器与物理计算节点n1之间不具有亲和性,需要将parameter server12容器存放到除物理计算节点n1之外的物理计算节点上。

89.因此,根据worker11容器、worker12容器、worker13容器、parameter server11容器、parameter server12容器的属性标签以及属性标签对应的权重数据,可以将worker11容器、worker12容器、parameter server11容器放在物理计算节点n1上,将parameter server12容器其他放在物理计算节点上,避免了将高带宽消耗的parameter server11容器和parameter server12容器放在同一个物理计算节点上,导致计算节点出现带宽瓶颈,从而降低parameter server与worker之间的通信效率和机器训练的速度。

90.图2示意性示出了根据本公开的一些实施例的确定不同角色的属性标签的示意图,可以通过图2中的步骤确定不同角色信息的属性标签:

91.参考图2,步骤s210,通过所述角色信息对应的关联信息确定所述角色名称标签;

92.步骤s220,基于所述角色名称标签与所述资源需求标签之间的映射关系,通过所述角色名称标签确定所述角色信息对应的资源需求标签;

93.步骤s230,根据所述分布式机器学习任务确定所述角色信息对应的任务编码标签。

94.其中,关联信息可以指与角色信息相关的信息,例如,关联信息可以是角色信息确定的时间戳,也可以是角色信息更新前后的记录数据信息如该角色信息所占用的资源情况,当然关联信息还可以指其他信息,本例实施例对此不作特殊限定。

95.角色名称标签可以指角色名称的标识信息,例如角色名称标签可以是角色名称,也可以是角色名称对应的英文名称,还可以指角色名称对应的英文缩写,当然,角色名称标签还可以指与角色名称相关的其他标签,本例实施例对此不作特殊限定。

96.具体的,根据分布式机器学习任务对应的配置文件,可以得到角色信息对应的关联信息,进而根据关联信息可以确定角色名称标签,例如,分布式机器学习任务的配置文件中记录了角色信息a的资源需求标签是gpu计算节点,以及该角色的功能是计算参数的梯度,并没有记录角色信息a对应的角色名称,则根据该资源需求标签以及该角色的功能可以判断与该资源需求标签对应的角色名称标签是worker,当然,此处只是举例说明可以根据角色信息的关联信息可以确定角色名称标签,本例实施例对关联信息不作特殊限定。

97.确定角色信息的角色标签后,可以根据角色名称与资源需求标签之间的对应关系,确定角色名称标签对应的资源需求标签。例如,参数服务器-parameter server的角色名称为“ps”,基于分布式机器学习任务的配置文件可以确定角色名称为“ps”的角色信息对应的资源需求为“高带宽”,进而参数服务器-parameter server的资源需求标签为“高带宽”,当然,parameter server还可以对应其他的资源需求标签,本例实施例对此不作特殊限定。同时,在获取分布式机器学习任务的配置文件时,可以得到该分布式机器学习任务对应的编码,进而可以确定该分布式机器学习任务的任务编码标签;根据不同的分布式机器学习任务的任务编码标签,对不同的分布式机器学习任务进行区分,有助于为每个分布式机器学习任务合理地分配资源,实现资源利用收益的最大化。

98.图3示意性示出了根据本公开的一些实施例的确定不同角色信息的属性标签对应的权重数据的示意图,可以通过图3所示的步骤,确定不同角色信息的属性标签对应的权重数据:

99.参考图3所示,步骤s310,获取所述角色信息的权重配置文件;其中,所述权重配置文件包括不同所述角色信息的所述属性标签之间的权重映射关系;

100.步骤s320,根据所述属性标签以及所述权重映射关系确定不同所述角色信息的所述属性标签之间对应的权重数据以通过所述权重数据确定不同所述角色信息之间的关联程度。

101.其中,权重配置文件可以指包含不同角色信息之间的权重映射关系以及不同角色信息的属性标签对应的权重映射关系的文件,当然,权重配置文件还可以包含不同角色信息的其他信息的权重映射关系,本例实施例对此不作特殊限定;根据权重配置文件,可以确定不同的角色信息之间的权重数据,以及不同角色信息的资源需求标签之间的权重数据,进而可以根据不同的角色信息之间的权重数据,以及不同角色信息的资源需求标签之间的权重数据,确定不同的角色信息之间的关联程度,一般地,不同角色信息之间关联程度越高,越需要将多个关联程度较高的角色信息放在同一个计算节点,以减少跨机通信的通信成本,进而,提高不同角色信息之间的通信效率。

102.具体的,根据分布式机器学习任务中的权重配置文件,确定不同角色容器之间亲和性/反亲和性以及权重数据,进而将不同角色容器分配到相应的物理计算节点上,减少同一物理计算节点的带宽瓶颈,实现资源利用收益最大化。

103.图4示意性示出了根据本公开的一些实施例的确定不同角色容器的亲和性或反亲和性的示意图,可以通过图4所示的步骤,确定不同角色容器的亲和性或反亲和性:

104.参考图4所示,步骤s410,将大于第一权重阈值的所述权重数据对应的角色容器作为亲和性角色容器,并将所述亲和性角色容器分配到第一物理计算节点;

105.步骤s420,将小于第二权重阈值的所述权重数据对应的角色容器作为反亲和性角

色容器,并将所述反亲和性角色容器分配到第二物理计算节点。

106.其中,第一权重阈值可以指衡量角色容器之间关联程度的权重值,例如,第一权重阈值可以是0.9,也可以是0.8,当然,第一权重阈值还可以指其他衡量角色容器之间的亲和程度的权重值,本例实施例对此不作特殊限定。

107.亲和性角色容器可以指关联程度较高的角色容器,例如,worker需要在parameter server中获取参数,计算参数的梯度,并将参数的梯度返回给parameter server,即worker与parameter server的关联程度较高,worker容器和parameter server容器互为亲和性角色容器,亲和性角色容器还可以指其他具有亲和性的角色容器,如controller容器和worker容器,本例实施例对此不作特殊限定。

108.当系统检测到多个角色信息之间的权重数据大于第一权重阈值时,可以将这些角色信息对应的容器标记为亲和性角色容器,将亲和性容器分配到同一个计算节点上或多个相近的计算节点上,提高亲和性角色容器对应的节点之间的通信效率。

109.第二权重阈值可以指表示衡量角色容器之间关联程度的权重值,第二权重阈值可以是0.4,也可以是0.3,当然,第二权重阈值还可以指其他衡量角色容器之间的反亲和程度的权重值,本例实施例对此不作特殊限定。

110.反亲和性角色容器可以指关联程度较低的多个角色容器,例如,parameter server为高带宽消耗的角色容器,将多个parameter server容器放在同一个计算节点上,会使得该计算节点出现带宽瓶颈,进而影响同一个计算节点上其他角色容器之间的通信效率,即多个parameter server容器之间都具有反亲和性,多个parameter server容器互为反亲和性角色容器,当然,反亲和性容器还可以指具有反亲和性的其他角色容器,本例实施例对此不作特殊限定。

111.举例而言,分布式机器学习任务001需要3个计算参数梯度的worker,如worker11、worker12、worker13,2个存放模型参数的parameter server,如parameter server11、parameter server12,基于5个不同的角色信息,生成了5个角色容器,即worker11容器、worker12容器、worker13容器、parameter server11容器、parameter server12容器;根据不同角色信息的属性标签以及不同角色信息的属性标签的权重数据,对5个角色容器进行标记,标记后的5个角色容器如下:

112.worker11容器:worker11与worker12的权重数据为67%,worker11与worker13的权重数据为48%,worker11与parameter server11的权重数据为80%,worker11与parameter server12的权重数据为5%。

113.worker12容器:worker12与worker11的权重数据为67%,worker12与worker13的权重数据为42%,worker12与parameter server11的权重数据为70%,worker12与parameter server12的权重数据为3%。

114.worker13容器:worker13与worker11的权重数据为48%,worker13与worker12的权重数据为42%,worker13与parameter server11的权重数据为30%,worker13与parameter server12的权重数据为93%。

115.parameter server11容器:parameter server11与worker11的权重数据为80%,parameter server11与worker12的权重数据为70%,parameter server11与worker13的权重数据为30%,parameter server11与parameter server12的权重数据为1%。

116.parameter server12容器:parameter server12与worker11的权重数据为5%,parameter server12与worker12的权重数据为3%,parameter server12与worker13的权重数据为93%,parameter server12与parameter server11的权重数据为1%。

117.假设第一权重阈值为60%,由于worker11与worker12的权重数据为67%,worker11与parameter server11的权重数据为80%,worker12与parameter server11的权重数据为70%,即worker11与worker12的权重数据、worker11与parameter server11的权重数据、worker12与parameter server11的权重数据均大于第一权重阈值,则worker11容器与worker12容器互为亲和性角色容器、worker11容器与parameter server11容器互为亲和性容器,worker12容器与parameter server11容器互为亲和性角色容器;进而,可以将worker11容器、worker12容器、parameter server11容器放在同一个物理计算节点。同理,若第二权重阈值为40%,由于worker11与parameter server12的权重数据为5%,worker12与parameter server12的权重数据为3%,parameter server11与parameter server12的权重数据为1%,即worker11与parameter server12的权重数据、worker12与parameter server12的权重数据、parameter server11与parameter server12的权重数据均小于第二权重阈值,则worker11容器与parameter server12容器互为反亲和性角色容器,parameter server12容器与worker12容器互为反亲和性容器;进而,需要将parameter server12容器放在与worker11容器、worker12容器不同的物理计算节点上;例如,可以将worker11容器、worker12容器、parameter server11容器放在物理计算节点001中,将parameter server12容器放在物理计算节点002中。

118.此外,权重数据介于第一权重阈值和第二权重阈值的角色容器可以放在亲和性角色容器里也可以放在反亲和性角色容器里,如worker13与worker11的权重数据为48%,worker13与worker12的权重数据为42%,由于worker13与worker11的权重数据、worker13与worker12的权重数据介于第一权重阈值与第二权重阈值之间,可以将worker13容器放在包含worker11容器、worker12容器、parameter server11容器的物理计算节点中,也可以将worker13容器放在包含parameter server12容器的物理计算节点002中。

119.一般而言,将多个亲和性角色容器放在同一个物理计算节点上,将多个反亲和角色容器分别放在不同的物理计算节点上,可有有效地避免单个计算节点的带宽瓶颈,进而提高计算节点中多个角色容器对应的节点之间的通信效率,实现资源利用收益的最大化。

120.优选的,当第一权重阈值和第二权重阈值相等时,例如第一权重阈值和第二权重阈值均为50%时,将角色容器之间的权重数据大于50%的角色容器放在同一个物理计算节点,将角色容器之间的权重数据小于50%的角色容器分开放置到多个相近的物理计算节点上,以缓解单个物理计算节点的带宽负担,从而提高物理计算节点之间的通信效率,实现资源利用收益最大化。

121.图5示意性示出了根据本公开的一些实施例的将不同角色容器分配到不同的计算节点的示意图,可以通过图5所示的步骤,将不同角色容器分配到不同的计算节点:

122.参考图5,步骤s510,确定所述角色名称权重数据、所述资源需求权重数据和所述任务编码权重数据之间的优先级;

123.步骤s520,基于预设的所述角色名称权重数据、所述资源需求权重数据和所述任务编码权重数据之间的优先级,将标记后的所述角色容器分配到不同的物理计算节点。

124.其中,角色名称权重数据可以指多个角色名称之间的权重数据,例如parameter server与worker的权重数据,worker与worker之间的权重数据,parameter server与parameter server的权重数据,当然,角色名称权重数据还可以指其他角色名称之间的权重数据,本例实施例对此不作特殊限定。

125.资源需求权重数据可以指多个角色名称与资源需求标签之间的权重数据,例如,parameter server的资源需求标签为“高带宽消耗”,worker与“高带宽消耗”的权重数据为56%,当然,资源需求标签还可以指其他角色名称与其他角色信息对应的资源需求标签之间的权重数据,本例实施例对此不作特殊限定。

126.任务编码权重数据可以指不同任务编码标签之间的权重数据,例如分布式机器学习中的任务编码标签为001的任务与分布式机器学习中的任务编码标签为011的任务之间的权重数据,当然,任务编码权重数据还可以指其他任务编码标签之间的权重数据,本例实施例对此不作特殊限定。

127.通过所述角色名称权重数据、所述资源需求权重数据和所述任务编码权重数据之间的优先级,可以合理地将同一任务中的多个角色容器分配到相同的或相近的物理计算节点上,减少角色容器之间通信的带宽,也减少同一任务多个角色容器需要跨机通信的成本,进而提高多个角色容器对应到的节点之间的通信效率。

128.举例而言,角色名称权重数据、资源需求权重数据和任务编码权重数据之间的优先级为任务编码权重数据、角色名称权重数据、资源需要权重数据;在分布式机器学习任务中,worker需要在gpu节点上运行,且parameter server需要消耗较高的带宽。

129.分布式机器学习任务001,即任务编码标签为id 001的分布式机器学习任务需要3个计算参数梯度的worker,如worker11、worker12、worker13,以及2个存放模型参数的parameter server,如parameter server11、parameter server12;同时,分布式机器学习任务002,即任务编码标签为id:002的需要2个计算参数梯度的worker,如worker21、worker22,以及1个存放模型参数的parameter server,如parameter server21;在分布式机器学习任务001中,基于5个不同的角色信息,生成了5个角色容器,即worker11容器、worker12容器、worker13容器、parameter server11容器、parameter server12容器;根据不同角色信息的属性标签以及不同角色信息的属性标签的权重数据,对5个角色容器进行标记,标记后的5个角色容器如下:

130.worker11容器:worker11与worker12的权重数据为80%,worker11与worker13的权重数据为48%,worker11与parameter server11的权重数据为67%,worker11与parameter server12的权重数据为5%,worker11与id001的权重数据为80%,worker11与worker21的权重数据为60%,worker11与worker22的权重数据为40%,worker11与parameter server21的权重数据为82%,worker11与id002的权重数据为16%。

131.worker12容器:worker12与worker11的权重数据为80%,worker12与worker13的权重数据为42%,worker12与parameter server11的权重数据为70%,worker12与parameter server12的权重数据为3%,worker12与id001的权重数据为78%,worker12与worker21的权重数据为66%,worker12与worker22的权重数据为34%,worker12与parameter server21的权重数据为87%,worker12与id002的权重数据为40%。

132.worker13容器:worker13与worker11的权重数据为48%,worker13与worker12的

权重数据为42%,worker13与parameter server11的权重数据为70%,worker13与parameter server12的权重数据为93%,worker13与id001的权重数据为88%,worker13与worker21的权重数据为59%,worker13与worker22的权重数据为59%,worker13与parameter server21的权重数据为54%,worker13与id 002的权重数据为70%。

133.parameter server11容器:parameter server11与worker11的权重数据为67%,parameter server11与worker12的权重数据为70%,parameter server11与parameter server12的权重数据为1%,parameter server11与id001的权重数据为80%,parameter server11与worker21的权重数据为66%,parameter server11与worker22的权重数据为34%,parameter server11与parameter server21的权重数据为57%,parameter server11与id 002的权重数据为2%。

134.parameter server12容器:parameter server12与worker11的权重数据为5%,parameter server12与worker12的权重数据为3%,parameter server12与worker13的权重数据为93%,parameter server12与parameter server11的权重数据为1%,parameter server12与id001的权重数据为65%,parameter server12与worker21的权重数据为66%,parameter server12与worker22的权重数据为67%,parameter server12与parameter server21的权重数据为17%,parameter server12与id 002的权重数据为52%。

135.在分布式机器学习任务002中,基于3个不同的角色信息,生成了3个角色容器,即worker21容器、worker22容器、parameter server21容器;根据不同角色信息的属性标签以及不同角色信息的属性标签的权重数据,对3个角色容器进行标记,标记后的3个角色容器如下:

136.worker21容器:worker21与worker11的权重数据为60%,worker21与worker12的权重数据为66%,worker21与worker13的权重数据为59%,worker21与worker22的权重数据为43%,worker21与parameter server21的权重数据为47%,worker21与id 001的权重数据为64%,worker21与id 002的权重数据为91%。

137.worker22容器:worker22与worker11的权重数据为40%,worker22与worker12的权重数据为34%,worker22与worker13的权重数据为59%,worker22与worker21的权重数据为43%,worker22与parameter server21的权重数据为7%,worker12与id 001的权重数据为23%,worker22与id 002的权重数据为64%。

138.parameter server21容器:parameter server21与worker11的权重数据为82%,parameter server21与worker12的权重数据为87%,parameter server21与worker13的权重数据为54%,parameter server21与parameter server11的权重数据为57%,parameter server21与parameter server12的权重数据为17%,parameter server21与worker21的权重数据为47%,parameter server21与worker22的权重数据为7%,parameter server21与id 001的权重数据为8%,parameter server21与id002的权重数据为70%。

139.若任务编码权重数据的第一权重阈值为50%,第二权重阈值也为50%,在分布式机器学习任务001中,大于第一权重阈值的角色容器有:worker11容器、worker12容器、worker13容器、parameter server11容器、parameter server12容器、worker21容器;在分布式机器学习任务002中,大于第一权重阈值的角色容器有:worker13容器、parameter server12容器、worker21容器、worker22容器、parameter server21容器。

140.接着,在根据任务编码权重数据对角色容器进行编排后,若角色名称权重数据的第一权重阈值为50%,在分布式机器学习任务001中,大于第一权重阈值的角色容器有:worker11容器、worker12容器、parameter server11容器、worker21容器;分布式机器学习任务002中,大于第一权重阈值的角色容器有:worker13容器、parameter server12容器、worker22容器、parameter server21容器。

141.由于根据任务编码权重数据、角色名称权重数据的优先级顺序,可以清楚地将不同任务的不同角色容器分配到相应的物理计算节点上;即根据上述实例,可以将worker11容器、worker12容器、parameter server11容器、worker21容器分配到一个物理计算节点上,可以将worker13容器、parameter server12容器、worker22容器、parameter server21容器分配到另一个物理计算节点上,其中分配到worker11容器、worker12容器、parameter server11容器、worker21容器的物理计算节点与分配到worker13容器、parameter server12容器、worker22容器、parameter server21容器的物理计算节点之间的地理位置可以较近,以减少跨机通信的成本,也减少单个计算节点的通信带宽压力,进而提高计算节点的通信效率,也实现资源利用收益的最大化。

142.图6示意性示出了根据本公开的一些实施例的对不同计算特性的角色信息对应的角色容器分配相应的计算节点的示意图,可以通过图6所示的步骤,实现对不同计算特性的角色信息对应的角色容器分配相应的计算节点:

143.参考图6,步骤s610,确定所述角色信息对应的计算特性;

144.步骤s620,根据所述计算特性确定所述角色信息对应的角色容器的待分配物理计算节点

145.其中,计算特性可以指衡量角色信息所需要的计算资源大小的数据,例如,用于计算参数梯度的worker需要较大的计算资源,需要为worker容器分配包含计算资源较大的物理计算节点如包含较强计算能力的gpu的物理计算节点,同时,parameter server容器需要向worker容器传递较多的参数,可以将parameter server容器分配到包含计算能力的cpu的物理节点中,controller容器的计算特性一般,可以为controller容器分配包含计算能力的cpu的物理计算节点,当然,也可以为parameter server容器分配包含计算能力较强的gpu的物理计算节点,当然,计算特性还可以指其他的角色容器对应的计算能力的特性,本例实施例对此不作特殊限定。

146.综上所述,可以将worker容器分配到包含gpu的物理计算节点,若还有闲置的包含gpu的物理计算节点,可以将parameter server容器分配到包含gpu的物理计算节点,将其他角色容器统一分配到包含cpu的物理计算节点,通过这种优化后的容器分配技术,分布式机器学习模型训练的性能可以提升约40%,同时还能节省出宝贵的包含gpu的计算节点资源,从而获取降本增效的成果。

147.图7示意性示出了根据本公开的一些实施例的对目标角色信息进行调整的示意图,可以在获取分布式机器学习任务,确定所述分布式机器学习任务中的角色信息之前,根据图7中的步骤对目标角色信息进行调整:

148.参考图7,步骤s710,确定不同角色信息之间的数量关系;

149.步骤s720,根据不同的所述角色信息之间的数量关系,添加目标数量个所述资源需求标签中属于高资源消耗的目标角色信息。

150.在本公开的一个示例实施例中,目标角色信息可以指需要调整的角色信息,例如,分布式机器学习任务001中,需要3个worker,而只有1个parameter server,但一个计算节点不能完全地承载3个worker,需要增加一个计算节点,则需要调整的角色信息为parameter server,即需要增加1个parameter server的数量,即目标角色信息为高带宽消耗的parameter server,当然,本例实施例中,目标角色信息还可以是其他角色信息,目标数量也可以是其他数量,本例实施例对此不作特殊限定。

151.需要说明的是,尽管在附图中以特定顺序描述了本公开中方法的各个步骤,但是,这并非要求或者暗示必须按照该特定顺序来执行这些步骤,或是必须执行全部所示的步骤才能实现期望的结果。附加的或备选的,可以省略某些步骤,将多个步骤合并为一个步骤执行,以及/或者将一个步骤分解为多个步骤执行等。

152.此外,在本示例实施例中,还提供了一种容器分配装置。参照图8所示,该容器分配装置800包括:角色信息确定模块810、属性标签确定模块820、角色容器标记模块830、角色容器分配模块840;其中:角色信息确定模块810,用于获取分布式机器学习任务,确定所述分布式机器学习任务中的角色信息;属性标签确定模块820,用于确定所述角色信息对应的属性标签以及不同所述角色信息的所述属性标签之间对应的权重数据;角色容器生成模块830,用于生成运行所述角色信息的角色容器,并根据所述属性标签以及所述权重数据对所述角色容器进行标记;角色容器分配模块840,用于基于所述属性标签以及所述权重数据,将标记后的所述角色容器分配到不同的物理计算节点。

153.在本公开的一种示例性实施例中,基于前述方案,所述属性标签确定模块820还包括属性标签确定单元,所述属性标签确定单元被配置为:通过所述角色信息对应的关联信息确定所述角色名称标签;基于所述角色名称标签与所述资源需求标签之间的映射关系,通过所述角色名称标签确定所述角色信息对应的资源需求标签;以及根据所述分布式机器学习任务确定所述角色信息对应的任务编码标签。

154.在本公开的一种示例性实施例中,基于前述方案,所述属性标签确定单元还被配置为:获取所述角色信息的权重配置文件;其中,所述权重配置文件包括不同所述角色信息的所述属性标签之间的权重映射关系;根据所述属性标签以及所述权重映射关系确定不同所述角色信息的所述属性标签之间对应的权重数据以通过所述权重数据确定不同所述角色信息之间的关联程度。

155.在本公开的一种示例性实施例中,基于前述方案,所述角色容器分配模块840还包括角色容器分配单元,所述角色容器分配单元被配置为:将大于第一权重阈值的所述权重数据对应的角色容器作为亲和性角色容器,并将所述亲和性角色容器分配到第一物理计算节点;将小于第二权重阈值的所述权重数据对应的角色容器作为反亲和性角色容器,并将所述反亲和性角色容器分配到第二物理计算节点。

156.在本公开的一种示例性实施例中,基于前述方案,所述角色容器分配单元还被配置为:基于预设的所述角色名称权重数据、所述资源需求权重数据和所述任务编码权重数据之间的优先级,将标记后的所述角色容器分配到不同的物理计算节点。

157.在本公开的一种示例性实施例中,基于前述方案,所述容器分配装置800,还包括计算特性确定单元,所述计算特性确定单元被配置为:确定所述角色信息对应的计算特性;根据所述计算特性确定所述角色信息对应的角色容器的待分配物理计算节点。

158.在本公开的一种示例性实施例中,基于前述方案,所述容器分配装置800还包括目标角色信息添加单元,所述目标角色信息添加单元被配置为:根据不同的所述角色信息之间的数量关系,添加目标数量个所述资源需求标签中属于高资源消耗的目标角色信息。

159.上述中容器分配装置各模块的具体细节已经在对应的容器分配方法中进行了详细的描述,因此此处不再赘述。

160.应当注意,尽管在上文详细描述中提及了容器分配装置的若干模块或者单元,但是这种划分并非强制性的。实际上,根据本公开的实施方式,上文描述的两个或更多模块或者单元的特征和功能可以在一个模块或者单元中具体化。反之,上文描述的一个模块或者单元的特征和功能可以进一步划分为由多个模块或者单元来具体化。

161.此外,在本公开的示例性实施例中,还提供了一种能够实现上述容器分配方法的电子设备。

162.所属技术领域的技术人员能够理解,本公开的各个方面可以实现为系统、方法或程序产品。因此,本公开的各个方面可以具体实现为以下形式,即:完全的硬件实施例、完全的软件实施例(包括固件、微代码等),或硬件和软件方面结合的实施例,这里可以统称为“电路”、“模块”或“系统”。

163.下面参照图9来描述根据本公开的这种实施例的电子设备900。图9所示的电子设备900仅仅是一个示例,不应对本公开实施例的功能和使用范围带来任何限制。

164.如图9所示,电子设备900以通用计算设备的形式表现。电子设备900的组件可以包括但不限于:上述至少一个处理单元910、上述至少一个存储单元920、连接不同系统组件(包括存储单元920和处理单元910)的总线930、显示单元940。

165.其中,所述存储单元存储有程序代码,所述程序代码可以被所述处理单元910执行,使得所述处理单元910执行本说明书上述“示例性方法”部分中描述的根据本公开各种示例性实施例的步骤。例如,所述处理单元910可以执行如图1中所示的步骤s110,获取分布式机器学习任务,确定所述分布式机器学习任务中的角色信息;步骤s120,确定所述角色信息对应的属性标签以及不同所述角色信息的所述属性标签之间对应的权重数据;步骤s130,生成运行所述角色信息的角色容器,并根据所述属性标签以及所述权重数据对所述角色容器进行标记;步骤s140,基于所述属性标签以及所述权重数据,将标记后的所述角色容器分配到不同的物理计算节点。

166.存储单元920可以包括易失性存储单元形式的可读介质,例如随机存取存储单元(ram)921和/或高速缓存存储单元922,还可以进一步包括只读存储单元(rom)923。

167.存储单元920还可以包括具有一组(至少一个)程序模块925的程序/实用工具924,这样的程序模块925包括但不限于:操作系统、一个或者多个应用程序、其它程序模块以及程序数据,这些示例中的每一个或某种组合中可能包括网络环境的实现。

168.总线930可以为表示几类总线结构中的一种或多种,包括存储单元总线或者存储单元控制器、外围总线、图形加速端口、处理单元或者使用多种总线结构中的任意总线结构的局域总线。

169.电子设备900也可以与一个或多个外部设备970(例如键盘、指向设备、蓝牙设备等)通信,还可与一个或者多个使得用户能与该电子设备900交互的设备通信,和/或与使得该电子设备900能与一个或多个其它计算设备进行通信的任何设备(例如路由器、调制解调

器等等)通信。这种通信可以通过输入/输出(i/o)接口950进行。并且,电子设备900还可以通过网络适配器960与一个或者多个网络(例如局域网(lan),广域网(wan)和/或公共网络,例如因特网)通信。如图所示,网络适配器960通过总线930与电子设备900的其它模块通信。应当明白,尽管图中未示出,可以结合电子设备900使用其它硬件和/或软件模块,包括但不限于:微代码、设备驱动器、冗余处理单元、外部磁盘驱动阵列、raid系统、磁带驱动器以及数据备份存储系统等。

170.通过以上的实施例的描述,本领域的技术人员易于理解,这里描述的示例实施例可以通过软件实现,也可以通过软件结合必要的硬件的方式来实现。因此,根据本公开实施例的技术方案可以以软件产品的形式体现出来,该软件产品可以存储在一个非易失性存储介质(可以是cd-rom,u盘,移动硬盘等)中或网络上,包括若干指令以使得一台计算设备(可以是个人计算机、服务器、终端装置、或者网络设备等)执行根据本公开实施例的方法。

171.在本公开的示例性实施例中,还提供了一种计算机可读存储介质,其上存储有能够实现本说明书上述方法的程序产品。在一些可能的实施例中,本公开的各个方面还可以实现为一种程序产品的形式,其包括程序代码,当所述程序产品在终端设备上运行时,所述程序代码用于使所述终端设备执行本说明书上述“示例性方法”部分中描述的根据本公开各种示例性实施例的步骤。

172.参考图10所示,描述了根据本公开的实施例的用于实现上述容器分配方法的程序产品1000,其可以采用便携式紧凑盘只读存储器(cd-rom)并包括程序代码,并可以在终端设备,例如个人电脑上运行。然而,本公开的程序产品不限于此,在本文件中,可读存储介质可以是任何包含或存储程序的有形介质,该程序可以被指令执行系统、装置或者器件使用或者与其结合使用。

173.所述程序产品可以采用一个或多个可读介质的任意组合。可读介质可以是可读信号介质或者可读存储介质。可读存储介质例如可以为但不限于电、磁、光、电磁、红外线、或半导体的系统、装置或器件,或者任意以上的组合。可读存储介质的更具体的例子(非穷举的列表)包括:具有一个或多个导线的电连接、便携式盘、硬盘、随机存取存储器(ram)、只读存储器(rom)、可擦式可编程只读存储器(eprom或闪存)、光纤、便携式紧凑盘只读存储器(cd-rom)、光存储器件、磁存储器件、或者上述的任意合适的组合。

174.计算机可读信号介质可以包括在基带中或者作为载波一部分传播的数据信号,其中承载了可读程序代码。这种传播的数据信号可以采用多种形式,包括但不限于电磁信号、光信号或上述的任意合适的组合。可读信号介质还可以是可读存储介质以外的任何可读介质,该可读介质可以发送、传播或者传输用于由指令执行系统、装置或者器件使用或者与其结合使用的程序。

175.可读介质上包含的程序代码可以用任何适当的介质传输,包括但不限于无线、有线、光缆、rf等等,或者上述的任意合适的组合。

176.可以以一种或多种程序设计语言的任意组合来编写用于执行本公开操作的程序代码,所述程序设计语言包括面向对象的程序设计语言—诸如java、c 等,还包括常规的过程式程序设计语言—诸如“c”语言或类似的程序设计语言。程序代码可以完全地在用户计算设备上执行、部分地在用户设备上执行、作为一个独立的软件包执行、部分在用户计算设备上部分在远程计算设备上执行、或者完全在远程计算设备或服务器上执行。在涉及远

程计算设备的情形中,远程计算设备可以通过任意种类的网络,包括局域网(lan)或广域网(wan),连接到用户计算设备,或者,可以连接到外部计算设备(例如利用因特网服务提供商来通过因特网连接)。

177.此外,上述附图仅是根据本公开示例性实施例的方法所包括的处理的示意性说明,而不是限制目的。易于理解,上述附图所示的处理并不表明或限制这些处理的时间顺序。另外,也易于理解,这些处理可以是例如在多个模块中同步或异步执行的。

178.通过以上的实施例的描述,本领域的技术人员易于理解,这里描述的示例实施例可以通过软件实现,也可以通过软件结合必要的硬件的方式来实现。因此,根据本公开实施例的技术方案可以以软件产品的形式体现出来,该软件产品可以存储在一个非易失性存储介质(可以是cd-rom,u盘,移动硬盘等)中或网络上,包括若干指令以使得一台计算设备(可以是个人计算机、服务器、触控终端、或者网络设备等)执行根据本公开实施例的方法。

179.本领域技术人员在考虑说明书及实践这里公开的发明后,将容易想到本公开的其它实施例。本技术旨在涵盖本公开的任何变型、用途或者适应性变化,这些变型、用途或者适应性变化遵循本公开的一般性原理并包括本公开未公开的本技术领域中的公知常识或惯用技术手段。说明书和实施例仅被视为示例性的,本公开的真正范围和精神由权利要求指出。

180.应当理解的是,本公开并不局限于上面已经描述并在附图中示出的精确结构,并且可以在不脱离其范围进行各种修改和改变。本公开的范围仅由所附的权利要求来限制。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。