1.本发明涉及表格检索技术领域,具体涉及一种基于深度学习的表格检索方法。

背景技术:

2.信息技术的发展不断推动着互联网技术的变革,数据表格和知识图谱是当前结构化知识库的常用储存形式,因此,如何快速检索表格中与查询最相关的信息对于智能搜索、问答等任务有重要意义,同时提升用户工作效率,改善体验。

3.当前很多的表格的检索系统对表格内容信息都采用了深度学习的神经网络结构,如bilstm、bert等,但未利用到针对于表格所特有的统计特征,降低表征向量的表征能力,并且对于复杂的难样本的检索效果水平还是较低。

技术实现要素:

4.本发明的目的是针对现有技术存在的不足,提供一种基于深度学习的表格检索方法。

5.为实现上述目的,本发明提供了一种基于深度学习的表格检索方法,包括:步骤1、接收用户输入的查询语句q,加载数据库中所有表格t的行、列以及单元格的语料库集合,每个特征信息是表格的一行、一列或者单元格内容组成的列表集,1≤i≤m;同时载入数据库中所有表的背景信息,其中,一张表格包含行、列、单元格信息特征,,n≤m,所述表格的背景信息为,j≤k;步骤2、对于每张表格的信息特征进行统计特征提取,每个信息特征生成一个统计特征向量a,将a放入多层感知机中,计算出,具体如下:其中,为多层感知机的参数,为偏置参数;步骤3、将用户查询语句q、表格的背景信息集合和单个特征信息连接,并用[sep]间隔开形成拼接向量i,所述拼接向量i的格式如下:其中,是拼接向量i起始占位符;将所述拼接向量i当作输入,放入已经训练好的roberta模型中;步骤4、取roberta模型最后一层输出的[cls]向量与感知机输出 拼接成包含相似度信息的特征向量o,具体如下:

步骤5、将包含相似度信息的特征向量o通过一个全连接线性层回归函数计算相似度得分,具体如下:其中,,r为常数,d为的维度,h为roberta隐含层的维度;以相似度得分排名最高的若干个表格作为检索结果输出。

[0006]

进一步的,所述统计特征包括与查询语句q相同字个数、相同词个数、最大公共子字串、表中行标题是否存在和表中列标题是否存在。

[0007]

进一步的,所述roberta模型通过以下方式训练获得:步骤101、对于正样本,收集用户的查询语句集合q、每个查询语句q相匹配单张表格的背景信息集合、与查询语句q匹配的表格特征信息以及与查询语句q相匹配表格的信息特征,查询语句q∈q,标注相似度分数,作为正样本data

‑

p;对于负样本,在生成正样本的基础上,用bm25获得与查询语句q非正确匹配但相似程度排前5名的表格的背景信息集合、表格特征信息和信息特征组成的负例数据样本data

‑

n,标注,把data

‑

p和data

‑

n合在一起生成所有样本数据data,并拆分成训练集、验证集、测试集;采用bm25算法计算语料库集合f中的每一个特征信息与查询语句q的相似程度,并根据相似程度进行排序,以从语料库集合f中找出与查询语句q最相似的若干个知识内容,所述相似程度的计算方式如下:其中,为表格内容,其为特征信息列表中的一个元素,为查询语句q中词的个数,e为词在查询语句q中的排列序号,为查询语句q中第e个词,为第e个词的权重,其计算方式如下:其中,n表示特征信息列表中的所有元素的个数,表示特征信息列表中包含词汇的元素的个数;为第e个词与表格内容的相关性分数,其计算方式如下:的相关性分数,其计算方式如下:其中,、和分别为调协因子,表示查询语句q中的词汇在特征信息列表中出现的次数;表示词汇在查询语句q中出现的次数,为表格内容的长度,为特征信息列表中所有表格内容的平均长度。

[0008]

步骤102、对于所述训练集中的所有训练样本,执行步骤3和步骤4得到包含相似度信息的特征向量o。

[0009]

步骤103、将包含相似度信息的特征向量o通过一个全连接线性层回归函数计算最后相似度得分,通过多次训练迭代,使得计算输出的相似度得分与训练数据的标签误差减小至设定阈值范围内后,将训练好模型保存。

[0010]

进一步的,还包括:步骤104、训练样本依次经过步骤1至5后得到相似度得分排名最高的若干个表格,以及得到对应背景信息集合、特征信息以及信息特征,剔除计算出的相似度分数的数据样本,得到新的负样本,并将新的负样本与所述正样本建立新的训练集,并以新的训练集中的训练样本进行二次训练过程,然后保存二次训练后的模型。

[0011]

5、根据权利要求3所述的基于深度学习的表格检索方法,其特征在于,所述的取值为2,所述的取值为1,所述的取值为0.75。

[0012]

有益效果:本发明采用了比bert效果更好的roberta预训练模型,并在原有深度学习模型基础上加入了统计特征进行特征融合,使得相似度的计算时候利用了统计层面上相似度信息,具有全面性和准确性;同时在训练的时候,采用了bm25与增加难负例训练相结合的训练方法,让训练出来的模型对于易出错样本有更强的适应能力,提升了模型精度。

附图说明

[0013]

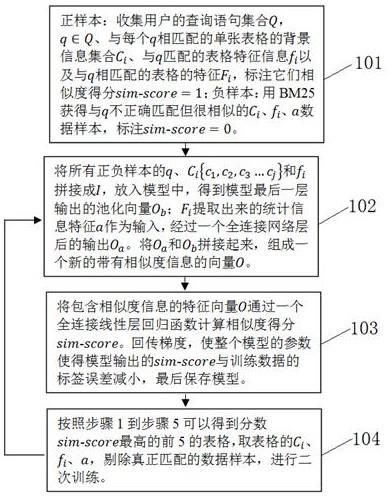

图1是本发明实施例的基于深度学习的表格检索方法的流程示意图;图2是本发明实施例的roberta模型的训练方法流程示意图。

具体实施方式

[0014]

下面结合附图和具体实施例,进一步阐明本发明,本实施例在以本发明技术方案为前提下进行实施,应理解这些实施例仅用于说明本发明而不用于限制本发明的范围。

[0015]

如图1所示,本发明实施例提供了一种基于深度学习的表格检索方法,包括:步骤1、接收用户输入的查询语句q,加载数据库中所有表格t的行、列以及单元格的语料库集合 ,每个特征信息是表格的一行、一列或者单元格内容组成的列表集,i、m均为自然数,m>3,且1≤i≤m;同时载入数据库中所有表的背景信息,其中,一张表格包含行、列、单元格信息特征,,,所述表格的背景信息(例如表格上下级标题)为,j、k也均为自然数,j≤k。

[0016]

步骤2、对于每张表格的信息特征进行统计特征提取,该统计特征包括与查询语句q相同字个数、相同词个数、最大公共子字串、表中行标题是否存在和表中列标题是否存在等。每个信息特征生成一个统计特征向量a,将a放入多层感知机中,计算出,具体如下:

其中,为多层感知机的参数,可通过训练获得,为偏置参数。

[0017]

步骤3、将用户查询语句q、表格的背景信息集合和单个特征信息连接,并用[sep]间隔开形成拼接向量i,所述拼接向量i的格式如下:其中,是拼接向量i起始占位符;将拼接向量i当作输入,放入已经训练好的roberta (a robustly optimized bert)模型中。roberta模型是华盛顿大学yinhan liu在2019年提出的一种预训练遮面语言模型,它是google提出的bert(bidirectional encoder representations from transformers)模型的改进版本,用更大的160g的训练文本,改进原有的静态遮面,采用随机的动态遮面减小了随机遮面可能带来的分布误差。同时取消了对下游任务没有提升的预测两句话是否连续的预训练任务,提升了整个模型的效果。

[0018]

步骤4、取roberta模型最后一层输出的[cls]向量与感知机输出 拼接成包含相似度信息的特征向量o,具体如下:步骤5、将包含相似度信息的特征向量o通过一个全连接线性层回归函数计算相似度得分,具体如下:其中,,r为常数,d为的维度,h为roberta隐含层的维度;以相似度得分排名最高的若干个表格作为检索结果输出。一般可设置为取相似度得分排名最高的5个表格作为检索结果输出。

[0019]

参见图2,本发明实施例的roberta模型通过以下方式训练获得:步骤101、对于正样本,收集用户的查询语句集合q、每个查询语句q相匹配单张表格的背景信息集合、与查询语句q匹配的表格特征信息以及与查询语句q相匹配表格的信息特征,查询语句q∈q,标注相似度分数,作为正样本data

‑

p;对于负样本,在生成正样本的基础上,用bm25获得与查询语句q非正确匹配但相似程度排前5名的表格的背景信息集合、表格特征信息和信息特征组成的负例数据样本data

‑

n,标注,把data

‑

p和data

‑

n合在一起生成所有样本数据data,并拆分成训练集、验证集、测试集。

[0020]

采用bm25算法计算语料库集合f中的每一个特征信息与查询语句q的相似程度,并根据相似程度进行排序,以从语料库集合f中找出与查询语句q最相似的若干个知识内容,相似程度的计算方式如下:

其中,为表格内容,其为特征信息列表中的一个元素,为查询语句q中词的个数,e为词在查询语句q中的排列序号,为查询语句q中第e个词,为第e个词的权重,其计算方式如下:其中,n表示特征信息列表中的所有元素的个数,表示特征信息列表中包含词汇的元素的个数;为第e个词与表格内容的相关性分数,其计算方式如下:的相关性分数,其计算方式如下:其中,、和分别为调协因子,一般情况下,可将的取值为2,的取值为1,的取值为0.75;表示查询语句q中的词汇在特征信息列表中出现的次数;表示词汇在查询语句q中出现的次数,为表格内容的长度,为特征信息列表中所有表格内容的平均长度;步骤102、对于所述训练集中的所有训练样本,执行步骤3和步骤4得到包含相似度信息的特征向量o;步骤103、将包含相似度信息的特征向量o通过一个全连接线性层回归函数计算最后相似度得分,通过多次训练迭代(如迭代1000次),使得计算输出的相似度得分与训练数据的标签误差减小至设定阈值范围内后,将训练好模型保存。

[0021]

本发明还包括:步骤104、训练样本依次经过步骤1至5后得到相似度得分排名最高的若干个表格,以及得到对应背景信息集合、特征信息以及信息特征,剔除计算出的相似度分数的数据样本,得到新的负样本,并将新的负样本与所述正样本建立新的训练集,并以新的训练集中的训练样本进行二次训练过程,然后保存二次训练后的模型。经过二次训练后,可大大增加模型对易错样本的判别能力。

[0022]

通过本发明提供的方法,在表格检索时,通常满足查询内容的表格有行包含、列包含、单元格包含三种形式,以下通过三个问题及其对应检索出的表格进行示意:查询问题:汽车的牌子(a)数据表格的行中包含查询的信息

查询问题:2008北京奥运会(b)数据表格的列中包含查询的信息查询问题:篮球运动员姚明(c)数据表格的单元格中包含查询的信息。

[0023]

以上所述仅是本发明的优选实施方式,应当指出,对于本技术领域的普通技术人员来说,其它未具体描述的部分,属于现有技术或公知常识。在不脱离本发明原理的前提下,还可以做出若干改进和润饰,这些改进和润饰也应视为本发明的保护范围。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。