1.本技术涉及图像处理技术领域,特别涉及一种视线方向的检测方法、装置及其检测系统及可读存储介质。

背景技术:

2.目前的摄像头只能拍摄整个监控画面,不能实现对人眼的视线进行仔细地追踪,即不能实现对人眼的视线方向的检测。尤其是在多人的复杂监控场景中,例如学生的注意力监控,防作弊监控等场景,不能实现对多人的视线方向的检测。

技术实现要素:

3.有鉴于此,本发明旨在至少在一定程度上解决相关技术中的问题之一。为此,本技术的目的在于提供一种视线方向的检测方法、装置及其检测系统及可读存储介质。

4.本技术实施方式提供一种视线方向的检测方法。所述检测方法包括:获取热成像摄像头采集的红外热成像图像;在所述红外热成像图像存在目标人脸的情况下,定位目标人脸区域;确定所述目标人脸区域中的眼部位置;控制目标摄像头对所述眼部位置进行聚焦拍摄以获得可见光双眼图像;利用视线检测模型对所述可见光双眼图像进行处理得到所述目标人脸的视线落点方向。

5.在某些实施方式中,所述定位目标人脸区域包括:根据所述红外热成像图像中的不同颜色区域初步确定目标检测区域;根据所述目标检测区域对应的颜色信息和温度信息区分所述目标检测区域中的人脸区域和非人脸区域;根据所述人脸区域在所述红外热成像图像中的位置对应定位一个或多个所述目标人脸区域。

6.在某些实施方式中,所述确定所述目标人脸区域中的眼部位置包括:根据人脸位置特性对所述红外热成像图像中的一个或多个所述目标人脸进行图像切割得到一个或多个所述目标人脸中的眼部位置;根据所述眼部位置拟合算法计算所述一个或多个所述目标人脸中的眼部位置。

7.在某些实施方式中,所述控制目标摄像头对所述眼部位置进行聚焦拍摄以获得可见光双眼图像包括:根据所述眼部位置确定所述目标摄像头;控制所述目标摄像头将视野范围缩放至所述眼部位置相应的视野范围;在所述摄像头缩放至预设视野范围之后,控制所述摄像头进行自动聚焦拍摄,以得到所述可见光双眼图像。

8.在某些实施方式中,所述利用视线检测模型对所述可见光双眼图像进行处理得到所述目标人脸的视线落点方向包括:将所述可见光双眼图像输入至所述视线检测模型中,输出所述目标人脸的面部角度和所述目标人脸中人眼的视线落点角度;根据所述目标人脸的面部角度、所述目标人脸中人眼的视线落点角度及所述目标人脸与所述摄像头的相对位置计算所述目标人脸的视线落点方向。

9.在某些实施方式中,检测方法包括:创建多个被测试者由不同面部角度看向空间中多个目标位置点的多个眼部图像构成的数据库;对所述数据库中的多个所述眼部图像进

行图像预处理;基于深度残差网络和深度卷积神经网络建立深度学习模型;利用预处理后的多个所述眼部图像对所述深度学习模型进行训练,以得到所述视线检测模型。

10.在某些实施方式中,所述创建多个被测试者由不同面部角度看向空间中多个目标位置点的多个眼部图像构成的数据库包括:记录所述被测试者的面部角度及对应的视线看向的位置,以面部为基准计算所述被测试者的视线落点角度;将所述视线落点角度和所述面部角度共同作为所述眼部图像的图像标签得到所述数据库。

11.本技术还提供一种视线方向的检测装置。所述检测装置包括:热成像模块、定位模块、确定模块、可见光图像获取模块和视线方向获取模块。所述热成像模块用于采集红外热成像图像;所述定位模块用于在所述红外热成像图像存在目标人脸的情况下,定位目标人脸区域;所述确定模块用于确定所述目标人脸区域中的眼部位置;所述可见光图像获取模块用于对所述眼部位置进行聚焦拍摄以获得可见光双眼图像;所述视线方向获取模块用于利用视线检测模型对所述可见光双眼图像进行处理得到所述目标人脸的视线落点方向。

12.本技术还提供一种视线方向的检测系统。所述检测系统包括处理器和存储器,所述存储器用于存储计算机程序,所述处理器在执行所述计算机程序时实现上述实施方式中任一项所述的检测方法。

13.本技术还提供一种计算机程序的非易失性计算机可读存储介质。当所述计算机程序被一个或多个处理器执行时,实现上述实施方式中任一项所述的检测方法。

14.本技术的视线方向的检测方法可以实现人眼视线方向的检测,也可以实现多人在某个空间范围内的视线方向检测,从而解决复杂需求场景的视线方向监测需求,复杂需求场景例如包括学生的注意力监控,防作弊监控等场景。

15.本技术的附加方面和优点将在下面的描述中部分给出,部分将从下面的描述中变得明显,或通过本技术的实践了解到。

附图说明

16.本技术上述的和/或附加的方面和优点从下面结合附图对实施例的描述中将变得明显和容易理解,其中:

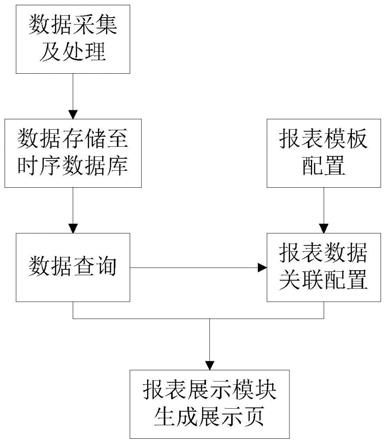

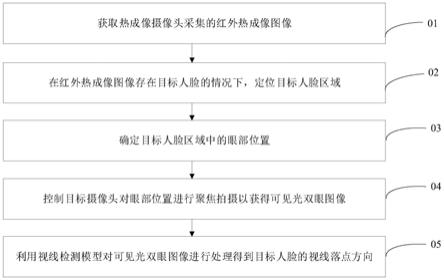

17.图1是本技术某些实施方式的视线方向的检测方法的流程示意图;

18.图2是本技术某些实施方式的视线方向的检测装置的结构示意图;

19.图3是本技术某些实施方式的视线方向的检测方法的场景示意图;

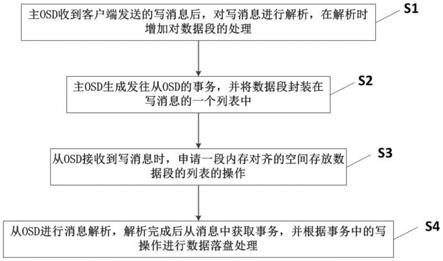

20.图4是本技术某些实施方式的视线方向的检测方法的流程示意图;

21.图5是本技术某些实施方式的视线方向的检测装置中定位模块的结构示意图;

22.图6是本技术某些实施方式的视线方向的检测方法的场景示意图;

23.图7是本技术某些实施方式的视线方向的检测方法的流程示意图;

24.图8是本技术某些实施方式的视线方向的检测装置中眼部位置确定模块的结构示意图;

25.图9是本技术某些实施方式的视线方向的检测方法的流程示意图;

26.图10是本技术某些实施方式的视线方向的检测装置中可见光图像获取模块的结构示意图;

27.图11是本技术某些实施方式的视线方向的检测方法的场景示意图;

28.图12是本技术某些实施方式的视线方向的检测方法的场景示意图;

29.图13是本技术某些实施方式的视线方向的检测方法的流程示意图;

30.图14是本技术某些实施方式的视线方向的检测装置中视线方向获取模块的结构示意图;

31.图15是本技术某些实施方式的视线方向的检测方法的场景示意图;

32.图16是本技术某些实施方式的视线方向的检测方法的场景示意图;

33.图17是本技术某些实施方式的视线方向的检测方法的流程示意图;

34.图18是本技术某些实施方式的视线方向的检测装置的结构示意图;

35.图19是本技术某些实施方式的视线方向的检测方法的流程示意图;

36.图20是本技术某些实施方式的视线方向的检测方法的流程示意图;

37.图21是本技术某些实施方式的视线方向的检测系统的结构示意图;

38.图22是本技术某些实施方式的计算机可读存储介质的结构示意图。

具体实施方式

39.下面详细描述本技术的实施方式,所述实施方式的示例在附图中示出,其中自始至终相同或类似的标号表示相同或类似的元件或具有相同或类似功能的元件。下面通过参考附图描述的实施方式是示例性的,仅用于解释本技术,而不能理解为对本技术的限制。

40.在本技术的描述中,需要理解的是,术语“第一”、“第二”仅用于描述目的,而不能理解为指示或暗示相对重要性或者隐含指明所指示的技术特征的数量。由此,限定有“第一”、“第二”的特征可以明示或者隐含地包括一个或者更多个所述特征。在本技术的描述中,“多个”的含义是两个或两个以上,除非另有明确具体地限定。

41.在本技术的描述中,需要说明的是,除非另有明确的规定和限定,术语“安装”、“相连”、“连接”应做广义理解,例如,可以是固定连接,也可以是可拆卸连接,或一体地连接;可以是机械连接,也可以是电连接或可以相互通信;可以是直接相连,也可以通过中间媒介间接相连,可以是两个元件内部的连通或两个元件的相互作用关系。对于本领域的普通技术人员而言,可以根据具体情况理解上述术语在本技术中的具体含义。

42.下文的公开提供了许多不同的实施方式或例子用来实现本技术的不同结构。为了简化本技术的公开,下文中对特定例子的部件和设置进行描述。当然,它们仅仅为示例,并且目的不在于限制本技术。此外,本技术可以在不同例子中重复参考数字和/或参考字母,这种重复是为了简化和清楚的目的,其本身不指示所讨论各种实施方式和/或设置之间的关系。

43.下面详细描述本技术的实施方式,所述实施方式的示例在附图中示出,其中自始至终相同或类似的标号表示相同或类似的元件或具有相同或类似功能的元件。下面通过参考附图描述的实施方式是示例性的,仅用于解释本技术,而不能理解为对本技术的限制。

44.请参阅图1,本技术提供一种视线方向的检测方法。检测方法包括:

45.01:获取热成像摄像头采集的红外热成像图像;

46.02:在红外热成像图像存在目标人脸的情况下,定位目标人脸区域;

47.03:确定目标人脸区域中的眼部位置;

48.04:控制目标摄像头对眼部位置进行聚焦拍摄以获得可见光双眼图像;

49.05:利用视线检测模型对可见光双眼图像进行处理得到目标人脸的视线落点方向。

50.请参阅图2,本技术还提供一种视线方向的检测装置10。检测装置10包括:热成像图像获取模块11、定位模块12、眼部位置确定模块13、可见光图像获取模块14和视线方向获取模块15。

51.步骤01可以由热成像图像获取模块11实现,步骤02可以由定位模块12实现,步骤03可以由眼部位置确定模块13实现,步骤04可以由可见光图像获取模块14实现,步骤05可以由视线方向获取模块15实现。也即是,热成像图像获取模块11用于获取热成像摄像头采集的红外热成像图像;定位模块12用于在红外热成像图像存在目标人脸的情况下,定位目标人脸区域;确定模块13用于确定目标人脸区域中的眼部位置;可见光图像获取模块14用于控制目标摄像头对眼部位置进行聚焦拍摄以获得可见光双眼图像;视线方向获取模块15用于利用视线检测模型对可见光双眼图像进行处理得到目标人脸的视线落点方向。

52.可以理解地,热成像摄像头可以为热成像图像采集装置的一部分,热成像图像采集装置为一种通过接受物体发出的红外线来显示输出红外热成像图的摄像机。任何有温度的物体都会发出红外线,红外热像仪可以接收物体发出的红外线,通过有颜色的图片来显示被测量物表面的温度分布。具体地,热成像图像采集装置可以为红外热像仪,热成像图像采集装置具体可以包括热红外信号接收模块、光学模块和数字信号转换模块。热红外信号接收模块例如红外探测器。光学模块包括光学成像物镜。数字信号转换模块包括数模转换器。红外热像仪可以利用红外探测器和光学成像物镜接收被测目标物体的红外辐射能量分布图形,并将红外辐射能量分布图形反映到红外探测器的光敏元件上。将红外辐射能量分布图形反映到红外探测器的光敏元件上后,被测目标物体的红外辐射的红外光还需要经过数字信号转换器将光信号变为电信号,然后,经过非均匀性校正、数字滤波、图像增强及伪彩查表变换后输出红外热成像图像。

53.然后,在红外热成像图像存在目标人脸的情况下,定位目标人脸区域。可以理解地,由于红外热成像图中不同的颜色代表不同的温度,在红外热成像图像存在目标人脸的情况下,目标人脸所在的区域的颜色与红外热成像图像中的其他区域的颜色不同,因此,定位模块12可以根据红外热成像图像中的颜色不同定位出目标人脸区域,不需要通过计算人脸面积和距离等定位目标人脸区域,节省了计算流程,提高了处理速度,实现了对人脸的迅速定位。其中,红外热成像图像中的目标人脸区域可以为一个或多个。

54.然后,眼部位置确定模块13可以确定一个或多个目标人脸区域中的眼部位置。

55.在确定目标人脸区域中的眼部位置后,可以自动触发眼部位置确定模块13传输相应的相机调用命令至与该眼部位置对应的可见光图像获取模块14,从而控制与该眼部位置对应的目标摄像头启用并进行自动聚焦拍摄,从而获得可见光双眼图像。目标摄像头可以为可见光相机,可以利用该可见光相机缩放至眼部定位的位置相应的视野范围,可见光相机视野缩放至相应范围内后自动拍摄获得可见光双眼图像,即可见光相机只拍摄到目标人脸的双眼。其中,由眼部位置确定模块13传输的相机调用命令决定启动整个检测区域中的某个位置的可见光相机,不需要人为控制可见光相机进行拍摄双眼图像,可见光相机接到相机调用命令后进行自动聚焦拍摄得到可见光双眼图像,使得本技术的检测方法更高效和更智能。

56.可以理解地,红外热成像图像是覆盖整个检测区域形成的图像,可以有多个可见光相机对应分布在红外热成像图像中的各个不同位置(如图3所示)。

57.当红外热成像图像中确定仅有一个目标人脸区域,且在确定一个目标人脸区域中的眼部位置后,可以触发红外热成像图像中该眼部位置对应的一个可见光相机启用,可见光相机启用后可以进行自动聚焦拍摄,从而获得该眼部位置对应的一个可见光双眼图像。其中,可见光相机为高速摄像机,可以迅速捕捉目标人脸的瞬间图像。

58.当红外热成像图像中确定有多个目标人脸区域,且在确定多个目标人脸区域中的多个眼部位置后,可以触发红外热成像图像中该多个眼部位置对应的多个可见光相机启用,多个可见光相机启用后可以进行自动聚焦拍摄,从而获得多个眼部位置对应的多个可见光双眼图像。

59.最后,利用视线检测模型对可见光双眼图像进行处理得到目标人脸的视线落点方向。即可以同时对获得的一个或多个可见光双眼图像进行处理得到一个或多个目标人脸的视线落点方向,能够实现多人在某个空间范围内的视线方向检测。其中,视线检测模型是基于可见光双眼图像的端到端算法建立的模型。

60.本技术的视线方向的检测方法可以实现人眼视线方向的检测,也可以实现多人在某个空间范围内的视线方向检测,从而解决复杂需求场景的视线方向监测需求,复杂需求场景例如包括学生的注意力监控,防作弊监控等场景。

61.请参阅图4,在某些实施例中,步骤02包括:

62.021:根据红外热成像图像中的不同颜色区域初步确定目标检测区域;

63.022:根据目标检测区域对应的颜色信息和温度信息区分目标检测区域中的人脸区域和非人脸区域;

64.023:根据人脸区域在红外热成像图像中的位置对应定位一个或多个目标人脸区域。

65.请参阅图5,定位模块12包括目标检测区域确定单元121、区分单元122和定位单元123。

66.步骤021可以由目标检测区域确定单元121实现,步骤022可以由区分单元122实现,步骤023可以由定位单元123实现。也即是,目标检测区域确定单元121用于根据热成像图像中的不同颜色区域初步确定目标检测区域;区分单元122用于根据目标检测区域对应的颜色信息和温度信息区分目标检测区域中的人脸区域和非人脸区域;定位单元123用于根据人脸区域在热成像图像中的位置对应定位一个或多个目标人脸区域。

67.具体地,请参阅图6,由于红外热成像图中不同的颜色代表不同的温度,根据颜色区域初步确定计算目标检测区域(roi),可以为图6中所示的阴影区域。

68.然后,可以将目标检测区域的温度信息和颜色信息输入到特征提取模型中,进行聚类计算,从而在红外热成像图像中将不同位置的目标检测区域区分为人脸区域和非人脸区域。如图6所示,位置1的目标检测区域为人脸区域,而位置2的目标检测区域为非人脸区域。其中,特征提取模型为能够识别人脸的模型。

69.接着,可以根据人脸区域在红外热成像图像中的位置对应定位一个或多个目标人脸区域,即可以根据图6中的位置1确定一个或多个目标人脸区域。可以理解地,若红外热成像图像的位置1具有一个目标人脸,则对应地,可以确定一个目标人脸区域;若红外热成像

图像的位置1具有多个目标人脸,则对应地,可以确定多个目标人脸区域。

70.本技术的视线方向的检测方法可以根据红外热成像图像定位在一定空间范围内的一个或多个人的目标人脸区域,能够在一定空间范围内实现对目标人脸的快速定位,便于后续对人眼的视线方向的检测。

71.请参阅图7,在某些实施例中,步骤03包括:

72.031:根据人脸位置特性对红外热成像图像中的一个或多个目标人脸进行图像切割得到一个或多个目标人脸中的眼部位置;

73.032:根据眼部位置拟合算法计算一个或多个目标人脸中的眼部位置。

74.请参阅图8,在某些实施例中,眼部位置确定模块13包括切割单元131和计算单元132。

75.步骤031可以由切割单元131实现,步骤032可以由计算单元132实现。也即是,切割单元131用于根据人脸位置特性对红外热成像图像中的一个或多个目标人脸进行图像切割得到一个或多个目标人脸中的眼部位置;计算单元132用于根据眼部位置拟合算法计算一个或多个目标人脸中的眼部位置。

76.可以理解地,目标人脸区域中可以包括一个目标人脸,也可以包括多个目标人脸,确定目标人脸区域中的眼部位置,相对应地,可以确定一个目标人脸的一个眼部位置,或确定多个目标人脸的多个眼部位置。

77.具体地,人脸位置特性可以指的是,人眼必然位于鼻子两侧,位于眉毛下方,脸颊上方的位置特性。眼部位置拟合算法可以包括taubin拟合算法。

78.例如,当一个目标人脸区域中包括一个目标人脸时,对该目标人脸进行图像切割并拟合后,确定该目标人脸的眼部位置在红外热成像图像中的位置可以为如图6所示。类似地,当一个目标人脸区域若包括多个目标人脸时,可以确定多个目标人脸的眼部位置在红外热成像图像中的位置。

79.当具有多个目标人脸区域且每个目标人脸区域分别包括一个或多个目标人脸时,对多个目标人脸区域的多个目标人脸进行图像切割并拟合后,也可以分别确定多个目标人脸的眼部位置在红外热成像图像中的位置。

80.本技术的检测方法可以对红外热成像图像中的一个或多个目标人脸进行图像切割得到一个或多个目标人脸中的眼部位置,根据红外热成像图像结合眼部位置拟合算法可以精确地定位并计算出一个或多个目标人脸的眼部位置。因此,本技术可以精确地确定在红外热成像图像中一个或多个目标人脸的眼部位置。

81.请参阅图9,步骤04包括:

82.041:根据眼部位置确定目标摄像头;

83.042:控制目标摄像头将视野范围缩放至眼部位置相应的视野范围;

84.043:在摄像头缩放至预设视野范围之后,控制摄像头进行自动聚焦拍摄,以得到可见光双眼图像。

85.请参阅图10,可见光图像获取模块14包括目标摄像头确定单元141、控制单元142和拍摄单元143。

86.步骤041可以由目标摄像头确定单元141实现,步骤042可以由控制单元142实现,步骤043可以由拍摄单元143实现。也即是说,目标摄像头确定单元141用于根据眼部位置确

定目标摄像头;控制单元142用于控制目标摄像头将视野范围缩放至眼部位置相应的视野范围;拍摄单元143用于在摄像头缩放至预设视野范围之后,控制摄像头进行自动聚焦拍摄,以得到可见光双眼图像。

87.具体地,目标摄像头即是前文所述的高速摄像头。可以理解地,本技术的视线方向的检测方法中的高速摄像头具有多个,多个高速摄像头分别设置在红外热成像图像中对应的各个位置(如图6所示),每个高速摄像头分别对应拍摄该高速摄像头的视场角所对应的区域。

88.因此,在确定红外热成像图像中的一个眼部位置后,可以根据该眼部位置确定调用对应的某个高速摄像头进行聚焦拍摄。例如,当眼部位置位于图6中的高速摄像头1的视场角覆盖的区域,则高速摄像头1为目标摄像头,可以调用高速摄像头1将视野范围缩放至眼部位置相应的视野范围,然后控制高速摄像头1进行自动聚焦拍摄,从而得到可见光双眼图像。

89.另外,在确定红外热成像图像中的多个眼部位置后,可以根据多个眼部位置确定调用对应的一个或多个高速摄像头进行聚焦拍摄。也即是,目标摄像头的数量可以根据确定的眼部位置的数量和位置是否处于同一高速摄像头的视场角范围进行确定。

90.在一个例子中,如图11所示,当确定的眼部位置有3个,且3个眼部位置的距离相近均处于高速摄像头2的视场角的覆盖范围内,则此时确定的目标摄像头即为高速摄像头2。

91.在另一个例子中,如图12所示,当确定的眼部位置也有3个,且3个眼部位置之间的距离比较远,其中,眼部位置1处于高速摄像头3的视场角的覆盖范围内,眼部位置2处于高速摄像头4的视场角的覆盖范围内,眼部位置3处于高速摄像头5的视场角的覆盖范围内,则此时确定的目标摄像头即为3个,分别为高速摄像头3、高速摄像头4和高速摄像头5。

92.需要说明的是,每个高速摄像头的视场角可以相同,也可以不相同。其中,每个高速摄像头的视场角可以是默认值,也可以根据用户需求进行自行设定。

93.请参阅图13,在某些实施例中,步骤05包括:

94.051:将可见光双眼图像输入至视线检测模型中,输出目标人脸的面部角度和目标人脸中人眼的视线落点角度;

95.052:根据目标人脸的面部角度、目标人脸中人眼的视线落点角度及目标人脸与摄像头的相对位置计算目标人脸的视线落点方向。

96.请参阅图14,视线方向获取模块15包括角度获取单元151和方向计算单元152。

97.步骤051可以由角度获取单元151实现,步骤052可以由方向计算单元152实现。也即是,角度获取单元151用于将双眼图像输入至视线检测模型中,输出目标人脸的面部角度和目标人脸中人眼的视线落点角度;方向计算单元152用于根据目标人脸的面部角度、目标人脸中人眼的视线落点角度及目标人脸与摄像头的相对位置计算目标人脸的视线落点方向。

98.具体地,请参阅图15,目标人脸的面部角度可以以目标人脸在正对高速摄像头时的角度为基准角度,此时目标人脸的面部角度为0度。

99.请参阅图15,视线落点角度可以以人眼处于眼睛框中间位置时的角度为基准角度,此时目标人脸中人眼的视线落点角度为平视0度。另外,在目标人脸的面部角度不变而人眼在眼睛框中的位置变化导致人眼的视线落点角度不同时,人眼在眼睛框中的位置与该

中间位置的相对距离与视线落点角度可以呈比例关系,例如,人眼在眼睛框中的位置每偏离该中间位置1mm,则视线落点角度偏离10度。例如,人眼在眼睛框中的位置向c方向偏离中间位置2mm,则相应的视线落点角度为向c方向偏转20度

100.更具体地,请一并参阅图15和图16,图16相对图15中的可见光双眼图输入至视线检测模型中后输出的目标人脸的面部角度为目标人脸可以向a方向偏转30度,即此时目标人脸的面部角度为a30度,此时若图15和图16中的眼睛位置不变,则对应的视线落点角度为向b方向偏转30度,将此时的视线落点角度记为b30度。需要说明的是,目标人脸若向a方向的反方向转动30度,则相应的面部角度也可以记为负数角度为

‑

a30度,相应的视线落点角度也可以记为与b方向相对的负数的角度,为

‑

b30度。目标人脸在除了a方向之外的其他方向转动的情况与a方向的情况类似,在此不再赘述。

101.然后根据目标人脸的面部角度、目标人脸中人眼的视线落点角度及目标人脸与摄像头的相对位置计算目标人脸的视线落点方向,从而可以计算出视线在空间中的真实落点。如图16所示,在目标人脸与摄像头的相对位置不变的情况下,也即是,目标人脸与摄像头之间的相对距离不变,由于目标人脸至地面的距离l1也可视为没有变化,且目标人脸的面部角度和视线落点角度都是已知的,从而可以根据目标人脸至地面的距离l1、目标人脸的面部角度a30度、目标人脸中人眼的视线落点角度b30度计算出朝向地面的最终视线落点位置,即可以根据勾股定理算出目标人脸在地面上的投影至视线落点位置之间的l2的数值,从而确定视线落点位置。

102.本技术的检测方法可以利用视线检测模型快速识别可见光双眼图像中目标人脸的面部角度和目标人脸中人眼的视线落点角度,从而最终得到目标人脸的视线落点方向,即可计算出视线在空间中的真实落点。

103.下面详细介绍视线检测模型的创建过程。请参阅图17,检测方法包括:

104.001:创建多个被测试者由不同面部角度看向空间中多个目标位置点的多个眼部图像构成的数据库;

105.002:对数据库中的多个眼部图像进行图像预处理;

106.003:基于深度残差网络和深度卷积神经网络建立深度学习模型;

107.004:利用预处理后的多个眼部图像对深度学习模型进行训练,以得到视线检测模型。

108.请结合图18,视线方向的检测装置10包括数据库创建模块101、预处理模块102、学习模型建立模块103和视线检测模型生成模块104。

109.步骤001可以由数据库创建模块101实现,步骤002可以由预处理模块102实现,步骤003可以由学习模型建立模块103实现,步骤004可以由视线检测模型生成模块104实现。也即是,视线检测模型生成模块101用于创建多个被测试者由不同面部角度看向空间中多个目标位置点的多个眼部图像构成的数据库;预处理模块102用于对数据库中的多个眼部图像进行图像预处理;学习模型建立模块103用于基于深度残差网络和深度卷积神经网络建立深度学习模型;视线检测模型生成模块104用于利用预处理后的多个眼部图像对深度学习模型进行训练,以得到视线检测模型。步骤001、步骤002、步骤003和步骤004可以在步骤04之后及步骤05之前如图17所示,也可以在步骤01之前,上述4个步骤的执行顺序在此不作限制。

110.具体地,首先,创建多个被测试者由不同面部角度看向空间中多个目标位置点的多个眼部图像构成的数据库。例如邀请多个被测试者,然后控制在不同的光线的条件下,令每个被测试者分别随机转动头部看向空间中的多个目标位置点,可以得到多个被测试者的不同面部角度的多个眼部图像,从而得到多个被测试者由不同面部角度看向空间中多个目标位置点的多个眼部图像。多个被测试者的数量越多,深度学习模型训练的眼部拟合结果越真实,得到的视线检测模型可信度越高。

111.然后对多个眼部图像进行图像预处理。图像预处理的过程可以包括对眼部图像进行随机旋转、增加高斯模糊、归一化等处理过程,实现对数据库中的眼部图像数据集的扩增。

112.接着,基于深度残差网络和深度卷积网络建立深度学习模型。深度学习模型为cnn模型。如图19所示,深度学习模型的特征提取部分由若干组深度残差网络(deep residual network,resnet)模块和深度卷积神经网络(inception)模块交替排布构成。其中,深度学习模型的损失函数(loss function)为对面部角度的回归l2和对视线角度的回归l1相加。

113.最后,利用预处理后的多个眼部图像对深度学习模型进行训练以得到视线检测模型。具体地,由图19所示,深度学习模型的特征提取部分后面连接全连接层(full connetion),将预处理后的多个眼部图像输入至深度学习模型中,多个眼部图像经过特征提取部分后再到全连接层中实现方向向量的拟合计算,从而得到视线检测模型。

114.本技术通过多个眼部图像对深度学习模型进行模型训练得到视线检测模型,直接根据视线检测模型对可见光双眼图像进行处理,能够极大地提升目前计算机处理可见光双眼图像的速度,提高可见光双眼图像的处理效率。

115.详细地,请参阅图20,步骤003包括:

116.0031:记录被测试者的面部角度及对应的视线看向的位置,以面部为基准计算被测试者的视线落点角度;

117.0032:将视线落点角度和面部角度共同作为眼部图像的图像标签得到数据库。

118.请结合图18,步骤0031和步骤0032可以由数据库创建模块101实现。也即是,数据库创建模块101用于记录被测试者的面部角度及对应的视线看向的位置,以面部为基准计算被测试者的视线落点角度;将视线落点角度和面部角度共同作为眼部图像的图像标签得到数据库。

119.具体地,记录被测试者的面部角度及对应的视线看向的位置,以面部为基准计算被测试者的视线落点角度,例如,被测试者的面部角度为如图16所示的向a方向偏转30度,此时被测试者对应的视线看向的位置则为虚线所指的b点。此时,可以以被测试者的面部为基准计算被测试者的视线落点角度,即被测试者的面部可以看成是一个平面,并以被测试者的面部为参考平面,通过一条视线和参考平面,则可以计算被测试者的视线落点角度。另外,被测试者可以随机转动头部,例如被测者头部朝左、朝右、朝上或朝下时,在被测试者的人眼的眼眶中眼睛位置不变的情况下,视线看向的位置也会随之变化,此时,可以以人脸的面部正对摄像头位置时的视线落点角度记为0度,以此为基准进行计算人眼看向空间中其他不同位置的视线落点角度。

120.然后,将视线落点角度和面部角度共同作为眼部图像的图像标签得到数据库,可以使得数据库中的每个眼部图像均具有对应的视线落点角度数据和面部角度数据,且可以

根据图像标签可以准确识别每个眼部图像的内容,提高深度学习模型的训练过程中对预处理后的多个眼部图像的检索效率和精度,有利于视线检测模型的快速建立。

121.请参阅图21,本技术还提供一种视线方向的检测系统100。该视线方向的检测系统100包括处理器110和存储器120,存储器120用于存储计算机程序121,处理器110在执行计算机程序121时实现上述任意一项实施例的检测方法。

122.本技术的视线方向的检测系统100可以实现人眼视线方向的检测,也可以实现多人在某个空间范围内的视线方向检测,从而解决复杂需求场景的视线方向监测需求,复杂需求场景例如包括学生的注意力监控,防作弊监控等场景。

123.请参阅图22,本技术还提供一种计算机程序的非易失性计算机可读存储介质200。当计算机程序210被一个或多个处理器220执行时,实现上述任意一项实施例的检测方法。

124.本技术的计算机可读存储介质200可以实现人眼视线方向的检测,也可以实现多人在某个空间范围内的视线方向检测,从而解决复杂需求场景的视线方向监测需求,复杂需求场景例如包括学生的注意力监控,防作弊监控等场景。

125.以上实施例仅表达了本技术的几种实施方式,其描述较为具体和详细,但并不能因此而理解为对本技术专利范围的限制。应当指出的是,对于本领域的普通技术人员来说,在不脱离本技术构思的前提下,还可以做出若干变形和改进,这些都属于本技术的保护范围。因此,本技术专利的保护范围应以所附权利要求为准。

再多了解一些

本文用于企业家、创业者技术爱好者查询,结果仅供参考。