1.本公开属于情感分析技术领域,尤其涉及一种用于情感分析的多模态特征融合方法及系统。

背景技术:

2.本部分的陈述仅仅是提供了与本公开相关的背景技术信息,不必然构成在先技术。

3.随着社交平台的不断崛起,多种模态表达情感的方式也在不断地多样化。以往的特征融合方法,大部分工作只是简单地将两种模式结合起来,而没有探索复杂的相关性,何更好地利用内部模态信息和模态交互信息成为当前研究的热点。

4.目前在多模态融合中使用的深度学习模型有以下三种:

5.(1)基于cnn和rnn及其变体的方法

6.卷积神经网络(cnn)是一种典型的深度学习模型。针对文本或者图像数据,它可以学习不同抽象层次的特征表示机制,是一种可以训练的多级前馈人工神经网络。例如,采用两种基于cnn的模型分别提取单模态特征。然后将它们的联合表示输入到多元cnn中,以充分利用模态之间的内在关系。

7.(2)基于注意力的方法

8.注意力机制(attention mechanism)是人们在机器学习模型中嵌入的一种特殊结构,用来自动学习和计算输入数据对输出数据的贡献大小,bert、gpt、transformer等等模型或结构,都采用了注意力机制。最近,许多研究者开始尝试将transformer引入到多模式任务中,例如,vilbert模型,该模型结合图片和文本信息的特征,将bert转换为双向结构。首先,采用transformer编码器对图像进行编码,其中图像编码器的输入为fast r-cnn提取的显著目标区域;然后将它们输入到一个通用的transformer层,实现稀疏交互,获得多模态联合表示。

9.(3)基于张量的办法

10.张量表示是一种成功的多模态融合方法,它首先将多输入转换为高维张量,然后将其映射回一个低维输出向量空间。通过对输入模态取外积可以得到张量表示。例如,tfn(tensor fusion network:张量融合网络)模型,它使用模间的外张量积来度量模各部分之间的关系。但这种方法会大大增加特征向量的维数,增加训练难度。lmf(low-rank multimodal fusion:低秩多模式融合)是tfn的升级,它使用低秩表示来分解权重。它通过对每个模式进行线性变换,然后进行多维点积来减少模型参数的数量。

11.多模态融合的主要目标是减少模态之间的异质差异,同时保持每个模态特定语义的完整性,以往的特征融合方法,大部分工作只是简单地将两种模式结合起来,而没有探索复杂的相关性。随着社交平台的不断崛起,多种模态表达情感的方式也在不断地多样化。为了更准确地提取和融合多模态的情感特征,研究者们通过捕捉不同模式之间的相似结构,进一步探索图像特征和文本特征之间的跨模态相关性,如何更好地利用内部模态信息和模

态交互信息成为当前研究的热点。例如:利用跨模态注意机制获取两种模式之间的交互信息,并提出了一种门控机制来过滤生成的交互信息中的噪声。

12.发明人发现,现有的基于注意力机制的多模态特征融合方法大多是双向的,旨在对齐文本实体名词和图像局部区域;但是,对于博客和评论类社交数据,文本所表达的情感信息通常是主体,而图像内容通常只是作为文本内容的辅助说明或补充解释,这种融合方式在现在的多媒体平台上经常会导致遗漏部分独立表达情感的图片信息,导致分类准确度降低。

技术实现要素:

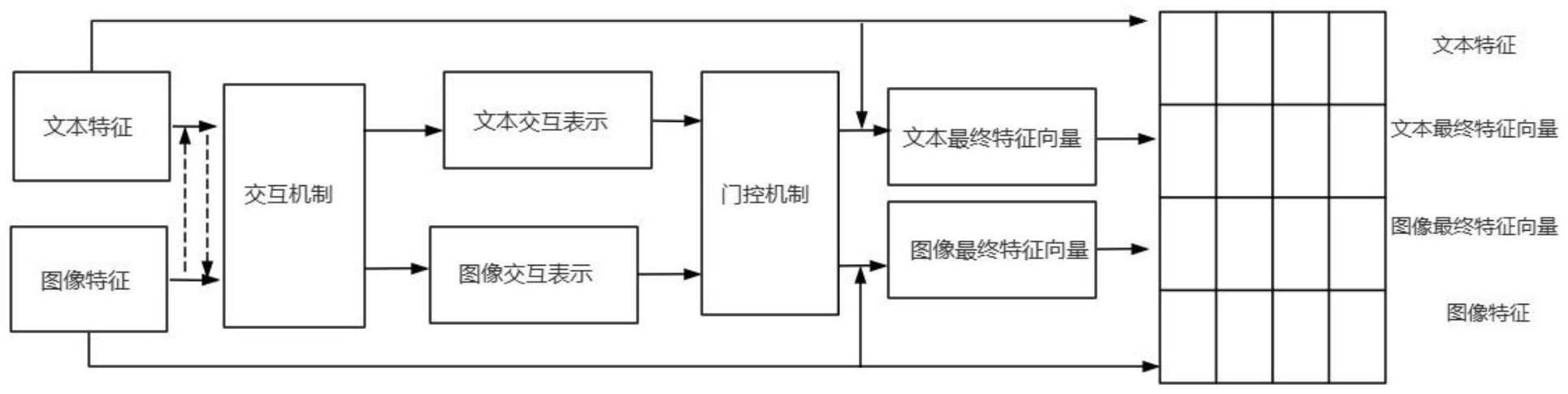

13.本公开为了解决上述问题,提供了一种用于情感分析的多模态特征融合方法及系统,所述方案通过基于注意力机制的跨模态交互和门控网络,将模态内部信息与模态之间的交互信息相结合,得到充分的模态表示,解决了多模态内部信息挖掘不足的问题;同时,通过交互机制获取两种模式之间更深层次的相关信息,以丰富单模信息,并利用门控机制过滤交互式信息中的冗余信息,进一步保证了融合特征的准确性。

14.根据本公开实施例的第一个方面,提供了一种用于情感分析的多模态特征融合方法,包括:

15.获取社交数据中的文本数据及其对应的图像数据;

16.分别对所述文本数据和图像数据进行特征提取,获得文本特征及图像特征;

17.基于所述文本特征及图像特征,采用跨模态注意力机制获取两者之间的交互信息,并通过门控机制对所述交互信息进行噪声过滤,获得图像滤波后的文本特征以及文本滤波后的图像特征;

18.将获得的文本特征、图像特征、图像滤波后的文本特征以及文本滤波后的图像特征进行拼接,获得融合特征;

19.基于所述融合特征,通过预先构建的情感分析模型获得情感分析结果。

20.进一步的,所述采用跨模态注意力机制获取两者之间的交互信息,具体为:

21.基于所述文本特征及图像特征,计算两者的注意力矩阵;

22.利用softmax函数对所述注意力矩阵进行量化处理;

23.计算注意力矩阵的量化结果与图像特征的乘积,获得文本到图像的交互信息;

24.计算注意力矩阵的量化结果与文本特征的乘积,获得图像到文本的交互信息。

25.进一步的,所述通过门控机制对所述交互信息进行噪声过滤,包括对文本到图像的交互信息的噪声过滤,以及对图像到文本的交互信息的噪声过滤。

26.进一步的,所述对文本到图像的交互信息的噪声过滤,具体表示如下;

[0027][0028]

其中,g()表示门控操作,n()表示非线性操作,i

tv

为文本到图像的交互信息,hv为图像特征。

[0029]

进一步的,所述对图像到文本的交互信息的噪声过滤,具体表示如下;

[0030][0031]

其中,i

vt

为图像到文本的交互信息,h

t

为文本特征。

[0032]

根据本公开实施例的第二个方面,提供了一种用于情感分析的多模态特征融合系统,包括:

[0033]

数据获取单元,其用于获取社交数据中的文本数据及其对应的图像数据;

[0034]

特征提取单元,其用于分别对所述文本数据和图像数据进行特征提取,获得文本特征及图像特征;

[0035]

交互信息获取及滤波单元,其用于基于所述文本特征及图像特征,采用跨模态注意力机制获取两者之间的交互信息,并通过门控机制对所述交互信息进行噪声过滤,获得图像滤波后的文本特征以及文本滤波后的图像特征;

[0036]

特征融合单元,其用于将获得的文本特征、图像特征、图像滤波后的文本特征以及文本滤波后的图像特征进行拼接,获得融合特征;

[0037]

情感分析单元,其用于基于所述融合特征,通过预先构建的情感分析模型获得情感分析结果。

[0038]

根据本公开实施例的第三个方面,提供了一种电子设备,包括存储器、处理器及存储在存储器上运行的计算机程序,所述处理器执行所述程序时实现所述的一种用于情感分析的多模态特征融合方法。

[0039]

根据本公开实施例的第四个方面,提供了一种非暂态计算机可读存储介质,其上存储有计算机程序,该程序被处理器执行时实现所述的一种用于情感分析的多模态特征融合方法。

[0040]

与现有技术相比,本公开的有益效果是:

[0041]

(1)本公开提供了一种用于情感分析的多模态特征融合方法及系统,所述方案通过基于注意力机制的跨模态交互和门控网络,将模态内部信息与模态之间的交互信息相结合,得到充分的模态表示,解决了多模态内部信息挖掘不足的问题。

[0042]

(2)本公开所述方案通过交互机制获取两种模式之间更深层次的相关信息,以丰富单模信息,并利用门控机制过滤交互式信息中的冗余信息,进一步保证了融合特征的准确性。

[0043]

本公开附加方面的优点将在下面的描述中部分给出,部分将从下面的描述中变得明显,或通过本公开的实践了解到。

附图说明

[0044]

构成本公开的一部分的说明书附图用来提供对本公开的进一步理解,本公开的示意性实施例及其说明用于解释本公开,并不构成对本公开的不当限定。

[0045]

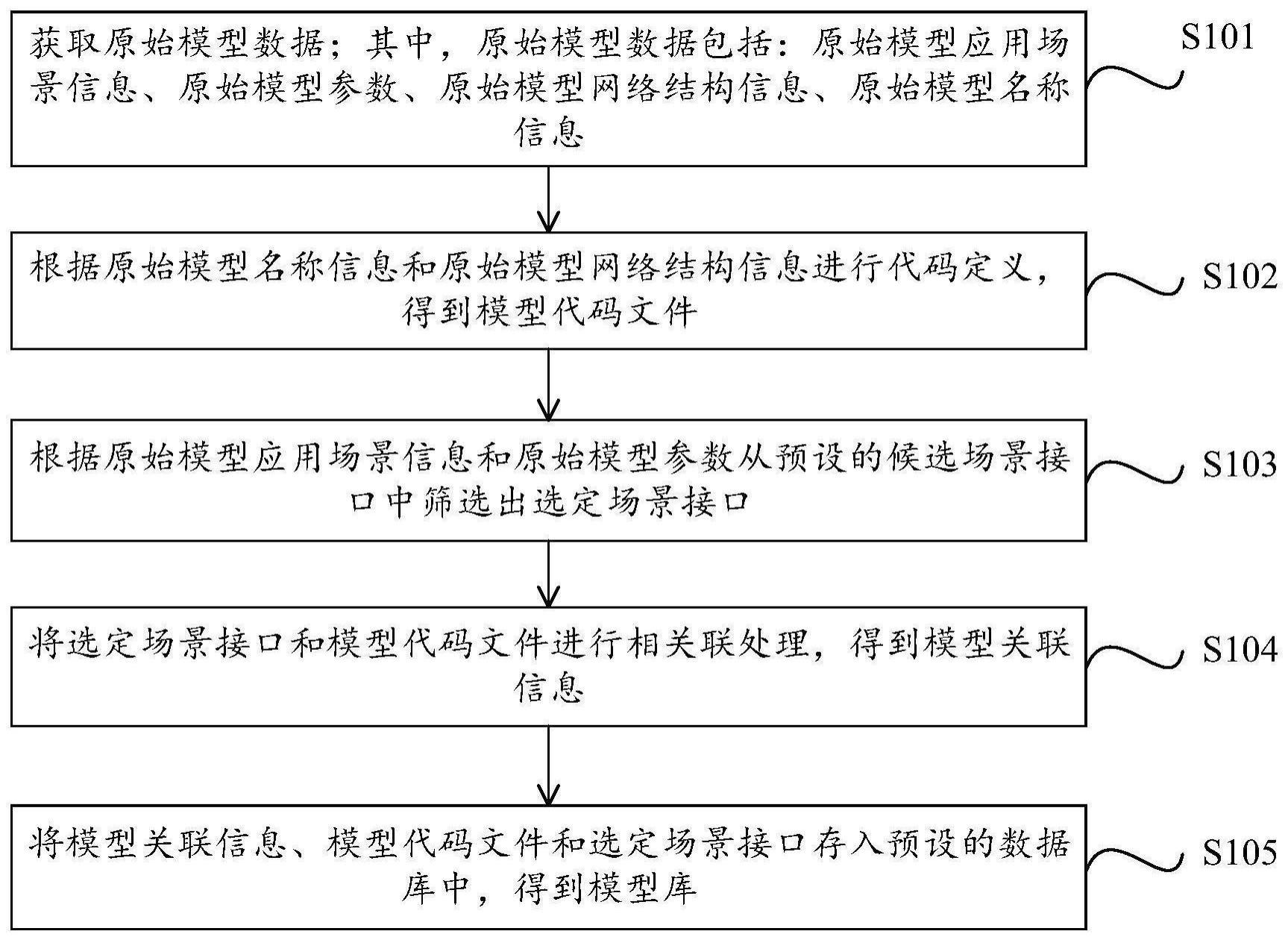

图1为本公开实施例中所述的一种用于情感分析的多模态特征融合方法基本流程图;

[0046]

图2为本公开实施例中所述的本公开所述方法的实验结果示意图。

具体实施方式

[0047]

下面结合附图与实施例对本公开做进一步说明。

[0048]

应该指出,以下详细说明都是例示性的,旨在对本公开提供进一步的说明。除非另有指明,本文使用的所有技术和科学术语具有与本公开所属技术领域的普通技术人员通常

理解的相同含义。

[0049]

需要注意的是,这里所使用的术语仅是为了描述具体实施方式,而非意图限制根据本公开的示例性实施方式。如在这里所使用的,除非上下文另外明确指出,否则单数形式也意图包括复数形式,此外,还应当理解的是,当在本说明书中使用术语“包含”和/或“包括”时,其指明存在特征、步骤、操作、器件、组件和/或它们的组合。

[0050]

在不冲突的情况下,本公开中的实施例及实施例中的特征可以相互组合。

[0051]

实施例一:

[0052]

本实施例的目的是提供一种用于情感分析的多模态特征融合方法。

[0053]

如图1所示,一种用于情感分析的多模态特征融合方法,包括:

[0054]

获取社交数据中的文本数据及其对应的图像数据;

[0055]

分别对所述文本数据和图像数据进行特征提取,获得文本特征及图像特征;

[0056]

基于所述文本特征及图像特征,采用跨模态注意力机制获取两者之间的交互信息,并通过门控机制对所述交互信息进行噪声过滤,获得图像滤波后的文本特征以及文本滤波后的图像特征;

[0057]

将获得的文本特征、图像特征、图像滤波后的文本特征以及文本滤波后的图像特征进行拼接,获得融合特征;

[0058]

基于所述融合特征,通过预先构建的情感分析模型获得情感分析结果。

[0059]

在具体实施中,所述采用跨模态注意力机制获取两者之间的交互信息,具体为:

[0060]

基于所述文本特征及图像特征,计算两者的注意力矩阵;

[0061]

利用softmax函数对所述注意力矩阵进行量化处理;

[0062]

计算注意力矩阵的量化结果与图像特征的乘积,获得文本到图像的交互信息;

[0063]

计算注意力矩阵的量化结果与文本特征的乘积,获得图像到文本的交互信息。

[0064]

在具体实施中,所述通过门控机制对所述交互信息进行噪声过滤,包括对文本到图像的交互信息的噪声过滤,以及对图像到文本的交互信息的噪声过滤。

[0065]

在具体实施中,所述对文本到图像的交互信息的噪声过滤,具体表示如下;

[0066][0067]

其中,g()表示门控操作,n()表示非线性操作,i

tv

为文本到图像的交互信息,hv为图像特征。

[0068]

在具体实施中,所述对图像到文本的交互信息的噪声过滤,具体表示如下;

[0069][0070]

其中,i

vt

为图像到文本的交互信息,h

t

为文本特征。

[0071]

在具体实施中,本实施例方案利用k-max pooling策略,保留了特征值的相对顺序同时,通过基于注意力机制的跨模态交互和门控网络,将模态内部信息与模态之间的交互信息相结合,得到充分的模态表示。所述方案采用如下技术构思:首先,利用一种跨模态交互机制来建模图像与文本之间的交互,分别得到两者之间的交互信息。其次,并非获得的交互信息都对情绪分析任务有用,故本实施例所述方案通过门控机制对交互过程中的冗余信息进行过滤,保留与情绪最相关的部分,获得其中最有价值的信息。最后,通过利用注意机制自动计算各模态的贡献度,将内部模态特征与学习到的相应交互特征相连接,得到每个

模态特征的完整表示,更有效地融合了双峰特征。

[0072]

其中,k-max pooling是一种全局取top-k特征的操作方法,它保持了特征值的相对顺序,可以表达同一类型特征多次出现的情况,以突出某一类型特征的重要性。

[0073]

其计算公式为:

[0074]

h’max

=k-max(h

t

)

[0075]

其中,k值的选取也可以动态求得:

[0076][0077]

其中,l为句子长度,l为卷积层总数,c为当前卷积层数。所以可以看出,k随着句子长度和网络深度的变化而变化。

[0078]

其中,所述贡献值指的是每个模态对于最后对情感分类的影响大小;双峰特征指两个模态的特征值。

[0079]

具体的,本实施例所述方案包括如下处理过程:

[0080]

步骤1:获得交互信息

[0081]

例如,计算一组文本h

t

与图像hv之间的交互作用,注意矩阵m

tv

∈ru×u表示为:

[0082][0083]

然后使用softmax函数来量化注意矩阵:

[0084][0085]

然后将文本到图像的最终交互信息表示为:

[0086]itv

=j

tv

.hvꢀꢀꢀ

(3)

[0087]

类似地,图像与文本的最终交互信息表示为:

[0088]ivt

=j

vt

.h

t

ꢀꢀꢀ

(4)

[0089]

其中,对于获取的文本数据进行如下处理:

[0090]

(1)文本预处理:先删除所有数字、特殊符号、参考文献等,然后将文本分成标记,添加特殊符号[cls]和[sep],最后截断句子,制作注意掩码。

[0091]

(2)利用bert提取包含上下文信息的文本向量表示。

[0092]

1)位置编码。向transformer提供文本中每个单词的位置信息,以识别评论文本中单词的依赖性和时间特征。

[0093]

2)self-attention机制。通过计算句子中每个词与句子中所有词的关系,调整每个词的权重,获得更多的语义表达,解决多义问题。自我注意机制的公式如下

[0094][0095]

其中,linear(

·

)表示线性映射;e是注释文本向量;wq,wkwv是权重。

[0096][0097]

其中,selfattention(

·

)表示自注意;将注意力矩阵转化为标准正态分布;对softmax(

·

)进行归一化处理,使文本中每个单词的注意权重和其他所有单词的注意权

重之和为1。

[0098]

3)层归一化和残差连接。层标准化网络中的隐含层呈标准正态分布,加快了模型的训练和收敛速度;剩余连接可以解决梯度消失和网络退化的问题。

[0099]

(3)textcnn卷积层。利用卷积运算提取输入词向量矩阵的高阶局部文本特征。卷积运算用卷积核来产生特征向量。f∈r

l,nht

其中l是卷积核的高度,n是卷积核的宽度,也就是字向量的长度。本文使用三个卷积窗口高度为l=(2,3,4)的卷积核进行卷积,提取不同粒度的文本特征向量。公式如下:

[0100]ht

=relu(conv(w,f) b)

[0101]

其中,relu为激活函数,conv为卷积运算,w为这句话的词向量矩阵,b为偏置项。

[0102]

卷积层输出的结果是由多个卷积核生成的特征向量集合h:

[0103]

h=(h1,h2,...,hn)

[0104]

其中,n为提取的特征向量个数,等于卷积核个数与卷积核类型的乘积。

[0105]

(4)textcnn池化层。池化操作可以减少模型参数的数量,缓解过拟合问题,将变长输入组织为定长输入。时间序列最大池化只保留了最大值,容易导致特征位置信息的丢失;而多次出现的强特征只能看到一次,因此失去了强度信息。因此,本文用k-maxpooling代替了maxpooling。其核心思想是k-max pooling是一种全局取top-k特征的操作方法,它保持了特征值的相对顺序,可以表达同一类型特征多次出现的情况,以突出某一类型特征的重要性。计算公式为:

[0106]

h’max

=k-max(h

t

)

[0107]

其中,k值的选取也可以动态求得:

[0108][0109]

其中,l为句子长度,l为卷积层总数,c为当前卷积层数。所以可以看出,k随着句子长度和网络深度的变化而变化。

[0110]

(5)最后,将这些汇集的输出值链接成向量,获得更丰富的文本特征表示。

[0111][0112]

在具体实施中,对于获取的图像数据可采用sift(scale-invariant feature transform)算子、hog(histogram of oriented gradient)特征提取算法或lbp(local binary pattern)算法等等,本实施例所述方法不限定图像特征的提取方式。

[0113]

步骤2:门控机制过滤噪声

[0114]

并非上述获得的交互信息都对情绪分析任务有用,因此,本实施例所述方案提出了一种门控机制,对产生的交互信息的噪声进行过滤,保留与情绪最相关的部分。

[0115]

其中,c

vt

表示图像滤波后的文本特征,c

vt

表示文本滤波后的图像特征,它们是单模态上下文信息和模态之间的交互信息的融合。

[0116]cvt

=gate(i

tv

,hv)

ꢀꢀꢀ

(5)

[0117]cvt

=gate(i

vt

,h

t

)

ꢀꢀꢀ

(6)

[0118]

其中,我们定义了一个内核函数(即门控)gate()来融合在上一步中获得的模态交互信息和上下文表示。

[0119]

我们以文本与图像的交互信息和图像的单独表示为例,说明门控机制的计算过

程:

[0120][0121][0122]ctv

=g(i

tv

,hv)

·

n(i

tv

,hv) (1-g(i

tv

,hv))

·

hvꢀꢀꢀ

(9)

[0123]

其中,n()表示非线性操作,g()表示门控,将交叉交互的信息调整到下一层,wf,bf,bg是可训练参数,

°

表示元素乘法,σ为激活函数,本实施例中采用sigmoid函数。

[0124]

步骤3:得到完整的融合模态特征

[0125]

将内部模态特征(即h

t

和hv)与学习到的相应交互特征(即c

vt

和c

tv

)相连接,得到每个模态特征的完整表示,由4种融合特征表示共同拼接为完整的特征表示sf=[h

t

,hv,c

vt

,c

tv

],输入到下游多任务学习模型中。

[0126]

其中,所述下游多任务学习模型可以为后期的分类任务,具体的:

[0127]

融合特征表示为sf=[h

t

,hv,c

vt

,c

tv

],通过利用前向神经网络学习每种特征表示的注意力权重:

[0128][0129]

其中,分别是两个全连接层的权重参数,和是对应的偏置。每种特征表示对应的注意力权重构成了任务专属的注意力向量attn=[attn

t

,attnv,attn

vt

,attn

tv

],与共享特征表示矩阵相乘获得任务专属的融合表示ff

task

=sf

×

attn∈rd×d。

[0130]

后续的预测则根据具体的任务目标,设置相应的输出层神经元数量和激活函数。本文所有的任务均设置输出层神经元数量为1,主任务和强度回归任务不使用激活函数,而极性二分类任务使用sigmoid激活函数。

[0131]

回归任务使用平均绝对误差(mean absolute error,mae)作为损失函数,而分类任务使用交叉熵(cross entropy)作为损失函数。整个模型的训练基于三项任务的综合损失:

[0132][0133]

其中,α、β、γ为超参数,用于调节三项任务的训练程度。较大的参数值能够指导模型优先学习该任务上的收敛。

[0134]

实施例二:

[0135]

本实施例的目的是提供一种用于情感分析的多模态特征融合系统。

[0136]

一种用于情感分析的多模态特征融合系统,包括:

[0137]

数据获取单元,其用于获取社交数据中的文本数据及其对应的图像数据;

[0138]

特征提取单元,其用于分别对所述文本数据和图像数据进行特征提取,获得文本特征及图像特征;

[0139]

交互信息获取及滤波单元,其用于基于所述文本特征及图像特征,采用跨模态注意力机制获取两者之间的交互信息,并通过门控机制对所述交互信息进行噪声过滤,获得图像滤波后的文本特征以及文本滤波后的图像特征;

[0140]

特征融合单元,其用于将获得的文本特征、图像特征、图像滤波后的文本特征以及文本滤波后的图像特征进行拼接,获得融合特征;

[0141]

情感分析单元,其用于基于所述融合特征,通过预先构建的情感分析模型获得情感分析结果。

[0142]

进一步的,本实施例所述系统与实施例一所述方法相对应,其技术细节在实施例一中进行了详细描述,故此处不再赘述。

[0143]

在更多实施例中,还提供:

[0144]

一种电子设备,包括存储器和处理器以及存储在存储器上并在处理器上运行的计算机指令,所述计算机指令被处理器运行时,完成实施例一中所述的方法。为了简洁,在此不再赘述。

[0145]

应理解,本实施例中,处理器可以是中央处理单元cpu,处理器还可以是其他通用处理器、数字信号处理器dsp、专用集成电路asic,现成可编程门阵列fpga或者其他可编程逻辑器件、分立门或者晶体管逻辑器件、分立硬件组件等。通用处理器可以是微处理器或者该处理器也可以是任何常规的处理器等。

[0146]

存储器可以包括只读存储器和随机存取存储器,并向处理器提供指令和数据、存储器的一部分还可以包括非易失性随机存储器。例如,存储器还可以存储设备类型的信息。

[0147]

一种计算机可读存储介质,用于存储计算机指令,所述计算机指令被处理器执行时,完成实施例一中所述的方法。

[0148]

实施例一中的方法可以直接体现为硬件处理器执行完成,或者用处理器中的硬件及软件模块组合执行完成。软件模块可以位于随机存储器、闪存、只读存储器、可编程只读存储器或者电可擦写可编程存储器、寄存器等本领域成熟的存储介质中。该存储介质位于存储器,处理器读取存储器中的信息,结合其硬件完成上述方法的步骤。为避免重复,这里不再详细描述。

[0149]

本领域普通技术人员可以意识到,结合本实施例描述的各示例的单元即算法步骤,能够以电子硬件或者计算机软件和电子硬件的结合来实现。这些功能究竟以硬件还是软件方式来执行,取决于技术方案的特定应用和设计约束条件。专业技术人员可以对每个特定的应用来使用不同方法来实现所描述的功能,但是这种实现不应认为超出本公开的范围。

[0150]

上述实施例提供的一种用于情感分析的多模态特征融合方法及系统可以实现,具有广阔的应用前景。

[0151]

以上所述仅为本公开的优选实施例而已,并不用于限制本公开,对于本领域的技术人员来说,本公开可以有各种更改和变化。凡在本公开的精神和原则之内,所作的任何修改、等同替换、改进等,均应包含在本公开的保护范围之内。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。