1.本技术涉及人工智能领域,尤其涉及一种数据处理方法及其装置。

背景技术:

2.人体动作捕捉技术是影视、游戏行业中常用的技术,该技术可对输入的视频流进行处理,以捕捉每一帧图像中人体的姿态,从而得到人体的运动信息。基于这种技术,可以从海量的视频中提取人体运动时的姿态数据,具有广阔的应用场景,例如,增强现实(augmented reality,ar)场景和虚拟现实(virtual reality,vr)场景中的虚拟人物驱动、远程会议以及元宇宙等等。

3.目前,可基于ai技术中实现人体动作捕捉。具体地,对于某一个图像而言,可通过已训练的神经网络对该图像进行处理,从而得到姿态参数,该姿态参数可用于确定人体的姿态。

4.然而现有技术中采用的神经网络是仅基于二维投影信息构建的损失进行更新的,虽然可以做到预测的姿态和图像或者视频中姿态之间的像素级的对齐,但是预测的姿态会出现动作畸形、不合理的问题。

技术实现要素:

5.本技术提供了一种数据处理方法,通过引入一个不会或基本不会出现畸形的姿态信息作为训练姿态识别模型时的监督信号(或者称之为先验信息,也就是第一姿态信息),来保证一方面更新后的姿态识别模型输出的姿态信息所确定的姿态可以和图像中人物对象的姿态实现像素级的对齐,另一方面所确定的姿态不会出现畸形(或者基本不会出现畸形)的情况。

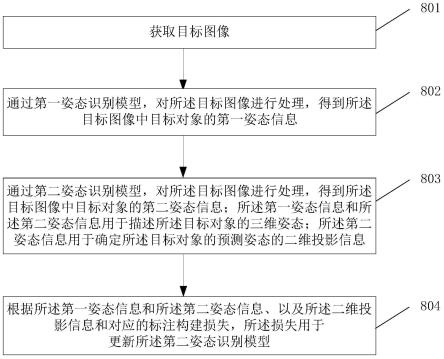

6.第一方面,本技术提供了一种数据处理方法,包括:获取目标图像;通过第一姿态识别模型,对所述目标图像进行处理,得到所述目标图像中目标对象的第一姿态信息;通过第二姿态识别模型,对所述目标图像进行处理,得到所述目标图像中目标对象的第二姿态信息;所述第一姿态信息和所述第二姿态信息用于描述所述目标对象的三维姿态;所述第二姿态信息用于确定所述目标对象的预测姿态的二维投影信息;根据所述第一姿态信息和所述第二姿态信息、以及所述二维投影信息和对应的标注构建损失,所述损失用于更新所述第二姿态识别模型。

7.在一种可能的实现中,对于需要训练的姿态识别模型,通常在前馈过程中可以输出用于描述所述目标对象的三维姿态的信息,将该信息进行二维关键点的优化,也就是通过一定的映射方式得到二维投影信息,并通过得到的二维投影信息和对应的标注的差异所构建的损失来更新姿态识别模型,进而使得更新后的姿态识别模型输出的姿态信息所确定的姿态可以和图像中人物对象的姿态实现像素级的对齐,然而这种方式会导致所确定的姿态出现畸形、不正常的情况。本技术实施例中,通过引入一个不会或基本不会出现畸形的姿态信息作为训练姿态识别模型时的监督信号(或者称之为先验信息),来保证一方面更新后

的姿态识别模型输出的姿态信息所确定的姿态可以和图像中人物对象的姿态实现像素级的对齐,另一方面所确定的姿态不会出现畸形(或者基本不会出现畸形)的情况。

8.在一种可能的实现中,上述所引入的监督信号(或者称之为先验信息)可以由第一姿态识别模型来提供。

9.在一种可能的实现中,所述第一姿态识别模型为根据输出的姿态信息和对应的标注构建的损失训练得到的。

10.其中,第一姿态识别模型可以基于端到端的方式,通过处理图像得到目标图像中目标对象的姿态信息。其中,姿态参数通常由两部分参数构成,一部分参数用于指示目标对象相对于相机的旋转角,另一部分参数用于指示目标对象自身各个关节之间的夹角。可选的,另一部分参数还可以用于指示目标对象上的三维坐标点的位置。

11.在一种可能的实现中,第一姿态信息可以用于描述所述目标对象的三维姿态,例如可以指示目标对象自身各个关节之间的夹角、或者用于指示目标对象上的三维坐标点的位置。

12.在一种可能的实现中,所述通过第一姿态识别模型,对所述目标图像进行处理,还得到所述目标图像中目标对象的第一体型信息;所述通过第二姿态识别模型,对所述目标图像进行处理,还得到所述目标图像中目标对象的第二体型信息;所述根据所述第一姿态信息和所述第二姿态信息、以及所述关键点位置信息和对应的标注值构建损失,包括:根据所述第一姿态信息和所述第二姿态信息、所述关键点位置信息和对应的标注值、以及所述第一体型信息和所述第二体型信息构建损失。

13.其中,第一体型信息也可以称之为形状参数(shape),用于指示目标对象的三维形状。位移参数用于指示目标对象在目标区域中所占的幅度,以及目标对象在目标区域中的偏移量(例如,以目标区域的中心点为参考点,目标对象向左偏移的程度或向右偏移的程度)。

14.在一种可能的实现中,所述目标图像为原始图像中所述目标对象所处的图像区域,在计算二维投影信息时,所述二维投影信息表示为所述预测姿态的二维投影在所述原始图像中所处的位置,也就是说,可以在全图上计算重投影误差,更贴近图片形成时的投影过程。

15.在一种可能的实现中,所述目标对象为人物。

16.在一种可能的实现中,所述方法还包括:通过更新后的所述第二姿态识别模型,处理所述目标图像,得到所述目标图像中目标对象的第三姿态信息;所述第三姿态信息用于确定所述目标对象的姿态。

17.在一种可能的实现中,在通过上述方式得到更新后的第二姿态识别模型之后,可以通过更新后的所述第二姿态识别模型,处理所述目标图像,得到所述目标图像中目标对象的第三姿态信息;所述第三姿态信息用于确定所述目标对象的姿态。类似的,对于视频流中的其余帧图像,也可执行如同对目标图像所执行的操作,以得到目标对象的连续多个姿态,形成目标对象的运动信息。

18.在一种可能的实现中,在得到上述第三姿态信息之后,可以向用户设备发送通过更新后的所述第二姿态识别模型处理所述目标图像得到的所述目标对象的姿态;或者,向用户设备发送所述更新后的所述第二姿态识别模型。

19.在一种可能的实现中,所述标注为人工预先标注的、或者通过预训练的模型对所述目标图像进行处理得到的。

20.第二方面,本技术提供了一种数据处理装置,其特征在于,包括:

21.获取模块,用于获取目标图像;

22.图像处理模块,用于通过第一姿态识别模型,对所述目标图像进行处理,得到所述目标图像中目标对象的第一姿态信息;

23.通过第二姿态识别模型,对所述目标图像进行处理,得到所述目标图像中目标对象的第二姿态信息;所述第一姿态信息和所述第二姿态信息用于描述所述目标对象的三维姿态;所述第二姿态信息用于确定所述目标对象的预测姿态的二维投影信息;

24.模型更新模块,用于根据所述第一姿态信息和所述第二姿态信息、以及所述二维投影信息和对应的标注构建损失,所述损失用于更新所述第二姿态识别模型。

25.在一种可能的实现中,所述第一姿态识别模型为根据输出的姿态信息和对应的标注构建的损失训练得到的。

26.在一种可能的实现中,

27.所述通过第一姿态识别模型,对所述目标图像进行处理,还得到所述目标图像中目标对象的第一体型信息;

28.所述通过第二姿态识别模型,对所述目标图像进行处理,还得到所述目标图像中目标对象的第二体型信息;

29.所述模型更新模块,具体用于:

30.根据所述第一姿态信息和所述第二姿态信息、所述关键点位置信息和对应的标注值、以及所述第一体型信息和所述第二体型信息构建损失。

31.在一种可能的实现中,所述目标图像为原始图像中所述目标对象所处的图像区域,在计算二维投影信息时,所述二维投影信息表示为所述预测姿态的二维投影在所述原始图像中所处的位置,也就是说,可以在全图上计算重投影误差,更贴近图片形成时的投影过程。

32.在一种可能的实现中,所述目标对象为人物。

33.在一种可能的实现中,所述图像处理模块,还用于:

34.通过更新后的所述第二姿态识别模型,处理所述目标图像,得到所述目标图像中目标对象的第三姿态信息;所述第三姿态信息用于确定所述目标对象的姿态。

35.在一种可能的实现中,所述装置还包括:

36.发送模块,用于向用户设备发送通过更新后的所述第二姿态识别模型处理所述目标图像得到的所述目标对象的姿态;或者,

37.向用户设备发送所述更新后的所述第二姿态识别模型。

38.在一种可能的实现中,所述标注为人工预先标注的、或者通过预训练的模型对所述目标图像进行处理得到的。

39.第三方面,本技术实施例提供了一种数据处理装置,可以包括存储器、处理器以及总线系统,其中,存储器用于存储程序,处理器用于执行存储器中的程序,以执行如上述第一方面及其任一可选的方法。

40.第四方面,本技术实施例提供了一种计算机可读存储介质,所述计算机可读存储

介质中存储有计算机程序,当其在计算机上运行时,使得计算机执行上述第一方面及其任一可选的方法。

41.第五方面,本技术实施例提供了一种计算机程序,当其在计算机上运行时,使得计算机执行上述第一方面及其任一可选的方法。

42.第六方面,本技术提供了一种芯片系统,该芯片系统包括处理器,用于支持执行设备或训练设备实现上述方面中所涉及的功能,例如,发送或处理上述方法中所涉及的数据;或,信息。在一种可能的设计中,所述芯片系统还包括存储器,所述存储器,用于保存执行设备或训练设备必要的程序指令和数据。该芯片系统,可以由芯片构成,也可以包括芯片和其他分立器件。

附图说明

43.图1a为人工智能主体框架的一种结构示意图;

44.图1b和图2为本发明的应用系统框架示意;

45.图3为终端的一种可选的硬件结构示意图;

46.图4为一种服务器的结构示意图;

47.图5为本技术的一种系统架构示意;

48.图6为一种云服务的流程;

49.图7为一种云服务的流程;

50.图8为本技术实施例提供的一种数据处理方法的流程示意;

51.图9为本技术实施例提供的姿态识别的一个应用例示意图;

52.图10为一种姿态识别的一个结果示意;

53.图11为一种姿态识别的一个结果示意;

54.图12a为一种重投影误差计算法方法的示意;

55.图12b为一种姿态识别的一个应用例示意图;

56.图12c为一种姿态识别的一个应用例示意图;

57.图13为本技术实施例提供的数据处理装置的一种结构示意图;

58.图14为本技术实施例提供的执行设备的一种结构示意图;

59.图15为本技术实施例提供的训练设备一种结构示意图;

60.图16为本技术实施例提供的芯片的一种结构示意图。

具体实施方式

61.下面结合本发明实施例中的附图对本发明实施例进行描述。本发明的实施方式部分使用的术语仅用于对本发明的具体实施例进行解释,而非旨在限定本发明。

62.下面结合附图,对本技术的实施例进行描述。本领域普通技术人员可知,随着技术的发展和新场景的出现,本技术实施例提供的技术方案对于类似的技术问题,同样适用。

63.本技术的说明书和权利要求书及上述附图中的术语“第一”、“第二”等是用于区别类似的对象,而不必用于描述特定的顺序或先后次序。应该理解这样使用的术语在适当情况下可以互换,这仅仅是描述本技术的实施例中对相同属性的对象在描述时所采用的区分方式。此外,术语“包括”和“具有”以及他们的任何变形,意图在于覆盖不排他的包含,以便

包含一系列单元的过程、方法、系统、产品或设备不必限于那些单元,而是可包括没有清楚地列出的或对于这些过程、方法、产品或设备固有的其它单元。

64.本文中所用用语“基本(substantially)”、“大约(about)”及类似用语用作近似用语、而并非用作程度用语,且旨在考虑到所属领域中的普通技术人员将知的测量值或计算值的固有偏差。此外,在阐述本发明实施例时使用“可(may)”是指“可能的一个或多个实施例”。本文中所用用语“使用(use)”、“正使用(using)”、及“被使用(used)”可被视为分别与用语“利用(utilize)”、“正利用(utilizing)”、及“被利用(utilized)”同义。另外,用语“示例性(exemplary)”旨在指代实例或例示。

65.首先对人工智能系统总体工作流程进行描述,请参见图1a,图1a示出的为人工智能主体框架的一种结构示意图,下面从“智能信息链”(水平轴)和“it价值链”(垂直轴)两个维度对上述人工智能主题框架进行阐述。其中,“智能信息链”反映从数据的获取到处理的一列过程。举例来说,可以是智能信息感知、智能信息表示与形成、智能推理、智能决策、智能执行与输出的一般过程。在这个过程中,数据经历了“数据—信息—知识—智慧”的凝练过程。“it价值链”从人智能的底层基础设施、信息(提供和处理技术实现)到系统的产业生态过程,反映人工智能为信息技术产业带来的价值。

66.(1)基础设施

67.基础设施为人工智能系统提供计算能力支持,实现与外部世界的沟通,并通过基础平台实现支撑。通过传感器与外部沟通;计算能力由智能芯片(cpu、npu、gpu、asic、fpga等硬件加速芯片)提供;基础平台包括分布式计算框架及网络等相关的平台保障和支持,可以包括云存储和计算、互联互通网络等。举例来说,传感器和外部沟通获取数据,这些数据提供给基础平台提供的分布式计算系统中的智能芯片进行计算。

68.(2)数据

69.基础设施的上一层的数据用于表示人工智能领域的数据来源。数据涉及到图形、图像、语音、文本,还涉及到传统设备的物联网数据,包括已有系统的业务数据以及力、位移、液位、温度、湿度等感知数据。

70.(3)数据处理

71.数据处理通常包括数据训练,机器学习,深度学习,搜索,推理,决策等方式。

72.其中,机器学习和深度学习可以对数据进行符号化和形式化的智能信息建模、抽取、预处理、训练等。

73.推理是指在计算机或智能系统中,模拟人类的智能推理方式,依据推理控制策略,利用形式化的信息进行机器思维和求解问题的过程,典型的功能是搜索与匹配。

74.决策是指智能信息经过推理后进行决策的过程,通常提供分类、排序、预测等功能。

75.(4)通用能力

76.对数据经过上面提到的数据处理后,进一步基于数据处理的结果可以形成一些通用的能力,比如可以是算法或者一个通用系统,例如,翻译,文本的分析,计算机视觉的处理,语音识别,图像的识别等等。

77.(5)智能产品及行业应用

78.智能产品及行业应用指人工智能系统在各领域的产品和应用,是对人工智能整体

解决方案的封装,将智能信息决策产品化、实现落地应用,其应用领域主要包括:智能终端、智能交通、智能医疗、自动驾驶、智慧城市等。

79.首先介绍本技术的应用场景,本技术可以但不限于应用在包含基于图像或视频进行的人体动作捕捉以及还原功能的应用程序(以下可以简称为动作捕捉类应用程序)或者云侧服务器提供的云服务等,接下来分别进行介绍:

80.一、动作捕捉类应用程序

81.本技术实施例的产品形态可以为动作捕捉类应用程序。动作捕捉类应用程序可以运行在终端设备或者云侧的服务器上。

82.在一种可能的实现中,动作捕捉类应用程序可以实现基于包含人体的图像或视频进行的人体动作捕捉以及还原的任务,其中,动作捕捉类应用程序可以响应于输入的图像或者视频而执行人体动作捕捉以及还原的任务,得到人体动作对应的3d姿态信息,基于该3d姿态信息可以还原出一个虚拟的人物,该人物的姿态和图像或视频中的人体姿态一致或者接近一致。

83.在一种可能的实现中,用户可以打开终端设备上安装的动作捕捉类应用程序,并输入图像或视频(可以是主动的输入、也可以是被动的采集,例如通过终端设备上的相机采集得到),动作捕捉类应用程序可以通过本技术实施例提供的方法对图像或视频进行人体动作捕捉以及还原,并将3d姿态信息或者基于3d姿态信息还原得到的虚拟人物呈现给用户(呈现方式可以但不限于是显示、保存、上传到云侧等)。

84.在一种可能的实现中,用户可以打开终端设备上安装的动作捕捉类应用程序,并输入图像或视频(可以是主动的输入、也可以是被动的采集,例如通过终端设备上的相机采集得到),动作捕捉类应用程序可以将图像或视频发送至云侧的服务器,云侧的服务器通过本技术实施例提供的方法对图像或视频进行人体动作捕捉以及还原,并将3d姿态信息或者基于3d姿态信息还原得到的虚拟人物的信息回传至终端设备,终端设备可以将3d姿态信息或者基于3d姿态信息还原得到的虚拟人物呈现给用户(呈现方式可以但不限于是显示、保存、上传到云侧等)。

85.在一种可能的实现中,动作捕捉类应用程序实现的人体动作捕捉以及还原功能可以具体用于使能增强现实(augmented reality,ar)、虚拟现实(virtual reality,vr)、混合现实(mixed reality,mr)远程会议、运动健康、元宇宙等应用场景中的虚拟人物驱动等。

86.接下来分别从功能架构以及实现功能的产品架构介绍本技术实施例中的动作捕捉类应用程序。

87.参照图1b,图1b为本技术实施例中动作捕捉类应用程序的功能架构示意:

88.在一种可能的实现中,如图1b所示,动作捕捉类应用程序102可接收输入的参数101(例如包含人体的图像或视频)且产生3d姿态信息103(或者基于3d姿态信息还原得到的虚拟人物的信息)。动作捕捉类应用程序102可在(举例来说)至少一个计算机系统上执行,且包括计算机代码,所述计算机代码在由一或多个计算机执行时致使所述计算机执行用于执行本文中所描述的数据处理方法。

89.参照图2,图2为本技术实施例中运行动作捕捉类应用程序的实体架构示意:

90.参见图2,图2示出了一种系统架构示意图。该系统可以包括终端100、以及服务器200。其中,服务器200可以包括一个或者多个服务器(图2中以包括一个服务器作为示例进

行说明),服务器200可以为一个或者多个终端提供动作捕捉功能服务。

91.其中,终端100上可以安装有动作捕捉类应用程序,或者打开与动作捕捉功能相关的网页,上述应用程序和网页可以提供一个界面,终端100可以接收用户在动作捕捉功能界面上输入的相关参数,并将上述参数发送至服务器200,服务器200可以基于接收到的参数,得到处理结果,并将处理结果返回至至终端100。

92.应理解,在一些可选的实现中,终端100也可以由自身完成基于接收到的参数,得到数据处理结果的动作,而不需要服务器配合实现,本技术实施例并不限定。

93.接下来描述图2中终端100的产品形态;

94.本技术实施例中的终端100可以为手机、平板电脑、可穿戴设备、车载设备、增强现实(augmented reality,ar)/虚拟现实(virtual reality,vr)设备、笔记本电脑、超级移动个人计算机(ultra-mobile personal computer,umpc)、上网本、个人数字助理(personal digital assistant,pda)等,本技术实施例对此不作任何限制。

95.图3示出了终端100的一种可选的硬件结构示意图。

96.参考图3所示,终端100可以包括射频单元110、存储器120、输入单元130、显示单元140、摄像头150(可选的)、音频电路160(可选的)、扬声器161(可选的)、麦克风162(可选的)、处理器170、外部接口180、电源190等部件。本领域技术人员可以理解,图3仅仅是终端或多功能设备的举例,并不构成对终端或多功能设备的限定,可以包括比图示更多或更少的部件,或者组合某些部件,或者不同的部件。

97.输入单元130可用于接收输入的数字或字符信息,以及产生与该便携式多功能装置的用户设置以及功能控制有关的键信号输入。具体地,输入单元130可包括触摸屏131(可选的)和/或其他输入设备132。该触摸屏131可收集用户在其上或附近的触摸操作(比如用户使用手指、关节、触笔等任何适合的物体在触摸屏上或在触摸屏附近的操作),并根据预先设定的程序驱动相应的连接装置。触摸屏可以检测用户对触摸屏的触摸动作,将该触摸动作转换为触摸信号发送给该处理器170,并能接收该处理器170发来的命令并加以执行;该触摸信号至少包括触点坐标信息。该触摸屏131可以提供该终端100和用户之间的输入界面和输出界面。此外,可以采用电阻式、电容式、红外线以及表面声波等多种类型实现触摸屏。除了触摸屏131,输入单元130还可以包括其他输入设备。具体地,其他输入设备132可以包括但不限于物理键盘、功能键(比如音量控制按键132、开关按键133等)、轨迹球、鼠标、操作杆等中的一种或多种。

98.其中,输入设备132可以接收到输入的图像或者视频等等。

99.该显示单元140可用于显示由用户输入的信息或提供给用户的信息、终端100的各种菜单、交互界面、文件显示和/或任意一种多媒体文件的播放。在本技术实施例中,显示单元140可用于显示动作捕捉类应用程序的界面、基于图像或者视频得到的虚拟人等。

100.该存储器120可用于存储指令和数据,存储器120可主要包括存储指令区和存储数据区,存储数据区可存储各种数据,如多媒体文件、文本等;存储指令区可存储操作系统、应用、至少一个功能所需的指令等软件单元,或者他们的子集、扩展集。还可以包括非易失性随机存储器;向处理器170提供包括管理计算处理设备中的硬件、软件以及数据资源,支持控制软件和应用。还用于多媒体文件的存储,以及运行程序和应用的存储。

101.处理器170是终端100的控制中心,利用各种接口和线路连接整个终端100的各个

部分,通过运行或执行存储在存储器120内的指令以及调用存储在存储器120内的数据,执行终端100的各种功能和处理数据,从而对终端设备进行整体控制。可选的,处理器170可包括一个或多个处理单元;优选的,处理器170可集成应用处理器和调制解调处理器,其中,应用处理器主要处理操作系统、用户界面和应用程序等,调制解调处理器主要处理无线通信。可以理解的是,上述调制解调处理器也可以不集成到处理器170中。在一些实施例中,处理器、存储器、可以在单一芯片上实现,在一些实施例中,他们也可以在独立的芯片上分别实现。处理器170还可以用于产生相应的操作控制信号,发给计算处理设备相应的部件,读取以及处理软件中的数据,尤其是读取和处理存储器120中的数据和程序,以使其中的各个功能模块执行相应的功能,从而控制相应的部件按指令的要求进行动作。

102.其中,存储器120可以用于存储数据处理方法相关的软件代码,处理器170可以执行芯片的数据处理方法的步骤,也可以调度其他单元(例如上述输入单元130以及显示单元140)以实现相应的功能。

103.该射频单元110(可选的)可用于收发信息或通话过程中信号的接收和发送,例如,将基站的下行信息接收后,给处理器170处理;另外,将设计上行的数据发送给基站。通常,rf电路包括但不限于天线、至少一个放大器、收发信机、耦合器、低噪声放大器(low noise amplifier,lna)、双工器等。此外,射频单元110还可以通过无线通信与网络设备和其他设备通信。该无线通信可以使用任一通信标准或协议,包括但不限于全球移动通讯系统(global system of mobile communication,gsm)、通用分组无线服务(general packet radio service,gprs)、码分多址(code division multiple access,cdma)、宽带码分多址(wideband code division multiple access,wcdma)、长期演进(long term evolution,lte)、电子邮件、短消息服务(short messaging service,sms)等。

104.其中,在本技术实施例中,该射频单元110可以将图像或者视频发送至服务器200,并接收到服务器200发送的3d姿态信息或者基于3d姿态信息还原得到的虚拟人物的信息。

105.应理解,该射频单元110为可选的,其可以被替换为其他通信接口,例如可以是网口。

106.终端100还包括给各个部件供电的电源190(比如电池),优选的,电源可以通过电源管理系统与处理器170逻辑相连,从而通过电源管理系统实现管理充电、放电、以及功耗管理等功能。

107.终端100还包括外部接口180,该外部接口可以是标准的micro usb接口,也可以使多针连接器,可以用于连接终端100与其他装置进行通信,也可以用于连接充电器为终端100充电。

108.尽管未示出,终端100还可以包括闪光灯、无线保真(wireless fidelity,wifi)模块、蓝牙模块、不同功能的传感器等,在此不再赘述。下文中描述的部分或全部方法均可以应用在如图3所示的终端100中。

109.接下来描述图2中服务器200的产品形态;

110.图4提供了一种服务器200的结构示意图,如图4所示,服务器200包括总线201、处理器202、通信接口203和存储器204。处理器202、存储器204和通信接口203之间通过总线201通信。

111.总线201可以是外设部件互连标准(peripheral component interconnect,pci)

总线或扩展工业标准结构(extended industry standard architecture,eisa)总线等。总线可以分为地址总线、数据总线、控制总线等。为便于表示,图4中仅用一条粗线表示,但并不表示仅有一根总线或一种类型的总线。

112.处理器202可以为中央处理器(central processing unit,cpu)、图形处理器(graphics processing unit,gpu)、微处理器(micro processor,mp)或者数字信号处理器(digital signal processor,dsp)等处理器中的任意一种或多种。

113.存储器204可以包括易失性存储器(volatile memory),例如随机存取存储器(random access memory,ram)。存储器204还可以包括非易失性存储器(non-volatile memory),例如只读存储器(read-only memory,rom),快闪存储器,机械硬盘(hard drive drive,hdd)或固态硬盘(solid state drive,ssd)。

114.其中,存储器204可以用于存储数据处理方法相关的软件代码,处理器202可以执行芯片的数据处理方法的步骤,也可以调度其他单元以实现相应的功能。

115.应理解,上述终端100和服务器200可以为集中式或者是分布式的设备,上述终端100和服务器200中的处理器(例如处理器170以及处理器202)可以为硬件电路(如专用集成电路(application specific integrated circuit,asic)、现场可编程门阵列(field-programmable gate array,fpga)、通用处理器、数字信号处理器(digital signal processing,dsp)、微处理器或微控制器等等)、或这些硬件电路的组合,例如,处理器可以为具有执行指令功能的硬件系统,如cpu、dsp等,或者为不具有执行指令功能的硬件系统,如asic、fpga等,或者为上述不具有执行指令功能的硬件系统以及具有执行指令功能的硬件系统的组合。

116.应理解,本技术实施例中的和模型推理过程相关的步骤涉及ai相关的运算,在执行ai运算时,终端设备和服务器的指令执行架构不仅仅局限在上述介绍的处理器结合存储器的架构。下面结合图5对本技术实施例提供的系统架构进行详细的介绍。

117.图5为本技术实施例提供的系统架构示意图。如图5所示,系统架构500包括执行设备510、训练设备520、数据库530、客户设备540、数据存储系统550以及数据采集系统560。

118.执行设备510包括计算模块511、i/o接口512、预处理模块513和预处理模块514。计算模块511中可以包括目标模型/规则501,预处理模块513和预处理模块514是可选的。

119.其中,执行设备510可以为上述运行人物动作捕捉类应用程序的终端设备或者服务器。

120.数据采集设备560用于采集训练样本。训练样本可以为图像或者视频,以及对图像或者视频中的人物的标注(例如二维投影信息)等。在采集到训练样本之后,数据采集设备560将这些训练样本存入数据库530。

121.训练设备520可以基于数据库530中维护训练样本,对待训练的神经网络(例如本技术实施例中的第二姿态识别模型等),以得到目标模型/规则501。

122.需要说明的是,在实际应用中,数据库530中维护的训练样本不一定都来自于数据采集设备560的采集,也有可能是从其他设备接收得到的。另外需要说明的是,训练设备520也不一定完全基于数据库530维护的训练样本进行目标模型/规则501的训练,也有可能从云端或其他地方获取训练样本进行模型训练,上述描述不应该作为对本技术实施例的限定。

123.根据训练设备520训练得到的目标模型/规则501可以应用于不同的系统或设备中,如应用于图5所示的执行设备510,该执行设备510可以是终端,如手机终端,平板电脑,笔记本电脑,增强现实(augmented reality,ar)/虚拟现实(virtual reality,vr)设备,车载终端等,还可以是服务器等。

124.具体的,训练设备520可以将训练后的模型传递至执行设备510。

125.在图5中,执行设备510配置输入/输出(input/output,i/o)接口512,用于与外部设备进行数据交互,用户可以通过客户设备540向i/o接口512输入数据(例如本技术实施例中图像或者视频等)。

126.预处理模块513和预处理模块514用于根据i/o接口512接收到的输入数据进行预处理。应理解,可以没有预处理模块513和预处理模块514或者只有的一个预处理模块。当不存在预处理模块513和预处理模块514时,可以直接采用计算模块511对输入数据进行处理。

127.在执行设备510对输入数据进行预处理,或者在执行设备510的计算模块511执行计算等相关的处理过程中,执行设备510可以调用数据存储系统550中的数据、代码等以用于相应的处理,也可以将相应处理得到的数据、指令等存入数据存储系统550中。

128.最后,i/o接口512将处理结果(例如3d姿态信息或者基于3d姿态信息还原得到的虚拟人物的信息等)提供给客户设备540,从而提供给用户。

129.在图5所示情况下,用户可以手动给定输入数据,该“手动给定输入数据”可以通过i/o接口512提供的界面进行操作。另一种情况下,客户设备540可以自动地向i/o接口512发送输入数据,如果要求客户设备540自动发送输入数据需要获得用户的授权,则用户可以在客户设备540中设置相应权限。用户可以在客户设备540查看执行设备510输出的结果,具体的呈现形式可以是显示、声音、动作等具体方式。客户设备540也可以作为数据采集端,采集如图所示输入i/o接口512的输入数据及输出i/o接口512的输出结果作为新的样本数据,并存入数据库530。当然,也可以不经过客户设备540进行采集,而是由i/o接口512直接将如图所示输入i/o接口512的输入数据及输出i/o接口512的输出结果,作为新的样本数据存入数据库530。

130.值得注意的是,图5仅是本技术实施例提供的一种系统架构的示意图,图中所示设备、器件、模块等之间的位置关系不构成任何限制,例如,在图5中,数据存储系统550相对执行设备510是外部存储器,在其它情况下,也可以将数据存储系统550置于执行设备510中。应理解,上述执行设备510可以部署于客户设备540中。

131.从模型的推理侧来说:

132.本技术实施例中,上述执行设备520的计算模块511可以获取到数据存储系统550中存储的代码来实现本技术实施例中的和模型推理过程相关的步骤。

133.本技术实施例中,执行设备520的计算模块511可以包括硬件电路(如专用集成电路(application specific integrated circuit,asic)、现场可编程门阵列(field-programmable gate array,fpga)、通用处理器、数字信号处理器(digital signal processing,dsp)、微处理器或微控制器等等)、或这些硬件电路的组合,例如,训练设备520可以为具有执行指令功能的硬件系统,如cpu、dsp等,或者为不具有执行指令功能的硬件系统,如asic、fpga等,或者为上述不具有执行指令功能的硬件系统以及具有执行指令功能的硬件系统的组合。

134.具体的,执行设备520的计算模块511可以为具有执行指令功能的硬件系统,本技术实施例提供的和模型推理过程相关的步骤可以为存储在存储器中的软件代码,执行设备520的计算模块511可以从存储器中获取到软件代码,并执行获取到的软件代码来实现本技术实施例提供的和模型推理过程相关的步骤。

135.应理解,执行设备520的计算模块511可以为不具有执行指令功能的硬件系统以及具有执行指令功能的硬件系统的组合,本技术实施例提供的和模型推理过程相关的步骤的部分步骤还可以通过执行设备520的计算模块511中不具有执行指令功能的硬件系统来实现,这里并不限定。

136.从模型的训练侧来说:

137.本技术实施例中,上述训练设备520可以获取到存储器(图5中未示出,可以集成于训练设备520或者与训练设备520分离部署)中存储的代码来实现本技术实施例中和模型训练相关的步骤。

138.本技术实施例中,训练设备520可以包括硬件电路(如专用集成电路(application specific integrated circuit,asic)、现场可编程门阵列(field-programmable gate array,fpga)、通用处理器、数字信号处理器(digital signal processing,dsp)、微处理器或微控制器等等)、或这些硬件电路的组合,例如,训练设备520可以为具有执行指令功能的硬件系统,如cpu、dsp等,或者为不具有执行指令功能的硬件系统,如asic、fpga等,或者为上述不具有执行指令功能的硬件系统以及具有执行指令功能的硬件系统的组合。

139.应理解,训练设备520可以为不具有执行指令功能的硬件系统以及具有执行指令功能的硬件系统的组合,本技术实施例提供的中和模型训练相关的部分步骤还可以通过训练设备520中不具有执行指令功能的硬件系统来实现,这里并不限定。

140.二、服务器提供的动作捕捉功能类云服务:

141.在一种可能的实现中,服务器可以通过应用程序编程接口(application programming interface,api)为端侧提供动作捕捉功能的服务。

142.其中,终端设备可以通过云端提供的api,将相关参数(例如包含人体的图像或者视频)发送至服务器,服务器可以基于接收到的参数,得到处理结果(例如3d姿态信息或者基于3d姿态信息还原得到的虚拟人物的信息等),并将处理结果返回至至终端。

143.关于终端以及服务器的描述可以上述实施例的描述,这里不再赘述。

144.如图6示出了使用一项云平台提供的动作捕捉功能类云服务的流程。

145.1.开通并购买内容审核服务。

146.2.用户可以下载内容审核服务对应的软件开发工具包(software development kit,sdk),通常云平台提供多个开发版本的sdk,供用户根据开发环境的需求选择,例如java版本的sdk、python版本的sdk、php版本的sdk、android版本的sdk等。

147.3.用户根据需求下载对应版本的sdk到本地后,将sdk工程导入至本地开发环境,在本地开发环境中进行配置和调试,本地开发环境还可以进行其他功能的开发,使得形成一个集合了动作捕捉功能类能力的应用。

148.4.动作捕捉功能类应用在被使用的过程中,当需要进行动作捕捉功能时,可以触发动作捕捉功能的api调用。当应用触发动作捕捉功能功能时,发起api请求至云环境中的动作捕捉功能类服务的运行实例,其中,api请求中携带图像或者视频,由云环境中的运行

实例对图像或者视频进行处理,获得处理结果(例如3d姿态信息或者基于3d姿态信息还原得到的虚拟人物的信息等)。

149.5.云环境将处理结果返回至应用,由此完成一次的动作捕捉功能服务调用。

150.三、服务器提供的模型训练类云服务:

151.在一种可能的实现中,服务器可以基于客户提供的图像或者视频,来提供一个适配于该图像或者视频中人物对象(或者更泛化的人物)的动作捕捉功能的模型。

152.在一种可能的实现中,服务器可以通过应用程序编程接口(application programming interface,api)为端侧提供配图信息还原的服务。

153.其中,终端设备可以通过云端提供的api,将相关参数(例如图像或者视频)发送至服务器,服务器可以基于接收到的参数,得到处理结果,并将处理结果(例如适配于该图像或者视频中人物对象(或者更泛化的人物)的动作捕捉功能的模型等)返回至终端。

154.如图7示出了使用一项云平台提供的模型训练类云服务的流程。

155.关于终端以及服务器的描述可以上述实施例的描述,这里不再赘述。

156.由于本技术实施例涉及大量神经网络的应用,为了便于理解,下面先对本技术实施例涉及的相关术语及神经网络等相关概念进行介绍。

157.(1)神经网络

158.神经网络可以是由神经单元组成的,神经单元可以是指以xs和截距1为输入的运算单元,该运算单元的输出可以为:

[0159][0160]

其中,s=1、2、

……

n,n为大于1的自然数,ws为xs的权重,b为神经单元的偏置。f为神经单元的激活函数(activation functions),用于将非线性特性引入神经网络中,来将神经单元中的输入信号转换为输出信号。该激活函数的输出信号可以作为下一层卷积层的输入。激活函数可以是sigmoid函数。神经网络是将许多个上述单一的神经单元联结在一起形成的网络,即一个神经单元的输出可以是另一个神经单元的输入。每个神经单元的输入可以与前一层的局部接受域相连,来提取局部接受域的特征,局部接受域可以是由若干个神经单元组成的区域。

[0161]

(2)深度神经网络

[0162]

深度神经网络(deep neural network,dnn),可以理解为具有很多层隐含层的神经网络,这里的“很多”并没有特别的度量标准,我们常说的多层神经网络和深度神经网络其本质上是同一个东西。从dnn按不同层的位置划分,dnn内部的神经网络可以分为三类:输入层,隐含层,输出层。一般来说第一层是输入层,最后一层是输出层,中间的层数都是隐含层。层与层之间是全连接的,也就是说,第i层的任意一个神经元一定与第i 1层的任意一个神经元相连。虽然dnn看起来很复杂,但是就每一层的工作来说,其实并不复杂,简单来说就是如下线性关系表达式:其中,是输入向量,是输出向量,是偏移向量,w是权重矩阵(也称系数),α()是激活函数。每一层仅仅是对输入向量经过如此简单的操作得到输出向量由于dnn层数多,则系数w和偏移向量的数量也就是很多了。那么,具体的参数在dnn是如何定义的呢?首先我们来看看系数w的定义。以一个三层的dnn为例,如:第

二层的第4个神经元到第三层的第2个神经元的线性系数定义为上标3代表系数w所在的层数,而下标对应的是输出的第三层索引2和输入的第二层索引4。总结下,第l-1层的第k个神经元到第l层的第j个神经元的系数定义为注意,输入层是没有w参数的。在深度神经网络中,更多的隐含层让网络更能够刻画现实世界中的复杂情形。理论上而言,参数越多的模型复杂度越高,“容量”也就越大,也就意味着它能完成更复杂的学习任务。

[0163]

(3)卷积神经网络(convosutionas neuras network,cnn)是一种带有卷积结构的深度神经网络。卷积神经网络包含了一个由卷积层和子采样层构成的特征抽取器。该特征抽取器可以看作是滤波器,卷积过程可以看作是使用一个可训练的滤波器与一个输入的图像或者卷积特征平面(feature map)做卷积。卷积层是指卷积神经网络中对输入信号进行卷积处理的神经元层。在卷积神经网络的卷积层中,一个神经元可以只与部分邻层神经元连接。一个卷积层中,通常包含若干个特征平面,每个特征平面可以由一些矩形排列的神经单元组成。同一特征平面的神经单元共享权重,这里共享的权重就是卷积核。共享权重可以理解为提取图像信息的方式与位置无关。这其中隐含的原理是:图像的某一部分的统计信息与其他部分是一样的。即意味着在某一部分学习的图像信息也能用在另一部分上。所以对于图像上的所有位置,我们都能使用同样的学习得到的图像信息。在同一卷积层中,可以使用多个卷积核来提取不同的图像信息,一般地,卷积核数量越多,卷积操作反映的图像信息越丰富。

[0164]

卷积核可以以随机大小的矩阵的形式初始化,在卷积神经网络的训练过程中卷积核可以通过学习得到合理的权重。另外,共享权重带来的直接好处是减少卷积神经网络各层之间的连接,同时又降低了过拟合的风险。

[0165]

(4)反向传播算法

[0166]

卷积神经网络可以采用误差反向传播(back propagation,bp)算法在训练过程中修正初始的超分辨率模型中参数的大小,使得超分辨率模型的重建误差损失越来越小。具体地,前向传递输入信号直至输出会产生误差损失,通过反向传播误差损失信息来更新初始的超分辨率模型中参数,从而使误差损失收敛。反向传播算法是以误差损失为主导的反向传播运动,旨在得到最优的超分辨率模型的参数,例如权重矩阵。

[0167]

(5)损失函数

[0168]

在训练深度神经网络的过程中,因为希望深度神经网络的输出尽可能的接近真正想要预测的值,所以可以通过比较当前网络的预测值和真正想要的目标值,再根据两者之间的差异情况来更新每一层神经网络的权重向量(当然,在第一次更新之前通常会有初始化的过程,即为深度神经网络中的各层预先配置参数),比如,如果网络的预测值高了,就调整权重向量让它预测低一些,不断地调整,直到深度神经网络能够预测出真正想要的目标值或与真正想要的目标值非常接近的值。因此,就需要预先定义“如何比较预测值和目标值之间的差异”,这便是损失函数(loss function)或目标函数(objective function),它们是用于衡量预测值和目标值的差异的重要方程。其中,以损失函数举例,损失函数的输出值(loss)越高表示差异越大,那么深度神经网络的训练就变成了尽可能缩小这个loss的过程。

[0169]

(6)反向传播算法

[0170]

神经网络可以采用误差反向传播(back propagation,bp)算法在训练过程中修正

初始的神经网络模型中参数的大小,使得神经网络模型的重建误差损失越来越小。具体地,前向传递输入信号直至输出会产生误差损失,通过反向传播误差损失信息来更新初始的神经网络模型中参数,从而使误差损失收敛。反向传播算法是以误差损失为主导的反向传播运动,旨在得到最优的神经网络模型的参数,例如权重矩阵。

[0171]

人体动作捕捉技术是影视、游戏行业中常用的技术,该技术可对输入的视频流进行处理,以捕捉每一帧图像中人体的姿态,从而得到人体的运动信息。基于这种技术,可以从海量的视频中提取人体运动时的姿态数据,具有广阔的应用场景,例如,增强现实(augmented reality,ar)场景和虚拟现实(virtual reality,vr)场景中的虚拟人物驱动、远程会议以及元宇宙等等。

[0172]

目前,可基于ai技术中实现人体动作捕捉。具体地,对于某一个图像而言,可通过已训练的神经网络对该图像进行处理,从而得到姿态参数,该姿态参数可用于确定人体的姿态。

[0173]

然而现有技术中采用的神经网络是仅基于二维投影信息构建的损失进行更新的,虽然可以做到预测的姿态和图像或者视频中姿态之间的像素级的对齐,但是预测的姿态会出现动作畸形、不合理的问题。

[0174]

为了解决上述问题,本技术实施例提供了一种数据处理方法。下面结合附图对本技术实施例的数据处理方法进行详细的介绍。

[0175]

参照图8,图8为本技术实施例提供的一种数据处理方法的流程示意,如图8所示,本技术实施例提供的一种数据处理方法,可以包括步骤801至804,下面分别对这些步骤进行详细的描述。

[0176]

801、获取目标图像。

[0177]

在一种可能的实现中,在对用于进行人物动作捕捉(或者称之为姿态识别)的模型训练时,需要获取到训练样本,该训练样本可以包括图像以及图像对应的标注,其中,标注可以包括预先标注的目标图像中目标对象(例如人物)的二维投影信息,二维投影信息的对应的标注可以为人工预先标注的,或者是通过预训练的神经网络处理目标图像得到的。

[0178]

此外,标注还可以包括通过预先训练的神经网络根据目标图像识别出的目标对象的信息(例如姿态信息、体型信息等)。

[0179]

本实施例中,目标图像可以为视频流中的某一帧图像,也可以为单独的一个图像。目标图像通常呈现有目标对象和目标对象所处的环境,那么,姿态识别的目标是为了获取目标图像中目标对象的姿态。例如,如图9所示(图9为本技术实施例提供的姿态识别的一个应用例示意图),目标图像所呈现的内容为人体以及人体所处的环境,故对目标图像的姿态识别目标为识别人体在目标图像中所呈现的姿态。

[0180]

得到目标图像后,可对目标图像进行检测处理,以确定目标图像中的目标区域。还可获取目标区域在目标图像中的位置信息,并对其进行归一化。

[0181]

在一种可能的实现方式中,目标对象为人体。

[0182]

802、通过第一姿态识别模型,对所述目标图像进行处理,得到所述目标图像中目标对象的第一姿态信息。

[0183]

在一种可能的实现中,对于需要训练的姿态识别模型,通常在前馈过程中可以输出用于描述所述目标对象的三维姿态的信息,将该信息进行二维关键点的优化,也就是通

过一定的映射方式得到二维投影信息,并通过得到的二维投影信息和对应的标注的差异所构建的损失来更新姿态识别模型,进而使得更新后的姿态识别模型输出的姿态信息所确定的姿态可以和图像中人物对象的姿态实现像素级的对齐,然而这种方式会导致所确定的姿态出现畸形、不正常的情况,例如可以参照图10所示。

[0184]

本技术实施例中,通过引入一个不会或基本不会出现畸形的姿态信息作为训练姿态识别模型时的监督信号(或者称之为先验信息),来保证一方面更新后的姿态识别模型输出的姿态信息所确定的姿态可以和图像中人物对象的姿态实现像素级的对齐,另一方面所确定的姿态不会出现畸形(或者基本不会出现畸形)的情况。

[0185]

在一种可能的实现中,上述所引入的监督信号(或者称之为先验信息)可以由第一姿态识别模型来提供。

[0186]

在一种可能的实现中,所述第一姿态识别模型为根据输出的姿态信息和对应的标注构建的损失训练得到的。

[0187]

其中,第一姿态识别模型可以基于端到端的方式,通过处理图像得到目标图像中目标对象的姿态信息。其中,姿态参数通常由两部分参数构成,一部分参数用于指示目标对象相对于相机的旋转角,另一部分参数用于指示目标对象自身各个关节之间的夹角。可选的,另一部分参数还可以用于指示目标对象上的三维坐标点的位置。

[0188]

在一种可能的实现中,第一姿态信息可以用于描述所述目标对象的三维姿态,例如可以指示目标对象自身各个关节之间的夹角、或者用于指示目标对象上的三维坐标点的位置。

[0189]

在对第一姿态识别模型进行训练的过程中,可以直接基于第一姿态识别模型通过处理图像输出的姿态信息和对应的标注(也就是姿态信息的真值)之间的差异来构建损失,进而使得第一姿态识别模型可以具备识别出较好的姿态信息的能力,基于该第一姿态识别模型得到的姿态信息所确定的姿态是合理且没有畸形的(这里所谓的没有畸形,可以理解为是正常的人体能够做出的动作)。当然,由于第一姿态识别模型输出的姿态信息用于描述所述目标对象的三维姿态,且在训练过程中,没有对其进行二维的优化处理(例如进行2d关键点的优化),因此,最终确定的姿态可能会出现和图像中人物姿态无法严格对齐的情况,例如可以参照11。

[0190]

在一种可能的实现中,可以通过第一姿态识别模型,对所述目标图像进行处理,得到所述目标图像中目标对象的第一姿态信息。

[0191]

在一种可能的实现中,可以通过第一姿态识别模型,对所述目标图像进行处理,还得到所述目标图像中目标对象的第一体型信息(可选的,还可以输出位移参数)。

[0192]

其中,第一体型信息也可以称之为形状参数(shape),用于指示目标对象的三维形状。位移参数用于指示目标对象在目标区域中所占的幅度,以及目标对象在目标区域中的偏移量(例如,以目标区域的中心点为参考点,目标对象向左偏移的程度或向右偏移的程度)。

[0193]

在使用第一姿态识别模型进行模型推理的过程中,基于第一姿态识别模型输出的第一姿态信息、形状参数和位移参数,可得到目标对象的姿态,目标对象的姿态可通过目标对象的多个三维关键点(3d关键点)进行表示,这些三维关键点可描述目标对象在相机坐标系中的朝向(即目标对象相对于相机的朝向)以及目标对象在相机坐标系中的肢体行为(即

目标对象在三维空间中的动作),其中,该相机坐标系的原点为拍摄目标图像的相机。依旧如上述例子,如图9所示,姿态识别模型输出第一姿态信息θ、形状参数β和位移参数s、t后,可对这些参数进行计算,得到目标对象的多个3d关键点,这些3d关键点组合在一起,可呈现出目标对象在相机坐标系中的朝向以及目标对象在相机坐标系中的肢体行为。

[0194]

可选的,为了减小第一姿态识别模型的计算量,可对目标图像进行预处理。具体地,可对目标图像进行检测,以确定目标图像中目标对象所在的区域,该区域可称为目标区域(也可以称为检测框)。依旧如上述的例子,在检测出目标图像中人体所在区域后,可将人体所在区域确定为目标区域(即图9中框围住的区域)。

[0195]

进一步地,还可获取目标区域在目标图像中的位置信息,该位置信息可存在多种情况:(1)目标区域在目标图像中的位置信息包括目标区域的中心点在图像坐标系中的坐标以及目标区域的尺寸,图像坐标系基于目标图像构建。具体地,可以目标图像的某一个顶点(例如,目标图像左上角的顶点)作为图像坐标系的原点,那么,可确定目标区域的中心点在该图像坐标系中的坐标,以及目标区域的长和宽(也就相当于得到了目标区域的尺寸),这些信息可用于指示目标区域在目标图像中的位置。(2)目标区域在目标图像中的位置信息包括目标区域的顶点在图像坐标系中的坐标,图像坐标系基于目标图像构建。具体地,可以目标图像的某一个顶点(例如,目标图像左上角的顶点)作为图像坐标系的原点,那么,可确定目标区域的所有顶点在该图像坐标系中的坐标,这些信息可用于指示目标区域在目标图像中的位置等等。

[0196]

更进一步地,得到目标区域在目标图像中的位置信息后,还可对该位置信息进行归一化处理,得到归一化处理后的目标区域在目标图像中的位置信息。具体地,设目标区域在目标图像中的位置信息为i,归一化处理后的目标区域在目标图像中的位置信息为i’,那么,i’=(i-mean(i))/f,f=sqrt(w

×

w h

×

h)其中,mean(i)为目标区域的均值,w为目标区域的宽,h为目标区域的长,f可以表示焦距,在一种实现中f可以通过上述公式推算得到,在另一种实现中,f可以直接从拍摄图像的相机的参数中获取到。如此一来,得到归一化处理后的信息后,有利于实现后续模型的姿态识别操作。

[0197]

得到目标区域以及归一化后的目标区域在目标图像中的位置信息后,可将目标区域以及归一化后的目标区域在目标图像中的位置信息输入至第一姿态识别模型(为已训练的神经网络),以通过第一姿态识别模型对目标图像的目标区域以及归一化后的目标区域在目标图像中的位置信息进行处理(例如,特征提取等一系列操作),得到第一姿态信息。

[0198]

第一姿态信息可以作为模型训练的先验约束

[0199][0200]

其中,i为目标图像。

[0201]

803、通过第二姿态识别模型,对所述目标图像进行处理,得到所述目标图像中目标对象的第二姿态信息;所述第一姿态信息和所述第二姿态信息用于描述所述目标对象的三维姿态;所述第二姿态信息用于确定所述目标对象的预测姿态的二维投影信息。

[0202]

其中,第二姿态识别模型为需要进行训练的模型,在进行前馈的过程中,可以通过第二姿态识别模型,对所述目标图像进行处理,得到所述目标图像中目标对象的第二姿态信息;第二姿态识别模型的网络结构可以和第一姿态识别模型的网络结构一致或者相似,和第一姿态识别模型不同的是,在训练第二姿态识别模型时的损失还包括对第二姿态识别

模型输出的第二姿态信息进行2d关键点的优化得到的二维投影信息、以及该二维投影信息对应的标注值之间的差异。

[0203]

在一种可能的实现中,二维投影信息可以包括目标图像中目标对象的2d关键点、部件分割、密集关键点估计等2d结果。

[0204]

804、根据所述第一姿态信息和所述第二姿态信息、以及所述二维投影信息和对应的标注构建损失,所述损失用于更新所述第二姿态识别模型。

[0205]

在一种可能的实现中,在对第二姿态识别模型进行训练时前馈过程的输出可以为第二姿态信息,以及基于第二姿态信息得到的二维投影信息;相应的,第一姿态信息可以作为第二姿态信息的监督信号,二维投影信息对应的标注可以作为二维投影信息的监督信号,进而构建损失。

[0206]

在一种可能的实现中,可以根据所述第一姿态信息和所述第二姿态信息(之间的差异)、以及所述二维投影信息和对应的标注(之间的差异)构建损失,所述损失用于更新所述第二姿态识别模型。

[0207]

在一种可能的实现中,第一姿态识别模型输出的信息还可以包括第一体型信息,可以根据第一体型信息和对应的监督信号(第二体型信息)构建损失,也就是说,损失可以包含根据所述第一姿态信息和所述第二姿态信息之间的差异、第一体型信息和对应的监督信号(第二体型信息)之间的差异、以及所述二维投影信息和对应的标注之间的差异。

[0208]

示例性的,损失可以为:

[0209][0210]

其中,表示二维投影信息和对应的标注之间的差异,可以表示第一姿态信息和所述第二姿态信息之间的差异(可选的,还可以包括第一体型信息和对应的监督信号(第二体型信息)之间的差异)。其中,尽管先验信息不是很精准,但仍可服从真实合理的估计分布。

[0211]

然后,可基于损失对待训练模型(也就是本技术实施例中的第二姿态识别模型)的模型参数进行更新,并利用下一批训练样本对更新参数后的待训练模型进行训练,直至满足模型训练条件(例如,目标损失达到收敛、或者是训练迭代次数达到预设次数等等)。

[0212]

通过上述方式,利用2d预测结果做弱监督信息,和先验模型(第一姿态识别模型)推理结果做约束,在目标视频上精调推理模型(第二姿态识别模型),得到最终的精调模型。

[0213]

在一种可能的实现中,所述目标图像为原始图像中所述目标对象所处的图像区域,在计算二维投影信息时,所述二维投影信息表示为所述预测姿态的二维投影在所述原始图像中所处的位置,也就是说,可以在全图上计算重投影误差,更贴近图片形成时的投影过程。

[0214]

具体可以参照图12a所示的那样,其中,图12a中的(a)为现有的重投影误差计算法方法,图12a中的(b)为本技术提供的一种重投影误差计算法方法。

[0215]

可选的,裁剪图的弱透视投影转换到全图的透视投影的转换公式可以示例性的为:

[0216]

[0217][0218][0219]

应理解,若目标图像为视频流中的某一帧图像,对于视频流中的其余帧图像,也可执行如同对目标图像所执行的操作,以得到目标对象的连续多个姿态,形成目标对象的运动信息,从而满足用户的各种应用需求。

[0220]

在一种可能的实现中,在通过上述方式得到更新后的第二姿态识别模型之后,可以通过更新后的所述第二姿态识别模型,处理所述目标图像,得到所述目标图像中目标对象的第三姿态信息;所述第三姿态信息用于确定所述目标对象的姿态。类似的,对于视频流中的其余帧图像,也可执行如同对目标图像所执行的操作,以得到目标对象的连续多个姿态,形成目标对象的运动信息。

[0221]

在一种可能的实现中,在得到上述第三姿态信息之后,可以向用户设备发送通过更新后的所述第二姿态识别模型处理所述目标图像得到的所述目标对象的姿态;或者,向用户设备发送所述更新后的所述第二姿态识别模型。

[0222]

参照图12b和图12c,分别示出了本技术提供的数据处理方法的具体示意。其中,图12c中的先验模型可以为第一姿态识别模型,2d人体估计模型为第二姿态识别模型以及之后的二维投影映射,推理模型为更新后的第二姿态识别模型。

[0223]

本技术实施例提供了一种数据处理方法,包括:获取目标图像;通过第一姿态识别模型,对所述目标图像进行处理,得到所述目标图像中目标对象的第一姿态信息;通过第二姿态识别模型,对所述目标图像进行处理,得到所述目标图像中目标对象的第二姿态信息;所述第一姿态信息和所述第二姿态信息用于描述所述目标对象的三维姿态;所述第二姿态信息用于确定所述目标对象的预测姿态的二维投影信息;根据所述第一姿态信息和所述第二姿态信息、以及所述二维投影信息和对应的标注构建损失,所述损失用于更新所述第二姿态识别模型。

[0224]

对于需要训练的姿态识别模型,通常在前馈过程中可以输出用于描述所述目标对象的三维姿态的信息,将该信息进行二维关键点的优化,也就是通过一定的映射方式得到二维投影信息,并通过得到的二维投影信息和对应的标注的差异所构建的损失来更新姿态识别模型,进而使得更新后的姿态识别模型输出的姿态信息所确定的姿态可以和图像中人物对象的姿态实现像素级的对齐,然而这种方式会导致所确定的姿态出现畸形、不正常的情况。本技术实施例中,通过引入一个不会或基本不会出现畸形的姿态信息作为训练姿态识别模型时的监督信号(或者称之为先验信息,也就是第一姿态信息),来保证一方面更新后的姿态识别模型输出的姿态信息所确定的姿态可以和图像中人物对象的姿态实现像素级的对齐,另一方面所确定的姿态不会出现畸形(或者基本不会出现畸形)的情况。

[0225]

参照图13,图13为本技术实施例提供的一种数据处理装置的结构示意,如图13所示,本技术实施例提供的一种数据处理装置1300,包括:

[0226]

获取模块1301,用于获取目标图像;

[0227]

其中,关于获取模块1301的具体描述可以参照上述实施例中步骤801的介绍,这里

不再赘述。

[0228]

图像处理模块1302,用于通过第一姿态识别模型,对所述目标图像进行处理,得到所述目标图像中目标对象的第一姿态信息;

[0229]

通过第二姿态识别模型,对所述目标图像进行处理,得到所述目标图像中目标对象的第二姿态信息;所述第一姿态信息和所述第二姿态信息用于描述所述目标对象的三维姿态;所述第二姿态信息用于确定所述目标对象的预测姿态的二维投影信息;

[0230]

其中,关于图像处理模块1302的具体描述可以参照上述实施例中步骤802和803的介绍,这里不再赘述。

[0231]

模型更新模块1303,用于根据所述第一姿态信息和所述第二姿态信息、以及所述二维投影信息和对应的标注构建损失,所述损失用于更新所述第二姿态识别模型。

[0232]

其中,关于模型更新模块1303的具体描述可以参照上述实施例中步骤804的介绍,这里不再赘述。

[0233]

在一种可能的实现中,所述第一姿态识别模型为根据输出的姿态信息和对应的标注构建的损失训练得到的。

[0234]

在一种可能的实现中,

[0235]

所述通过第一姿态识别模型,对所述目标图像进行处理,还得到所述目标图像中目标对象的第一体型信息;

[0236]

所述通过第二姿态识别模型,对所述目标图像进行处理,还得到所述目标图像中目标对象的第二体型信息;

[0237]

所述模型更新模块,具体用于:

[0238]

根据所述第一姿态信息和所述第二姿态信息、所述关键点位置信息和对应的标注值、以及所述第一体型信息和所述第二体型信息构建损失。

[0239]

在一种可能的实现中,所述目标图像为原始图像中所述目标对象所处的图像区域,在计算二维投影信息时,所述二维投影信息表示为所述预测姿态的二维投影在所述原始图像中所处的位置,也就是说,可以在全图上计算重投影误差,更贴近图片形成时的投影过程。

[0240]

在一种可能的实现中,所述目标对象为人物。

[0241]

在一种可能的实现中,所述图像处理模块,还用于:

[0242]

通过更新后的所述第二姿态识别模型,处理所述目标图像,得到所述目标图像中目标对象的第三姿态信息;所述第三姿态信息用于确定所述目标对象的姿态。

[0243]

在一种可能的实现中,所述装置还包括:

[0244]

发送模块,用于向用户设备发送通过更新后的所述第二姿态识别模型处理所述目标图像得到的所述目标对象的姿态;或者,

[0245]

向用户设备发送所述更新后的所述第二姿态识别模型。

[0246]

接下来介绍本技术实施例提供的一种执行设备,请参阅图14,图14为本技术实施例提供的执行设备的一种结构示意图,执行设备1400具体可以表现为虚拟现实vr设备、手机、平板、笔记本电脑、智能穿戴设备、监控数据处理设备或服务器等,此处不做限定。具体的,执行设备1400包括:接收器1401、发射器1402、处理器1403和存储器1404(其中执行设备1400中的处理器1403的数量可以一个或多个,图14中以一个处理器为例),其中,处理器

1403可以包括应用处理器14031和通信处理器14032。在本技术的一些实施例中,接收器1401、发射器1402、处理器1403和存储器1404可通过总线或其它方式连接。

[0247]

存储器1404可以包括只读存储器和随机存取存储器,并向处理器1403提供指令和数据。存储器1404的一部分还可以包括非易失性随机存取存储器(non-volatile random access memory,nvram)。存储器1404存储有处理器和操作指令、可执行模块或者数据结构,或者它们的子集,或者它们的扩展集,其中,操作指令可包括各种操作指令,用于实现各种操作。

[0248]

处理器1403控制执行设备的操作。具体的应用中,执行设备的各个组件通过总线系统耦合在一起,其中总线系统除包括数据总线之外,还可以包括电源总线、控制总线和状态信号总线等。但是为了清楚说明起见,在图中将各种总线都称为总线系统。

[0249]

上述本技术实施例揭示的方法可以应用于处理器1403中,或者由处理器1403实现。处理器1403可以是一种集成电路芯片,具有信号的处理能力。在实现过程中,上述方法的各步骤可以通过处理器1403中的硬件的集成逻辑电路或者软件形式的指令完成。上述的处理器1403可以是通用处理器、数字信号处理器(digital signal processing,dsp)、微处理器或微控制器,还可进一步包括专用集成电路(application specific integrated circuit,asic)、现场可编程门阵列(field-programmable gate array,fpga)或者其他可编程逻辑器件、分立门或者晶体管逻辑器件、分立硬件组件。该处理器1403可以实现或者执行本技术实施例中的公开的各方法、步骤及逻辑框图。通用处理器可以是微处理器或者该处理器也可以是任何常规的处理器等。结合本技术实施例所公开的方法的步骤可以直接体现为硬件译码处理器执行完成,或者用译码处理器中的硬件及软件模块组合执行完成。软件模块可以位于随机存储器,闪存、只读存储器,可编程只读存储器或者电可擦写可编程存储器、寄存器等本领域成熟的存储介质中。该存储介质位于存储器1404,处理器1403读取存储器1404中的信息,结合其硬件完成上述方法中涉及模型推理过程的步骤。

[0250]

接收器1401可用于接收输入的数字或字符信息,以及产生与执行设备的相关设置以及功能控制有关的信号输入。发射器1402可用于通过第一接口输出数字或字符信息;发射器1402还可用于通过第一接口向磁盘组发送指令,以修改磁盘组中的数据;发射器1402还可以包括显示屏等显示设备。

[0251]

本技术实施例还提供了一种训练设备,请参阅图15,图15是本技术实施例提供的训练设备一种结构示意图,具体的,训练设备1500由一个或多个服务器实现,训练设备1500可因配置或性能不同而产生比较大的差异,可以包括一个或一个以上中央处理器(central processing units,cpu)1515(例如,一个或一个以上处理器)和存储器1532,一个或一个以上存储应用程序1542或数据1544的存储介质1530(例如一个或一个以上海量存储设备)。其中,存储器1532和存储介质1530可以是短暂存储或持久存储。存储在存储介质1530的程序可以包括一个或一个以上模块(图示没标出),每个模块可以包括对训练设备中的一系列指令操作。更进一步地,中央处理器1515可以设置为与存储介质1530通信,在训练设备1500上执行存储介质1530中的一系列指令操作。

[0252]

训练设备1500还可以包括一个或一个以上电源1526,一个或一个以上有线或无线网络接口1550,一个或一个以上输入输出接口1558;或,一个或一个以上操作系统1541,例如windows servertm,mac os xtm,unixtm,linuxtm,freebsdtm等等。

[0253]

本技术实施例中,中央处理器1515,用于执行上述实施例中和模型训练相关的动作。

[0254]

本技术实施例中还提供一种包括计算机程序产品,当其在计算机上运行时,使得计算机执行如前述执行设备所执行的步骤,或者,使得计算机执行如前述训练设备所执行的步骤。

[0255]

本技术实施例中还提供一种计算机可读存储介质,该计算机可读存储介质中存储有用于进行信号处理的程序,当其在计算机上运行时,使得计算机执行如前述执行设备所执行的步骤,或者,使得计算机执行如前述训练设备所执行的步骤。

[0256]

本技术实施例提供的执行设备、训练设备或终端设备具体可以为芯片,芯片包括:处理单元和通信单元,所述处理单元例如可以是处理器,所述通信单元例如可以是输入/输出接口、管脚或电路等。该处理单元可执行存储单元存储的计算机执行指令,以使执行设备内的芯片执行上述实施例描述的数据处理方法,或者,以使训练设备内的芯片执行上述实施例描述的数据处理方法。可选地,所述存储单元为所述芯片内的存储单元,如寄存器、缓存等,所述存储单元还可以是所述无线接入设备端内的位于所述芯片外部的存储单元,如只读存储器(read-only memory,rom)或可存储静态信息和指令的其他类型的静态存储设备,随机存取存储器(random access memory,ram)等。

[0257]

具体的,请参阅图16,图16为本技术实施例提供的芯片的一种结构示意图,所述芯片可以表现为神经网络处理器npu 1600,npu 1600作为协处理器挂载到主cpu(host cpu)上,由host cpu分配任务。npu的核心部分为运算电路1603,通过控制器1604控制运算电路1603提取存储器中的矩阵数据并进行乘法运算。

[0258]

在一些实现中,运算电路1603内部包括多个处理单元(process engine,pe)。在一些实现中,运算电路1603是二维脉动阵列。运算电路1603还可以是一维脉动阵列或者能够执行例如乘法和加法这样的数学运算的其它电子线路。在一些实现中,运算电路1603是通用的矩阵处理器。

[0259]

举例来说,假设有输入矩阵a,权重矩阵b,输出矩阵c。运算电路从权重存储器1602中取矩阵b相应的数据,并缓存在运算电路中每一个pe上。运算电路从输入存储器1601中取矩阵a数据与矩阵b进行矩阵运算,得到的矩阵的部分结果或最终结果,保存在累加器(accumulator)1608中。

[0260]

统一存储器1606用于存放输入数据以及输出数据。权重数据直接通过存储单元访问控制器(direct memory access controller,dmac)1605,dmac被搬运到权重存储器1602中。输入数据也通过dmac被搬运到统一存储器1606中。

[0261]

biu为bus interface unit即,总线接口单元1610,用于axi总线与dmac和取指存储器(instruction fetch buffer,ifb)1609的交互。

[0262]

总线接口单元1610(bus interface unit,简称biu),用于取指存储器1609从外部存储器获取指令,还用于存储单元访问控制器1605从外部存储器获取输入矩阵a或者权重矩阵b的原数据。

[0263]

dmac主要用于将外部存储器ddr中的输入数据搬运到统一存储器1606或将权重数据搬运到权重存储器1602中或将输入数据数据搬运到输入存储器1601中。

[0264]

向量计算单元1607包括多个运算处理单元,在需要的情况下,对运算电路1603的

输出做进一步处理,如向量乘,向量加,指数运算,对数运算,大小比较等等。主要用于神经网络中非卷积/全连接层网络计算,如batch normalization(批归一化),像素级求和,对特征平面进行上采样等。

[0265]

在一些实现中,向量计算单元1607能将经处理的输出的向量存储到统一存储器1606。例如,向量计算单元1607可以将线性函数;或,非线性函数应用到运算电路1603的输出,例如对卷积层提取的特征平面进行线性插值,再例如累加值的向量,用以生成激活值。在一些实现中,向量计算单元1607生成归一化的值、像素级求和的值,或二者均有。在一些实现中,处理过的输出的向量能够用作到运算电路1603的激活输入,例如用于在神经网络中的后续层中的使用。

[0266]

控制器1604连接的取指存储器(instruction fetch buffer)1609,用于存储控制器1604使用的指令;

[0267]

统一存储器1606,输入存储器1601,权重存储器1602以及取指存储器1609均为on-chip存储器。外部存储器私有于该npu硬件架构。

[0268]

其中,上述任一处提到的处理器,可以是一个通用中央处理器,微处理器,asic,或一个或多个用于控制上述程序执行的集成电路。

[0269]

另外需说明的是,以上所描述的装置实施例仅仅是示意性的,其中所述作为分离部件说明的单元可以是或者也可以不是物理上分开的,作为单元显示的部件可以是或者也可以不是物理单元,即可以位于一个地方,或者也可以分布到多个网络单元上。可以根据实际的需要选择其中的部分或者全部模块来实现本实施例方案的目的。另外,本技术提供的装置实施例附图中,模块之间的连接关系表示它们之间具有通信连接,具体可以实现为一条或多条通信总线或信号线。

[0270]

通过以上的实施方式的描述,所属领域的技术人员可以清楚地了解到本技术可借助软件加必需的通用硬件的方式来实现,当然也可以通过专用硬件包括专用集成电路、专用cpu、专用存储器、专用元器件等来实现。一般情况下,凡由计算机程序完成的功能都可以很容易地用相应的硬件来实现,而且,用来实现同一功能的具体硬件结构也可以是多种多样的,例如模拟电路、数字电路或专用电路等。但是,对本技术而言更多情况下软件程序实现是更佳的实施方式。基于这样的理解,本技术的技术方案本质上或者说对现有技术做出贡献的部分可以以软件产品的形式体现出来,该计算机软件产品存储在可读取的存储介质中,如计算机的软盘、u盘、移动硬盘、rom、ram、磁碟或者光盘等,包括若干指令用以使得一台计算机设备(可以是个人计算机,训练设备,或者网络设备等)执行本技术各个实施例所述的方法。

[0271]

在上述实施例中,可以全部或部分地通过软件、硬件、固件或者其任意组合来实现。当使用软件实现时,可以全部或部分地以计算机程序产品的形式实现。

[0272]

所述计算机程序产品包括一个或多个计算机指令。在计算机上加载和执行所述计算机程序指令时,全部或部分地产生按照本技术实施例所述的流程或功能。所述计算机可以是通用计算机、专用计算机、计算机网络、或者其他可编程装置。所述计算机指令可以存储在计算机可读存储介质中,或者从一个计算机可读存储介质向另一计算机可读存储介质传输,例如,所述计算机指令可以从一个网站站点、计算机、训练设备或数据中心通过有线(例如同轴电缆、光纤、数字用户线(dsl))或无线(例如红外、无线、微波等)方式向另一个网

站站点、计算机、训练设备或数据中心进行传输。所述计算机可读存储介质可以是计算机能够存储的任何可用介质或者是包含一个或多个可用介质集成的训练设备、数据中心等数据存储设备。所述可用介质可以是磁性介质,(例如,软盘、硬盘、磁带)、光介质(例如,dvd)、或者半导体介质(例如固态硬盘(solid state disk,ssd))等。

再多了解一些

本文用于创业者技术爱好者查询,仅供学习研究,如用于商业用途,请联系技术所有人。